Peranti teknologi

Peranti teknologi

AI

AI

Mengintegrasikan model bahasa, rangkaian saraf graf dan rangka kerja latihan graf teks GLEM dengan berkesan untuk mencapai SOTA baharu

Mengintegrasikan model bahasa, rangkaian saraf graf dan rangka kerja latihan graf teks GLEM dengan berkesan untuk mencapai SOTA baharu

Mengintegrasikan model bahasa, rangkaian saraf graf dan rangka kerja latihan graf teks GLEM dengan berkesan untuk mencapai SOTA baharu

- Unit utama: Montreal Algorithm Learning Artificial Intelligence Laboratory (Mila), Microsoft Research Asia, dsb.

- Alamat kertas: https://arxiv.org/abs/2210.14709

- Alamat kod: https://github.com /andyjzhao/glem

Pengenalan

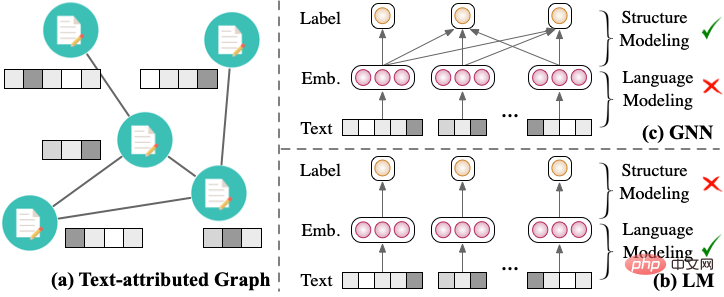

Rajah 1: (a) Graf teks (b) Rangkaian saraf graf (c) Model bahasa

Graf ialah struktur data universal yang memodelkan hubungan struktur antara nod. Dalam kehidupan sebenar, banyak nod mengandungi ciri teks yang kaya, dan graf ini dipanggil graf beratribut teks [2]. Sebagai contoh, rangkaian petikan kertas mengandungi teks kertas dan hubungan petikan antara kertas kerja itu mengandungi penerangan teks pengguna dan hubungan interaktif langsung pengguna. Model pembelajaran perwakilan pada graf teks boleh digunakan untuk tugas seperti pengelasan nod dan ramalan pautan, dan mempunyai nilai aplikasi yang luas.

Graf teks mengandungi dua aspek maklumat: maklumat teks nod dan maklumat struktur graf antara nod. Pemodelan graf teks tradisional boleh dibahagikan kepada dua perspektif: pemodelan teks dan pemodelan graf. Antaranya, kaedah pemodelan teks (ditunjukkan dalam Rajah 1.b) biasanya menggunakan model bahasa berasaskan Transformer (LM) untuk mendapatkan perwakilan teks bagi satu nod dan meramalkan tugasan sasaran kaedah pemodelan pemodelan graf (Seperti yang ditunjukkan dalam Rajah 1.c), rangkaian neural graf (GNN) biasanya digunakan untuk memodelkan interaksi antara ciri nod dan meramalkan tugas sasaran melalui mekanisme penyebaran mesej.

Walau bagaimanapun, kedua-dua model hanya boleh memodelkan struktur teks dan graf dalam graf teks masing-masing: model bahasa tradisional tidak boleh mempertimbangkan secara langsung maklumat struktur, dan rangkaian saraf graf tidak boleh mempertimbangkan secara langsung maklumat teks asal. Untuk memodelkan struktur teks dan graf pada masa yang sama, penyelidik cuba mengintegrasikan model bahasa dan rangkaian saraf graf serta mengemas kini parameter kedua-dua model secara serentak. Walau bagaimanapun, kerja sedia ada [2, 3] tidak boleh memodelkan sejumlah besar teks jiran pada masa yang sama, mempunyai kebolehskalaan yang lemah, dan tidak boleh digunakan pada graf teks yang besar.

Rangka kerja GLEM

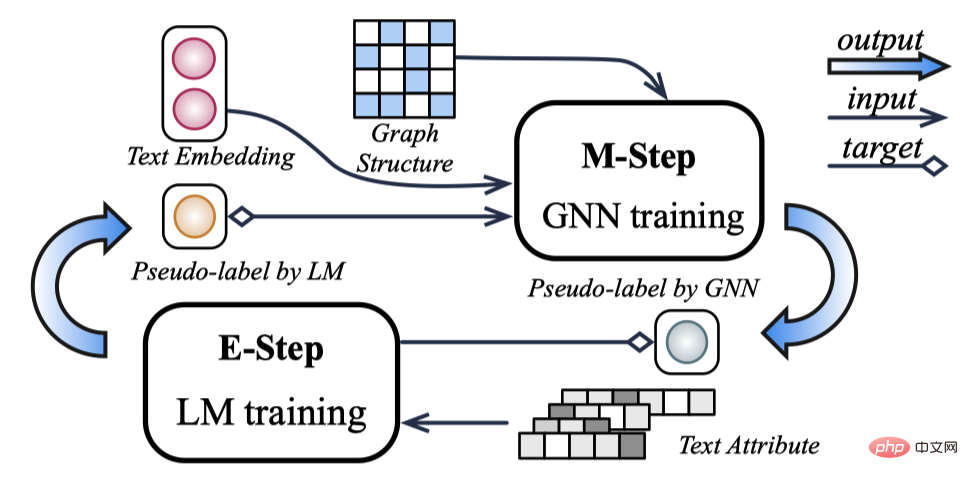

Untuk menyepadukan rangkaian saraf graf dan model bahasa dengan lebih berkesan, artikel ini mencadangkan Graph dan LPembelajaran bahasa oleh rangka kerja Expectation Maximization (GLEM). Rangka kerja GLEM adalah berdasarkan algoritma maksimum jangkaan variasi (Variational EM) dan secara bergilir-gilir mempelajari rangkaian saraf graf dan model bahasa, sekali gus mencapai kebolehskalaan yang baik.

Rajah 2: Rangka kerja GLEM

Secara khususnya, mengambil tugas pengelasan nod sebagai contoh, dalam E langkah , GLEM melatih model bahasa berdasarkan label sebenar dan label pseudo yang diramalkan oleh rangkaian saraf graf; >M langkah , GLEM melatih rangkaian saraf graf berdasarkan label sebenar dan label pseudo yang diramalkan oleh model bahasa. Dengan cara ini, rangka kerja GLEM secara berkesan melombong maklumat tekstual tempatan dan maklumat interaksi struktur global. Kedua-dua rangkaian saraf graf (GLEM-GNN) dan model bahasa (GLEM-LM) yang dilatih melalui rangka kerja GLEM boleh digunakan untuk meramalkan label nod.

Eksperimen

Bahagian eksperimen kertas terutamanya membincangkan rangka kerja GLEM dari aspek berikut:

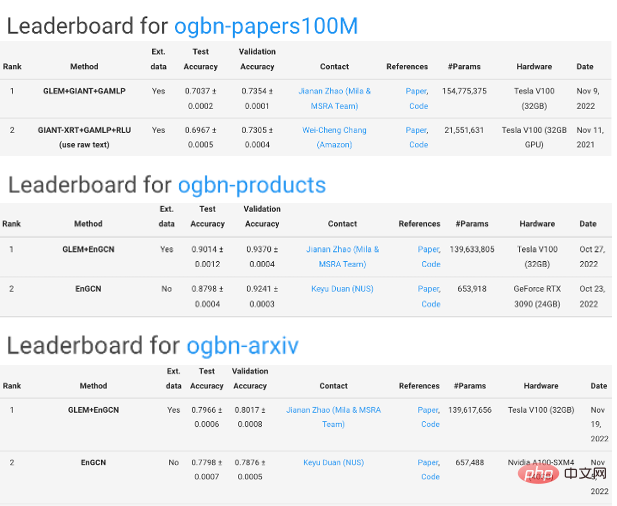

- Keberkesanan: Model GLEM boleh menyepadukan rangkaian saraf graf dan model bahasa dengan berkesan, meningkatkan kedua-dua model dengan ketara. Rangka kerja GLEM mencapai tempat pertama pada tiga tugas pengelasan nod graf teks di OGB.

- Skalabiliti: Dengan melatih rangkaian saraf dan model bahasa graf secara bergilir-gilir, rangka kerja GLEM boleh melatih model bahasa besar dan GNN mendalam secara serentak.

- Keupayaan penaakulan induktif bebas struktur: Model GNN tradisional berprestasi lemah apabila menghadapi nod baharu tanpa struktur graf. Sebaliknya, GLEM-LM membolehkan inferens yang cekap hanya menggunakan ciri teks (tanpa struktur graf).

- Penumpuan model: GLEM menggunakan algoritma lelaran EM dan boleh menumpu dalam satu lelaran EM pada beberapa set data.

Rajah 3: Rangka kerja GLEM memenangi tempat pertama pada set data OGBN-arxiv, products, papers100M

Atas ialah kandungan terperinci Mengintegrasikan model bahasa, rangkaian saraf graf dan rangka kerja latihan graf teks GLEM dengan berkesan untuk mencapai SOTA baharu. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1376

1376

52

52

Bytedance Cutting melancarkan keahlian super SVIP: 499 yuan untuk langganan tahunan berterusan, menyediakan pelbagai fungsi AI

Jun 28, 2024 am 03:51 AM

Bytedance Cutting melancarkan keahlian super SVIP: 499 yuan untuk langganan tahunan berterusan, menyediakan pelbagai fungsi AI

Jun 28, 2024 am 03:51 AM

Laman web ini melaporkan pada 27 Jun bahawa Jianying ialah perisian penyuntingan video yang dibangunkan oleh FaceMeng Technology, anak syarikat ByteDance Ia bergantung pada platform Douyin dan pada asasnya menghasilkan kandungan video pendek untuk pengguna platform tersebut Windows , MacOS dan sistem pengendalian lain. Jianying secara rasmi mengumumkan peningkatan sistem keahliannya dan melancarkan SVIP baharu, yang merangkumi pelbagai teknologi hitam AI, seperti terjemahan pintar, penonjolan pintar, pembungkusan pintar, sintesis manusia digital, dsb. Dari segi harga, yuran bulanan untuk keratan SVIP ialah 79 yuan, yuran tahunan ialah 599 yuan (nota di laman web ini: bersamaan dengan 49.9 yuan sebulan), langganan bulanan berterusan ialah 59 yuan sebulan, dan langganan tahunan berterusan ialah 499 yuan setahun (bersamaan dengan 41.6 yuan sebulan) . Di samping itu, pegawai yang dipotong juga menyatakan bahawa untuk meningkatkan pengalaman pengguna, mereka yang telah melanggan VIP asal

Pembantu pengekodan AI yang ditambah konteks menggunakan Rag dan Sem-Rag

Jun 10, 2024 am 11:08 AM

Pembantu pengekodan AI yang ditambah konteks menggunakan Rag dan Sem-Rag

Jun 10, 2024 am 11:08 AM

Tingkatkan produktiviti, kecekapan dan ketepatan pembangun dengan menggabungkan penjanaan dipertingkatkan semula dan memori semantik ke dalam pembantu pengekodan AI. Diterjemah daripada EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, pengarang JanakiramMSV. Walaupun pembantu pengaturcaraan AI asas secara semulajadi membantu, mereka sering gagal memberikan cadangan kod yang paling relevan dan betul kerana mereka bergantung pada pemahaman umum bahasa perisian dan corak penulisan perisian yang paling biasa. Kod yang dijana oleh pembantu pengekodan ini sesuai untuk menyelesaikan masalah yang mereka bertanggungjawab untuk menyelesaikannya, tetapi selalunya tidak mematuhi piawaian pengekodan, konvensyen dan gaya pasukan individu. Ini selalunya menghasilkan cadangan yang perlu diubah suai atau diperhalusi agar kod itu diterima ke dalam aplikasi

Tujuh Soalan Temuduga Teknikal GenAI & LLM yang Cool

Jun 07, 2024 am 10:06 AM

Tujuh Soalan Temuduga Teknikal GenAI & LLM yang Cool

Jun 07, 2024 am 10:06 AM

Untuk mengetahui lebih lanjut tentang AIGC, sila layari: 51CTOAI.x Komuniti https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou berbeza daripada bank soalan tradisional yang boleh dilihat di mana-mana sahaja di Internet memerlukan pemikiran di luar kotak. Model Bahasa Besar (LLM) semakin penting dalam bidang sains data, kecerdasan buatan generatif (GenAI) dan kecerdasan buatan. Algoritma kompleks ini meningkatkan kemahiran manusia dan memacu kecekapan dan inovasi dalam banyak industri, menjadi kunci kepada syarikat untuk kekal berdaya saing. LLM mempunyai pelbagai aplikasi Ia boleh digunakan dalam bidang seperti pemprosesan bahasa semula jadi, penjanaan teks, pengecaman pertuturan dan sistem pengesyoran. Dengan belajar daripada sejumlah besar data, LLM dapat menjana teks

Bolehkah penalaan halus benar-benar membolehkan LLM mempelajari perkara baharu: memperkenalkan pengetahuan baharu boleh menjadikan model menghasilkan lebih banyak halusinasi

Jun 11, 2024 pm 03:57 PM

Bolehkah penalaan halus benar-benar membolehkan LLM mempelajari perkara baharu: memperkenalkan pengetahuan baharu boleh menjadikan model menghasilkan lebih banyak halusinasi

Jun 11, 2024 pm 03:57 PM

Model Bahasa Besar (LLM) dilatih pada pangkalan data teks yang besar, di mana mereka memperoleh sejumlah besar pengetahuan dunia sebenar. Pengetahuan ini dibenamkan ke dalam parameter mereka dan kemudiannya boleh digunakan apabila diperlukan. Pengetahuan tentang model ini "diperbaharui" pada akhir latihan. Pada akhir pra-latihan, model sebenarnya berhenti belajar. Selaraskan atau perhalusi model untuk mempelajari cara memanfaatkan pengetahuan ini dan bertindak balas dengan lebih semula jadi kepada soalan pengguna. Tetapi kadangkala pengetahuan model tidak mencukupi, dan walaupun model boleh mengakses kandungan luaran melalui RAG, ia dianggap berfaedah untuk menyesuaikan model kepada domain baharu melalui penalaan halus. Penalaan halus ini dilakukan menggunakan input daripada anotasi manusia atau ciptaan LLM lain, di mana model menemui pengetahuan dunia sebenar tambahan dan menyepadukannya

Versi Kuaishou Sora 'Ke Ling' dibuka untuk ujian: menghasilkan video lebih 120-an, memahami fizik dengan lebih baik dan boleh memodelkan pergerakan kompleks dengan tepat

Jun 11, 2024 am 09:51 AM

Versi Kuaishou Sora 'Ke Ling' dibuka untuk ujian: menghasilkan video lebih 120-an, memahami fizik dengan lebih baik dan boleh memodelkan pergerakan kompleks dengan tepat

Jun 11, 2024 am 09:51 AM

Apa? Adakah Zootopia dibawa menjadi realiti oleh AI domestik? Didedahkan bersama-sama dengan video itu ialah model penjanaan video domestik berskala besar baharu yang dipanggil "Keling". Sora menggunakan laluan teknikal yang serupa dan menggabungkan beberapa inovasi teknologi yang dibangunkan sendiri untuk menghasilkan video yang bukan sahaja mempunyai pergerakan yang besar dan munasabah, tetapi juga mensimulasikan ciri-ciri dunia fizikal dan mempunyai keupayaan gabungan konsep dan imaginasi yang kuat. Mengikut data, Keling menyokong penjanaan video ultra panjang sehingga 2 minit pada 30fps, dengan resolusi sehingga 1080p dan menyokong berbilang nisbah aspek. Satu lagi perkara penting ialah Keling bukanlah demo atau demonstrasi hasil video yang dikeluarkan oleh makmal, tetapi aplikasi peringkat produk yang dilancarkan oleh Kuaishou, pemain terkemuka dalam bidang video pendek. Selain itu, tumpuan utama adalah untuk menjadi pragmatik, bukan untuk menulis cek kosong, dan pergi ke dalam talian sebaik sahaja ia dikeluarkan Model besar Ke Ling telah pun dikeluarkan di Kuaiying.

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Editor |ScienceAI Question Answering (QA) set data memainkan peranan penting dalam mempromosikan penyelidikan pemprosesan bahasa semula jadi (NLP). Set data QA berkualiti tinggi bukan sahaja boleh digunakan untuk memperhalusi model, tetapi juga menilai dengan berkesan keupayaan model bahasa besar (LLM), terutamanya keupayaan untuk memahami dan menaakul tentang pengetahuan saintifik. Walaupun pada masa ini terdapat banyak set data QA saintifik yang meliputi bidang perubatan, kimia, biologi dan bidang lain, set data ini masih mempunyai beberapa kekurangan. Pertama, borang data adalah agak mudah, kebanyakannya adalah soalan aneka pilihan. Ia mudah dinilai, tetapi mengehadkan julat pemilihan jawapan model dan tidak dapat menguji sepenuhnya keupayaan model untuk menjawab soalan saintifik. Sebaliknya, Soal Jawab terbuka

Lima sekolah pembelajaran mesin yang anda tidak tahu

Jun 05, 2024 pm 08:51 PM

Lima sekolah pembelajaran mesin yang anda tidak tahu

Jun 05, 2024 pm 08:51 PM

Pembelajaran mesin ialah cabang penting kecerdasan buatan yang memberikan komputer keupayaan untuk belajar daripada data dan meningkatkan keupayaan mereka tanpa diprogramkan secara eksplisit. Pembelajaran mesin mempunyai pelbagai aplikasi dalam pelbagai bidang, daripada pengecaman imej dan pemprosesan bahasa semula jadi kepada sistem pengesyoran dan pengesanan penipuan, dan ia mengubah cara hidup kita. Terdapat banyak kaedah dan teori yang berbeza dalam bidang pembelajaran mesin, antaranya lima kaedah yang paling berpengaruh dipanggil "Lima Sekolah Pembelajaran Mesin". Lima sekolah utama ialah sekolah simbolik, sekolah sambungan, sekolah evolusi, sekolah Bayesian dan sekolah analogi. 1. Simbolisme, juga dikenali sebagai simbolisme, menekankan penggunaan simbol untuk penaakulan logik dan ekspresi pengetahuan. Aliran pemikiran ini percaya bahawa pembelajaran adalah proses penolakan terbalik, melalui sedia ada

Pemula AI secara kolektif menukar pekerjaan kepada OpenAI, dan pasukan keselamatan berkumpul semula selepas Ilya pergi!

Jun 08, 2024 pm 01:00 PM

Pemula AI secara kolektif menukar pekerjaan kepada OpenAI, dan pasukan keselamatan berkumpul semula selepas Ilya pergi!

Jun 08, 2024 pm 01:00 PM

Minggu lalu, di tengah gelombang peletakan jawatan dalaman dan kritikan luar, OpenAI dibelenggu oleh masalah dalaman dan luaran: - Pelanggaran kakak balu itu mencetuskan perbincangan hangat global - Pekerja menandatangani "fasal tuan" didedahkan satu demi satu - Netizen menyenaraikan " Ultraman " tujuh dosa maut" ” Pembasmi khabar angin: Menurut maklumat dan dokumen bocor yang diperolehi oleh Vox, kepimpinan kanan OpenAI, termasuk Altman, sangat mengetahui peruntukan pemulihan ekuiti ini dan menandatanganinya. Di samping itu, terdapat isu serius dan mendesak yang dihadapi oleh OpenAI - keselamatan AI. Pemergian lima pekerja berkaitan keselamatan baru-baru ini, termasuk dua pekerjanya yang paling terkemuka, dan pembubaran pasukan "Penjajaran Super" sekali lagi meletakkan isu keselamatan OpenAI dalam perhatian. Majalah Fortune melaporkan bahawa OpenA