Pada Disember 2022, ChatGPT telah dilahirkan. OpenAI telah mengubah paradigma penyelidikan saintifik dan aplikasi kejuruteraan dengan hasil peringkat bom nuklear. Di China, ChatGPT telah mendapat perhatian meluas dan perbincangan mendalam. Pada bulan lalu, saya melawat universiti utama, institut penyelidikan, kilang besar, syarikat permulaan, dan modal teroka dari Beijing ke Shanghai ke Hangzhou ke Shenzhen, saya bercakap dengan semua pemain terkemuka. The Game of Scale telah pun bermula di China Bagaimana pemain di tengah-tengah ribut dapat mencapai ini memandangkan jurang yang besar antara teknologi domestik dan ekologi dan kelebihan utama dunia? Siapa yang boleh melakukan ini?

Qin kehilangan rusanya, dan seluruh dunia menghalaunya. ———— "Rekod Sejarah·Biografi Marquis of Huaiyin"

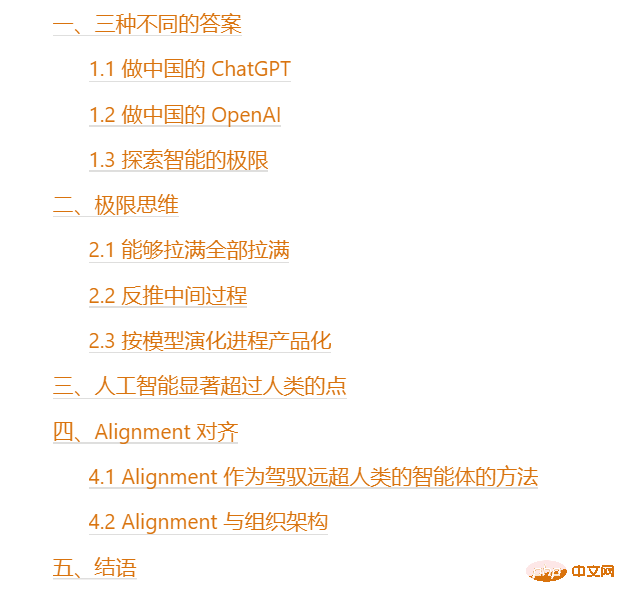

Setiap kali saya berhubung dengan syarikat permulaan, saya akan bertanya soalan yang sama: "Di manakah ChatGPT, apakah yang anda mahu lakukan, saya mungkin boleh menerima tiga jawapan yang berbeza?" Jawapan pertama adalah jelas: untuk membina ChatGPT China.

1.1 Membuat ChatGPT China

Oleh kerana ia ada di sana, saya ingin mengeluarkannya semula dan mengubahnya secara domestik. Ini adalah pemikiran Internet Cina berorientasikan produk yang sangat klasik . Idea ini juga merupakan model perniagaan biasa Internet Cina dalam dua dekad yang lalu: pertama Silicon Valley membuat sesuatu, dan kemudian kami menyalinnya.

Tetapi masalahnya di sini ialah, pertama sekali, ChatGPT bukanlah seperti perisian panggilan teksi, dan kesukaran pembiakan adalah berbeza sama sekali. Dari perspektif manusia, penciptaan GPT adalah hasil penyelidikan berterusan oleh saintis dan jurutera terkemuka dunia sejak 2015. Ketua saintis OpenAI, Ilya Sutskever[1], amat percaya bahawa AGI boleh dicapai. Sebagai murid kepada pemenang Anugerah Turing, Geoffery Hinton, dia telah mempelajari pembelajaran mendalam sejak 2007. Beliau mempunyai 370,000 petikan, dan artikel yang telah diterbitkannya tepat mengenai semua nod utama Pembelajaran Dalam dalam tempoh sepuluh tahun yang lalu. Walaupun dengan pasukan yang begitu kuat, ia mengambil masa empat tahun untuk pergi dari GPT 2 ke GPT 3.5 Orang boleh bayangkan kesukaran sains dan kejuruteraannya.

Pada masa yang sama, generasi pertama ChatGPT adalah berdasarkan model asas OpenAI bagi GPT 3.5 Selepas menghabiskan dua minggu melakukan penalaan halus. pada dialog Buang demo . Kekuatan sebenar di sini bukanlah ChatGPT produk, tetapi model asas GPT 3.5 yang mendasari. Model ini masih berkembang. Siri GPT 3.5 telah dikemas kini dengan tiga versi utama pada tahun 2022[2], setiap versi utama jauh lebih kuat daripada versi sebelumnya, sama seperti ChatGPT dikeluarkan dua bulan lalu daripada empat versi kecil telah dikemas kini [3], setiap versi kecil mempunyai peningkatan yang jelas berbanding versi sebelumnya dalam satu dimensi. Semua model OpenAI sentiasa berkembang dan semakin kukuh dari semasa ke semasa.

Ini juga bermakna jika anda hanya menumpukan pada produk ChatGPT semasa, adalah sama seperti mencari pedang pada saat genting . Apabila ChatGPT muncul, ia menyebabkan tamparan pengurangan dimensi kepada pembantu suara sedia ada jika anda tidak dapat melihat evolusi model asas, walaupun anda menghabiskan satu atau dua tahun bekerja keras untuk membuat sesuatu yang serupa, asas OpenAI pada masa itu; Model juga terus menjadi lebih kukuh jika mereka terus menghasilkan dan memperkemaskan produk yang lebih kukuh dengan model asas baharu yang lebih kukuh, adakah mereka akan mengalami pengurangan dimensi lagi?

Pendekatan mengukir perahu dan mencari pedang tidak akan berhasil.

1.2 Menjadi OpenAI China

Jawapan kedua ialah menjadi OpenAI China. Pemain yang memberikan jawapan ini melompat keluar dari pemikiran produk Internet Cina klasik. Mereka bukan sahaja melihat satu produk, tetapi juga melihat daya penggerak yang kuat untuk evolusi berterusan model asas di sebalik produk ini, yang datang daripada kepadatan bakat termaju dan struktur organisasi teknologi canggih. Jadi, jika anda mahu melakukannya ini, anda bukan sahaja perlu melihat Untuk produk, kita juga perlu melihat pasukan bakat dan struktur organisasi di belakangnya jika disenaraikan mengikut kekurangan, orang>> kad>> wang. Tetapi masalahnya di sini ialah tanah yang berbeza menggalakkan inovasi pada tahap yang berbeza. Apabila OpenAI mula-mula diasaskan pada 2015, pelaburnya percaya kepada AGI, walaupun tiada keuntungan dilihat pada masa itu. Kini GPT telah dibangunkan, pelabur domestik juga telah mempercayai AGI, tetapi kepercayaan mereka mungkin berbeza: Sekiranya mereka percaya bahawa AGI boleh menjana wang, atau haruskah mereka percaya bahawa AGI boleh menggalakkan pembangunan manusia ? Selain itu, walaupun OpenAI dilahirkan di sini dan akan muncul esok, bolehkah perjanjian yang mereka capai dengan Microsoft dapat dicapai dengan pengeluar pengkomputeran awan domestik? Latihan dan inferens model besar memerlukan kos yang besar dan memerlukan enjin pengkomputeran awan sebagai sokongan. Microsoft boleh menumpukan segala usahanya untuk membenarkan seluruh Azure membantu OpenAI[4] Jika ini dipindahkan ke China, adakah mungkin untuk Alibaba Cloud membantu syarikat permulaan. ? Struktur organisasi adalah sangat penting hanya bakat termaju dan struktur organisasi yang maju boleh menggalakkan lelaran dan evolusi kecerdasan yang berterusan tetapi ia juga perlu menyesuaikan diri dengan tanah di mana ia berada , dan mencari kaedah untuk berkembang maju. 1.3 Meneroka had kecerdasan Jawapan ketiga ialah meneroka kecerdasan had . Ini adalah jawapan terbaik yang saya dengar. Ia melampaui pemikiran produk Internet klasik untuk mencari pedang pada setiap masa Ia juga melihat kepentingan struktur organisasi dan ketumpatan bakat termaju Lebih penting lagi, ia melihat masa depan, melihat evolusi model dan lelaran produk, dan berfikir tentang cara mengintegrasikan perkara yang paling mendalam dan paling mendalam Masalah sukar diselesaikan dengan pendekatan yang paling inovatif. Ini melibatkan pemikiran yang melampau tentang model besar. Memerhatikan ChatGPT / GPT-3.5 semasa, ia jelas merupakan keadaan pertengahan yang masih mempunyai banyak peningkatan yang boleh dipertingkatkan ia akan tersedia tidak lama lagi. Perkara yang diperkukuh termasuk: Kotak input model boleh dipanjangkan dan saiz model boleh diteruskan Apabila model meningkat, data model boleh terus meningkat, data berbilang modal boleh disepadukan, tahap pengkhususan model boleh terus meningkat, dan semua dimensi ini boleh terus ditarik ke atas model belum mencapai hadnya. Had ialah satu proses. Bagaimanakah keupayaan model akan berkembang semasa proses ini?

Lengkung log-linear: Pertumbuhan beberapa keupayaan akan mengikuti lengkung log-linear Setelah berfikir dengan jelas tentang proses had, anda boleh membalikkan proses perantaraan daripada keadaan had. Sebagai contoh, jika kita ingin meningkatkan saiz kotak input: Dengan cara ini, kita boleh membuat kesimpulan tentang teknologi yang diperlukan untuk penskalaan pada peringkat yang berbeza. Analisis di atas bukan sahaja digunakan pada panjang kotak input, tetapi juga digunakan untuk proses penskalaan faktor lain. Dengan cara ini, kita boleh mendapatkan peta jalan teknologi yang jelas untuk setiap peringkat pertengahan daripada teknologi semasa hingga had penskalaan . 2.3 Pengeluaran mengikut proses evolusi model Model sentiasa berkembang, tetapi pengeluaran tidak perlu menunggu sehingga yang terakhir Penyiapan Model - Setiap kali versi besar model diulang, ia boleh dikomersialkan. Ambil proses penghasilan OpenAI sebagai contoh: Dapat dilihat bahawa dalam setiap versi penting dalam perantaraan peringkat, keupayaan model akan dipertingkatkan, dan akan ada peluang untuk pengeluaran. Lebih penting lagi, dengan mengikuti proses evolusi model dan menghasilkannya, anda boleh menyesuaikan diri dengan pasaran semasa peringkat pengeluaran. Ketahui struktur organisasi OpenAI untuk mempromosikan evolusi model itu sendiri, tetapi pengeluaran boleh berdasarkan ciri-ciri pasaran tempatan. Pendekatan ini mungkin membolehkan kita belajar daripada pengalaman lanjutan OpenAI sambil mengelakkan masalah penyesuaian diri. Setakat ini, kami telah membincangkan keperluan untuk menganalisis model dari perspektif evolusi model dan membincangkannya dengan pemikiran yang melampau Evolusi model. Perkara yang boleh dipertingkatkan serta-merta pada peringkat ini termasuk panjang kotak input, model dan data yang lebih besar, data berbilang modal dan tahap pengkhususan model. Sekarang mari kita lihat pandangan jangka panjang dan fikirkan tentang cara model itu boleh ditolak lebih jauh ke hadnya dalam masa dan ruang yang lebih besar. Kami membincangkan: Dari perspektif ini, tidak dapat dibayangkan bahawa kecerdasan buatan akan mengatasi manusia. Ini membawa kepada soalan seterusnya: Bagaimana untuk mengawal kecerdasan buatan yang kuat yang jauh melebihi kecerdasan manusia? Masalah inilah yang sebenarnya ingin diselesaikan oleh teknologi Alignment. Pada peringkat semasa, kecuali AlphaGo mengatasi manusia terkuat dalam Go, aspek AI yang lain belum mengatasi manusia yang lebih kuat (tetapi ChatGPT mungkin telah melebihi 95% manusia dalam seni liberal, dan ia terus berkembang). Apabila model itu belum mengatasi manusia, tugas Alignment adalah untuk menjadikan model itu mematuhi nilai-nilai manusia tetapi selepas model tersebut terus berkembang untuk mengatasi manusia, tugas Alignment adalah untuk mencari cara untuk mengawal agen pintar yang jauh melebihi. manusia. 4.1 Penjajaran sebagai kaedah untuk mengawal agen pintar yang jauh melebihi manusia Masalah yang jelas ialah selepas AI mengatasi manusia, adakah ia masih mampu Menjadikan dia lebih kuat/lebih berdisiplin melalui maklum balas manusia? Adakah ia di luar kawalan pada ketika ini? Tidak semestinya model itu jauh lebih hebat daripada manusia, kita masih boleh mengawalnya di antara atlet dan jurulatih Hubungan: Atlet pingat emas itu sudah menjadi manusia paling kuat ke arahnya, tetapi ini tidak bermakna jurulatih tidak boleh melatihnya. Sebaliknya, walaupun jurulatih tidak sehebat atlet, dia masih boleh menjadikan atlet itu lebih kuat dan berdisiplin melalui pelbagai mekanisme maklum balas. Begitu juga, hubungan antara manusia dan kecerdasan buatan yang kuat mungkin menjadi hubungan antara atlet dan jurulatih di peringkat pertengahan dan kemudian pembangunan AI. Pada masa ini, keupayaan yang manusia perlukan bukanlah untuk melengkapkan matlamat , tetapi untuk menetapkan matlamat yang baik dan kemudian mengukur sama ada mesin itu Capai matlamat ini dengan cukup baik dan berikan cadangan untuk penambahbaikan. Penyelidikan ke arah ini masih sangat awal. Nama subjek baharu ini ialah Scalable Oversight[15] 4.2 Penjajaran dan Struktur Organisasi Di jalan menuju kecerdasan buatan yang kuat, bukan sahaja manusia dan AI perlu diselaraskan, manusia dan manusia juga memerlukan kecerdasan buatan yang tinggi. darjah penjajaran . Dari perspektif struktur organisasi, penjajaran melibatkan: Pada tahun 2017, apabila saya mula-mula memasuki industri NLP, saya menghabiskan banyak usaha untuk penjanaan yang boleh dikawal. Pada masa itu, pemindahan gaya teks yang paling dipanggil ialah menukar klasifikasi sentimen ayat Penukaran baik kepada buruk dianggap sebagai pemindahan lengkap. Pada tahun 2018, saya menghabiskan banyak masa untuk mengkaji cara membenarkan model mengubah suai gaya ayat dari perspektif struktur ayat. Saya pernah tersalah anggap bahawa penukaran gaya hampir mustahil untuk dicapai. Kini ChatGPT menjadikan penukaran gaya sangat mudah. Tugas yang dahulunya kelihatan mustahil, perkara yang dahulunya amat sukar, kini boleh dicapai dengan mudah dengan model bahasa yang besar. Sepanjang tahun 2022, saya menjejaki semua lelaran versi daripada GPT-3 hingga GPT-3.5[11] dan melihat dengan mata kepala saya sendiri evolusi berterusannya daripada lemah kepada kuat langkah demi langkah. Kadar evolusi ini tidak perlahan, tetapi semakin pantas. Apa yang dahulunya kelihatan seperti fiksyen sains kini telah menjadi kenyataan. Siapa tahu apa masa depan? Sekoi dipisahkan, anak pokok padi semakin membesar. Langkahnya perlahan dan malu-malu, dan pusatnya bergegar. Millet dipisahkan, bulir biji dipisahkan. Berjalan ke hadapan dengan langkah yang hebat, pusat itu seperti mabuk. ———— "Kitab Lagu·Muli"

2. Pemikiran Melampau

, seperti menyempurnakan tugasan tertentu. Apabila data finetune berkembang secara eksponen, keupayaan tugas finetune yang sepadan dengan model akan berkembang secara linear. Kebolehan ini dijangka akan menjadi lebih kuat

kaedah, kerana menambah memori video pada masa ini sepatutnya tidak dapat menyokong peningkatan kuadratik dalam volum pengiraan perhatian dengan panjang kotak input.

3 Titik di mana kecerdasan buatan mengatasi manusia dengan ketara

4. Penjajaran

5. Kesimpulan

Atas ialah kandungan terperinci Siapa yang boleh membuat ChatGPT versi Cina? Bagaimana untuk melakukannya?. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

penggunaan atribut

penggunaan atribut

Alat penilaian nama domain tapak web

Alat penilaian nama domain tapak web

Apakah pelayan awan?

Apakah pelayan awan?

Bagaimana untuk menyelesaikan masalah kehilangan steam_api.dll

Bagaimana untuk menyelesaikan masalah kehilangan steam_api.dll

pelayar Ethereum pertanyaan mata wang digital

pelayar Ethereum pertanyaan mata wang digital

Komponen utama yang membentuk CPU

Komponen utama yang membentuk CPU

Apakah kaedah pemindahan fail java?

Apakah kaedah pemindahan fail java?

Bagaimana untuk menetapkan komputer untuk menyambung ke WiFi secara automatik

Bagaimana untuk menetapkan komputer untuk menyambung ke WiFi secara automatik

Adakah perdagangan Bitcoin dibenarkan di China?

Adakah perdagangan Bitcoin dibenarkan di China?