Untuk menjelaskan isu ini, platform American Zeta Alpha mengira 100 kertas AI yang paling banyak disebut di dunia antara 2020 dan 2022, dan menghasilkan beberapa hasil yang sangat menarik.

Contohnya:

"Bintang popular" OpenAI menduduki tempat ke-9 dalam kalangan institusi yang paling banyak disebut kertas kerja.

Walau bagaimanapun, namanya tidak dapat ditemui sama sekali dalam senarai institusi yang mempunyai bilangan terbesar kertas terbitan.

Untuk contoh lain, Google Meta dan Microsoft dari industri sentiasa antara yang terbaik dalam pelbagai data Walau bagaimanapun, secara amnya, akademik tidak ketinggalan dalam industri.

Selain itu, pandangan sebelum ini bahawa "kuantiti dan kualiti hasil penyelidikan AI China mungkin melebihi Amerika Syarikat" nampaknya telah dipecahkan dalam laporan ini -

Lebih banyak data dan khusus , Mari kita lihat mereka satu persatu.

Sebelum analisis khusus, Zeta Alpha terlebih dahulu mengira kertas yang paling banyak disebut setiap tahun dari 2020 hingga 2022. Ia adalah:

2022:

1. Pangkalan Data Struktur Protein AlphaFold: Memperluaskan liputan struktur ruang jujukan protein dengan model ketepatan tinggi

Bilangan petikan: 1372

Institusi: Dilengkapkan melalui pelbagai kerjasama.

Topik: Model lipatan protein sumber terbuka dan cekap

Institusi: OpenAI

Topik: DALL·E 2

Institusi: Meta dan UC Berkeley

Topik: Berjaya memodenkan CNN semasa Transformer boom

Institusi: Google

Topik: Model bahasa besar 540B Google, paradigma MLOps baharu, termasuk Proses pelaksanaannya

Institusi: DeepMind

Topik: AlphaFold, A kejayaan besar dalam ramalan struktur protein menggunakan pembelajaran mendalam

Institusi: Microsoft

Topik: ViT Powerful Varian

Institusi: OpenAI

Topik: CLIP

Institusi: Washington, DC, Amerika Syarikat, Black dalam AI, The Aether

Topik: Kertas kedudukan penting mengenai pertumbuhan Bersikap kritis terhadap trend model bahasa, menekankan batasan dan bahayanya

Institusi: Meta

Topik: DINO, mendedahkan cara penyeliaan kendiri imej membawa kepada beberapa jenis pembahagian proto-objek dalam Transformers

Institusi: Google

Topik: Kerja pertama untuk menunjukkan prestasi Transformer biasa dalam bidang penglihatan komputer

Institusi: OpenAI

Topik: GPT-3

Institusi: "Academia Sinica", Taiwan, China

Topik: YOLOv4

Organisasi: Google

Topik: Kajian yang teliti tentang pembelajaran pemindahan Transformer menghasilkan T5

Institusi: DeepMind dan Imperial College

Topik: Menunjukkan bahawa negatif tidak diperlukan untuk pembelajaran perwakilan

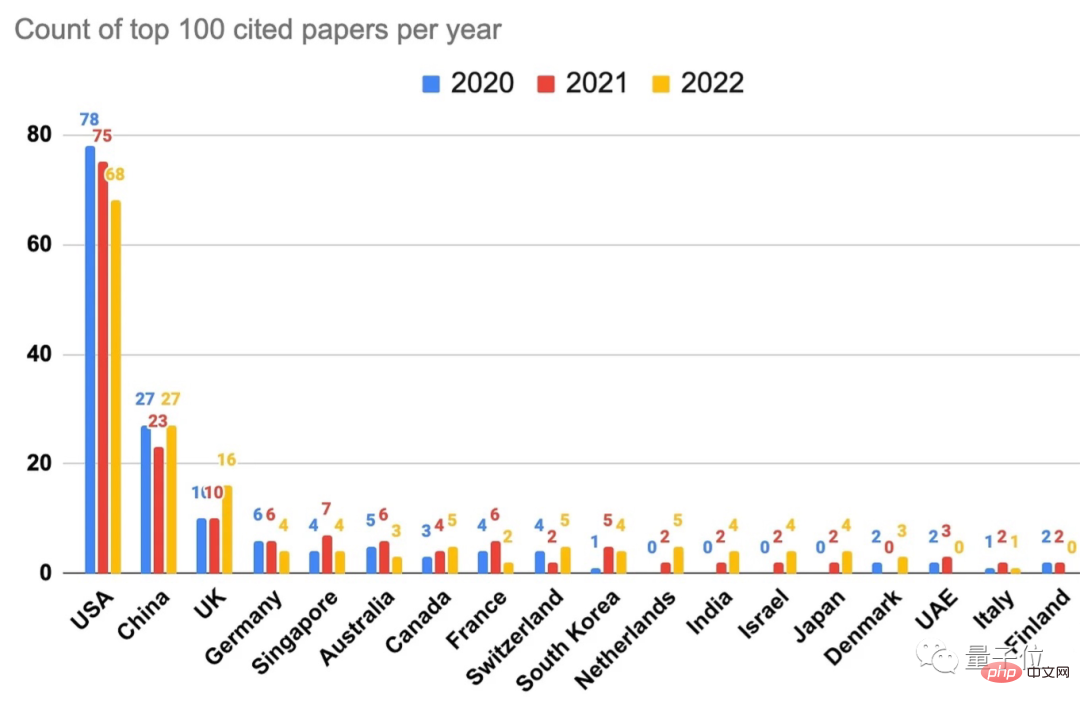

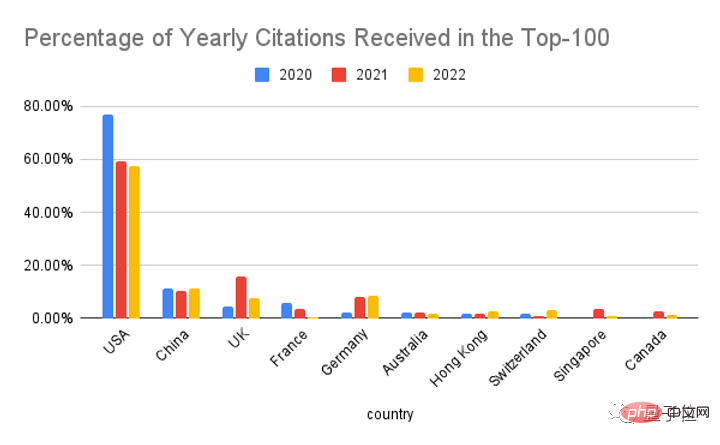

Sudah tentu, Amerika Syarikat masih berada di kedudukan pertama, tetapi kita dapat melihat bahagiannya telah menurun dalam tempoh tiga tahun yang lalu.

UK ialah pesaing terbesar di luar China dan Amerika Syarikat, tetapi prestasi cemerlang UK pada tahun 2022 sebenarnya disumbangkan terutamanya oleh DeepMind (mencatat 69%).

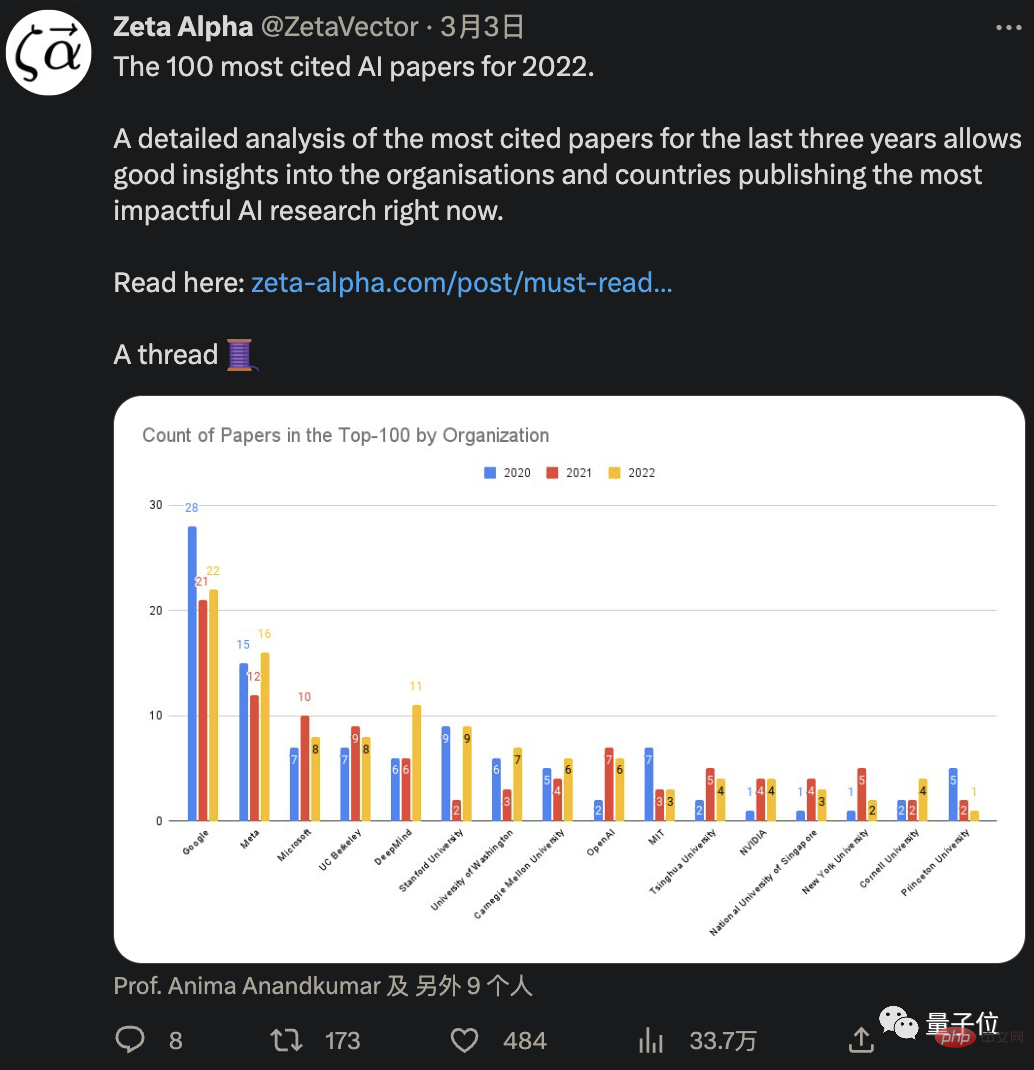

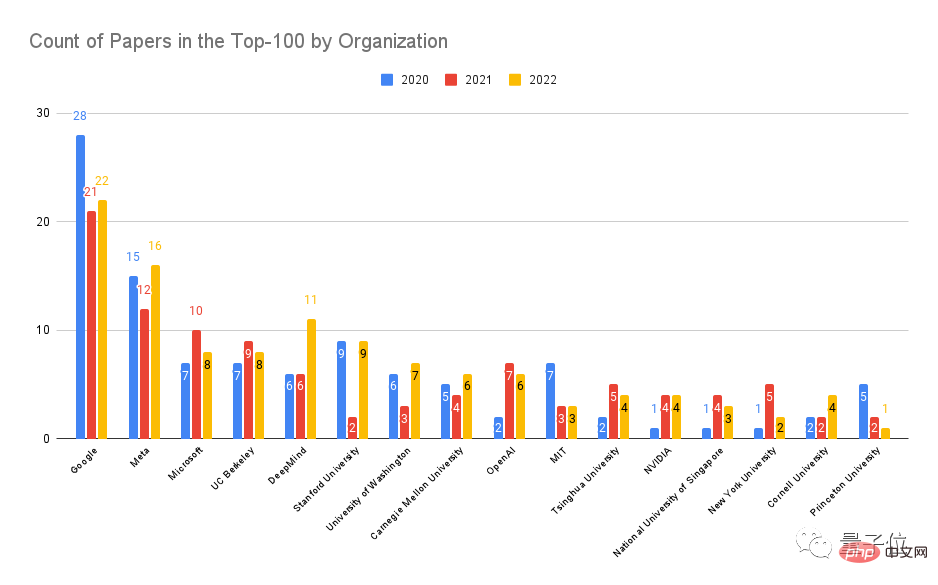

Berikut ialah kedudukan 100 individu teratas dengan petikan terbanyak mengikut organisasi atau institusi.

Tidak menghairankan, Google dan Meta Microsoft menduduki tempat tiga teratas, diikuti oleh UC Berkeley, DeepMind dan Stanford.

OpenAI juga mencapai kedudukan yang cukup baik, kesembilan. Yang kesepuluh ialah MIT dan yang kesebelas ialah Universiti Tsinghua.

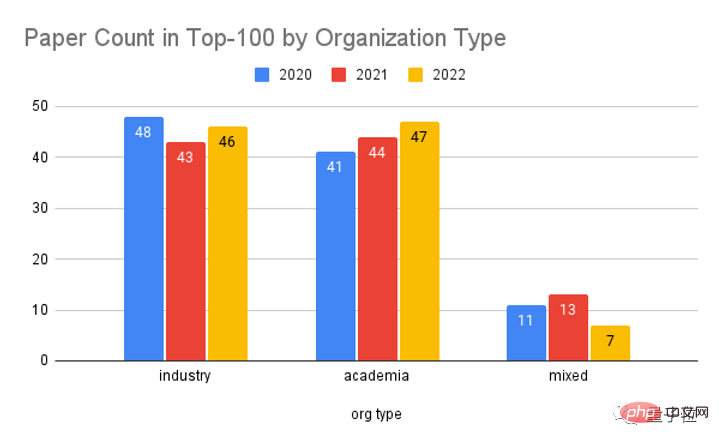

Walaupun tiga peserta terbaik semuanya dari industri, jika kita hanya membahagikannya mengikut jenis institusi, prestasi akademik dan pada asasnya adalah sama.

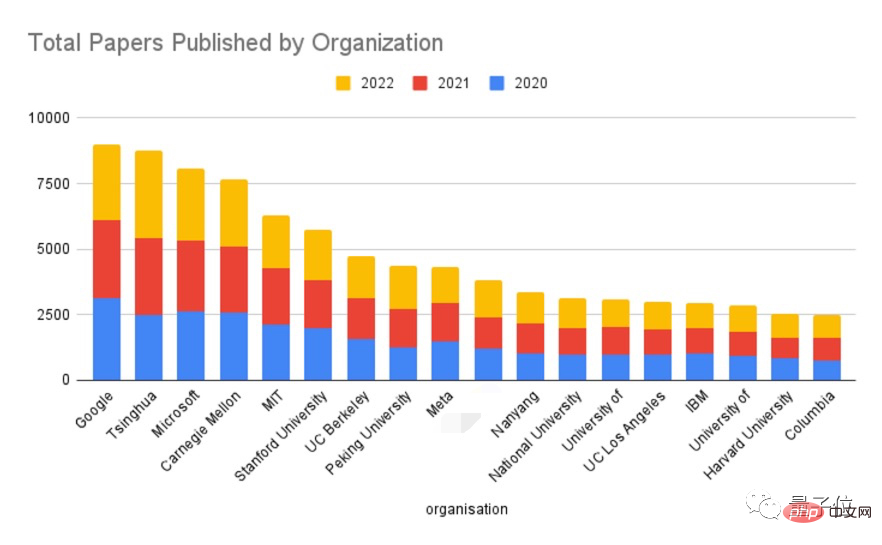

Kemudian, kedudukan jumlah bilangan kertas kerja yang diterbitkan oleh setiap organisasi atau institusi dalam tempoh tiga tahun yang lalu.

Bos masih Google. Tempat kedua lebih menarik perhatian iaitu Universiti Tsinghua, diikuti oleh Microsoft, CMU, MIT, Stanford, UC Berkeley, Universiti Peking (kelapan), Meta...

Nampak yang teratas sepuluh bergabung dengan akademia Institusi atau organisasi menduduki kawasan yang luas di negara ini.

Dan kami mencari untuk masa yang lama, tetapi kami tidak melihat nama OpenAI dan DeepMind -

Jelas sekali mereka menerbitkan bilangan kertas yang lebih kecil dan menang terutamanya dari segi kualiti.

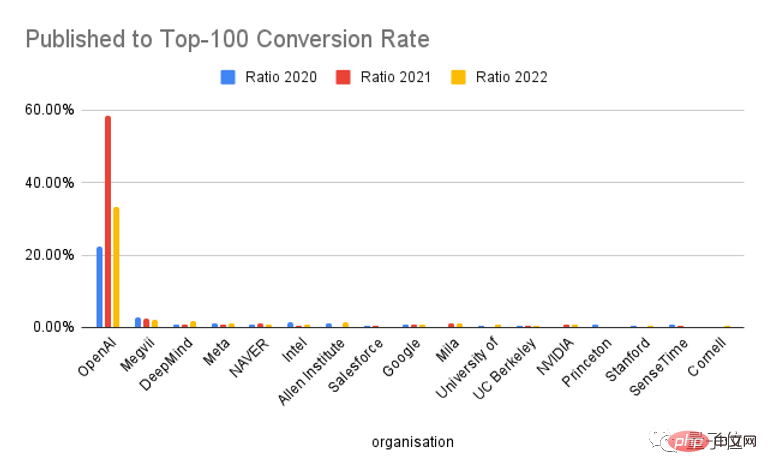

Untuk mengesahkan tekaan ini, Zeta Alpha turut membuat penarafan kadar penukaran kertas yang diberi sebutan tinggi.

Seperti yang dijangkakan, OpenAI memenangi mahkota dan DeepMind menduduki tempat ketiga.

Sudah tentu, Meta juga bagus Keempat, LeCun pun keluar untuk memberikan kenyataan peribadi:

Kami di Meta memang lebih mementingkan kualiti berbanding kuantiti.

Sebaliknya, Google, yang mempunyai banyak petikan tetapi lebih banyak penerbitan, hanya menduduki tempat kesembilan, hampir tidak keluar daripada 10 teratas.

Selain itu, tempat kedua juga menjadi kemuncak - ia adalah Megvii.

Serta SenseTime domestik, mereka juga berada dalam senarai.

Kepopularan ChatGPT telah benar-benar menggiatkan semula industri AI Ke arah manakah penyelidikan termaju terbaharu? Kita juga perlu lebih teliti.

Untuk tujuan ini, Zeta Alpha juga telah memberikan senarai semua kertas AI yang disebut dalam 100 teratas pada tahun 2022, yang mungkin memberi inspirasi kepada semua orang.

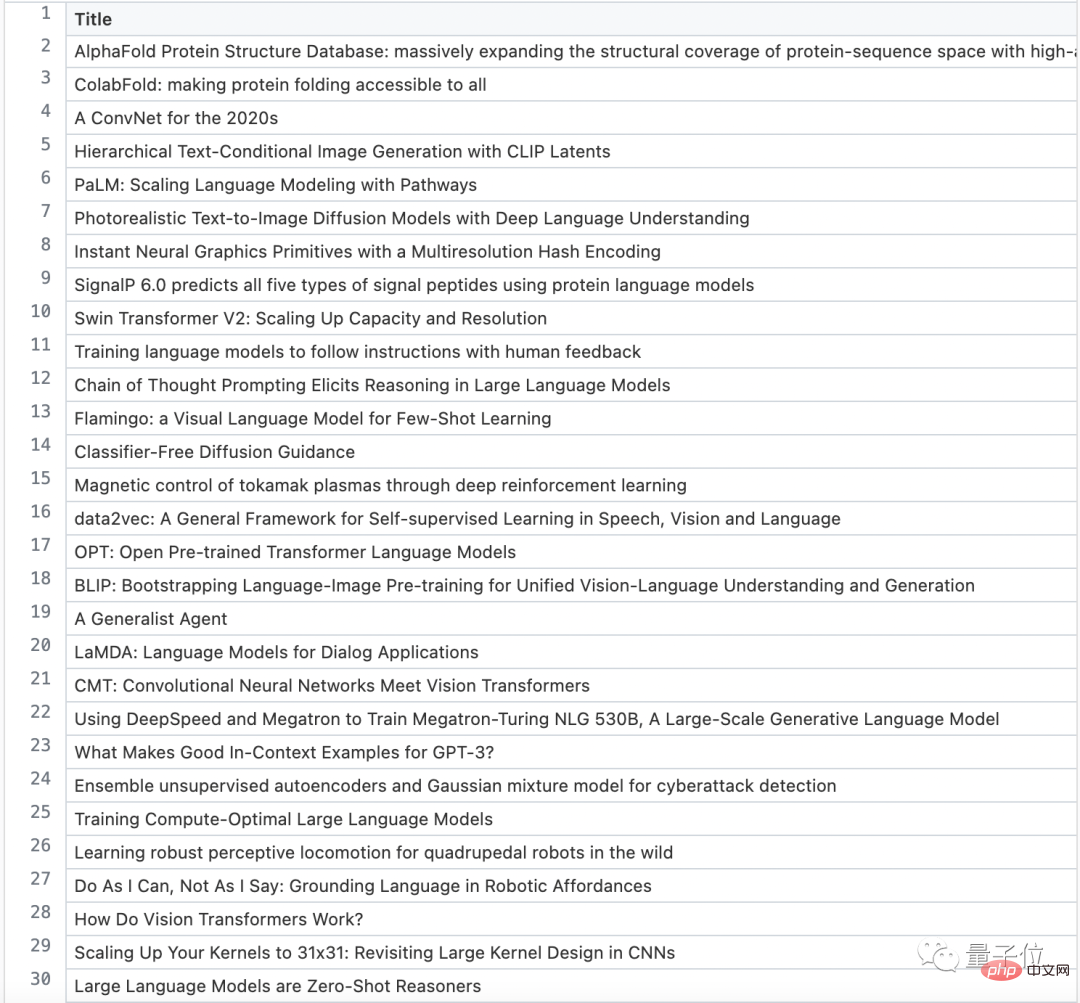

1-30:

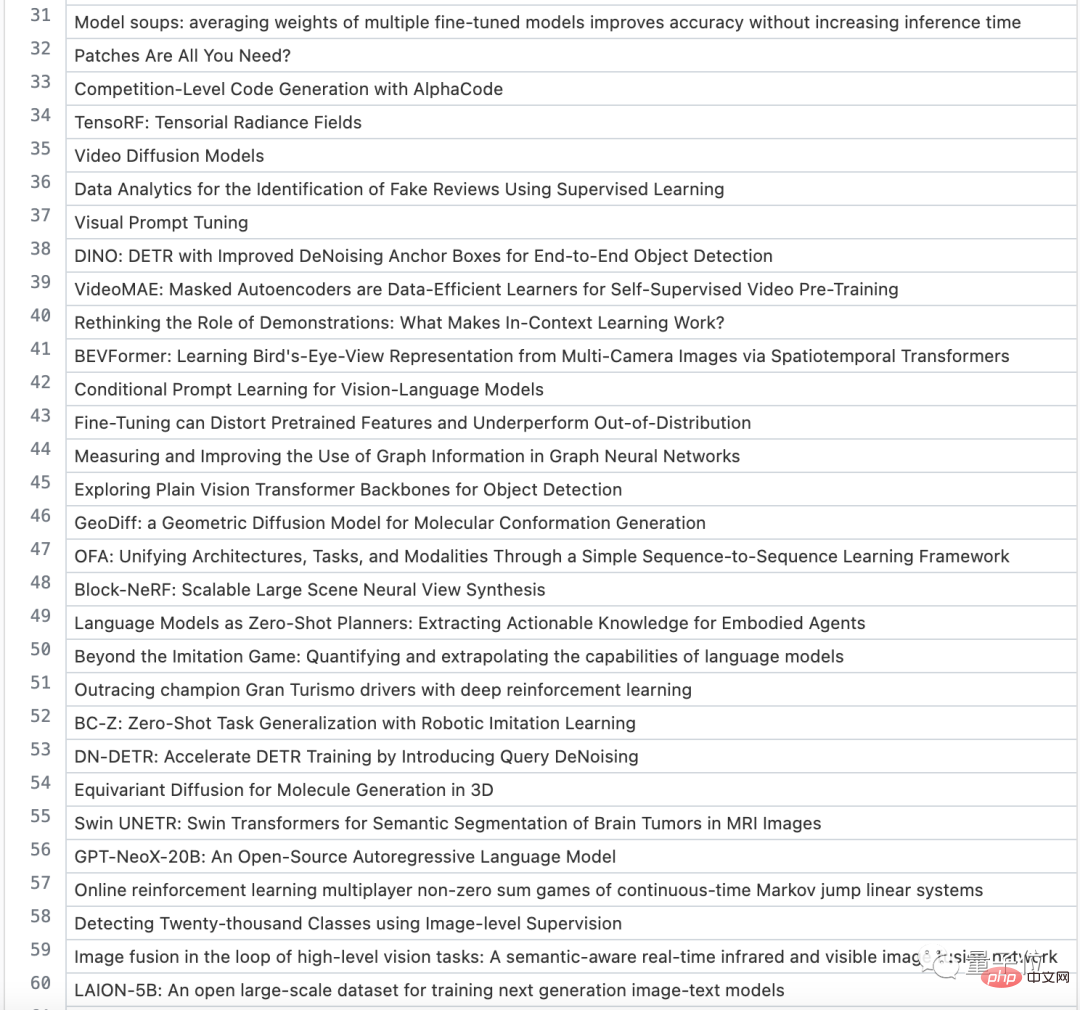

31-60:

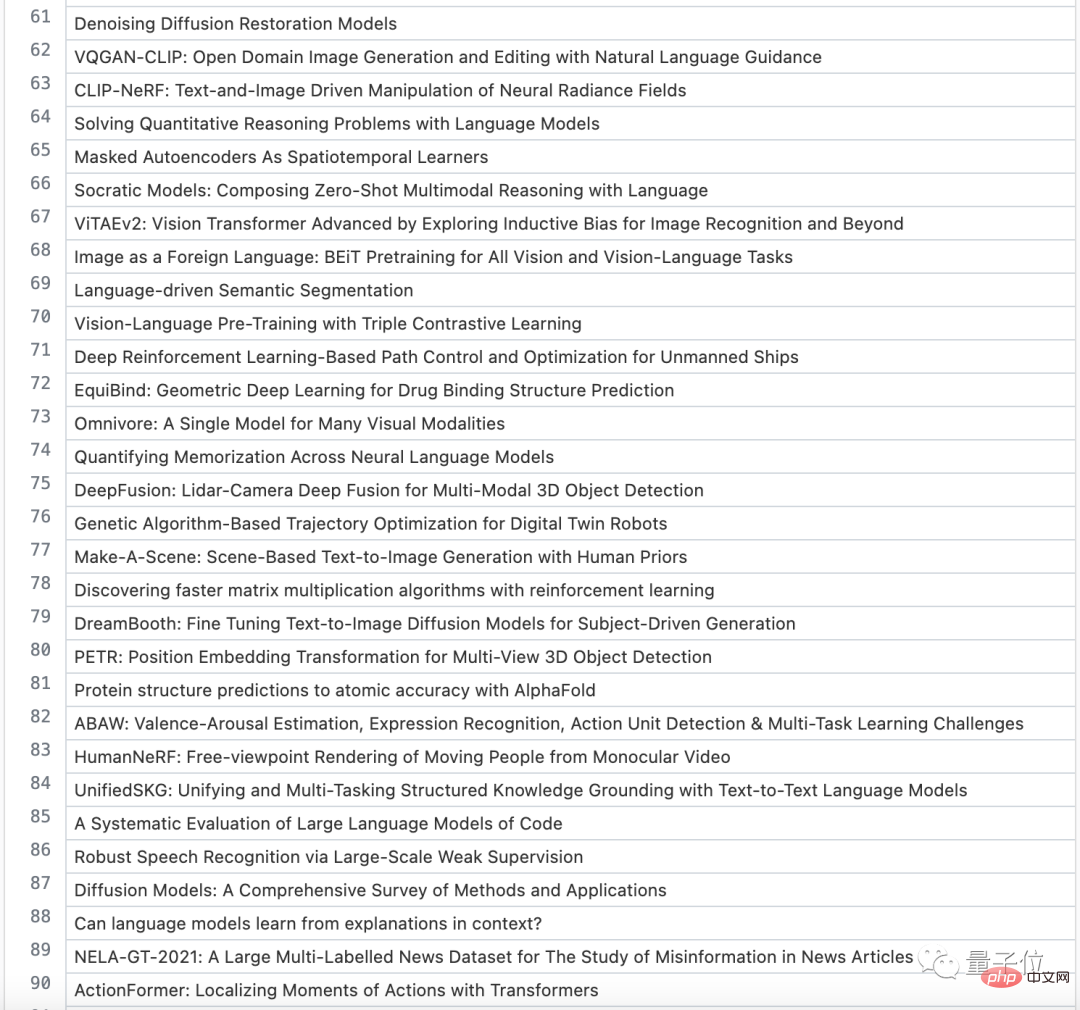

61-90:

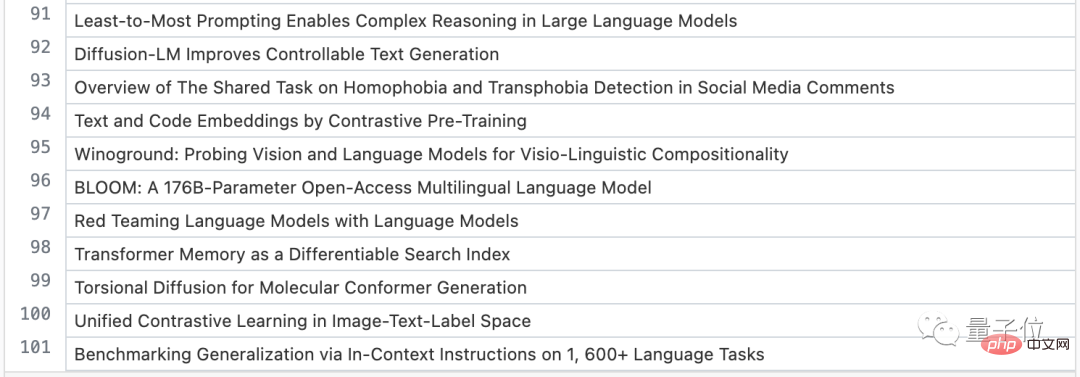

91-100:

Jadi, itu sahaja kandungan laporan Zeta Alpha.

Teks asal boleh dicop:https://www.php.cn/link/ea20aed6df7caa746052d227d194a395

Atas ialah kandungan terperinci Kedudukan 'kadar penukaran petikan tinggi' kertas AI dikeluarkan: OpenAI di tempat pertama, Megvii di tempat kedua dan Google di tempat kesembilan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Apakah kegunaan slot vue.js?

Apakah kegunaan slot vue.js?

koleksi kod latar belakang css

koleksi kod latar belakang css

NumberFormatException

NumberFormatException

maklumat versi paparan linux

maklumat versi paparan linux

Peranan mod Jangan Ganggu Apple

Peranan mod Jangan Ganggu Apple

Bagaimana untuk menggunakan arahan mencari untuk mencari fail dalam linux

Bagaimana untuk menggunakan arahan mencari untuk mencari fail dalam linux

kaedah yang dipanggil oleh penonton

kaedah yang dipanggil oleh penonton

Bagaimana untuk memaparkan dua div sebelah menyebelah

Bagaimana untuk memaparkan dua div sebelah menyebelah