Peranti teknologi

Peranti teknologi

AI

AI

Parameter dipertingkatkan sedikit, dan indeks prestasi meletup! Google: Model bahasa besar menyembunyikan 'kemahiran misteri'

Parameter dipertingkatkan sedikit, dan indeks prestasi meletup! Google: Model bahasa besar menyembunyikan 'kemahiran misteri'

Parameter dipertingkatkan sedikit, dan indeks prestasi meletup! Google: Model bahasa besar menyembunyikan 'kemahiran misteri'

Oleh kerana ia boleh melakukan perkara yang belum dilatih, model bahasa besar nampaknya mempunyai sejenis sihir, dan oleh itu telah menjadi tumpuan gembar-gembur dan perhatian daripada media dan penyelidik.

Apabila mengembangkan model bahasa yang besar, kadangkala beberapa keupayaan baharu akan muncul yang tidak tersedia dalam model yang lebih kecil Atribut yang serupa dengan "kreativiti" ini dipanggil keupayaan "emergent", yang mewakili Kami telah mengambil langkah besar ke arah kecerdasan buatan am.

Kini, penyelidik dari Google, Stanford, Deepmind dan University of North Carolina sedang meneroka keupayaan "muncul" dalam model bahasa besar.

DALL-E digesa oleh penyahkod

Keupayaan "kecemasan" ajaib

Pemprosesan bahasa semula jadi (NLP) telah direvolusikan oleh model bahasa yang dilatih pada sejumlah besar data teks. Menskalakan model bahasa selalunya meningkatkan prestasi dan kecekapan sampel pada pelbagai tugasan NLP hiliran.

Dalam banyak kes, kita boleh meramalkan prestasi model bahasa besar dengan membuat kesimpulan arah aliran prestasi model yang lebih kecil. Sebagai contoh, kesan skala pada kekeliruan model bahasa telah ditunjukkan dalam lebih daripada tujuh urutan magnitud.

Walau bagaimanapun, prestasi pada beberapa tugasan lain tidak bertambah baik dengan cara yang boleh diramalkan.

Sebagai contoh, kertas GPT-3 menunjukkan bahawa keupayaan model bahasa untuk melakukan penambahan berbilang digit mempunyai lengkung penskalaan rata untuk model dari parameter 100M hingga 13B, adalah lebih kurang rawak, tetapi berkurangan dalam Satu nod menyebabkan lompatan prestasi.

Memandangkan peningkatan penggunaan model bahasa dalam penyelidikan NLP, adalah penting untuk memahami dengan lebih baik keupayaan ini yang mungkin timbul secara tidak dijangka.

Dalam kertas kerja baru-baru ini "Kuasa Muncul Model Bahasa Besar" yang diterbitkan dalam Penyelidikan Pembelajaran Mesin (TMLR), penyelidik menunjukkan "kuasa timbul" yang dihasilkan oleh berpuluh-puluh model bahasa lanjutan kebolehan.

Kewujudan keupayaan "emergent" ini menimbulkan persoalan sama ada penskalaan tambahan boleh mengembangkan lagi julat keupayaan model bahasa.

Petua tertentu dan kaedah penalaan halus hanya akan menghasilkan penambahbaikan dalam model yang lebih besar

Tugasan segera "Emergent"

Pertama, kita membincangkan kebolehan "emergent" yang mungkin muncul dalam tugasan segera.

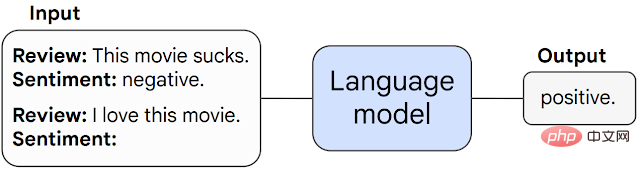

Dalam jenis tugasan ini, model bahasa pra-latihan digesa untuk melaksanakan tugas ramalan perkataan seterusnya dan melaksanakan tugas dengan melengkapkan respons.

Tanpa sebarang penalaan halus lagi, model bahasa selalunya boleh melaksanakan tugas yang tidak dilihat semasa latihan.

Apabila tugasan tanpa diduga melonjak daripada prestasi rawak kepada prestasi melebihi rawak pada ambang skala tertentu, kami memanggilnya tugasan "muncul" .

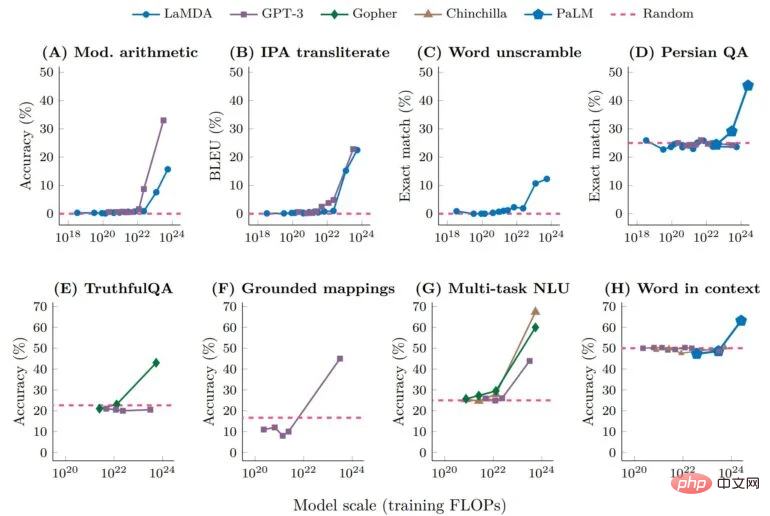

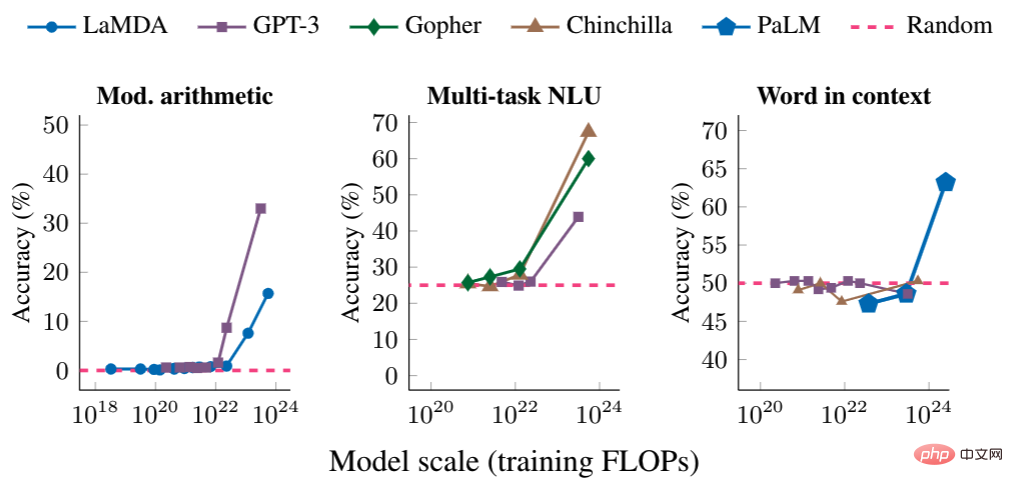

Di bawah ini kami menunjukkan tiga contoh tugasan segera dengan prestasi "muncul": aritmetik berbilang langkah, mengambil peperiksaan peringkat kolej dan mengenal pasti maksud yang dimaksudkan bagi sesuatu perkataan.

Dalam setiap kes, model bahasa berprestasi buruk, dengan sedikit pergantungan pada saiz model, sehingga ambang tertentu dicapai - di mana prestasinya meningkat.

Untuk model skala yang mencukupi, prestasi pada tugasan ini hanya menjadi bukan rawak - contohnya, tugasan NLU aritmetik dan berbilang tugas dilatih dalam operasi titik terapung sesaat ( FLOP) melebihi 10 hingga kuasa ke-22, dan FLOP latihan perkataan dalam tugas konteks melebihi 10 hingga kuasa ke-24.

Strategi gesaan "Emergent"

Jenis kedua keupayaan "emergent" termasuk strategi gesaan yang meningkatkan keupayaan model bahasa.

Strategi menggesa ialah paradigma luas untuk menggesa yang boleh digunakan pada pelbagai tugas yang berbeza. Ia dianggap "emergent" apabila ia gagal pada model kecil dan hanya boleh digunakan oleh model yang cukup besar.

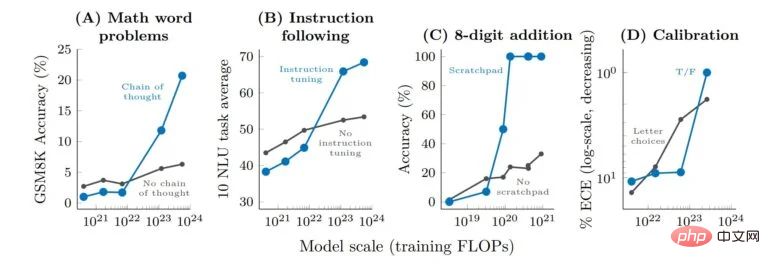

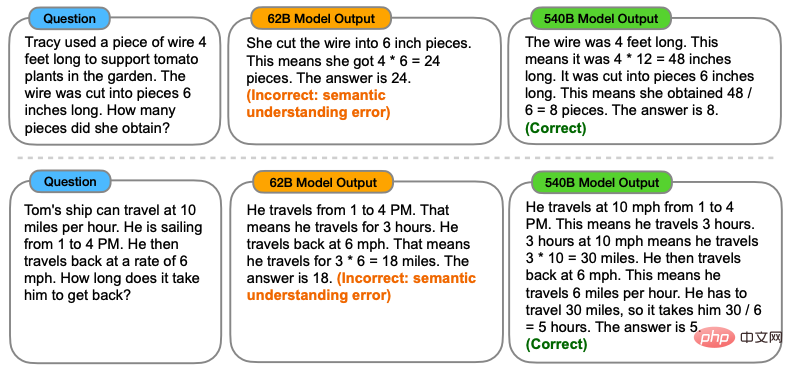

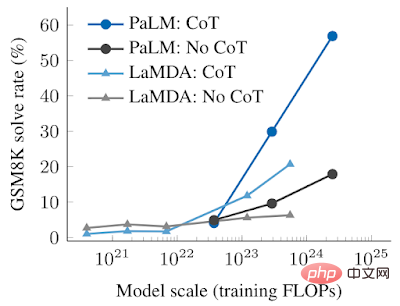

Gesaan rantaian pemikiran ialah contoh tipikal strategi gesaan "emergensi", di mana model gesaan menjana satu siri langkah perantaraan sebelum memberikan jawapan akhir.

Gesaan rantai pemikiran membolehkan model bahasa melaksanakan tugas yang memerlukan penaakulan yang kompleks, seperti masalah perkataan matematik berbilang langkah.

Perlu dinyatakan bahawa model boleh memperoleh keupayaan penaakulan rantaian pemikiran tanpa latihan yang jelas. Rajah di bawah menunjukkan contoh gesaan rantaian pemikiran.

Keputusan empirikal gesaan rantaian pemikiran adalah seperti berikut.

Untuk model yang lebih kecil, menggunakan gesaan Rantaian Pemikiran tidak mengatasi gesaan standard, contohnya apabila digunakan pada GSM8K, yang merupakan perkataan matematik Mencabar penanda aras masalah.

Walau bagaimanapun, untuk model besar, Petua Rantaian Pemikiran mencapai kadar penyelesaian 57% pada GSM8K, meningkatkan prestasi dengan ketara dalam ujian kami.

Kepentingan mempelajari kebolehan "emergent"

Jadi apakah kepentingan mempelajari kebolehan "emergent"?

Mengenal pasti keupayaan "muncul" dalam model bahasa besar ialah langkah pertama dalam memahami fenomena ini dan potensi kesannya terhadap keupayaan model masa hadapan.

Contohnya, kerana keupayaan dan strategi isyarat kecil "muncul" tidak dikodkan secara eksplisit dalam pra-latihan, penyelidik mungkin tidak mengetahui skop penuh pukulan kecil model bahasa semasa keupayaan membayangkan.

Selain itu, persoalan sama ada pengembangan selanjutnya berpotensi memberi model yang lebih besar keupayaan "muncul" juga sangat penting.

- Mengapa kebolehan "muncul" muncul?

- Apabila keupayaan tertentu muncul, adakah aplikasi dunia sebenar model bahasa baharu akan dibuka kuncinya?

- Memandangkan sumber pengkomputeran adalah mahal, bolehkah keupayaan yang muncul dibuka kunci melalui kaedah lain (seperti seni bina model atau teknik latihan yang lebih baik) tanpa meningkatkan skalabiliti?

Penyelidik mengatakan isu ini belum diketahui.

Walau bagaimanapun, apabila bidang NLP terus berkembang, adalah sangat penting untuk menganalisis dan memahami tingkah laku model bahasa, termasuk keupayaan "emergent" yang dihasilkan oleh penskalaan.

Atas ialah kandungan terperinci Parameter dipertingkatkan sedikit, dan indeks prestasi meletup! Google: Model bahasa besar menyembunyikan 'kemahiran misteri'. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1379

1379

52

52

Cara Mengulas DeepSeek

Feb 19, 2025 pm 05:42 PM

Cara Mengulas DeepSeek

Feb 19, 2025 pm 05:42 PM

DeepSeek adalah alat pengambilan maklumat yang kuat. .

Cara Mencari DeepSeek

Feb 19, 2025 pm 05:39 PM

Cara Mencari DeepSeek

Feb 19, 2025 pm 05:39 PM

DeepSeek adalah enjin carian proprietari yang hanya mencari dalam pangkalan data atau sistem tertentu, lebih cepat dan lebih tepat. Apabila menggunakannya, pengguna dinasihatkan untuk membaca dokumen itu, cuba strategi carian yang berbeza, dapatkan bantuan dan maklum balas mengenai pengalaman pengguna untuk memanfaatkan kelebihan mereka.

Sesame Open Door Exchange Web Pautan Pautan Gerbang Perdagangan Laman Web Pendaftaran Terkini

Feb 28, 2025 am 11:06 AM

Sesame Open Door Exchange Web Pautan Pautan Gerbang Perdagangan Laman Web Pendaftaran Terkini

Feb 28, 2025 am 11:06 AM

Artikel ini memperkenalkan proses pendaftaran versi web Web Open Exchange (GATE.IO) dan aplikasi Perdagangan Gate secara terperinci. Sama ada pendaftaran web atau pendaftaran aplikasi, anda perlu melawat laman web rasmi atau App Store untuk memuat turun aplikasi tulen, kemudian isi nama pengguna, kata laluan, e -mel, nombor telefon bimbit dan maklumat lain, dan lengkap e -mel atau pengesahan telefon bimbit.

Mengapa pautan Bybit Exchange tidak dimuat turun dan dipasang secara langsung?

Feb 21, 2025 pm 10:57 PM

Mengapa pautan Bybit Exchange tidak dimuat turun dan dipasang secara langsung?

Feb 21, 2025 pm 10:57 PM

Mengapa pautan Bybit Exchange tidak dimuat turun dan dipasang secara langsung? Bybit adalah pertukaran cryptocurrency yang menyediakan perkhidmatan perdagangan kepada pengguna. Aplikasi mudah alih Exchange tidak boleh dimuat turun terus melalui AppStore atau GooglePlay untuk sebab -sebab berikut: 1. Aplikasi pertukaran cryptocurrency sering tidak memenuhi keperluan ini kerana ia melibatkan perkhidmatan kewangan dan memerlukan peraturan dan standard keselamatan tertentu. 2. Undang -undang dan Peraturan Pematuhan di banyak negara, aktiviti yang berkaitan dengan urus niaga cryptocurrency dikawal atau terhad. Untuk mematuhi peraturan ini, aplikasi bybit hanya boleh digunakan melalui laman web rasmi atau saluran yang diberi kuasa lain

Platform Perdagangan Pintu Terbuka Sesame Muat turun Versi Mudah Alih Platform Perdagangan Platform Perdagangan Alamat Muat Turun

Feb 28, 2025 am 10:51 AM

Platform Perdagangan Pintu Terbuka Sesame Muat turun Versi Mudah Alih Platform Perdagangan Platform Perdagangan Alamat Muat Turun

Feb 28, 2025 am 10:51 AM

Adalah penting untuk memilih saluran rasmi untuk memuat turun aplikasi dan memastikan keselamatan akaun anda.

WEB OPEN DOOR EXCHANGE WEB PAGE LOGIN VERSI VERSI UNTUK GATEIO Laman Web Rasmi Pintu Masuk

Mar 04, 2025 pm 11:48 PM

WEB OPEN DOOR EXCHANGE WEB PAGE LOGIN VERSI VERSI UNTUK GATEIO Laman Web Rasmi Pintu Masuk

Mar 04, 2025 pm 11:48 PM

Pengenalan terperinci kepada operasi log masuk versi Web Open Exchange, termasuk langkah masuk dan proses pemulihan kata laluan.

Top 10 Disyorkan untuk App Perdagangan Aset Digital Crypto (2025 Global Ranking)

Mar 18, 2025 pm 12:15 PM

Top 10 Disyorkan untuk App Perdagangan Aset Digital Crypto (2025 Global Ranking)

Mar 18, 2025 pm 12:15 PM

Artikel ini mencadangkan sepuluh platform perdagangan cryptocurrency teratas yang memberi perhatian kepada, termasuk Binance, OKX, Gate.io, Bitflyer, Kucoin, Bybit, Coinbase Pro, Kraken, BYDFI dan Xbit yang desentralisasi. Platform ini mempunyai kelebihan mereka sendiri dari segi kuantiti mata wang transaksi, jenis urus niaga, keselamatan, pematuhan, dan ciri khas. Memilih platform yang sesuai memerlukan pertimbangan yang komprehensif berdasarkan pengalaman perdagangan anda sendiri, toleransi risiko dan keutamaan pelaburan. Semoga artikel ini membantu anda mencari saman terbaik untuk diri sendiri

Portal Log Masuk Versi Rasmi Binance Binance

Feb 21, 2025 pm 05:42 PM

Portal Log Masuk Versi Rasmi Binance Binance

Feb 21, 2025 pm 05:42 PM

Untuk mengakses versi Login Laman Web Binance yang terkini, ikuti langkah mudah ini. Pergi ke laman web rasmi dan klik butang "Login" di sudut kanan atas. Pilih kaedah log masuk anda yang sedia ada. Masukkan nombor mudah alih berdaftar atau e -mel dan kata laluan anda dan pengesahan lengkap (seperti kod pengesahan mudah alih atau Google Authenticator). Selepas pengesahan yang berjaya, anda boleh mengakses Portal Log masuk laman web rasmi Binance.