Peranti teknologi

Peranti teknologi

AI

AI

Video licin dijana berdasarkan GAN, dan kesannya sangat mengagumkan: tiada lekatan tekstur, pengurangan jitter

Video licin dijana berdasarkan GAN, dan kesannya sangat mengagumkan: tiada lekatan tekstur, pengurangan jitter

Video licin dijana berdasarkan GAN, dan kesannya sangat mengagumkan: tiada lekatan tekstur, pengurangan jitter

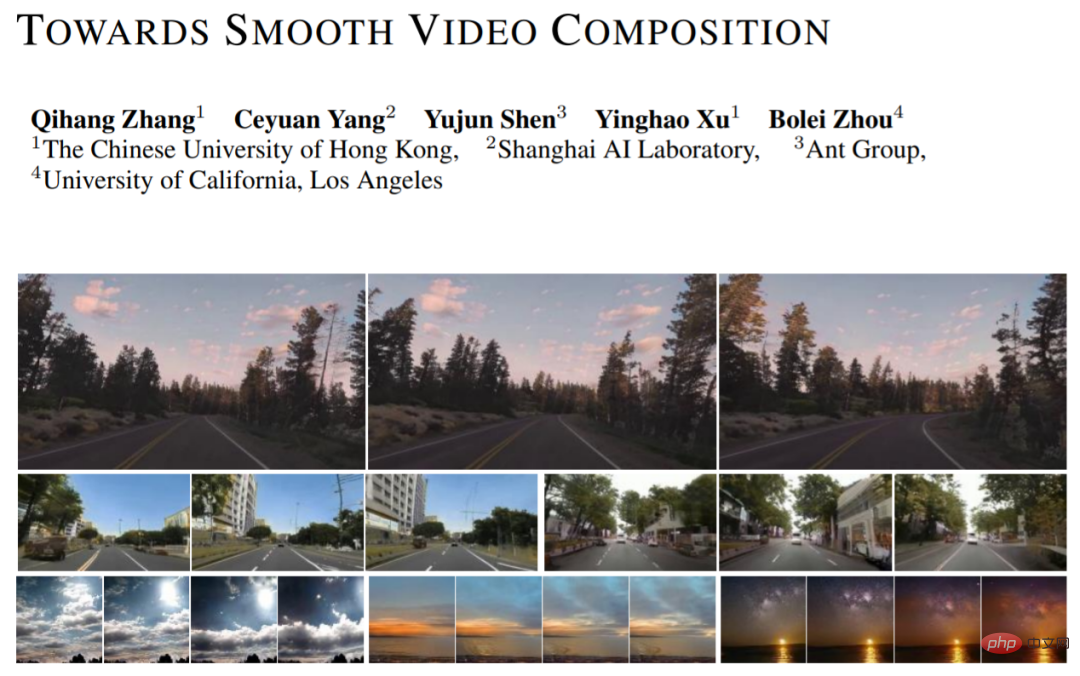

Dalam beberapa tahun kebelakangan ini, penyelidikan mengenai penjanaan imej berdasarkan Generative Adversarial Network (GAN) telah mencapai kemajuan yang ketara. Selain dapat menghasilkan gambar beresolusi tinggi, realistik, banyak aplikasi inovatif juga telah muncul, seperti penyuntingan gambar yang diperibadikan, animasi gambar, dll. Walau bagaimanapun, cara menggunakan GAN untuk penjanaan video masih menjadi masalah yang mencabar.

Selain memodelkan imej bingkai tunggal, penjanaan video juga memerlukan pembelajaran perhubungan temporal yang kompleks. Baru-baru ini, penyelidik dari Universiti China Hong Kong, Makmal Kecerdasan Buatan Shanghai, Institut Penyelidikan Teknologi Semut dan Universiti California, Los Angeles mencadangkan kaedah penjanaan video baharu (Menuju Komposisi Video Lancar). Dalam artikel itu, mereka menjalankan pemodelan dan penambahbaikan terperinci pada hubungan siri masa bagi rentang yang berbeza (julat jangka pendek, julat sederhana, julat panjang) dan mencapai peningkatan yang ketara berbanding kerja sebelumnya pada berbilang set data. Kerja ini menyediakan penanda aras baharu yang mudah dan berkesan untuk penjanaan video berasaskan GAN.

- Alamat kertas: https://arxiv.org/pdf/2212.07413.pdf

- Pautan kod projek: https://github.com/genforce/StyleSV

Seni bina model

Rangkaian penjanaan imej berdasarkan GAN boleh dinyatakan sebagai: I=G(Z), di mana Z ialah pembolehubah rawak, G ialah rangkaian penjanaan, dan I ialah imej yang dijana. Kita hanya boleh memanjangkan rangka kerja ini kepada kategori penjanaan video: I_i=G(z_i), i=[1,...,N], di mana kita sampel N pembolehubah rawak z_i pada satu masa, dan setiap pembolehubah rawak z_i menjana a sepadan A bingkai gambar I_i. Video yang dijana boleh diperolehi dengan menyusun imej yang dihasilkan dalam dimensi masa.

MoCoGAN, StyleGAN-V dan karya lain telah mencadangkan ungkapan penyahgandingan atas dasar ini: I_i=G(u, v_i), i=[1,..., N], di mana u mewakili pembolehubah rawak yang mengawal kandungan, dan v_i mewakili pembolehubah rawak yang mengawal tindakan. Perwakilan ini berpendapat bahawa semua bingkai berkongsi kandungan yang sama dan mempunyai gerakan yang unik. Melalui ungkapan yang dipisahkan ini, kami boleh menjana video aksi dengan lebih baik dengan gaya kandungan yang konsisten dan realisme yang boleh diubah. Kerja baharu itu mengguna pakai reka bentuk StyleGAN-V dan menggunakannya sebagai garis dasar.

Kesukaran dalam penjanaan video: Bagaimana untuk memodelkan perhubungan pemasaan secara berkesan dan munasabah?

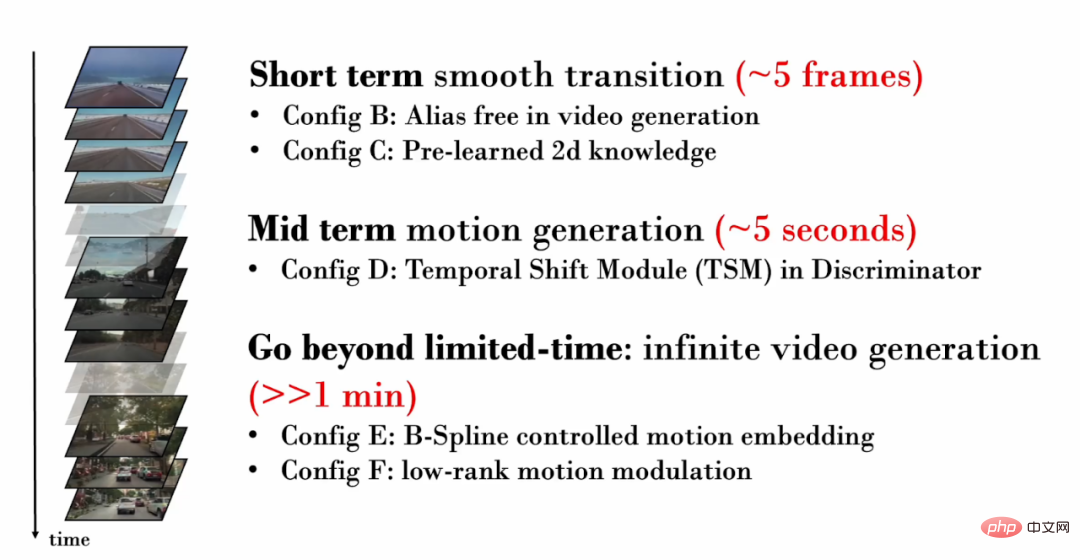

Kerja baharu memfokuskan pada perhubungan pemasaan bagi rentang yang berbeza (julat pendek, julat sederhana, julat panjang) dan masing-masing menjalankan pemodelan dan penambahbaikan terperinci:

1. Hubungan pemasaan masa yang singkat (~5 bingkai)

Mari kita pertimbangkan dahulu video dengan hanya beberapa bingkai . Bingkai video pendek ini selalunya mengandungi kandungan yang hampir sama, hanya menunjukkan pergerakan yang sangat halus. Oleh itu, adalah penting untuk menjana pergerakan halus antara bingkai secara realistik. Walau bagaimanapun, tekstur melekat yang serius berlaku dalam video yang dihasilkan oleh StyleGAN-V.

Lekatan tekstur bermaksud bahagian kandungan yang dijana bergantung pada koordinat tertentu menyebabkan fenomena "melekat" pada kawasan tetap. Dalam bidang penjanaan imej, StyleGAN3 mengurangkan masalah lekatan tekstur melalui pemprosesan isyarat terperinci, julat padding yang diperluas dan operasi lain. Kerja ini mengesahkan bahawa teknik yang sama masih berkesan untuk penjanaan video.

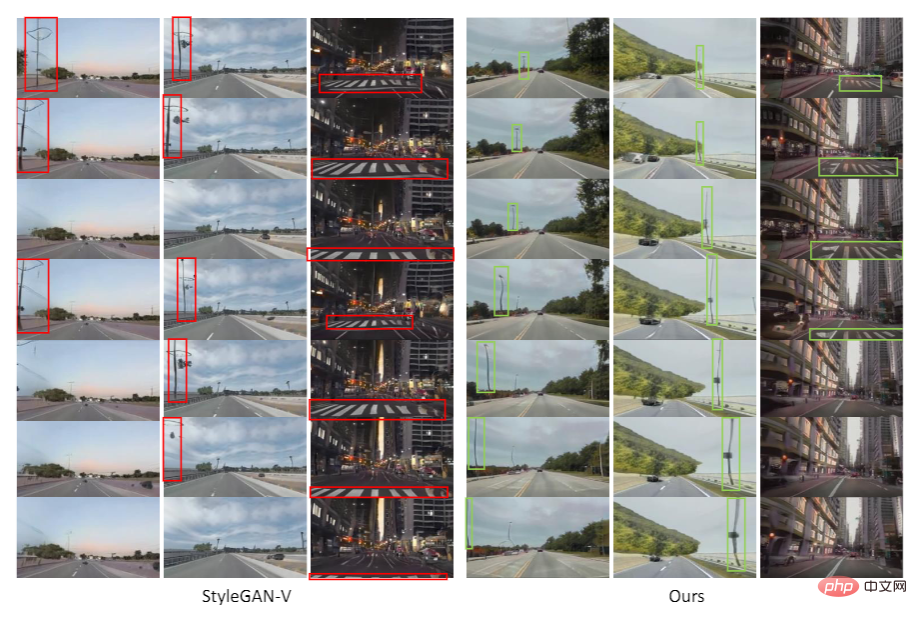

Dalam visualisasi di bawah, kami menjejaki piksel pada lokasi yang sama dalam setiap bingkai video. Adalah mudah untuk mengetahui bahawa dalam video StyleGAN-V, beberapa kandungan telah "melekit" pada koordinat tetap untuk masa yang lama dan tidak bergerak dari semasa ke semasa, sekali gus menghasilkan "fenomena berus" dalam visualisasi. Dalam video yang dihasilkan oleh kerja baharu, semua piksel mempamerkan pergerakan semula jadi.

Walau bagaimanapun, penyelidik mendapati bahawa merujuk tulang belakang StyleGAN3 akan mengurangkan kualiti penjanaan imej. Untuk mengurangkan masalah ini, mereka memperkenalkan pra-latihan peringkat imej. Dalam peringkat pra-latihan, rangkaian hanya perlu mempertimbangkan kualiti penjanaan bingkai tertentu dalam video, dan tidak perlu mempelajari pemodelan julat temporal, menjadikannya lebih mudah untuk mempelajari pengetahuan tentang pengedaran imej.

2 perhubungan pemasaan panjang sederhana (~5 saat)

Dengan lebih banyak video bingkai yang dihasilkan, ia akan dapat menunjukkan tindakan yang lebih spesifik. Oleh itu, adalah penting untuk memastikan bahawa video yang dihasilkan mempunyai gerakan yang realistik. Contohnya, jika kita ingin menjana video pemanduan orang pertama, kita harus menjana pemandangan tanah dan jalanan yang surut secara beransur-ansur, dan kereta yang menghampiri juga harus mengikut trajektori pemanduan semula jadi.

Dalam latihan lawan, untuk memastikan rangkaian generatif menerima penyeliaan latihan yang mencukupi, rangkaian diskriminatif adalah penting. Oleh itu, dalam penjanaan video, untuk memastikan rangkaian penjanaan boleh menjana tindakan yang realistik, rangkaian diskriminatif perlu memodelkan hubungan temporal dalam berbilang bingkai dan menangkap gerakan tidak realistik yang dihasilkan. Walau bagaimanapun, dalam kerja sebelumnya, rangkaian diskriminasi hanya menggunakan operasi penggabungan mudah untuk melaksanakan pemodelan temporal: y = cat (y_i), di mana y_i mewakili ciri bingkai tunggal dan y mewakili ciri selepas gabungan domain masa.

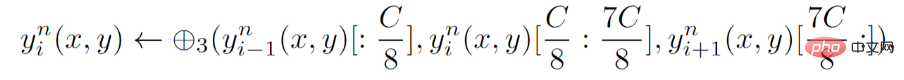

Untuk rangkaian diskriminasi, kerja baharu ini mencadangkan pemodelan pemasaan yang jelas, iaitu, memperkenalkan Modul Anjakan Temporal (TSM) pada setiap lapisan rangkaian diskriminasi. TSM berasal dari bidang pengecaman tindakan dan merealisasikan pertukaran maklumat temporal melalui operasi anjakan mudah:

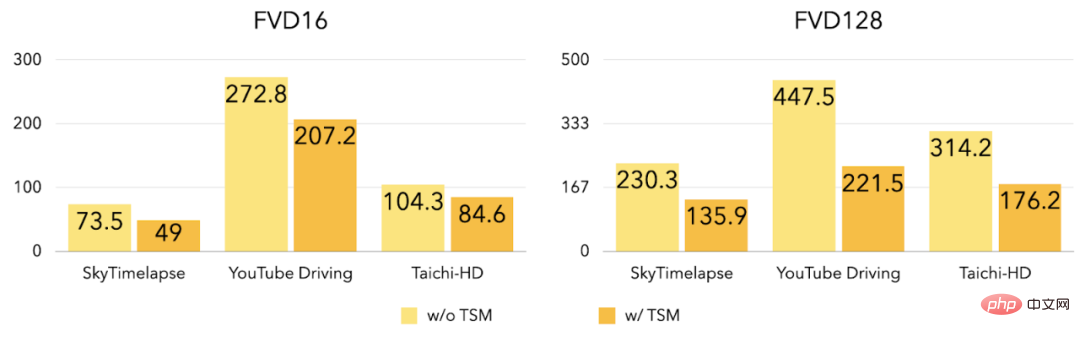

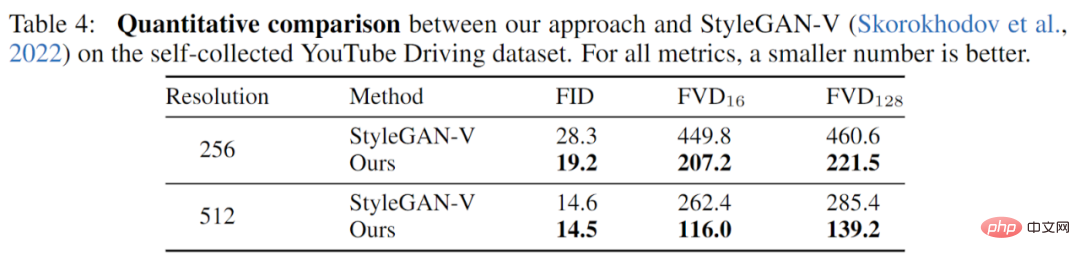

Eksperimen menunjukkan bahawa selepas pengenalan TSM, tiga FVD16 , FVD128 pada set data telah dikurangkan ke tahap yang besar.

3 Penjanaan video tanpa had

Seperti yang ditunjukkan dalam rajah, dalam video yang dijana oleh StyleGAN-V, apabila kereta sendiri bergerak maju, lintasan zebra pada asalnya berundur seperti biasa, tetapi kemudian tiba-tiba berubah untuk bergerak ke hadapan. Kerja ini mendapati ketakselanjaran dalam ciri gerakan (motion embedding) menyebabkan fenomena jitter ini.

Seperti yang ditunjukkan dalam rajah, dalam video yang dijana oleh StyleGAN-V, apabila kereta sendiri bergerak maju, lintasan zebra pada asalnya berundur seperti biasa, tetapi kemudian tiba-tiba berubah untuk bergerak ke hadapan. Kerja ini mendapati ketakselanjaran dalam ciri gerakan (motion embedding) menyebabkan fenomena jitter ini.

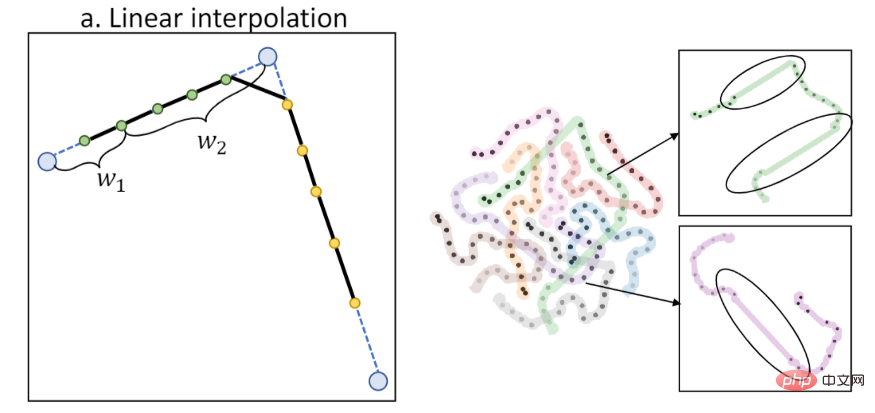

Kerja sebelumnya menggunakan interpolasi linear untuk mengira ciri tindakan Walau bagaimanapun, interpolasi linear akan membawa kepada ketakselanjaran urutan pertama, seperti yang ditunjukkan dalam rajah di bawah (sebelah kiri ialah rajah interpolasi, sebelah kanan. ialah ciri T-SNE) Visualisasi):

Kerja ini mencadangkan ciri-ciri gerakan kawalan B-spline (pembenaman gerakan berasaskan B-Spline) . Interpolasi melalui B-spline boleh memperoleh ciri tindakan yang lebih lancar berkenaan dengan masa, seperti yang ditunjukkan dalam rajah (kiri ialah rajah interpolasi, kanan ialah visualisasi ciri T-SNE):

Kerja ini mencadangkan ciri-ciri gerakan kawalan B-spline (pembenaman gerakan berasaskan B-Spline) . Interpolasi melalui B-spline boleh memperoleh ciri tindakan yang lebih lancar berkenaan dengan masa, seperti yang ditunjukkan dalam rajah (kiri ialah rajah interpolasi, kanan ialah visualisasi ciri T-SNE):

Dengan memperkenalkan ciri-ciri tindakan kawalan B-spline, kerja baharu ini mengurangkan fenomena jitter:

Seperti yang ditunjukkan dalam rajah, dalam video yang dijana oleh StyleGAN-V, lampu jalan dan tanah secara tiba-tiba akan menukar arah pergerakan. Dalam video yang dihasilkan oleh karya baharu, arah pergerakan adalah konsisten dan semula jadi.

Pada masa yang sama, karya baharu itu juga mencadangkan kekangan peringkat rendah pada ciri tindakan untuk mengurangkan lagi kejadian kandungan berulang berkala.

Eksperimen

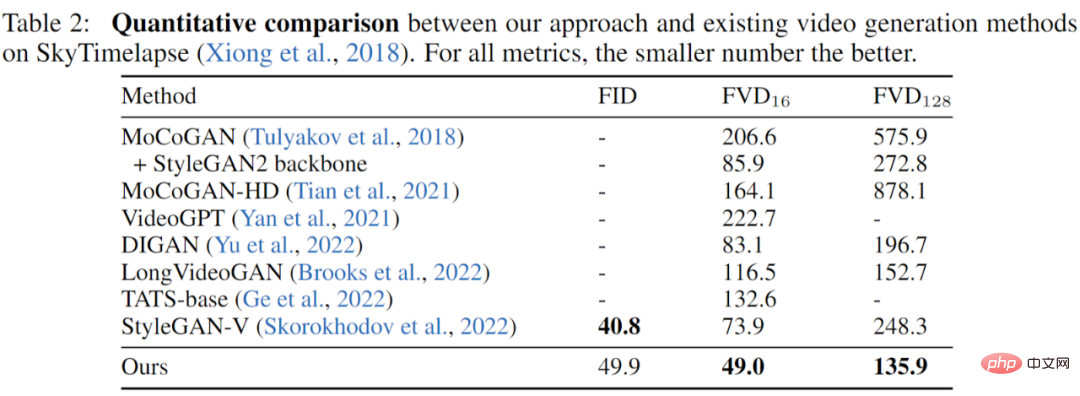

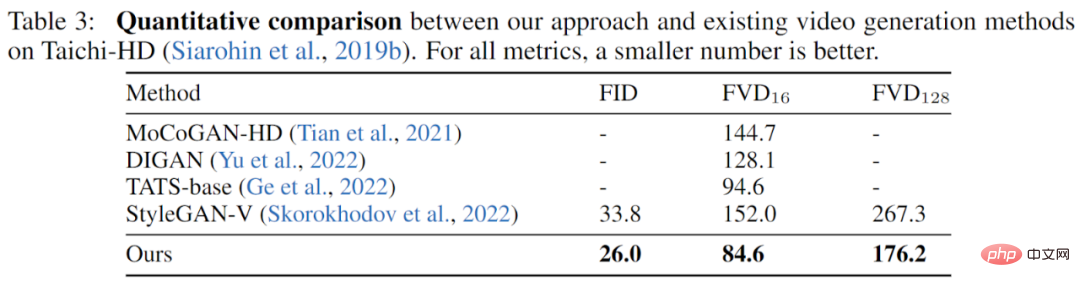

Kerja telah diuji sepenuhnya pada tiga set data (YouTube Pemanduan, Timelapse, Taichi-HD) dan dibandingkan sepenuhnya dengan kerja sebelumnya, Keputusan menunjukkan bahawa kerja baharu telah mencapai peningkatan yang mencukupi dalam kualiti gambar (FID) dan kualiti video (FVD).

Keputusan percubaan SkyTimelapse:

Hasil percubaan Taichi-HD:

Hasil percubaan Memandu YouTube:

Ringkasan

Karya baharu adalah berdasarkan model GAN, Penanda aras penjanaan video baharu dicadangkan, bermula daripada perhubungan temporal skala yang berbeza, dan mencadangkan penambahbaikan baru dan berkesan. Percubaan pada berbilang set data menunjukkan bahawa kerja baharu itu berjaya mencapai kualiti video yang jauh melebihi kerja sebelumnya.

Atas ialah kandungan terperinci Video licin dijana berdasarkan GAN, dan kesannya sangat mengagumkan: tiada lekatan tekstur, pengurangan jitter. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1378

1378

52

52

Cara menulis novel dalam aplikasi Novel Percuma Tomato Kongsi tutorial cara menulis novel dalam Novel Tomato.

Mar 28, 2024 pm 12:50 PM

Cara menulis novel dalam aplikasi Novel Percuma Tomato Kongsi tutorial cara menulis novel dalam Novel Tomato.

Mar 28, 2024 pm 12:50 PM

Novel Tomato adalah perisian membaca novel yang sangat popular Kami sering mempunyai novel dan komik baru untuk dibaca dalam Novel Tomato Setiap novel dan komik sangat menarik ingin menulis ke dalam teks. Jadi bagaimana kita menulis novel di dalamnya? Kongsi tutorial novel Tomato tentang cara menulis novel 1. Mula-mula buka aplikasi novel percuma Tomato pada telefon bimbit anda dan klik pada Pusat Peribadi - Pusat Penulis 2. Lompat ke halaman Pembantu Penulis Tomato - klik pada Buat buku baru di penghujung novel.

Adakah ia melanggar untuk menyiarkan video orang lain di Douyin? Bagaimanakah ia mengedit video tanpa pelanggaran?

Mar 21, 2024 pm 05:57 PM

Adakah ia melanggar untuk menyiarkan video orang lain di Douyin? Bagaimanakah ia mengedit video tanpa pelanggaran?

Mar 21, 2024 pm 05:57 PM

Dengan peningkatan platform video pendek, Douyin telah menjadi bahagian yang sangat diperlukan dalam kehidupan seharian setiap orang. Di TikTok, kita boleh melihat video menarik dari seluruh dunia. Sesetengah orang suka menyiarkan video orang lain, yang menimbulkan persoalan: Adakah Douyin melanggar apabila menyiarkan video orang lain? Artikel ini akan membincangkan isu ini dan memberitahu anda cara mengedit video tanpa pelanggaran dan cara mengelakkan isu pelanggaran. 1. Adakah ia melanggar penyiaran video orang lain oleh Douyin? Menurut peruntukan Undang-undang Hak Cipta negara saya, penggunaan tanpa kebenaran karya pemilik hak cipta tanpa kebenaran pemilik hak cipta adalah satu pelanggaran. Oleh itu, menyiarkan video orang lain di Douyin tanpa kebenaran pengarang asal atau pemilik hak cipta adalah satu pelanggaran. 2. Bagaimana untuk mengedit video tanpa pelanggaran? 1. Penggunaan domain awam atau kandungan berlesen: Awam

Bagaimana untuk memulihkan kenalan yang dipadam pada WeChat (tutorial mudah memberitahu anda cara memulihkan kenalan yang dipadam)

May 01, 2024 pm 12:01 PM

Bagaimana untuk memulihkan kenalan yang dipadam pada WeChat (tutorial mudah memberitahu anda cara memulihkan kenalan yang dipadam)

May 01, 2024 pm 12:01 PM

Malangnya, orang sering memadamkan kenalan tertentu secara tidak sengaja atas sebab tertentu WeChat ialah perisian sosial yang digunakan secara meluas. Untuk membantu pengguna menyelesaikan masalah ini, artikel ini akan memperkenalkan cara mendapatkan semula kenalan yang dipadam dengan cara yang mudah. 1. Fahami mekanisme pemadaman kenalan WeChat Ini memberi kita kemungkinan untuk mendapatkan semula kenalan yang dipadamkan Mekanisme pemadaman kenalan dalam WeChat mengalih keluar mereka daripada buku alamat, tetapi tidak memadamkannya sepenuhnya. 2. Gunakan fungsi "Pemulihan Buku Kenalan" terbina dalam WeChat menyediakan "Pemulihan Buku Kenalan" untuk menjimatkan masa dan tenaga Pengguna boleh mendapatkan semula kenalan yang telah dipadamkan dengan cepat melalui fungsi ini. 3. Masuk ke halaman tetapan WeChat dan klik sudut kanan bawah, buka aplikasi WeChat "Saya" dan klik ikon tetapan di sudut kanan atas untuk memasuki halaman tetapan.

Bagaimana untuk membuat wang daripada menyiarkan video di Douyin? Bagaimanakah seorang pemula boleh membuat wang di Douyin?

Mar 21, 2024 pm 08:17 PM

Bagaimana untuk membuat wang daripada menyiarkan video di Douyin? Bagaimanakah seorang pemula boleh membuat wang di Douyin?

Mar 21, 2024 pm 08:17 PM

Douyin, platform video pendek kebangsaan, bukan sahaja membolehkan kami menikmati pelbagai video pendek yang menarik dan novel pada masa lapang kami, tetapi juga memberi kami pentas untuk menunjukkan diri kami dan merealisasikan nilai kami. Jadi, bagaimana untuk membuat wang dengan menyiarkan video di Douyin? Artikel ini akan menjawab soalan ini secara terperinci dan membantu anda menjana lebih banyak wang di TikTok. 1. Bagaimana untuk membuat wang daripada menyiarkan video di Douyin? Selepas menyiarkan video dan mendapat jumlah tontonan tertentu pada Douyin, anda akan berpeluang untuk mengambil bahagian dalam pelan perkongsian pengiklanan. Kaedah pendapatan ini adalah salah satu yang paling biasa kepada pengguna Douyin dan juga merupakan sumber pendapatan utama bagi banyak pencipta. Douyin memutuskan sama ada untuk menyediakan peluang perkongsian pengiklanan berdasarkan pelbagai faktor seperti berat akaun, kandungan video dan maklum balas khalayak. Platform TikTok membolehkan penonton menyokong pencipta kegemaran mereka dengan menghantar hadiah,

Bagaimana untuk menerbitkan karya video Xiaohongshu? Apakah yang perlu saya perhatikan semasa menyiarkan video?

Mar 23, 2024 pm 08:50 PM

Bagaimana untuk menerbitkan karya video Xiaohongshu? Apakah yang perlu saya perhatikan semasa menyiarkan video?

Mar 23, 2024 pm 08:50 PM

Dengan kemunculan platform video pendek, Xiaohongshu telah menjadi platform untuk ramai orang berkongsi kehidupan mereka, meluahkan perasaan mereka dan mendapatkan trafik. Pada platform ini, menerbitkan karya video ialah cara interaksi yang sangat popular. Jadi, bagaimana untuk menerbitkan karya video Xiaohongshu? 1. Bagaimana untuk menerbitkan karya video Xiaohongshu? Mula-mula, pastikan anda mempunyai kandungan video yang sedia untuk dikongsi. Anda boleh menggunakan telefon bimbit anda atau peralatan kamera lain untuk merakam, tetapi anda perlu memberi perhatian kepada kualiti imej dan kejelasan bunyi. 2. Edit video: Untuk menjadikan kerja lebih menarik, anda boleh mengedit video. Anda boleh menggunakan perisian penyuntingan video profesional, seperti Douyin, Kuaishou, dsb., untuk menambah penapis, muzik, sari kata dan elemen lain. 3. Pilih kulit muka: Kulit adalah kunci untuk menarik pengguna untuk mengklik.

Cara menyiarkan video di Weibo tanpa memampatkan kualiti imej_Cara menyiarkan video di Weibo tanpa memampatkan kualiti imej

Mar 30, 2024 pm 12:26 PM

Cara menyiarkan video di Weibo tanpa memampatkan kualiti imej_Cara menyiarkan video di Weibo tanpa memampatkan kualiti imej

Mar 30, 2024 pm 12:26 PM

1. Mula-mula buka Weibo pada telefon mudah alih anda dan klik [Saya] di sudut kanan bawah (seperti yang ditunjukkan dalam gambar). 2. Kemudian klik [Gear] di penjuru kanan sebelah atas untuk membuka tetapan (seperti yang ditunjukkan dalam gambar). 3. Kemudian cari dan buka [Tetapan Umum] (seperti yang ditunjukkan dalam gambar). 4. Kemudian masukkan pilihan [Video Follow] (seperti yang ditunjukkan dalam gambar). 5. Kemudian buka tetapan [Video Upload Resolution] (seperti yang ditunjukkan dalam gambar). 6. Akhir sekali, pilih [Kualiti Imej Asal] untuk mengelakkan pemampatan (seperti yang ditunjukkan dalam gambar).

Rahsia penetasan telur naga mudah alih terbongkar (langkah demi langkah untuk mengajar anda cara berjaya menetas telur naga mudah alih)

May 04, 2024 pm 06:01 PM

Rahsia penetasan telur naga mudah alih terbongkar (langkah demi langkah untuk mengajar anda cara berjaya menetas telur naga mudah alih)

May 04, 2024 pm 06:01 PM

Permainan mudah alih telah menjadi sebahagian daripada kehidupan orang ramai dengan perkembangan teknologi. Ia telah menarik perhatian ramai pemain dengan imej telur naga yang comel dan proses penetasan yang menarik, dan salah satu permainan yang telah menarik perhatian ramai ialah versi mudah alih Dragon Egg. Untuk membantu pemain memupuk dan mengembangkan naga mereka sendiri dengan lebih baik dalam permainan, artikel ini akan memperkenalkan kepada anda cara menetas telur naga dalam versi mudah alih. 1. Pilih jenis telur naga yang sesuai Pemain perlu berhati-hati memilih jenis telur naga yang mereka suka dan sesuai dengan diri mereka, berdasarkan pelbagai jenis sifat dan kebolehan telur naga yang disediakan dalam permainan. 2. Tingkatkan tahap mesin pengeraman Pemain perlu meningkatkan tahap mesin pengeraman dengan menyelesaikan tugasan dan mengumpul prop Tahap mesin pengeraman menentukan kelajuan penetasan dan kadar kejayaan penetasan. 3. Kumpul sumber yang diperlukan untuk penetasan Pemain perlu berada dalam permainan

Bagaimana untuk menetapkan saiz fon pada telefon mudah alih (mudah melaraskan saiz fon pada telefon bimbit)

May 07, 2024 pm 03:34 PM

Bagaimana untuk menetapkan saiz fon pada telefon mudah alih (mudah melaraskan saiz fon pada telefon bimbit)

May 07, 2024 pm 03:34 PM

Menetapkan saiz fon telah menjadi keperluan pemperibadian yang penting kerana telefon mudah alih menjadi alat penting dalam kehidupan seharian manusia. Untuk memenuhi keperluan pengguna yang berbeza, artikel ini akan memperkenalkan cara meningkatkan pengalaman penggunaan telefon mudah alih dan melaraskan saiz fon telefon mudah alih melalui operasi mudah. Mengapa anda perlu melaraskan saiz fon telefon mudah alih anda - Melaraskan saiz fon boleh menjadikan teks lebih jelas dan mudah dibaca - Sesuai untuk keperluan membaca pengguna yang berbeza umur - Mudah untuk pengguna yang kurang penglihatan menggunakan saiz fon fungsi tetapan sistem telefon mudah alih - Cara memasukkan antara muka tetapan sistem - Dalam Cari dan masukkan pilihan "Paparan" dalam antara muka tetapan - cari pilihan "Saiz Fon" dan laraskan saiz fon dengan pihak ketiga aplikasi - muat turun dan pasang aplikasi yang menyokong pelarasan saiz fon - buka aplikasi dan masukkan antara muka tetapan yang berkaitan - mengikut individu