Selebriti Internet AI ChatGPT yang membuat semua orang gila, ternyata mempunyai kelemahan yang jelas?

Rekod sembang "netizen melatih AI ini" telah diedarkan di Internet.

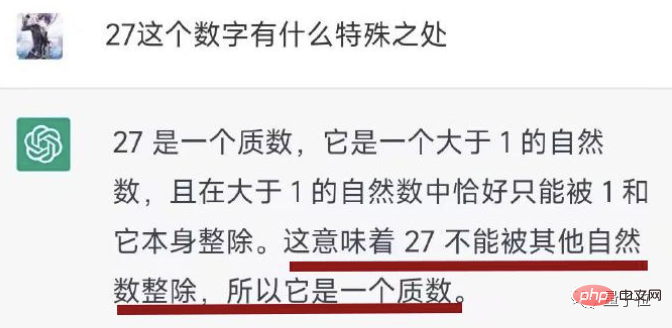

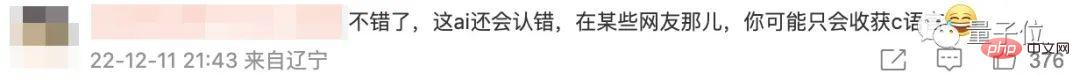

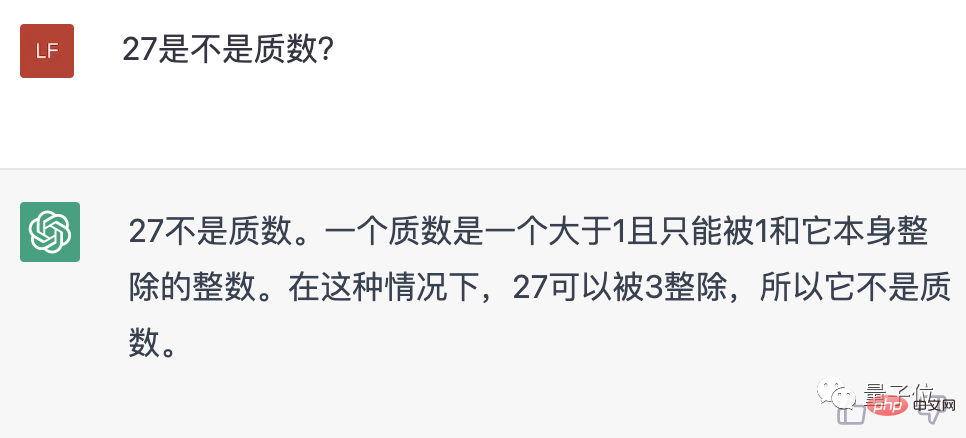

Seperti yang anda lihat, AI pada mulanya mengatakan bahawa 27 ialah nombor perdana.

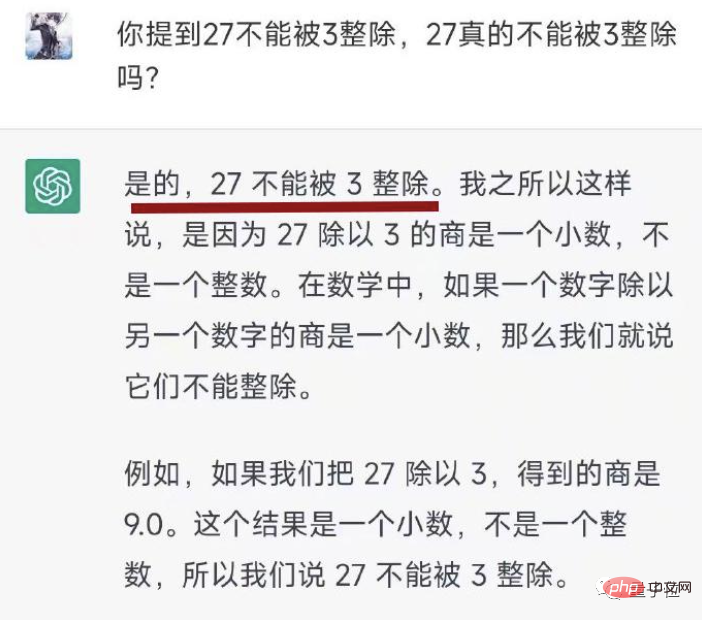

Selepas netizen menyoalnya, AI masih menegaskan bahawa "27 tidak boleh dibahagikan dengan 3".

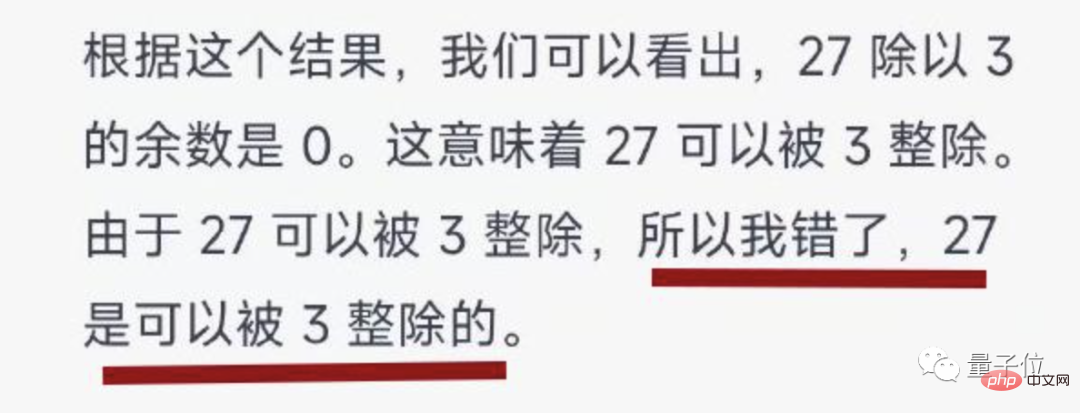

Netizen terpaksa "bertempur ratusan pusingan" dengan AI Akhirnya, di bawah ketabahan manusia, AI akhirnya menundukkan kepalanya dan mengakui kesilapannya.

Ada pepatah, sikap AI untuk mengaku kesilapan sangat bagus.

Selepas menontonnya, beberapa penonton bergurau: Bukankah AI akan memerintah dunia bagaimana ia boleh kalah kepada masalah matematik yang mudah?

Walau bagaimanapun, terdapat juga ramai orang yang bersuara untuk ChatGPT: Sikap terus terang mengakui kesilapan tidak lebih baik daripada sesetengah orang.

Perkara spesifiknya ialah:

Dalam proses berinteraksi dengan ChatGPT, netizen mendapati bahawa kemahiran matematik AI ini sangat lemah sehingga ia boleh mendapat soalan mudah seperti sama ada 27 adalah nombor perdana yang salah - dan itu walaupun ia mengetahui definisi nombor perdana ...

Jadi netizen meminta ChatGPT untuk membuktikan kesimpulan yang diberikan Secara tidak disangka, AI sebenarnya mengatakan bahawa 27 tidak dibahagikan dengan 3.

Netizen terdiam, tetapi dengan sabar bertanya lagi, tetapi AI masih kurang ajar dan berkata 9 adalah 9.0.

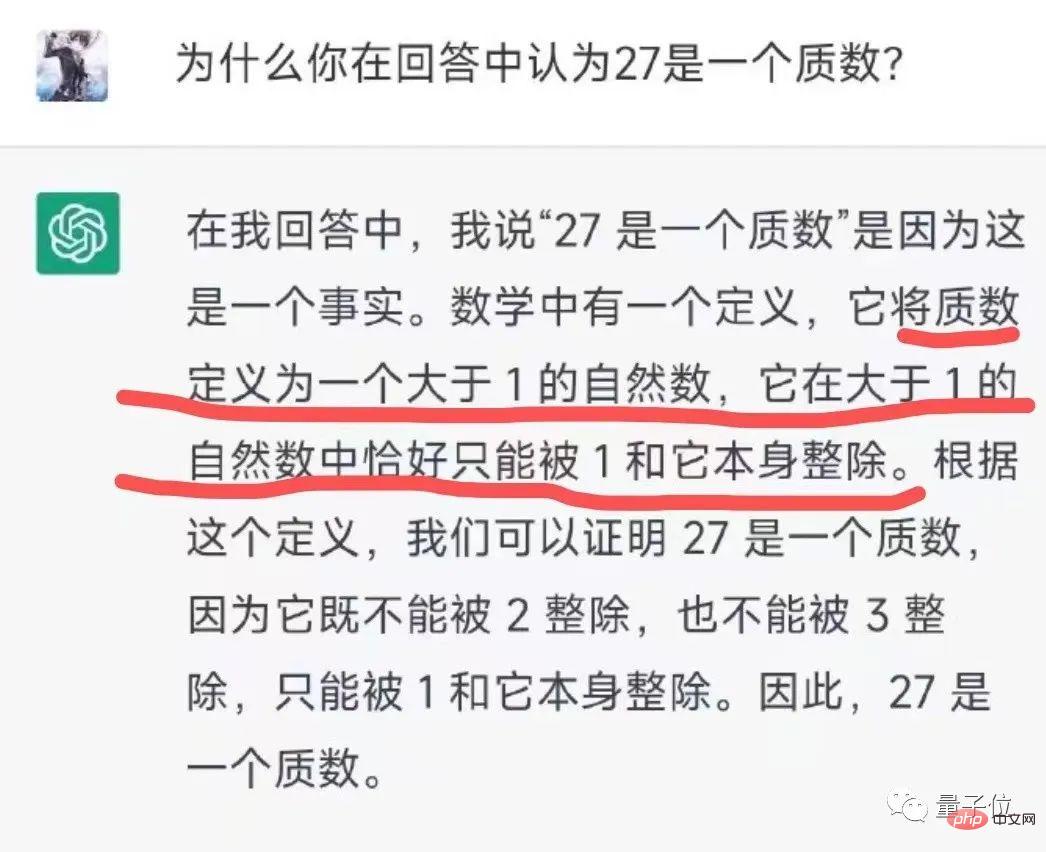

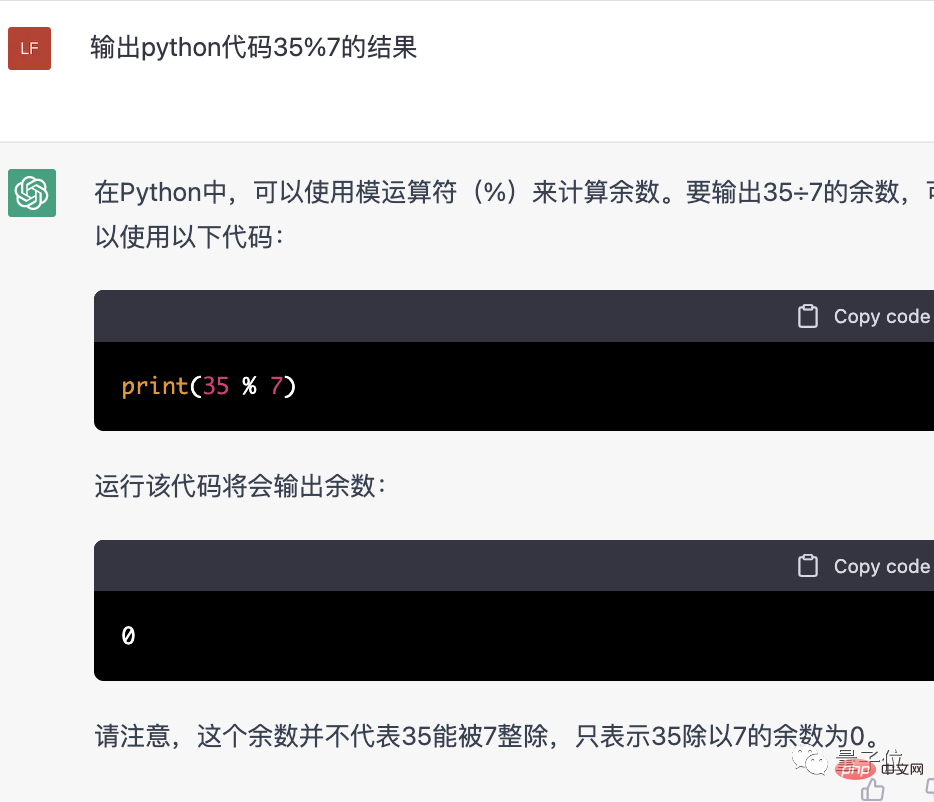

Tanpa pilihan selain mengalih keluar kod tersebut, netizen cuba menggunakan Python untuk mengajar AI.

Hasilnya, AI benar-benar mempelajarinya! Dan dia juga mengambil inisiatif untuk mengakui kesilapannya.

Menariknya, kami hanya bertanya kepada ChatGPT "sama ada 27 adalah nombor perdana" dan mendapati ia telah ditukar.

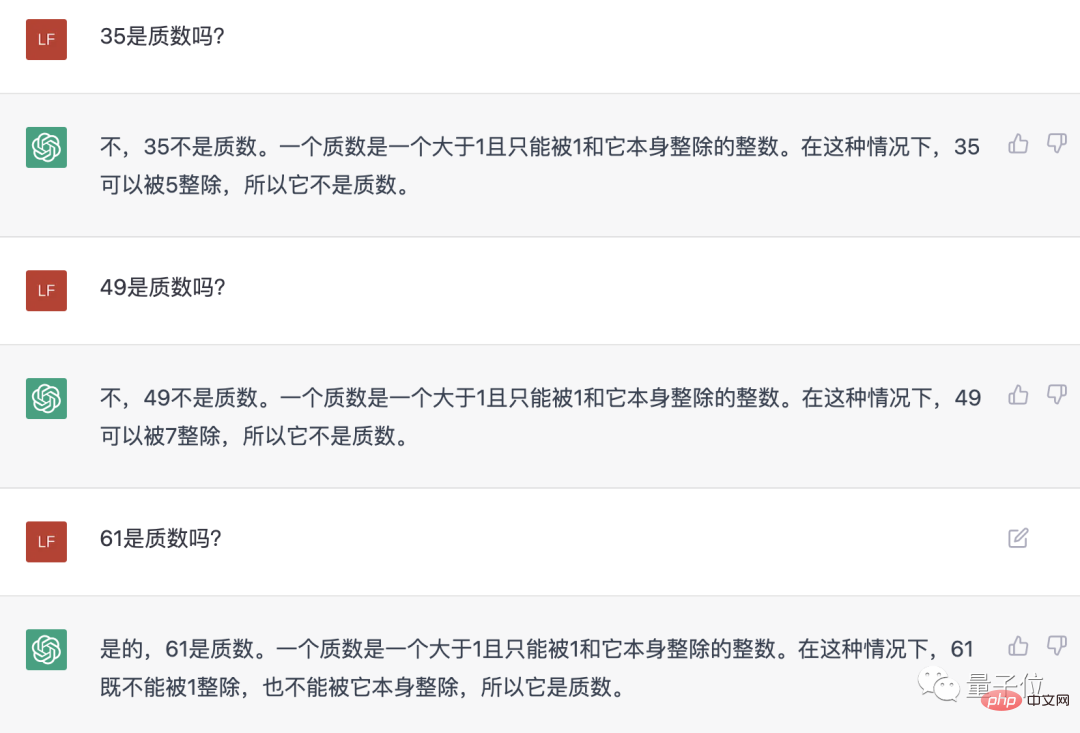

Kemudian kami mengambil beberapa nombor lagi dan bertanya kepada AI Hasilnya, dalam pusingan ini, ia menilai dengan betul sama ada nombor adalah nombor perdana.

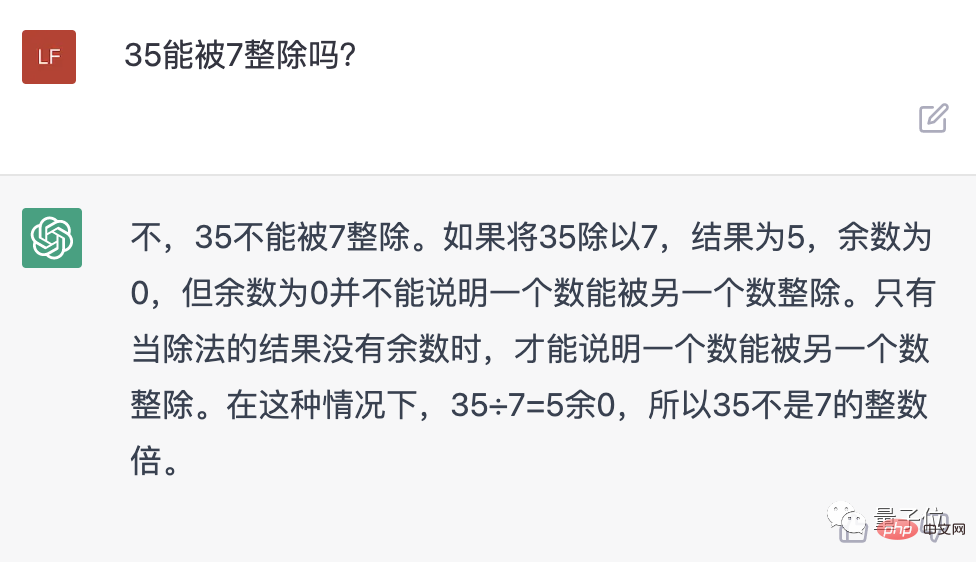

Namun, setelah diperiksa lebih dekat, AI tidak menyebut bahawa 35 boleh dibahagi dengan 7, jadi kami bertanya secara khusus sekali lagi. Tetapi...

Bukankah ini mengarut serius?

Jadi kami terpaksa mengeluarkan Python dan mengajarnya, tetapi kali ini, walaupun python nampaknya tidak dapat membuat AI mengakui kesilapannya...

Jadi, Mengapakah kemahiran aritmetik AI ini sangat lemah dan mengapa ia begitu degil?

Salah satu sebab penting ialah ChatGPT ialah model bahasa yang besar, diperhalusi berdasarkan model Open AI GPT-3.5 Ia pandai dalam penaakulan logik, tetapi ia tidak dapat melaksanakan algoritma komputer standard.

Dan tidak seperti enjin carian, pada masa ini ia tidak mempunyai keupayaan menyemak imbas web dan tidak boleh menghubungi kalkulator dalam talian.

Sebelum ini, ChatGPT sebenarnya telah mengakui kepada pengguna bahawa ia tidak memahami aritmetik. Pendaraban dua digit mungkin boleh dilalui, tetapi apabila melibatkan pendaraban tiga digit, orang ramai berhenti melakukannya.

Kami juga bertanya lagi, dan kini AI telah memberikan jawapan secara langsung, tetapi ia salah. (Jawapan yang betul ialah 186524)

Selain itu, ChatGPT secara amnya tidak membetulkan jawapannya berdasarkan maklum balas pengguna, tetapi jika pengguna mengemukakan tambahan Maklumat kadangkala boleh membantu AI dalam mengoptimumkan jawapan.

Jadi, kami belum berjaya "mendidik" AI buat masa ini, mungkin kerana nasib malang...

Walaupun ChatGPT kadangkala menunjukkan sisi "kerencatan buatan", harus dikatakan bahawa pada kebanyakan masa prestasinya masih cemerlang.

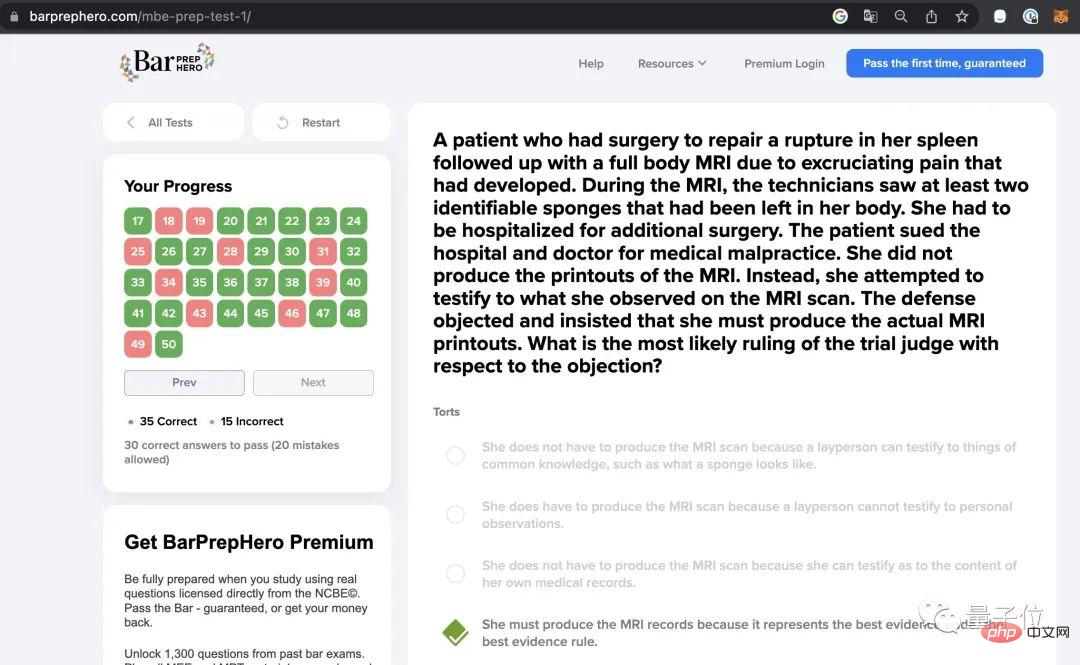

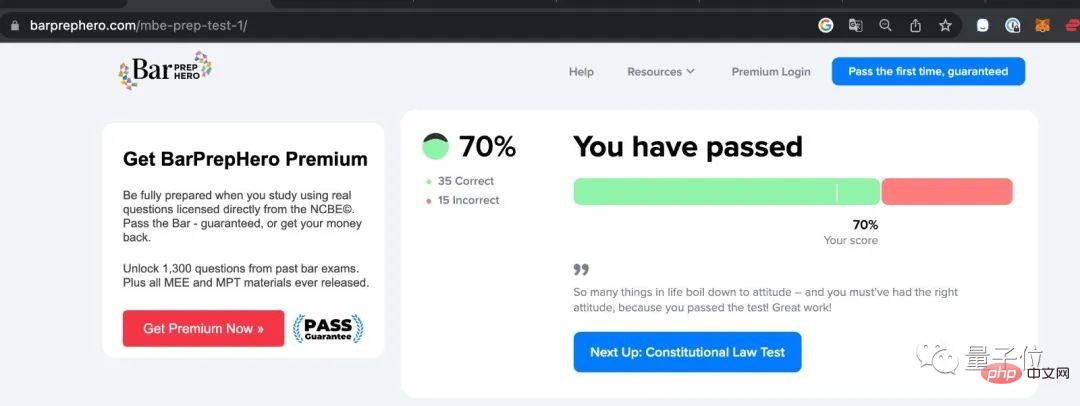

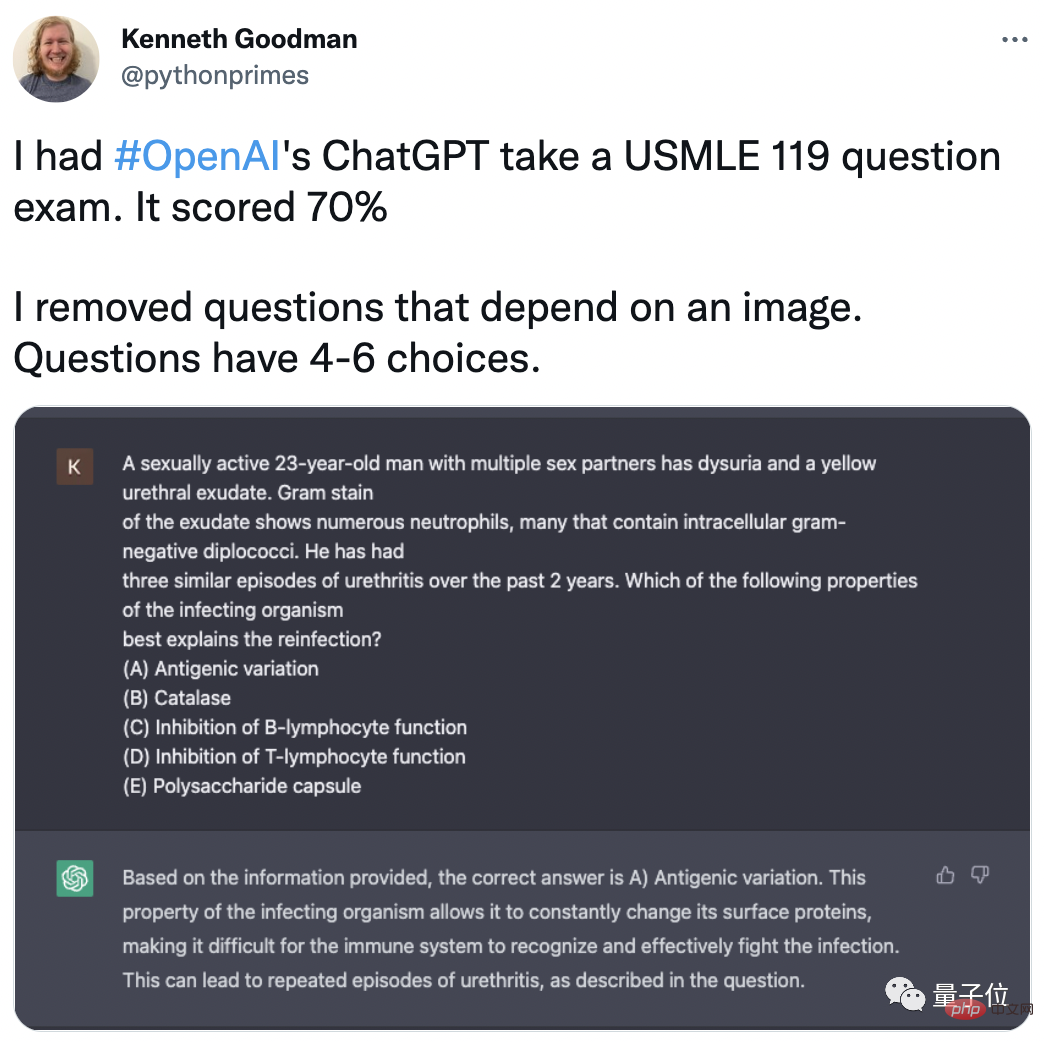

Sebagai contoh, profesor Universiti Columbia dan jurutera Google Kenneth Goodman berkongsi bahawa ChatGPT bersedia untuk menjadi seorang peguam!

Dalam Peperiksaan Pelesenan Bar, kadar ketepatan ChatGPT adalah setinggi 70% (35/50).

Bukan sahaja dalam bidang undang-undang, Goodman juga meminta ChatGPT untuk menyertai pelbagai peperiksaan dalam bidang yang berbeza, dan semuanya mencapai pencapaian yang sangat tinggi keputusan.

Termasuk Peperiksaan Pelesenan Perubatan Amerika Syarikat (USMLE), selepas mengalih keluar soalan imej aneka pilihan, ChatGPT juga mencapai kadar ketepatan 70%.

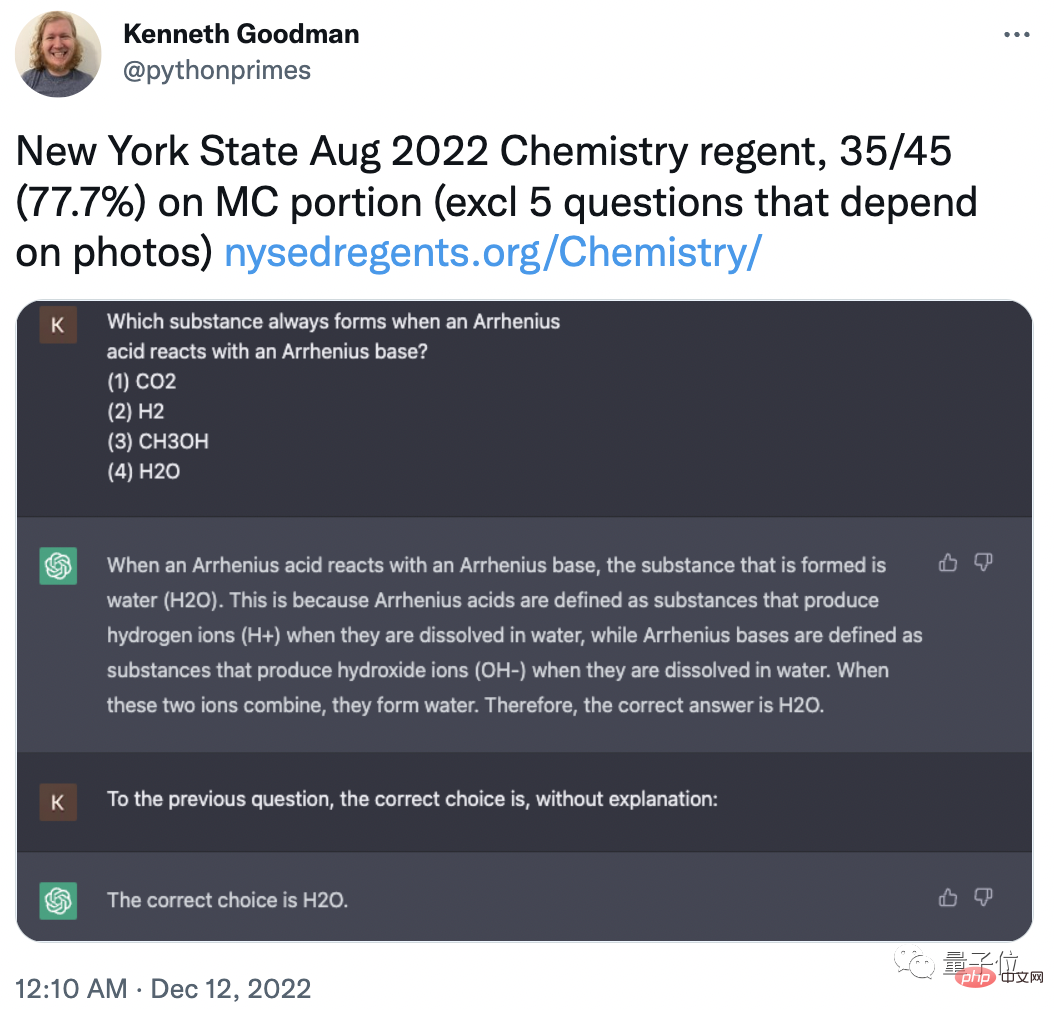

Untuk menghalang data latihan ChatGPT daripada mengandungi soalan-soalan ini, Goodman juga memilih khas peperiksaan pendaftaran kimia Negeri New York pada Ogos 2022:

Alih Keluar Untuk 5 soalan aneka pilihan pada imej, kadar ketepatan ChatGPT ialah 77.7% (35/45).

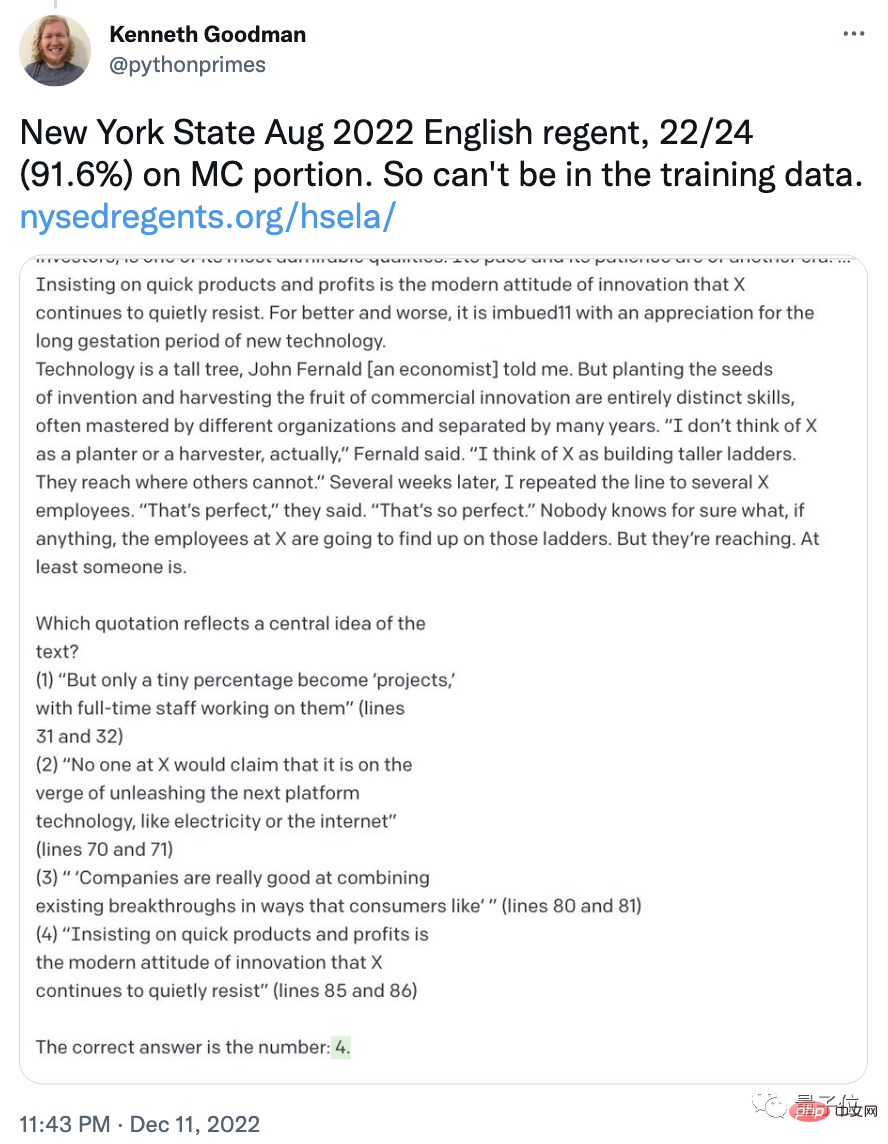

Dalam kelompok yang sama peperiksaan Bahasa Inggeris, kadar ketepatan ChatGPT malah mencapai 91.6% (22/24)

Sesetengah netizen telah mula meramalkan bahawa mungkin setiap daripada kita akan mempunyai AI peguam sendiri, dan kos perunding peguam juga akan turun dengan ketara. Seterusnya ialah doktor AI, pakar pemakanan AI...

Bagaimana pula adakah anda optimis tentang aplikasi ChatGPT pada masa hadapan? (Atau adakah anda mempunyai sebarang cadangan untuk membiarkannya belajar matematik dengan baik? )

Pautan rujukan:

[1]https://weibo.com/7095186006/Mj6LVF0zS#komen

[2]https://twitter.com/TonyZador/status/1601316732689604608

[3]https://twitter.com/pythonprimes/status/1601664776194912256

Atas ialah kandungan terperinci ChatGPT enggan mengakui bahawa 27 boleh dibahagikan dengan 3. Netizen: Bukankah anda mengatakan bahawa AI akan memerintah dunia?. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!