Peranti teknologi

Peranti teknologi

AI

AI

CMU menerbitkan algoritma robot tangkas baharu yang mempelajari cara mengendalikan perabot harian dengan tepat

CMU menerbitkan algoritma robot tangkas baharu yang mempelajari cara mengendalikan perabot harian dengan tepat

CMU menerbitkan algoritma robot tangkas baharu yang mempelajari cara mengendalikan perabot harian dengan tepat

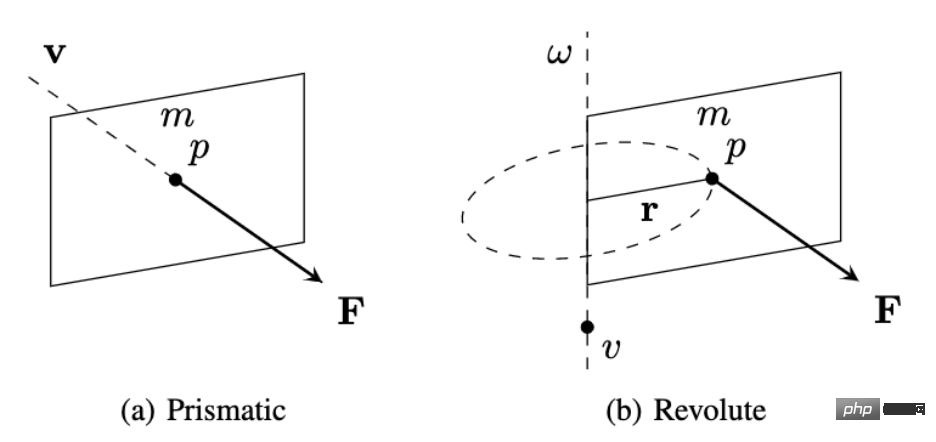

Kebanyakan perabot yang orang ramai bersentuhan dalam kehidupan seharian ialah "objek artikulasi", seperti laci dengan rel tarik keluar, pintu dengan paksi putaran menegak, pintu dengan putaran mendatar Ketuhar aci, kerana bahagian utama bahagian objek ini disambungkan oleh pelbagai sendi.

Disebabkan kewujudan sendi ini, pelbagai bahagian bahagian objek yang disambungkan secara kinematik dikekang oleh sendi, jadi bahagian ini hanya mempunyai satu darjah kebebasan (1 DoF ). Barang-barang ini ada di mana-mana dalam kehidupan kita, terutamanya di rumah harian kita Ia adalah bahagian penting dalam kehidupan seharian kita. Kita sebagai manusia melihat bahawa tidak kira apa jenis perabot yang kita ada, kita boleh memikirkan cara untuk memanipulasi dan mengawalnya dengan cepat. Ia seperti kita tahu bagaimana setiap sendi objek ini bergerak.

Jadi bolehkah robot meramalkan bagaimana perabot akan bergerak seperti manusia? Keupayaan ramalan jenis ini sukar diperoleh, dan jika robot dapat mempelajari keupayaan ini, ia akan menjadi rangsangan besar untuk robot rumah.

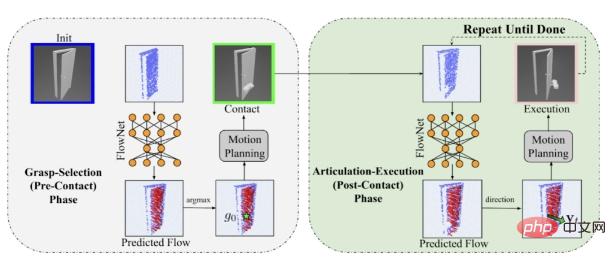

Baru-baru ini, dua pelajar di makmal R-PAD Profesor David Held dari Sekolah Robotik CMU, Ben Eisner dan Harry Zhang, telah membuat kejayaan dalam memanipulasi objek artikulasi yang kompleks dan melancarkan FlowBot 3D untuk Rangkaian Neural berasaskan 3D, algoritma yang secara berkesan menyatakan dan meramalkan trajektori gerakan bahagian objek yang diartikulasikan, seperti perabot harian. Algoritma mengandungi dua bahagian.

Bahagian pertama ialah bahagian persepsi, yang menggunakan rangkaian saraf dalam 3D untuk meramalkan trajektori gerakan serta-merta tiga dimensi daripada data awan titik objek perabot yang dimanipulasi ( Aliran Artikulasi 3D ).

Bahagian kedua algoritma ialah bahagian dasar (dasar), yang menggunakan ramalan Aliran Artikulasi 3D untuk memilih tindakan seterusnya robot. Kedua-duanya dipelajari sepenuhnya dalam simulator dan boleh dilaksanakan secara langsung di dunia nyata tanpa latihan semula atau penalaan. Dengan bantuan algoritma FlowBot 3D, robot boleh memanipulasi objek yang diartikulasikan seperti perabot harian sesuka hati, sama seperti manusia.

Kertas ini merupakan persidangan robotik terbaik dunia Sains Robotik dan Sistem (RSS) 2022 calon kertas terbaik (3%) teratas, dan akan dipamerkan di New York, Amerika Syarikat pada bulan Julai, bersaing dengan 7 artikel cemerlang lain untuk penghormatan kertas terbaik.

- Alamat kertas: https://arxiv.org/pdf/2205.04382.pdf

- Laman utama projek: https:// sites.google.com/view/articulated-flowbot-3d

FlowBot 3D bergantung sepenuhnya pada simulator dan melaksanakan pembelajaran diselia dalam data simulasi untuk mempelajari objek yang diartikulasikan seperti perabot harian Trajektori gerakan serta-merta bahagian (Aliran Berartikulasi 3D). Aliran Artikulasi 3D ialah kaedah perwakilan trajektori awan titik visual yang boleh memudahkan kerumitan strategi seterusnya robot dan meningkatkan generalisasi dan kecekapan. Robot hanya perlu mengikuti trajektori serta-merta ini dan meramalkan semula trajektori ini dalam gelung tertutup untuk menyelesaikan tugas memanipulasi objek bersama.

Sebelum ini, kaedah konvensional untuk memanipulasi objek bersama seperti perabot dalam akademik adalah dengan mengira arah pergerakan bahagian melalui ciri geometri objek yang dimanipulasi (seperti kedudukan dan arah bahagian yang bersambung). , atau dengan meniru strategi pakar (biasanya daripada manusia) untuk mempelajari operasi objek tertentu untuk menyelesaikan tindakan kompleks manipulasi objek bersama. Kaedah tradisional dalam akademik ini tidak mempunyai generalisasi yang baik, dan kecekapan penggunaan data adalah rendah Latihan memerlukan pengumpulan sejumlah besar data demonstrasi manusia. Tidak seperti ini, FlowBot 3D ialah pembelajaran berasaskan simulator semata-mata yang pertama yang tidak memerlukan manusia untuk menyediakan sebarang data demonstrasi, dan algoritma membolehkan robot mengira laluan manipulasi objek yang optimum dengan mempelajari trajektori gerakan serta-merta setiap bahagian, jadi The algoritma mempunyai kebolehgeneralisasian yang hebat. Ciri inilah yang membolehkan FlowBot 3D membuat generalisasi kepada objek yang tidak kelihatan semasa latihan simulator, berjaya memanipulasi barangan perabot harian sebenar secara langsung di dunia nyata.

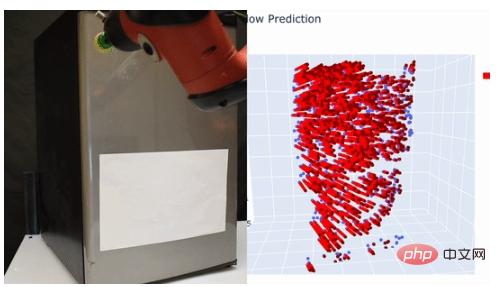

Animasi berikut menunjukkan proses manipulasi FlowBot 3D. Di sebelah kiri ialah video yang dimanipulasi, dan di sebelah kanan ialah trajektori gerakan serta-merta yang diramalkan bagi Aliran Artikulasi 3D awan titik. Algoritma FlowBot 3D mula-mula membolehkan robot mengenal pasti bahagian mana pada objek yang boleh dimanipulasi dan kemudian meramalkan arah pergerakan bahagian itu.

Buka pintu peti sejuk:

Buka tempat duduk tandas:

Buka laci:

Pengulas kertas ini berkata: Secara keseluruhannya, kertas ini sumbangan yang besar kepada sains kawalan robot.

Jadi, bagaimanakah FlowBot 3D mempelajari kemahiran ini?

Apabila manusia melihat barang perabot baru, seperti pintu, kita tahu bahawa pintu itu berputar melalui paksi pintu, dan kita tahu kekangan paksi pintu ini sahaja berputar ke satu arah, supaya kita boleh mengikut arah yang dibayangkan dalam fikiran kita untuk membuka pintu. Oleh itu, jika anda mahu robot benar-benar cekap dan berkesan dalam meramalkan kaedah manipulasi dan trajektori pergerakan objek bersama seperti perabot, cara yang berkesan adalah dengan membiarkan robot memahami kekangan kinematik bahagian-bahagian ini, supaya ia boleh meramalkan pergerakan objek ini.

Kaedah khusus FlowBot 3D tidak rumit dan hanya bergantung pada simulator tanpa memerlukan data manusia sebenar yang rumit. Di samping itu, faedah lain simulator ialah dalam simulator, fail data 3D (URDF) objek isi rumah ini mengandungi kekangan kinematik setiap bahagian dan parameter khusus kekangan, jadi trajektori gerakan setiap bahagian adalah dalam simulator boleh dikira dengan tepat.

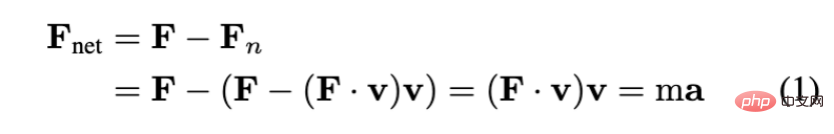

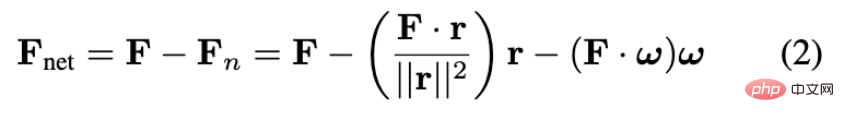

Dua modul untuk FlowBot 3D.

Semasa latihan simulator, robot memerhati data awan titik tiga dimensi objek yang dimanipulasi sebagai data input kepada modul penglihatan robot. Modul penglihatan (modul persepsi) menggunakan PointNet++ untuk meramalkan aliran artikulasi 3D bagi trajektori gerakan serta-merta setiap titik dalam awan titik input di bawah tindakan daya luaran (contohnya, selepas laci dibuka 1cm, pintu dibuka 5 darjah ke luar), menggunakan vektor koordinat tiga dimensi yang dinyatakan dalam bentuk buruk. Data sebenar trajektori gerakan ini boleh dikira dengan tepat melalui kinematik hadapan. Dengan menolak koordinat vektor tiga dimensi semasa daripada koordinat vektor tiga dimensi seterusnya, trajektori gerakan bahagian objek yang dimanipulasi boleh diperolehi. Oleh itu, semasa latihan, hanya kehilangan L2 aliran Artikulasi 3D yang diramalkan perlu diminimumkan untuk pembelajaran diselia.

Dalam gambar ini, titik biru ialah data awan titik yang diperhatikan, dan anak panah merah mewakili fasad 3D yang diramalkan Aliran Berartikulasi.

Belajar dengan cara ini, FlowBot 3D boleh mempelajari arah pergerakan setiap bahagian di bawah kekangan kinematik dan situasi apabila setiap titik pada bahagian tertakluk kepada daya yang sama. kelajuan dan arah relatif gerakan (halaju). Barangan bersama isi rumah biasa adalah prismatik dan revolusioner. Untuk bahagian yang berkedut, seperti laci, arah pergerakan dan kelajuan setiap titik pada permukaan laci adalah sama apabila menerima daya luaran yang sama. Untuk bahagian berputar, seperti pintu, arah pergerakan setiap titik pada permukaan pintu adalah sama apabila menerima daya luaran yang sama, tetapi kelajuan bertambah jauh dari paksi putaran. Para penyelidik menggunakan undang-undang fizikal dalam robotik (teori skru) untuk membuktikan bahawa Aliran Artikulasi 3D terpanjang boleh memaksimumkan pecutan objek. Mengikut undang-undang kedua Newton, strategi ini adalah penyelesaian yang optimum.

Berdasarkan asas teori, dalam operasi sebenar , apa yang perlu dilakukan oleh robot ialah meramalkan trajektori pergerakan setiap titik melalui modul penglihatan FlowBot 3D Dalam setiap trajektori titik, cari titik yang sepadan dengan arah aliran artikulasi 3D terpanjang sebagai titik manipulasi, dan ramalkan manipulasi ini dalam. gelung tertutup Trajektori pergerakan titik. Jika titik manipulasi yang dipilih tidak dapat digenggam dengan jayanya (contohnya, permukaan tidak memenuhi syarat menggenggam tangan robot), maka FlowBot 3D akan memilih titik dengan panjang kedua terpanjang yang memenuhi syarat menggenggam.

Selain itu, disebabkan oleh ciri PointNet++, FlowBot 3D meramalkan trajektori gerakan setiap titik dan tidak bergantung pada ciri geometri objek itu sendiri kemungkinan tersumbat objek oleh robot. Di samping itu, kerana algoritma ini adalah gelung tertutup, robot boleh membetulkan kemungkinan ralatnya dalam langkah ramalan seterusnya.

Prestasi FlowBot 3D di dunia nyataFlowBot 3D mempunyai keupayaan untuk mengatasi cabaran generalisasi dalam dunia nyata. Konsep reka bentuk FlowBot 3D ialah selagi ia boleh meramalkan trajektori pergerakan objek yang dimanipulasi aliran artikulasi 3D dengan tepat, maka langkah seterusnya adalah mengikuti trajektori ini untuk menyelesaikan tugasan.

Satu lagi perkara penting ialah FlowBot 3D menggunakan model latihan tunggal untuk memanipulasi berbilang kategori item, termasuk kategori yang belum dilihat dalam latihan. Dan di dunia nyata, robot hanya perlu menggunakan model yang diperoleh melalui latihan simulator tulen ini untuk memanipulasi pelbagai objek sebenar. Oleh itu, dalam dunia nyata, oleh kerana kekangan kinematik objek rumah adalah sangat sama seperti dalam simulator, FlowBot 3D boleh digeneralisasikan secara langsung kepada dunia nyata.

Item isi rumah yang digunakan oleh FlowBot3D dalam eksperimen dunia sebenar (termasuk tong sampah, peti sejuk, tempat duduk tandas, kotak, peti besi, dll.

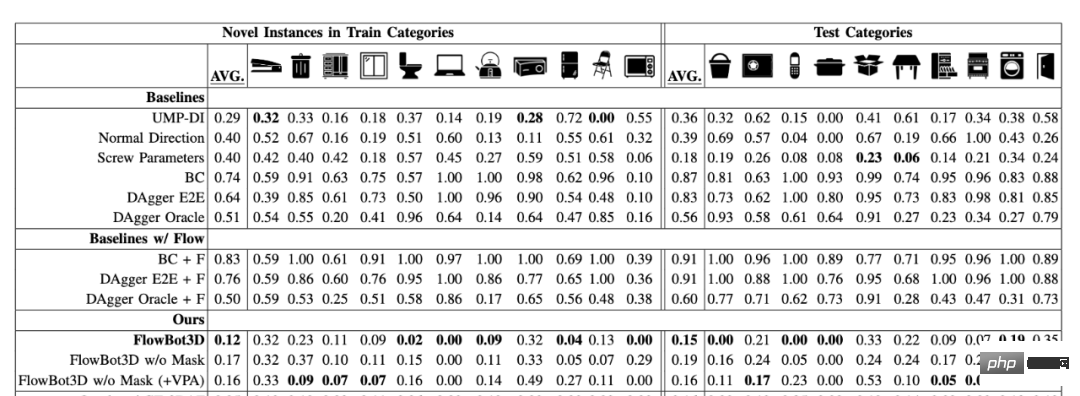

Dalam simulator, robot dilatih menggunakan beberapa kategori barangan rumah, termasuk stapler, tong sampah, laci, tingkap, peti sejuk, dll. Uji data dalam kedua-dua simulator dan objek baharu daripada kategori latihan dan kategori yang tidak dilihat semasa latihan

Tugas manipulasi 3D FlowBot dalam simulator

Tugas manipulasi 3D FlowBot dalam simulator

Hasil eksperimen menunjukkan bahawa FlowBot 3D boleh mencapai jarak kurang daripada 10% apabila mengendalikan kebanyakan objek (sama ada kategori yang dilihat atau tidak dilihat semasa latihan), dan Success Ridge boleh mencapai Lebih daripada 90%. Sebagai perbandingan, kaedah lain berdasarkan pembelajaran tiruan (DAgger) atau pembelajaran pengukuhan (SAC) jauh ketinggalan dan kurang generalisasi. Secara keseluruhannya, FlowBot 3D ialah pekerjaan yang berpotensi besar. Ia boleh digunakan dengan cekap di dunia nyata tanpa memerlukan penalaan halus. Kerja ini juga menunjukkan bahawa kemajuan dalam penglihatan komputer boleh mengubah bidang robotik, terutamanya ekspresi visual trajektori gerakan yang dipanggil aliran artikulasi 3D, yang boleh digunakan untuk pelbagai tugas untuk memudahkan pemilihan strategi robot dan proses membuat keputusan. Dengan ungkapan yang boleh digeneralisasikan ini, kaedah pembelajaran simulator akan berpotensi untuk digunakan secara langsung di dunia nyata, yang akan mengurangkan kos latihan dan pembelajaran robot rumah pada masa hadapan. Pelan seterusnya FlowBot 3DPada masa ini, pasukan penyelidik cuba menggunakan aliran, kaedah pemahaman dan ramalan, kepada objek selain daripada objek bersama, seperti bagaimana untuk gunakan aliran Ramalkan trajektori objek dengan 6 darjah kebebasan. Pada masa yang sama, penulis cuba menggunakan aliran sebagai ekspresi visual umum untuk menerapkannya pada tugas pembelajaran robot lain, seperti pembelajaran pengukuhan, dengan itu meningkatkan kecekapan pembelajaran, keteguhan, dan kebolehgeneralisasian. Halaman utama Profesor Madya David Held: https://davheld.github.io/Halaman utama Ben Eisner: https://beisner.me/Halaman utama Harry Zhang: https:// harryzhangog. github.io/

Sebagai perbandingan, berasaskan tiruan tugas adalah perkara biasa dalam akademia. Kaedah pembelajaran memerlukan bimbingan manual untuk mempelajari cara memanipulasi objek baharu, menjadikannya tidak realistik untuk robot ini dilaksanakan di dunia sebenar, terutamanya dalam senario robot rumah Selain itu, data awan titik 3D lebih kuat daripada data RGB 2D yang digunakan oleh kaedah lain kerana awan titik membolehkan robot memahami setiap sendi dan hubungan antara sendi, ia boleh memahami dan meramalkan trajektori pergerakan bahagian pada tahap yang lebih tinggi, dengan sangat meningkatkan generalisasi >

Atas ialah kandungan terperinci CMU menerbitkan algoritma robot tangkas baharu yang mempelajari cara mengendalikan perabot harian dengan tepat. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1378

1378

52

52

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Bayangkan model kecerdasan buatan yang bukan sahaja mempunyai keupayaan untuk mengatasi pengkomputeran tradisional, tetapi juga mencapai prestasi yang lebih cekap pada kos yang lebih rendah. Ini bukan fiksyen sains, DeepSeek-V2[1], model MoE sumber terbuka paling berkuasa di dunia ada di sini. DeepSeek-V2 ialah gabungan model bahasa pakar (MoE) yang berkuasa dengan ciri-ciri latihan ekonomi dan inferens yang cekap. Ia terdiri daripada 236B parameter, 21B daripadanya digunakan untuk mengaktifkan setiap penanda. Berbanding dengan DeepSeek67B, DeepSeek-V2 mempunyai prestasi yang lebih kukuh, sambil menjimatkan 42.5% kos latihan, mengurangkan cache KV sebanyak 93.3% dan meningkatkan daya pemprosesan penjanaan maksimum kepada 5.76 kali. DeepSeek ialah sebuah syarikat yang meneroka kecerdasan buatan am

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

Awal bulan ini, penyelidik dari MIT dan institusi lain mencadangkan alternatif yang sangat menjanjikan kepada MLP - KAN. KAN mengatasi MLP dari segi ketepatan dan kebolehtafsiran. Dan ia boleh mengatasi prestasi MLP berjalan dengan bilangan parameter yang lebih besar dengan bilangan parameter yang sangat kecil. Sebagai contoh, penulis menyatakan bahawa mereka menggunakan KAN untuk menghasilkan semula keputusan DeepMind dengan rangkaian yang lebih kecil dan tahap automasi yang lebih tinggi. Khususnya, MLP DeepMind mempunyai kira-kira 300,000 parameter, manakala KAN hanya mempunyai kira-kira 200 parameter. KAN mempunyai asas matematik yang kukuh seperti MLP berdasarkan teorem penghampiran universal, manakala KAN berdasarkan teorem perwakilan Kolmogorov-Arnold. Seperti yang ditunjukkan dalam rajah di bawah, KAN telah

Melaksanakan Algoritma Pembelajaran Mesin dalam C++: Cabaran dan Penyelesaian Biasa

Jun 03, 2024 pm 01:25 PM

Melaksanakan Algoritma Pembelajaran Mesin dalam C++: Cabaran dan Penyelesaian Biasa

Jun 03, 2024 pm 01:25 PM

Cabaran biasa yang dihadapi oleh algoritma pembelajaran mesin dalam C++ termasuk pengurusan memori, multi-threading, pengoptimuman prestasi dan kebolehselenggaraan. Penyelesaian termasuk menggunakan penunjuk pintar, perpustakaan benang moden, arahan SIMD dan perpustakaan pihak ketiga, serta mengikuti garis panduan gaya pengekodan dan menggunakan alat automasi. Kes praktikal menunjukkan cara menggunakan perpustakaan Eigen untuk melaksanakan algoritma regresi linear, mengurus memori dengan berkesan dan menggunakan operasi matriks berprestasi tinggi.

Bagaimanakah AI boleh menjadikan robot lebih autonomi dan boleh disesuaikan?

Jun 03, 2024 pm 07:18 PM

Bagaimanakah AI boleh menjadikan robot lebih autonomi dan boleh disesuaikan?

Jun 03, 2024 pm 07:18 PM

Dalam bidang teknologi automasi perindustrian, terdapat dua titik panas terkini yang sukar diabaikan: kecerdasan buatan (AI) dan Nvidia. Jangan ubah maksud kandungan asal, perhalusi kandungan, tulis semula kandungan, jangan teruskan: “Bukan itu sahaja, kedua-duanya berkait rapat, kerana Nvidia tidak terhad kepada unit pemprosesan grafik asalnya (GPU ), ia sedang mengembangkan GPUnya Teknologi ini meluas ke bidang kembar digital dan berkait rapat dengan teknologi AI yang baru muncul "Baru-baru ini, NVIDIA telah mencapai kerjasama dengan banyak syarikat industri, termasuk syarikat automasi industri terkemuka seperti Aveva, Rockwell Automation, Siemens. dan Schneider Electric, serta Teradyne Robotics dan syarikat MiR dan Universal Robotsnya. Baru-baru ini, Nvidiahascoll

Robot Tesla bekerja di kilang, Musk: Tahap kebebasan tangan akan mencapai 22 tahun ini!

May 06, 2024 pm 04:13 PM

Robot Tesla bekerja di kilang, Musk: Tahap kebebasan tangan akan mencapai 22 tahun ini!

May 06, 2024 pm 04:13 PM

Video terbaru robot Tesla Optimus dikeluarkan, dan ia sudah boleh berfungsi di kilang. Pada kelajuan biasa, ia mengisih bateri (bateri 4680 Tesla) seperti ini: Pegawai itu juga mengeluarkan rupanya pada kelajuan 20x - pada "stesen kerja" kecil, memilih dan memilih dan memilih: Kali ini ia dikeluarkan Salah satu sorotan video itu ialah Optimus menyelesaikan kerja ini di kilang, sepenuhnya secara autonomi, tanpa campur tangan manusia sepanjang proses. Dan dari perspektif Optimus, ia juga boleh mengambil dan meletakkan bateri yang bengkok, memfokuskan pada pembetulan ralat automatik: Berkenaan tangan Optimus, saintis NVIDIA Jim Fan memberikan penilaian yang tinggi: Tangan Optimus adalah robot lima jari di dunia paling cerdik. Tangannya bukan sahaja boleh disentuh

Melebihi DPO secara menyeluruh: Pasukan Chen Danqi mencadangkan pengoptimuman pilihan mudah SimPO, dan turut memperhalusi model sumber terbuka 8B terkuat

Jun 01, 2024 pm 04:41 PM

Melebihi DPO secara menyeluruh: Pasukan Chen Danqi mencadangkan pengoptimuman pilihan mudah SimPO, dan turut memperhalusi model sumber terbuka 8B terkuat

Jun 01, 2024 pm 04:41 PM

Untuk menyelaraskan model bahasa besar (LLM) dengan nilai dan niat manusia, adalah penting untuk mempelajari maklum balas manusia untuk memastikan bahawa ia berguna, jujur dan tidak berbahaya. Dari segi penjajaran LLM, kaedah yang berkesan ialah pembelajaran pengukuhan berdasarkan maklum balas manusia (RLHF). Walaupun keputusan kaedah RLHF adalah cemerlang, terdapat beberapa cabaran pengoptimuman yang terlibat. Ini melibatkan latihan model ganjaran dan kemudian mengoptimumkan model dasar untuk memaksimumkan ganjaran tersebut. Baru-baru ini, beberapa penyelidik telah meneroka algoritma luar talian yang lebih mudah, salah satunya ialah pengoptimuman keutamaan langsung (DPO). DPO mempelajari model dasar secara langsung berdasarkan data keutamaan dengan meparameterkan fungsi ganjaran dalam RLHF, sekali gus menghapuskan keperluan untuk model ganjaran yang jelas. Kaedah ini mudah dan stabil

Tiada data OpenAI diperlukan, sertai senarai model kod besar! UIUC mengeluarkan StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

Tiada data OpenAI diperlukan, sertai senarai model kod besar! UIUC mengeluarkan StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

Di barisan hadapan teknologi perisian, kumpulan UIUC Zhang Lingming, bersama penyelidik dari organisasi BigCode, baru-baru ini mengumumkan model kod besar StarCoder2-15B-Instruct. Pencapaian inovatif ini mencapai kejayaan ketara dalam tugas penjanaan kod, berjaya mengatasi CodeLlama-70B-Instruct dan mencapai bahagian atas senarai prestasi penjanaan kod. Keunikan StarCoder2-15B-Instruct terletak pada strategi penjajaran diri yang tulen Keseluruhan proses latihan adalah terbuka, telus, dan sepenuhnya autonomi dan boleh dikawal. Model ini menjana beribu-ribu arahan melalui StarCoder2-15B sebagai tindak balas kepada penalaan halus model asas StarCoder-15B tanpa bergantung pada anotasi manual yang mahal.

Algoritma pengesanan yang dipertingkatkan: untuk pengesanan sasaran dalam imej penderiaan jauh optik resolusi tinggi

Jun 06, 2024 pm 12:33 PM

Algoritma pengesanan yang dipertingkatkan: untuk pengesanan sasaran dalam imej penderiaan jauh optik resolusi tinggi

Jun 06, 2024 pm 12:33 PM

01Garis prospek Pada masa ini, sukar untuk mencapai keseimbangan yang sesuai antara kecekapan pengesanan dan hasil pengesanan. Kami telah membangunkan algoritma YOLOv5 yang dipertingkatkan untuk pengesanan sasaran dalam imej penderiaan jauh optik resolusi tinggi, menggunakan piramid ciri berbilang lapisan, strategi kepala pengesanan berbilang dan modul perhatian hibrid untuk meningkatkan kesan rangkaian pengesanan sasaran dalam imej penderiaan jauh optik. Menurut set data SIMD, peta algoritma baharu adalah 2.2% lebih baik daripada YOLOv5 dan 8.48% lebih baik daripada YOLOX, mencapai keseimbangan yang lebih baik antara hasil pengesanan dan kelajuan. 02 Latar Belakang & Motivasi Dengan perkembangan pesat teknologi penderiaan jauh, imej penderiaan jauh optik resolusi tinggi telah digunakan untuk menggambarkan banyak objek di permukaan bumi, termasuk pesawat, kereta, bangunan, dll. Pengesanan objek dalam tafsiran imej penderiaan jauh