Baru-baru ini, AIGC telah menjadi carian hangat, dan popularitinya kekal tinggi. Sudah tentu, sebagai tambahan kepada nama yang sangat terkenal, kejayaannya juga benar-benar luar biasa: imej, video dan juga model 3D boleh secara automatik. dihasilkan dengan memasukkan bahasa semula jadi Anda berkata Adakah ia mengejutkan?

Tetapi dalam bidang audio dan kesan bunyi, faedah AIGC nampaknya lebih teruk sedikit. Terutamanya kerana penjanaan audio tahap kebebasan tinggi bergantung pada sejumlah besar data pasangan teks-audio, dan terdapat banyak kesukaran dalam pemodelan bentuk gelombang jangka panjang. Untuk menyelesaikan masalah di atas, Universiti Zhejiang dan Universiti Peking bersama-sama mencadangkan sistem penjanaan teks-ke-audio yang inovatif, iaitu Make-An-Audio. Ia boleh mengambil penerangan bahasa semula jadi sebagai input, dan ia boleh dalam sebarang modaliti (seperti teks, audio, imej, video, dll.), dan pada masa yang sama mengeluarkan kesan bunyi audio yang sepadan dengan penerangan majoriti netizen mengabaikan kebolehkawalan dan generalisasinya.

Dalam masa dua hari sahaja, video demo menerima 45K tontonan di Twitter.

Selepas Malam Tahun Baru pada 2023, sejumlah besar artikel sintesis audio muncul, seperti Make-An-Audio dan MusicLM Terdapat 4 perkembangan terobosan dalam masa 48 jam.

Komen netizen 1

Netizen telah menyatakan bahawa sintesis kesan bunyi AIGC akan mengubah masa depan pengeluaran filem dan video pendek.

Komen netizen 2

Komen netizen 3

Sesetengah netizen menyiarkan sedemikian mengeluh: "audio sahaja yang anda perlukan..."

Komen netizen 4

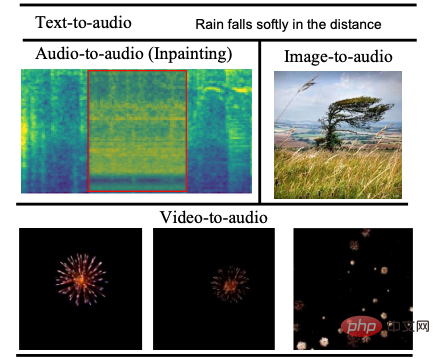

Tanpa berlengah lagi, lihat sahaja kesannya, Jana bunyi kesan berdasarkan teks Ternyata ia boleh menjadi begitu mudah dan lancar.

Teks 1: bot laju berjalan sambil angin bertiup ke dalam mikrofon

Tukar audio 1Audio: 00:0000:09

Teks 2: bunga api meletus dan meletup

Tukar audio 2Audio: 00:0000:09

Pernahkah anda bermasalah dengan membaiki audio yang rosak? Sebaik sahaja model Make-An-Audio keluar, ini menjadi lebih mudah.

Sebelum dibaiki

Audio sebelum dibaiki

Audio sebelum dibaikiAudio: 00:0000:09

Selepas dibaiki

Audio Dibaiki

Audio DibaikiAudio: 00: 0000:09

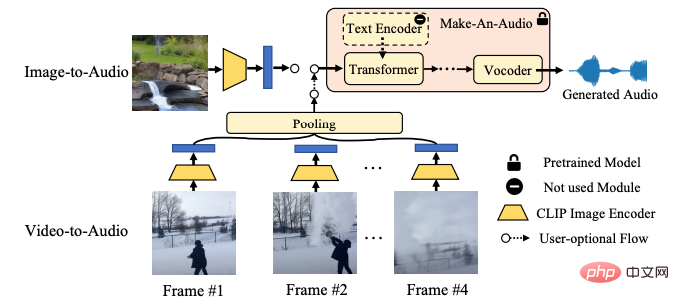

Fahami gambar untuk menjana kesan bunyi melalui , tidak mustahil.

Gambar 1

Tukar Audio

Tukar Imej AudioAudio: 00:0000:09

Gambar 2

Tukar Audio

Tukar Gambar Audio 2Audio: 00:0000:09

mengikutKandungan video menghasilkan kesan bunyi yang sepadan, model ini juga boleh melakukannya dengan mudah.

Video 1

Tukar audio

Video 1Audio: 00:0000:09

Video 2

Audio penukaran

Video 2Audio: 00:0000:09

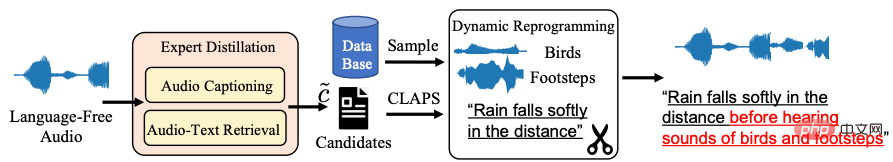

Analisis mendalam tentang konotasi ajaib model "Selebriti Internet", tetapi juga kembali kepada masalah objektif data jarang bahasa audio semula jadi, dalam hal ini Universiti Zhejiang dan Universiti Peking bersama-sama melancarkan Volcano Voice Pasukan itu bekerjasama dengan dua universiti utama untuk bersama-sama mencadangkan Strategi peningkatan teks Distill-then-Reprogram , yang menggunakan model guru untuk dapatkan penerangan bahasa semula jadi bagi audio, dan kemudian dapatkan latihan dinamik melalui sampel penyusunan semula rawak.

Khususnya, dalam pautan Distill, model perolehan audio-ke-teks dan teks audio digunakan untuk mencari calon penerangan bahasa semula jadi (Calon) untuk audio bebas bahasa memadankan persamaan antara teks calon dan audio, hasil terbaik diperoleh di bawah ambang sebagai perihalan audio. Kaedah ini mempunyai generalisasi yang kuat, dan bahasa semula jadi sebenar mengelakkan teks luar domain dalam fasa ujian. "Dalam fasa Program Semula, pasukan mengambil sampel secara rawak daripada set data acara tambahan dan menggabungkannya dengan sampel latihan semasa untuk mendapatkan kombinasi dan penerangan konsep baharu untuk meningkatkan keteguhan model kepada kombinasi acara yang berbeza," kata pasukan penyelidik.

Suling-kemudian-program semula gambarajah rangka kerja strategi peningkatan teks

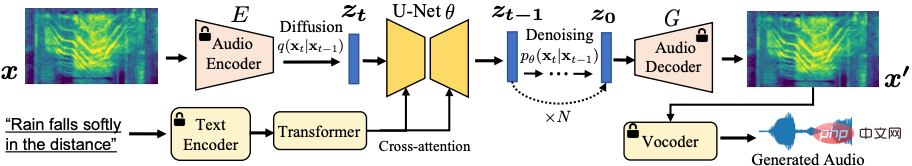

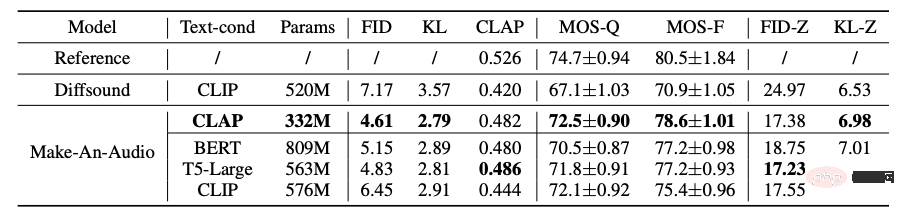

Selain itu, dalam penyelidikan, pasukan juga meneroka strategi keadaan teks yang berkuasa, termasuk Contrastive Language-Audio Pretraining (CLAP) dan model bahasa (LLM) T5, BERT, dsb., yang mengesahkan keberkesanan dan keramahan pengiraan seks perwakilan teks CLAP. Pada masa yang sama, Skor CLAP digunakan buat kali pertama untuk menilai audio yang dihasilkan, yang boleh digunakan untuk mengukur konsistensi antara teks dan adegan yang dihasilkan menggunakan gabungan kaedah penilaian subjektif dan objektif, keberkesanan model telah disahkan; dalam ujian set data penanda aras, menunjukkan Model ini mempunyai generalisasi pembelajaran sifar pukulan (Zero-Shot) yang sangat baik, dsb.

Sejauh manakah anda tahu tentang prospek permohonan model ajaib?

Secara keseluruhannya, model Make-An-Audio mencapai kualiti tinggi, sintesis audio yang sangat dikawal dan mencadangkan "Tiada Modaliti Tertinggal" untuk memperhalusi model audio bersyarat teks ( finetune), yang boleh membuka kunci sintesis audio (audio/imej/video) untuk sebarang input modal.

Untuk sintesis audio dipandu secara visual, Make-An-Audio mengambil pengekod teks CLIP sebagai syarat dan menggunakan ruang bersama teks imejnya , boleh terus mensintesis audio berdasarkan pengekodan imej.

Adalah dijangkakan bahawa AIGC sintesis audio akan memainkan peranan penting dalam alih suara filem pada masa hadapan, penciptaan video pendek dan bidang lain, dan dengan bantuan model seperti Make-An-Audio, ia mungkin boleh dilakukan untuk semua orang untuk menjadi profesional pada masa hadapan Jurutera kesan bunyi boleh menggunakan teks, video dan imej untuk mensintesis audio dan kesan bunyi seperti hidup pada bila-bila masa dan di mana-mana tempat. Walau bagaimanapun, Make-An-Audio tidak sempurna pada peringkat ini Mungkin disebabkan oleh sumber data yang kaya dan isu kualiti sampel yang tidak dapat dielakkan, kesan sampingan pasti akan berlaku semasa proses latihan, seperti menghasilkan audio yang tidak mematuhi kandungan teks. Make-An- Audio secara teknikal diletakkan sebagai "generasi artis terbantu", dan satu perkara yang pasti, kemajuan dalam bidang AIGC sememangnya mengejutkan. Huoshan Voice telah lama menyediakan barisan perniagaan utama ByteDance dengan keupayaan teknologi suara AI yang berfaedah secara global dan penyelesaian produk suara tindanan penuh, termasuk pemahaman audio, sintesis audio dan Orang digital maya, dialog interaksi, mendapatkan semula muzik, perkakasan pintar, dsb. Sejak penubuhannya pada 2017, pasukan itu telah menumpukan pada membangunkan teknologi suara pintar AI yang menerajui industri dan sentiasa meneroka gabungan AI yang cekap dan senario perniagaan untuk mencapai nilai pengguna yang lebih besar. Pada masa ini, pengecaman pertuturan dan sintesis pertuturannya telah merangkumi pelbagai bahasa dan dialek Banyak kertas teknikal telah dipilih ke dalam pelbagai persidangan AI teratas, menyediakan keupayaan suara terkemuka untuk Douyin, Jianying, Feishu, Novel Tomato, Pico dan perniagaan lain. . Ia sesuai untuk pelbagai senario seperti video pendek, siaran langsung, penciptaan video, pejabat dan peranti boleh pakai, dan terbuka kepada syarikat luar melalui Volcano Engine.

Atas ialah kandungan terperinci Audio ini menjadi viral di Internet! Hasilkan kesan bunyi yang realistik daripada teks dan gambar dengan satu klik, AIGC akan datang ke industri audio. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Apakah kemahiran yang diperlukan untuk bekerja dalam industri PHP?

Apakah kemahiran yang diperlukan untuk bekerja dalam industri PHP?

kaedah tampalan naik taraf win10

kaedah tampalan naik taraf win10

Bagaimana untuk melaraskan saiz teks dalam mesej teks

Bagaimana untuk melaraskan saiz teks dalam mesej teks

Perbezaan antara timbunan dan timbunan

Perbezaan antara timbunan dan timbunan

Apakah arahan penutupan Linux?

Apakah arahan penutupan Linux?

Belajar C# dari awal

Belajar C# dari awal

Tutorial Mendapatkan Ikon Komputer Saya Win10

Tutorial Mendapatkan Ikon Komputer Saya Win10

Bagaimana untuk memusatkan teks div secara menegak

Bagaimana untuk memusatkan teks div secara menegak

keperluan konfigurasi perkakasan pelayan web

keperluan konfigurasi perkakasan pelayan web