Siapakah yang menerbitkan penyelidikan AI yang paling berpengaruh? Dalam era "membiarkan seratus bunga mekar", isu ini berpotensi besar untuk diterokai.

Anda mungkin telah meneka beberapa kesimpulan: seperti institusi terkemuka seperti Google, Microsoft, OpenAI dan DeepMind Kesimpulan seperti ini hanya separuh betul. Terdapat juga beberapa maklumat lain memberi kami kesimpulan Mendedahkan yang sebaliknya tidak diketahui.

Dengan perkembangan pesat inovasi AI, adalah penting untuk mendapatkan sedikit "kepintaran" secepat mungkin. Lagipun, hanya sedikit orang yang mempunyai masa untuk membaca segala-galanya, tetapi apa yang pasti ialah kertas kerja yang disusun dalam artikel ini berpotensi mengubah arah teknologi kecerdasan buatan.

Ujian sebenar pengaruh pasukan R&D sudah tentu bagaimana teknologi itu dilaksanakan dalam produk OpenAI mengeluarkan ChatGPT pada penghujung November 2022, yang mengejutkan seluruh bidang ini adalah selepas 2022 Satu lagi kejayaan mereka selepas kertas Mac "Melatih model bahasa untuk mengikuti arahan dengan maklum balas manusia" (Melatih model bahasa untuk mengikuti arahan dengan maklum balas manusia).

Jarang ada produk yang dilancarkan begitu cepat. Oleh itu, untuk mendapatkan cerapan tentang maklumat lanjut, statistik Zeta Alpha baru-baru ini menggunakan penunjuk akademik klasik: Bilangan petikan.

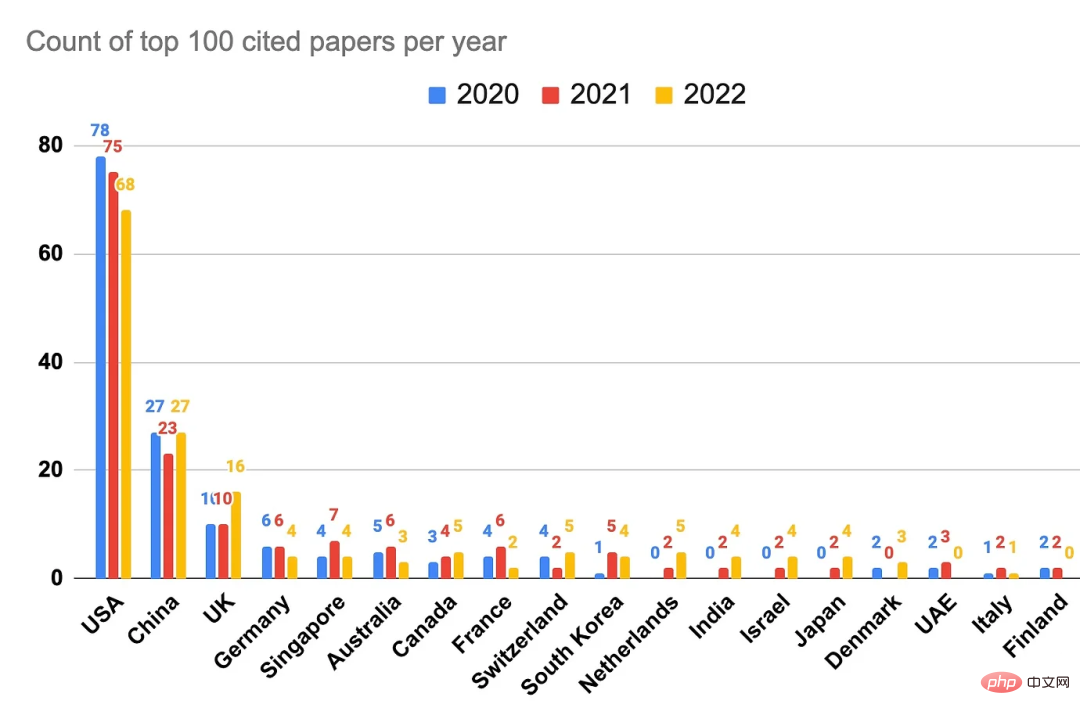

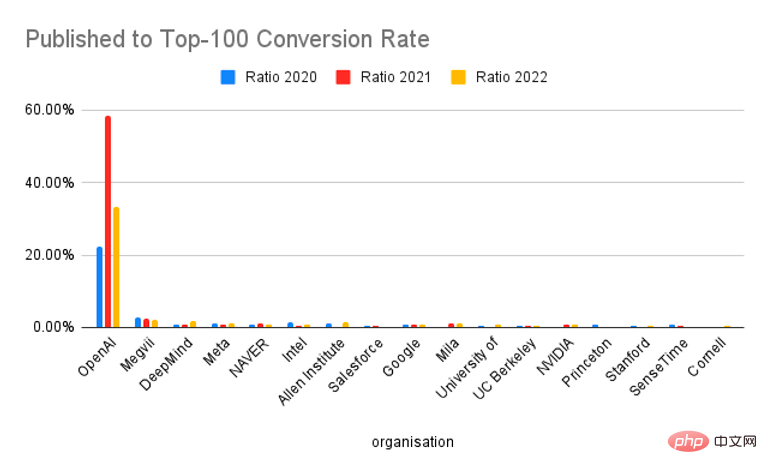

Analisis terperinci bagi 100 kertas kerja yang paling banyak disebut dalam setiap tahun 2022, 2021 dan 2020 memberikan cerapan tentang institusi dan negara yang sedang menerbitkan penyelidikan / bidang AI yang paling berpengaruh. Beberapa kesimpulan awal ialah: Amerika Syarikat dan Google masih mendominasi, dan DeepMind juga mempunyai tahun yang hebat, tetapi memandangkan output, OpenAI benar-benar berada di barisan hadapan dari segi kesan dan penyelidikan produk, dan boleh diterima pakai dengan cepat dan meluas.

Sumber: Zeta Alpha.

Seperti yang ditunjukkan dalam rajah di atas, satu lagi kesimpulan penting ialah China menduduki tempat kedua dari segi pengaruh petikan penyelidikan, tetapi masih terdapat jurang berbanding dengan Amerika Syarikat diterangkan dalam banyak laporan, "menyamai atau melebihi".

Menggunakan data daripada platform Zeta Alpha, dan kemudian digabungkan dengan penyusunan manual, artikel ini mengumpulkan kertas yang paling banyak disebut dalam bidang kecerdasan buatan pada 2022, 2021 dan 2020, dan menganalisis pengarang Institusi dan negara/rantau. Ini membolehkan penarafan kertas ini mengikut kesan R&D dan bukannya data penerbitan tulen.

Untuk mencipta keputusan analisis, kertas kerja ini mula-mula mengumpulkan kertas yang paling banyak disebut setiap tahun pada platform Zeta Alpha, dan kemudian menyemak secara manual tarikh penerbitan pertama (biasanya pracetak arXiv) untuk Kertas diletakkan pada tahun yang betul. Senarai ini kemudiannya ditambah dengan melombong kertas AI yang dipetik tinggi pada Semantic Scholar, yang mempunyai liputan yang lebih luas dan keupayaan untuk mengisih mengikut kiraan petikan. Ini terutamanya mendedahkan kertas kerja dari luar penerbit berimpak tinggi seperti Nature, Elsevier, Springer dan jurnal lain. Kemudian, bilangan petikan untuk setiap kertas di Google Scholar telah digunakan sebagai metrik perwakilan, dan kertas itu diisih mengikut nombor ini untuk mencapai 100 teratas untuk tahun tersebut. Untuk kertas kerja ini, kami menggunakan GPT-3 untuk mengekstrak pengarang, gabungan dan negara dan menyemak hasil carian ini secara manual (jika negara itu tidak jelas dalam penerbitan, negara tempat pertubuhan itu beribu pejabat digunakan). Jika kertas kerja mempunyai pengarang daripada pelbagai institusi, setiap institusi dikira sekali.

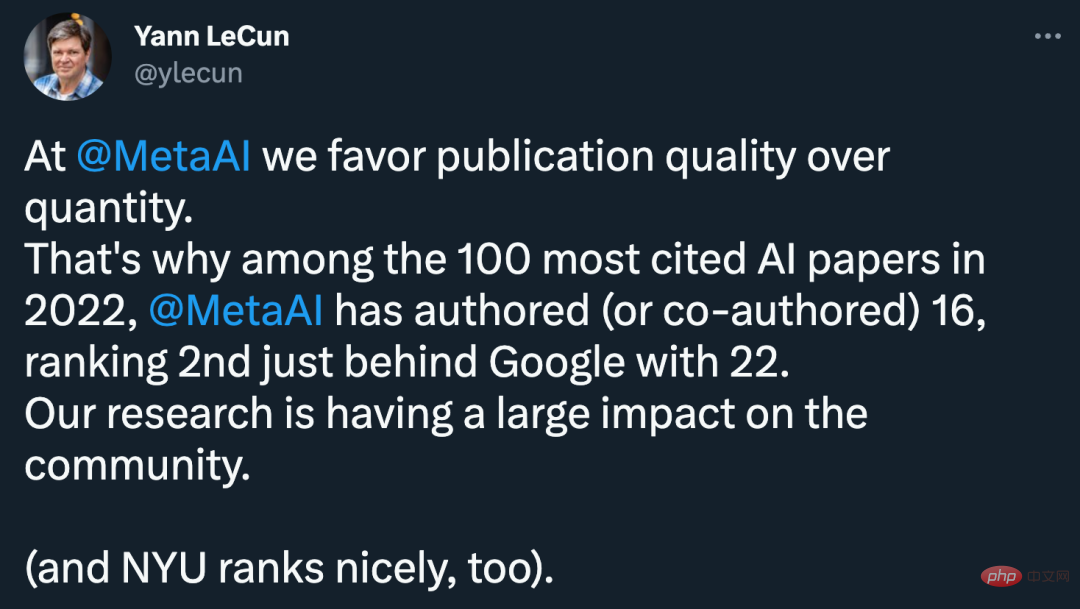

Selepas membaca ranking ini, bos Yann LeCun berkata dia sangat gembira: "Di Meta AI, kami cenderung untuk menerbitkan kualiti dan bukannya kuantiti. Inilah sebabnya disebut pada 2022 Meta AI telah mengarang (atau mengarang bersama) 16 daripada 100 kertas kecerdasan buatan teratas, menduduki tempat kedua selepas Google 22. Penyelidikan kami memberi impak yang besar kepada masyarakat (selain itu, Universiti New York. Kedudukannya juga sangat baik).

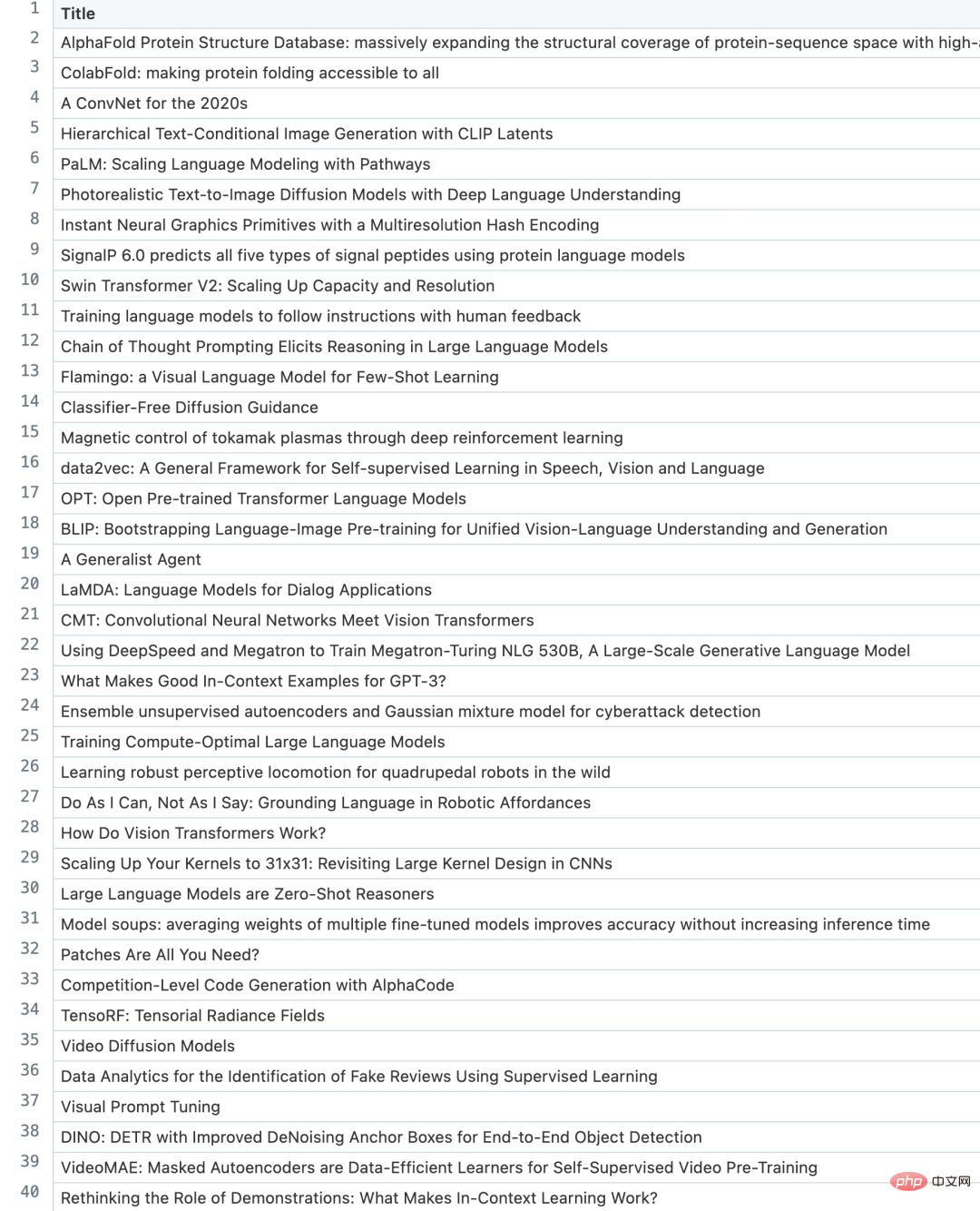

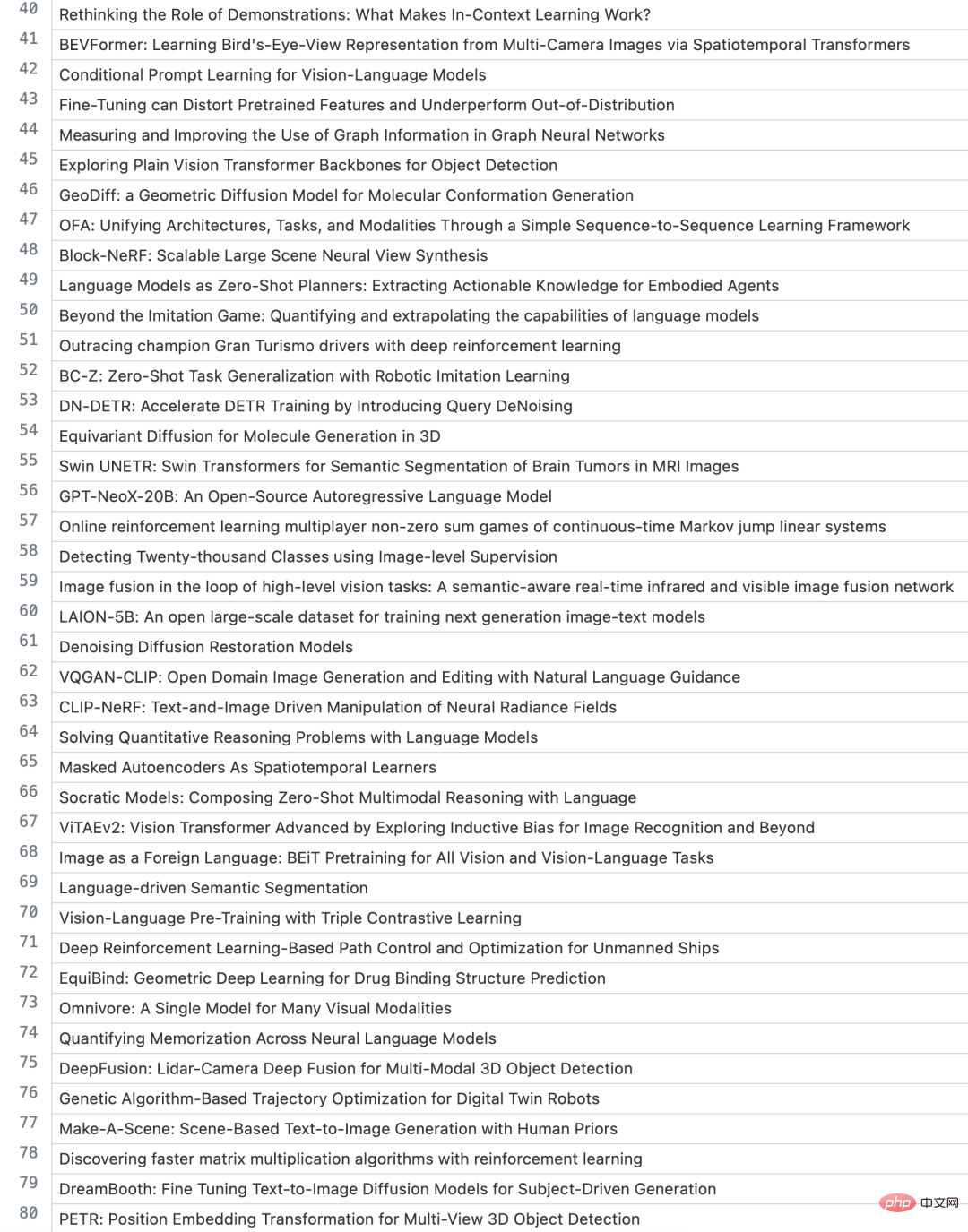

Jadi, apakah kertas teratas yang baru kita bincangkan?

Sebelum kita menyelami nombor, mari kita lihat kertas teratas dari tiga tahun yang lalu. Saya pasti anda akan mengenali beberapa daripada mereka.

1 Pangkalan Data Struktur Protein AlphaFold: meluaskan liputan struktur ruang jujukan protein dengan model ketepatan tinggi

2. ColabFold: menjadikan lipatan protein boleh diakses oleh semua

3. 🎜 >Pautan kertas: https://arxiv.org/abs/2204.06125

Pautan kertas: https://arxiv.org/abs/2201.03545

Pautan kertas: https:/ /arxiv. org/abs/2204.02311

Pautan kertas: https://www.nature.com/articles/s41586-021-03819-2Institusi: DeepMind

Pautan kertas: https://arxiv.org/abs/2103.14030Institusi: Microsoft

Pautan kertas: https://arxiv.org/abs/2103.00020Institusi: OpenAI

5 "Hartanah Muncul dalam Transformers Penglihatan Sendiri"

1 "Imej Bernilai 16x16 Perkataan: Transformer untuk Pengecaman Imej pada Skala"

2 Pelajar"

3. "YOLOv4: Kelajuan Optimum dan Ketepatan Pengesanan Objek"

4 "Meneroka Had Pembelajaran Pemindahan dengan Transformer Teks-ke-Teks Bersatu "

5. "Bootstrap laten anda sendiri: Pendekatan baharu untuk Pembelajaran diselia sendiri"

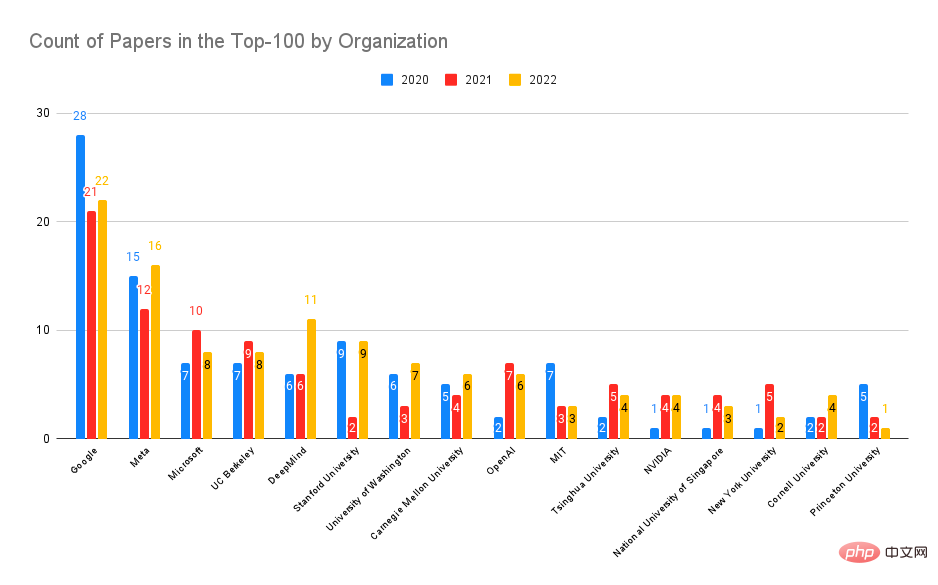

Mari kita lihat beberapa institusi terkemuka dalam 100 teratas Kedudukan bilangan kertas terkenal:

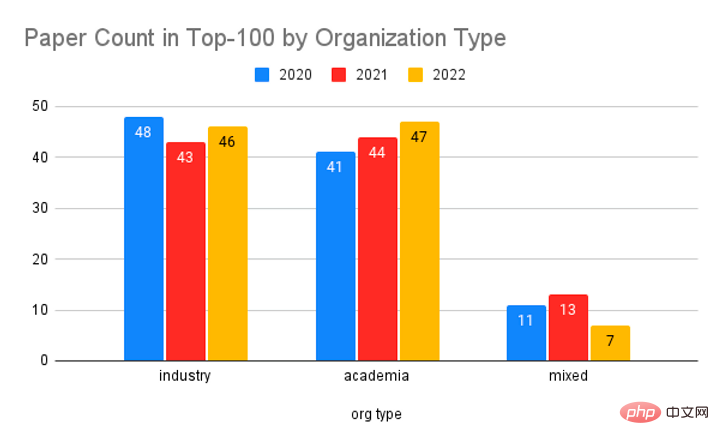

Google sentiasa menjadi yang terkuat pemain, diikuti oleh Meta , Microsoft, UC Berkeley, DeepMind dan Stanford . Walaupun industri kini menjadi kuasa dominan dalam penyelidikan AI, satu institusi akademik tidak akan mempunyai kesan yang besar, tetapi ekor institusi ini lebih panjang, jadi apabila kita mengagregat mengikut jenis organisasi, keseimbangan dicapai .

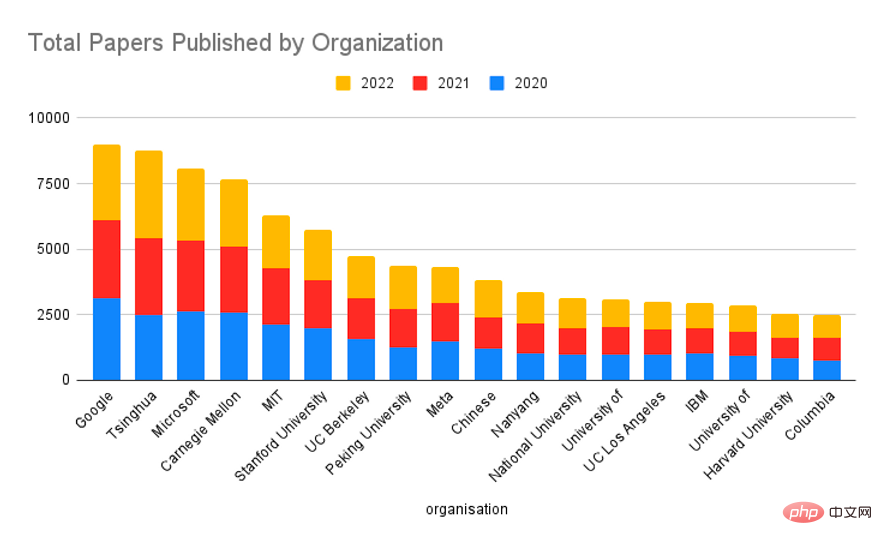

Dari segi jumlah volum penyelidikan, Google telah menduduki tempat pertama dalam tempoh tiga tahun yang lalu, Universiti Tsinghua, Universiti Carnegie Mellon, MIT, Universiti Stanford dan universiti lain berada pada kedudukan tinggi, manakala Microsoft menduduki tempat ketiga Bit. Secara keseluruhannya, institusi akademik menghasilkan lebih banyak penyelidikan berbanding syarikat teknologi dalam industri, dan dua gergasi teknologi Google dan Microsoft juga telah menerbitkan bilangan kajian yang tinggi dalam tempoh tiga tahun yang lalu.

Malah, kekuatan penyelidikan saintifik Google sentiasa sangat kukuh. Pada tahun 2017, Google menerbitkan kertas kerja "Perhatian Adalah Semua yang Anda Perlukan", menandakan kemunculan transformer. Sehingga hari ini, transformer masih menjadi asas seni bina kebanyakan model NLP dan CV, termasuk ChatGPT.

Bulan lepas, sempena pelancaran Bard, Ketua Pegawai Eksekutif Google Sundar Pichai turut menyatakan dalam surat terbuka: "Google AI dan DeepMind mempromosikan pembangunan teknologi paling canggih. Kami Transformer Projek penyelidikan dan kertas lapangan 2017 kami, bersama-sama dengan kemajuan penting kami dalam model penyebaran, adalah asas untuk banyak aplikasi AI generatif semasa OpenAI, syarikat di sebalik penstriman ChatGPT, mempunyai kelebihan mutlak dalam kadar penukaran hasil penyelidikannya tiga tahun yang lalu. Dalam beberapa tahun kebelakangan ini, kebanyakan hasil penyelidikan OpenAI telah menarik perhatian besar, terutamanya dalam model bahasa berskala besar.

Pada tahun 2020, OpenAI mengeluarkan GPT-3, model bahasa berskala besar dengan 175 bilion parameter penukar permainan dalam bidang pemodelan bahasa kerana ia menyelesaikan banyak masalah sukar dalam pemodelan bahasa berskala besar. GPT-3 mencetuskan kegilaan untuk model bahasa berskala besar. Selama beberapa tahun, skala parameter model bahasa telah dipecahkan secara berterusan, dan orang ramai telah meneroka lebih banyak potensi model bahasa berskala besar.

Pada tahun 2020, OpenAI mengeluarkan GPT-3, model bahasa berskala besar dengan 175 bilion parameter penukar permainan dalam bidang pemodelan bahasa kerana ia menyelesaikan banyak masalah sukar dalam pemodelan bahasa berskala besar. GPT-3 mencetuskan kegilaan untuk model bahasa berskala besar. Selama beberapa tahun, skala parameter model bahasa telah dipecahkan secara berterusan, dan orang ramai telah meneroka lebih banyak potensi model bahasa berskala besar.

Pada penghujung tahun 2022, ChatGPT dilahirkan, yang menarik perhatian besar kepada penjanaan teks dan sistem dialog AI. Khususnya, ChatGPT telah menunjukkan keupayaan yang sangat tinggi dalam menjana kandungan berasaskan pengetahuan dan menjana kod. Selepas Google dan Microsoft secara berturut-turut mengumumkan penyepaduan fungsi seperti ChatGPT ke dalam enjin carian generasi akan datang, ChatGPT dipercayai akan menerajui revolusi baharu dalam AIGC dan alatan pintar.

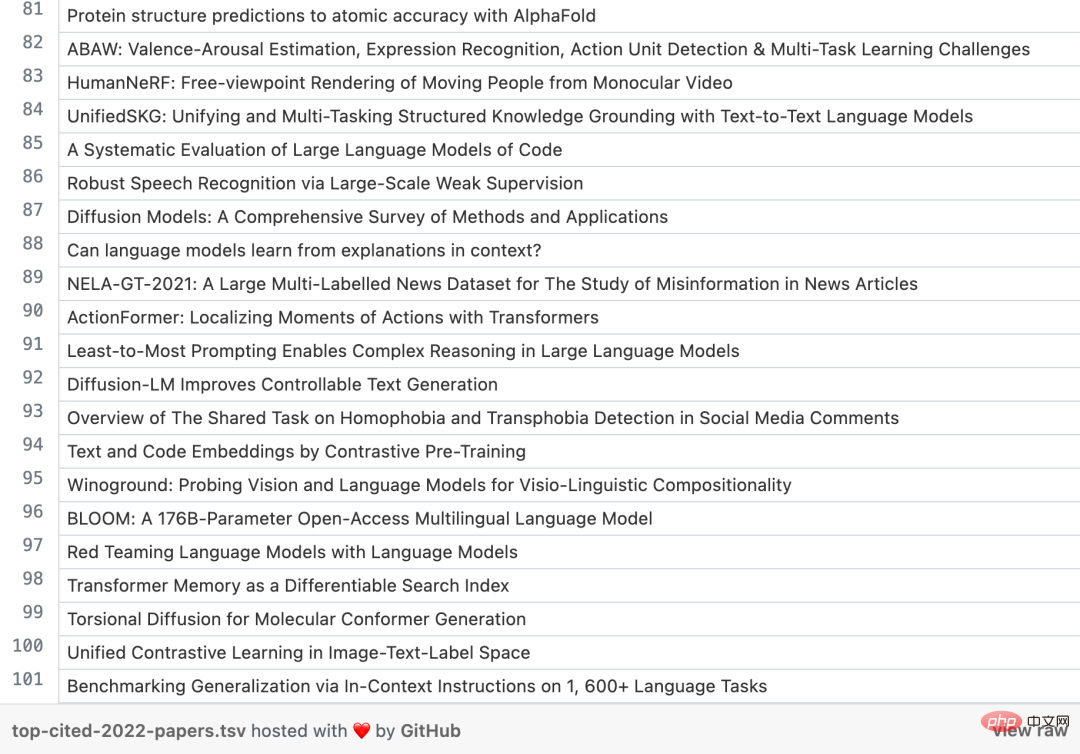

Akhir sekali, mari kita lihat 100 kertas kerja yang paling banyak disebut pada tahun 2022:

Bilangan sebutan Twitter juga telah ditambah di sini, Ini kadangkala dilihat sebagai penunjuk awal kesan. Tetapi setakat ini, korelasi kelihatan lemah. Kerja lanjut diperlukan.

Bilangan sebutan Twitter juga telah ditambah di sini, Ini kadangkala dilihat sebagai penunjuk awal kesan. Tetapi setakat ini, korelasi kelihatan lemah. Kerja lanjut diperlukan.

Atas ialah kandungan terperinci Siapa yang telah menerbitkan penyelidikan AI yang paling berpengaruh? Google jauh ke hadapan, dan kadar penukaran pencapaian OpenAI mengatasi DeepMind. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Cara menggunakan findbugs

Cara menggunakan findbugs

penggunaan fungsi vlookup excel

penggunaan fungsi vlookup excel

penggunaan fungsi setproperty

penggunaan fungsi setproperty

Apakah ciri-ciri utama komputer?

Apakah ciri-ciri utama komputer?

Kaedah pendaftaran akaun Google

Kaedah pendaftaran akaun Google

Apakah alat semakan nama domain terbalik IP?

Apakah alat semakan nama domain terbalik IP?

imp oracle

imp oracle

Adakah anda tahu jika anda membatalkan orang lain sejurus selepas mengikuti mereka di Douyin?

Adakah anda tahu jika anda membatalkan orang lain sejurus selepas mengikuti mereka di Douyin?