Peranti teknologi

Peranti teknologi

AI

AI

2023 akan datang, tinjauan tahunan Ng Enda, Bengio dan nama besar lain! Adakah model AI rasional akan datang?

2023 akan datang, tinjauan tahunan Ng Enda, Bengio dan nama besar lain! Adakah model AI rasional akan datang?

2023 akan datang, tinjauan tahunan Ng Enda, Bengio dan nama besar lain! Adakah model AI rasional akan datang?

Tidak sampai 3 hari, 2022 akan berakhir.

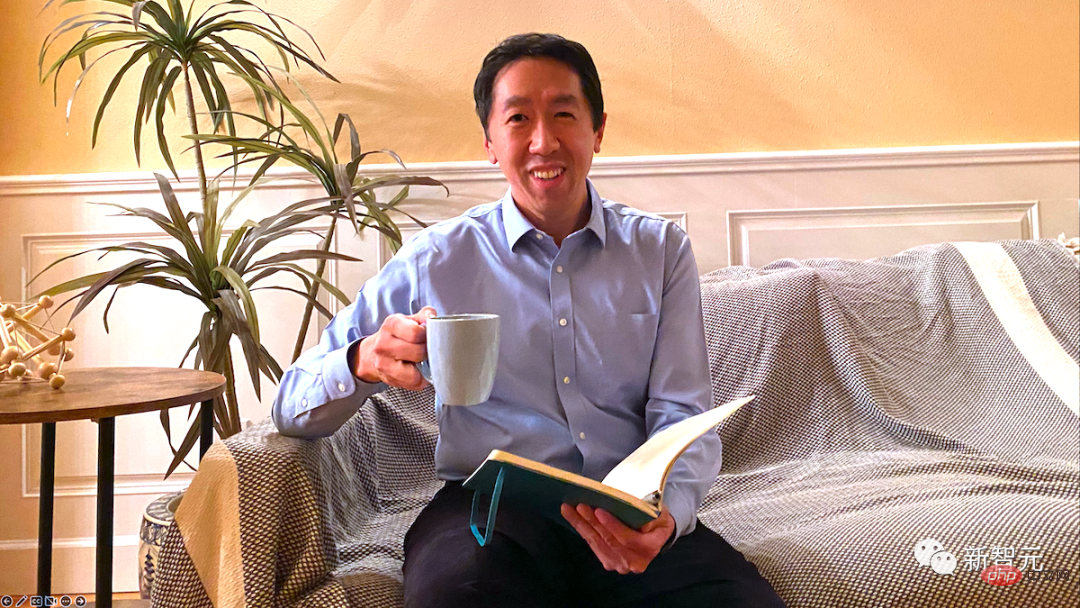

Sempena mengucapkan selamat tinggal kepada yang lama dan mengalu-alukan yang baharu, Ng Enda, Bengio dan taikun AI lain berkumpul bersama di DeepLearning.ai untuk menantikan tahun 2023 dalam mata sendiri.

Sebagai pengasas DeepLearning.ai, Andrew Ng mula-mula menyampaikan ucapan alu-aluan dan mengimbau kembali tahun-tahun ketika dia mula-mula membuat penyelidikan, bersiap sedia untuk pelbagai aspek ini Perbincangan bermula dengan baik dengan penyertaan beberapa gambar besar.

Rakan-rakan yang dihormati:

Semasa kita memasuki tahun baru, Marilah kita fikirkan 2023 bukan sebagai tahun tunggal, terpencil, tetapi sebagai tahun pertama daripada banyak tahun pada masa hadapan di mana kami akan mencapai matlamat jangka panjang kami. Sesetengah keputusan mengambil masa yang lama untuk dicapai, tetapi kita boleh melakukan ini dengan lebih berkesan jika kita membayangkan jalan daripada hanya pergi dari satu pencapaian ke seterusnya.

Semasa saya masih muda, saya mempunyai sedikit hubungan konkrit antara tindakan jangka pendek dan hasil jangka panjang. Saya akan sentiasa menumpukan pada matlamat, projek atau kertas penyelidikan seterusnya, dengan mengatakan terdapat matlamat 10 tahun yang samar tetapi tiada jalan yang jelas untuk sampai ke sana.

10 tahun yang lalu saya membina kursus pembelajaran mesin pertama saya dalam seminggu (selalunya penggambaran pada pukul 2 pagi). Tahun ini, saya mengemas kini kandungan kursus untuk jurusan Pembelajaran Mesin dan merancang keseluruhan kursus dengan lebih baik (walaupun beberapa tangkapan masih diambil pada jam 2 pagi, tetapi bilangannya berkurangan!).

Dalam perniagaan terdahulu, saya cenderung untuk membina produk dan kemudian memikirkan cara untuk menyampaikannya kepada pelanggan. Pada masa kini, walaupun pada peringkat awal, saya lebih memikirkan keperluan pelanggan saya.

Maklum balas daripada rakan dan mentor boleh membantu anda membentuk visi anda. Satu langkah besar dalam pertumbuhan saya ialah belajar mempercayai nasihat pakar dan mentor tertentu dan cuba memahaminya. Sebagai contoh, saya mempunyai rakan yang pakar dalam geopolitik global, dan mereka kadangkala menasihati saya untuk melabur lebih banyak di negara tertentu.

Saya tidak boleh membuat kesimpulan ini sendiri kerana saya tidak tahu banyak tentang negara-negara ini. Tetapi saya telah belajar untuk menerangkan rancangan jangka panjang saya, meminta maklum balas mereka dan mendengar dengan teliti apabila mereka menunjukkan saya ke arah yang berbeza.

Pada masa ini, salah satu matlamat utama saya ialah untuk mendemokrasikan inovasi AI. Benarkan lebih ramai orang membina sistem kecerdasan buatan tersuai dan mendapat manfaat daripadanya. Walaupun jalan untuk mencapai matlamat ini adalah panjang dan sukar, saya dapat melihat langkah-langkah untuk ke sana, dan nasihat rakan dan mentor sangat membentuk pemikiran saya.

Memandangkan tahun 2023 menghampiri, sejauh mana masa depan anda boleh merancang? Adakah anda ingin mendapatkan kepakaran dalam sesuatu topik, memajukan kerjaya anda atau menyelesaikan masalah teknikal? Buat andaian laluan (walaupun yang belum diuji) dan dapatkan maklum balas untuk menguji dan memperhalusinya?

Mimpilah untuk 2023.

Selamat Tahun Baru!

Andrew Ng

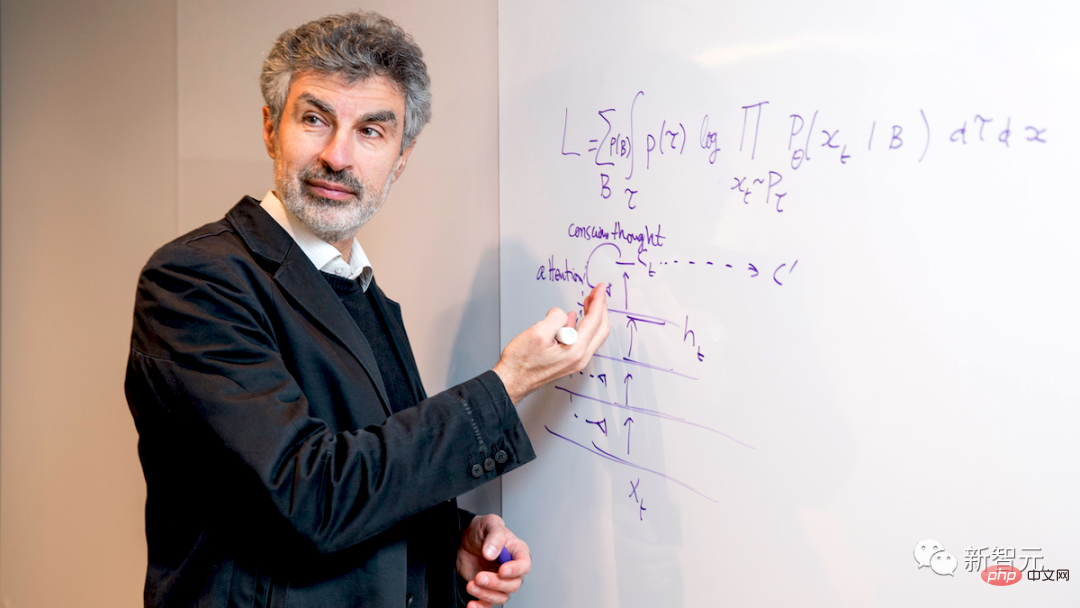

Yoshua Bengio: Mencari model AI rasional

Pada masa lalu, kemajuan pembelajaran mendalam adalah terutamanya tentang "membuat keajaiban berlaku dengan kekuatan yang hebat": mengguna pakai seni bina terkini, menambah baik perkakasan dan mengembangkan kuasa pengkomputeran, data dan skala. Adakah kita sudah mempunyai seni bina yang kita perlukan dan yang tinggal hanyalah membangunkan perkakasan dan set data yang lebih baik supaya kita boleh terus meningkat? Adakah ada yang hilang sekarang?

Saya rasa ada sesuatu yang hilang, dan saya berharap dapat mencari perkara yang hilang ini pada tahun akan datang.

Saya telah bekerjasama dengan saintis saraf dan saintis saraf kognitif untuk mengkaji jurang antara sistem terkini dan manusia. Hanya meningkatkan saiz model tidak akan mengisi jurang ini. Sebaliknya, membina ke dalam model semasa keupayaan seperti manusia untuk menemui dan membuat alasan tentang konsep peringkat tinggi dan perhubungannya boleh menjadikan jurang lebih luas.

Fikirkan tentang bilangan contoh yang diperlukan untuk mempelajari tugasan baharu, yang dipanggil "kerumitan sampel". Melatih model pembelajaran mendalam untuk memainkan permainan video baharu memerlukan sejumlah besar permainan yang boleh dipelajari oleh manusia dengan cepat. Tetapi komputer perlu mempertimbangkan banyak kemungkinan untuk merancang laluan yang cekap dari A ke B. Manusia tidak memerlukannya.

Manusia boleh memilih cebisan pengetahuan yang betul dan menyesuaikan cebisan itu bersama-sama untuk membentuk satu set penjelasan, jawapan atau rancangan yang relevan. Tambahan pula, memandangkan satu set pembolehubah, manusia sangat pandai menentukan yang mana punca dan yang mana kesan. Teknologi kecerdasan buatan semasa tidak hampir dengan tahap manusia dalam keupayaan ini.

Lazimnya, sistem AI sangat yakin dengan ketepatan jawapan dan penyelesaian yang mereka hasilkan, walaupun ia sebenarnya salah. Masalah ini mungkin jenaka lucu dalam aplikasi seperti penjana teks atau chatbot, tetapi ia boleh mengancam nyawa dalam kereta pandu sendiri atau sistem diagnostik perubatan.

Cara sistem AI semasa berkelakuan adalah sebahagiannya kerana ia direka bentuk untuk berbuat demikian. Sebagai contoh, penjana teks dilatih hanya untuk meramalkan perkataan seterusnya, bukannya untuk mewujudkan struktur data dalaman atau untuk menerangkan konsep ia beroperasi dan hubungan antara mereka.

Tetapi saya rasa kita boleh mereka sistem AI yang boleh menjejaki maksud di sebalik sesuatu dan membuat alasan tentangnya sambil masih memanfaatkan kaedah pembelajaran mendalam semasa yang mempunyai banyak kelebihan. Ini menangani cabaran daripada kerumitan sampel yang berlebihan kepada ketidakyakinan yang berlebihan.

Pautan kertas: https://arxiv.org/pdf/2111.09266.pdf

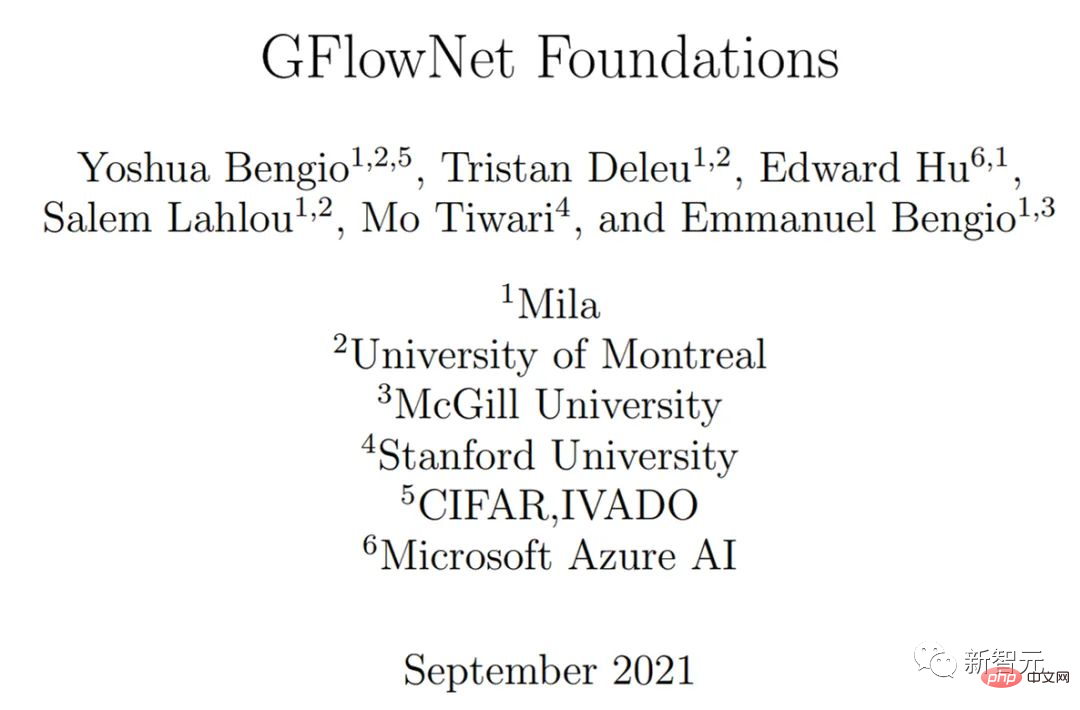

Saya sangat berminat dengan "rangkaian aliran generatif" GFlowNets, iaitu kaedah baharu untuk melatih rangkaian dalam yang pasukan kami mulakan setahun lalu. Idea ini diilhamkan oleh cara manusia menaakul melalui satu siri langkah, menambah maklumat baharu yang berkaitan pada setiap langkah.

Ini seperti pembelajaran pengukuhan kerana model mempelajari dasar secara berurutan untuk menyelesaikan masalah. Ia juga seperti pemodelan generatif kerana ia boleh mengambil sampel penyelesaian yang sepadan dengan penaakulan kebarangkalian.

Jika anda memikirkan tafsiran imej, pemikiran anda boleh ditukar menjadi ayat, tetapi ia bukan ayat itu sendiri. Sebaliknya, ia mengandungi maklumat semantik dan hubungan tentang konsep dalam ayat. Secara umumnya, kami mewakili kandungan semantik ini sebagai graf, di mana setiap nod ialah konsep atau pembolehubah.

Saya tidak fikir ini satu-satunya penyelesaian dan saya tidak sabar untuk melihat pelbagai pendekatan. Melalui penerokaan kepelbagaian, kita akan mempunyai peluang yang lebih besar untuk mencari perkara yang hilang pada masa ini dalam bidang AI dan merapatkan jurang antara manusia semasa dan AI peringkat manusia.

Yoshua Bengio ialah Profesor Sains Komputer di Universiti Montreal dan Pengarah Saintifik Institut Mila-Québec untuk Kepintaran Buatan. Beliau menerima Anugerah Turing 2018 bersama Geoffrey Hinton dan Yann LeCun atas sumbangan terobosannya kepada pembelajaran mendalam.

Alon Halevy: Garis Masa Data Peribadi

Alon Halevy ialah seorang saintis komputer Israel-Amerika dan pakar dalam bidang penyepaduan data. Beliau berkhidmat sebagai saintis penyelidikan di Google dari 2005 hingga 2015, di mana beliau bertanggungjawab untuk Jadual Gabungan Data Google.

Beliau ialah ahli ACM dan menerima Anugerah Presiden (PECASE) pada tahun 2000. Beliau juga merupakan pengasas syarikat teknologi Nimble Technology (kini Actuate Corporation) dan Transformic Inc.

Dalam prospek 2023, Halevy menumpukan pada pembinaan garis masa data peribadi.

Bagaimanakah syarikat dan organisasi menggunakan data pengguna? Isu penting ini telah mendapat perhatian meluas dalam kedua-dua kalangan teknikal dan dasar.

Pada tahun 2023, terdapat persoalan yang sama pentingnya yang patut diberi perhatian lebih: bagaimana kita, sebagai individu, boleh menggunakan data yang dijana untuk meningkatkan kesihatan kita dan meningkatkan Vitality dan produktiviti?

Kami menjana semua jenis data setiap hari. Foto menangkap pengalaman hidup kita, telefon bimbit merekodkan senaman dan lokasi kita, dan perkhidmatan Internet merekodkan apa yang kita makan dan beli.

Kami juga merakam pelbagai hasrat: perjalanan yang ingin kami lalui dan restoran yang ingin kami cuba, buku dan filem yang kami rancang untuk menikmati, dan aktiviti sosial yang kami mahu mempunyai.

Tidak lama lagi, cermin mata pintar akan merekodkan pengalaman kami dengan lebih terperinci. Walau bagaimanapun, data ini tersebar di banyak aplikasi. Untuk meringkaskan pengalaman lalu dengan lebih baik, kita perlu menyusun kenangan lalu daripada aplikasi yang berbeza setiap hari.

Bolehkah semua maklumat digabungkan menjadi garis masa peribadi untuk membantu kita bergerak ke arah matlamat, harapan dan impian kita? Malah, seseorang mempunyai idea ini lama dahulu.

Seawal tahun 1945, saintis Amerika Vannevar Bush mereka produk yang dipanggil memex ). Pada 1990-an, Gordon Bell dan rakan-rakannya di Microsoft Research membina MyLifeBits, yang boleh menyimpan semua maklumat tentang kehidupan seseorang.

Walau bagaimanapun, apabila kami menyimpan semua data di satu tempat, melindungi privasi dan mencegah penyalahgunaan maklumat jelas menjadi isu utama.

Pada masa ini, tiada satu syarikat pun memiliki semua data kami, dan ia juga tidak mempunyai kuasa untuk menyimpan semua data kami. Oleh itu, usaha kolaboratif diperlukan untuk membina teknologi untuk menyokong garis masa peribadi, termasuk protokol untuk pertukaran data, storan yang disulitkan dan pemprosesan selamat.

Untuk mencipta garis masa peribadi, terdapat dua cabaran teknikal yang perlu diselesaikan.

Cabaran pertama ialah mengenai Soal Jawab pintar tentang sistem. Walaupun kami telah mencapai kemajuan yang ketara dalam menjawab soalan berdasarkan data teks dan multimodal, dalam banyak kes, menjawab soalan pintar memerlukan kami membuat alasan secara eksplisit tentang set jawapan.

Ini adalah asas sistem pangkalan data. Contohnya, untuk menjawab "Kafe manakah yang saya lawati di Tokyo?" atau "Berapa banyak separuh maraton yang saya larian dalam masa dua jam?" Pada masa ini, tugas ini tidak dapat diselesaikan dalam pemprosesan bahasa semula jadi.

Untuk mendapatkan lebih banyak inspirasi daripada pangkalan data, sistem juga perlu dapat menerangkan sumber jawapan dan menentukan sama ada jawapan itu betul dan lengkap.

Cabaran kedua dalam membina garis masa peribadi ialah bagaimana untuk membangunkan teknologi analisis paksi data peribadi untuk meningkatkan kualiti hidup pengguna.

Menurut psikologi positif, orang boleh mencipta pengalaman positif untuk diri mereka sendiri dan membangunkan tabiat yang lebih baik untuk pembangunan yang lebih baik. Ejen AI yang mempunyai akses kepada kehidupan dan matlamat harian kita boleh mengingatkan kita tentang perkara yang perlu kita capai dan elakkan.

Sudah tentu, apa yang kita pilih terpulang kepada kita, tetapi saya percaya bahawa seseorang yang mempunyai pandangan yang menyeluruh tentang aktiviti harian kita akan mempunyai ingatan yang lebih baik. dan kemahiran merancang Kecerdasan buatan akan memberi manfaat yang besar kepada semua orang.

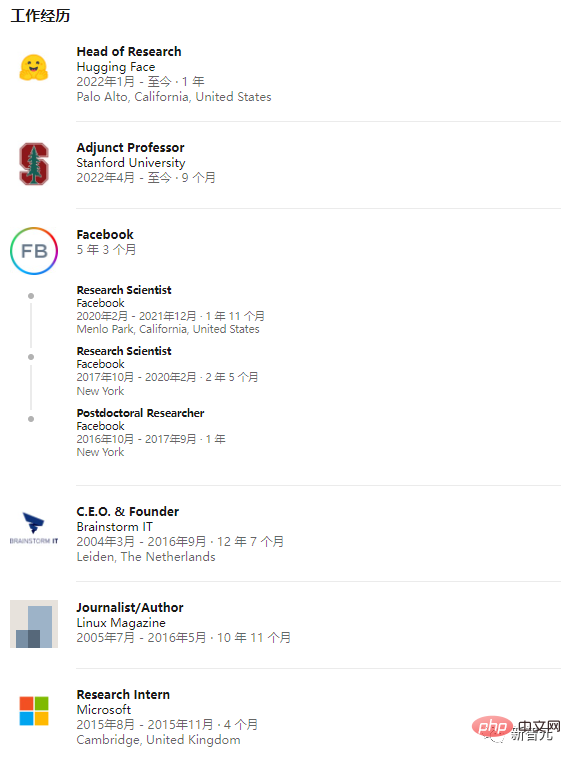

Douwe Kiela: Kurang gembar-gembur, lebih berhati-hati

Douwe Kiela adalah seorang profesor tambahan sistem simbolik di Universiti Stanford. Selepas menamatkan ijazah sarjana dan kedoktorannya di Universiti Cambridge, Kiela bekerja sebagai penyelidik di IBM, Microsoft, dan Facebook AI, dan sebagai pengarah penyelidikan Hugging Face.

Dalam pandangan Tahun Baharunya, Kiela menyatakan hasratnya untuk pembangunan sistem kecerdasan buatan.

Ini adalah tahun kita benar-benar melihat kecerdasan buatan mula menjadi arus perdana. Sistem seperti Stable Diffusion dan ChatGPT telah menangkap sepenuhnya imaginasi orang ramai.

Ini adalah masa yang menggembirakan dan kita berada di puncak perkara yang hebat: tidak keterlaluan untuk mengatakan bahawa peralihan keupayaan ini akan menjadi seperti Revolusi Perindustrian, Mempunyai kesan yang mengganggu.

Tetapi di tengah keterujaan, kita harus berhati-hati dengan gembar-gembur, lebih berhati-hati, dan menjalankan penyelidikan dan pembangunan dengan penuh tanggungjawab.

Untuk model bahasa yang besar, tidak kira sama ada sistem ini benar-benar "masuk akal", orang awam akan membuat antropomorfisme mereka kerana keupayaan mereka untuk melakukan manusia Perkara yang paling mewakili: menghasilkan bahasa.

Walau bagaimanapun, kita mesti mendidik orang ramai tentang keupayaan dan batasan sistem kecerdasan buatan ini, kerana orang ramai kebanyakannya menganggap komputer sebagai pemproses simbolik kuno, cth. , mereka pandai dalam matematik tetapi buruk dalam seni, sedangkan pada masa ini keadaannya adalah sebaliknya.

AI moden mempunyai kecacatan yang serius, dan sistemnya boleh disalahgunakan dengan mudah secara tidak sengaja atau sengaja. Mereka bukan sahaja menghasilkan maklumat yang salah, mereka kelihatan begitu yakin sehingga orang mempercayainya.

Sistem AI ini kurang pemahaman yang mencukupi tentang dunia manusia yang kompleks dan pelbagai mod, dan tidak memiliki apa yang ahli falsafah panggil "psikologi rakyat," atau penjelasan dan keupayaan untuk meramalkan tingkah laku dan keadaan mental orang lain.

Pada masa ini, sistem AI masih merupakan produk intensif sumber yang tidak mampan, dan kami mengetahui sangat sedikit tentang hubungan antara data latihan input dan model output.

Pada masa yang sama, sementara penskalaan model boleh meningkatkan keberkesanan dengan ketara—sebagai contoh, ciri tertentu hanya muncul apabila model mencapai saiz tertentu—terdapat juga tanda-tanda bahawa semasa model ini berskala, Sistem yang lebih cenderung kepada berat sebelah dan lebih tidak adil.

Jadi harapan saya untuk tahun 2023 ialah kita boleh memperbaiki isu ini. Penyelidikan ke dalam pelbagai mod, penyetempatan dan interaksi boleh membolehkan sistem untuk lebih memahami dunia sebenar dan tingkah laku manusia, dan dengan itu lebih memahami manusia.

Mengkaji penjajaran, atribusi dan ketidakpastian boleh menjadikan sistem AI lebih selamat, kurang terdedah kepada halusinasi dan membina model ganjaran yang lebih tepat. AI berpusatkan data berjanji untuk menunjukkan undang-undang penskalaan yang lebih cekap yang mengubah data menjadi model yang teguh dan adil dengan lebih berkesan.

Pautan kertas: https://arxiv.org/pdf/2007.14435.pdf

Akhir sekali, kita harus memberi lebih perhatian kepada krisis penilaian kecerdasan buatan yang berterusan. Kami memerlukan pengukuran yang lebih terperinci dan komprehensif bagi data dan model kami untuk memastikan kami dapat menerangkan kemajuan dan batasan kami serta memahami kami dari perspektif kesahihan ekologi (cth., kes penggunaan dunia sebenar sistem AI) Perkara yang anda ingin perolehi daripada pembangunan kecerdasan buatan.

Been Kim: Terangkan model dengan penyelidikan saintifik

Been Kim ialah seorang saintis dari Google Brain, lulusan MIT, bidang penyelidikannya ialah pembelajaran mesin interaktif.

Walaupun teruja dengan kreativiti dan banyak pencapaian yang AI telah tunjukkan pada tahun lalu, dia juga mengemukakan pemikirannya tentang masa depan AI penyelidikan itu.

Ini adalah masa yang menarik untuk AI, dengan pencapaian dalam seni generatif dan banyak aplikasi lain

Walaupun arah ini menarik, saya fikir kita perlu melibatkan diri dalam kerja yang kurang membosankan, bukan hanya perkara yang AI boleh cipta Lebih banyak barangan atau betapa besar model yang anda boleh reka:

Kembali kepada asas dan jadikan mempelajari model kecerdasan buatan sebagai matlamat siasatan saintifik.

Mengapa anda melakukan ini?

Bidang kebolehtafsiran bertujuan untuk mencipta alatan untuk menjana penjelasan bagi output model yang kompleks, membantu kami meneroka hubungan antara AI dan manusia.

Sebagai contoh, satu alat mengambil imej dan model klasifikasi dan menjana penjelasan dalam bentuk piksel berwajaran. Semakin tinggi berat piksel, semakin penting ia. Sebagai contoh, lebih banyak kesan nilainya terhadap output, lebih penting ia mungkin, tetapi cara kepentingan ditakrifkan berbeza dari satu alat ke satu alat.

Walaupun AI generatif telah mencapai beberapa kejayaan, banyak alatan telah terbukti berfungsi dengan cara yang tidak kami jangkakan.

Contohnya, penjelasan model yang tidak terlatih secara kuantitatif dan kualitatif tidak dapat dibezakan daripada model terlatih, dan walaupun menghasilkan output yang sama, penjelasannya selalunya berbeza-beza. . perubahan dengan perubahan kecil dalam input.

Selain itu, tidak banyak kaitan antara output model dan tafsiran alat. Kerja lain telah menunjukkan bahawa tafsiran yang baik terhadap keluaran model tidak semestinya mempunyai kesan positif ke atas cara orang menggunakan model tersebut.

Apakah maksud ketidakpadanan ini antara jangkaan dan hasil, dan apakah yang perlu kita lakukan terhadapnya? Ia mencadangkan kita perlu menyemak cara kita membina alat ini.

Pada masa ini kami mengambil pendekatan berpaksikan kejuruteraan: percubaan dan kesilapan. Kami membina alat berdasarkan gerak hati (mis. kami menjana pemberat untuk setiap blok piksel dan bukannya piksel individu, tafsiran lebih intuitif).

Pautan kertas: https://arxiv.org/pdf/1811.12231.pdf

Sebuah pasukan di Universiti Tübingen mendapati bahawa rangkaian saraf melihat lebih banyak tekstur (seperti kulit gajah) daripada bentuk (garis besar gajah) walaupun apabila kita mentafsir imej Siluet gajah dilihat mungkin dalam bentuk piksel yang diserlahkan secara kolektif.

Penyelidikan ini memberitahu kita bahawa model mungkin tidak melihat bentuk tetapi tekstur, yang dipanggil bias induktif - disebabkan oleh seni binanya atau oleh kami mengoptimumkannya dalam arah aliran tertentu. kelas model.

Mendedahkan kecenderungan ini boleh membantu kita memahami model, sama seperti mendedahkan kecenderungan manusia boleh digunakan untuk memahami tingkah laku manusia (seperti keputusan yang tidak adil).

Kaedah yang biasa digunakan untuk memahami manusia ini juga boleh membantu kita memahami model. Untuk model, kerana cara struktur dalaman mereka dibina, kami mempunyai alat lain: analisis teori.

Kerja ke arah ini telah menghasilkan hasil teori yang menarik tentang kelakuan model, pengoptimum dan fungsi kehilangan. Sesetengah menggunakan alat klasik daripada statistik, fizik, sistem dinamik atau pemprosesan isyarat, dan banyak alat dari bidang berbeza masih belum diterokai dalam kajian kecerdasan buatan.

Mengejar sains tidak bermakna kita harus berhenti berlatih: sains membolehkan kita membina alat berdasarkan prinsip dan pengetahuan, dan amalan mengubah idea menjadi realiti.

Pautan kertas: https://hal.inria.fr/inria-00112631/document

Amalan juga boleh memberi inspirasi kepada sains: Perkara yang berfungsi dengan baik dalam amalan boleh memberikan rujukan untuk struktur model berstruktur secara saintifik, sama seperti rangkaian konvolusi berprestasi tinggi pada tahun 2012 yang memberi inspirasi kepada ramai Sama seperti kertas teori menganalisis mengapa konvolusi membantu generalisasi.

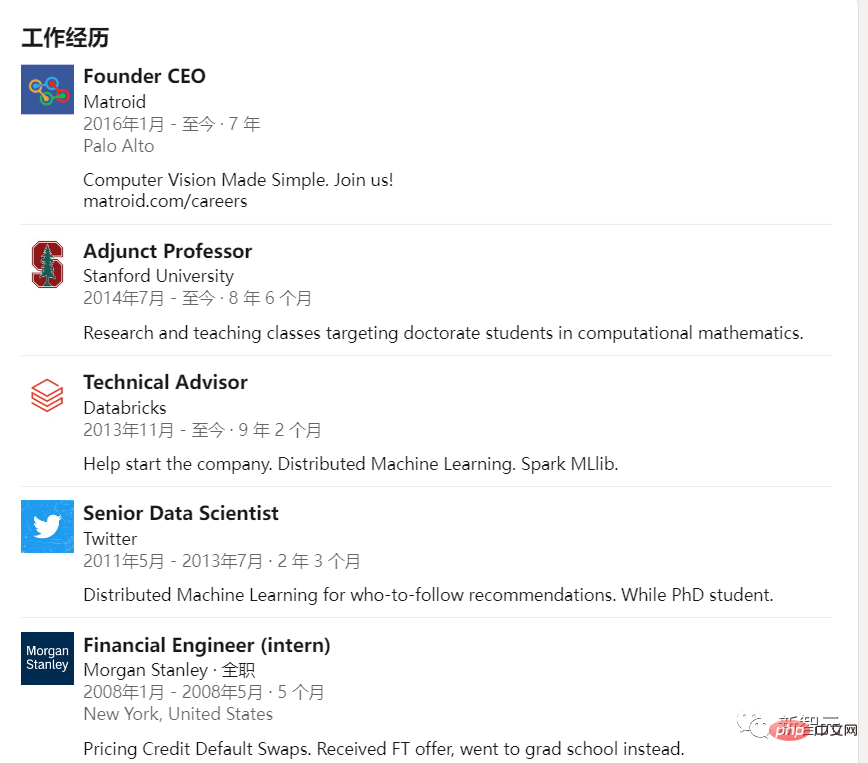

Reza Zadeh: Biarkan model ML belajar secara aktif

Reza Zadeh ialah pengasas dan CEO syarikat visi komputer Matroid, lulusan Universiti Stanford, bidang penyelidikannya ialah pembelajaran mesin, pengkomputeran teragih dan matematik gunaan diskret. Beliau juga merupakan ahli awal Databricks.

Dia percaya bahawa tahun 2023 akan datang akan menjadi tahun untuk pembelajaran aktif bermula.

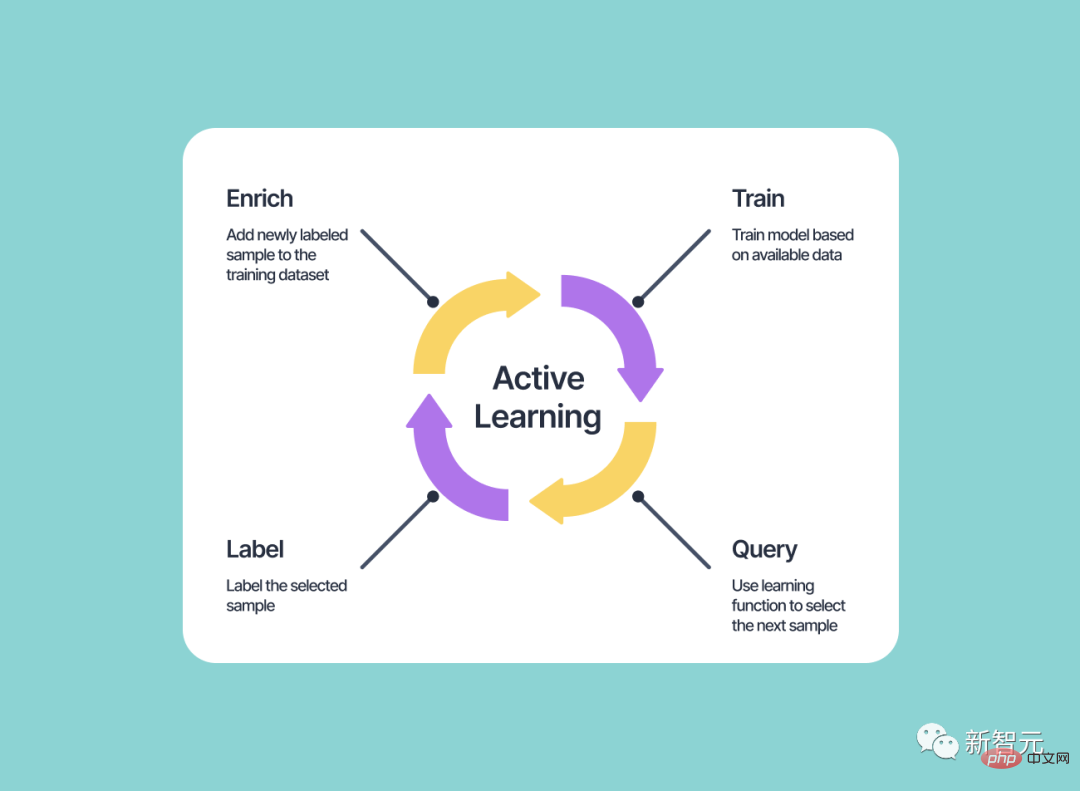

Menjelang tahun baru, ada harapan bahawa ledakan AI generatif akan berlaku dalam Pembelajaran Aktif ) telah membawa kemajuan yang ketara.

Teknik ini membolehkan sistem ML menjana contoh latihan mereka sendiri dan melabelkannya, manakala dalam kebanyakan bentuk pembelajaran mesin yang lain, algoritma diberikan set contoh tetap dan biasanya hanya Boleh belajar daripada contoh-contoh ini.

Jadi apakah yang boleh dibawa oleh pembelajaran aktif kepada sistem pembelajaran mesin?

- Menyesuaikan diri dengan keadaan yang berubah-ubah

- Dari lebih sedikit teg Learn

- Biarkan orang memahami contoh yang paling berharga/sukar

- Mencapai lebih banyak Prestasi Tinggi

Idea pembelajaran aktif telah wujud selama beberapa dekad tetapi tidak pernah benar-benar ditangkap. Sebelum ini, sukar bagi algoritma untuk menghasilkan imej atau ayat yang boleh dinilai oleh manusia dan memajukan algoritma pembelajaran.

Tetapi dengan populariti AI penjanaan imej dan teks, pembelajaran aktif dijangka mencapai kejayaan besar. Kini apabila algoritma pembelajaran tidak pasti tentang label yang betul untuk beberapa bahagian ruang pengekodannya, ia boleh menjana data secara proaktif daripada bahagian tersebut untuk input.

Pembelajaran aktif berpotensi untuk merevolusikan cara pembelajaran mesin dilakukan kerana ia membolehkan sistem bertambah baik dan menyesuaikan diri dari semasa ke semasa.

Daripada bergantung pada set tetap data berlabel, sistem pembelajaran aktif boleh mencari maklumat dan contoh baharu untuk membantunya memahami dengan lebih baik perkara yang cuba dilakukan masalah selesai.

Ini boleh membawa kepada model pembelajaran mesin yang lebih tepat dan berkesan serta mengurangkan keperluan untuk sejumlah besar data berlabel.

Saya menantikan kemajuan terkini dalam pembelajaran aktif dalam AI generatif. Apabila kita memasuki tahun baharu, kita mungkin akan melihat lebih banyak sistem pembelajaran mesin melaksanakan teknik pembelajaran aktif, dan tahun 2023 boleh menjadi tahun pembelajaran aktif benar-benar bermula.

Atas ialah kandungan terperinci 2023 akan datang, tinjauan tahunan Ng Enda, Bengio dan nama besar lain! Adakah model AI rasional akan datang?. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1382

1382

52

52

Petua Konfigurasi Firewall Pelayan Mel Debian

Apr 13, 2025 am 11:42 AM

Petua Konfigurasi Firewall Pelayan Mel Debian

Apr 13, 2025 am 11:42 AM

Mengkonfigurasi firewall pelayan Mail Debian adalah langkah penting dalam memastikan keselamatan pelayan. Berikut adalah beberapa kaedah konfigurasi firewall yang biasa digunakan, termasuk penggunaan iptables dan firewalld. Gunakan iptables untuk mengkonfigurasi firewall untuk memasang iptables (jika belum dipasang): sudoapt-getupdateudoapt-getinstalliplesview peraturan iptables semasa: konfigurasi sudoiptable-l

Kaedah pemasangan sijil SSL Server Server Debian

Apr 13, 2025 am 11:39 AM

Kaedah pemasangan sijil SSL Server Server Debian

Apr 13, 2025 am 11:39 AM

Langkah -langkah untuk memasang sijil SSL pada pelayan mel Debian adalah seperti berikut: 1. Pasang OpenSSL Toolkit terlebih dahulu, pastikan bahawa OpenSSL Toolkit telah dipasang pada sistem anda. Jika tidak dipasang, anda boleh menggunakan arahan berikut untuk memasang: sudoapt-getupdateudoapt-getinstallopenssl2. Menjana permintaan kunci dan sijil peribadi seterusnya, gunakan OpenSSL untuk menjana kunci peribadi RSA 2048-bit dan permintaan sijil (CSR): Membuka

Baris arahan shutdown centos

Apr 14, 2025 pm 09:12 PM

Baris arahan shutdown centos

Apr 14, 2025 pm 09:12 PM

Perintah shutdown CentOS adalah penutupan, dan sintaks adalah tutup [pilihan] [maklumat]. Pilihan termasuk: -h menghentikan sistem dengan segera; -P mematikan kuasa selepas penutupan; -r mulakan semula; -T Waktu Menunggu. Masa boleh ditentukan sebagai segera (sekarang), minit (minit), atau masa tertentu (HH: mm). Maklumat tambahan boleh dipaparkan dalam mesej sistem.

Sony mengesahkan kemungkinan menggunakan GPU khas di PS5 Pro untuk membangunkan AI dengan AMD

Apr 13, 2025 pm 11:45 PM

Sony mengesahkan kemungkinan menggunakan GPU khas di PS5 Pro untuk membangunkan AI dengan AMD

Apr 13, 2025 pm 11:45 PM

Mark Cerny, Ketua Arkitek SonyinterActiveEntainment (SIE, Sony Interactive Entertainment), telah mengeluarkan lebih banyak butiran perkakasan dari PlayStation5Pro hos generasi akan datang (PS5Pro), termasuk GPU seni bina AMDRDNA2.x yang dinamakan, dan Kod Arsitektur AMDRDNA2.x yang dinamakan. Tumpuan peningkatan prestasi PS5Pro masih pada tiga tiang, termasuk GPU yang lebih kuat, jejak sinar maju dan fungsi resolusi super PSSR yang berkuasa AI. GPU mengamalkan seni bina AmdrDNA2 yang disesuaikan, yang Sony menamakan RDNA2.x, dan ia mempunyai beberapa seni bina RDNA3.

Apakah kaedah sandaran untuk gitlab di centos

Apr 14, 2025 pm 05:33 PM

Apakah kaedah sandaran untuk gitlab di centos

Apr 14, 2025 pm 05:33 PM

Dasar sandaran dan pemulihan Gitlab di bawah sistem CentOS untuk memastikan keselamatan data dan pemulihan, Gitlab pada CentOS menyediakan pelbagai kaedah sandaran. Artikel ini akan memperkenalkan beberapa kaedah sandaran biasa, parameter konfigurasi dan proses pemulihan secara terperinci untuk membantu anda menubuhkan strategi sandaran dan pemulihan GitLab lengkap. 1. Backup Manual Gunakan Gitlab-Rakegitlab: Backup: Buat Perintah untuk Melaksanakan Backup Manual. Perintah ini menyokong maklumat utama seperti repositori Gitlab, pangkalan data, pengguna, kumpulan pengguna, kunci, dan kebenaran. Fail sandaran lalai disimpan dalam direktori/var/opt/gitlab/sandaran. Anda boleh mengubah suai /etc /gitlab

Apakah kaedah penalaan prestasi zookeeper di CentOS

Apr 14, 2025 pm 03:18 PM

Apakah kaedah penalaan prestasi zookeeper di CentOS

Apr 14, 2025 pm 03:18 PM

Penalaan prestasi zookeeper pada centOs boleh bermula dari pelbagai aspek, termasuk konfigurasi perkakasan, pengoptimuman sistem operasi, pelarasan parameter konfigurasi, pemantauan dan penyelenggaraan, dan lain -lain. Memori yang cukup: memperuntukkan sumber memori yang cukup untuk zookeeper untuk mengelakkan cakera kerap membaca dan menulis. CPU multi-teras: Gunakan CPU multi-teras untuk memastikan bahawa zookeeper dapat memprosesnya selari.

Akhirnya berubah! Fungsi carian Microsoft Windows akan membawa kemas kini baru

Apr 13, 2025 pm 11:42 PM

Akhirnya berubah! Fungsi carian Microsoft Windows akan membawa kemas kini baru

Apr 13, 2025 pm 11:42 PM

Penambahbaikan Microsoft ke fungsi carian Windows telah diuji pada beberapa saluran Windows Insider di EU. Sebelum ini, fungsi carian Windows bersepadu dikritik oleh pengguna dan mempunyai pengalaman yang buruk. Kemas kini ini membahagikan fungsi carian ke dalam dua bahagian: carian tempatan dan carian web berasaskan Bing untuk meningkatkan pengalaman pengguna. Versi baru antara muka carian melakukan carian fail tempatan secara lalai. Jika anda perlu mencari dalam talian, anda perlu mengklik tab "Microsoft Bingwebsearch" untuk menukar. Selepas bertukar, bar carian akan memaparkan "Microsoft Bingwebsearch:", di mana pengguna boleh memasukkan kata kunci. Langkah ini berkesan mengelakkan pencampuran hasil carian tempatan dengan hasil carian Bing

Cara Melatih Model Pytorch di CentOs

Apr 14, 2025 pm 03:03 PM

Cara Melatih Model Pytorch di CentOs

Apr 14, 2025 pm 03:03 PM

Latihan yang cekap model pytorch pada sistem CentOS memerlukan langkah -langkah, dan artikel ini akan memberikan panduan terperinci. 1. Penyediaan Persekitaran: Pemasangan Python dan Ketergantungan: Sistem CentOS biasanya mempamerkan python, tetapi versi mungkin lebih tua. Adalah disyorkan untuk menggunakan YUM atau DNF untuk memasang Python 3 dan menaik taraf PIP: Sudoyumupdatepython3 (atau SudodnfupdatePython3), pip3install-upgradepip. CUDA dan CUDNN (Percepatan GPU): Jika anda menggunakan Nvidiagpu, anda perlu memasang Cudatool