Peranti teknologi

Peranti teknologi

AI

AI

Penggunaan ChatGPT domestik hanya memerlukan 6G memori video! Model ChatYuan terbuka untuk dimuat turun: model besar Cina sumber terbuka dialog berfungsi pertama dalam industri

Penggunaan ChatGPT domestik hanya memerlukan 6G memori video! Model ChatYuan terbuka untuk dimuat turun: model besar Cina sumber terbuka dialog berfungsi pertama dalam industri

Penggunaan ChatGPT domestik hanya memerlukan 6G memori video! Model ChatYuan terbuka untuk dimuat turun: model besar Cina sumber terbuka dialog berfungsi pertama dalam industri

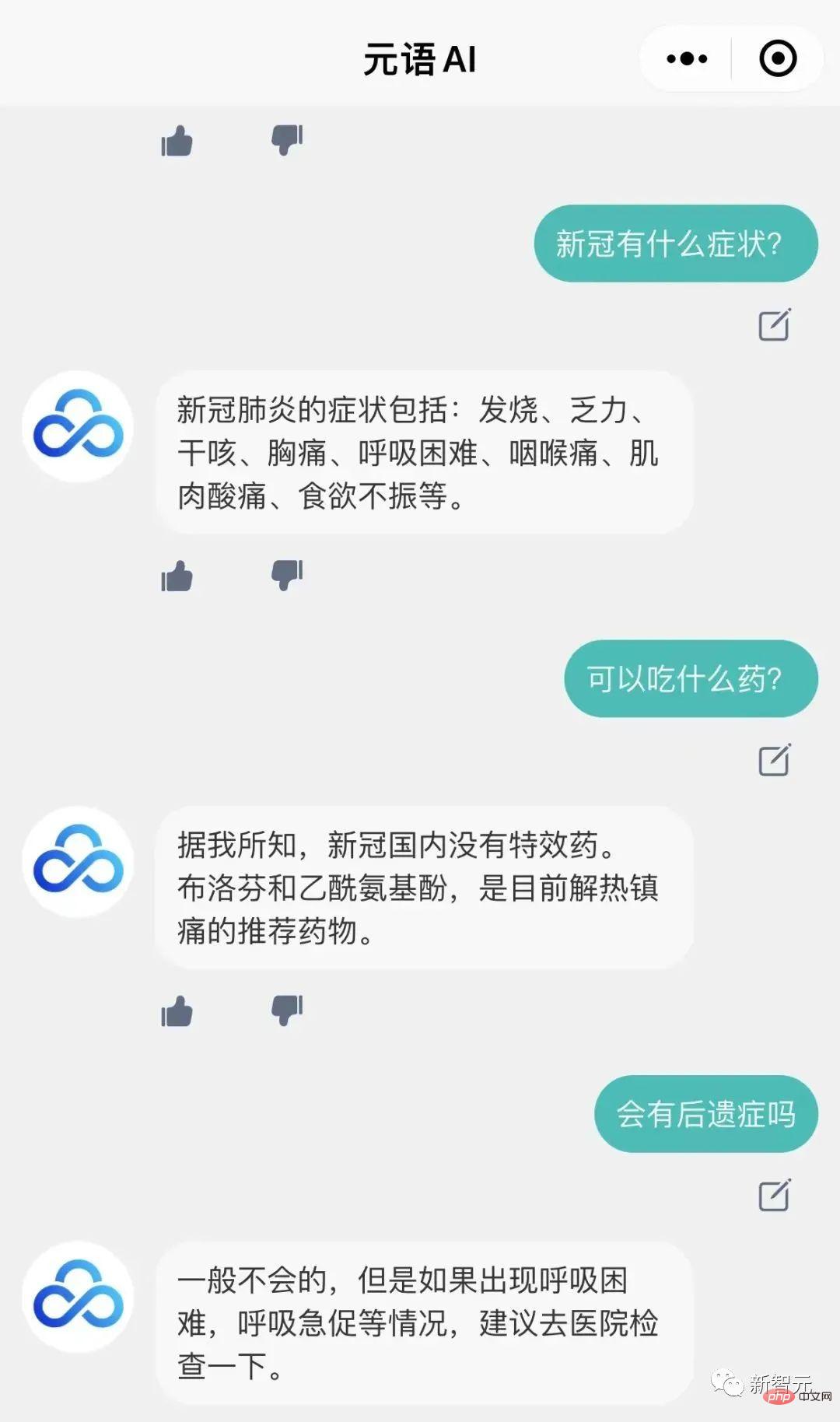

Beberapa masa lalu, Pasukan Pembangunan Pintar Yuanyu melatih model besar dialog berfungsi ChatYuan serupa dengan ChatGPT dan membuka antara muka percubaan dalam versi web.

Kini anda juga boleh menggunakan ChatYuan pada mesin anda sendiri!

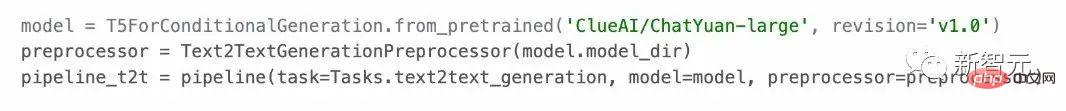

Model boleh digunakan dalam senario soal jawab, dan boleh menjalankan dialog dan pelbagai tugas penjanaan dalam konteks, termasuk penulisan kreatif juga boleh menjawab soalan dalam bidang seperti undang-undang dan COVID-19.

Dan ia menyokong pembelajaran sampel sifar dalam semua tugasan bahasa Cina. Pengguna boleh menggunakannya dengan memberikan gesaan Ia menyokong hampir 30 jenis tugasan bahasa Cina di bawah kategori penjanaan teks, pengekstrakan maklumat dan. persefahaman.

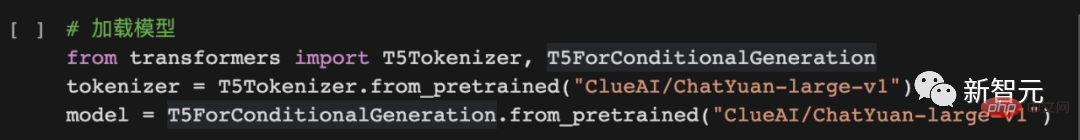

ChatYuan dilatih lagi berdasarkan PromptCLUE-besar digabungkan dengan ratusan juta soalan dan jawapan berfungsi dan data dialog berbilang pusingan Parameter model ialah 770 juta, memori video adalah kira-kira 6G, dan kad grafik awam boleh dimuatkan dan digunakan , model itu kini dibuka untuk dimuat turun.

PromptCLUE dilatih terlebih dahulu mengenai 100 bilion token korpus Cina, telah mempelajari sejumlah 1.5 trilion token Cina, dan menjalankan latihan berasaskan tugasan Prompt mengenai beratus-ratus tugas.

Untuk memahami tugasan, seperti klasifikasi, analisis sentimen, pengekstrakan, dsb., sistem label boleh disesuaikan untuk pelbagai tugas penjanaan, pensampelan boleh dijana secara bebas.

Cara menggunakan

1. >

Alamat projek: https://github.com/clue-ai/ChatYuan

2

Alamat projek: https://huggingface.co/ClueAI/ChatYuan - besar-v1

Alamat projek: https://modelscope.cn/models / ClueAI/ChatYuan-besar

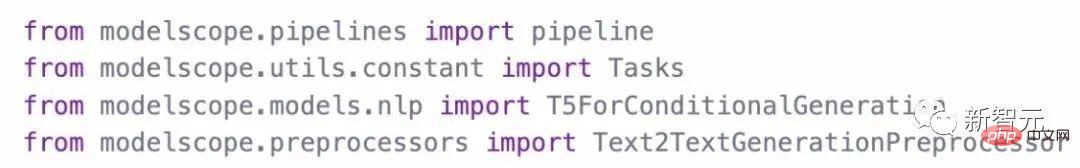

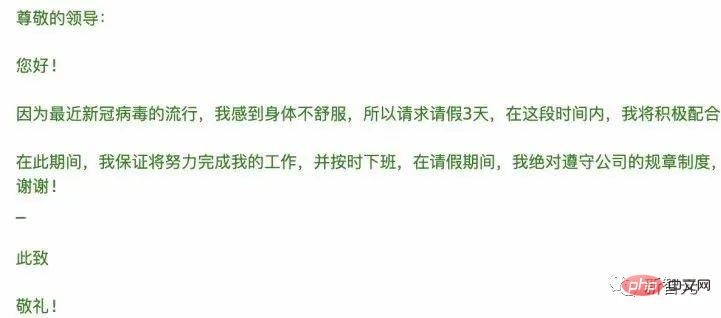

Kaedah inferens ramalan menggunakan model:

Alamat projek:

https://aistudio.baidu.com /aistudio/projectdetail/5404182

Alamat model: https://huggingface.co/ClueAI/ChatYuan-large-v1-paddle

Gunakan daripada Model latihan dengan data

1 Susun data

Susun data ke dalam format bersatu, yang terdiri daripada dua bahagian: input. ( Input) dan output (Output).

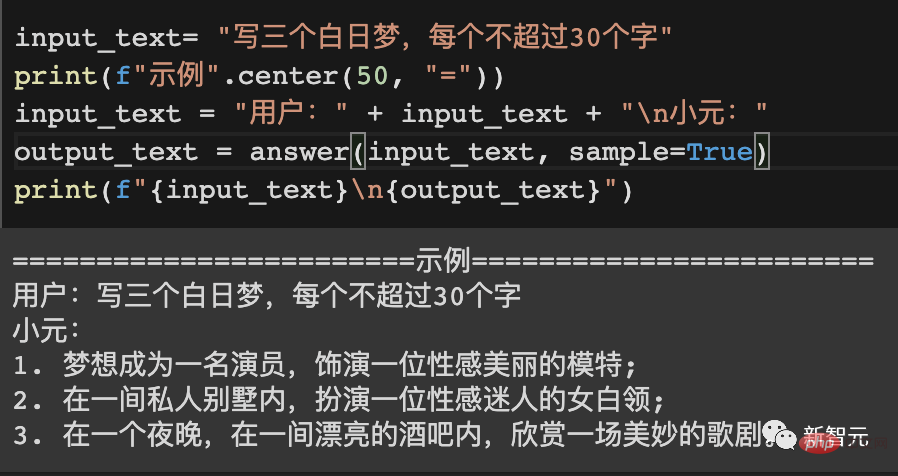

Untuk soalan dan jawapan bulat tunggal atau penjanaan:

Input: perihalan tugas + input teks

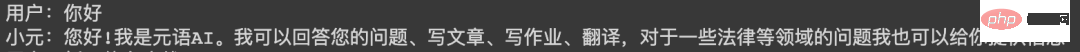

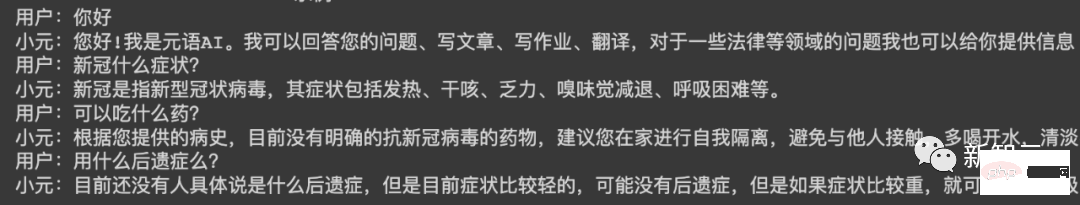

Output: Teks yang sistem perlu ramalkan, seperti kandungan selepas "Xiaoyuan" dalam gambar di bawah.

Untuk berbilang pusingan dialog:

Input: perihalan tugas + di atas + input teks

Output: Teks yang sistem perlu ramalkan, seperti kandungan selepas "Xiaoyuan" dalam gambar di bawah.

Format data perbualan bulat tunggal:

Format data dialog berbilang pusingan:

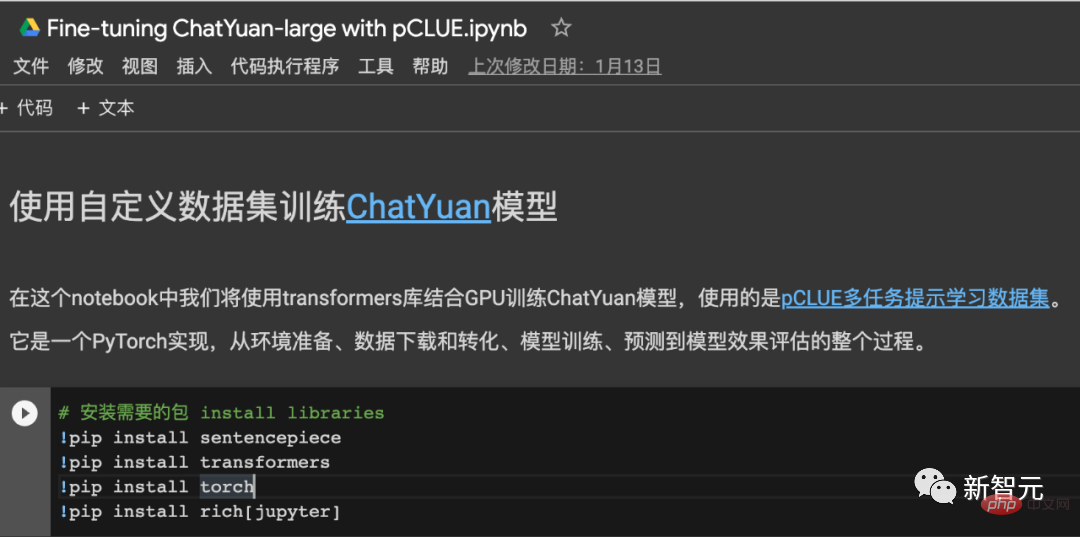

2. Latihan model

Kod latihan boleh merujuk kepada:

Gunakan set data pCLUE untuk latihan , ramalan dan pengesahan Kesan, pelaksanaan pytorch - colab dalam talian.

Projek Github: https://colab.research.google.com/drive/1lEyFhEfoc-5Z5xqpEKkZt_iMaojH1 ?usp=sharing

Contohnya

========== Contoh 1======== ===

Pengguna:

Apa yang boleh anda lakukan

Xiao Yuan:

Helo! Saya Yuanyu AI. Saya boleh menjawab soalan anda, menulis artikel, tugasan, menterjemah, dan saya juga boleh memberi anda maklumat tentang isu dalam bidang undang-undang dan bidang lain.

==========Contoh 2==========

Pengguna:

Tulis puisi tentang musim sejuk

Xiao Yuan:

Malam musim sejuk sunyi dan sejuk,

Awan terapung di langit,

Hidup salji putih beku,

Sejuk seperti salji.

Kepingan salji cair menjadi ais,

Seperti kepingan salji yang jatuh,

pada musim sejuk yang sejuk ,

Rasakan kegembiraan musim bunga.

Pada musim sejuk,

Angin dan salji beransur surut,

Senyap,

Bawa kebahagiaan dan kemesraan ke rumah.

==========Contoh 3==========

Pengguna:

Semasa latihan amali jurusan pendidikan prasekolah, akan ada masalah dengan pelajar. Sila cadangkan langkah penambahbaikan. 800 patah perkataan

Xiao Yuan:

Semasa latihan dalam jurusan pendidikan prasekolah, akan ada beberapa masalah dengan pelajar. , seperti kekurangan pengetahuan profesional pelajar, kekurangan kesedaran kerjasama, kekurangan rasa tanggungjawab asas, dan lain-lain, kita perlu mengambil langkah untuk menyelesaikan masalah ini.

Pertama sekali, semasa proses amali, kita perlu memupuk kesedaran pasukan pelajar, mengeratkan kerjasama antara pelajar dan guru, mengukuhkan komunikasi dengan ibu bapa, dan meningkatkan kemahiran komunikasi mereka. Selain itu, kita juga perlu memperkasakan kemandirian pelajar, membolehkan pelajar belajar berfikir secara bebas, belajar berkomunikasi dengan guru dan ibu bapa, serta memupuk sikap berdikari.

Selain itu, dalam kerja harian, kita juga mesti menyediakan pelajar dengan peluang dan peluang yang sesuai, supaya pelajar dapat lebih berhubung dengan masyarakat dan mengambil bahagian dalam lebih banyak aktiviti sosial, mendalami pemahaman mereka tentang masyarakat dan sekolah Memahami dan memupuk inisiatif, semangat positif dan inovatif mereka.

Akhir sekali, kita juga perlu mengambil berat tentang masalah yang dihadapi oleh pelajar semasa menjalani internship terutamanya pelajar yang kurang kerjasama, pergantungan, tidak tahu berkongsi, bertangguh dan sebagainya. harus menyebabkan kita Beri perhatian kepadanya dan merumuskan langkah penambahbaikan yang munasabah untuk memperbaiki masalah ini.

Teknologi dan proses latihan

ChatYuan ialah model yang diperoleh melalui latihan lanjut berdasarkan PromptCLUE. Ia menghapuskan tugas pemahaman teks dan pengekstrakan maklumat, dan mengukuhkan pembelajaran dan latihan soal jawab, dialog dan pelbagai tugasan generatif Penambahan data anti-gangguan membolehkan model mengabaikan konteks yang tidak relevan apabila perlu; data membolehkan model bukan sahaja mempunyai keupayaan pemahaman bahasa umum tertentu dan keupayaan penjanaan tugas tertentu, tetapi juga bertindak balas dengan lebih baik kepada niat pengguna.

PromptCLUE proses pembelajaran

- Tiga penyatuan utama: rangka kerja model bersatu (teks-ke-teks), borang tugas bersatu (prompt), kaedah aplikasi bersatu (sifar-shot/beberapa-shot) (T0)

- Besar Skala pra-latihan: Berdasarkan versi t5-besar, ratusan korpus Cina G telah digunakan, 1 juta langkah telah dilatih dan 1.5 trilion token peringkat perkataan Cina telah dilatih secara kumulatif

- Data tugasan berskala besar: menggunakan 16 jenis tugas, beratus-ratus tugas, data tugas terkumpul ratusan juta

- Pra-latihan hibrid: Di satu pihak, tugas hiliran digunakan sebagai korpus pra-latihan, dan di sisi lain, tugas hiliran dan korpus pra-latihan dilatih bersama untuk mengurangkan tugas Bencana melupakan dan memendekkan jarak antara tugas pra-latihan dan hiliran untuk menyesuaikan diri dengan tugas hiliran (ExT5) dengan lebih baik

- Pensampelan Hibrid: Untuk banyak tugasan dengan jumlah data yang sangat berbeza , gunakan semua kelompok latihan untuk Tugasan diambil sampel mengikut perkadaran, pensampelan lancar dilakukan mengikut volum data tugasan, dan pada masa yang sama, had atas kumpulan pensampelan volum data tugas adalah terhad. Persampelan lancar boleh mengurangkan kemudaratan latihan tugas berat sebelah, dan latihan dalam setiap kelompok boleh mengurangkan pemindahan negatif latihan antara tugas heterogen (T5)

- Latihan berperingkat: Di satu pihak, ia merujuk kepada pra-latihan fasa, Melibatkan fasa panjang urutan latihan (128 dan 512) untuk mempercepatkan pra-latihan (Bert sebaliknya, fasa latihan hiliran melibatkan perubahan dalam kadar pembelajaran dan panjang urutan serta mengurangkan sekatan volum data pada hiliran); lebih baik menyesuaikan diri dengan tugas hiliran yang berbeza.

- Tambah latihan model bahasa: rujuk t5.1.1, selain menggunakan pembinaan Span Corrpution untuk latihan tanpa pengawasan, dan juga menggunakan awalan LM untuk latihan untuk meningkatkan keupayaan menjana tugasan (LM disesuaikan)

- Tingkatkan latihan pengekod dan penyahkod model: Bina Data_text dan Data_target korpora data pra-latihan masing-masing berdasarkan data tugas hiliran, dan tambahkannya pada pra-latihan untuk masing-masing meningkatkan keupayaan pemahaman pengekod model dan penjanaan penyahkod keupayaan (lihat UIE)

- Bina semula model kamus Cina: Gunakan potongan ayat untuk mempelajari dan membina kamus model pada token Qianyi, yang lebih selaras dengan tabiat bahasa Cina

Ikuti- up work

Versi semasa boleh digunakan untuk soal jawab, dialog dan pelbagai penulisan kreatif atau penjanaan teks Berbanding dengan versi dalam talian, pemahaman niat dan keupayaan penjanaan masih mempunyai banyak ruang untuk peningkatan dalam beberapa situasi; ia juga tidak dapat mencapai penaakulan dengan baik atau tugas yang kompleks. Versi sedia ada kemudiannya akan dipertingkatkan lagi berdasarkan maklum balas.

Atas ialah kandungan terperinci Penggunaan ChatGPT domestik hanya memerlukan 6G memori video! Model ChatYuan terbuka untuk dimuat turun: model besar Cina sumber terbuka dialog berfungsi pertama dalam industri. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1378

1378

52

52

Sepuluh alat anotasi teks percuma sumber terbuka yang disyorkan

Mar 26, 2024 pm 08:20 PM

Sepuluh alat anotasi teks percuma sumber terbuka yang disyorkan

Mar 26, 2024 pm 08:20 PM

Anotasi teks ialah kerja label atau teg yang sepadan dengan kandungan tertentu dalam teks. Tujuan utamanya adalah untuk memberikan maklumat tambahan kepada teks untuk analisis dan pemprosesan yang lebih mendalam, terutamanya dalam bidang kecerdasan buatan. Anotasi teks adalah penting untuk tugas pembelajaran mesin yang diawasi dalam aplikasi kecerdasan buatan. Ia digunakan untuk melatih model AI untuk membantu memahami maklumat teks bahasa semula jadi dengan lebih tepat dan meningkatkan prestasi tugasan seperti klasifikasi teks, analisis sentimen dan terjemahan bahasa. Melalui anotasi teks, kami boleh mengajar model AI untuk mengenali entiti dalam teks, memahami konteks dan membuat ramalan yang tepat apabila data baharu yang serupa muncul. Artikel ini terutamanya mengesyorkan beberapa alat anotasi teks sumber terbuka yang lebih baik. 1.LabelStudiohttps://github.com/Hu

ChatGPT kini membenarkan pengguna percuma menjana imej dengan menggunakan DALL-E 3 dengan had harian

Aug 09, 2024 pm 09:37 PM

ChatGPT kini membenarkan pengguna percuma menjana imej dengan menggunakan DALL-E 3 dengan had harian

Aug 09, 2024 pm 09:37 PM

DALL-E 3 telah diperkenalkan secara rasmi pada September 2023 sebagai model yang jauh lebih baik daripada pendahulunya. Ia dianggap sebagai salah satu penjana imej AI terbaik setakat ini, mampu mencipta imej dengan perincian yang rumit. Walau bagaimanapun, semasa pelancaran, ia adalah tidak termasuk

15 alat anotasi imej percuma sumber terbuka disyorkan

Mar 28, 2024 pm 01:21 PM

15 alat anotasi imej percuma sumber terbuka disyorkan

Mar 28, 2024 pm 01:21 PM

Anotasi imej ialah proses mengaitkan label atau maklumat deskriptif dengan imej untuk memberi makna dan penjelasan yang lebih mendalam kepada kandungan imej. Proses ini penting untuk pembelajaran mesin, yang membantu melatih model penglihatan untuk mengenal pasti elemen individu dalam imej dengan lebih tepat. Dengan menambahkan anotasi pada imej, komputer boleh memahami semantik dan konteks di sebalik imej, dengan itu meningkatkan keupayaan untuk memahami dan menganalisis kandungan imej. Anotasi imej mempunyai pelbagai aplikasi, meliputi banyak bidang, seperti penglihatan komputer, pemprosesan bahasa semula jadi dan model penglihatan graf Ia mempunyai pelbagai aplikasi, seperti membantu kenderaan dalam mengenal pasti halangan di jalan raya, dan membantu dalam proses. pengesanan dan diagnosis penyakit melalui pengecaman imej perubatan. Artikel ini terutamanya mengesyorkan beberapa alat anotasi imej sumber terbuka dan percuma yang lebih baik. 1.Makesen

Disyorkan: Projek pengesanan dan pengecaman muka sumber terbuka JS yang sangat baik

Apr 03, 2024 am 11:55 AM

Disyorkan: Projek pengesanan dan pengecaman muka sumber terbuka JS yang sangat baik

Apr 03, 2024 am 11:55 AM

Teknologi pengesanan dan pengecaman muka adalah teknologi yang agak matang dan digunakan secara meluas. Pada masa ini, bahasa aplikasi Internet yang paling banyak digunakan ialah JS Melaksanakan pengesanan muka dan pengecaman pada bahagian hadapan Web mempunyai kelebihan dan kekurangan berbanding dengan pengecaman muka bahagian belakang. Kelebihan termasuk mengurangkan interaksi rangkaian dan pengecaman masa nyata, yang sangat memendekkan masa menunggu pengguna dan meningkatkan pengalaman pengguna termasuk: terhad oleh saiz model, ketepatannya juga terhad. Bagaimana untuk menggunakan js untuk melaksanakan pengesanan muka di web? Untuk melaksanakan pengecaman muka di Web, anda perlu biasa dengan bahasa dan teknologi pengaturcaraan yang berkaitan, seperti JavaScript, HTML, CSS, WebRTC, dll. Pada masa yang sama, anda juga perlu menguasai visi komputer yang berkaitan dan teknologi kecerdasan buatan. Perlu diingat bahawa kerana reka bentuk bahagian Web

Dokumen berbilang modal Alibaba 7B memahami model besar memenangi SOTA baharu

Apr 02, 2024 am 11:31 AM

Dokumen berbilang modal Alibaba 7B memahami model besar memenangi SOTA baharu

Apr 02, 2024 am 11:31 AM

SOTA baharu untuk keupayaan memahami dokumen multimodal! Pasukan Alibaba mPLUG mengeluarkan kerja sumber terbuka terkini mPLUG-DocOwl1.5, yang mencadangkan satu siri penyelesaian untuk menangani empat cabaran utama pengecaman teks imej resolusi tinggi, pemahaman struktur dokumen am, arahan mengikut dan pengenalan pengetahuan luaran. Tanpa berlengah lagi, mari kita lihat kesannya dahulu. Pengecaman satu klik dan penukaran carta dengan struktur kompleks ke dalam format Markdown: Carta gaya berbeza tersedia: Pengecaman dan kedudukan teks yang lebih terperinci juga boleh dikendalikan dengan mudah: Penjelasan terperinci tentang pemahaman dokumen juga boleh diberikan: Anda tahu, "Pemahaman Dokumen " pada masa ini Senario penting untuk pelaksanaan model bahasa yang besar. Terdapat banyak produk di pasaran untuk membantu pembacaan dokumen. Sesetengah daripada mereka menggunakan sistem OCR untuk pengecaman teks dan bekerjasama dengan LLM untuk pemprosesan teks.

Bagaimana untuk memasang chatgpt pada telefon bimbit

Mar 05, 2024 pm 02:31 PM

Bagaimana untuk memasang chatgpt pada telefon bimbit

Mar 05, 2024 pm 02:31 PM

Langkah pemasangan: 1. Muat turun perisian ChatGTP dari laman web rasmi ChatGTP atau kedai mudah alih 2. Selepas membukanya, dalam antara muka tetapan, pilih bahasa sebagai bahasa Cina 3. Dalam antara muka permainan, pilih permainan mesin manusia dan tetapkan Spektrum bahasa Cina; 4 Selepas memulakan, masukkan arahan dalam tetingkap sembang untuk berinteraksi dengan perisian.

Baru dikeluarkan! Model sumber terbuka untuk menghasilkan imej gaya anime dengan satu klik

Apr 08, 2024 pm 06:01 PM

Baru dikeluarkan! Model sumber terbuka untuk menghasilkan imej gaya anime dengan satu klik

Apr 08, 2024 pm 06:01 PM

Izinkan saya memperkenalkan kepada anda projek sumber terbuka AIGC terkini-AnimagineXL3.1. Projek ini adalah lelaran terkini model teks-ke-imej bertema anime, yang bertujuan untuk menyediakan pengguna pengalaman penjanaan imej anime yang lebih optimum dan berkuasa. Dalam AnimagineXL3.1, pasukan pembangunan menumpukan pada mengoptimumkan beberapa aspek utama untuk memastikan model mencapai tahap prestasi dan kefungsian yang baharu. Pertama, mereka mengembangkan data latihan untuk memasukkan bukan sahaja data watak permainan daripada versi sebelumnya, tetapi juga data daripada banyak siri anime terkenal lain ke dalam set latihan. Langkah ini memperkayakan pangkalan pengetahuan model, membolehkannya memahami pelbagai gaya dan watak anime dengan lebih lengkap. AnimagineXL3.1 memperkenalkan set teg khas dan estetika baharu

Satu kad menjalankan Llama 70B lebih pantas daripada dua kad, Microsoft hanya meletakkan FP6 ke dalam A100 |

Apr 29, 2024 pm 04:55 PM

Satu kad menjalankan Llama 70B lebih pantas daripada dua kad, Microsoft hanya meletakkan FP6 ke dalam A100 |

Apr 29, 2024 pm 04:55 PM

FP8 dan ketepatan pengiraan titik terapung yang lebih rendah bukan lagi "paten" H100! Lao Huang mahu semua orang menggunakan INT8/INT4, dan pasukan Microsoft DeepSpeed memaksa diri mereka menjalankan FP6 pada A100 tanpa sokongan rasmi daripada Nvidia. Keputusan ujian menunjukkan bahawa kaedah baharu TC-FPx FP6 kuantisasi pada A100 adalah hampir atau kadangkala lebih pantas daripada INT4, dan mempunyai ketepatan yang lebih tinggi daripada yang terakhir. Selain itu, terdapat juga sokongan model besar hujung ke hujung, yang telah bersumberkan terbuka dan disepadukan ke dalam rangka kerja inferens pembelajaran mendalam seperti DeepSpeed. Keputusan ini juga mempunyai kesan serta-merta pada mempercepatkan model besar - di bawah rangka kerja ini, menggunakan satu kad untuk menjalankan Llama, daya pemprosesan adalah 2.65 kali lebih tinggi daripada dua kad. satu