"Kecerdasan Buatan Umum" kini hampir menjadi teknologi "air kepada minyak" pada tahun 2020-an Hampir setiap setengah bulan seseorang akan mengumumkan penemuan/kepercayaan bahawa model besar tertentu telah membangkitkan sifat manusia dan AI. Hiduplah". Yang paling banyak menimbulkan pergolakan dalam berita seperti ini baru-baru ini ialah Google. Umum mengetahui bahawa bekas penyelidik Blake Lemoine mengatakan bahawa model bahasa besar LaMDA adalah "hidup".

Malah, hampir pada masa yang sama, terdapat juga artikel seakan-akan lembut daripada Google dalam The Atlantic Monthly mengatakan bahawa satu lagi model bahasa besar baharu, PaLM, juga telah menjadi " kecerdasan buatan am sebenar" (Ia adalah kecerdasan am buatan sebenar).

Tetapi hampir tiada siapa yang membaca artikel ini, jadi ia hanya mencetuskan beberapa perbincangan dan kritikan Hanya beberapa sahaja.

Namun, walaupun tidak ada yang membaca manuskrip penerbitan bertaraf dunia yang memuji pengeluar bertaraf dunia, mereka tetap akan menjadi seperti barisan filem lama, "Seperti kunang-kunang di malam yang gelap, begitu terang. , Sangat luar biasa..." Pada 19 Jun 2022, "The Atlantic Monthly" menerbitkan artikel bertajuk "Kesedaran Buatan Adalah Membosankan."

Tajuk artikel di The Atlantic ini lebih mudah daripada tajuk artikel: "Google's PaLM AI Is Far Stranger" Than Conscious).

Kandungan adalah seperti yang dijangkakan, ia adalah pujian pengarang selepas menemu bual ahli pasukan projek PaLM Google Brain: 540 bilion parameter, ratusan tugasan berbeza boleh diselesaikan tanpa Tugas pra-latihan. Boleh bercerita jenaka dan meringkaskan teks. Jika pengguna memasukkan soalan dalam bahasa Bengali, model PaLM boleh membalas dalam kedua-dua bahasa Bengali dan Inggeris.

Jika pengguna memerlukan menterjemah sekeping kod daripada bahasa C kepada Python, model PaLM juga boleh melengkapkannya dengan cepat. Tetapi artikel ini beransur-ansur berubah daripada skrip temu bual yang megah yang disyaki sebagai rencana lembut, kepada draf yang menyanjung: mengumumkan bahawa model PaLM ialah "kecerdasan am buatan sebenar" (Ia adalah kecerdasan am buatan sebenar).

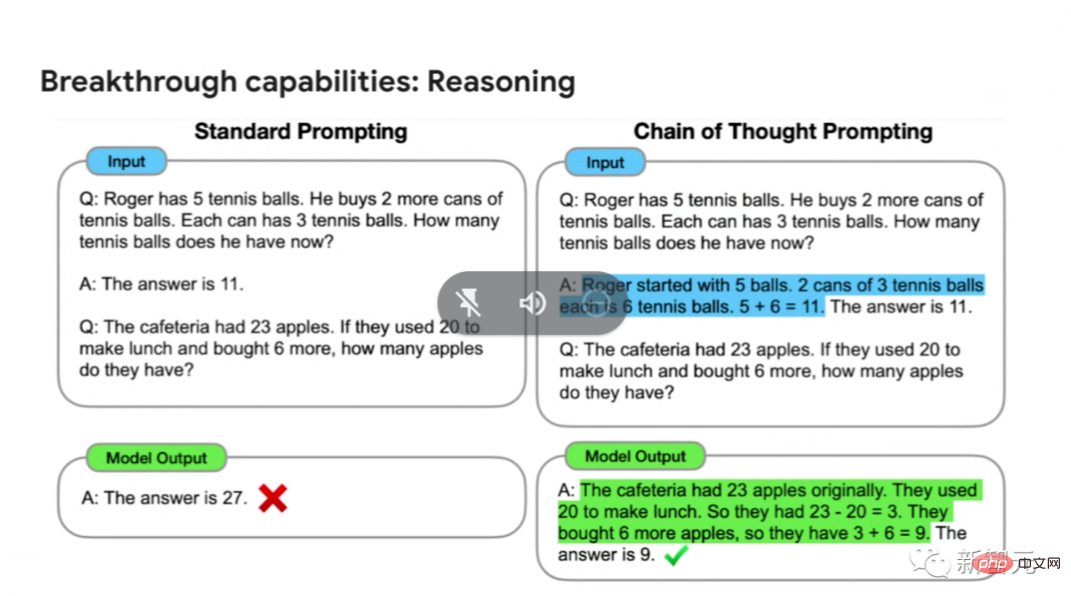

"Fungsi PaLM menakutkan pembangun. Ia memerlukan kesejukan dan jarak intelektual untuk tidak takut dan menerimanya - PaLM adalah rasional yang mengejutkan pembangunnya sendiri, dan yang memerlukan jarak dan intelektual tertentu Kesejukan untuk tidak panik. secara paksa diumumkan menjadi AGI. Apakah asas untuk tuntutan ini? Menurut pengarang artikel ini, ia adalah kerana model PaLM boleh "pecah keluar dari kotak" untuk menyelesaikan tugas pintar yang berbeza dengan sendirinya tanpa latihan khusus terlebih dahulu. Selain itu, model PaLM mempunyai fungsi "gesaan rantaian berfikir" Dalam bahasa vernakular, selepas membongkar, menerangkan dan menunjukkan proses penyelesaian masalah kepada model PaLM, PaLM boleh menghasilkan jawapan yang betul sendiri.

Jeff Dean sendiri tidak pernah mengatakan bahawa PaLM adalah AGI

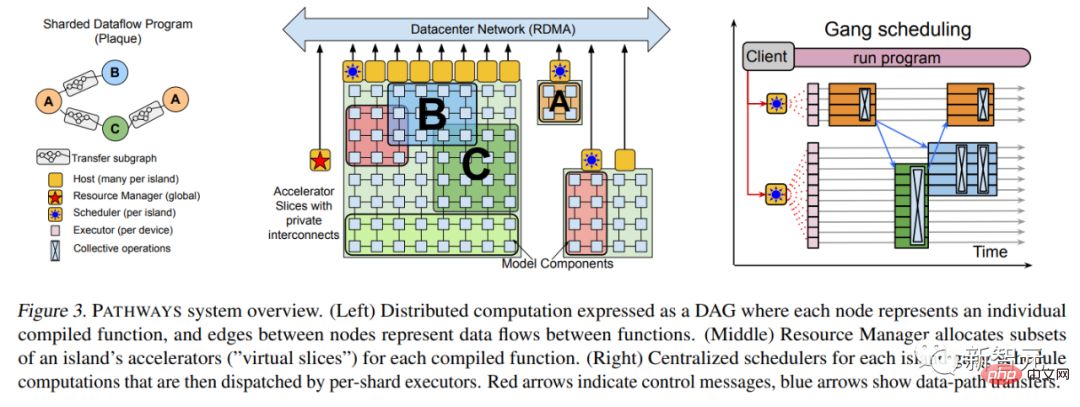

Jurang antara gimik dan bukti adalah besar Besar " Tanggalkan seluar dan lihat ini" perasaan: Ternyata pengarang "The Atlantic Monthly" juga mempunyai tabiat menemu bual orang untuk menulis artikel tanpa menyemak maklumat.  Sebab mengapa saya katakan ini adalah kerana semasa cikgu Jeff Dean mengetuai pasukan untuk melancarkan model PaLM, dia memperkenalkan fungsi "Thinking Chain Prompt". Tetapi Google Brain tidak akan pernah berani berbangga bahawa produk ini adalah "Terminator" yang telah dihidupkan. Pada Oktober 2021, Jeff Dean secara peribadi menulis artikel yang memperkenalkan seni bina pembelajaran mesin baharu-Pathways. Tujuannya sangat mudah, iaitu untuk membolehkan AI menjangkau puluhan ribu tugas, memahami jenis data yang berbeza dan mencapainya dengan kecekapan yang sangat tinggi pada masa yang sama:

Sebab mengapa saya katakan ini adalah kerana semasa cikgu Jeff Dean mengetuai pasukan untuk melancarkan model PaLM, dia memperkenalkan fungsi "Thinking Chain Prompt". Tetapi Google Brain tidak akan pernah berani berbangga bahawa produk ini adalah "Terminator" yang telah dihidupkan. Pada Oktober 2021, Jeff Dean secara peribadi menulis artikel yang memperkenalkan seni bina pembelajaran mesin baharu-Pathways. Tujuannya sangat mudah, iaitu untuk membolehkan AI menjangkau puluhan ribu tugas, memahami jenis data yang berbeza dan mencapainya dengan kecekapan yang sangat tinggi pada masa yang sama:

Lebih setengah tahun kemudian, pada Mac 2022, Jeff Dean akhirnya mengeluarkan kertas Pathways.  Alamat kertas: https://arxiv.org/abs/2203.12533 Antaranya, banyak butiran teknikal ditambah, seperti Sistem yang paling asas seni bina, dsb.

Alamat kertas: https://arxiv.org/abs/2203.12533 Antaranya, banyak butiran teknikal ditambah, seperti Sistem yang paling asas seni bina, dsb.

Pada April 2022, model bahasa PaLM Google yang dibina menggunakan sistem Pathways telah dilancarkan Model bahasa pengubah dengan 540 bilion parameter telah berturut-turut memecahkan SOTA dalam pelbagai tugas pemprosesan bahasa semula jadi. Selain menggunakan sistem Pathways yang berkuasa, kertas kerja memperkenalkan bahawa latihan PaLM menggunakan 6144 TPU v4, menggunakan set data berkualiti tinggi sebanyak 780 bilion token, dan 22% daripadanya adalah korpus bukan bahasa Inggeris dan berbilang bahasa.

Alamat kertas: https://arxiv.org/abs/2204.02311 "Self- "Pembelajaran" dan "rantaian pemikiran" adalah konsep yang biasa digunakan oleh industri AI sebelum ini. Model PaLM hanya melaksanakan konsep tersebut. Lebih memburukkan keadaan, artikel Atlantic Monthly secara langsung menyatakan bahawa "Penyelidik Google tidak tahu mengapa model PaLM boleh mencapai fungsi ini"... Ini kerana Cikgu Jeff Dean terlalu sibuk dan sedang mencari sesuatu untuk dilakukan untuknya.

Sudah pasti, Profesor Melanie Mitchell, ahli Institut Santa Fe di California, Amerika Syarikat, menyiarkan pada rangkaian sosialnya akaun Siri siaran secara tersirat tetapi tegas mempersoalkan artikel Bulanan Atlantik.

Melanie Mitchell berkata: "Artikel ini sangat menarik, tetapi saya fikir penulis mungkin tidak menemu bual profesional dalam industri AI selain daripada penyelidik Google.

Sebagai contoh, terdapat pelbagai bukti yang mendakwa bahawa model PaLM adalah "real AGI". Saya tidak mempunyai kebenaran untuk menggunakan PaLM, tetapi kertas yang dikeluarkan oleh Google pada April hanya mempunyai kesan yang ketara beberapa ujian penanda aras , tetapi tidak semua sampel kecil keputusan ujian pembelajaran PaLM adalah sama teguh

Dan berapa banyak tanda aras yang digunakan dalam ujian menggunakan teknologi "pembelajaran pintasan" untuk memudahkan kesukaran, kertas. Ia tidak disebutkan dalam artikel Menurut kata-kata artikel "Atlantic Monthly", PaLM sekurang-kurangnya boleh menyelesaikan pelbagai tugas dengan kebolehpercayaan yang tinggi, dan ketepatan umum artikel mahupun kertas Google April menerangkan secara terperinci keupayaan dan batasan model PaLM dari segi kecerdasan umum, dan juga tidak menyebut penanda aras untuk menguji keupayaan ini Dan dakwaan yang sama perlu disahkan siri GPT telah dipalsukan oleh orang dalam industri yang telah menjalankan pelbagai eksperimen ke atasnya Jika PaLM ingin menerima penghormatan sedemikian, ia harus diterima pada tahap yang sama

Selain itu, menurut pengakuan kertas April Google, ujian penanda aras rasional PaLM hanya lebih baik sedikit daripada beberapa model SOTA yang serupa dalam industri, dan tidak banyak pemenang >

Perkara yang paling penting ialah kertas kerja PaLM belum disemak rakan sebaya dan model tersebut tidak mempunyai sebarang akses kepada dunia luar hanya sekadar mulut sahaja dan tidak boleh disahkan, diterbitkan semula atau dinilai ”

Atas ialah kandungan terperinci Adakah model Google PaLM juga diisytiharkan oleh orang awam? Orang dalam industri: Ujian rasional hanya 3% lebih baik daripada GPT. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!