Pengekstrakan maklumat sampel sifar dengan bercakap dengan GPT

Trend semasa model besar tujuan umum yang menggantikan model proprietari yang disesuaikan untuk tugasan tertentu secara beransur-ansur muncul. Pendekatan ini telah mengurangkan kos marginal aplikasi model AI dengan ketara. Ini menimbulkan persoalan: Adakah boleh mencapai pengekstrakan maklumat sampel sifar tanpa latihan?

Teknologi pengekstrakan maklumat merupakan bahagian penting dalam membina graf pengetahuan Jika ia boleh dilaksanakan tanpa latihan sama sekali, ia akan mengurangkan ambang analisis data dan membantu merealisasikan pengetahuan automatik.

Kami membina sistem IE sampel sifar am dengan menggunakan kaedah kejuruteraan segera untuk GPT-3.5 - GPT4IE (GPT untuk Pengekstrakan Maklumat) , mendapati bahawa GPT3.5 boleh mengekstrak maklumat berstruktur secara automatik daripada ayat asal. Menyokong kedua-dua bahasa Cina dan Inggeris, dan kod alat adalah sumber terbuka.

URL Alat: https://cocacola-lab.github.io/GPT4IE/

Kod: https://github.com/cocacola-lab/GPT4IE

1 Pengenalan latar belakang

Maklumat matlamat pengekstrakan (Ekstraksi Maklumat, IE) adalah untuk mengekstrak maklumat berstruktur daripada teks tidak berstruktur, termasuk pengekstrakan tiga kali ganda perhubungan entiti (Ekstrak Perhubungan Entiti, RE), pengiktirafan entiti bernama (Pengiktirafan Entiti Dinamakan, NER) dan pengekstrakan peristiwa ( Pengekstrakan Peristiwa, EE) [1][2][3][4][5]. Banyak kajian telah mula bergantung pada teknologi IE untuk mengautomasikan kerja sifar / beberapa pukulan, seperti IE klinikal [6].

Model bahasa pra-latihan berskala besar (LLM) baru-baru ini telah menunjukkan prestasi yang sangat baik pada banyak tugas hiliran, walaupun dengan hanya beberapa contoh sebagai panduan tanpa memerlukan Ia boleh dicapai dengan sedikit tweak. Daripada ini kami menimbulkan soalan: Adakah ia boleh dilaksanakan untuk melaksanakan tugasan IE pukulan sifar melalui gesaan sahaja? Kami cuba menggunakan kaedah segera untuk membina sistem IE tembakan sifar umum untuk GPT-3.5 - GPT4IE (GPT untuk Pengekstrakan Maklumat) . Digabungkan dengan GPT3.5 dan pembayang, ia dapat mengekstrak maklumat berstruktur secara automatik daripada ayat asal.

2 Rangka Kerja Teknikal

Mereka bentuk templat gesaan yang ditentukan tugas, dan kemudian mengisi templat dengan input pengguna Nilai slot tertentu (slot) membentuk gesaan (prompt), yang dimasukkan ke dalam GPT-3.5 dan digunakan untuk IE. Terdapat tiga tugasan yang disokong: RE, NER dan EE, dan ketiga-tiga tugasan adalah dwibahasa dalam bahasa Cina dan Inggeris. Pengguna perlu memasukkan ayat dan merumuskan senarai jenis pengekstrakan (iaitu, senarai perhubungan, senarai entiti kepala, senarai entiti ekor, senarai jenis entiti atau senarai acara). Butirannya adalah seperti berikut:

Matlamat tugas RE adalah untuk mengekstrak tiga kali ganda daripada teks, seperti "(China, ibu kota, Beijing)", " ("Ruyi "Biografi", lakonan, Zhou Xun)". Format input yang diperlukan adalah seperti berikut (item dengan "*" mewakili medan yang tidak diperlukan. Kami telah menetapkan nilai lalai untuk pilihan ini, tetapi untuk fleksibiliti, kami menyokong senarai yang ditentukan yang ditentukan pengguna, sama seperti di bawah):

- Ayat Input: Teks input

- Senarai jenis hubungan (rtl)* : ['Jenis hubungan 1', 'Jenis hubungan 2' , ...]

- Senarai jenis subjek (stl)* : ['Jenis entiti pengepala 1', 'Jenis entiti pengepala 2', ...]

- Senarai jenis objek (otl)* : ['Jenis entiti ekor 1', 'Jenis entiti ekor 2', ...]

- Kunci API OpenAI: OpenAI Kunci API (kami Beberapa kunci yang tersedia disediakan dalam Github sebagai contoh )

tugas NER direka untuk mengekstrak entiti daripada teks, seperti " (LOC , Beijing)”, “(Watak, Zhou Enlai)”. Pada tugasan NER, format input adalah seperti berikut:

- Ayat Input: Teks input

- Senarai jenis entiti (etl) * : [ 'Jenis entiti 1', 'Jenis entiti 2', ...]

- Kunci API OpenAI: Kunci API OpenAI

Tugas EE bertujuan untuk mengeluarkan peristiwa daripada teks biasa, seperti "{Life-Divorce: {Orang: Bob, Masa: hari ini, Tempat: Amerika}}", "{Contest Behavior-Promotion: {Time" : Tiada, Bahagian promosi: Northwest Wolves, Acara promosi: Pertempuran untuk tempat teratas Liga Perdana China}}". Format input adalah seperti berikut:

- Ayat Input: Teks input

- Senarai jenis acara (etl)* : {'Jenis peristiwa 1': ['Peranan hujah 1', ' Hujah peranan 2', ...], ...}

- Kunci API OpenAI: Kunci API OpenAI

3 Contoh penggunaan alatan

3.1 RE Contoh 1

Input:

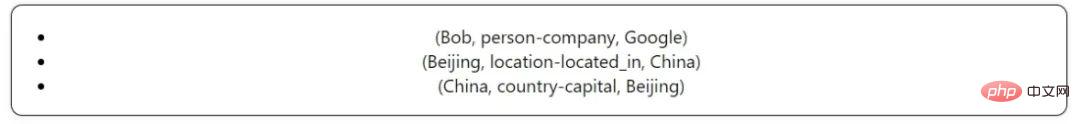

Ayat Input: Bob bekerja untuk Google di Beijing, ibu negara China.

rtl: [ 'lokasi- terletak_dalam', 'negara-bahagian_pentadbiran', 'orang-tempat_diami', 'orang-syarikat', 'orang-kewarganegaraan', 'pengasas-syarikat', 'bahagian_pentadbiran-negara', 'orang-anak', 'negara-modal' , 'orang-orang-tempat_mati', 'kejiranan-kejiranan', 'orang-tempat_kelahiran']

stl: ['organisasi', 'orang' , 'lokasi ', 'negara']

otl: ['orang', 'lokasi', 'negara', 'organisasi', 'bandar']

Output:

3.2 RE Contoh 2

Input:

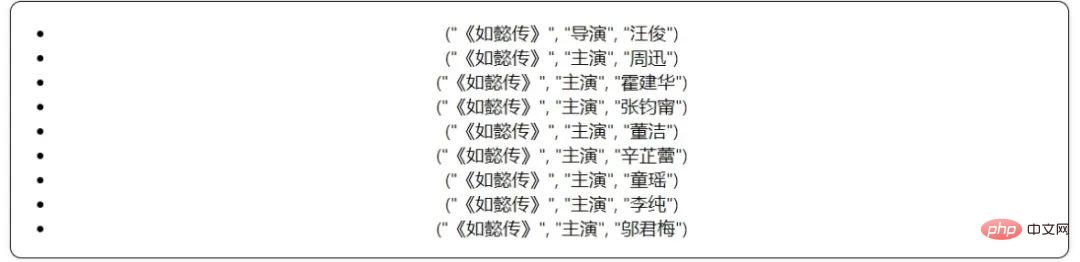

Ayat Input: "Cinta Diraja Ruyi di Istana" ialah siri TV emosi istana pakaian kuno, diterbitkan oleh Diarahkan oleh Wang Jun, dibintangi oleh Zhou Xun, Huo Jianhua, Zhang Junning, Dong Jie, Xin Zhilei, Tong Yao, Li Chun, Wu Junmei dan lain-lain.

rtl: ['Album', 'Tarikh Penubuhan', 'Altitud', 'Bahasa Rasmi', 'Kawasan', 'Bapa', 'Penyanyi ', 'Penerbit', 'Pengarah', 'Modal', 'Dibintangi', 'Pengerusi', 'rumah pusaka', 'Isteri', 'Ibu', 'Iklim', 'Kawasan', 'Protagonis' , 'Poskod ', 'Singkatan', 'Syarikat pengeluaran', 'Modal berdaftar', 'Penulis Skrin', 'Pengasas', 'Sekolah tamat pengajian', 'Kewarganegaraan', 'Kod profesional', 'Dinasti', 'Pengarang', 'lirik', 'bandar', 'tetamu', 'lokasi ibu pejabat', 'populasi', 'jurucakap', 'diadaptasi daripada', 'pengetua', 'suami', 'tuan rumah', 'lagu tema' ', 'tahun belajar', 'komposisi', 'nombor', 'masa keluaran', 'box office', 'lakonan', 'dubbing', 'anugerah']

stl: ['Negara', 'Wilayah Pentadbiran', 'Karya Sastera', 'Watak', 'Karya Filem dan Televisyen', 'Sekolah', 'Karya Buku', 'Tempat', 'Tokoh Sejarah', 'Tempat Tarikan' , 'Lagu ', 'Subject Major', 'Enterprise', 'TV Variety Show', 'Institution', 'Enterprise/Brand', 'Entertainment Figure']

otl : ['Negara', 'Orang', 'Teks', 'Tarikh', 'Tempat', 'Iklim', 'Bandar', 'Lagu', 'Perusahaan', 'Nombor', 'Album Muzik', 'sekolah ', 'kerja', 'bahasa']

Output:

3.3 NER Contoh 1

Input:

Ayat Input : Bob bekerja untuk Google di Beijing, ibu negara China.

etl: ['LOC', 'MISC', 'ORG', ' PER' ]

Output:

3.4 NER contoh dua

Input:

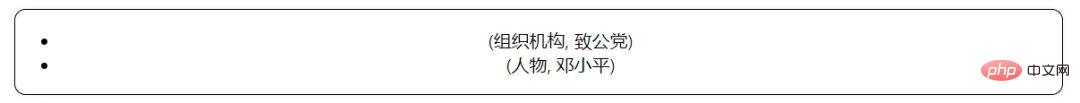

Ayat Input: Dalam tempoh lima tahun yang lalu, di bawah bimbingan Teori Deng Xiaoping, Parti Zhigong telah mengikuti garis asas tahap utama sosialisme dan bekerja keras untuk melaksanakan dasar dicadangkan pada Kongres Kebangsaan ke-10 Parti Zhigong Tugas asas untuk mengambil bahagian dalam fungsi parti dan mengukuhkan pembinaan diri.

etl: ['organisasi', 'lokasi', 'orang']

Output:

3.5 EE Contoh 1

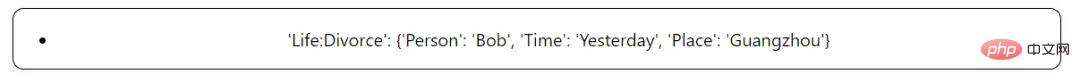

Ayat Input:Semalam Bob dan isterinya bercerai di Guangzhou.

etl: {'Personnel:Elect': ['Orang', 'Entiti', 'Jawatan', 'Masa', 'Tempat'], 'Perniagaan:Isytihar-Muflis': ['Org', 'Masa', 'Tempat'], 'Keadilan:Tangkapan-Penjara': ['Orang ', 'Ejen', 'Jenayah', 'Masa', 'Tempat'], 'Hidup:Perceraian': ['Orang', 'Masa', 'Tempat'], 'Hidup:Mencederakan': ['Ejen', 'Mangsa', 'Alat', 'Masa', 'Tempat']}

Output:

3.6 EE Contoh 2

3.6 EE Contoh 2

Input:

Ayat Input: : Pada perlawanan akhir Piala Dunia Qatar 2022, Argentina menewaskan Perancis secara tipis dalam penentuan sepakan penalti.

etl: {'Gelagat organisasi-mogok': ['masa', 'organisasi', 'bilangan mogok', 'kakitangan mogok'], ' Kelakuan Persaingan-Promosi': ['Masa', 'Pesta Promosi', 'Acara Promosi'], 'Kewangan/Stok Terhad Dagangan': ['Masa', 'Stok Terhad'], 'Perhubungan Organisasi-Pembuangan': [ ' Time', 'Firing Party', 'Fired Person']}

Output:

Input:

Ayat Input:: Saya ceraikan dia hari ini

etl: {'Tingkah Laku Organisasi - Mogok': [ 'Masa' , 'Afiliasi', 'Bilangan mogok', 'Kakitangan mogok'], 'Kelakuan-Kelakuan Persaingan': ['Masa', 'Pesta Kenaikan Pangkat', 'Acara Promosi'], 'Kewangan/Had Lebih Tinggi' ; . ']}, outputnya ialah:

Atas ialah kandungan terperinci Pengekstrakan maklumat sampel sifar dengan bercakap dengan GPT. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1386

1386

52

52

Bagaimana untuk mengalih keluar maklumat pengarang dan terakhir diubah suai dalam Microsoft Word

Apr 15, 2023 am 11:43 AM

Bagaimana untuk mengalih keluar maklumat pengarang dan terakhir diubah suai dalam Microsoft Word

Apr 15, 2023 am 11:43 AM

Dokumen Microsoft Word mengandungi beberapa metadata apabila disimpan. Butiran ini digunakan untuk pengenalan pada dokumen, seperti apabila ia dibuat, siapa pengarangnya, tarikh diubah suai, dsb. Ia juga mempunyai maklumat lain seperti bilangan aksara, bilangan perkataan, bilangan perenggan dan banyak lagi. Jika anda mungkin ingin mengalih keluar pengarang atau maklumat terakhir yang diubah suai atau sebarang maklumat lain supaya orang lain tidak mengetahui nilainya, maka ada caranya. Dalam artikel ini, mari lihat cara mengalih keluar pengarang dokumen dan maklumat terakhir diubah suai. Alih keluar pengarang dan maklumat terakhir diubah suai daripada dokumen Microsoft Word Langkah 1 – Pergi ke

Senjata muktamad untuk penyahpepijatan Kubernetes: K8sGPT

Feb 26, 2024 am 11:40 AM

Senjata muktamad untuk penyahpepijatan Kubernetes: K8sGPT

Feb 26, 2024 am 11:40 AM

Apabila teknologi kecerdasan buatan dan pembelajaran mesin terus berkembang, syarikat dan organisasi telah mula meneroka secara aktif strategi inovatif untuk memanfaatkan teknologi ini untuk meningkatkan daya saing. K8sGPT[2] ialah salah satu alat yang paling berkuasa dalam bidang ini Ia adalah model GPT berdasarkan k8s, yang menggabungkan kelebihan orkestrasi k8s dengan keupayaan pemprosesan bahasa semula jadi yang sangat baik bagi model GPT. Apakah K8sGPT? Mari lihat contoh dahulu: Menurut laman web rasmi K8sGPT: K8sgpt ialah alat yang direka untuk mengimbas, mendiagnosis dan mengklasifikasikan masalah kelompok kubernetes Ia menyepadukan pengalaman SRE ke dalam enjin analisisnya untuk memberikan maklumat yang paling relevan. Melalui aplikasi teknologi kecerdasan buatan, K8sgpt terus memperkaya kandungannya dan membantu pengguna memahami dengan lebih cepat dan tepat.

Sekiranya saya memilih MBR atau GPT sebagai format cakera keras untuk win7?

Jan 03, 2024 pm 08:09 PM

Sekiranya saya memilih MBR atau GPT sebagai format cakera keras untuk win7?

Jan 03, 2024 pm 08:09 PM

Apabila kami menggunakan sistem pengendalian win7, kadangkala kami mungkin menghadapi situasi di mana kami perlu memasang semula sistem dan membahagikan cakera keras. Mengenai isu sama ada format cakera keras win7 memerlukan mbr atau gpt, editor berpendapat bahawa anda masih perlu membuat pilihan berdasarkan butiran konfigurasi sistem dan perkakasan anda sendiri. Dari segi keserasian, sebaiknya pilih format mbr. Untuk butiran, mari kita lihat apa yang dilakukan oleh editor~ Format cakera keras win7 memerlukan mbr atau gpt1 Jika sistem dipasang dengan Win7, adalah disyorkan untuk menggunakan MBR, yang mempunyai keserasian yang baik. 2. Jika melebihi 3T atau pasang win8, anda boleh menggunakan GPT. 3. Walaupun GPT sememangnya lebih maju daripada MBR, MBR pastinya tidak dapat dikalahkan dari segi keserasian. Kawasan GPT dan MBR

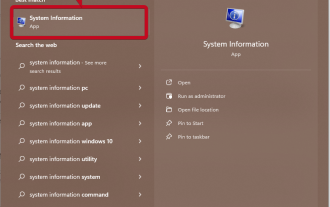

Bagaimana untuk mendapatkan GPU dalam Windows 11 dan semak butiran kad grafik

Nov 07, 2023 am 11:21 AM

Bagaimana untuk mendapatkan GPU dalam Windows 11 dan semak butiran kad grafik

Nov 07, 2023 am 11:21 AM

Menggunakan Maklumat Sistem Klik Mula dan masukkan Maklumat Sistem. Hanya klik pada program seperti yang ditunjukkan dalam imej di bawah. Di sini anda boleh menemui kebanyakan maklumat sistem, dan satu perkara yang anda boleh temui ialah maklumat kad grafik. Dalam program Maklumat Sistem, kembangkan Komponen, dan kemudian klik Tunjukkan. Biarkan program mengumpulkan semua maklumat yang diperlukan dan setelah ia siap, anda boleh mencari nama khusus kad grafik dan maklumat lain pada sistem anda. Walaupun anda mempunyai berbilang kad grafik, anda boleh menemui kebanyakan kandungan yang berkaitan dengan kad grafik khusus dan bersepadu yang disambungkan ke komputer anda dari sini. Menggunakan Pengurus Peranti Windows 11 Sama seperti kebanyakan versi Windows yang lain, anda juga boleh mencari kad grafik pada komputer anda daripada Pengurus Peranti. Klik Mula dan kemudian

Pemahaman mendalam tentang format partition Win10: perbandingan GPT dan MBR

Dec 22, 2023 am 11:58 AM

Pemahaman mendalam tentang format partition Win10: perbandingan GPT dan MBR

Dec 22, 2023 am 11:58 AM

Apabila membahagikan sistem mereka sendiri, disebabkan oleh pemacu keras yang berbeza yang digunakan oleh pengguna, ramai pengguna tidak mengetahui format partition win10 gpt atau mbr Atas sebab ini, kami telah membawakan anda pengenalan terperinci untuk membantu anda memahami perbezaan antara keduanya. Format partition Win10 gpt atau mbr: Jawapan: Jika anda menggunakan cakera keras melebihi 3 TB, anda boleh menggunakan gpt. gpt lebih maju daripada mbr, tetapi mbr masih lebih baik dari segi keserasian. Sudah tentu, ini juga boleh dipilih mengikut keutamaan pengguna. Perbezaan antara gpt dan mbr: 1. Bilangan partition yang disokong: 1. MBR menyokong sehingga 4 partition primer. 2. GPT tidak dihadkan oleh bilangan partition. 2. Saiz cakera keras yang disokong: 1. MBR hanya menyokong sehingga 2TB

Bagaimana untuk menentukan sama ada cakera keras komputer menggunakan kaedah pembahagian GPT atau MBR

Dec 25, 2023 pm 10:57 PM

Bagaimana untuk menentukan sama ada cakera keras komputer menggunakan kaedah pembahagian GPT atau MBR

Dec 25, 2023 pm 10:57 PM

Bagaimana untuk menyemak sama ada cakera keras komputer adalah partition GPT atau partition MBR Apabila kita menggunakan cakera keras komputer, kita perlu membezakan antara GPT dan MBR Sebenarnya, kaedah semakan ini sangat mudah . Bagaimana untuk menyemak sama ada cakera keras komputer adalah GPT atau MBR 1. Klik kanan pada Komputer pada desktop dan klik "Urus" 2. Cari "Pengurusan Cakera" dalam "Pengurusan" 3. Masukkan Pengurusan Cakera untuk melihat status umum kami cakera keras, kemudian Bagaimana untuk menyemak mod partition cakera keras saya, klik kanan "Disk 0" dan pilih "Properties" 4. Tukar ke tab "Volume" dalam "Properties", kemudian kita boleh melihat "Disk Partition Form " dan anda boleh melihatnya sebagai Masalah yang berkaitan dengan cakera win10 partition MBR Bagaimana untuk menukar partition MBR kepada partition GPT>

Cara berkongsi butiran hubungan dengan NameDrop: Panduan cara untuk iOS 17

Sep 16, 2023 pm 06:09 PM

Cara berkongsi butiran hubungan dengan NameDrop: Panduan cara untuk iOS 17

Sep 16, 2023 pm 06:09 PM

Dalam iOS 17, terdapat ciri AirDrop baharu yang membolehkan anda bertukar maklumat hubungan dengan seseorang dengan menyentuh dua iPhone. Ia dipanggil NameDrop, dan inilah cara ia berfungsi. Daripada memasukkan nombor orang baharu untuk menghubungi atau menghantar teks kepada mereka, NameDrop membenarkan anda meletakkan iPhone anda berhampiran iPhone mereka untuk bertukar-tukar butiran hubungan supaya mereka mempunyai nombor anda. Meletakkan kedua-dua peranti bersama-sama akan muncul secara automatik antara muka perkongsian kenalan. Mengklik pada pop timbul akan memaparkan maklumat hubungan seseorang dan poster kenalan mereka (anda boleh menyesuaikan dan mengedit foto anda sendiri, juga ciri baharu iOS17). Skrin ini juga termasuk pilihan untuk "Terima Sahaja" atau berkongsi maklumat hubungan anda sendiri sebagai balasan.

Algoritma NeRF paparan tunggal S^3-NeRF menggunakan maklumat berbilang pencahayaan untuk memulihkan geometri pemandangan dan maklumat bahan.

Apr 13, 2023 am 10:58 AM

Algoritma NeRF paparan tunggal S^3-NeRF menggunakan maklumat berbilang pencahayaan untuk memulihkan geometri pemandangan dan maklumat bahan.

Apr 13, 2023 am 10:58 AM

Kerja pembinaan semula 3D imej semasa biasanya menggunakan kaedah pembinaan semula stereo berbilang paparan (Stereo Berbilang Pandangan) yang merakam pemandangan sasaran daripada berbilang sudut pandangan (berbilang paparan) di bawah keadaan pencahayaan semula jadi yang berterusan. Walau bagaimanapun, kaedah ini biasanya menganggap permukaan Lambertian dan mengalami kesukaran memulihkan butiran frekuensi tinggi. Satu lagi pendekatan untuk pembinaan semula pemandangan ialah menggunakan imej yang ditangkap dari sudut pandangan tetap tetapi dengan lampu titik yang berbeza. Kaedah Stereo fotometrik, sebagai contoh, ambil persediaan ini dan gunakan maklumat teduhannya untuk membina semula butiran permukaan objek bukan Lambertian. Walau bagaimanapun, kaedah paparan tunggal sedia ada biasanya menggunakan peta biasa atau peta kedalaman untuk mewakili yang boleh dilihat