Peranti teknologi

Peranti teknologi

AI

AI

Rangkaian saraf binari pertama BNext dengan ketepatan lebih daripada 80% pada ImageNet keluar, perjalanan lima tahun -1 dan +1

Rangkaian saraf binari pertama BNext dengan ketepatan lebih daripada 80% pada ImageNet keluar, perjalanan lima tahun -1 dan +1

Rangkaian saraf binari pertama BNext dengan ketepatan lebih daripada 80% pada ImageNet keluar, perjalanan lima tahun -1 dan +1

Dua tahun lalu, apabila MeliusNet keluar, Machine Heart menerbitkan artikel teknikal "Rangkaian saraf binari mengatasi MobileNet buat kali pertama, - 1 dan + 1 tiga- tahun perjalanan yang sukar ", mengkaji semula sejarah pembangunan BNN. Pada masa itu, XNOR.AI, yang bermula dengan kerja awal BNN XNOR-Net, telah diperoleh oleh Apple Semua orang telah membayangkan sama ada teknologi rangkaian saraf binari berkuasa rendah dan berprestasi tinggi ini tidak lama lagi akan membuka prospek aplikasi yang luas.

Walau bagaimanapun, dalam tempoh dua tahun yang lalu, adalah sukar bagi kami untuk mendapatkan lebih banyak maklumat tentang aplikasi teknologi BNN daripada Apple, yang dengan ketat merahsiakan teknologi, dan tidak ada penampilan dalam akademik atau industri Lain-lain kes aplikasi yang menarik perhatian. Sebaliknya, apabila bilangan peranti terminal meroket, aplikasi dan pasaran AI edge berkembang pesat: dijangkakan 500 hingga 125 bilion peranti edge akan dihasilkan menjelang 2030, dan pasaran pengkomputeran tepi akan melonjak kepada AS$60 bilion. Terdapat beberapa kawasan aplikasi yang popular pada masa ini: AIoT, Metaverse dan peralatan terminal robotik. Industri yang berkaitan sedang mempercepatkan pelaksanaan teknologi Pada masa yang sama, keupayaan AI telah dibenamkan dalam banyak pautan teknikal teras dalam bidang di atas, seperti aplikasi meluas teknologi AI dalam pembinaan semula tiga dimensi, pemampatan video dan masa nyata. persepsi adegan robot. Berdasarkan latar belakang ini, permintaan industri untuk kecekapan tenaga tinggi berasaskan kelebihan, teknologi AI berkuasa rendah, alatan perisian dan pecutan perkakasan telah menjadi semakin mendesak.

Pada masa ini, terdapat dua kesesakan utama yang menyekat penggunaan BNN: pertama, ketidakupayaan untuk mengecilkan jurang ketepatan secara berkesan dengan model pembelajaran mendalam 32-bit tradisional, kedua, kekurangan prestasi pada perkakasan berbeza Pelaksanaan algoritma berprestasi tinggi. Kelajuan dalam kertas pembelajaran mesin selalunya tidak diterjemahkan kepada GPU atau CPU yang anda gunakan. Sebab kedua mungkin timbul daripada sebab pertama BNN tidak dapat mencapai ketepatan yang memuaskan dan oleh itu tidak dapat menarik perhatian meluas daripada pengamal dalam bidang pecutan dan pengoptimuman sistem dan perkakasan. Komuniti algoritma pembelajaran mesin selalunya tidak dapat membangunkan kod perkakasan berprestasi tinggi sendiri. Oleh itu, untuk mencapai ketepatan yang tinggi dan pecutan yang kuat, aplikasi atau pemecut BNN sudah pasti memerlukan kerjasama pembangun dari dua bidang berbeza ini.

Mengapa BNN adalah cekap dari segi pengiraan dan memori

Sebagai contoh, model sistem pengesyoran Meta DLRM menggunakan nombor titik terapung 32-bit untuk menyimpan berat dan parameter pengaktifan, dan model Saiznya lebih kurang 2.2GB. Versi binari model dengan pengurangan kecil dalam ketepatan (

Kelebihan ketara kedua BNN ialah kaedah pengiraan sangat cekap. Ia hanya menggunakan 1 bit, iaitu, dua keadaan, untuk mewakili pembolehubah. Ini bermakna semua operasi boleh diselesaikan hanya dengan operasi bit Dengan bantuan get AND, get XOR dan operasi lain, operasi pendaraban dan penambahan tradisional boleh diganti. Operasi bit adalah unit asas dalam litar Pelajar yang biasa dengan reka bentuk litar harus memahami bahawa mengurangkan luas unit pengiraan pendaraban dan penambahan dan mengurangkan akses memori luar cip adalah cara yang paling berkesan untuk mengurangkan penggunaan kuasa. BNN memfokuskan pada memori dan pengiraan Kesemuanya mempunyai kelebihan unik WRPN [1] menunjukkan bahawa pada FPGA dan ASIC tersuai, BNN boleh mencapai penjimatan kuasa 1000 kali berbanding dengan ketepatan penuh. Kerja yang lebih baru BoolNet [2] menunjukkan reka bentuk struktur BNN yang boleh menggunakan hampir tiada operasi titik terapung dan mengekalkan aliran maklumat binari tulen, yang mencapai penggunaan kuasa yang sangat baik dan pertukaran ketepatan dalam simulasi ASIC.

Apakah rupa BNN pertama dengan ketepatan 80%?

Penyelidik seperti Nianhui Guo dan Haojin Yang dari Institut Kejuruteraan Sistem Komputer Hasso Plattner di Jerman mencadangkan model BNext, menjadi BNN pertama yang mencapai ketepatan klasifikasi top1 melebihi 80% di ImageNet set data. :

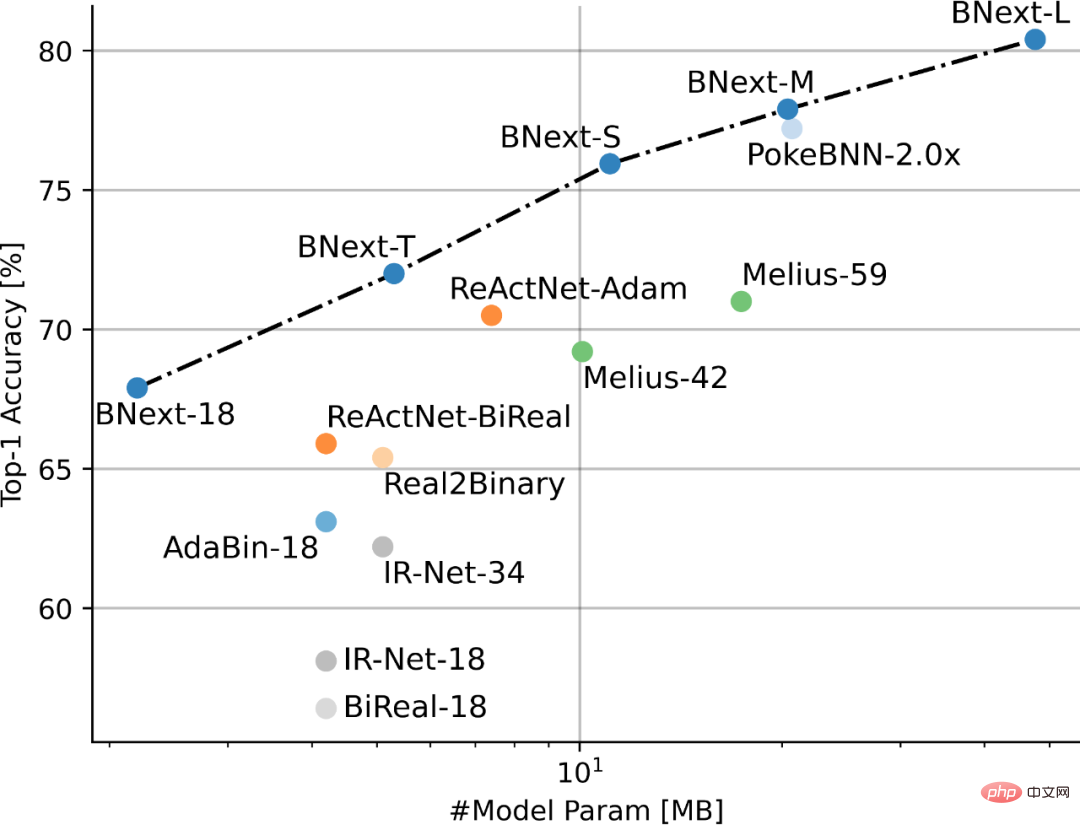

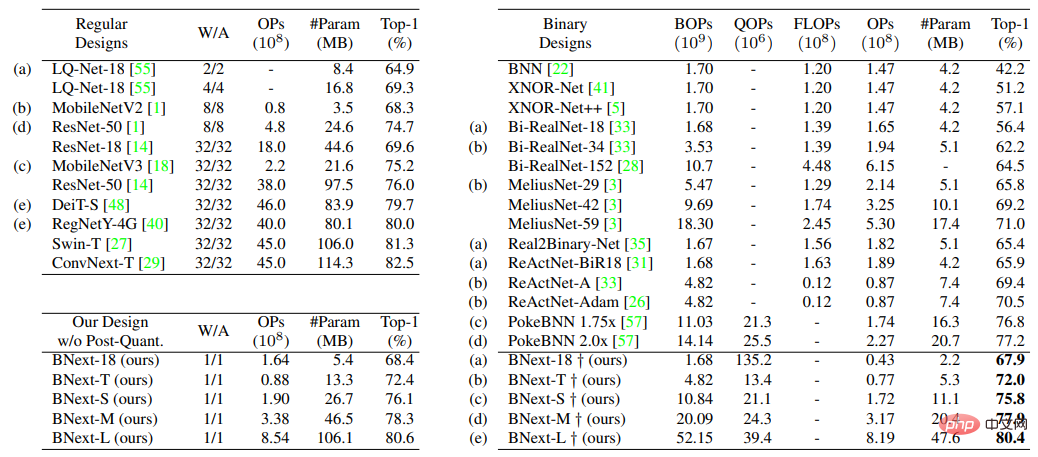

Rajah 1 Perbandingan prestasi SOTA BNN berdasarkan ImageNet

Alamat kertas: https://arxiv.org/pdf/2211.12933.pdf

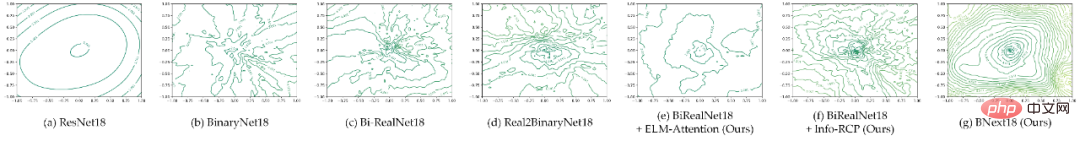

Pengarang Pertama, berdasarkan borang visualisasi Landskap Kehilangan, perbandingan yang mendalam dibuat tentang perbezaan besar dalam keramahan pengoptimuman antara model BNN arus perdana dan model 32-bit (Rajah 2 adalah dicadangkan bahawa Landskap Kehilangan kasar bagi BNN menghalang komuniti penyelidikan semasa menerokai sempadan prestasi BNN. Salah satu sebab utama.

Berdasarkan andaian ini, penulis cuba menggunakan reka bentuk struktur baru untuk meningkatkan keramahan pengoptimuman model BNN, dan membina seni bina rangkaian neural binari dengan Landskap Kerugian yang lebih lancar untuk mengurangkan risiko tinggi Kesukaran mengoptimumkan ketepatan model BNN. Secara khusus, pengarang menekankan bahawa perduaan model sangat mengehadkan corak ciri yang boleh digunakan untuk perambatan ke hadapan, memaksa lilitan binari untuk hanya mengekstrak dan memproses maklumat dalam ruang ciri terhad ini Kesukaran pengoptimuman yang disebabkan olehnya dikurangkan dengan berkesan melalui dua peringkat reka bentuk struktur: (1) membina modul penentukuran ciri lilitan bersebelahan yang fleksibel untuk meningkatkan kebolehsesuaian model kepada perwakilan binari; .

Rajah 2 Perbandingan visualisasi Landskap Kehilangan untuk seni bina BNN popular (perspektif kontur 2D)

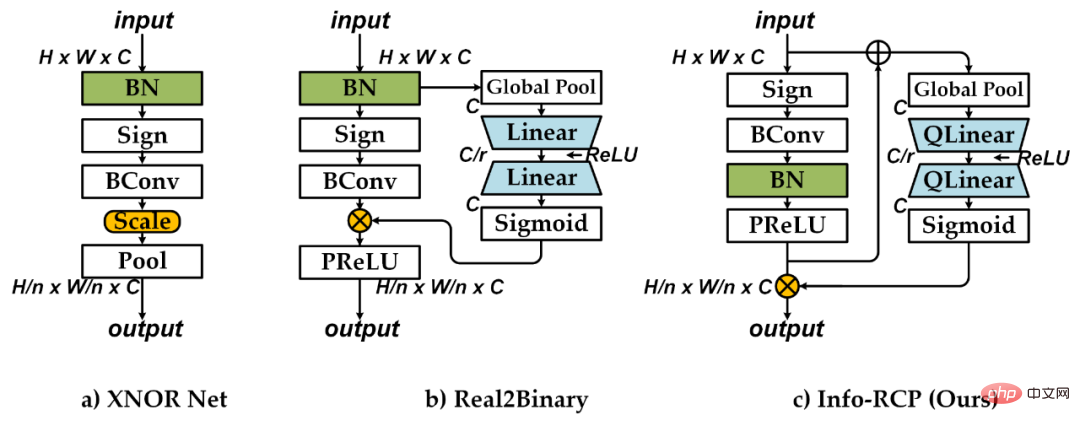

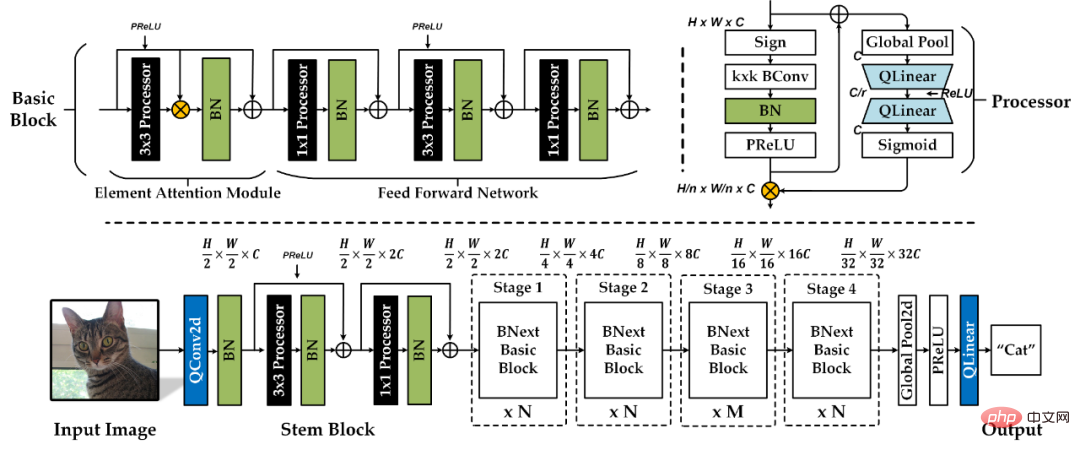

Berdasarkan analisis di atas, penulis mencadangkan BNext, seni bina rangkaian neural binari pertama yang mencapai ketepatan > 80% dalam tugas pengelasan imej ImageNe Reka bentuk seni bina rangkaian khusus ditunjukkan dalam Rajah 4 ditunjukkan. Penulis mula-mula mereka bentuk unit pemprosesan binari asas berdasarkan modul Info-Recoupling (Info-RCP). Untuk menangani masalah kesesakan maklumat antara lilitan bersebelahan, reka bentuk penentukuran awal taburan keluaran lilitan binari diselesaikan dengan memperkenalkan lapisan Normalisasi Batch tambahan dan lapisan PReLU. Kemudian penulis membina reka bentuk penentukuran taburan dinamik kuadratik berdasarkan struktur baki songsang dan struktur cawangan Squeeze-And-Expand. Seperti yang ditunjukkan dalam Rajah 3, berbanding dengan struktur penentukuran Real2Binary tradisional, struktur baki songsang tambahan mempertimbangkan sepenuhnya jurang ciri antara input dan output unit binari, mengelakkan penentukuran pengedaran suboptimum berdasarkan sepenuhnya pada maklumat input. Penentukuran pengedaran dinamik dua peringkat ini dengan berkesan boleh mengurangkan kesukaran pengekstrakan ciri dalam lapisan lilitan binari bersebelahan berikutnya.

Rajah 3 Perbandingan reka bentuk modul konvolusi

Kedua, penulis mencadangkan modul Blok Asas binari yang dipertingkatkan digabungkan dengan Perhatian Element-wise (ELM-Attention). Penulis menyelesaikan pembinaan asas Blok Asas dengan menyusun berbilang modul Info-RCP, dan memperkenalkan Penormalan Batch tambahan dan sambungan baki berterusan kepada setiap modul Info-RCP untuk mengurangkan lagi masalah kesesakan maklumat antara modul Info-RCP yang berbeza. Berdasarkan analisis kesan struktur pintasan pada pengoptimuman model binari, penulis mencadangkan untuk menggunakan cawangan pendaraban matriks Element-wise untuk melaksanakan penentukuran pengedaran pada output modul 3x3 Info-RCP pertama setiap Blok Asas . Mekanisme pemberat perhatian ruang udara tambahan boleh membantu Blok Asas melaksanakan gabungan dan pengedaran maklumat ke hadapan dengan mekanisme yang lebih fleksibel, meningkatkan kelancaran Landskap Kehilangan model. Seperti yang ditunjukkan dalam Rajah 2.e dan Rajah 2.f, reka bentuk modul yang dicadangkan boleh meningkatkan kelicinan Landskap Kehilangan model dengan ketara.

Rajah 4 BNreka bentuk seni bina seterusnya. "Pemproses mewakili modul Info-RCP, "BN" mewakili lapisan Normalisasi Kelompok, "C" mewakili lebar asas model, "N" dan "M" mewakili parameter skala kedalaman peringkat berbeza model.

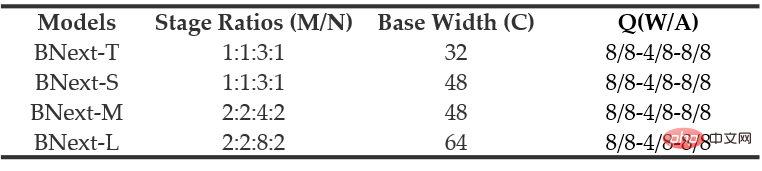

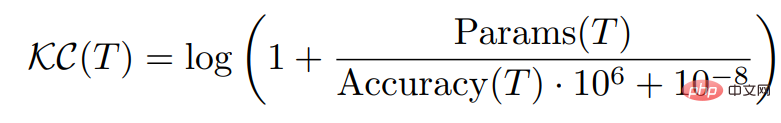

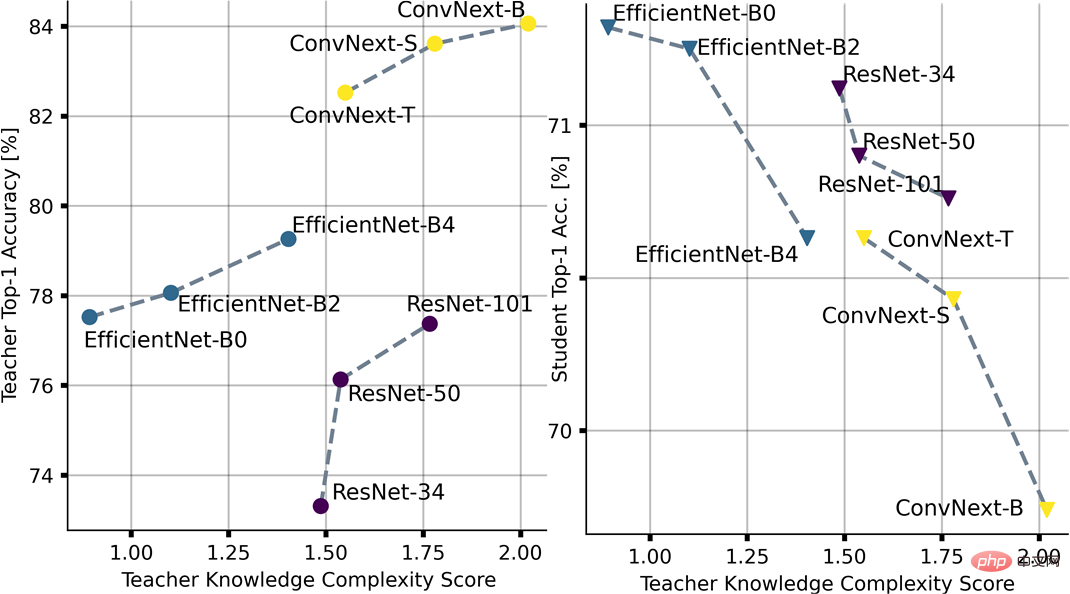

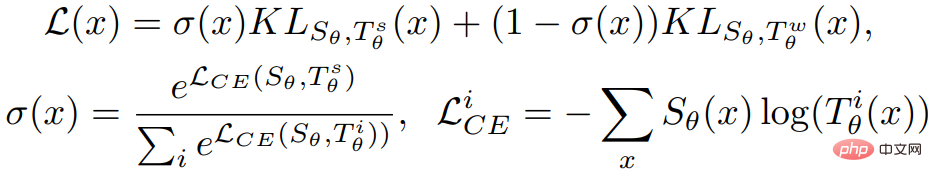

Jadual 1 BNext series “Q” mewakili tetapan lapisan input, SEbranch dan lapisan output. > Pengarang menggabungkan reka bentuk struktur di atas dengan model penanda aras MoboleNetv1 yang popular, dan membina empat siri model BNext kerumitan berbeza (Jadual 1) dengan menukar pekali berkadar kedalaman dan lebar model: BNex-Tiny, BNext - Kecil, BNext-Middle, BNext-Large. Disebabkan Landskap Kerugian yang agak kasar, pengoptimuman model binari semasa secara amnya bergantung pada maklumat penyeliaan yang lebih halus yang disediakan melalui kaedah seperti penyulingan pengetahuan untuk menyingkirkan penumpuan suboptimum yang meluas. Buat pertama kalinya, pengarang BNext mempertimbangkan kemungkinan kesan jurang yang besar dalam taburan ramalan antara model guru dan model pelajar binari semasa proses pengoptimuman, dan menegaskan bahawa pemilihan guru berdasarkan ketepatan model semata-mata akan membawa kepada pembilang. -hasil overfitting pelajar yang intuitif. Untuk menyelesaikan masalah ini, penulis mencadangkan kerumitan pengetahuan (KC) sebagai metrik pemilihan guru baharu, dengan mengambil kira perkaitan antara keberkesanan label lembut keluaran model guru dan kerumitan parameter model guru. Seperti yang ditunjukkan dalam Rajah 5, berdasarkan kerumitan pengetahuan, penulis menjalankan pengukuran kerumitan dan perbandingan siri model ketepatan penuh yang popular seperti ResNet, EfficientNet, dan ConvNext Ranking, digabungkan dengan BNext-T sebagai model pelajar, mengesahkan keberkesanan metrik ini secara awal dan keputusan penarafan digunakan untuk pemilihan model penyulingan pengetahuan dalam eksperimen seterusnya. Rajah 5 Kesan overfitting kontra-intuitif dan kesan kerumitan pengetahuan di bawah pemilihan guru yang berbeza Atas dasar ini, pengarang kertas kerja mempertimbangkan lagi masalah pengoptimuman yang disebabkan oleh jurang pengedaran ramalan awal dalam proses pengoptimuman guru yang kukuh, dan mencadangkan Diversified Consecutive KD. Seperti yang ditunjukkan di bawah, penulis memodulasi fungsi objektif dalam proses pengoptimuman melalui kaedah integrasi pengetahuan gabungan guru kuat dan lemah. Atas dasar ini, strategi peningkatan pengetahuan diperkenalkan lagi, menggunakan berbilang calon guru yang telah ditetapkan untuk menukar guru yang lemah secara sekata semasa proses latihan, membimbing gabungan kerumitan pengetahuan dalam cara kurikulum daripada lemah kepada kuat, dan mengurangkan gangguan Pengoptimuman disebabkan oleh perbezaan. Dari segi teknik pengoptimuman, penulis BNext mempertimbangkan sepenuhnya kemungkinan keuntungan yang dibawa oleh penambahan data dalam pengoptimuman model ketepatan tinggi moden dan menyediakan yang pertama Memandangkan keputusan analisis kemungkinan kesan strategi penambahan data popular sedia ada dalam pengoptimuman model binari, keputusan eksperimen menunjukkan bahawa kaedah penambahan data sedia ada tidak sesuai sepenuhnya untuk pengoptimuman model binari, yang khusus untuk model binari dalam data Dioptimumkan reka bentuk strategi peningkatan menyediakan idea. Berdasarkan reka bentuk seni bina yang dicadangkan dan kaedah pengoptimuman, penulis menjalankan pengesahan kaedah pada tugas pengelasan imej berskala besar ImageNet-1k. Keputusan eksperimen ditunjukkan dalam Rajah 6. Rajah 6 Perbandingan kaedah SOTA BNN berdasarkan ImageNet-1k. Berbanding dengan kaedah sedia ada, BNext-L melonjakkan sempadan prestasi model binari kepada 80.57% buat kali pertama pada ImageNet-1k, mencapai ketepatan 10%+ mengatasi kebanyakan kaedah sedia ada. Berbanding dengan PokeBNN daripada Google, BNext-M adalah 0.7% lebih tinggi dengan parameter yang serupa. Pengarang juga menekankan bahawa pengoptimuman PokeBNN bergantung pada sumber pengkomputeran yang lebih tinggi, seperti Saiz Bacth sehingga 8192 dan TPU 720 Epochs , manakala BNext-L hanya mengulangi 512 Epoch dengan Saiz Kelompok konvensional 512, yang mencerminkan keberkesanan kaedah reka bentuk dan pengoptimuman struktur BNext. Dalam perbandingan berdasarkan model garis dasar yang sama, kedua-dua BNext-T dan BNext-18 telah meningkatkan ketepatan dengan ketara. Berbanding dengan model ketepatan penuh seperti RegNetY-4G (80.0%), BNext-L menunjukkan padanan keupayaan pembelajaran representasi visual sambil hanya menggunakan ruang parameter terhad dan kerumitan pengiraan, yang menjadikannya sesuai untuk penggunaan edge berdasarkan model tugas visual pada pengekstrak ciri model binari menyediakan ruang imaginasi yang kaya. BNext Penulis menyebut dalam kertas kerja bahawa mereka dan rakan usaha sama mereka sedang giat melaksanakan dan mengesahkan seni bina BNN berketepatan tinggi ini pada kecekapan operasi perkakasan GPU, dan merancang untuk berkembang ke platform perkakasan lain yang lebih luas pada masa hadapan. Walau bagaimanapun, pada pendapat editor, masyarakat telah memperoleh semula keyakinan terhadap BNN dan menarik perhatian lebih ramai pakar dalam bidang sistem dan perkakasan Mungkin kepentingan yang lebih penting dalam karya ini adalah untuk membentuk semula imaginasi potensi aplikasi BNN. Dalam jangka panjang, apabila semakin banyak aplikasi berhijrah daripada paradigma pengkomputeran tertumpu awan kepada pengkomputeran tepi terdesentralisasi, bilangan besar peranti tepi pada masa hadapan akan memerlukan teknologi AI, rangka kerja perisian dan platform pengkomputeran perkakasan yang lebih cekap. Walau bagaimanapun, model AI yang paling arus perdana dan seni bina pengkomputeran tidak direka bentuk dan dioptimumkan untuk senario kelebihan. Oleh itu, sehingga jawapan kepada edge AI ditemui, saya percaya bahawa BNN akan sentiasa menjadi pilihan penting yang penuh dengan cabaran teknikal dan potensi besar.

Apa seterusnya?

Atas ialah kandungan terperinci Rangkaian saraf binari pertama BNext dengan ketepatan lebih daripada 80% pada ImageNet keluar, perjalanan lima tahun -1 dan +1. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1377

1377

52

52

Bagaimana untuk memulihkan kenalan yang dipadam pada WeChat (tutorial mudah memberitahu anda cara memulihkan kenalan yang dipadam)

May 01, 2024 pm 12:01 PM

Bagaimana untuk memulihkan kenalan yang dipadam pada WeChat (tutorial mudah memberitahu anda cara memulihkan kenalan yang dipadam)

May 01, 2024 pm 12:01 PM

Malangnya, orang sering memadamkan kenalan tertentu secara tidak sengaja atas sebab tertentu WeChat ialah perisian sosial yang digunakan secara meluas. Untuk membantu pengguna menyelesaikan masalah ini, artikel ini akan memperkenalkan cara mendapatkan semula kenalan yang dipadam dengan cara yang mudah. 1. Fahami mekanisme pemadaman kenalan WeChat Ini memberi kita kemungkinan untuk mendapatkan semula kenalan yang dipadamkan Mekanisme pemadaman kenalan dalam WeChat mengalih keluar mereka daripada buku alamat, tetapi tidak memadamkannya sepenuhnya. 2. Gunakan fungsi "Pemulihan Buku Kenalan" terbina dalam WeChat menyediakan "Pemulihan Buku Kenalan" untuk menjimatkan masa dan tenaga Pengguna boleh mendapatkan semula kenalan yang telah dipadamkan dengan cepat melalui fungsi ini. 3. Masuk ke halaman tetapan WeChat dan klik sudut kanan bawah, buka aplikasi WeChat "Saya" dan klik ikon tetapan di sudut kanan atas untuk memasuki halaman tetapan.

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Bayangkan model kecerdasan buatan yang bukan sahaja mempunyai keupayaan untuk mengatasi pengkomputeran tradisional, tetapi juga mencapai prestasi yang lebih cekap pada kos yang lebih rendah. Ini bukan fiksyen sains, DeepSeek-V2[1], model MoE sumber terbuka paling berkuasa di dunia ada di sini. DeepSeek-V2 ialah gabungan model bahasa pakar (MoE) yang berkuasa dengan ciri-ciri latihan ekonomi dan inferens yang cekap. Ia terdiri daripada 236B parameter, 21B daripadanya digunakan untuk mengaktifkan setiap penanda. Berbanding dengan DeepSeek67B, DeepSeek-V2 mempunyai prestasi yang lebih kukuh, sambil menjimatkan 42.5% kos latihan, mengurangkan cache KV sebanyak 93.3% dan meningkatkan daya pemprosesan penjanaan maksimum kepada 5.76 kali. DeepSeek ialah sebuah syarikat yang meneroka kecerdasan buatan am

Apr 09, 2024 am 11:52 AM

Apr 09, 2024 am 11:52 AM

AI memang mengubah matematik. Baru-baru ini, Tao Zhexuan, yang telah mengambil perhatian terhadap isu ini, telah memajukan keluaran terbaru "Buletin Persatuan Matematik Amerika" (Buletin Persatuan Matematik Amerika). Memfokuskan pada topik "Adakah mesin akan mengubah matematik?", ramai ahli matematik menyatakan pendapat mereka Seluruh proses itu penuh dengan percikan api, tegar dan menarik. Penulis mempunyai barisan yang kuat, termasuk pemenang Fields Medal Akshay Venkatesh, ahli matematik China Zheng Lejun, saintis komputer NYU Ernest Davis dan ramai lagi sarjana terkenal dalam industri. Dunia AI telah berubah secara mendadak Anda tahu, banyak artikel ini telah dihantar setahun yang lalu.

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas secara rasmi memasuki era robot elektrik! Semalam, Atlas hidraulik hanya "menangis" menarik diri daripada peringkat sejarah Hari ini, Boston Dynamics mengumumkan bahawa Atlas elektrik sedang berfungsi. Nampaknya dalam bidang robot humanoid komersial, Boston Dynamics berazam untuk bersaing dengan Tesla. Selepas video baharu itu dikeluarkan, ia telah pun ditonton oleh lebih sejuta orang dalam masa sepuluh jam sahaja. Orang lama pergi dan peranan baru muncul. Ini adalah keperluan sejarah. Tidak dinafikan bahawa tahun ini adalah tahun letupan robot humanoid. Netizen mengulas: Kemajuan robot telah menjadikan majlis pembukaan tahun ini kelihatan seperti manusia, dan tahap kebebasan adalah jauh lebih besar daripada manusia Tetapi adakah ini benar-benar bukan filem seram? Pada permulaan video, Atlas berbaring dengan tenang di atas tanah, seolah-olah terlentang. Apa yang berikut adalah rahang-jatuh

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

Awal bulan ini, penyelidik dari MIT dan institusi lain mencadangkan alternatif yang sangat menjanjikan kepada MLP - KAN. KAN mengatasi MLP dari segi ketepatan dan kebolehtafsiran. Dan ia boleh mengatasi prestasi MLP berjalan dengan bilangan parameter yang lebih besar dengan bilangan parameter yang sangat kecil. Sebagai contoh, penulis menyatakan bahawa mereka menggunakan KAN untuk menghasilkan semula keputusan DeepMind dengan rangkaian yang lebih kecil dan tahap automasi yang lebih tinggi. Khususnya, MLP DeepMind mempunyai kira-kira 300,000 parameter, manakala KAN hanya mempunyai kira-kira 200 parameter. KAN mempunyai asas matematik yang kukuh seperti MLP berdasarkan teorem penghampiran universal, manakala KAN berdasarkan teorem perwakilan Kolmogorov-Arnold. Seperti yang ditunjukkan dalam rajah di bawah, KAN telah

Rahsia penetasan telur naga mudah alih terbongkar (langkah demi langkah untuk mengajar anda cara berjaya menetas telur naga mudah alih)

May 04, 2024 pm 06:01 PM

Rahsia penetasan telur naga mudah alih terbongkar (langkah demi langkah untuk mengajar anda cara berjaya menetas telur naga mudah alih)

May 04, 2024 pm 06:01 PM

Permainan mudah alih telah menjadi sebahagian daripada kehidupan orang ramai dengan perkembangan teknologi. Ia telah menarik perhatian ramai pemain dengan imej telur naga yang comel dan proses penetasan yang menarik, dan salah satu permainan yang telah menarik perhatian ramai ialah versi mudah alih Dragon Egg. Untuk membantu pemain memupuk dan mengembangkan naga mereka sendiri dengan lebih baik dalam permainan, artikel ini akan memperkenalkan kepada anda cara menetas telur naga dalam versi mudah alih. 1. Pilih jenis telur naga yang sesuai Pemain perlu berhati-hati memilih jenis telur naga yang mereka suka dan sesuai dengan diri mereka, berdasarkan pelbagai jenis sifat dan kebolehan telur naga yang disediakan dalam permainan. 2. Tingkatkan tahap mesin pengeraman Pemain perlu meningkatkan tahap mesin pengeraman dengan menyelesaikan tugasan dan mengumpul prop Tahap mesin pengeraman menentukan kelajuan penetasan dan kadar kejayaan penetasan. 3. Kumpul sumber yang diperlukan untuk penetasan Pemain perlu berada dalam permainan

Bagaimana untuk menetapkan saiz fon pada telefon mudah alih (mudah melaraskan saiz fon pada telefon bimbit)

May 07, 2024 pm 03:34 PM

Bagaimana untuk menetapkan saiz fon pada telefon mudah alih (mudah melaraskan saiz fon pada telefon bimbit)

May 07, 2024 pm 03:34 PM

Menetapkan saiz fon telah menjadi keperluan pemperibadian yang penting kerana telefon mudah alih menjadi alat penting dalam kehidupan seharian manusia. Untuk memenuhi keperluan pengguna yang berbeza, artikel ini akan memperkenalkan cara meningkatkan pengalaman penggunaan telefon mudah alih dan melaraskan saiz fon telefon mudah alih melalui operasi mudah. Mengapa anda perlu melaraskan saiz fon telefon mudah alih anda - Melaraskan saiz fon boleh menjadikan teks lebih jelas dan mudah dibaca - Sesuai untuk keperluan membaca pengguna yang berbeza umur - Mudah untuk pengguna yang kurang penglihatan menggunakan saiz fon fungsi tetapan sistem telefon mudah alih - Cara memasukkan antara muka tetapan sistem - Dalam Cari dan masukkan pilihan "Paparan" dalam antara muka tetapan - cari pilihan "Saiz Fon" dan laraskan saiz fon dengan pihak ketiga aplikasi - muat turun dan pasang aplikasi yang menyokong pelarasan saiz fon - buka aplikasi dan masukkan antara muka tetapan yang berkaitan - mengikut individu

Robot Tesla bekerja di kilang, Musk: Tahap kebebasan tangan akan mencapai 22 tahun ini!

May 06, 2024 pm 04:13 PM

Robot Tesla bekerja di kilang, Musk: Tahap kebebasan tangan akan mencapai 22 tahun ini!

May 06, 2024 pm 04:13 PM

Video terbaru robot Tesla Optimus dikeluarkan, dan ia sudah boleh berfungsi di kilang. Pada kelajuan biasa, ia mengisih bateri (bateri 4680 Tesla) seperti ini: Pegawai itu juga mengeluarkan rupanya pada kelajuan 20x - pada "stesen kerja" kecil, memilih dan memilih dan memilih: Kali ini ia dikeluarkan Salah satu sorotan video itu ialah Optimus menyelesaikan kerja ini di kilang, sepenuhnya secara autonomi, tanpa campur tangan manusia sepanjang proses. Dan dari perspektif Optimus, ia juga boleh mengambil dan meletakkan bateri yang bengkok, memfokuskan pada pembetulan ralat automatik: Berkenaan tangan Optimus, saintis NVIDIA Jim Fan memberikan penilaian yang tinggi: Tangan Optimus adalah robot lima jari di dunia paling cerdik. Tangannya bukan sahaja boleh disentuh