Peranti teknologi

Peranti teknologi

AI

AI

Mengenai AGI dan ChatGPT, Stuart Russell dan Zhu Songchun berpendapat demikian

Mengenai AGI dan ChatGPT, Stuart Russell dan Zhu Songchun berpendapat demikian

Mengenai AGI dan ChatGPT, Stuart Russell dan Zhu Songchun berpendapat demikian

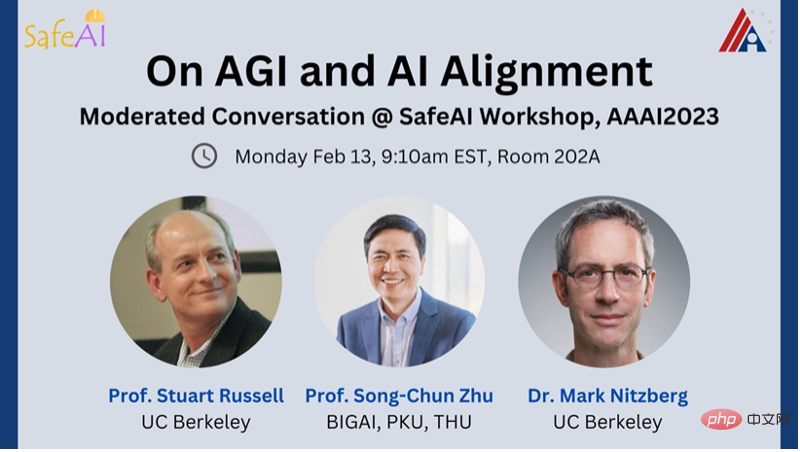

Mark Nitzberg: Hari ini kami berbesar hati untuk menjemput dua pakar terkemuka dalam kecerdasan buatan untuk menyertai seminar SafeAI ini.

Mereka ialah: Stuart Russell, saintis komputer di University of California, Berkeley, pengarah Pusat Kepintaran Buatan Serasi Kelas (CHAI) dan ahli Jawatankuasa Pemandu Makmal Penyelidikan Kepintaran Buatan (BAIR). Naib Pengerusi Jawatankuasa Kecerdasan Buatan dan Robotik Forum Ekonomi Dunia, Fellow AAAS, dan Fellow AAAI.

Zhu Songchun, Presiden Institut Kecerdasan Buatan Am Beijing, Pengerusi Profesor Universiti Peking, Dekan Pusat Pengajian Kepintaran dan Institut Penyelidikan Kepintaran Buatan Universiti Peking, dan Pengerusi Profesor Sains Asas di Universiti Tsinghua.

Mark Nitzberg: Apakah itu "kecerdasan buatan am"? Adakah terdapat ujian yang jelas untuk menentukan bila kami menciptanya?

Stuart Russell: Kecerdasan buatan umum digambarkan mampu menyelesaikan semua tugas yang mampu dilakukan oleh manusia, tetapi ini hanya kenyataan umum. Kami berharap kecerdasan buatan am boleh melakukan perkara yang tidak boleh dilakukan oleh manusia, seperti meringkaskan semua pengetahuan atau mensimulasikan interaksi zarah yang kompleks.

Untuk mengkaji kecerdasan buatan am, kita boleh beralih daripada penanda aras tugas khusus (Tanda Aras) kepada sifat umum persekitaran tugas , seperti pemerhatian separa, jangka panjang, tidak dapat diramalkan, dsb., dan tanya diri anda sama ada anda mempunyai keupayaan untuk menyediakan penyelesaian lengkap untuk sifat ini. Jika kita mempunyai keupayaan ini, kecerdasan buatan am sepatutnya dapat menyelesaikan tugasan yang boleh diselesaikan oleh manusia secara automatik, dan masih mempunyai keupayaan untuk menyelesaikan lebih banyak tugasan. Walaupun terdapat beberapa ujian (seperti BigBench) yang mendakwa menguji keluasan, mereka tidak meliputi tugas yang tidak boleh diakses oleh sistem kecerdasan buatan, seperti "Bolehkah anda mencipta pengesan gelombang graviti?"

Zhu Songchun:Beberapa tahun yang lalu, ramai orang berpendapat bahawa mencapai kecerdasan buatan am adalah matlamat yang tidak boleh dicapai Walau bagaimanapun, populariti ChatGPT baru-baru ini telah membuatkan semua orang penuh dengan jangkaan, dan nampaknya begitu umum kecerdasan buatan berada dalam jangkauan. Apabila saya menubuhkan Beijing Institute of General Artificial Intelligence (BIGAI), sebuah institusi penyelidikan dan pembangunan baharu di China, saya secara khusus memutuskan untuk menggunakan AGI sebagai sebahagian daripada nama institusi untuk membezakannya daripada kecerdasan buatan khusus. Perkataan "Tong" dalam Tongyuan terdiri daripada tiga huruf "A", "G" dan "I". Mengikut sebutan perkataan "tong", kami juga memanggil kecerdasan buatan am TongAI.

Kecerdasan buatan am ialah niat asal dan matlamat utama penyelidikan kecerdasan buatan. Matlamatnya adalah untuk merealisasikan agen pintar am dengan persepsi autonomi, kognisi, membuat keputusan, pembelajaran, pelaksanaan dan keupayaan kerjasama sosial, dan selaras dengan emosi, etika dan konsep moral manusia. Walau bagaimanapun, dalam tempoh 20-30 tahun yang lalu, orang telah menggunakan sejumlah besar data terperingkat untuk menyelesaikan tugasan seperti pengecaman muka, pengesanan sasaran dan terjemahan teks satu demi satu dianggap universal?

Saya percaya terdapat tiga keperluan utama untuk mencapai kecerdasan buatan am. 1) Ejen tujuan am boleh mengendalikan tugas tanpa had , termasuk yang tidak ditakrifkan dalam persekitaran fizikal dan sosial yang kompleks dan dinamik 2) Ejen tujuan am hendaklah Automomous, iaitu ia seharusnya mampu menjana dan menyelesaikan tugasan sendiri seperti manusia; , Kerana tujuannya ditentukan oleh nilai. Sistem pintar didorong oleh seni bina kognitif dengan sistem nilai.

Mark Nitzberg: Adakah anda fikir model bahasa besar (LLM) dan jenis asas lain boleh mencapai kecerdasan buatan am? Kertas kerja baru-baru ini yang ditulis oleh seorang profesor Universiti Stanford mendakwa bahawa model bahasa mungkin mempunyai keadaan mental yang setanding dengan kanak-kanak berumur 9 tahun. Apa pendapat anda tentang kenyataan ini?Zhu Songchun:

Walaupun model bahasa berskala besar telah mencapai beberapa kemajuan yang menakjubkan, jika kita membandingkan tiga piawai di atas, Ia didapati bahawa model bahasa yang besar masih belum memenuhi keperluan untuk kecerdasan buatan am.1) Model bahasa yang besar mempunyai keupayaan terhad dalam memproses tugasan hanya boleh mengendalikan tugasan dalam domain teks dan tidak boleh berinteraksi dengan persekitaran fizikal dan sosial. Ini bermakna model seperti ChatGPT tidak benar-benar "memahami" maksud bahasa kerana mereka tidak mempunyai badan untuk mengalami ruang fizikal. Ahli falsafah Cina telah lama mengiktiraf konsep "kesatuan ilmu dan tindakan", iaitu "pengetahuan" manusia tentang dunia adalah berdasarkan "tindakan". Ini juga merupakan kunci kepada sama ada kecerdasan am benar-benar boleh memasuki adegan fizikal dan masyarakat manusia. Hanya apabila agen buatan diletakkan di dunia fizikal sebenar dan masyarakat manusia, mereka boleh benar-benar memahami dan mempelajari hubungan fizikal antara perkara di dunia nyata dan hubungan sosial antara agen pintar yang berbeza, dengan itu mencapai "perpaduan pengetahuan dan tindakan." 2) Model bahasa yang besar juga tidak bersifat autonomi. Kepintaran yang benar-benar autonomi sepatutnya serupa dengan "kecerdasan gagak." Gagak boleh menyelesaikan tugasan yang lebih pintar daripada sistem AI semasa yang belum mempunyai potensi ini. 3) Walaupun ChatGPT telah dilatih secara besar-besaran mengenai korpus data teks yang berbeza, termasuk teks dengan nilai kemanusiaan tersirat, ia tidak dilengkapi untuk memahami nilai kemanusiaan atau berkomunikasi dengan nilai kemanusiaan. Keupayaan untuk kekal konsisten, kekurangan apa yang dikenali sebagai kompas moral. Mengenai penemuan kertas bahawa model bahasa mungkin mempunyai keadaan mental yang setara dengan kanak-kanak berumur 9 tahun, saya rasa ini agak keterlaluan ujian eksperimen yang GPT-3.5 Boleh menjawab 93% soalan dengan betul iaitu setara dengan tahap kanak-kanak berumur 9 tahun. Tetapi jika beberapa mesin berasaskan peraturan boleh lulus ujian yang sama, bolehkah kita mengatakan bahawa mesin ini mempunyai teori fikiran? Walaupun GPT boleh lulus ujian ini, ia hanya mencerminkan keupayaannya untuk lulus teori ujian minda ini, dan ia tidak bermakna ia mempunyai teori minda Pada masa yang sama, kita juga harus merenung amalan menggunakan tradisional ini tugas ujian untuk mengesahkan sama ada mesin telah membangunkan teori minda Adakah ia ketat dan undang-undang? Mengapa mesin boleh menyelesaikan tugas ini tanpa teori fikiran? Stuart Russell: Dalam kertas kerja 1948, Turing menimbulkan masalah menjana tindakan pintar daripada jadual carian gergasi. Ini tidak praktikal, kerana jika anda ingin menjana 2000 perkataan, anda memerlukan jadual dengan kira-kira 10^10000 entri untuk menyimpan semua urutan yang mungkin, seperti saiz tetingkap model bahasa besar yang menggunakan transformer. Sistem sedemikian mungkin kelihatan sangat pintar, tetapi sebenarnya ia tidak mempunyai keadaan mental dan proses penaakulan (maksud asas sistem kecerdasan buatan klasik). Malah, tiada bukti bahawa ChatGPT mempunyai sebarang keadaan mental, apatah lagi yang serupa dengan kanak-kanak berumur 9 tahun. LLM tidak mempunyai keupayaan untuk belajar dan menyatakan generalisasi yang kompleks, itulah sebabnya mereka memerlukan sejumlah besar data teks, jauh lebih banyak daripada mana-mana kanak-kanak berumur 9 tahun boleh mengendalikan, dan mereka masih menghasilkan ralat. Ini seperti program permainan catur yang mengiktiraf urutan pergerakan yang serupa daripada permainan peringkat induk sebelumnya (seperti d4, c6, Nc3, dll.) dan kemudian mengeluarkan langkah seterusnya dalam urutan itu. Walaupun anda akan menganggapnya sebagai pemain catur mahir pada kebanyakan masa, ia kadang-kadang akan melakukan gerakan yang menyalahi undang-undang kerana ia tidak mengetahui papan, kepingan, atau matlamatnya adalah untuk menyerang lawan. Sedikit sebanyak, ChatGPT adalah seperti ini dalam setiap bidang. Kami tidak pasti ada mana-mana kawasan yang benar-benar difahami. Sesetengah ralat mungkin diperbaiki, tetapi ini seperti membetulkan ralat dalam jadual nilai untuk fungsi logaritma. Jika seseorang hanya memahami "log" bermaksud "nilai dalam jadual di halaman 17", membetulkan kesilapan menaip tidak akan menyelesaikan masalah. Jadual ini belum lagi merangkumi maksud dan definisi "logaritma", jadi ia tidak boleh disimpulkan sama sekali. Memperluas saiz jadual dengan lebih banyak data tidak menyelesaikan punca masalah. Mark Nitzberg: Stuart, anda adalah salah seorang yang pertama memberi amaran kepada kami tentang risiko kewujudan kecerdasan buatan am, memikirkan ia seperti tenaga nuklear. Mengapa anda fikir begitu? Bagaimanakah kita boleh mencegah perkara ini? Matsuzumi, apakah risiko daripada kecerdasan buatan yang paling anda bimbangkan? Stuart Russell: Malah, Turing adalah antara orang pertama yang memberi amaran. Beliau berkata pada tahun 1951: "Apabila mesin mula berfikir, ia akan segera mengatasi kita. Oleh itu, pada satu ketika, kita harus menjangkakan bahawa mesin itu akan dapat dikuasai kerana apabila kecerdasan yang lebih berkuasa daripada manusia muncul, manusia akan segera Sukar untuk mengekalkan kuasa, terutamanya apabila ejen ini mempunyai matlamat yang salah atau tidak lengkap. Sekiranya sesiapa yang berpendapat adalah membimbangkan untuk mempertimbangkan risiko ini sekarang, anda boleh bertanya terus kepada mereka: Bagaimanakah anda mengekalkan kuasa selama-lamanya dalam menghadapi kecerdasan yang lebih berkuasa daripada manusia? Saya suka mendengar jawapan mereka. Tambahan pula, dalam bidang kecerdasan buatan, masih terdapat segelintir pihak yang cuba mengelak isu tersebut dan menafikan kebolehcapaian AGI tanpa memberikan sebarang bukti. Akta Kepintaran Buatan EU mentakrifkan sistem kecerdasan buatan standard yang boleh mencapai matlamat yang ditentukan oleh manusia. Saya diberitahu bahawa piawaian ini datang daripada OECD, dan orang OECD memberitahu saya bahawa ia datang daripada versi buku teks saya yang lebih awal. Sekarang, saya rasa takrifan sistem AI standard ini pada asasnya cacat kerana kita tidak boleh tepat sepenuhnya tentang perkara yang kita mahu AI lakukan di dunia nyata, dan kita juga tidak boleh menerangkan dengan tepat apa yang kita mahu AI lakukan lakukan di dunia sebenar. Bagaimana rupa masa depan. Sistem AI yang mengejar matlamat yang salah akan membawa masa depan yang tidak kita inginkan. Sistem pengesyoran dalam media sosial memberikan contoh - sistem pengesyor cuba memaksimumkan kadar klik lalu atau penglibatan, dan mereka telah belajar untuk melakukan ini dengan memanipulasi manusia, Mengubah manusia menjadi lebih mudah diramal dan rupa-rupanya versi mereka yang lebih ekstrem melalui satu siri gesaan. Menjadikan AI "lebih baik" hanya akan memburukkan hasil manusia. Sebaliknya, kita perlu membina sistem AI yang 1) hanya bertujuan untuk faedah manusia dan 2) menjelaskan bahawa mereka tidak tahu apa maksudnya. Memandangkan AI tidak memahami maksud sebenar kepentingan manusia, ia mesti kekal tidak pasti tentang keutamaan manusia untuk memastikan kita mengekalkan kawalan ke atasnya . Mesin sepatutnya boleh ditutup apabila mereka tidak pasti dengan pilihan manusia. Apabila tiada lagi ketidakpastian tentang matlamat AI, manusialah yang membuat kesilapan, dan mesin tidak lagi boleh dimatikan. Zhu Songchun: Jika kecerdasan buatan umum menjadi realiti, ia mungkin mengancam kewujudan manusia dalam jangka masa panjang. Kita boleh menyimpulkan dengan melihat kembali sejarah panjang evolusi kecerdasan bahawa kelahiran kecerdasan buatan umum hampir tidak dapat dielakkan. Penyelidikan saintifik moden menunjukkan bahawa kehidupan di bumi sentiasa berkembang, daripada bahan bukan organik kepada bahan organik, sel tunggal, organisma berbilang sel, kepada tumbuhan, haiwan, dan akhirnya kepada manusia makhluk. Ini mendedahkan bahawa terdapat proses evolusi yang berterusan daripada "fizikal" kepada "pintar". Daripada objek tidak bernyawa kepada kecerdasan hidup, di manakah sempadannya? Soalan ini sangat penting kerana ia adalah tentang bagaimana untuk memahami dan mentakrifkan "agen pintar" yang akan wujud bersama kita dalam masyarakat masa depan saya fikir jawapan ini berkaitan dengan "darjah kehidupan", dari bentuk kehidupan yang tidak bernyawa kepada agen pintar yang kompleks. "Ijazah kehidupan" "Kecerdasan" semakin besar dan semakin besar, dan "kecerdasan" semakin kompleks Ini adalah spektrum yang berterusan spektrum ini juga menunjukkan bahawa kecerdasan am boleh mengatasi manusia pada masa hadapan. Untuk mengelakkan kecerdasan buatan am masa hadapan daripada membawa ancaman kepada manusia, kita boleh secara beransur-ansur meliberalisasikan ruang keupayaan dan ruang nilai kecerdasan am. Sama seperti ketika kita berhadapan dengan robot, kita mula-mula menguncinya dalam "sangkar" dan perlahan-lahan membuka kebenarannya Kini, kenderaan tanpa pemandu telah muncul di bahagian jalan tertentu. Mula-mula kita boleh mengehadkan kesempatan dan ruang tindakan yang berkenaan sistem kecerdasan buatan kepada kawasan tertentu. Apabila kepercayaan kami terhadap mesin meningkat, dan selepas mengesahkan bahawa sistem AI selamat dan boleh dikawal, kami akan memberi mereka lebih banyak ruang secara beransur-ansur. Selain itu, kita harus menggalakkan ketelusan dalam proses membuat keputusan algoritma. Jika kita boleh secara eksplisit mewakili seni bina kognitif kecerdasan buatan am, supaya kita tahu cara ia berfungsi, kita boleh mengawalnya dengan lebih baik. Mark Nitzberg: Stuart, dalam kerja penyelidikan anda, apakah arah yang boleh dianggap sebagai penyelidikan penjajaran? Stuart Russell: Matlamat teras kami di CHAI adalah untuk mencapai visi di atas, iaitu untuk membina sistem kecerdasan buatan yang boleh mengendalikan ketidakpastian sasaran . Kaedah sedia ada, mungkin kecuali pembelajaran tiruan, semuanya menganggap matlamat tetap yang diketahui untuk sistem kecerdasan buatan terlebih dahulu, jadi kaedah ini mungkin perlu direka bentuk semula. Ringkasnya, kami cuba mensimulasikan sistem di mana berbilang orang dan berbilang mesin berinteraksi. Memandangkan setiap orang mempunyai pilihan mereka sendiri, tetapi mesin boleh mempengaruhi ramai orang, kami mentakrifkan fungsi utiliti mesin sebagai jumlah fungsi utiliti orang. Namun, kami menghadapi tiga masalah. Soalan pertama ialah bagaimana untuk mengagregat keutamaan orang yang berbeza supaya mesin dapat memahami dan memenuhi keperluan kebanyakan orang. Telah dicadangkan bahawa penambahan mungkin merupakan fungsi pengagregatan yang baik kerana setiap orang mempunyai wajaran yang sama dan mempunyai rasa bentuk yang baik, yang ditunjukkan dengan baik dalam kerja ahli ekonomi John Harsanyi dan lain-lain. Tetapi mesti ada perspektif lain. Persoalan kedua ialah bagaimana kita mencirikan kekayaan struktur keutamaan, iaitu susunan pengagihan ke atas semua kemungkinan masa hadapan alam semesta, ini adalah sangat kompleks Struktur data tidak diwakili secara eksplisit dalam otak manusia atau dalam mesin. Oleh itu, kita memerlukan cara untuk mengisih, mengurai dan menggabungkan pilihan dengan cekap. Pada masa ini terdapat beberapa percubaan penyelidikan AI untuk menggunakan apa yang dipanggil "jaringan CP" untuk mewakili beberapa fungsi utiliti yang kompleks Cara CP Nets menguraikan utiliti berbilang atribut fungsi adalah serupa dengan rangkaian Bayesian menguraikan model kebarangkalian multivariat kompleks dengan cara yang sama. Walau bagaimanapun, AI tidak benar-benar mengkaji kandungan kebahagiaan manusia, yang mengejutkan memandangkan dakwaan bidang itu untuk membantu manusia. Memang terdapat komuniti akademik yang mengkaji kesejahteraan manusia dalam bidang seperti ekonomi, sosiologi, pembangunan, dll. yang cenderung untuk menyusun senarai faktor seperti kesihatan, keselamatan, perumahan, makanan, dll. Senarai ini direka terutamanya untuk menyampaikan keutamaan kepada selebihnya kemanusiaan dan dasar awam, mungkin tidak menangkap banyak pilihan "jelas" yang tidak dinyatakan, seperti "ingin menjadi berkemampuan." Untuk pengetahuan saya, penyelidik ini belum lagi membangunkan teori saintifik untuk meramalkan tingkah laku manusia, tetapi untuk AI kita memerlukan struktur keutamaan manusia yang lengkap, termasuk semua kemungkinan pilihan yang tidak dinyatakan jika kita telah terlepas apa-apa Sesuatu yang penting yang mungkin menyebabkan masalah. Soalan ketiga ialah bagaimana untuk membuat kesimpulan keutamaan daripada tingkah laku manusia dan mencirikan keplastikan pilihan manusia. Jika pilihan berubah dari semasa ke semasa, AI bekerja untuk siapa – anda hari ini atau anda esok? Kami tidak mahu kecerdasan buatan mengubah pilihan kami untuk mematuhi keadaan dunia yang mudah dicapai, yang akan menyebabkan dunia kehilangan kepelbagaian. Sebagai tambahan kepada soalan kajian asas ini, kami juga berfikir tentang cara membina semula secara lebih luas semua andaian bahawa sistem kecerdasan buatan diberikan pengetahuan penuh terlebih dahulu Teknik kecerdasan buatan yang disasarkan (algoritma carian, algoritma perancangan, algoritma pengaturcaraan dinamik, pembelajaran pengukuhan, dsb.). Atribut utama sistem baharu ialah aliran maklumat keutamaan daripada manusia ke mesin semasa sistem sedang berjalan. Ini adalah perkara biasa di dunia nyata. Sebagai contoh, kami meminta pemandu teksi untuk "bawa kami ke lapangan terbang." Ini sebenarnya matlamat yang lebih luas daripada matlamat sebenar kita. Apabila kami berada satu batu jauhnya pemandu bertanya kepada kami terminal mana yang kami perlukan. Apabila kami semakin hampir, pemandu mungkin bertanya syarikat penerbangan mana yang akan membawa kami ke pintu pagar yang betul. (Tetapi bukan berapa milimeter dari pintu!) Jadi kita perlu menentukan bentuk ketidakpastian dan pemindahan keutamaan yang paling sesuai untuk kelas algoritma tertentu sebagai contoh, algoritma carian menggunakan fungsi kos, jadi mesin boleh menganggap had pada fungsi itu, dan memperhalusi had dengan bertanya kepada manusia antara dua urutan tindakan yang lebih sesuai. Secara amnya, mesin sentiasa mempunyai sejumlah besar ketidakpastian tentang keutamaan manusia; atas sebab ini, saya fikir istilah "penjajaran" yang sering digunakan dalam bidang ini boleh mengelirukan, Kerana orang cenderung untuk berfikir ia bermaksud "selaraskan sepenuhnya pilihan mesin dan manusia, kemudian pilih apa yang perlu dilakukan". Itu mungkin sebenarnya tidak berlaku. Mark Nitzberg: Matsuzumi, sila perkenalkan penyelidikan penjajaran nilai yang telah anda lakukan. Zhu Songchun: Apabila bercakap tentang penjajaran nilai, kita mesti membincangkan "nilai" dahulu. Pelbagai tingkah laku pintar orang didorong oleh nilai, dan orang ramai boleh memahami dan mempelajari nilai dengan cepat. Sebagai contoh, apabila anda duduk di atas kerusi, kita boleh melihat keadaan keseimbangan melalui analisis daya sentuhan antara kerusi dan badan, dengan itu secara tersirat membuat kesimpulan nilai "keselesaan". Nilai ini mungkin tidak diterangkan dengan tepat dalam perkataan, tetapi ia boleh dinyatakan dengan berinteraksi dengan kerusi. Kita juga boleh belajar tentang nilai estetik orang melalui cara mereka melipat pakaian mereka. Di samping itu, saya berpendapat bahawa sistem nilai mempunyai set perwakilan bersatu, dan kekayaan keutamaan semasa adalah disebabkan oleh pemetaan nilai bersatu pada keadaan yang berbeza. Nilai kami akan berubah bergantung pada keadaan Contohnya, bas tiba di perhentian Jika anda sedang menunggu bas, anda mungkin mahu bas itu tinggal lebih lama anda masuk; manakala jika anda berada di dalam kereta, anda mungkin mahu pintu ditutup dengan segera. Sistem AI mesti dapat menyesuaikan diri dengan cepat kepada perubahan dalam pilihan kita, jadi seni bina kognitif dipacu nilai adalah penting untuk AI. Untuk mencapai kecerdasan umum pada tahap kognitif manusia, kami memasukkan unsur penjajaran nilai dalam penyelidikan BIGAI kami dan membina sistem interaksi manusia-komputer yang mengandungi empat penjajaran. Penjajaran pertama ialah perwakilan bersama, termasuk pemahaman bersama tentang dunia. Penjajaran kedua ialah pengetahuan teras yang dikongsi, seperti akal fizik, rantai sebab, logik, dsb. Penjajaran ketiga ialah norma sosial yang dikongsi, yang menetapkan bahawa AI harus mengikut norma masyarakat manusia dan mengekalkan tingkah laku yang sesuai. Penjajaran keempat ialah nilai bersama yang AI perlu diselaraskan dengan prinsip etika manusia. Kami menerbitkan kajian penjajaran nilai manusia-robot Dwiarah masa nyata. Penyelidikan ini mencadangkan sistem kecerdasan buatan yang boleh dijelaskan. Dalam sistem ini, sekumpulan robot membuat kesimpulan matlamat nilai pengguna melalui interaksi masa nyata dengan pengguna dan maklum balas pengguna, dan pada masa yang sama menyampaikan proses membuat keputusannya kepada pengguna melalui "penjelasan" supaya pengguna memahami nilai asas untuk penghakiman robot. Selain itu, sistem menjana penjelasan yang lebih mudah difahami oleh pengguna dengan membuat kesimpulan keutamaan nilai intrinsik pengguna dan meramalkan cara terbaik untuk menerangkan. Mark Nitzberg: Apakah ciri-ciri sistem AI yang membawa kita untuk membuat kesimpulan bahawa ia tidak akan membawa kepada kecerdasan buatan am? Zhu Songchun: Bagaimanakah kita menilai sama ada AI ialah kecerdasan buatan am Salah satu faktor penting ialah sejauh mana kita mempercayainya? Terdapat dua tahap kepercayaan: satu ialah kepercayaan terhadap keupayaan AI, dan satu lagi ialah kepercayaan sama ada AI bermanfaat kepada emosi dan nilai manusia. Sebagai contoh, sistem AI hari ini boleh mengecam imej dengan sangat baik, tetapi untuk membina kepercayaan, ia mesti boleh dijelaskan dan difahami. Sesetengah teknologi sangat berkuasa, tetapi jika ia tidak dapat dijelaskan, ia akan dianggap tidak boleh dipercayai. Ini amat penting dalam bidang seperti senjata atau sistem penerbangan, di mana kos melakukan kesilapan adalah teruk. Dalam kes ini, dimensi emosi kepercayaan adalah lebih penting, dan AI perlu menjelaskan cara mereka membuat keputusan untuk dipercayai oleh manusia. Oleh itu, kita perlu mempertingkatkan persefahaman bersama melalui lelaran, komunikasi dan kerjasama antara manusia dan mesin, dan kemudian mencapai kata sepakat dan menjana "Justified Trust". Berfikir lebih lanjut, bertanya apakah kecerdasan buatan am pada asasnya bertanya apakah itu "manusia"? Semua orang adalah ejen am. Kami mencadangkan teori didorong sistem dwi UV untuk menerangkan kecerdasan buatan am. Sistem U ialah fungsi tenaga berpotensi, termasuk undang-undang fizikal objektif dan norma sosial yang dikuasai oleh ejen sistem V merangkumi koleksi fungsi nilai ejen Dengan merujuk kepada teori hierarki keperluan dan penyelidikan dalam psikologi perkembangan, kami kehendak Nilai dikategorikan secara meluas. Berdasarkan sistem dwi UV, kami cuba menilai tahap pembangunan kecerdasan buatan umum dan membentuk piawaian yang berbeza dari L1 hingga L5 Sistem ujian ini akan dikeluarkan tahun ini. Stuart Russell: Sistem AI semasa tidak universal kerana litar tidak menangkap kesejagatan dengan baik. Kami telah melihat ini dalam cara model bahasa besar mengalami kesukaran mempelajari peraturan asas aritmetik. Penyelidikan terbaru kami mendapati bahawa walaupun berjuta-juta contoh, sistem kecerdasan buatan Go yang sebelum ini telah mengalahkan manusia tidak dapat memahami dengan betul konsep "naga besar" dan "hidup atau mati kami, sebagai penyelidik pemain Go amatur, telah membangunkan strategi , mengalahkan program Go. Jika kita yakin kecerdasan buatan akan memberi manfaat kepada manusia, maka kita perlu tahu bagaimana ia berfungsi. Kami memerlukan untuk membina sistem kecerdasan buatan pada substrat yang boleh digubah secara semantik yang disokong oleh logik eksplisit dan teori kebarangkalian untuk berfungsi sebagai asas yang baik , untuk mencapai kecerdasan buatan am pada masa hadapan. Satu cara yang mungkin untuk mencipta sistem sedemikian ialah pengaturcaraan kemungkinan, sesuatu yang kami di CHAI baru-baru ini sedang mencari untuk meneroka. Saya digalakkan untuk melihat Matsuzumi meneroka arah yang sama dengan BIGAI.

Atas ialah kandungan terperinci Mengenai AGI dan ChatGPT, Stuart Russell dan Zhu Songchun berpendapat demikian. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

Bytedance Cutting melancarkan keahlian super SVIP: 499 yuan untuk langganan tahunan berterusan, menyediakan pelbagai fungsi AI

Jun 28, 2024 am 03:51 AM

Bytedance Cutting melancarkan keahlian super SVIP: 499 yuan untuk langganan tahunan berterusan, menyediakan pelbagai fungsi AI

Jun 28, 2024 am 03:51 AM

Laman web ini melaporkan pada 27 Jun bahawa Jianying ialah perisian penyuntingan video yang dibangunkan oleh FaceMeng Technology, anak syarikat ByteDance Ia bergantung pada platform Douyin dan pada asasnya menghasilkan kandungan video pendek untuk pengguna platform tersebut Windows , MacOS dan sistem pengendalian lain. Jianying secara rasmi mengumumkan peningkatan sistem keahliannya dan melancarkan SVIP baharu, yang merangkumi pelbagai teknologi hitam AI, seperti terjemahan pintar, penonjolan pintar, pembungkusan pintar, sintesis manusia digital, dsb. Dari segi harga, yuran bulanan untuk keratan SVIP ialah 79 yuan, yuran tahunan ialah 599 yuan (nota di laman web ini: bersamaan dengan 49.9 yuan sebulan), langganan bulanan berterusan ialah 59 yuan sebulan, dan langganan tahunan berterusan ialah 499 yuan setahun (bersamaan dengan 41.6 yuan sebulan) . Di samping itu, pegawai yang dipotong juga menyatakan bahawa untuk meningkatkan pengalaman pengguna, mereka yang telah melanggan VIP asal

Pembantu pengekodan AI yang ditambah konteks menggunakan Rag dan Sem-Rag

Jun 10, 2024 am 11:08 AM

Pembantu pengekodan AI yang ditambah konteks menggunakan Rag dan Sem-Rag

Jun 10, 2024 am 11:08 AM

Tingkatkan produktiviti, kecekapan dan ketepatan pembangun dengan menggabungkan penjanaan dipertingkatkan semula dan memori semantik ke dalam pembantu pengekodan AI. Diterjemah daripada EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, pengarang JanakiramMSV. Walaupun pembantu pengaturcaraan AI asas secara semulajadi membantu, mereka sering gagal memberikan cadangan kod yang paling relevan dan betul kerana mereka bergantung pada pemahaman umum bahasa perisian dan corak penulisan perisian yang paling biasa. Kod yang dijana oleh pembantu pengekodan ini sesuai untuk menyelesaikan masalah yang mereka bertanggungjawab untuk menyelesaikannya, tetapi selalunya tidak mematuhi piawaian pengekodan, konvensyen dan gaya pasukan individu. Ini selalunya menghasilkan cadangan yang perlu diubah suai atau diperhalusi agar kod itu diterima ke dalam aplikasi

Tujuh Soalan Temuduga Teknikal GenAI & LLM yang Cool

Jun 07, 2024 am 10:06 AM

Tujuh Soalan Temuduga Teknikal GenAI & LLM yang Cool

Jun 07, 2024 am 10:06 AM

Untuk mengetahui lebih lanjut tentang AIGC, sila layari: 51CTOAI.x Komuniti https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou berbeza daripada bank soalan tradisional yang boleh dilihat di mana-mana sahaja di Internet memerlukan pemikiran di luar kotak. Model Bahasa Besar (LLM) semakin penting dalam bidang sains data, kecerdasan buatan generatif (GenAI) dan kecerdasan buatan. Algoritma kompleks ini meningkatkan kemahiran manusia dan memacu kecekapan dan inovasi dalam banyak industri, menjadi kunci kepada syarikat untuk kekal berdaya saing. LLM mempunyai pelbagai aplikasi Ia boleh digunakan dalam bidang seperti pemprosesan bahasa semula jadi, penjanaan teks, pengecaman pertuturan dan sistem pengesyoran. Dengan belajar daripada sejumlah besar data, LLM dapat menjana teks

Bolehkah penalaan halus benar-benar membolehkan LLM mempelajari perkara baharu: memperkenalkan pengetahuan baharu boleh menjadikan model menghasilkan lebih banyak halusinasi

Jun 11, 2024 pm 03:57 PM

Bolehkah penalaan halus benar-benar membolehkan LLM mempelajari perkara baharu: memperkenalkan pengetahuan baharu boleh menjadikan model menghasilkan lebih banyak halusinasi

Jun 11, 2024 pm 03:57 PM

Model Bahasa Besar (LLM) dilatih pada pangkalan data teks yang besar, di mana mereka memperoleh sejumlah besar pengetahuan dunia sebenar. Pengetahuan ini dibenamkan ke dalam parameter mereka dan kemudiannya boleh digunakan apabila diperlukan. Pengetahuan tentang model ini "diperbaharui" pada akhir latihan. Pada akhir pra-latihan, model sebenarnya berhenti belajar. Selaraskan atau perhalusi model untuk mempelajari cara memanfaatkan pengetahuan ini dan bertindak balas dengan lebih semula jadi kepada soalan pengguna. Tetapi kadangkala pengetahuan model tidak mencukupi, dan walaupun model boleh mengakses kandungan luaran melalui RAG, ia dianggap berfaedah untuk menyesuaikan model kepada domain baharu melalui penalaan halus. Penalaan halus ini dilakukan menggunakan input daripada anotasi manusia atau ciptaan LLM lain, di mana model menemui pengetahuan dunia sebenar tambahan dan menyepadukannya

Lima sekolah pembelajaran mesin yang anda tidak tahu

Jun 05, 2024 pm 08:51 PM

Lima sekolah pembelajaran mesin yang anda tidak tahu

Jun 05, 2024 pm 08:51 PM

Pembelajaran mesin ialah cabang penting kecerdasan buatan yang memberikan komputer keupayaan untuk belajar daripada data dan meningkatkan keupayaan mereka tanpa diprogramkan secara eksplisit. Pembelajaran mesin mempunyai pelbagai aplikasi dalam pelbagai bidang, daripada pengecaman imej dan pemprosesan bahasa semula jadi kepada sistem pengesyoran dan pengesanan penipuan, dan ia mengubah cara hidup kita. Terdapat banyak kaedah dan teori yang berbeza dalam bidang pembelajaran mesin, antaranya lima kaedah yang paling berpengaruh dipanggil "Lima Sekolah Pembelajaran Mesin". Lima sekolah utama ialah sekolah simbolik, sekolah sambungan, sekolah evolusi, sekolah Bayesian dan sekolah analogi. 1. Simbolisme, juga dikenali sebagai simbolisme, menekankan penggunaan simbol untuk penaakulan logik dan ekspresi pengetahuan. Aliran pemikiran ini percaya bahawa pembelajaran adalah proses penolakan terbalik, melalui sedia ada

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Editor |ScienceAI Question Answering (QA) set data memainkan peranan penting dalam mempromosikan penyelidikan pemprosesan bahasa semula jadi (NLP). Set data QA berkualiti tinggi bukan sahaja boleh digunakan untuk memperhalusi model, tetapi juga menilai dengan berkesan keupayaan model bahasa besar (LLM), terutamanya keupayaan untuk memahami dan menaakul tentang pengetahuan saintifik. Walaupun pada masa ini terdapat banyak set data QA saintifik yang meliputi bidang perubatan, kimia, biologi dan bidang lain, set data ini masih mempunyai beberapa kekurangan. Pertama, borang data adalah agak mudah, kebanyakannya adalah soalan aneka pilihan. Ia mudah dinilai, tetapi mengehadkan julat pemilihan jawapan model dan tidak dapat menguji sepenuhnya keupayaan model untuk menjawab soalan saintifik. Sebaliknya, Soal Jawab terbuka

SK Hynix akan memaparkan produk berkaitan AI baharu pada 6 Ogos: HBM3E 12 lapisan, NAND 321 tinggi, dsb.

Aug 01, 2024 pm 09:40 PM

SK Hynix akan memaparkan produk berkaitan AI baharu pada 6 Ogos: HBM3E 12 lapisan, NAND 321 tinggi, dsb.

Aug 01, 2024 pm 09:40 PM

Menurut berita dari laman web ini pada 1 Ogos, SK Hynix mengeluarkan catatan blog hari ini (1 Ogos), mengumumkan bahawa ia akan menghadiri Global Semiconductor Memory Summit FMS2024 yang akan diadakan di Santa Clara, California, Amerika Syarikat dari 6 hingga 8 Ogos, mempamerkan banyak produk penjanaan teknologi baru. Pengenalan kepada Sidang Kemuncak Memori dan Penyimpanan Masa Depan (FutureMemoryandStorage), dahulunya Sidang Kemuncak Memori Flash (FlashMemorySummit) terutamanya untuk pembekal NAND, dalam konteks peningkatan perhatian kepada teknologi kecerdasan buatan, tahun ini dinamakan semula sebagai Sidang Kemuncak Memori dan Penyimpanan Masa Depan (FutureMemoryandStorage) kepada jemput vendor DRAM dan storan serta ramai lagi pemain. Produk baharu SK hynix dilancarkan tahun lepas

Prestasi SOTA, kaedah AI ramalan pertalian protein-ligan pelbagai mod Xiamen, menggabungkan maklumat permukaan molekul buat kali pertama

Jul 17, 2024 pm 06:37 PM

Prestasi SOTA, kaedah AI ramalan pertalian protein-ligan pelbagai mod Xiamen, menggabungkan maklumat permukaan molekul buat kali pertama

Jul 17, 2024 pm 06:37 PM

Editor |. KX Dalam bidang penyelidikan dan pembangunan ubat, meramalkan pertalian pengikatan protein dan ligan dengan tepat dan berkesan adalah penting untuk pemeriksaan dan pengoptimuman ubat. Walau bagaimanapun, kajian semasa tidak mengambil kira peranan penting maklumat permukaan molekul dalam interaksi protein-ligan. Berdasarkan ini, penyelidik dari Universiti Xiamen mencadangkan rangka kerja pengekstrakan ciri berbilang mod (MFE) novel, yang buat pertama kalinya menggabungkan maklumat mengenai permukaan protein, struktur dan jujukan 3D, dan menggunakan mekanisme perhatian silang untuk membandingkan ciri modaliti yang berbeza penjajaran. Keputusan eksperimen menunjukkan bahawa kaedah ini mencapai prestasi terkini dalam meramalkan pertalian mengikat protein-ligan. Tambahan pula, kajian ablasi menunjukkan keberkesanan dan keperluan maklumat permukaan protein dan penjajaran ciri multimodal dalam rangka kerja ini. Penyelidikan berkaitan bermula dengan "S