Peranti teknologi

Peranti teknologi

AI

AI

Plagiarisme dan penipuan, ChatGPT secara rahsia menghasilkan 12 kertas yang ditandatangani! Marcus mengecam Ta kerana bertukar menjadi CheatGPT

Plagiarisme dan penipuan, ChatGPT secara rahsia menghasilkan 12 kertas yang ditandatangani! Marcus mengecam Ta kerana bertukar menjadi CheatGPT

Plagiarisme dan penipuan, ChatGPT secara rahsia menghasilkan 12 kertas yang ditandatangani! Marcus mengecam Ta kerana bertukar menjadi CheatGPT

Marcus berada di sini untuk menyerang ChatGPT sekali lagi!

Hari ini, Marcus menulis di blog peribadinya: Keadaan semakin keterlaluan.

Semak jawapan sebelum anda meniupnya

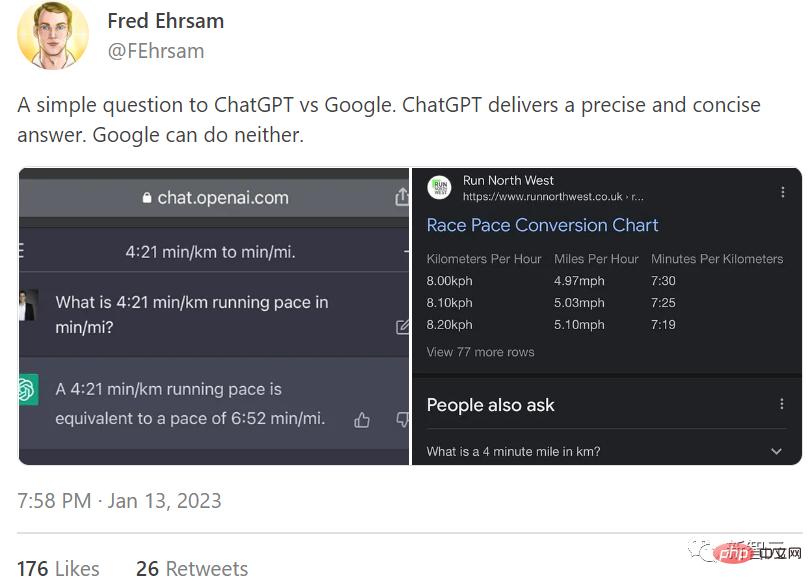

Punca perkara adalah dari baris demi tweet Fred Ehrsam.

Ehrsam bertanya kepada ChatGPT dan Google "Berapa lama masa yang diambil untuk mengambil masa 4 minit dan 21 kilometer untuk sama dengan 1 batu?" diberikan untuk mendapatkan jawapan yang tepat dan padat, tetapi Google tidak dapat melakukannya.

Sebagai tindak balas kepada siaran ini, Marcus berkata: "Ia sombong dan angkuh, seolah-olah ia adalah simbol dunia masa depan. Tetapi dengan cara itu, jawapannya adalah salah."

ChatGPT tidak menukar unit dengan betul ia sama sekali.

Itulah masalahnya. Ramalan perkataan statistik bukan pengganti untuk matematik sebenar, tetapi ramai orang berfikir sebaliknya. (Kelajuan 4 minit dan 21 saat setiap kilometer ialah kelajuan 7 minit setiap batu. Jika anda bertanya soalan dengan baik, ia akan memberikan anda jawapan yang betul.)

ChatGPT ialah seperti "Betul, tidak betul-betul betul." Bahagian paling teruk daripada jawapan itu bukanlah bahawa ia salah, tetapi ia kelihatan begitu yakin. Sangat meyakinkan bahawa pengguna Twitter tidak terfikir untuk meraguinya.

Inilah keadaan semasa: ChatGPT disalahgunakan, orang mempercayainya, malah menyombongkannya, walaupun ia bertentangan dengan jawapan yang betul.

Ingin tahu apa yang lebih teruk daripada gembar-gembur? Orang ramai mula melihat ChatGPT sebagai kolaborator saintifik yang boleh dipercayai dan berkelayakan.

Tolong, jangan tulis ChatGPT sebagai pengarang bersama

Marcus berkata mengenai ChatGPT, tajuk berita semalam menghebohkan kezalimannya terhadap Google kebolehan. Hari ini, pendapat umum membincangkan ChatGPT menjadi pengarang bersama kertas kerja itu.

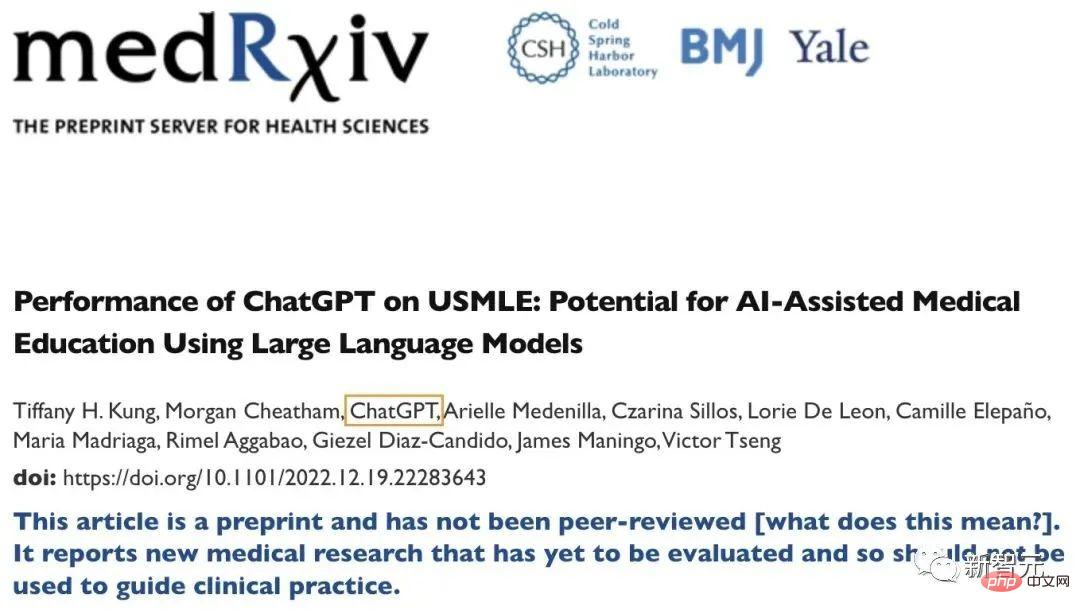

Dalam kertas pracetak yang diterbitkan pada Disember tahun lalu, ChatGPT tiba-tiba muncul dalam ruangan pengarang!

Kebetulan, nama ChatGPT telah kerap muncul dalam beberapa kertas kajian rakan sebaya dalam bidang perubatan sejak Disember tahun lalu:

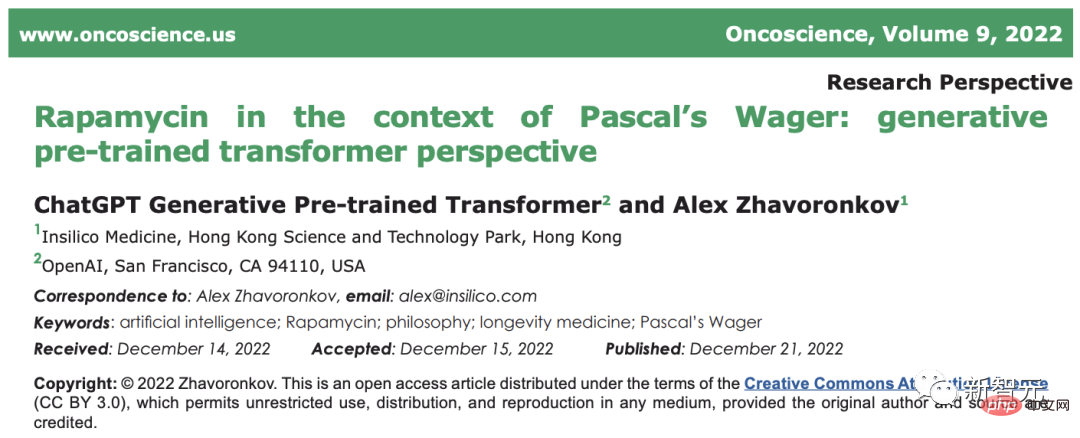

Alamat kertas: https://www.oncoscience.us/article/571/text/

Menurut Semantic Scholar, ChatGPT yang berusia 6 minggu sudah mempunyai dua penerbitan, 12 pengarang bersama dan satu petikan.

Saya amat berharap trend ini tidak berterusan.

Marcus memberikan lima alasan:

- CtGPT hanyalah alat, bukan manusia. Untuk mengatakan bahawa ia adalah seorang saintis, lebih baik untuk mengatakan bahawa ia lebih seperti penyemak ejaan, penyemak tatabahasa atau pakej statistik yang terbaik.

Ia tidak dapat memberikan idea sebenar, mereka bentuk eksperimen yang dikawal dengan teliti atau mendapat inspirasi daripada kesusasteraan sedia ada. Anda tidak menjadikan penyemak ejaan atau hamparan sebagai pengarang bersama.

Sebagai contoh, anda akan memetik sumber dalam rujukan anda seperti pakej perisian untuk analisis otak seperti SPM. Tiada siapa yang akan menyenaraikan SPM sebagai pengarang bersama walaupun ia penting untuk usaha penyelidikan.

- Pengarang bersama ditakrifkan secara berbeza dalam bidang yang berbeza, tetapi secara amnya, pengarang bersama diperlukan untuk membuat sumbangan saintifik yang besar.

CtGPT tidak dapat membuat alasan yang cukup untuk melakukan perkara ini; .

Marcus menulis dalam artikel sebelum ini bahawa ChatGPT tidak mempunyai pemahaman tentang fizik, biologi, psikologi, perubatan dan subjek lain, dan menjelaskan kepada semua orang bahawa "pintar dan bodoh" itu Apakah rupanya suka.

Dalam jawapan ini, ChatGPT berkata dengan serius bahawa saintis telah menemui bahawa churros Sepanyol adalah alat pembedahan yang paling berguna di rumah.

- CtGPT telah membuktikan dirinya tidak boleh dipercayai dan tidak benar. Ia menghasilkan ralat pengiraan yang keterlaluan, mengada-adakan butiran biografi palsu, menyalahgunakan perbendaharaan kata, dan mentakrifkan fenomena saintifik yang tidak wujud.

Jika anda tidak mengetahui perkara ini, anda tidak memahami penyelidikan AI jika anda mengetahui perkara ini dan tidak mengambil berat, itu lebih teruk. Jika anda menjadikannya pengarang bersama, ini menunjukkan bahawa anda hanya cuba mengikuti orang ramai daripada benar-benar melakukan penyelidikan.

- Orang ramai terlalu kuat menggunakan penapis ChatGPT.

Anda tidak akan mempercayai kalkulator dengan kadar ketepatan hanya 75%, maka, jika anda secara terbuka mengisytiharkan bahawa anda tidak berpuas hati dengan penggunaan " buruk" kecerdasan buatan Saya teruja dengan "menulis" kertas kerja dengan alatan pintar, mengapa saya perlu mempercayai anda?

- Tujuan penulisan ilmiah adalah untuk mengajar kebenaran dengan jelas kepada orang lain.

Jika anda melihat ChatGPT sebagai makhluk hidup, yang jelas bukan, anda mengelirukan orang ramai supaya merasakan cara yang sama; anda tidak menyampaikan sains Konsep hanyalah gembar-gembur dan karut. Tolong hentikan kelakuan ini.

Akhirnya, Marcus membuat kesimpulan: Rakan sejati tidak akan membenarkan ChatGPT menjadi pengarang bersama kertas kerja anda.

Sekiranya Marcus berdebat dengan LeCun dan yang lain dengan penuh semangat tentang prospek kecerdasan buatan dan kebolehcapaian AGI, dan menuduh LeCun mengambil kredit daripada orang lain untuk "peta jalan kecerdasan buatan"nya, jika ada lebih kurang rungutan peribadi, maka kerisauan dan kewaspadaan yang diluahkan tentang ChatGPT kali ini amatlah relevan.

Malah, apa yang Marcus sebutkan di atas tentang ChatGPT, penipuan kertas dan pertikaian hak cipta hanya berlaku beberapa minggu selepas pelancaran ChatGPT satu realiti.

Baru-baru ini, Darren Hick, seorang profesor falsafah di Universiti Furman, mendapati bahawa kertas kerja yang diserahkan oleh pelajar dihasilkan oleh kecerdasan buatan.

Hick berkata dia mula curiga apabila melihat maklumat yang nampaknya direka dengan teliti tetapi palsu dalam kertas itu.

Dia menyerahkan kertas kerja itu kepada pengesan ChatGPT Open AI, dan keputusan menunjukkan terdapat 99% kemungkinan kertas ini dihasilkan oleh kecerdasan buatan.

Kebetulan, Antony Aumann, seorang profesor di Northern Michigan University, juga berkata bahawa dia juga mendapati dua pelajar menyerahkan kod yang ditulis oleh artikel ChatGPT.

Setelah perasan ada sesuatu yang tidak kena tentang gaya penulisan kedua-dua artikel itu, Orman menyerahkan artikel tersebut kepada chatbot, bertanyakan kemungkinan besar artikel tersebut ditulis oleh program tersebut. Apabila chatbot mengatakan ia 99% pasti ia ditulis oleh ChatGPT, ia memajukan hasilnya kepada pelajar.

Kedua-dua Schick dan Orman berkata selepas mereka berdepan dengan pelajar itu, kesemua mereka akhirnya mengakui pelanggaran tersebut. Pelajar Hick gagal dalam kelas, dan Ohman menyuruh pelajarnya menulis semula kertas itu dari awal.

Walaupun kertas itu mempunyai ralat, ia ditulis dengan baik

Kedua-dua profesor itu berkata terdapat beberapa perkara penting dalam kedua-dua yang dijana AI Anda boleh melihat lebih banyak kesan yang jelas di sana sini. Schick berkata, kertas yang ditemuinya menyebut beberapa fakta yang tidak disebut dalam kelas dan membuat dakwaan yang dipertikaikan.

Dia berkata: "Di atas kertas, ini adalah artikel yang ditulis dengan baik, tetapi jika diteliti lebih dekat, terdapat kenyataan tentang ahli falsafah prolifik David Hume Ia tidak bermakna, malah salah sama sekali. ”

Ralat yang digilap dengan sempurna ini ialah kecacatan terbesar penulisan hantu AI.

Bagi Orman, chatbot ditulis terlalu sempurna. "Saya rasa alat sembang ini lebih baik ditulis daripada 95% pelajar saya." atau keupayaan menulis. "Orang ramai menulis sesuatu yang benar-benar memenuhi semua keperluan, dengan tatabahasa yang rumit dan idea yang kompleks, dan ia berkaitan secara langsung dengan gesaan artikel itu, dan sesuatu yang terasa tidak kena serta-merta," katanya.

Christopher Bartel, seorang profesor falsafah di Appalachian State University, berkata walaupun tatabahasa artikel yang dijana oleh AI hampir sempurna, kandungan substantif selalunya kurang terperinci.

"Tiada konteks, tiada kedalaman, tiada pandangan."

Sukar untuk membuktikan plagiarisme: tiada apa yang boleh dilakukan tanpa mengaku

Tetapi setelah berkata demikian, beberapa pelajar profesor telah mengakui penulisan ghosting AI Malah, jika pelajar enggan mengakui bahawa kecerdasan buatan digunakan untuk menulis kertas, komuniti akademik mungkin menghadapi masalah.

Battle berkata bahawa peraturan semasa beberapa institusi akademik belum cukup dibangunkan untuk memerangi penipuan seperti ini. Jika pelajar berusaha keras untuk menafikan menggunakan kecerdasan buatan, sebenarnya sukar untuk membuktikan penipuan itu.

Beliau juga berkata bahawa alat pengesan AI yang disediakan oleh OpenAI adalah baik, tetapi tidak sempurna.

Alat ini menjalankan analisis statistik tentang kemungkinan teks dihasilkan oleh kecerdasan buatan dan memberikan kebarangkalian.

Dasar semasa secara amnya mesti ada bukti yang jelas dan boleh disahkan untuk membuktikan bahawa kertas itu palsu sebelum ia boleh dianggap sebagai tukul batu, yang meletakkan kita dalam kedudukan yang sangat sukar. Jika hasil yang dikembalikan adalah 95% berkemungkinan artikel yang dihasilkan oleh kecerdasan buatan, dan 5% berkemungkinan tidak.

Dalam kes Schick, walaupun laman web ujian mengatakan "99% pasti" bahawa kertas itu dihasilkan oleh kecerdasan buatan, sebenarnya, kuncinya terletak pada pelajar itu sendiri mengakuinya, Jika tidak, keputusan kebarangkalian ini sahaja tidak mencukupi untuk mengesahkan penipuan.

Hick berkata bahawa pengakuan adalah penting, tetapi selain itu, segala-galanya adalah bukti tidak langsung Bagi kandungan yang dihasilkan oleh kecerdasan buatan, secara amnya tiada bukti material dan bukti material adalah lebih baik daripada bukti tidak langsung Mempunyai bahagian yang lebih besar. "

Oman berkata walaupun dia percaya analisis chatbot adalah bukti yang mencukupi untuk mengambil tindakan, menggunakan kecerdasan buatan untuk memplagiat dan menipu masih merupakan cabaran baharu untuk kolej dan universiti.

Lagipun, dengan keupayaan ChatGPT untuk kelihatan nyata dan palsu, selagi pengguna mahukannya, ia boleh menjadi CheatGPT dalam masa beberapa minit sahaja

Atas ialah kandungan terperinci Plagiarisme dan penipuan, ChatGPT secara rahsia menghasilkan 12 kertas yang ditandatangani! Marcus mengecam Ta kerana bertukar menjadi CheatGPT. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1378

1378

52

52

ChatGPT kini membenarkan pengguna percuma menjana imej dengan menggunakan DALL-E 3 dengan had harian

Aug 09, 2024 pm 09:37 PM

ChatGPT kini membenarkan pengguna percuma menjana imej dengan menggunakan DALL-E 3 dengan had harian

Aug 09, 2024 pm 09:37 PM

DALL-E 3 telah diperkenalkan secara rasmi pada September 2023 sebagai model yang jauh lebih baik daripada pendahulunya. Ia dianggap sebagai salah satu penjana imej AI terbaik setakat ini, mampu mencipta imej dengan perincian yang rumit. Walau bagaimanapun, semasa pelancaran, ia adalah tidak termasuk

Kertas Stable Diffusion 3 akhirnya telah dikeluarkan, dan butiran seni bina didedahkan Adakah ia akan membantu untuk menghasilkan semula Sora?

Mar 06, 2024 pm 05:34 PM

Kertas Stable Diffusion 3 akhirnya telah dikeluarkan, dan butiran seni bina didedahkan Adakah ia akan membantu untuk menghasilkan semula Sora?

Mar 06, 2024 pm 05:34 PM

Kertas StableDiffusion3 akhirnya di sini! Model ini dikeluarkan dua minggu lalu dan menggunakan seni bina DiT (DiffusionTransformer) yang sama seperti Sora. Ia menimbulkan kekecohan apabila ia dikeluarkan. Berbanding dengan versi sebelumnya, kualiti imej yang dijana oleh StableDiffusion3 telah dipertingkatkan dengan ketara Ia kini menyokong gesaan berbilang tema, dan kesan penulisan teks juga telah dipertingkatkan, dan aksara bercelaru tidak lagi muncul. StabilityAI menegaskan bahawa StableDiffusion3 ialah satu siri model dengan saiz parameter antara 800M hingga 8B. Julat parameter ini bermakna model boleh dijalankan terus pada banyak peranti mudah alih, dengan ketara mengurangkan penggunaan AI

Gabungan sempurna ChatGPT dan Python: mencipta chatbot perkhidmatan pelanggan yang pintar

Oct 27, 2023 pm 06:00 PM

Gabungan sempurna ChatGPT dan Python: mencipta chatbot perkhidmatan pelanggan yang pintar

Oct 27, 2023 pm 06:00 PM

Gabungan sempurna ChatGPT dan Python: Mencipta Perkhidmatan Pelanggan Pintar Chatbot Pengenalan: Dalam era maklumat hari ini, sistem perkhidmatan pelanggan pintar telah menjadi alat komunikasi yang penting antara perusahaan dan pelanggan. Untuk memberikan pengalaman perkhidmatan pelanggan yang lebih baik, banyak syarikat telah mula beralih kepada chatbots untuk menyelesaikan tugas seperti perundingan pelanggan dan menjawab soalan. Dalam artikel ini, kami akan memperkenalkan cara menggunakan bahasa ChatGPT dan Python model OpenAI yang berkuasa untuk mencipta bot sembang perkhidmatan pelanggan yang pintar untuk meningkatkan

Bagaimana untuk memasang chatgpt pada telefon bimbit

Mar 05, 2024 pm 02:31 PM

Bagaimana untuk memasang chatgpt pada telefon bimbit

Mar 05, 2024 pm 02:31 PM

Langkah pemasangan: 1. Muat turun perisian ChatGTP dari laman web rasmi ChatGTP atau kedai mudah alih 2. Selepas membukanya, dalam antara muka tetapan, pilih bahasa sebagai bahasa Cina 3. Dalam antara muka permainan, pilih permainan mesin manusia dan tetapkan Spektrum bahasa Cina; 4 Selepas memulakan, masukkan arahan dalam tetingkap sembang untuk berinteraksi dengan perisian.

Bagaimana untuk membangunkan chatbot pintar menggunakan ChatGPT dan Java

Oct 28, 2023 am 08:54 AM

Bagaimana untuk membangunkan chatbot pintar menggunakan ChatGPT dan Java

Oct 28, 2023 am 08:54 AM

Dalam artikel ini, kami akan memperkenalkan cara membangunkan chatbot pintar menggunakan ChatGPT dan Java, dan menyediakan beberapa contoh kod khusus. ChatGPT ialah versi terkini Generative Pre-training Transformer yang dibangunkan oleh OpenAI, teknologi kecerdasan buatan berasaskan rangkaian saraf yang boleh memahami bahasa semula jadi dan menjana teks seperti manusia. Menggunakan ChatGPT kami boleh membuat sembang adaptif dengan mudah

NeRF dan pemanduan autonomi masa lalu dan sekarang, ringkasan hampir 10 kertas kerja!

Nov 14, 2023 pm 03:09 PM

NeRF dan pemanduan autonomi masa lalu dan sekarang, ringkasan hampir 10 kertas kerja!

Nov 14, 2023 pm 03:09 PM

Sejak Medan Sinaran Neural dicadangkan pada tahun 2020, bilangan kertas kerja yang berkaitan telah meningkat secara eksponen. Ia bukan sahaja menjadi hala tuju cabang penting pembinaan semula tiga dimensi, tetapi juga secara beransur-ansur menjadi aktif di sempadan penyelidikan sebagai alat penting untuk pemanduan autonomi. . NeRF telah muncul secara tiba-tiba dalam tempoh dua tahun yang lalu, terutamanya kerana ia melangkau pengekstrakan dan pemadanan titik ciri, geometri dan triangulasi epipolar, PnP serta Pelarasan Bundle dan langkah lain dalam saluran paip pembinaan semula CV tradisional, malah melangkau pembinaan semula jaringan, pemetaan dan pengesanan cahaya , terus daripada 2D Imej input digunakan untuk mempelajari medan sinaran, dan kemudian imej yang dihasilkan yang menghampiri foto sebenar adalah output daripada medan sinaran. Dengan kata lain, biarkan model tiga dimensi tersirat berdasarkan rangkaian saraf sesuai dengan perspektif yang ditentukan

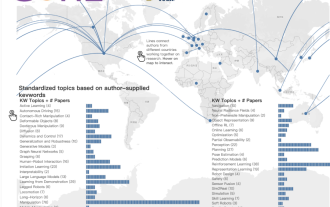

Pasukan China memenangi anugerah kertas terbaik dan kertas sistem terbaik, dan keputusan penyelidikan CoRL diumumkan.

Nov 10, 2023 pm 02:21 PM

Pasukan China memenangi anugerah kertas terbaik dan kertas sistem terbaik, dan keputusan penyelidikan CoRL diumumkan.

Nov 10, 2023 pm 02:21 PM

Sejak pertama kali diadakan pada 2017, CoRL telah menjadi salah satu persidangan akademik terbaik dunia dalam persimpangan robotik dan pembelajaran mesin. CoRL ialah persidangan tema tunggal untuk penyelidikan pembelajaran robot, meliputi pelbagai topik seperti robotik, pembelajaran mesin dan kawalan, termasuk teori dan aplikasi Persidangan CoRL 2023 akan diadakan di Atlanta, Amerika Syarikat, dari 6 hingga 9 November. Menurut data rasmi, 199 kertas kerja dari 25 negara telah dipilih untuk CoRL tahun ini. Topik popular termasuk operasi, pembelajaran pengukuhan dan banyak lagi. Walaupun CoRL berskala lebih kecil daripada persidangan akademik AI yang besar seperti AAAI dan CVPR, memandangkan populariti konsep seperti model besar, kecerdasan terkandung dan robot humanoid meningkat tahun ini, penyelidikan berkaitan yang patut diberi perhatian juga akan

Bolehkah chatgpt digunakan di China?

Mar 05, 2024 pm 03:05 PM

Bolehkah chatgpt digunakan di China?

Mar 05, 2024 pm 03:05 PM

chatgpt boleh digunakan di China, tetapi tidak boleh didaftarkan, begitu juga di Hong Kong dan Macao Jika pengguna ingin mendaftar, mereka boleh menggunakan nombor telefon mudah alih asing untuk mendaftar. Perhatikan bahawa semasa proses pendaftaran, persekitaran rangkaian mesti ditukar IP asing.