Peranti teknologi

Peranti teknologi

AI

AI

Temu bual dengan Stuart Russell: Berkenaan ChatGPT, lebih banyak data dan lebih banyak kuasa pengkomputeran tidak boleh membawa kecerdasan sebenar

Temu bual dengan Stuart Russell: Berkenaan ChatGPT, lebih banyak data dan lebih banyak kuasa pengkomputeran tidak boleh membawa kecerdasan sebenar

Temu bual dengan Stuart Russell: Berkenaan ChatGPT, lebih banyak data dan lebih banyak kuasa pengkomputeran tidak boleh membawa kecerdasan sebenar

Edisi Bahasa Cina keempat "Kecerdasan Buatan: Pendekatan Moden" telah dikeluarkan baru-baru ini dalam temu bual eksklusif dengan pengarang, Profesor Stuart Russell. Sebagai klasik dalam bidang AI, Kecerdasan Buatan: Pendekatan Moden telah dicetak semula beberapa kali, dengan kandungan dan struktur mencerminkan pemahaman yang berkembang tentang kedua-dua pengarang. Edisi keempat terbaharu ialah penjelasan terbaharu mereka selepas menggabungkan kemajuan AI dalam dekad yang lalu, terutamanya kesan pembelajaran mendalam, ke dalam rangka kerja keseluruhan Ia mencerminkan pandangan kedua-dua sarjana tentang trend dalam kecerdasan buatan dan pembangunan subjek sistem.

Temu bual ini juga mengikut "pendekatan moden", dengan harapan dapat menunjukkan pandangan Profesor Russell tentang trend teknologi dan teori kecerdasan dari perspektif yang selaras dengan perkembangan teknologi dan zaman , serta pemikiran popular vs. klasik, membawa inspirasi kepada penyelidik dan pengamal AI.

Stuart Russell bekerja di Universiti California, Berkeley, dan kini seorang profesor di Jabatan Sains Komputer (dahulunya Pengerusi Jabatan), Pengarah Pusat Kepintaran Buatan Serasi Manusia. Beliau menerima Anugerah Presiden Yayasan Sains Kebangsaan untuk Saintis Muda Cemerlang pada tahun 1990 dan Anugerah Pengkomputeran dan Idea IJCAI pada tahun 1995. Beliau adalah Fellow AAAI, ACM dan AAAS dan telah menerbitkan lebih daripada 300 kertas kerja dalam bidang kecerdasan buatan, meliputi pelbagai topik. Sumber imej: kavlicenter.berkeley.edu

Profesor Russell percaya bahawa dalam tempoh sepuluh tahun akan datang, tumpuan orang ramai akan beralih daripada pergantungan pada hujung ke hujung mendalam pembelajaran , kembali kepada sistem yang terdiri daripada perwakilan modular, logik matematik, semantik yang ditakrifkan dengan baik, dan pembelajaran mendalam akan memainkan peranan penting dalam mendapatkan data deria mentah. Adalah penting untuk menekankan bahawa perwakilan modular yang ditakrifkan dengan baik secara semantik tidak perlu direka bentuk dengan tangan atau tidak fleksibel boleh dipelajari daripada data.

Bagi ChatGPT yang popular, Profesor Russell percaya bahawa kuncinya adalah untuk membezakan bidang tugas dan memikirkan dalam keadaan apa ia digunakan: ChatGPT boleh menjadi baik Alat yang akan membawa nilai yang lebih besar jika ia berlabuh pada fakta dan disepadukan dengan sistem perancangan. Masalahnya ialah, pada masa ini kami tidak tahu cara ChatGPT berfungsi, dan kami mungkin tidak akan dapat memikirkannya, yang memerlukan beberapa penemuan konsep yang sukar untuk diramalkan.

Beliau percaya bahawa untuk membina sistem yang benar-benar pintar, kita harus memberi lebih perhatian kepada logik matematik dan penaakulan pengetahuan, kerana kita perlu membina sistem berdasarkan kaedah yang kita fahami. , untuk memastikan AI tidak terlepas dari kawalan. Dia tidak percaya bahawa penskalaan adalah jawapannya, dan dia juga tidak percaya bahawa lebih banyak data dan lebih banyak kuasa pengkomputeran boleh menyelesaikan masalah ini terlalu optimistik dan tidak menarik dari segi intelek.

Jika kita mengabaikan masalah asas ketidakcekapan data pembelajaran mendalam, "Saya bimbang kita menipu diri sendiri untuk berfikir bahawa kita sedang menuju ke arah kecerdasan sebenar. Apa yang kita telah melakukan Ini semua tentang menambah lebih banyak piksel kepada sesuatu yang sebenarnya bukan model pintar sama sekali 🎜>Machine Heart: Pada pendapat anda, lakukan model bahasa pra-latihan berskala besar (LLM) yang diwakili oleh ChatGPT pada dasarnya meningkatkan. kecerdasan buatan ke tahap yang lebih tinggi? Adakah LLM mengatasi beberapa masalah asas sistem pembelajaran mendalam, seperti pemerolehan akal dan penaakulan pengetahuan?

Stuart Russell:

Jawapan pertama yang terlintas di fikiran saya ialah - kita tidak tahu kerana tidak seseorang tahu ini Bagaimana model berfungsi, termasuk orang yang menciptanya.

Apa yang ChatGPT tahu? Bolehkah ia memberi alasan? Dalam erti kata apa ia memahami jawapannya? Kami tidak tahu.

Seorang kawan saya di Oregon State University bertanya kepada model itu "Mana satu lebih besar, gajah atau kucing?" Model itu menjawab "gajah lebih besar?" ", tetapi bertanya dengan cara yang berbeza "Gajah atau kucing, yang manakah tidak lebih besar daripada yang lain?" Model itu menjawab "Gajah atau kucing tidak lebih besar daripada yang lain." Jadi anda mengatakan bahawa model itu tahu yang mana lebih besar, gajah atau kucing? Ia tidak tahu, kerana jika ditanya cara lain, ia akan mendapat kesimpulan yang bercanggah.Jadi, apa yang model tahu?

Biar saya berikan satu lagi contoh, yang juga sebenarnya berlaku. Data latihan untuk model ini mengandungi sejumlah besar permainan catur, diwakili oleh kod dan simbol bersatu Permainan kelihatan seperti urutan e4 e5 Nf3 Nc6 Bb5... Pemain mengetahui maksud simbol ini dan pergerakan yang digambarkan oleh urutan ini. Tetapi model tidak tahu Model itu tidak tahu bahawa terdapat papan catur, dan ia tidak tahu pergerakannya, simbol ini hanyalah simbol. Jadi, apabila anda bermain catur buta dengannya dan anda berkata "Mari kita bermain catur, g4", ia mungkin membalas "e6". latihan Cari jujukan yang serupa dalam data, lakukan transformasi yang sesuai pada jujukan ini, dan kemudian jana langkah seterusnya. 80% atau bahkan 90% masa ia akan menghasilkan langkah yang baik, tetapi pada masa lain ia akan membuat gerakan yang mengarut atau benar-benar bertentangan dengan peraturan kerana ia tidak mempunyai konsep bermain gerakan di papan catur. Bukan hanya untuk catur, saya fikir ini sebenarnya terpakai kepada semua model besar lakukan sekarang: 80% daripada masa ia kelihatan seperti lelaki Pintar, tetapi 20% lagi ia kelihatan seperti orang bodoh. Ia kelihatan pintar kerana ia mempunyai banyak data Ia telah membaca hampir semua buku dan artikel yang ditulis oleh manusia setakat ini, tetapi walaupun ini, dalam Selepas menerima sejumlah besar maklumat berguna, ia masih akan memuntahkan perkara-perkara yang ia tidak tahu apa maksudnya. Jadi, dalam pengertian ini, saya fikir model bahasa yang besar mungkin bukan kemajuan dalam kecerdasan buatan. Apa yang benar-benar mengagumkan tentang ChatGPT ialah keupayaannya untuk menyamaratakan antara perbualan yang dilakukannya dengan penggunanya dan teks yang pernah dibacanya sebelum ini buat penukaran yang sesuai , jadi jawapannya kelihatan bijak. Walau bagaimanapun, kami tidak tahu bagaimana model melakukan ini, kami tidak tahu di mana sempadan keupayaan generalisasi ini, dan kami tidak tahu bagaimana generalisasi ini dilaksanakan dalam litar. Jika kita benar-benar mengetahuinya, ia memang boleh dikatakan sebagai kemajuan dalam kecerdasan buatan, kerana kita boleh menggunakannya sebagai asas, dan kita boleh membangunkan teknologi lain berdasarkan sistem ChatGPT. Tetapi pada peringkat ini, semuanya masih menjadi misteri. Satu-satunya cara kita boleh bergerak ke hadapan ialah jika model itu tidak berfungsi? Okey, mari berikan lebih banyak data dan jadikan model itu lebih besar sedikit. Saya tidak fikir peningkatan adalah jawapannya. Data akhirnya akan kehabisan, dan situasi baharu sentiasa berlaku di dunia nyata. Apabila kita menulis program catur, program-program yang benar-benar boleh bermain catur dengan baik boleh menghadapi situasi yang tidak pernah dilihat sebelum ini. Hanya ada satu sebab, iaitu program ini memahami peraturan catur dan boleh menggerakkan buah catur dalam The evolution. kedudukan pada papan catur—titik di mana kepingan boleh digerakkan, dan kemungkinan pergerakan lawan yang seterusnya, termasuk pergerakan yang tidak pernah direkodkan dalam permainan catur—divisualisasikan. Kami masih jauh daripada dapat melakukan perkara ini dalam situasi dunia sebenar umum. Pada masa yang sama, saya tidak fikir model besar bahasa membawa kita lebih dekat untuk mencapai matlamat itu. Kecuali, anda mungkin berkata, model bahasa yang besar membolehkan kita menggunakan pengetahuan manusia yang disimpan dalam teks. Model bahasa yang besar akan lebih berguna jika kita dapat menambatnya dalam fakta yang diketahui. Fikirkan tentang Graf Pengetahuan Google, yang mempunyai 500 bilion fakta Jika ChatGPT boleh disandarkan dalam fakta ini dan boleh memberikan jawapan yang betul kepada soalan yang berkaitan dengan fakta ini, maka ChatGPT akan lebih dipercayai. Jika kita boleh mencari cara untuk menggandingkan model bahasa yang besar ke dalam enjin inferens yang boleh menaakul dan merancang dengan betul, maka anda boleh mengatakan bahawa kami mempunyai kejayaan dalam kecerdasan buatan A bottleneck. Kami kini mempunyai banyak algoritma perancangan, tetapi sukar untuk membuat algoritma perancangan ini menjalankan perancangan yang betul dan munasabah, seperti membina kereta, dan memberikan mereka pengetahuan yang diperlukan, kerana terdapat terlalu banyak perkara yang perlu difahami, dan adalah sangat sukar untuk melakukannya. Sukar untuk menulis semuanya dan memastikan semuanya betul. Tetapi model besar bahasa telah membaca setiap buku tentang kereta, dan mungkin mereka boleh membantu kami membina pengetahuan yang diperlukan, atau hanya menjawab soalan yang diperlukan atas permintaan, supaya kami dapat menangkap semua pengetahuan ini semasa merancang. Daripada hanya melihat ChatGPT sebagai kotak hitam yang membantu anda melakukan sesuatu, menggabungkan model bahasa besar dengan algoritma perancangan untuk menjadikannya input Pengetahuan ke dalam sistem perancangan yang akan membawa kepada alatan perniagaan yang benar-benar berharga . Setahu saya, sudah ada orang yang bekerja ke arah ini, dan jika berjaya, ia akan menjadi satu kemajuan yang besar. Machine Heart: Sebagai seorang guru, apakah pendapat anda tentang ChatGPT - adakah anda akan membenarkan pelajar menggunakan ChatGPT untuk menjana kertas? Sebagai pengguna, apakah pendapat anda tentang pelbagai aplikasi yang dihasilkan oleh ChatGPT, terutamanya aplikasi komersial? Stuart Russell: Beberapa minggu lalu, semasa saya berada di Forum Ekonomi Dunia di Davos Apabila bercakap dengan orang dalam dunia perniagaan, semua orang bertanya kepada saya tentang model besar bahasa dan cara mereka menggunakannya dalam syarikat mereka. Saya rasa anda boleh memikirkannya dengan cara ini, adakah anda akan meletakkan seorang yang berumur 6 tahun pada kedudukan yang sama dalam syarikat anda? Walaupun ada perbezaan kebolehan antara keduanya, saya rasa kita boleh buat analogi ini. Model bahasa yang besar dan ChatGPT tidak boleh dipercayai. Mereka tidak mempunyai akal dan akan memberikan maklumat yang salah dengan cara yang serius. Jadi, jika anda akan menggunakan ChatGPT atau model yang serupa dalam syarikat anda, anda perlu berhati-hati. Jika anda menganggap jawatan atau tanggungjawab tertentu dalam syarikat sebagai nod dalam rangkaian, bahasa adalah input dan output dalam nod ini - sudah tentu, anda boleh memikirkannya dengan cara ini. Ini berlaku untuk banyak pekerjaan, seperti wartawan dan profesor Perkara sedemikian. Walau bagaimanapun, itu tidak bermakna anda boleh menggantikannya dengan ChatGPT. Kita perlu berhati-hati dalam hal pendidikan. Kemunculan ChatGPT telah menyebabkan ramai orang panik. Ada orang kata, ah kita kena disable ChatGPT di sekolah. Yang lain berkata mengharamkan ChatGPT adalah tidak masuk akal, memetik perbincangan dari abad ke-19 di mana sesetengah orang berkata kami terpaksa mengharamkan kalkulator mekanikal kerana jika pelajar mula menggunakan kalkulator mekanikal, mereka tidak akan belajar dengan betul. Tidakkah ini terdengar meyakinkan? Nampaknya kita tidak perlu melarang ChatGPT? Walau bagaimanapun, analogi ini salah sama sekali - kalkulator mekanikal mengautomasikan proses mekanikal yang sama. Mendarab nombor 26 digit adalah sangat mekanikal, satu set arahan, dan anda hanya perlu mengikuti langkah-langkah, langkah demi langkah, langkah demi langkah, untuk mendapatkan jawapannya. Nilai intelek mengikuti arahan adalah terhad, terutamanya jika orang itu tidak memahami apa yang dilakukan oleh arahan itu. Tetapi apa yang akan digantikan oleh ChatGPT bukanlah mengikut arahan secara mekanikal, tetapi keupayaan untuk menjawab soalan, membaca dan memahami serta menyusun idea ke dalam dokumen. Jika anda tidak mempelajari ini, dan membiarkan ChatGPT melakukannya untuk anda, anda mungkin benar-benar menjadi orang yang tidak berguna. Kini terdapat kalkulator elektronik, tetapi kami masih mengajar kanak-kanak aritmetik, kami mengajar mereka peraturan aritmetik dan cuba memahami apa itu nombor, nombor Bagaimana ia sepadan dengan perkara di dunia fizikal, dsb. Selepas mereka mendapat pemahaman ini dan menguasai peraturan aritmetik barulah kami memberi mereka kalkulator elektronik supaya mereka tidak perlu mengikut prosedur mekanikal. Pada zaman kita, apabila tiada kalkulator, kami menggunakan jadual bercetak dengan nilai pelbagai fungsi sinus, kosinus dan logaritma , tiada siapa yang mempunyai pernah mengatakan bahawa anda tidak boleh belajar matematik dengan menggunakan jadual ini. Jadi, kita perlu memikirkan bila masa yang sesuai untuk pelajar mula menggunakan alat seperti ChatGPT. Untuk menjawab soalan anda, jika anda dapat mencari bahagian yang tidak berotak dalam tugas menulis kertas - sebenarnya, terdapat banyak masa apabila menulis kertas kerja tidak masuk akal, hanya mengulangi proses yang membosankan dan membosankan secara mekanikal - maka anda mungkin ChatGPT tersedia dan Saya tidak mempunyai masalah dengan itu. Walau bagaimanapun, menulis bukanlah satu proses yang membosankan pada dasarnya adalah sejenis pemikiran, dan ia juga merupakan satu cara untuk orang belajar berfikir. Perkara terakhir yang kami mahu ialah seseorang yang menggunakan ChatGPT secara membuta tuli yang tidak memahami soalan mahupun jawapannya. Bagi aplikasi ChatGPT yang lain, seperti menjana gambar atau muzik, saya rasa keadaannya adalah serupa. Saya fikir proses mencipta seni boleh dibahagikan secara kasar kepada dua bahagian, pertama mempunyai konsep tentang apa yang anda ingin cipta, dan kemudian proses yang agak mekanikal untuk menciptanya berdasarkan penglihatan anda. Bagi sesetengah orang, yang terakhir ini sangat mencabar dan tidak kira bagaimana mereka mencuba, mereka tidak dapat membuat gambar yang bagus, jadi kami mempunyai artis terlatih khas, terutamanya artis komersial, yang kerjanya tidak banyak melibatkan Kreativiti, memberi perhatian yang lebih. kepada kebolehan menghasilkan gambar mengikut keperluan. Saya fikir ini adalah satu profesion yang sangat terancam. Saya mempunyai pengalaman ini semasa saya menulis buku Terdapat lima hingga enam ratus ilustrasi dalam "Kecerdasan Buatan: Pendekatan Moden", hampir kesemuanya telah dilukis oleh saya. Mencipta ilustrasi atau rajah yang baik adalah proses yang perlahan dan teliti yang memerlukan banyak kemahiran dan kemahiran. Jika terdapat model atau aplikasi besar yang menghasilkan gambar rajah atau ilustrasi teknikal seperti yang terdapat dalam buku saya, saya berbesar hati untuk menggunakannya.

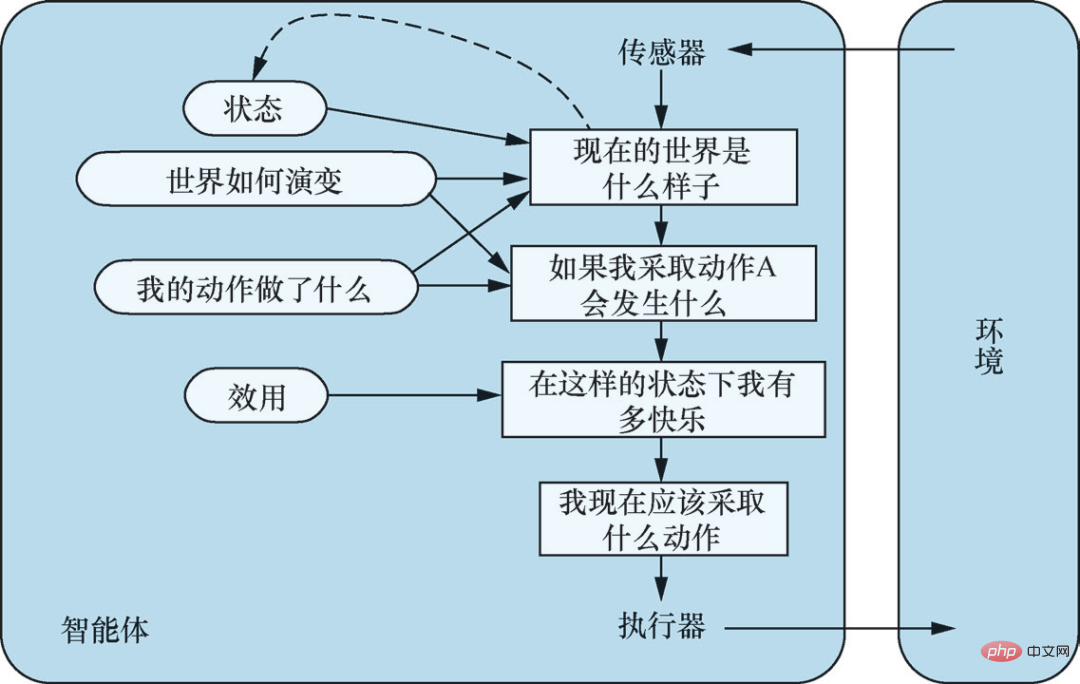

Berasaskan model, ejen berasaskan utiliti. Sumber: "Kecerdasan Buatan: Pendekatan Moden (Edisi Ke-4)" Ilustrasi 2-14

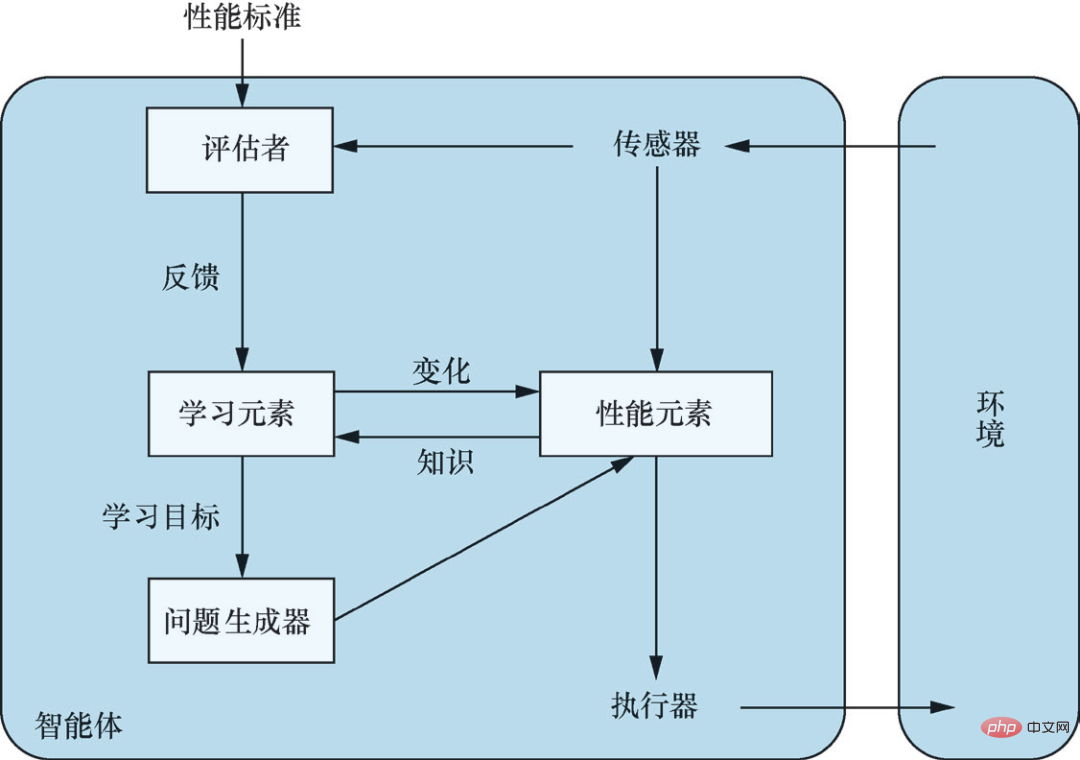

Ejen pembelajaran am. Sumber: "Kecerdasan Buatan: Pendekatan Moden (Edisi Ke-4)" Ilustrasi 2-15

-2-

Jantung mesin: Kami tidak mengetahui prinsip ChatGPT, tetapi melalui pelaksanaan kejuruteraan, kami telah memperoleh alat yang berguna dalam situasi tertentu ChatGPT juga nampaknya merupakan contoh yang baik untuk membawa orang ke dalam gelung. Adakah ChatGPT satu peningkatan dari perspektif kejuruteraan?

Stuart Russell: Saya tidak pasti sama ada ChatGPT boleh dipanggil projek, kerana secara umumnya, kami berpendapat "Kejuruteraan" ialah satu disiplin sains kejuruteraan gunaan yang menggabungkan pengetahuan fizik, kimia, mekanik, elektronik, dll. untuk mencipta perkara yang berguna kepada manusia dengan cara yang kompleks dan bijak. Pada masa yang sama, kami memahami mengapa perkara ini berguna, kerana sifat bergunanya dicapai melalui kaedah tertentu dan boleh dihasilkan semula.

Tetapi bagaimanakah kami membangunkan ChatGPT? Menggabungkan maklum balas manusia adalah berguna, tetapi daripada keputusan, ChatGPT diperoleh dengan melakukan penurunan kecerunan pada sejumlah besar set data. Ini mengingatkan saya pada tahun 1950-an, apabila banyak usaha dilakukan dalam pengaturcaraan genetik, dan program Fortran yang diharapkan untuk mencapai kecerdasan dengan mensimulasikan evolusi biologi gagal dengan teruk.

Secara teorinya, apabila anda mempunyai program Fortran yang mencukupi dan membiarkannya menjana mutasi yang mencukupi, pada dasarnya mungkin untuk menghasilkan sesuatu yang lebih bijak daripada program Fortran. Tetapi kemungkinan ini pada dasarnya tidak menjadi kenyataan dalam amalan.

Sekarang, anda melakukan penurunan kecerunan pada litar yang cukup besar dan data yang mencukupi, dan tiba-tiba anda boleh mencipta kecerdasan sebenar? Saya fikir ia tidak mungkin, mungkin lebih sedikit daripada program Fortran yang berkembang - tetapi saya tidak boleh mengatakan, mungkin program Fortran lebih berkemungkinan, kerana ada sebab untuk berfikir bahawa program Fortran adalah sejenis perwakilan yang mempunyai keupayaan yang lebih kuat daripada litar. bahasa, dan apabila mereka meninggalkan program Fortran pada tahun 1958, kuasa pengkomputeran adalah 15 atau 16 pesanan magnitud kurang daripada apa yang kita ada hari ini.

Jantung Mesin: Tanpa perkataan "kejuruteraan", apakah pendapat anda tentang apa yang OpenAI lakukan?

Stuart Russell: Apa yang OpenAI lakukan, anda boleh panggil Cookery , kerana kami benar-benar tidak tahu bagaimana model ini berfungsi. Sama seperti ketika saya membuat kek, saya tidak tahu bagaimana ia berubah menjadi kek Manusia telah membuat kek selama beribu-ribu tahun Mereka telah mencuba pelbagai bahan mentah dan banyak kaedah yang berbeza , suatu hari saya menemui satu perkara ajaib - kek, iaitu memasak. Sekarang kita tahu lebih sedikit tentang prinsip asas kek, tetapi ia masih tidak sempurna. Hanya banyak yang boleh kita peroleh daripada memasak, dan proses itu tidak mempunyai nilai intelek yang tinggi.

Jika ia disebabkan oleh beberapa masalah asas dengan ChatGPT, suatu hari nanti anda tidak akan mendapat apa yang anda inginkan dengan memasukkan gesaan atau arahan Apa yang perlu dilakukan dengan jawapan itu ? Adakah anda akan mengubah suai resipi sekali lagi? Naikkan token daripada 4000 kepada 5000 dan gandakan bilangan lapisan rangkaian? Ia bukan sains, dan saya rasa ia tidak menarik dari segi intelek.

Penyelidikan cuba memahami betapa besarnya model bahasa berfungsi pastinya berharga, kerana ChatGPT membuat jumlah generalisasi yang mengejutkan, dan hanya memikirkan bagaimana baru boleh kami benar-benar membangunkan sistem pintar yang bermakna. Terdapat ramai orang yang mengusahakannya sekarang, dan banyak kertas kerja telah diterbitkan mengenainya.

Tetapi sama ada mekanisme dalaman ChatGPT boleh difahami, saya fikir ia sukar untuk dikatakan, ia mungkin terlalu rumit dan kita tidak mempunyai cara untuk membuat kejuruteraan terbalik apa yang berlaku di dalam.

Analogi yang menarik ialah apa yang berlaku antara manusia dan anjing 30,000 tahun dahulu. Kami tidak faham bagaimana otak anjing berfungsi, dan sukar untuk mengetahui dengan tepat apa yang difikirkan oleh anjing, tetapi kami belajar untuk menjinakkan mereka, dan kini anjing disepadukan ke dalam kehidupan kita, memainkan pelbagai peranan yang berharga. Kami telah mendapati bahawa anjing mahir dalam banyak perkara, termasuk menjaga rumah dan bermain dengan kanak-kanak, tetapi kami tidak melakukannya melalui kejuruteraan Kami memilih dan memperbaiki sifat tersebut melalui pembiakan, melalui mengubah formula mereka. Tetapi anda tidak akan mengharapkan anjing anda menulis artikel anda untuk anda, anda tahu mereka tidak boleh melakukannya, dan anda mungkin juga tidak mengharapkan anjing anda melakukannya.

CtGPT Perkara yang mengejutkan tentang keseluruhan perkara ini ialah saya fikir ini adalah kali pertama sistem AI benar-benar memasuki mata umum, yang merupakan Perubahan besar. OpenAI sendiri mempunyai pepatah yang baik, iaitu, walaupun ChatGPT bukanlah kecerdasan sebenar, ia membolehkan tubuh manusia merasai kesedaran kecerdasan sebenar (buatan), dan semua orang boleh menggunakan kecerdasan itu untuk melakukan semua jenis perkara yang mereka mahu lakukan .

Heart of the Machine: Satu lagi perkara yang ramai orang bimbang ialah kehilangan tugas perantaraan yang dibawa oleh LLM. Adakah anda fikir tugas perantaraan ini, seperti analisis semantik dan analisis sintaksis, mempunyai banyak nilai sekarang dari perspektif lelaran teknikal, dan adakah tugasan tersebut benar-benar hilang pada masa hadapan? Adakah penyelidik dan pengamal AI berada di tengah-tengah, mereka yang tidak mempunyai sumber perkakasan yang berkuasa atau pengetahuan domain yang kukuh, dalam bahaya kehilangan pekerjaan mereka?

Stuart Russell: Itu soalan yang bagus. Hakikatnya adalah sukar untuk menerbitkan kertas mengenai analisis semantik pada hari ini Malah, sukar untuk mendapatkan orang dalam komuniti NLP mendengar apa-apa sekarang melainkan anda bercakap tentang model besar bahasa, atau menyegarkan penanda aras besar dengan model besar. Hampir semua kertas kerja adalah mengenai menyegarkan penanda aras besar Sukar untuk menerbitkan artikel yang bukan tentang menyegarkan penanda aras besar, seperti struktur bahasa, pemahaman bahasa atau analisis semantik, analisis sintaksis, dll., jadi penanda aras besar untuk menilai model besar. Adakah Ia telah menjadi satu-satunya pilihan untuk menulis kertas kerja, dan penanda aras besar ini tidak ada kaitan dengan bahasa.

Dalam satu segi, dalam bidang pemprosesan bahasa semula jadi hari ini, kita tidak lagi mengkaji bahasa, yang saya rasa amat malang. Perkara yang sama berlaku untuk penglihatan komputer Dalam kebanyakan penyelidikan penglihatan komputer hari ini, kita tidak lagi mengkaji penglihatan, kita hanya mengkaji data, latihan dan ketepatan ramalan.

Mengenai cara membangunkan AI seterusnya, saya fikir kita harus fokus pada kaedah yang kita faham, fokus pada pengetahuan dan penaakulan logik. Sebabnya adalah dua kali ganda, pertama kami mahu sistem AI boleh dipercayai, kami perlu memastikan ia selamat dan terkawal secara matematik, dan ini bermakna kami perlu memahami sistem yang kami bina.

Kedua, dari sudut kecekapan data, yang diperlukan jika kecerdasan am ingin dicapai, otak manusia beroperasi pada 20 watt dan bukannya 20 megawatt. Litar bukanlah bahasa yang sangat ekspresif, kecekapan data algoritma ini adalah susunan magnitud yang lebih rendah daripada pembelajaran manusia, dan anda akan menghadapi kesukaran untuk menulis banyak perkara yang kita ketahui tentang dunia dalam litar. Sebaik sahaja kami mempunyai komputer tujuan umum dan bahasa pengaturcaraan, kami berhenti menggunakan litar kerana ia lebih mudah dan lebih mudah digunakan untuk menyatakan perkara yang kami mahukan dalam program, sesuatu yang telah dilupakan oleh komuniti AI Pada satu ketika, ramai orang pergi sesat.

-3-

Jantung Mesin: Edisi keempat "Kecerdasan Buatan: Pendekatan Moden" mempunyai kemas kini penting, iaitu , tidak Andaikan lagi bahawa sistem atau ejen AI mempunyai matlamat yang tetap. Sebelum ini, tujuan kecerdasan buatan ditakrifkan sebagai "mewujudkan sistem yang cuba memaksimumkan utiliti yang diharapkan, dengan matlamat yang ditetapkan oleh manusia sekarang kami tidak lagi menetapkan matlamat untuk sistem AI.

Stuart Russell: Terdapat beberapa sebab. Pertama, apabila kecerdasan buatan bergerak keluar dari makmal dan ke dunia nyata, kami mendapati sukar untuk menentukan matlamat kami dengan betul. Sebagai contoh, apabila anda memandu di jalan raya, anda ingin sampai ke destinasi anda dengan cepat, tetapi itu tidak bermakna anda perlu memandu sejauh 200 batu sejam dan jika anda memberitahu kereta pandu sendiri untuk mengutamakan keselamatan, ia mungkin akan diletakkan di dalam garaj selama-lamanya. Terdapat pertukaran antara matlamat untuk sampai ke destinasi anda dengan selamat dan cepat, serta mesra dengan pemandu lain, tidak membuat penumpang tidak selesa, mematuhi undang-undang dan peraturan, dsb. Selalu ada beberapa risiko di jalan raya, dan beberapa kemalangan yang tidak dapat dielakkan akan berlaku Sukar untuk menulis semua matlamat anda semasa memandu, dan memandu hanyalah perkara kecil dan mudah dalam hidup. Oleh itu, dari perspektif praktikal, menetapkan matlamat untuk sistem AI adalah tidak munasabah.

Yang kedua melibatkan Masalah Raja Midas (Masalah Raja Midas) yang saya berikan dalam buku. Midas adalah seorang raja dalam mitologi Yunani Dia sangat tamak dan meminta Tuhan untuk memberinya kuasa untuk mengubah segala-galanya menjadi emas dan semua yang disentuhnya berubah menjadi emas, tetapi kemudiannya air dan makanannya juga bertukar menjadi emas, dan ahli keluarganya juga bertukar menjadi emas setelah disentuh olehnya Akhirnya, dia mati dengan tragis dikelilingi oleh emas. Ini mengingatkan kami bahawa apabila anda mentakrifkan matlamat untuk sistem yang sangat berkuasa, lebih baik anda memastikan bahawa matlamat yang anda tetapkan adalah betul-betul betul. Tetapi sekarang setelah kita tahu kita tidak boleh melakukannya, ia menjadi semakin penting apabila sistem AI menjadi lebih berkuasa sehingga mereka tidak tahu apakah matlamat sebenar mereka.

Matlamat sebenarnya adalah perkara yang sangat rumit. Sebagai contoh, jika saya katakan saya ingin membeli buah oren untuk makan tengah hari, itu boleh menjadi matlamat, bukan? Dalam konteks seharian, matlamat dilihat sebagai sesuatu yang boleh dicapai, dan apabila dicapai, ia dilakukan. Tetapi dalam teori pilihan rasional yang ditakrifkan oleh falsafah dan ekonomi, tidak ada matlamat sedemikian. Apa yang kita ada adalah keutamaan atau kedudukan pelbagai masa depan yang mungkin berlaku dari sekarang hingga akhir zaman. Saya fikir ia adalah pemahaman yang lebih kompleks dan lebih mendalam tentang tujuan, tentang apa yang sebenarnya manusia inginkan.

Jantung Mesin: Apakah kesan transformasi ini terhadap pembangunan kecerdasan buatan pada masa hadapan?

Stuart Russell: Sejak kelahiran kecerdasan buatan bersama sains komputer pada tahun 1940-an dan Tahun 1950-an, penyelidik perlu mempunyai konsep kecerdasan untuk, dapat menjalankan penyelidikan berdasarkannya. Walaupun beberapa kerja awal lebih kepada meniru kognisi manusia, konsep rasional yang akhirnya menang: Lebih baik mesin boleh mencapai matlamat yang dimaksudkan melalui tindakan, lebih bijak kita menganggapnya.

Dalam model piawai kecerdasan buatan, ini adalah jenis mesin yang kami cuba ciptakan; manusia menentukan matlamat dan mesin melakukan yang lain. Sebagai contoh, untuk sistem penyelesaian dalam persekitaran yang menentukan, kami memberikan fungsi kos dan kriteria matlamat untuk membolehkan mesin mencari urutan tindakan dengan kos terkecil untuk mencapai keadaan matlamat untuk sistem pembelajaran pengukuhan dalam persekitaran stokastik, kami berikan fungsi ganjaran dan faktor diskaun , biarkan mesin mempelajari strategi yang memaksimumkan jumlah ganjaran diskaun yang dijangkakan. Pendekatan ini juga boleh dilihat di luar bidang kecerdasan buatan: saintis kawalan meminimumkan fungsi kos, penyelidik operasi memaksimumkan ganjaran, ahli statistik meminimumkan fungsi kerugian yang dijangkakan, dan ahli ekonomi memaksimumkan utiliti individu atau kebajikan kumpulan.

Tetapi Model Standard sebenarnya salah. Seperti yang baru dikatakan, hampir mustahil bagi kita untuk menentukan matlamat kita dengan betul, dan apabila matlamat mesin tidak sepadan dengan apa yang kita mahukan, kita mungkin kehilangan kawalan ke atas mesin kerana mesin akan mengambil langkah awal dan melakukan apa sahaja. mengambil. Harga memastikan bahawa ia mencapai matlamat yang dinyatakan. Hampir semua sistem AI sedia ada dibangunkan dalam rangka kerja model standard, yang menimbulkan masalah besar.

Dalam "Kecerdasan Buatan: Pendekatan Moden (Edisi Ke-4)", kami mencadangkan bahawa kecerdasan buatan memerlukan model baharu, Model baharu ini menekankan ketidakpastian matlamat sistem AI Ketidakpastian ini membolehkan mesin mempelajari pilihan manusia dan mencari pendapat manusia sebelum mengambil tindakan. Semasa operasi sistem AI, mesti ada beberapa maklumat yang mengalir dari manusia ke mesin yang menggambarkan keutamaan sebenar manusia, dan bukannya matlamat manusia menjadi tidak relevan sebaik sahaja ia ditetapkan pada mulanya. Ini memerlukan mesin penyahgandingan daripada matlamat tetap dan gandingan binari antara mesin dan manusia. Model Standard boleh dianggap sebagai kes yang melampau di mana mesin boleh menentukan dengan betul matlamat manusia yang dikehendaki, seperti bermain Go atau menyelesaikan teka-teki, dalam skop mesin.

Kami juga menyediakan beberapa contoh dalam buku untuk menggambarkan cara model baharu berfungsi, seperti pilihan yang tidak pasti, masalah mati suis, permainan Bantuan tambahan, dsb. Tetapi ini hanyalah permulaan, dan kami baru sahaja mula mengkajinya.

Jantung Mesin: Dalam bidang kecerdasan buatan yang berkembang pesat, bagaimana untuk mengikuti aliran teknologi tanpa mengejar titik panas secara membabi buta? Apakah yang perlu diingat oleh penyelidik dan pengamal AI?

Stuart Russell: Untuk membina sistem yang benar-benar pintar, saya fikir masalah asas Ia mampu menggunakan bahasa ekspresif untuk menyatakan pelbagai penyelewengan yang terkandung dalam alam semesta. Perbezaan penting antara perisikan dan litar ialah, setakat yang kita tahu, litar tidak dapat mewakili penyelewengan tersebut dengan baik, yang dalam praktiknya menunjukkan dirinya sebagai kecekapan data yang melampau rendah.

Sebagai contoh mudah, saya boleh menulis takrifan fungsi sinus (dengan formula matematik), atau saya boleh cuba menerangkan fungsi sinus secara empirik menggunakan bilangan piksel yang besar. Jika saya hanya mempunyai 10 juta piksel, saya hanya boleh menutup sebahagian daripada fungsi sinus, dan jika saya melihat kawasan yang saya tutup, saya nampaknya mempunyai model fungsi sinus yang cukup bagus. Tetapi sebenarnya, saya tidak begitu memahami fungsi sinus, saya tidak tahu bentuk fungsi itu, dan saya tidak tahu sifat matematiknya.

Saya khuatir kita memperbodohkan diri sendiri dengan menganggap kita sedang menuju ke arah kecerdasan sebenar. Apa yang sebenarnya kami lakukan ialah menambah lebih banyak piksel kepada sesuatu yang sebenarnya bukan model pintar sama sekali.

Saya fikir apabila membina sistem AI, kita perlu menumpukan pada kaedah dengan keupayaan perwakilan asas, yang terasnya terletak pada kebolehan mengisytiharkan semua objek . Katakan saya ingin menulis peraturan Go Kemudian peraturan ini mesti digunakan untuk setiap petak di papan saya boleh mengatakan apa yang akan berlaku kepada setiap y saya juga boleh menulisnya dalam C++ atau Python Ditulis dalam bahasa Inggeris, ditulis dalam logik urutan pertama. Setiap bahasa ini membolehkan saya menulis peraturan dengan cara yang sangat ringkas kerana mereka semua mempunyai kuasa ekspresif untuk menyatakan peraturan ini. Walau bagaimanapun, saya tidak boleh melakukan ini dalam litar, dan perwakilan berasaskan litar (termasuk sistem pembelajaran mendalam) tidak boleh mewakili kelas generalisasi ini.

Mengabaikan fakta ini dan cuba mencapai kecerdasan melalui data besar adalah tidak masuk akal pada pendapat saya Ia seperti mengatakan bahawa anda tidak perlu memahami apa itu Go buah catur, kerana kita mempunyai berbilion contoh latihan. Jika anda berfikir tentang apa yang telah dilakukan oleh kecerdasan manusia, kami membina LIGO dan mengesan gelombang graviti dari seberang alam semesta. Bagaimana kami melakukannya? Berdasarkan pengetahuan dan penaakulan. Sebelum membina LIGO, di manakah kami mengumpul sampel latihan? Jelas sekali, pendahulu mempelajari beberapa perkara, termasuk pengalaman deria mereka, dan kemudian merekodkannya dalam bahasa ekspresif seperti bahasa Inggeris dan matematik Kami belajar daripada mereka, memahami undang-undang alam semesta, dan menjalankan penaakulan dan kejuruteraan berdasarkan ini reka bentuk, dsb., dengan itu memerhatikan perlanggaran lubang hitam di hujung alam semesta yang lain.

Sudah tentu, adalah mungkin untuk mencapai kecerdasan berdasarkan data besar. Ia juga mungkin untuk mengembangkan program Fortran yang lebih pintar daripada manusia. Tetapi kami telah menghabiskan lebih daripada dua ribu tahun untuk memahami pengetahuan dan penaakulan, dan telah membangunkan sejumlah besar teknologi cemerlang berdasarkan pengetahuan dan penaakulan, dan beribu-ribu aplikasi berguna telah dibangunkan berdasarkan teknologi ini. Sekarang anda berminat dengan kecerdasan tetapi bukan pengetahuan dan penaakulan, saya tidak mempunyai apa-apa untuk mengatakan tentang itu.

Atas ialah kandungan terperinci Temu bual dengan Stuart Russell: Berkenaan ChatGPT, lebih banyak data dan lebih banyak kuasa pengkomputeran tidak boleh membawa kecerdasan sebenar. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1386

1386

52

52

Cara Memeriksa Konfigurasi HDFS CentOS

Apr 14, 2025 pm 07:21 PM

Cara Memeriksa Konfigurasi HDFS CentOS

Apr 14, 2025 pm 07:21 PM

Panduan Lengkap untuk Memeriksa Konfigurasi HDFS Dalam Sistem CentOS Artikel ini akan membimbing anda bagaimana untuk memeriksa konfigurasi dan menjalankan status HDFS secara berkesan pada sistem CentOS. Langkah -langkah berikut akan membantu anda memahami sepenuhnya persediaan dan operasi HDFS. Sahkan Pembolehubah Alam Sekitar Hadoop: Pertama, pastikan pembolehubah persekitaran Hadoop ditetapkan dengan betul. Di terminal, laksanakan arahan berikut untuk mengesahkan bahawa Hadoop dipasang dan dikonfigurasi dengan betul: Hadoopversion Semak fail konfigurasi HDFS: Fail konfigurasi teras HDFS terletak di/etc/hadoop/conf/direktori, di mana core-site.xml dan hdfs-site.xml adalah kritikal. gunakan

Baris arahan shutdown centos

Apr 14, 2025 pm 09:12 PM

Baris arahan shutdown centos

Apr 14, 2025 pm 09:12 PM

Perintah shutdown CentOS adalah penutupan, dan sintaks adalah tutup [pilihan] [maklumat]. Pilihan termasuk: -h menghentikan sistem dengan segera; -P mematikan kuasa selepas penutupan; -r mulakan semula; -T Waktu Menunggu. Masa boleh ditentukan sebagai segera (sekarang), minit (minit), atau masa tertentu (HH: mm). Maklumat tambahan boleh dipaparkan dalam mesej sistem.

Apakah kaedah sandaran untuk gitlab di centos

Apr 14, 2025 pm 05:33 PM

Apakah kaedah sandaran untuk gitlab di centos

Apr 14, 2025 pm 05:33 PM

Dasar sandaran dan pemulihan Gitlab di bawah sistem CentOS untuk memastikan keselamatan data dan pemulihan, Gitlab pada CentOS menyediakan pelbagai kaedah sandaran. Artikel ini akan memperkenalkan beberapa kaedah sandaran biasa, parameter konfigurasi dan proses pemulihan secara terperinci untuk membantu anda menubuhkan strategi sandaran dan pemulihan GitLab lengkap. 1. Backup Manual Gunakan Gitlab-Rakegitlab: Backup: Buat Perintah untuk Melaksanakan Backup Manual. Perintah ini menyokong maklumat utama seperti repositori Gitlab, pangkalan data, pengguna, kumpulan pengguna, kunci, dan kebenaran. Fail sandaran lalai disimpan dalam direktori/var/opt/gitlab/sandaran. Anda boleh mengubah suai /etc /gitlab

CentOS memasang MySQL

Apr 14, 2025 pm 08:09 PM

CentOS memasang MySQL

Apr 14, 2025 pm 08:09 PM

Memasang MySQL pada CentOS melibatkan langkah -langkah berikut: Menambah sumber MySQL YUM yang sesuai. Jalankan YUM Pasang Perintah MySQL-Server untuk memasang pelayan MySQL. Gunakan perintah mysql_secure_installation untuk membuat tetapan keselamatan, seperti menetapkan kata laluan pengguna root. Sesuaikan fail konfigurasi MySQL seperti yang diperlukan. Tune parameter MySQL dan mengoptimumkan pangkalan data untuk prestasi.

Cara Melihat Log Gitlab Di Bawah Centos

Apr 14, 2025 pm 06:18 PM

Cara Melihat Log Gitlab Di Bawah Centos

Apr 14, 2025 pm 06:18 PM

Panduan Lengkap untuk Melihat Log Gitlab Di bawah Sistem CentOS Artikel ini akan membimbing anda bagaimana untuk melihat pelbagai log Gitlab dalam sistem CentOS, termasuk log utama, log pengecualian, dan log lain yang berkaitan. Sila ambil perhatian bahawa laluan fail log mungkin berbeza -beza bergantung pada versi GitLab dan kaedah pemasangan. Jika laluan berikut tidak wujud, sila semak fail Direktori Pemasangan dan Konfigurasi GitLab. 1. Lihat log Gitlab utama Gunakan arahan berikut untuk melihat fail log utama aplikasi GitLabRails: Perintah: Sudocat/var/Log/Gitlab/Gitlab-Rails/Production.log Perintah ini akan memaparkan produk

Cara Mengendalikan Latihan Pittorch Diagihkan di Centos

Apr 14, 2025 pm 06:36 PM

Cara Mengendalikan Latihan Pittorch Diagihkan di Centos

Apr 14, 2025 pm 06:36 PM

Latihan yang diedarkan Pytorch pada sistem CentOS memerlukan langkah -langkah berikut: Pemasangan Pytorch: Premisnya ialah Python dan PIP dipasang dalam sistem CentOS. Bergantung pada versi CUDA anda, dapatkan arahan pemasangan yang sesuai dari laman web rasmi Pytorch. Untuk latihan CPU sahaja, anda boleh menggunakan arahan berikut: PipinstallToRchTorchVisionTorchaudio Jika anda memerlukan sokongan GPU, pastikan versi CUDA dan CUDNN yang sama dipasang dan gunakan versi pytorch yang sepadan untuk pemasangan. Konfigurasi Alam Sekitar Teragih: Latihan yang diedarkan biasanya memerlukan pelbagai mesin atau mesin berbilang mesin tunggal. Tempat

Penjelasan terperinci mengenai Prinsip Docker

Apr 14, 2025 pm 11:57 PM

Penjelasan terperinci mengenai Prinsip Docker

Apr 14, 2025 pm 11:57 PM

Docker menggunakan ciri -ciri kernel Linux untuk menyediakan persekitaran berjalan yang cekap dan terpencil. Prinsip kerjanya adalah seperti berikut: 1. Cermin digunakan sebagai templat baca sahaja, yang mengandungi semua yang anda perlukan untuk menjalankan aplikasi; 2. Sistem Fail Kesatuan (Unionfs) menyusun pelbagai sistem fail, hanya menyimpan perbezaan, menjimatkan ruang dan mempercepatkan; 3. Daemon menguruskan cermin dan bekas, dan pelanggan menggunakannya untuk interaksi; 4. Ruang nama dan cgroups melaksanakan pengasingan kontena dan batasan sumber; 5. Pelbagai mod rangkaian menyokong interkoneksi kontena. Hanya dengan memahami konsep -konsep teras ini, anda boleh menggunakan Docker dengan lebih baik.

Bagaimana sokongan GPU untuk Pytorch di CentOS

Apr 14, 2025 pm 06:48 PM

Bagaimana sokongan GPU untuk Pytorch di CentOS

Apr 14, 2025 pm 06:48 PM

Membolehkan pecutan GPU pytorch pada sistem CentOS memerlukan pemasangan cuda, cudnn dan GPU versi pytorch. Langkah-langkah berikut akan membimbing anda melalui proses: Pemasangan CUDA dan CUDNN Tentukan keserasian versi CUDA: Gunakan perintah NVIDIA-SMI untuk melihat versi CUDA yang disokong oleh kad grafik NVIDIA anda. Sebagai contoh, kad grafik MX450 anda boleh menyokong CUDA11.1 atau lebih tinggi. Muat turun dan pasang Cudatoolkit: Lawati laman web rasmi Nvidiacudatoolkit dan muat turun dan pasang versi yang sepadan mengikut versi CUDA tertinggi yang disokong oleh kad grafik anda. Pasang Perpustakaan Cudnn: