Peranti teknologi

Peranti teknologi

AI

AI

Pra-latihan tanpa perhatian; Pembelajaran Dalam Konteks didorong oleh GPT

Pra-latihan tanpa perhatian; Pembelajaran Dalam Konteks didorong oleh GPT

Pra-latihan tanpa perhatian; Pembelajaran Dalam Konteks didorong oleh GPT

Kertas 1: ClimateNeRF: Rendering Neural Berasaskan Fizikal untuk Sintesis Iklim Ekstrim

- Pengarang: Yuan Li et al

- Alamat kertas: https://arxiv.org/pdf/2211.13226.pdf

Abstrak: Kertas kerja ini memperkenalkan kaedah baharu untuk menggabungkan simulasi fizikal dengan model adegan NeRF untuk menjana filem realistik fenomena fizikal dalam babak ini. Dari segi keputusan konkrit, kaedah ini boleh mensimulasikan kemungkinan kesan perubahan iklim secara realistik - apakah rupa taman permainan selepas banjir berskala kecil? Bagaimana pula selepas banjir besar? Bagaimana pula selepas ribut salji?

Disyorkan: Kabus, musim sejuk, banjir, model NeRF baharu menjadikan realistik fizikal filem blockbuster.

Kertas 2: Pralatihan Tanpa Perhatian

- Pengarang: Junxiong Wang et al

- Alamat kertas: https://arxiv.org/pdf/2212.10544.pdf

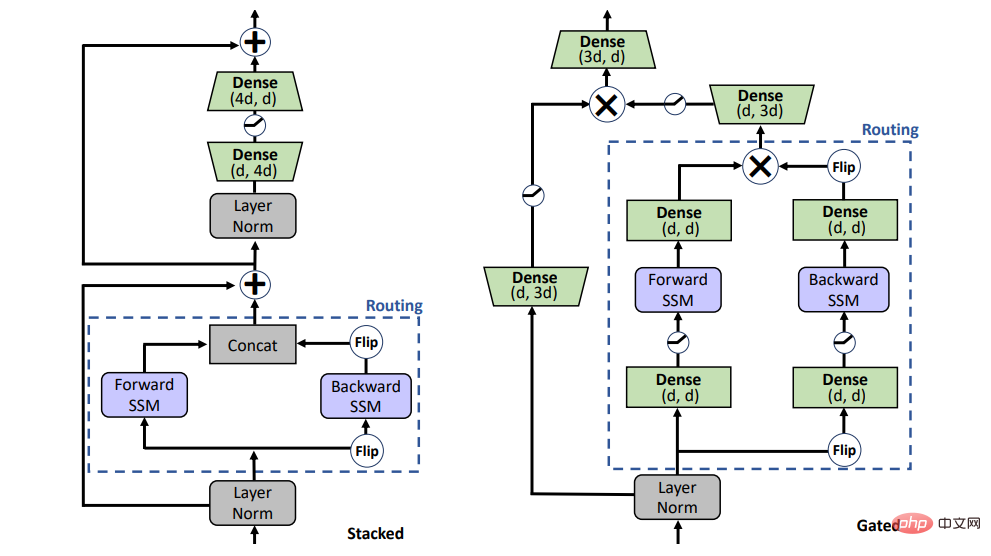

Abstrak: Kertas ini mencadangkan model Dwiarah Gating SSM (BiGS), yang menggabungkan lapisan Penghalaan berdasarkan Model Ruang Negeri (SSM) dan seni bina model berasaskan get darab untuk mereplikasi ramalan BERT tanpa menggunakan perhatian. .

Cadangan: Pra-latihan tidak memerlukan perhatian dan penskalaan kepada 4096 token tidak menjadi masalah, setanding dengan BERT.

Kertas 3: Satu Model untuk Mengedit Kesemuanya: Manipulasi Imej Dipacu Teks Bentuk Percuma dengan Modulasi Semantik

- Pengarang: Yiming Zhu et al

- Alamat kertas: https://arxiv.org/pdf/2210.07883.pdf

Abstrak: Baru-baru ini, menggunakan teks untuk membimbing penyuntingan imej telah mencapai kemajuan dan perhatian yang hebat, terutamanya berdasarkan model penyebaran denoising seperti StableDiffusion atau DALLE wait . Walau bagaimanapun, penyuntingan imej teks berasaskan GAN masih mempunyai beberapa masalah yang menunggu untuk diselesaikan Contohnya, dalam StyleCILP klasik, model mesti dilatih untuk setiap teks pendekatan satu-teks-ke-model tunggal ini menyusahkan dalam praktikal aplikasi.

Artikel ini mencadangkan FFCLIP dan menyelesaikan masalah ini Untuk input teks berbeza yang fleksibel, FFCLIP hanya memerlukan satu model untuk mengedit imej dengan sewajarnya, tanpa melatih semula model untuk setiap teks , dan mencapainya keputusan yang baik pada beberapa set data. Artikel ini telah diterima oleh NeurIPS 2022.

Disyorkan: Paradigma baharu untuk penyuntingan teks dan imej, satu model membolehkan penyuntingan imej berpandukan berbilang teks.

Kertas 4: ARAHAN KENDIRI: Menjajarkan Model Bahasa dengan Arahan Dihasilkan Sendiri

- Pengarang: Yizhong Wang et al

- Alamat kertas: https://arxiv.org/pdf/2212.10560v1.pdf

Abstrak: Universiti Washington dan institusi lain baru-baru ini bersama-sama menerbitkan sebuah kertas kerja Rangka kerja baharu INSTRUCT KENDIRI meningkatkan prestasi model bahasa yang telah dilatih dengan membimbing model tersebut. proses penjanaan sendiri. ARAHAN KENDIRI ialah proses separa automatik yang melakukan penalaan arahan pada LM pra-latihan menggunakan isyarat arahan daripada model itu sendiri.

Disyorkan: Tidak memerlukan anotasi manual, rangka kerja arahan yang dijana sendiri memecahkan kesesakan kos LLM seperti ChatGPT.

Kertas 5: Ab Initio Pengiraan Pepejal Nyata melalui Ansatz Rangkaian Neural

- Pengarang: Xiang Li et al

- Alamat kertas: https://www.nature.com/articles/s41467-022 - 35627-1

Abstrak: Pembelajaran mesin boleh memproses sejumlah besar data, menyelesaikan masalah saintifik dalam senario yang kompleks dan memimpin penerokaan saintifik kepada kawasan yang mustahil pada masa lalu. Sebagai contoh, DeepMind menggunakan perisian kecerdasan buatan AlphaFold untuk membuat ramalan yang sangat tepat bagi hampir semua struktur protein yang diketahui oleh komuniti saintifik kaedah halaju imej zarah (PIV) berdasarkan pembelajaran mendalam yang dicadangkan oleh Christian Lagemann telah banyak menambah baik tetapan manual semata-mata; daripada parameter. Skop penggunaan model adalah amat penting untuk penyelidikan dalam banyak bidang seperti kereta, aeroangkasa dan kejuruteraan bioperubatan.

Baru-baru ini, kerja "Pengiraan Ab initio pepejal sebenar melalui ansatz rangkaian saraf" oleh pasukan Penyelidikan Makmal AI ByteDance dan kumpulan penyelidik Chen Ji di Sekolah Fizik Universiti Peking menyediakan kaedah untuk mengkaji jirim pekat Satu idea baru dalam fizik, kerja ini mencadangkan fungsi gelombang rangkaian saraf pertama industri yang sesuai untuk sistem pepejal, merealisasikan pengiraan prinsip pertama pepejal, dan menolak keputusan pengiraan ke had termodinamik. Ia amat membuktikan bahawa rangkaian saraf ialah alat yang cekap untuk mengkaji fizik keadaan pepejal, dan juga menunjukkan bahawa teknologi pembelajaran mendalam akan memainkan peranan yang semakin penting dalam fizik jirim pekat. Hasil penyelidikan yang berkaitan telah diterbitkan dalam jurnal antarabangsa teratas Nature Communication pada 22 Disember 2022.

Disyorkan: Fungsi gelombang rangkaian saraf pertama industri yang sesuai untuk sistem pepejal telah diterbitkan dalam sub-jurnal Nature.

Kertas 6: Mengapa GPT Boleh Belajar Dalam Konteks Model Secara Rahsia Melakukan Keturunan Kecerunan sebagai Pengoptimum Meta

- Pengarang: Damai Dai et al

- Alamat kertas: https://arxiv.org/pdf/2212.10559v2.pdf

Abstrak: Pembelajaran Dalam Konteks (ICL) telah mencapai kejayaan besar pada model bahasa pra-latihan yang besar, tetapi mekanisme kerjanya masih merupakan Soalan yang tidak dijawab. Dalam artikel ini, penyelidik dari Universiti Peking, Universiti Tsinghua dan Microsoft memahami ICL sebagai sejenis penalaan halus tersirat, dan memberikan bukti empirikal untuk membuktikan bahawa ICL dan penalaan halus eksplisit berprestasi serupa pada pelbagai peringkat.

Disyorkan: Mengapakah Pembelajaran Dalam Konteks, didorong oleh GPT, berfungsi? Model melakukan penurunan kecerunan secara rahsia.

Kertas 7: Petunjuk Eksperimen Fungsi Otak Bukan Klasik

- Pengarang: Christian Matthias Kerskens et al

- Alamat kertas: https://iopscience.iop.org/article/10.1088/2399-6528/ac94be

Abstrak: Selama beberapa dekad, saintis telah meneroka mekanisme pengkomputeran dan pemikiran otak manusia. Namun, struktur otak manusia terlalu kompleks, mengandungi berpuluh bilion neuron, bersamaan dengan trilion cip, jadi sukar untuk kita ketahui. Roger Penrose, yang memenangi Hadiah Nobel dalam Fizik untuk sumbangannya kepada kajian lubang hitam, pernah dengan berani mencadangkan idea "kesedaran kuantum", iaitu, otak manusia itu sendiri adalah struktur kuantum, atau komputer kuantum. Tetapi pandangan ini telah dipersoalkan.

Kajian baru-baru ini dari Universiti Trinity Dublin mencadangkan bahawa otak kita melakukan pengiraan kuantum, dengan alasan bahawa terdapat kekusutan dalam otak manusia yang dimediasi oleh fungsi otak yang berkaitan dengan kesedaran. Jika fungsi otak ini mesti beroperasi dengan cara bukan klasik, maka ini bermakna kesedaran adalah bukan klasik, iaitu proses kognitif otak melibatkan pengiraan kuantum.

Disyorkan: Pemikiran otak ialah pengkomputeran kuantum. Terdapat bukti baharu untuk spekulasi ini.

Stesen Radio Mingguan ArXiv

Heart of Machine bekerjasama dengan Stesen Radio Mingguan ArXiv yang dimulakan oleh Chu Hang dan Luo Ruotian, dan memilih kertas kerja yang lebih penting minggu ini berdasarkan 7 Kertas, termasuk 10 kertas terpilih setiap satu dalam bidang NLP, CV dan ML . Dan sediakan ringkasan audio kertas tersebut, butirannya adalah seperti berikut:

10 Kertas NLPAudio: 00:0020:18

10 kertas NLP terpilih minggu ini Ya:

1 Adakah induksi tatabahasa yang tidak diawasi memerlukan piksel? (daripada Serge Belongie, Kilian Q. Weinberger, Jitendra Malik, Trevor Darrell)

2. Memahami Stereotaip dalam Model Bahasa: Ke Arah Pengukuran Teguh dan Penyahbiakan Pukulan Sifar (dari Bernhard Schölkopf)

3 Terjemahan Mesin dan Penilaian Kontrastif (daripada Cordelia Schmid, Ivan Laptev)

4 )

5 Mengenai Penggunaan Data Selari untuk Anggaran Kualiti Terjemahan (dari Dacheng Tao)

6 Penilaian Suka Manusia untuk Penjanaan Bahasa Semulajadi dengan Analisis Ralat (dari Dacheng Tao)

7 Bolehkah Model Dialog Berorientasikan Tugasan Semasa Mengautomasikan Senario Dunia Sebenar? (dari Kyunghyun Cho )

8 Pada Titik Buta Metrik Penilaian Berasaskan Model untuk Penjanaan Teks (daripada Kyunghyun Cho)

9. Beyond Contrastive Learning: Model Generative Variational for Multilingual Retrieval (daripada William W. Cohen)

10. Kesan Perwakilan Simbolik terhadap Pembelajaran Dalam Konteks. daripada Li Erran Li, Eric Xing)

10 Kertas CVAudio: 00:0023: 15

10 kertas kerja unggulan CV minggu ini ialah:

1. -Penjanaan Imej. (daripada Eric Horvitz)

3. Tinjauan Ringkas tentang Pengecaman Orang pada Jarak Jauh (daripada Rama Chellappa)

. 4. MetaCLUE: Towards Comprehensive Visual Metaphors Research (dari Leonidas Guibas, William T. Freeman)

5. Aliasing ialah Pemacu Serangan Adversarial

6. Rangkaian Lajur Boleh Balik (dari Xiangyu Zhang)

7 Hi-LASSIE: High-Fidelity Articulated Shape and Skeleton Discovery daripada Jarang Imej Ensemble. . (daripada Ming-Hsuan Yang)

8. Pembesaran Titik Tahap Objek untuk Pengesanan Objek 3D Separa diselia (dari Ming-Hsuan Yang)

9. Melancarkan Kuasa Penggerak Visual Pada Tahap Piksel (daripada Alan Yuille)

10. Daripada Imej kepada Gesaan Teks: VQA Tangkapan Sifar dengan Model Bahasa Besar Pembekuan. (dari Dacheng Tao, Steven C.H. Hoi)

Atas ialah kandungan terperinci Pra-latihan tanpa perhatian; Pembelajaran Dalam Konteks didorong oleh GPT. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

Sumber terbuka! Di luar ZoeDepth! DepthFM: Anggaran kedalaman monokular yang cepat dan tepat!

Apr 03, 2024 pm 12:04 PM

Sumber terbuka! Di luar ZoeDepth! DepthFM: Anggaran kedalaman monokular yang cepat dan tepat!

Apr 03, 2024 pm 12:04 PM

0. Apakah fungsi artikel ini? Kami mencadangkan DepthFM: model anggaran kedalaman monokular generatif yang serba boleh dan pantas. Sebagai tambahan kepada tugas anggaran kedalaman tradisional, DepthFM juga menunjukkan keupayaan terkini dalam tugas hiliran seperti mengecat kedalaman. DepthFM cekap dan boleh mensintesis peta kedalaman dalam beberapa langkah inferens. Mari kita baca karya ini bersama-sama ~ 1. Tajuk maklumat kertas: DepthFM: FastMonocularDepthEstimationwithFlowMatching Pengarang: MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Bayangkan model kecerdasan buatan yang bukan sahaja mempunyai keupayaan untuk mengatasi pengkomputeran tradisional, tetapi juga mencapai prestasi yang lebih cekap pada kos yang lebih rendah. Ini bukan fiksyen sains, DeepSeek-V2[1], model MoE sumber terbuka paling berkuasa di dunia ada di sini. DeepSeek-V2 ialah gabungan model bahasa pakar (MoE) yang berkuasa dengan ciri-ciri latihan ekonomi dan inferens yang cekap. Ia terdiri daripada 236B parameter, 21B daripadanya digunakan untuk mengaktifkan setiap penanda. Berbanding dengan DeepSeek67B, DeepSeek-V2 mempunyai prestasi yang lebih kukuh, sambil menjimatkan 42.5% kos latihan, mengurangkan cache KV sebanyak 93.3% dan meningkatkan daya pemprosesan penjanaan maksimum kepada 5.76 kali. DeepSeek ialah sebuah syarikat yang meneroka kecerdasan buatan am

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

Awal bulan ini, penyelidik dari MIT dan institusi lain mencadangkan alternatif yang sangat menjanjikan kepada MLP - KAN. KAN mengatasi MLP dari segi ketepatan dan kebolehtafsiran. Dan ia boleh mengatasi prestasi MLP berjalan dengan bilangan parameter yang lebih besar dengan bilangan parameter yang sangat kecil. Sebagai contoh, penulis menyatakan bahawa mereka menggunakan KAN untuk menghasilkan semula keputusan DeepMind dengan rangkaian yang lebih kecil dan tahap automasi yang lebih tinggi. Khususnya, MLP DeepMind mempunyai kira-kira 300,000 parameter, manakala KAN hanya mempunyai kira-kira 200 parameter. KAN mempunyai asas matematik yang kukuh seperti MLP berdasarkan teorem penghampiran universal, manakala KAN berdasarkan teorem perwakilan Kolmogorov-Arnold. Seperti yang ditunjukkan dalam rajah di bawah, KAN telah

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas secara rasmi memasuki era robot elektrik! Semalam, Atlas hidraulik hanya "menangis" menarik diri daripada peringkat sejarah Hari ini, Boston Dynamics mengumumkan bahawa Atlas elektrik sedang berfungsi. Nampaknya dalam bidang robot humanoid komersial, Boston Dynamics berazam untuk bersaing dengan Tesla. Selepas video baharu itu dikeluarkan, ia telah pun ditonton oleh lebih sejuta orang dalam masa sepuluh jam sahaja. Orang lama pergi dan peranan baru muncul. Ini adalah keperluan sejarah. Tidak dinafikan bahawa tahun ini adalah tahun letupan robot humanoid. Netizen mengulas: Kemajuan robot telah menjadikan majlis pembukaan tahun ini kelihatan seperti manusia, dan tahap kebebasan adalah jauh lebih besar daripada manusia Tetapi adakah ini benar-benar bukan filem seram? Pada permulaan video, Atlas berbaring dengan tenang di atas tanah, seolah-olah terlentang. Apa yang berikut adalah rahang-jatuh

Apr 09, 2024 am 11:52 AM

Apr 09, 2024 am 11:52 AM

AI memang mengubah matematik. Baru-baru ini, Tao Zhexuan, yang telah mengambil perhatian terhadap isu ini, telah memajukan keluaran terbaru "Buletin Persatuan Matematik Amerika" (Buletin Persatuan Matematik Amerika). Memfokuskan pada topik "Adakah mesin akan mengubah matematik?", ramai ahli matematik menyatakan pendapat mereka Seluruh proses itu penuh dengan percikan api, tegar dan menarik. Penulis mempunyai barisan yang kuat, termasuk pemenang Fields Medal Akshay Venkatesh, ahli matematik China Zheng Lejun, saintis komputer NYU Ernest Davis dan ramai lagi sarjana terkenal dalam industri. Dunia AI telah berubah secara mendadak Anda tahu, banyak artikel ini telah dihantar setahun yang lalu.

Daya hidup kecerdasan super membangkitkan! Tetapi dengan kedatangan AI yang mengemas kini sendiri, ibu tidak perlu lagi bimbang tentang kesesakan data

Apr 29, 2024 pm 06:55 PM

Daya hidup kecerdasan super membangkitkan! Tetapi dengan kedatangan AI yang mengemas kini sendiri, ibu tidak perlu lagi bimbang tentang kesesakan data

Apr 29, 2024 pm 06:55 PM

Saya menangis hingga mati. Dunia sedang membina model besar. Data di Internet tidak mencukupi. Model latihan kelihatan seperti "The Hunger Games", dan penyelidik AI di seluruh dunia bimbang tentang cara memberi makan data ini kepada pemakan yang rakus. Masalah ini amat ketara dalam tugas berbilang modal. Pada masa mereka mengalami kerugian, pasukan pemula dari Jabatan Universiti Renmin China menggunakan model baharu mereka sendiri untuk menjadi yang pertama di China untuk menjadikan "suapan data yang dijana model itu sendiri" menjadi kenyataan. Selain itu, ia merupakan pendekatan serampang dua mata dari segi pemahaman dan sisi penjanaan Kedua-dua pihak boleh menjana data baharu berbilang modal yang berkualiti tinggi dan memberikan maklum balas data kepada model itu sendiri. Apakah model? Awaker 1.0, model berbilang modal besar yang baru sahaja muncul di Forum Zhongguancun. Siapa pasukan itu? Enjin Sophon. Diasaskan oleh Gao Yizhao, pelajar kedoktoran di Sekolah Kecerdasan Buatan Hillhouse Universiti Renmin.

Versi Kuaishou Sora 'Ke Ling' dibuka untuk ujian: menghasilkan video lebih 120-an, memahami fizik dengan lebih baik dan boleh memodelkan pergerakan kompleks dengan tepat

Jun 11, 2024 am 09:51 AM

Versi Kuaishou Sora 'Ke Ling' dibuka untuk ujian: menghasilkan video lebih 120-an, memahami fizik dengan lebih baik dan boleh memodelkan pergerakan kompleks dengan tepat

Jun 11, 2024 am 09:51 AM

Apa? Adakah Zootopia dibawa menjadi realiti oleh AI domestik? Didedahkan bersama-sama dengan video itu ialah model penjanaan video domestik berskala besar baharu yang dipanggil "Keling". Sora menggunakan laluan teknikal yang serupa dan menggabungkan beberapa inovasi teknologi yang dibangunkan sendiri untuk menghasilkan video yang bukan sahaja mempunyai pergerakan yang besar dan munasabah, tetapi juga mensimulasikan ciri-ciri dunia fizikal dan mempunyai keupayaan gabungan konsep dan imaginasi yang kuat. Mengikut data, Keling menyokong penjanaan video ultra panjang sehingga 2 minit pada 30fps, dengan resolusi sehingga 1080p dan menyokong berbilang nisbah aspek. Satu lagi perkara penting ialah Keling bukanlah demo atau demonstrasi hasil video yang dikeluarkan oleh makmal, tetapi aplikasi peringkat produk yang dilancarkan oleh Kuaishou, pemain terkemuka dalam bidang video pendek. Selain itu, tumpuan utama adalah untuk menjadi pragmatik, bukan untuk menulis cek kosong, dan pergi ke dalam talian sebaik sahaja ia dikeluarkan Model besar Ke Ling telah pun dikeluarkan di Kuaiying.

Tentera Udara A.S. mempamerkan jet pejuang AI pertamanya dengan profil tinggi! Menteri secara peribadi menjalankan pandu uji tanpa campur tangan semasa keseluruhan proses, dan 100,000 baris kod telah diuji selama 21 kali.

May 07, 2024 pm 05:00 PM

Tentera Udara A.S. mempamerkan jet pejuang AI pertamanya dengan profil tinggi! Menteri secara peribadi menjalankan pandu uji tanpa campur tangan semasa keseluruhan proses, dan 100,000 baris kod telah diuji selama 21 kali.

May 07, 2024 pm 05:00 PM

Baru-baru ini, bulatan tentera telah terharu dengan berita: jet pejuang tentera AS kini boleh melengkapkan pertempuran udara automatik sepenuhnya menggunakan AI. Ya, baru-baru ini, jet pejuang AI tentera AS telah didedahkan buat pertama kali, mendedahkan misterinya. Nama penuh pesawat pejuang ini ialah Variable Stability Simulator Test Aircraft (VISTA). Ia diterbangkan sendiri oleh Setiausaha Tentera Udara AS untuk mensimulasikan pertempuran udara satu lawan satu. Pada 2 Mei, Setiausaha Tentera Udara A.S. Frank Kendall berlepas menggunakan X-62AVISTA di Pangkalan Tentera Udara Edwards Ambil perhatian bahawa semasa penerbangan selama satu jam, semua tindakan penerbangan telah diselesaikan secara autonomi oleh AI! Kendall berkata - "Sejak beberapa dekad yang lalu, kami telah memikirkan tentang potensi tanpa had pertempuran udara-ke-udara autonomi, tetapi ia sentiasa kelihatan di luar jangkauan." Namun kini,