Peranti teknologi

Peranti teknologi

AI

AI

Universiti York: AI membuat kemajuan pesat, tetapi keupayaan pengecamannya masih jauh di belakang mata manusia

Universiti York: AI membuat kemajuan pesat, tetapi keupayaan pengecamannya masih jauh di belakang mata manusia

Universiti York: AI membuat kemajuan pesat, tetapi keupayaan pengecamannya masih jauh di belakang mata manusia

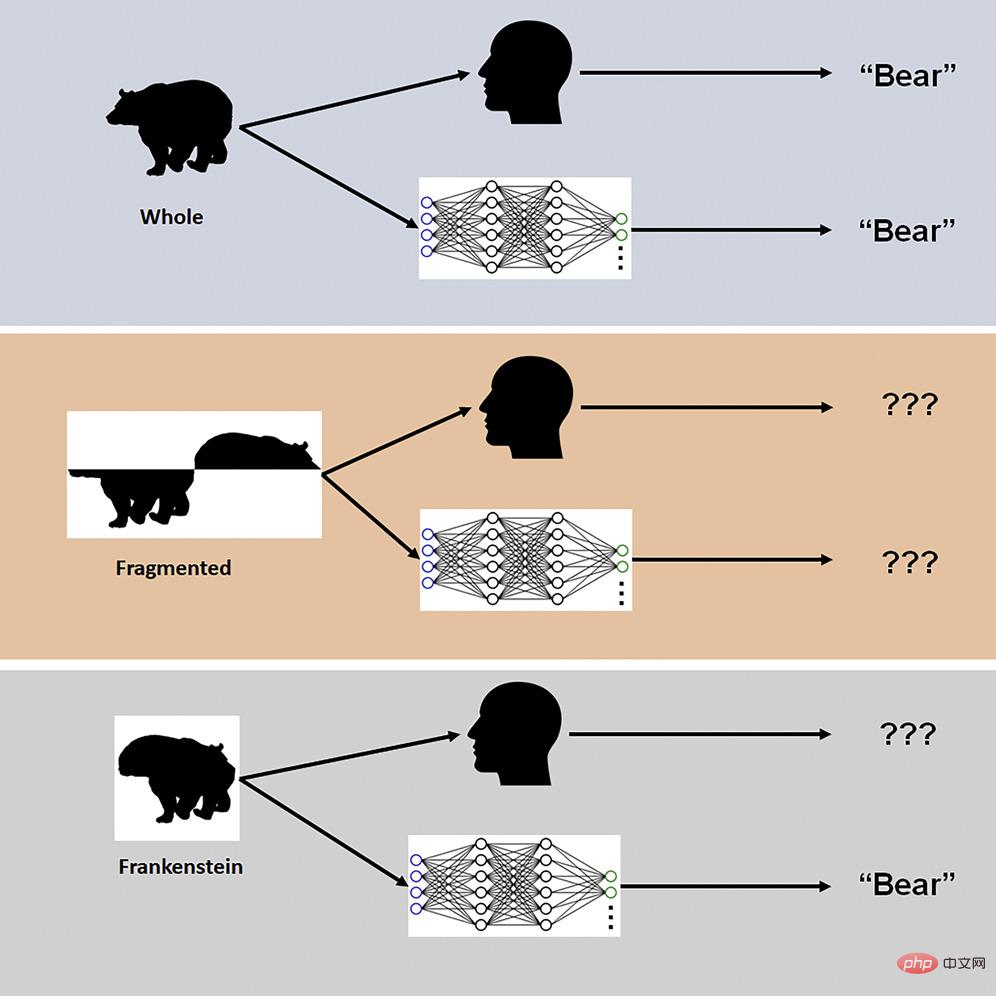

Deep convolutional neural network (DCNN) melihat objek secara berbeza daripada manusia Pasukan penyelidik Profesor James Elder dari Universiti York percaya bahawa model pembelajaran mendalam tidak dapat menangkap ciri konfigurasi yang diperolehi oleh persepsi bentuk manusia.

Bagaimanakah otak manusia dan DCNN memahami keseluruhannya? Bagaimanakah anda melihat ciri-ciri objek? Para saintis menggunakan rangsangan visual yang dipanggil "Frankensteins" untuk mengesan ini. James Elder berkata: "Apa yang dipanggil Frankenstein adalah untuk membahagikan keseluruhannya kepada beberapa bahagian dan meletakkan bahagian itu bersama-sama dengan cara yang salah. Dari perspektif separa, ia betul, tetapi bahagian itu diletakkan di tempat yang salah."

Penyelidikan Didapati bahawa walaupun Frankenstein mengelirukan sistem visual manusia, DCNN tidak sensitif terhadap konfigurasi yang salah.

Atas ialah kandungan terperinci Universiti York: AI membuat kemajuan pesat, tetapi keupayaan pengecamannya masih jauh di belakang mata manusia. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1377

1377

52

52

Memahami sifat asid: tiang pangkalan data yang boleh dipercayai

Apr 08, 2025 pm 06:33 PM

Memahami sifat asid: tiang pangkalan data yang boleh dipercayai

Apr 08, 2025 pm 06:33 PM

Penjelasan terperinci mengenai atribut asid asid pangkalan data adalah satu set peraturan untuk memastikan kebolehpercayaan dan konsistensi urus niaga pangkalan data. Mereka menentukan bagaimana sistem pangkalan data mengendalikan urus niaga, dan memastikan integriti dan ketepatan data walaupun dalam hal kemalangan sistem, gangguan kuasa, atau pelbagai pengguna akses serentak. Gambaran keseluruhan atribut asid Atomicity: Transaksi dianggap sebagai unit yang tidak dapat dipisahkan. Mana -mana bahagian gagal, keseluruhan transaksi dilancarkan kembali, dan pangkalan data tidak mengekalkan sebarang perubahan. Sebagai contoh, jika pemindahan bank ditolak dari satu akaun tetapi tidak meningkat kepada yang lain, keseluruhan operasi dibatalkan. Begintransaction; UpdateAcCountSsetBalance = Balance-100Wh

Klausa had SQL Master: Kawal bilangan baris dalam pertanyaan

Apr 08, 2025 pm 07:00 PM

Klausa had SQL Master: Kawal bilangan baris dalam pertanyaan

Apr 08, 2025 pm 07:00 PM

Klausa SQLLIMIT: Kawal bilangan baris dalam hasil pertanyaan. Klausa had dalam SQL digunakan untuk mengehadkan bilangan baris yang dikembalikan oleh pertanyaan. Ini sangat berguna apabila memproses set data yang besar, paparan paginat dan data ujian, dan dapat meningkatkan kecekapan pertanyaan dengan berkesan. Sintaks Asas Sintaks: SelectColumn1, Column2, ... FROMTABLE_NAMELIMITNUMBER_OF_ROWS; Number_of_rows: Tentukan bilangan baris yang dikembalikan. Sintaks dengan Offset: SelectColumn1, Column2, ... Fromtable_namelimitoffset, Number_of_rows; Offset: Langkau

Bagaimana untuk mengoptimumkan prestasi MySQL untuk aplikasi beban tinggi?

Apr 08, 2025 pm 06:03 PM

Bagaimana untuk mengoptimumkan prestasi MySQL untuk aplikasi beban tinggi?

Apr 08, 2025 pm 06:03 PM

Panduan Pengoptimuman Prestasi Pangkalan Data MySQL Dalam aplikasi yang berintensifkan sumber, pangkalan data MySQL memainkan peranan penting dan bertanggungjawab untuk menguruskan urus niaga besar-besaran. Walau bagaimanapun, apabila skala aplikasi berkembang, kemunculan prestasi pangkalan data sering menjadi kekangan. Artikel ini akan meneroka satu siri strategi pengoptimuman prestasi MySQL yang berkesan untuk memastikan aplikasi anda tetap cekap dan responsif di bawah beban tinggi. Kami akan menggabungkan kes-kes sebenar untuk menerangkan teknologi utama yang mendalam seperti pengindeksan, pengoptimuman pertanyaan, reka bentuk pangkalan data dan caching. 1. Reka bentuk seni bina pangkalan data dan seni bina pangkalan data yang dioptimumkan adalah asas pengoptimuman prestasi MySQL. Berikut adalah beberapa prinsip teras: Memilih jenis data yang betul dan memilih jenis data terkecil yang memenuhi keperluan bukan sahaja dapat menjimatkan ruang penyimpanan, tetapi juga meningkatkan kelajuan pemprosesan data.

Kaedah Navicat untuk melihat kata laluan pangkalan data MongoDB

Apr 08, 2025 pm 09:39 PM

Kaedah Navicat untuk melihat kata laluan pangkalan data MongoDB

Apr 08, 2025 pm 09:39 PM

Tidak mustahil untuk melihat kata laluan MongoDB secara langsung melalui Navicat kerana ia disimpan sebagai nilai hash. Cara mendapatkan kata laluan yang hilang: 1. Tetapkan semula kata laluan; 2. Periksa fail konfigurasi (mungkin mengandungi nilai hash); 3. Semak Kod (boleh kata laluan Hardcode).

Menguasai Pesanan mengikut klausa dalam SQL: Susun data dengan berkesan

Apr 08, 2025 pm 07:03 PM

Menguasai Pesanan mengikut klausa dalam SQL: Susun data dengan berkesan

Apr 08, 2025 pm 07:03 PM

Penjelasan terperinci mengenai klausa SQLOrderBy: Penyortiran Data Orderby yang cekap adalah pernyataan utama dalam SQL yang digunakan untuk menyusun set hasil pertanyaan. Ia boleh diatur dalam urutan menaik (ASC) atau perintah menurun (DESC) dalam lajur tunggal atau lajur berganda, meningkatkan kebolehbacaan data dan kecekapan analisis. Orderby Syntax SelectColumn1, Column2, ... FRARTABLE_NAMEORDERBYCOLUMN_NAME [asc | desc]; column_name: sort mengikut lajur. ASC: Susun Pesanan Menaik (lalai). DESC: Susun mengikut urutan menurun. Ciri-ciri Utama Orderby: Penyortiran Multi-lajur: Menyokong pelbagai penyortiran lajur, dan urutan lajur menentukan keutamaan penyortiran. sejak

Navicat menyambung ke kod ralat dan penyelesaian pangkalan data

Apr 08, 2025 pm 11:06 PM

Navicat menyambung ke kod ralat dan penyelesaian pangkalan data

Apr 08, 2025 pm 11:06 PM

Kesilapan dan penyelesaian yang biasa apabila menyambung ke pangkalan data: Nama pengguna atau kata laluan (ralat 1045) Sambungan blok firewall (ralat 2003) Timeout sambungan (ralat 10060)

Cara Menulis Tutorial Terkini Mengenai Pernyataan Sisipan SQL

Apr 09, 2025 pm 01:48 PM

Cara Menulis Tutorial Terkini Mengenai Pernyataan Sisipan SQL

Apr 09, 2025 pm 01:48 PM

Pernyataan sisipan SQL digunakan untuk menambah baris baru ke jadual pangkalan data, dan sintaksinya ialah: masukkan ke dalam table_name (column1, column2, ..., columnn) nilai (value1, value2, ..., valuen);. Kenyataan ini menyokong memasukkan pelbagai nilai dan membolehkan nilai null dimasukkan ke dalam lajur, tetapi perlu untuk memastikan bahawa nilai yang dimasukkan bersesuaian dengan jenis data lajur untuk mengelakkan melanggar kekangan keunikan.

Cara menambah lajur baru dalam SQL

Apr 09, 2025 pm 02:09 PM

Cara menambah lajur baru dalam SQL

Apr 09, 2025 pm 02:09 PM

Tambah lajur baru ke jadual yang sedia ada dalam SQL dengan menggunakan pernyataan Alter Table. Langkah -langkah khusus termasuk: Menentukan nama jadual dan maklumat lajur, menulis pernyataan Alter Jadual, dan melaksanakan pernyataan. Sebagai contoh, tambahkan lajur e -mel ke Jadual Pelanggan (Varchar (50)): Alter Jadual Pelanggan Tambah Varchar E -mel (50);