Kepopularan ChatGPT dan Midjourney telah menjadikan model penyebaran teknologi di belakangnya sebagai asas revolusi "AI generatif".

Malah, ia sangat dicari oleh penyelidik dalam industri, dan popularitinya jauh melebihi GAN, yang pernah menyerang dunia.

Setelah model penyebaran berada pada tahap yang paling berkuasa, beberapa netizen tiba-tiba mengumumkan dalam profil tinggi:

Era model Difusi telah berakhir ! Model konsisten dinobatkan sebagai raja!

Apa yang sedang berlaku? ? ?

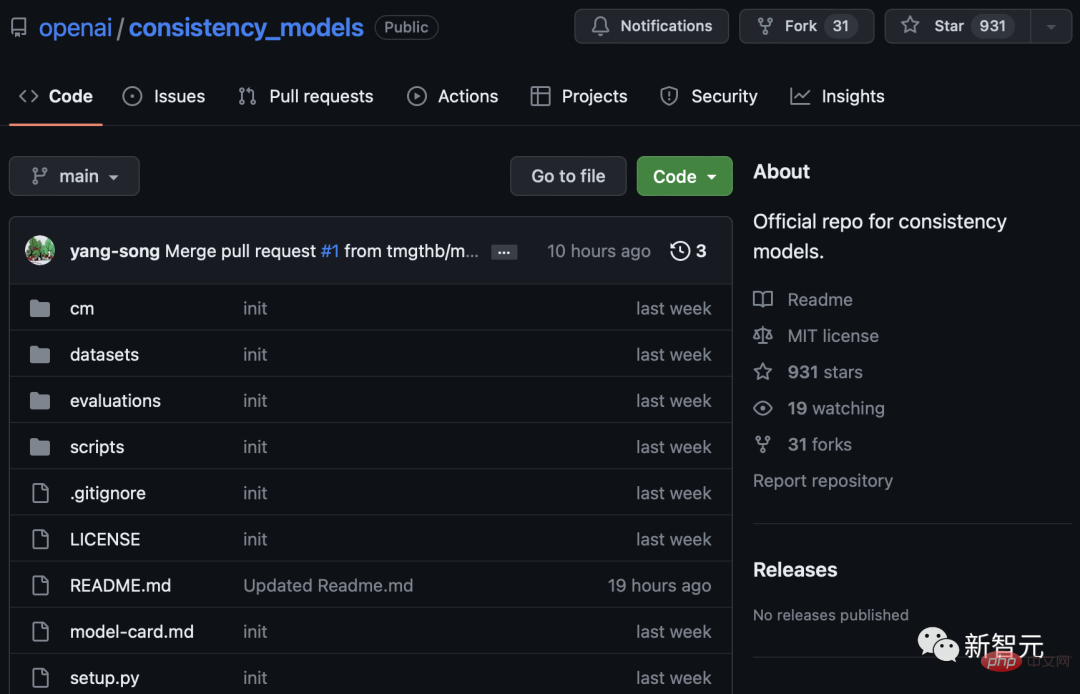

Ternyata OpenAI mengeluarkan kertas blokbuster dan bernilai "Model Konsistensi" pada bulan Mac, dan mengeluarkan pemberat model di GitHub hari ini.

Alamat kertas: https://arxiv.org/abs/2303.01469

Alamat projek: https://github.com/openai/consistency_models

"Model Konsistensi" dalam kelajuan latihan Ia menumbangkan model resapan dan boleh "menjana dalam satu langkah" , menyelesaikan tugasan mudah susunan magnitud lebih cepat daripada model resapan, dan menggunakan pengiraan 10-2000 kali lebih sedikit.

Jadi, berapa pantas ini?

Sesetengah netizen berkata ia setara dengan menjana 64 imej dengan resolusi 256x256 dalam masa kira-kira 3.5 saat, iaitu 18 imej sesaat!

Selain itu, salah satu kelebihan utama model terkini ialah ia boleh mencapai sampel berkualiti tinggi tanpa perlu untuk "latihan lawan" .

Penyelidikan ini telah dijalankan oleh Ilya Sutskever, salah seorang pelajar Hinton dari Turing's Big Three dan yang utama penganjur AlexNet Ditulis oleh , serta cendekiawan Cina Mark Chen dan Prafulla Dhariwal yang membangunkan DALL-E 2, anda boleh bayangkan betapa tegarnya kandungan penyelidikan itu.

Malah ada netizen yang mengatakan bahawa "model konsistensi" adalah hala tuju kajian masa hadapan.

Jadi, model resapan juga hilang?

Pada masa ini, kertas kerja ini masih versi yang belum dimuktamadkan, dan penyelidikan masih diteruskan.

Pada tahun 2021, Ketua Pegawai Eksekutif OpenAI Sam Altman menulis blog membincangkan cara Undang-undang Moore harus digunakan untuk semua bidang.

Altman secara terbuka bercakap tentang "lompat" kecerdasan buatan di Twitter suatu ketika dahulu. Dia berkata, "Versi baru Undang-undang Moore mungkin muncul tidak lama lagi, dengan bilangan kecerdasan di alam semesta berganda setiap 18 bulan." 🎜> Bagi orang lain, keyakinan Altman mungkin kelihatan tidak berasas.

Tetapi penyelidikan terbaharu yang dijalankan oleh pasukan yang diketuai oleh ketua saintis OpenAI Ilya Sutskever memberikan sokongan padu untuk tuntutan Altman.

Tetapi penyelidikan terbaharu yang dijalankan oleh pasukan yang diketuai oleh ketua saintis OpenAI Ilya Sutskever memberikan sokongan padu untuk tuntutan Altman.

Dikatakan tahun 2022 adalah tahun pertama AIGC, kerana banyak model berdasarkan model penyebaran.

Kepopularan model resapan telah menggantikan GAN secara beransur-ansur dan telah menjadi model penjanaan imej yang paling berkesan dalam industri semasa, contohnya, DALL.E 2 dan Google Imagen adalah kedua-dua model penyebaran .

Kepopularan model resapan telah menggantikan GAN secara beransur-ansur dan telah menjadi model penjanaan imej yang paling berkesan dalam industri semasa, contohnya, DALL.E 2 dan Google Imagen adalah kedua-dua model penyebaran .

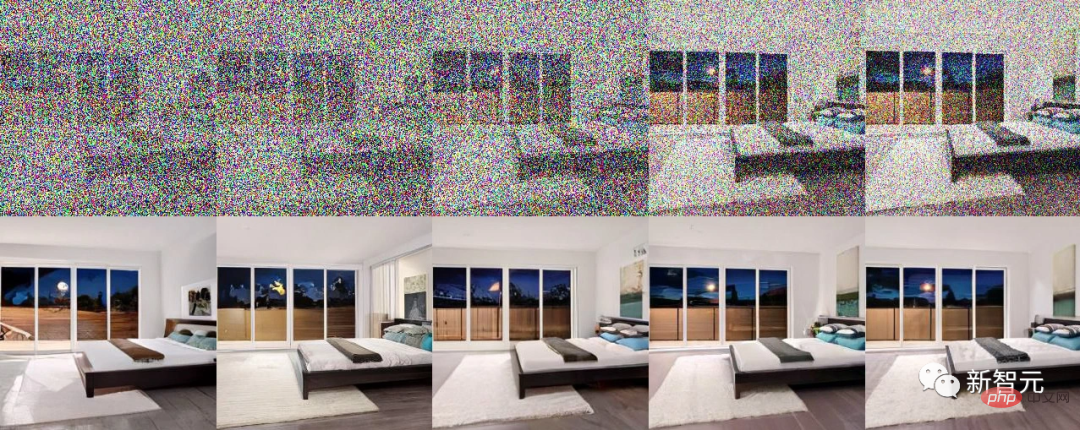

Walau bagaimanapun, "model konsistensi" yang baru dicadangkan telah terbukti mampu menghasilkan kandungan kualiti yang sama seperti model resapan dalam masa yang lebih singkat.

Ini kerana "model ketekalan" ini menggunakan proses penjanaan satu langkah yang serupa dengan GAN.

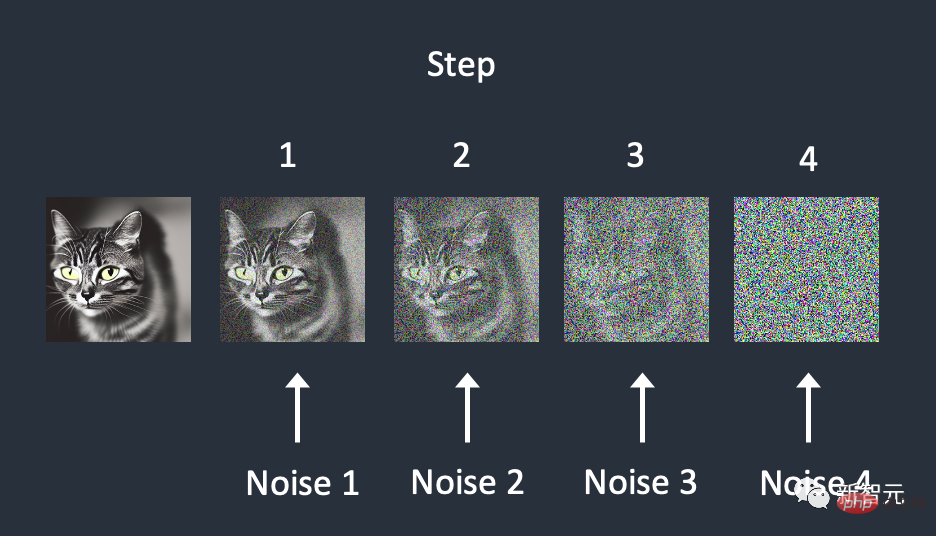

Sebaliknya, model resapan menggunakan proses persampelan berulang untuk menghapuskan hingar dalam imej secara beransur-ansur.

Kaedah ini, walaupun mengagumkan, bergantung pada melakukan ratusan hingga ribuan langkah untuk mencapai hasil yang baik, yang bukan sahaja mahal untuk dikendalikan, tetapi juga perlahan.

Proses penjanaan berulang berterusan model resapan menggunakan 10-2000 lebih pengiraan daripada masa "model ketekalan", malah memperlahankan inferens semasa latihan.

Kuasa "Model Ketekalan" ialah ia boleh membuat pertukaran antara kualiti sampel dan sumber pengkomputeran apabila perlu.

Kuasa "Model Ketekalan" ialah ia boleh membuat pertukaran antara kualiti sampel dan sumber pengkomputeran apabila perlu.

Selain itu, model ini mampu melaksanakan tugas pengeditan data tangkapan sifar seperti tampalan imej, pewarnaan atau penyuntingan imej berpandukan strok.

Penyuntingan imej sifar tangkapan menggunakan model konsensus yang dilatih melalui penyulingan pada Bilik Tidur LSUN 256^256

Persamaan jenis ini dipanggil "Persamaan Pembezaan Biasa Aliran Kebarangkalian" (Probability Flow ODE).

Kajian ini menamakan model jenis ini sebagai "konsistensi" kerana mereka mengekalkan ketekalan diri ini antara data input dan data output.

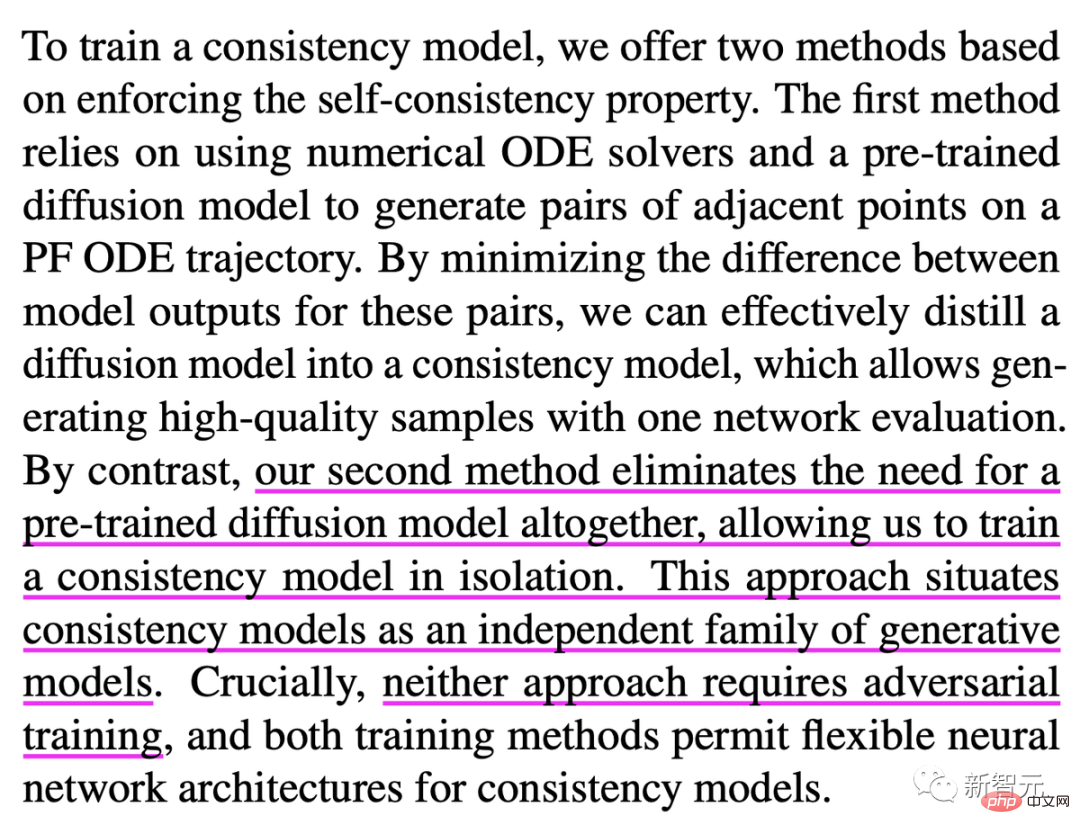

Model ini boleh dilatih sama ada dalam mod penyulingan atau mod pengasingan.

Dalam mod penyulingan, model ini dapat mengekstrak data daripada model resapan terlatih, membolehkannya dilaksanakan dalam satu langkah.

Dalam mod terpisah, model tidak bergantung pada model resapan sama sekali, menjadikannya model bebas sepenuhnya.

Perlu diambil perhatian bahawa kedua-dua kaedah latihan memadamkan "latihan lawan" daripadanya.

Saya harus mengakui bahawa latihan lawan memang akan menghasilkan rangkaian saraf yang lebih berkuasa, tetapi prosesnya lebih litar. Iaitu, ia memperkenalkan satu set sampel musuh yang salah klasifikasi dan kemudian melatih semula rangkaian saraf sasaran dengan label yang betul.

Oleh itu, latihan lawan juga akan menyebabkan sedikit penurunan dalam ketepatan ramalan model pembelajaran mendalam, malah ia mungkin membawa kesan sampingan yang tidak dijangka dalam aplikasi robotik.

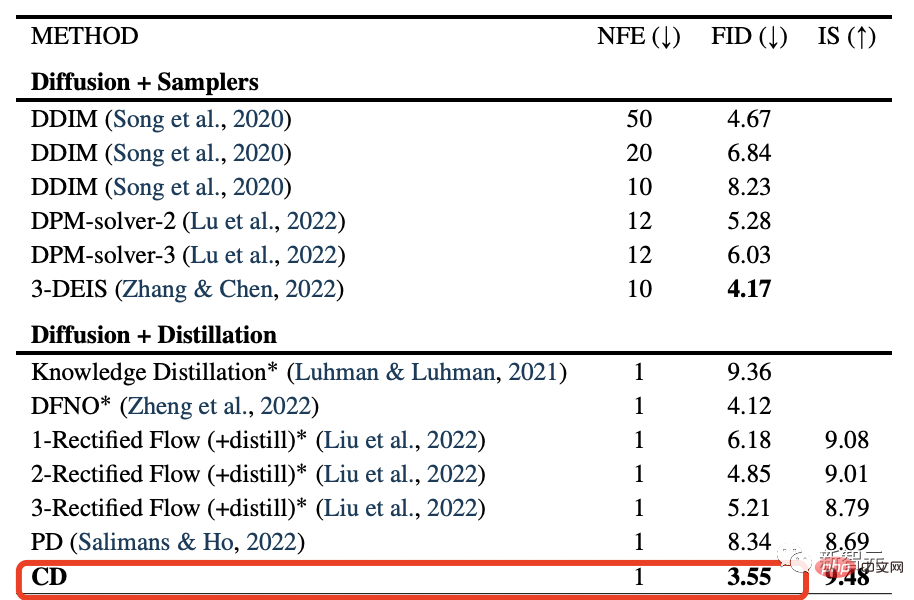

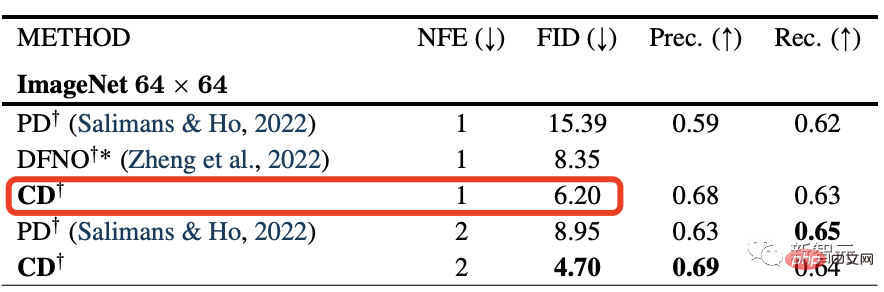

Hasil eksperimen menunjukkan bahawa teknik penyulingan yang digunakan untuk melatih "model ketekalan" adalah lebih baik daripada yang digunakan untuk model resapan.

"Model Konsisten" masing-masing mencapai skor FID terkini 3.55 dan 6.20 pada set imej CIFAR10 dan set data ImageNet 64x64.

Ini hanya direalisasikan, model penyebaran The kualiti + kelajuan GAN, dua kali ganda sempurna.

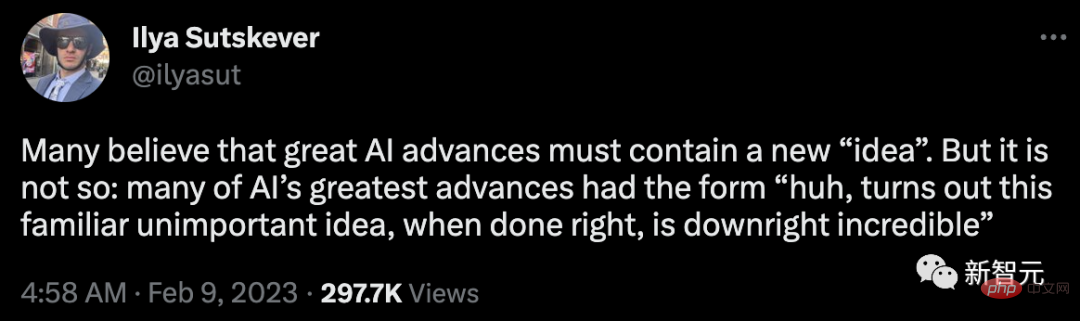

Pada bulan Februari, Sutskever menyiarkan tweet yang mencadangkan,

Ramai orang percaya bahawa kemajuan AI yang hebat mesti menyertakan "idea" baharu. Tetapi itu tidak berlaku: Banyak kemajuan terbesar AI telah datang dalam bentuk, baik, idea sederhana yang biasa itu, jika dilakukan dengan baik, menjadi luar biasa.

Penyelidikan terkini membuktikan perkara itu, dan mengubah konsep lama boleh mengubah segala-galanya.

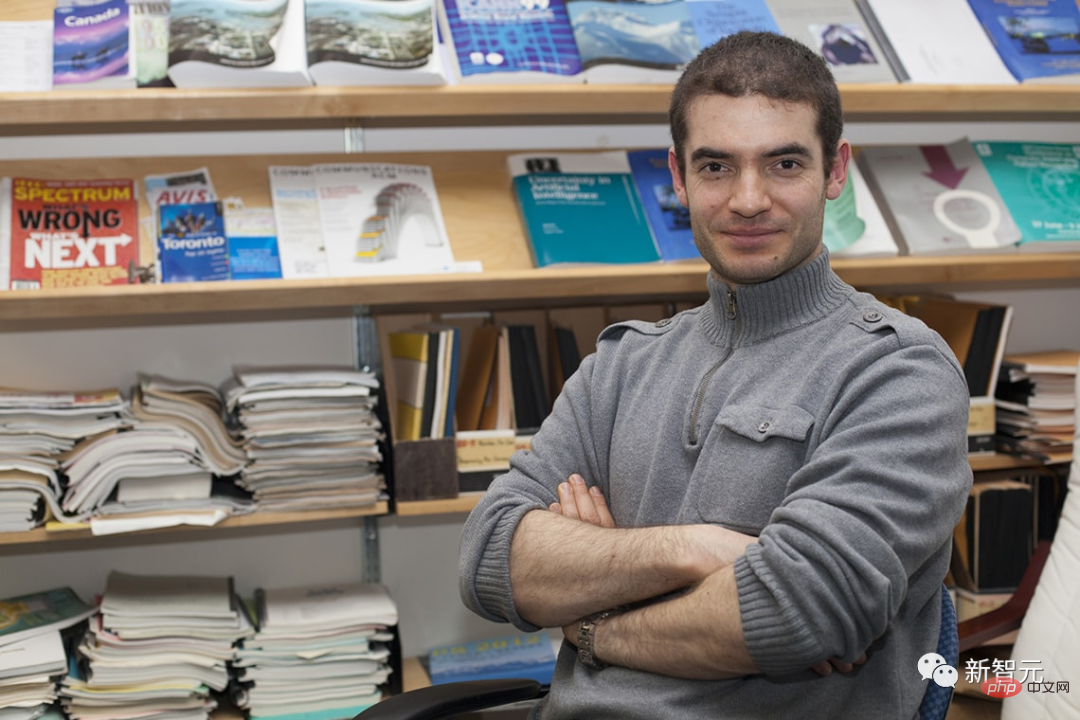

Sebagai pengasas bersama dan ketua saintis OpenAI, Ilya Sutskever Tidak perlu perincian, lihat sahaja foto kumpulan "pelakon terbaik" ini.

(kanan gambar)

Song Yang, pengarang pertama kertas kerja, ialah seorang saintis penyelidikan di OpenAI.

Sebelum ini, beliau menerima ijazah sarjana muda dalam matematik dan fizik dari Universiti Tsinghua, dan ijazah sarjana dan kedoktoran dalam sains komputer dari Universiti Stanford. Selain itu, beliau telah menjalani latihan di Google Brain, Uber ATG, dan Microsoft Research.

Sebagai penyelidik pembelajaran mesin, beliau menumpukan pada membangunkan kaedah berskala untuk memodelkan, menganalisis dan menjana data dimensi tinggi yang kompleks. Minatnya merangkumi pelbagai bidang, termasuk pemodelan generatif, pembelajaran perwakilan, penaakulan probabilistik, keselamatan kecerdasan buatan dan AI untuk sains.

Mark Chen ialah ketua jabatan penyelidikan multimodal dan canggih OpenAI, Beliau juga merupakan jurulatih pasukan Olimpik Komputer A.S.

Sebelum ini, beliau memperoleh ijazah sarjana muda dalam matematik dan sains komputer daripada MIT dan bekerja sebagai peniaga kuantitatif di beberapa firma perdagangan proprietari, termasuk Jane Street Capital.

Selepas menyertai OpenAI, beliau mengetuai pasukan untuk membangunkan DALL-E 2 dan memperkenalkan visi ke dalam GPT-4. Di samping itu, beliau mengetuai pembangunan Codex, mengambil bahagian dalam projek GPT-3, dan mencipta Image GPT.

Prafulla Dhariwal ialah seorang Saintis Penyelidikan di OpenAI, bekerja pada model generatif dan autonomi model Pembelajaran yang diselia. Sebelum itu, beliau adalah seorang sarjana di MIT, belajar pengkomputeran, matematik, dan fizik.

Menariknya, model resapan boleh mengalahkan GAN dalam bidang penjanaan imej, yang dicadangkannya dalam kertas NeurIPS 2021.

OpenAI membuka kod sumber konsistensi model hari ini.

Akhirnya kembali ke Open AI.

Menghadapi begitu banyak penemuan dan pengumuman gila setiap hari. Netizen bertanya: Perlukah kita berehat atau mempercepatkan?

Ini akan menjimatkan kos melatih model dengan ketara kepada penyelidik berbanding model resapan.

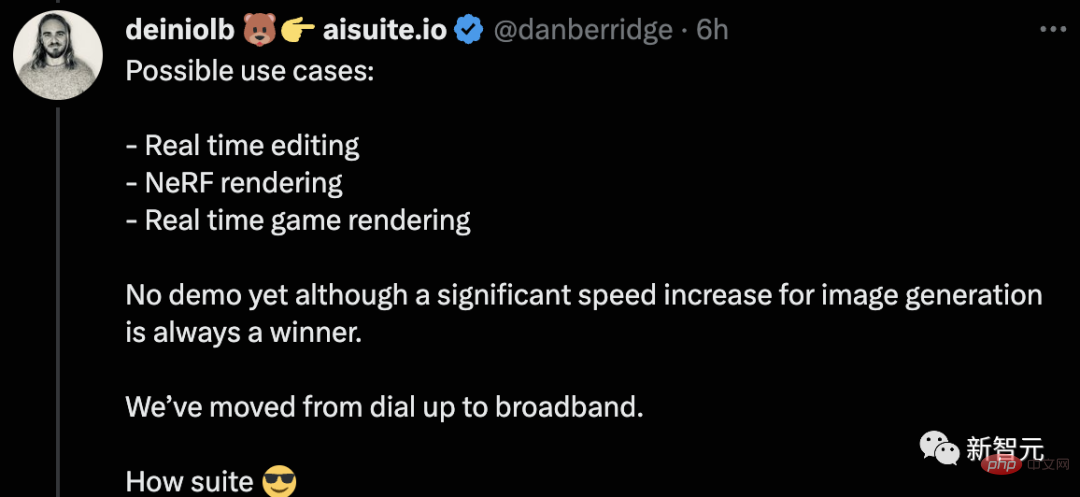

Sesetengah netizen turut memberikan kes penggunaan masa hadapan bagi "model konsistensi": penyuntingan masa nyata, pemaparan NeRF, sebenar -masa permainan render.

Tiada demo buat masa ini, tetapi perlu disahkan bahawa ia boleh meningkatkan kelajuan penjanaan imej dengan ketara dan sentiasa menjadi pemenang.

Kami menaik taraf terus daripada dial-up kepada jalur lebar.

Antara muka otak-komputer, serta imej ultra-realistik yang dijana dalam hampir masa nyata.

Atas ialah kandungan terperinci OpenAI mengeluarkan model konsisten baharu, kelajuan GAN mencapai 18FPS, dan boleh menjana imej berkualiti tinggi dalam masa nyata.. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Bagaimana untuk menyelesaikan masalah bahawa pintasan IE tidak boleh dipadamkan

Bagaimana untuk menyelesaikan masalah bahawa pintasan IE tidak boleh dipadamkan

Akhiran nama fail pengubahsuaian kelompok Linux

Akhiran nama fail pengubahsuaian kelompok Linux

Tiada pilihan WLAN dalam win11

Tiada pilihan WLAN dalam win11

WeChat gagal memuatkan data

WeChat gagal memuatkan data

Sebab utama mengapa komputer menggunakan binari

Sebab utama mengapa komputer menggunakan binari

Apakah maksud pelayan web?

Apakah maksud pelayan web?

Cara menggunakan pembuka kunci

Cara menggunakan pembuka kunci

Bagaimana untuk memulihkan data dari cakera keras mudah alih

Bagaimana untuk memulihkan data dari cakera keras mudah alih