Peranti teknologi

Peranti teknologi

AI

AI

Universiti Wisconsin-Madison dan lain-lain bersama-sama mengeluarkan artikel! Model besar berbilang modal terkini LLaVA dikeluarkan, dan tahapnya hampir dengan GPT-4

Universiti Wisconsin-Madison dan lain-lain bersama-sama mengeluarkan artikel! Model besar berbilang modal terkini LLaVA dikeluarkan, dan tahapnya hampir dengan GPT-4

Universiti Wisconsin-Madison dan lain-lain bersama-sama mengeluarkan artikel! Model besar berbilang modal terkini LLaVA dikeluarkan, dan tahapnya hampir dengan GPT-4

Penalaan halus perintah visual adalah popular.

Kertas kerja ini dipanggil Penalaan Arahan Visual dan dihasilkan bersama oleh Universiti Wisconsin-Madison, Penyelidikan Microsoft dan Universiti Columbia.

Pengarang termasuk Haotian Liu, Chunyuan Li, Qingyang Wu dan Yong Jae Lee.

Pada masa yang sama, penyelidik juga membuka sumber kod, model dan set data mereka pada GitHub. Kertas itu juga disiarkan di Arxiv.

Penjelasan

Jadi apakah sebenarnya fungsi LLaVA? Jika anda menyelami kertas itu, mungkin agak pelik bagi mereka yang tidak biasa dengannya.

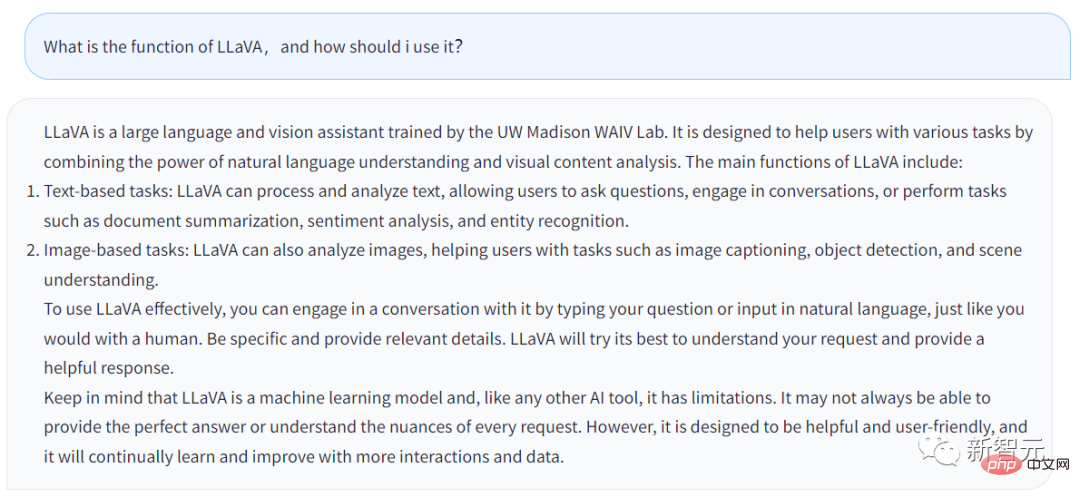

Mari kita lihat apa yang dikatakan oleh LLaVA sendiri dahulu.

Jawapan di atas dijana daripada Chatbot LLaVA Soalan yang saya masukkan ialah, apakah fungsi LLaVA dan apakah patutkah pengguna memanfaatkannya?

Jawapannya adalah seperti berikut:

LLaVA ialah pembantu bahasa dan visual yang terlatih di makmal WAIV UW Madison. LLaVA direka untuk membantu pengguna mengendalikan pelbagai tugas dengan memanfaatkan keupayaan pemahaman bahasa semula jadi dan keupayaan analisis kandungan visualnya.

Ciri utama LLaVA termasuk:

· Tugas berasaskan teks: LLaVA boleh memproses dan menganalisis teks , membenarkan pengguna untuk bertanya soalan, LLaVA boleh bersembang dengan pengguna, atau menyelesaikan tugasan yang dimasukkan oleh pengguna, seperti menapis ringkasan dokumen, analisis sentimen, pengecaman entiti, dsb.

· Tugas berasaskan imej: LLaVA boleh menganalisis imej, menerangkan imej, melakukan pengecaman objek dan menganalisis serta memahami pemandangan.

Jika pengguna ingin menggunakan LLaVA dengan lebih baik, mereka boleh bercakap terus dengan LLaVA, sama seperti bercakap dengan manusia. Berikan butiran sebanyak mungkin dan LLaVA akan menjana jawapan yang lebih lengkap.

Pada masa yang sama, anda harus ingat bahawa selepas semua, LLaVA ialah model pembelajaran mesin dan alat AI. Selagi ia adalah alat, ia mempunyai batasannya. LLaVA mungkin tidak menjawab dengan sempurna soalan yang dimasukkan oleh pengguna setiap kali.

Sudah tentu, LLaVA sentiasa belajar dan bertambah baik, dan fungsinya akan menjadi lebih dan lebih berkuasa.

Secara umumnya, dapat dilihat daripada jawapan LLaVA bahawa fungsi Chatbot tidak jauh berbeza dengan GPT. Tetapi LLaVA boleh mengendalikan beberapa tugas yang berkaitan dengan imej.

Pameran Warna

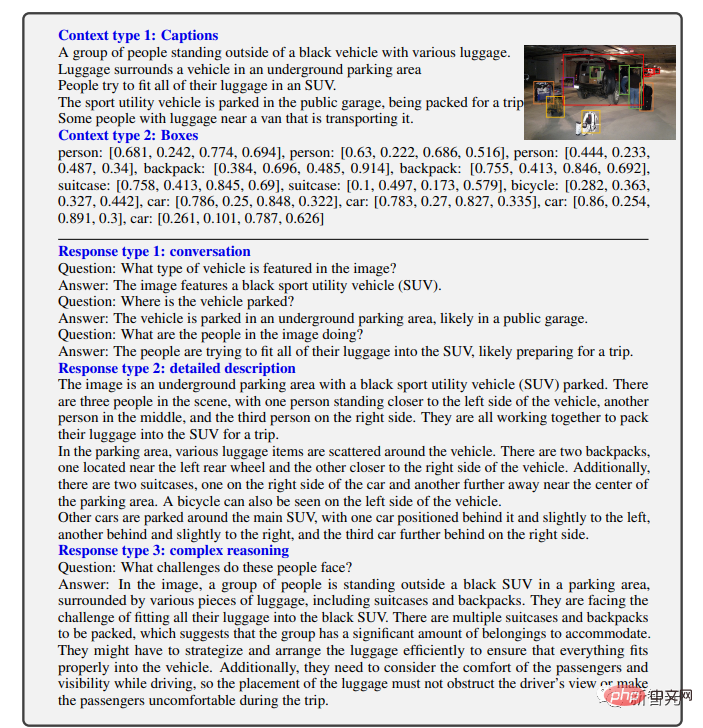

Para penyelidik memperincikan butiran teknikal LLaVA dalam kertas Arxiv.

Adalah penting untuk mengetahui bahawa menggunakan arahan yang dijana mesin untuk mengikuti data untuk memperhalusi arahan untuk model bahasa besar (LLM) meningkatkan keupayaan titik sifar tugas baharu, tetapi ini idea tidak diterokai dalam bidang multi-modal kurang.

Dalam kertas kerja, penyelidik mula-mula cuba menggunakan GPT-4 bahasa sahaja untuk menjana data mengikut arahan untuk imej bahasa berbilang mod.

Dengan menundukkan data yang dijana ini kepada pelarasan pengajaran, para penyelidik memperkenalkan LLaVA: bahasa berskala besar dan pembantu penglihatan yang merupakan stateful berskala besar terlatih hujung-ke-hujung model, yang menghubungkan pengekod visual dan LLM untuk penglihatan umum dan pemahaman bahasa.

Eksperimen awal menunjukkan bahawa LLaVA menunjukkan keupayaan sembang berbilang mod yang mengagumkan, kadangkala mengeluarkan prestasi GPT-4 berbilang mod pada imej/arahan ghaib, dan pada banyak sintetik Berbanding dengan GPT-4 pada arahan modal berikut set data , ia mencapai skor relatif 85.1%.

Apabila diperhalusi untuk majalah Sains, sinergi LLaVA dan GPT-4 mencapai ketepatan terkini 92.53%.

Penyelidik telah mendedahkan data, model dan asas kod untuk pelarasan arahan visual yang dijana oleh GPT-4.

Model berbilang mod

Pertama-tama jelaskan definisi.

Model multimodal berskala besar merujuk kepada model berdasarkan teknologi pembelajaran mesin yang boleh memproses dan menganalisis berbilang jenis input, seperti teks dan imej.

Model ini direka bentuk untuk mengendalikan pelbagai tugasan yang lebih luas dan dapat memahami pelbagai bentuk data. Dengan mengambil teks dan imej sebagai input, model ini meningkatkan keupayaan mereka untuk memahami dan menyusun penjelasan untuk menjana jawapan yang lebih tepat dan relevan.

Manusia berinteraksi dengan dunia melalui pelbagai saluran seperti penglihatan dan bahasa, kerana setiap saluran individu mempunyai kelebihan unik dalam mewakili dan menyampaikan konsep dunia tertentu, dengan itu memudahkan Memahami dunia dengan baik .

Salah satu aspirasi teras kecerdasan buatan adalah untuk membangunkan pembantu sejagat yang boleh mengikut arahan visual dan bahasa pelbagai mod secara berkesan, konsisten dengan niat manusia, dan melengkapkan pelbagai kehidupan sebenar tugasan.

Hasilnya, komuniti pembangun telah menyaksikan minat yang diperbaharui dalam membangunkan model penglihatan asas yang ditambah bahasa dengan keupayaan berkuasa dalam pemahaman visual dunia terbuka seperti klasifikasi, pengesanan, segmentasi, penerangan , dan penjanaan dan penyuntingan visual.

Dalam ciri ini, setiap tugasan diselesaikan secara bebas oleh satu model visual besar, dengan arahan tugas secara tersirat dipertimbangkan dalam reka bentuk model.

Selain itu, bahasa hanya digunakan untuk menerangkan kandungan imej. Walaupun ini membolehkan bahasa memainkan peranan penting dalam memetakan isyarat visual kepada semantik linguistik - saluran biasa untuk komunikasi manusia. Walau bagaimanapun, ini menghasilkan model yang selalunya mempunyai antara muka tetap dengan interaktiviti terhad dan kebolehsuaian kepada arahan pengguna.

Dan model bahasa besar (LLM) menunjukkan bahawa bahasa boleh memainkan peranan yang lebih luas: antara muka biasa untuk pembantu am, pelbagai arahan tugas boleh dinyatakan secara eksplisit dalam bahasa dan membimbing penghujungnya -to-end Pembantu saraf terlatih akhir beralih kepada tugas yang diminati untuk menyelesaikannya.

Sebagai contoh, kejayaan ChatGPT dan GPT-4 baru-baru ini telah membuktikan keupayaan LLM ini untuk mengikut arahan manusia dan merangsang minat yang besar dalam membangunkan LLM sumber terbuka.

LLaMA ialah LLM sumber terbuka yang prestasinya setanding dengan GPT-3. Kerja yang berterusan memanfaatkan pelbagai arahan berkualiti tinggi yang dijana mesin berikutan sampel untuk meningkatkan keupayaan penjajaran LLM, melaporkan prestasi yang mengagumkan berbanding LLM proprietari. Yang penting, barisan kerja ini adalah teks sahaja.

Dalam kertas ini, penyelidik mencadangkan penalaan arahan visual, yang merupakan percubaan pertama untuk memanjangkan penalaan arahan ke dalam ruang berbilang mod dan membuka jalan untuk membina pembantu visual universal . Khususnya, kandungan utama kertas itu termasuk:

Arahan berbilang modal berikutan data. Cabaran utama ialah kekurangan arahan bahasa visual untuk mengikuti data. Kami membentangkan perspektif pembaharuan data dan saluran paip yang menggunakan ChatGPT/GPT-4 untuk menukar pasangan teks imej kepada format mengikut arahan yang sesuai.

Model berbilang modal besar. Para penyelidik membangunkan model multimodal besar (LMM) dengan menyambungkan pengekod visual set terbuka CLIP dan penyahkod bahasa LaMA, dan memperhalusinya dari hujung ke hujung pada data visual-verbal pengajaran yang dijana. Kajian empirikal mengesahkan keberkesanan penalaan arahan LMM menggunakan data yang dijana dan memberikan cadangan praktikal untuk membina agen visual mengikut arahan am. Dengan GPT 4, pasukan penyelidik mencapai prestasi terkini pada set data inferens berbilang mod Sains QA.

Sumber terbuka. Pasukan penyelidik mengeluarkan perkara berikut kepada orang ramai: data arahan multimodal yang dijana, perpustakaan kod untuk penjanaan data dan latihan model, pusat pemeriksaan model dan demonstrasi sembang visual.

Paparan Keputusan

Dapat dilihat bahawa LLaVA boleh menangani semua jenis masalah, dan jawapan yang dihasilkan adalah komprehensif dan logik.

LLaVA menunjukkan beberapa keupayaan berbilang modal yang hampir dengan tahap GPT-4, dengan skor relatif GPT-4 sebanyak 85% dari segi sembang visual.

Dari segi penaakulan soal jawab, LLaVA malah mencapai SoTA baharu - 92.53%, mengalahkan rantaian pemikiran pelbagai mod.

Atas ialah kandungan terperinci Universiti Wisconsin-Madison dan lain-lain bersama-sama mengeluarkan artikel! Model besar berbilang modal terkini LLaVA dikeluarkan, dan tahapnya hampir dengan GPT-4. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1393

1393

52

52

1209

1209

24

24

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Bayangkan model kecerdasan buatan yang bukan sahaja mempunyai keupayaan untuk mengatasi pengkomputeran tradisional, tetapi juga mencapai prestasi yang lebih cekap pada kos yang lebih rendah. Ini bukan fiksyen sains, DeepSeek-V2[1], model MoE sumber terbuka paling berkuasa di dunia ada di sini. DeepSeek-V2 ialah gabungan model bahasa pakar (MoE) yang berkuasa dengan ciri-ciri latihan ekonomi dan inferens yang cekap. Ia terdiri daripada 236B parameter, 21B daripadanya digunakan untuk mengaktifkan setiap penanda. Berbanding dengan DeepSeek67B, DeepSeek-V2 mempunyai prestasi yang lebih kukuh, sambil menjimatkan 42.5% kos latihan, mengurangkan cache KV sebanyak 93.3% dan meningkatkan daya pemprosesan penjanaan maksimum kepada 5.76 kali. DeepSeek ialah sebuah syarikat yang meneroka kecerdasan buatan am

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

Awal bulan ini, penyelidik dari MIT dan institusi lain mencadangkan alternatif yang sangat menjanjikan kepada MLP - KAN. KAN mengatasi MLP dari segi ketepatan dan kebolehtafsiran. Dan ia boleh mengatasi prestasi MLP berjalan dengan bilangan parameter yang lebih besar dengan bilangan parameter yang sangat kecil. Sebagai contoh, penulis menyatakan bahawa mereka menggunakan KAN untuk menghasilkan semula keputusan DeepMind dengan rangkaian yang lebih kecil dan tahap automasi yang lebih tinggi. Khususnya, MLP DeepMind mempunyai kira-kira 300,000 parameter, manakala KAN hanya mempunyai kira-kira 200 parameter. KAN mempunyai asas matematik yang kukuh seperti MLP berdasarkan teorem penghampiran universal, manakala KAN berdasarkan teorem perwakilan Kolmogorov-Arnold. Seperti yang ditunjukkan dalam rajah di bawah, KAN telah

Robot Tesla bekerja di kilang, Musk: Tahap kebebasan tangan akan mencapai 22 tahun ini!

May 06, 2024 pm 04:13 PM

Robot Tesla bekerja di kilang, Musk: Tahap kebebasan tangan akan mencapai 22 tahun ini!

May 06, 2024 pm 04:13 PM

Video terbaru robot Tesla Optimus dikeluarkan, dan ia sudah boleh berfungsi di kilang. Pada kelajuan biasa, ia mengisih bateri (bateri 4680 Tesla) seperti ini: Pegawai itu juga mengeluarkan rupanya pada kelajuan 20x - pada "stesen kerja" kecil, memilih dan memilih dan memilih: Kali ini ia dikeluarkan Salah satu sorotan video itu ialah Optimus menyelesaikan kerja ini di kilang, sepenuhnya secara autonomi, tanpa campur tangan manusia sepanjang proses. Dan dari perspektif Optimus, ia juga boleh mengambil dan meletakkan bateri yang bengkok, memfokuskan pada pembetulan ralat automatik: Berkenaan tangan Optimus, saintis NVIDIA Jim Fan memberikan penilaian yang tinggi: Tangan Optimus adalah robot lima jari di dunia paling cerdik. Tangannya bukan sahaja boleh disentuh

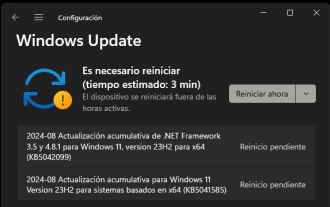

Microsoft mengeluarkan kemas kini kumulatif Win11 Ogos: meningkatkan keselamatan, mengoptimumkan skrin kunci, dsb.

Aug 14, 2024 am 10:39 AM

Microsoft mengeluarkan kemas kini kumulatif Win11 Ogos: meningkatkan keselamatan, mengoptimumkan skrin kunci, dsb.

Aug 14, 2024 am 10:39 AM

Menurut berita dari tapak ini pada 14 Ogos, semasa hari acara August Patch Tuesday hari ini, Microsoft mengeluarkan kemas kini kumulatif untuk sistem Windows 11, termasuk kemas kini KB5041585 untuk 22H2 dan 23H2, dan kemas kini KB5041592 untuk 21H2. Selepas peralatan yang disebutkan di atas dipasang dengan kemas kini kumulatif Ogos, perubahan nombor versi yang dilampirkan pada tapak ini adalah seperti berikut: Selepas pemasangan peralatan 21H2, nombor versi meningkat kepada Build22000.314722H2 Selepas pemasangan peralatan, nombor versi meningkat kepada Build22621.403723H2 Selepas pemasangan peralatan, nombor versi meningkat kepada Build22631.4037 Kandungan utama kemas kini KB5041585 untuk Windows 1121H2 adalah seperti berikut: Penambahbaikan.

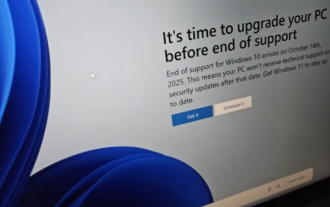

Pop timbul skrin penuh Microsoft menggesa pengguna Windows 10 untuk menyegerakan dan menaik taraf kepada Windows 11

Jun 06, 2024 am 11:35 AM

Pop timbul skrin penuh Microsoft menggesa pengguna Windows 10 untuk menyegerakan dan menaik taraf kepada Windows 11

Jun 06, 2024 am 11:35 AM

Menurut berita pada 3 Jun, Microsoft sedang aktif menghantar pemberitahuan skrin penuh kepada semua pengguna Windows 10 untuk menggalakkan mereka menaik taraf kepada sistem pengendalian Windows 11. Langkah ini melibatkan peranti yang konfigurasi perkakasannya tidak menyokong sistem baharu. Sejak 2015, Windows 10 telah menduduki hampir 70% bahagian pasaran, dengan kukuh mengukuhkan penguasaannya sebagai sistem pengendalian Windows. Walau bagaimanapun, bahagian pasaran jauh melebihi bahagian pasaran 82%, dan bahagian pasaran jauh melebihi Windows 11, yang akan dikeluarkan pada 2021. Walaupun Windows 11 telah dilancarkan selama hampir tiga tahun, penembusan pasarannya masih perlahan. Microsoft telah mengumumkan bahawa ia akan menamatkan sokongan teknikal untuk Windows 10 selepas 14 Oktober 2025 untuk memberi tumpuan lebih kepada

Melebihi DPO secara menyeluruh: Pasukan Chen Danqi mencadangkan pengoptimuman pilihan mudah SimPO, dan turut memperhalusi model sumber terbuka 8B terkuat

Jun 01, 2024 pm 04:41 PM

Melebihi DPO secara menyeluruh: Pasukan Chen Danqi mencadangkan pengoptimuman pilihan mudah SimPO, dan turut memperhalusi model sumber terbuka 8B terkuat

Jun 01, 2024 pm 04:41 PM

Untuk menyelaraskan model bahasa besar (LLM) dengan nilai dan niat manusia, adalah penting untuk mempelajari maklum balas manusia untuk memastikan bahawa ia berguna, jujur dan tidak berbahaya. Dari segi penjajaran LLM, kaedah yang berkesan ialah pembelajaran pengukuhan berdasarkan maklum balas manusia (RLHF). Walaupun keputusan kaedah RLHF adalah cemerlang, terdapat beberapa cabaran pengoptimuman yang terlibat. Ini melibatkan latihan model ganjaran dan kemudian mengoptimumkan model dasar untuk memaksimumkan ganjaran tersebut. Baru-baru ini, beberapa penyelidik telah meneroka algoritma luar talian yang lebih mudah, salah satunya ialah pengoptimuman keutamaan langsung (DPO). DPO mempelajari model dasar secara langsung berdasarkan data keutamaan dengan meparameterkan fungsi ganjaran dalam RLHF, sekali gus menghapuskan keperluan untuk model ganjaran yang jelas. Kaedah ini mudah dan stabil

Tiada data OpenAI diperlukan, sertai senarai model kod besar! UIUC mengeluarkan StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

Tiada data OpenAI diperlukan, sertai senarai model kod besar! UIUC mengeluarkan StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

Di barisan hadapan teknologi perisian, kumpulan UIUC Zhang Lingming, bersama penyelidik dari organisasi BigCode, baru-baru ini mengumumkan model kod besar StarCoder2-15B-Instruct. Pencapaian inovatif ini mencapai kejayaan ketara dalam tugas penjanaan kod, berjaya mengatasi CodeLlama-70B-Instruct dan mencapai bahagian atas senarai prestasi penjanaan kod. Keunikan StarCoder2-15B-Instruct terletak pada strategi penjajaran diri yang tulen Keseluruhan proses latihan adalah terbuka, telus, dan sepenuhnya autonomi dan boleh dikawal. Model ini menjana beribu-ribu arahan melalui StarCoder2-15B sebagai tindak balas kepada penalaan halus model asas StarCoder-15B tanpa bergantung pada anotasi manual yang mahal.

LLM sudah selesai! OmniDrive: Mengintegrasikan persepsi 3D dan perancangan penaakulan (terbaharu NVIDIA)

May 09, 2024 pm 04:55 PM

LLM sudah selesai! OmniDrive: Mengintegrasikan persepsi 3D dan perancangan penaakulan (terbaharu NVIDIA)

May 09, 2024 pm 04:55 PM

Ditulis di atas & pemahaman peribadi pengarang: Kertas kerja ini didedikasikan untuk menyelesaikan cabaran utama model bahasa besar multimodal semasa (MLLM) dalam aplikasi pemanduan autonomi, iaitu masalah melanjutkan MLLM daripada pemahaman 2D kepada ruang 3D. Peluasan ini amat penting kerana kenderaan autonomi (AV) perlu membuat keputusan yang tepat tentang persekitaran 3D. Pemahaman spatial 3D adalah penting untuk AV kerana ia memberi kesan langsung kepada keupayaan kenderaan untuk membuat keputusan termaklum, meramalkan keadaan masa depan dan berinteraksi dengan selamat dengan alam sekitar. Model bahasa besar berbilang mod semasa (seperti LLaVA-1.5) selalunya hanya boleh mengendalikan input imej resolusi rendah (cth.) disebabkan oleh had resolusi pengekod visual, had panjang jujukan LLM. Walau bagaimanapun, aplikasi pemanduan autonomi memerlukan