Topik Khas ChatGPT: Keupayaan dan Masa Depan Model Bahasa Besar

1. Pengkomersialan model generatif

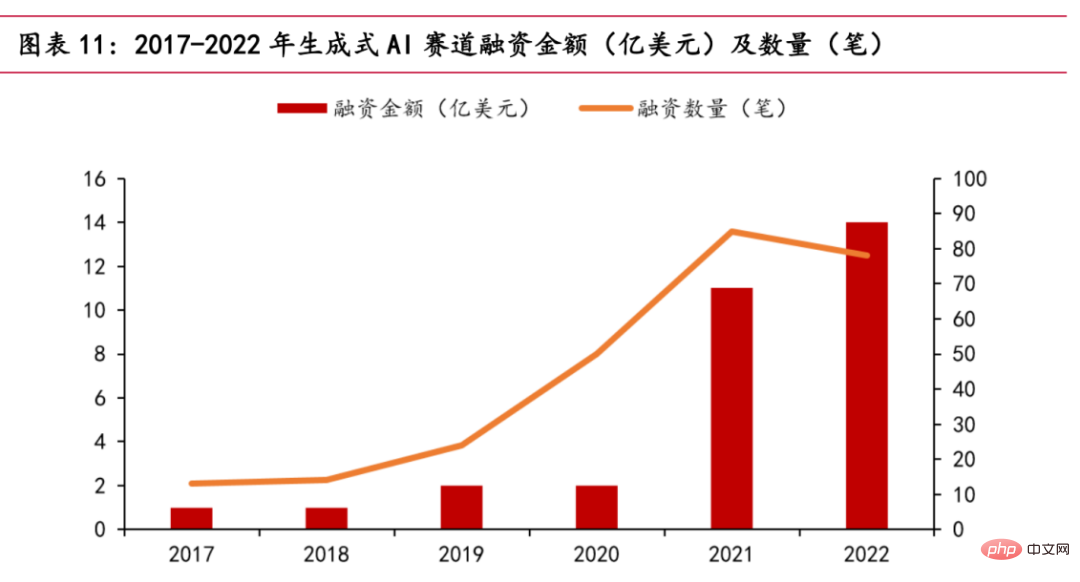

Kini, trek AI generatif sedang hangat. Menurut statistik PitchBook, landasan AI generatif akan menerima sejumlah kira-kira AS$1.4 bilion dalam pembiayaan pada 2022, hampir mencecah jumlah keseluruhan lima tahun yang lalu. Syarikat bintang seperti OpenAI dan Stability AI, dan syarikat permulaan lain seperti Jasper, Regie.AI, Replika, dll. semuanya telah menerima bantuan modal.

Carta hubungan antara jumlah pembiayaan dan masa

Pada Oktober 2022, Stability AI menerima kira-kira AS$100 juta dalam pembiayaan, dan model sumber terbuka yang dikeluarkan Stable Penyebaran boleh berdasarkan Input penerangan teks oleh pengguna menjana gambar, meletupkan bidang lukisan AI. Pada 30 November 2022, selepas ChatGPT mengumumkan beta awamnya, lima hari selepas ia masuk dalam talian, bilangan pengguna global melebihi satu juta. Dalam masa kurang daripada 40 hari sejak pelancarannya, pengguna aktif harian telah melebihi 10 juta. Pada awal pagi 15 Mac 2023, OpenAI mengeluarkan model siri GPT-GPT-4 terkuat pada masa ini, yang menyediakan model berbilang modal berskala besar yang boleh menerima input imej dan teks serta menghasilkan output teks, yang mempunyai kesan gangguan dalam industri. Pada 17 Mac 2023, Microsoft mengadakan persidangan Microsoft 365 Copilot, secara rasmi memasang model GPT-4 OpenAI ke dalam suite Office, dan melancarkan Copilot fungsi AI baharu. Ia bukan sahaja boleh membuat PPT dan menulis salinan, tetapi juga melakukan analisis dan menjana video. Selain itu, pelbagai pengeluar domestik utama turut mengumumkan pelancaran produk serupa dengan ChatGPT. Pada 8 Februari, pakar Alibaba mengumumkan bahawa Akademi Damo sedang membangunkan robot perbualan seperti ChatGPT dan telah membukanya kepada pekerja dalam syarikat untuk ujian. Adalah mungkin untuk menggabungkan teknologi model besar AI secara mendalam dengan alat produktiviti DingTalk. Pada 8 Februari, He Xiaodong, Naib Presiden JD.com, berkata terus terang: JD.com mempunyai senario yang kaya dan data berkualiti tinggi dalam bidang ChatGPT. Pada 9 Februari, sumber berkaitan di Tencent berkata: Tencent kini mempunyai rancangan untuk produk yang serupa dengan kandungan ChatGPT dan AI, dan penyelidikan khas juga sedang berjalan dengan teratur. NetEase berkata bahawa perniagaan pendidikannya akan menyepadukan kandungan yang dijana AI, termasuk tetapi tidak terhad kepada guru penutur AI, pemarkahan dan penilaian esei, dsb. Pada 16 Mac, Baidu secara rasmi mengeluarkan model bahasa besar dan produk AI generatif "Wen Xin Yi Yan" Dua hari selepas dikeluarkan, 12 syarikat telah melengkapkan kumpulan pertama kerjasama kontrak dan memohon panggilan API Baidu Intelligent Cloud Wen Xin Yi Yan. perkhidmatan. Bilangan syarikat yang diuji mencecah 90,000.

Pada masa ini, model besar telah secara beransur-ansur menembusi kehidupan kita. Pada masa hadapan, semua lapisan masyarakat berkemungkinan akan mengalami perubahan yang menggegarkan bumi. Mengambil ChatGPT sebagai contoh, ia merangkumi aspek berikut:

- Media ChatGPT+: Ia boleh merealisasikan penulisan berita pintar dan meningkatkan keberkesanan berita

- ChatGPT+ Filem dan Televisyen: Sesuaikan filem dan kandungan televisyen mengikut minat awam Mendapat penarafan yang lebih tinggi, box office dan dari mulut ke mulut mengurangkan kos penciptaan kandungan untuk pasukan penerbitan filem dan televisyen dan meningkatkan kecekapan kreatif.

- Pemasaran ChatGPT+: Bertindak sebagai perkhidmatan pelanggan maya untuk membantu pemasaran produk. Sebagai contoh, pengenalan produk 24 jam dan perkhidmatan dalam talian mengurangkan kos pemasaran dengan cepat dapat memahami keperluan pelanggan dan mengikuti aliran teknologi menyediakan perkhidmatan perundingan yang stabil dan boleh dipercayai dengan kawalan dan keselamatan yang kukuh;

- ChatGPT+Hiburan: Objek sembang masa nyata, mempertingkatkan persahabatan dan keseronokan.

- Pendidikan ChatGPT+: Menyediakan alat pendidikan baharu untuk menyemak dan mengisi jurang dengan cepat melalui soalan layan diri.

- ChatGPT+ Finance: Realisasikan maklumat kewangan, pengeluaran automatik produk kewangan dan cipta penasihat kewangan maya.

- SembangGPT+Perubatan: Fahami keadaan pesakit dengan cepat dan berikan maklum balas tepat pada masanya, memberikan sokongan emosi segera.

Perlu diingatkan bahawa walaupun perbincangan utama di sini ialah pelaksanaan model bahasa yang besar, sebenarnya, model besar berbilang modal (audio, video, gambar) lain juga mempunyai senario aplikasi yang luas.

2. Pengenalan kepada model generatif

1. Model bahasa besar arus perdana: LaMDA

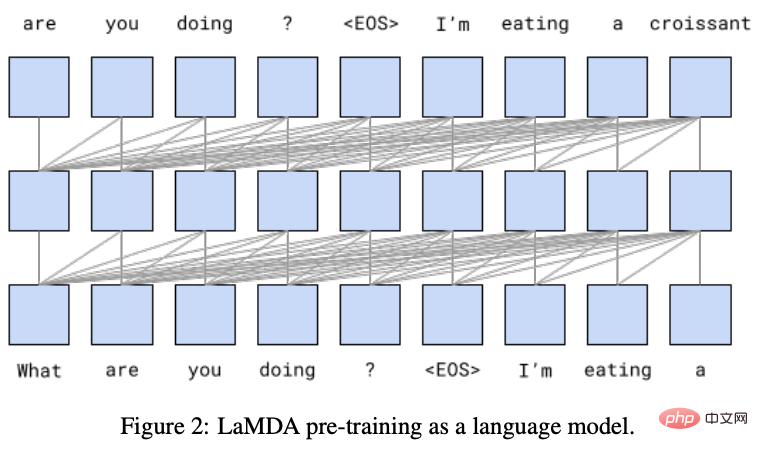

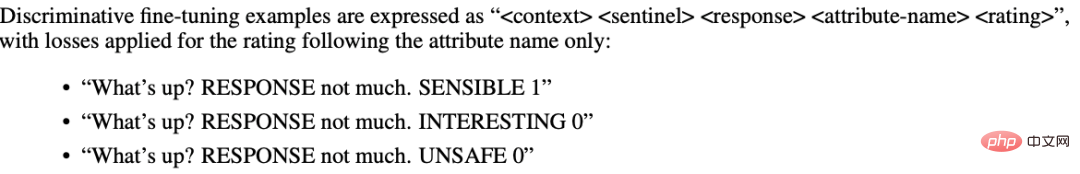

dikeluarkan oleh Google. Model LaMDA adalah berdasarkan rangka kerja pengubah, mempunyai 137 bilion parameter model dan mempunyai keupayaan untuk memodelkan kebergantungan jarak jauh dalam teks. Model dilatih melalui perbualan. Ia terutamanya merangkumi dua proses: pra-latihan dan penalaan halus: Dalam peringkat pra-latihan, mereka menggunakan sehingga 1.56T set data perbualan awam dan teks halaman web, menggunakan model bahasa (LM) sebagai fungsi objektif latihan, iaitu matlamatnya adalah untuk meramal watak seterusnya (token). Dalam fasa penalaan halus, mereka mereka bentuk berbilang tugas, seperti atribut pemarkahan respons (sensitiviti, keselamatan, dll.), untuk memberikan model bahasa pilihan manusianya. Rajah di bawah menunjukkan satu jenis tugasan penalaan halus.

Fasa pra-latihan model LaMDA

Salah satu tugas fasa penalaan halus model LaMDA

Model LaMDA Memfokuskan pada tugas penjanaan dialog tetapi sering membuat kesilapan fakta. Google mengeluarkan Bard (perkhidmatan AI perbualan percubaan) tahun ini, yang dikuasakan oleh model LaMDA. Walau bagaimanapun, semasa sidang akhbar Bard, Bard membuat kesilapan fakta, yang menyebabkan harga saham Google menjunam pada hari Rabu, jatuh lebih daripada 8% semasa sesi itu serendah kira-kira AS$98 pada hari penyegaran, dan nilai pasarannya hilang sebanyak AS$110 bilion, yang mengecewakan.

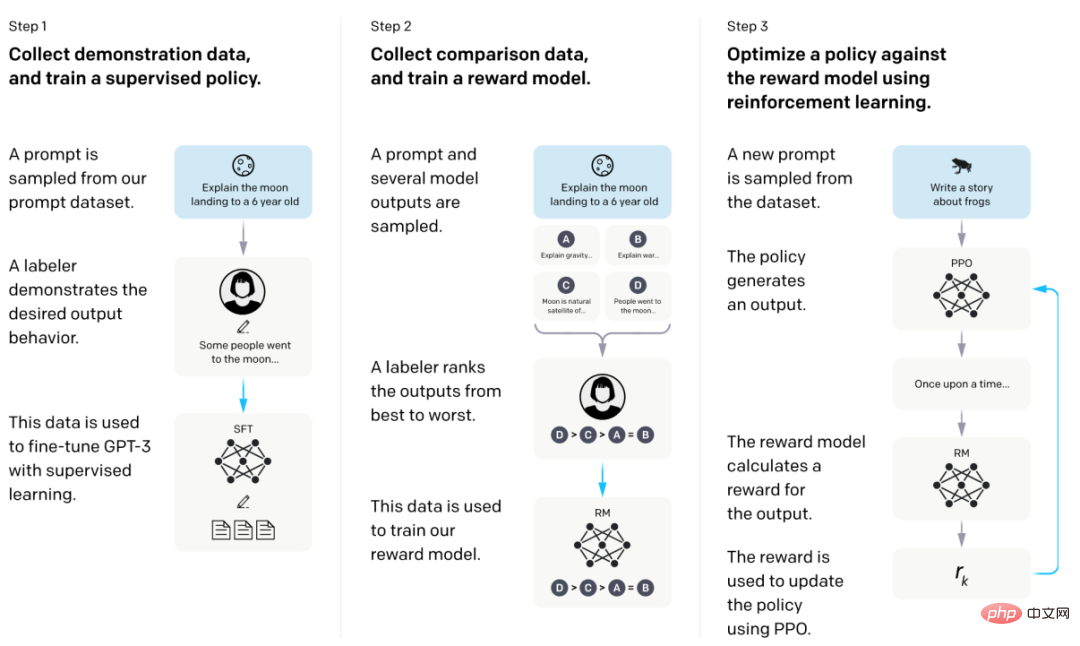

2. Model bahasa besar arus perdana: InstructGPT

Model InstructGPT adalah berdasarkan seni bina GPT dan terutamanya terdiri daripada penalaan halus diselia (Supervise Fune-Tuning, SFT) dan pembelajaran pengukuhan maklum balas manusia (Reinforce Learning Penalaan Fune Manusia, RLHF). ChatGPT, produk perbualan yang dikuasakan oleh InstructGPT, menumpukan pada penjanaan teks bahasa, dan juga boleh menjana kod dan melaksanakan operasi matematik yang mudah. Butiran teknikal khusus telah dibincangkan secara terperinci dalam dua isu sebelumnya. Pembaca boleh membacanya di sini dan tidak akan mengulanginya di sini.

Carta aliran latihan model InstructGPT

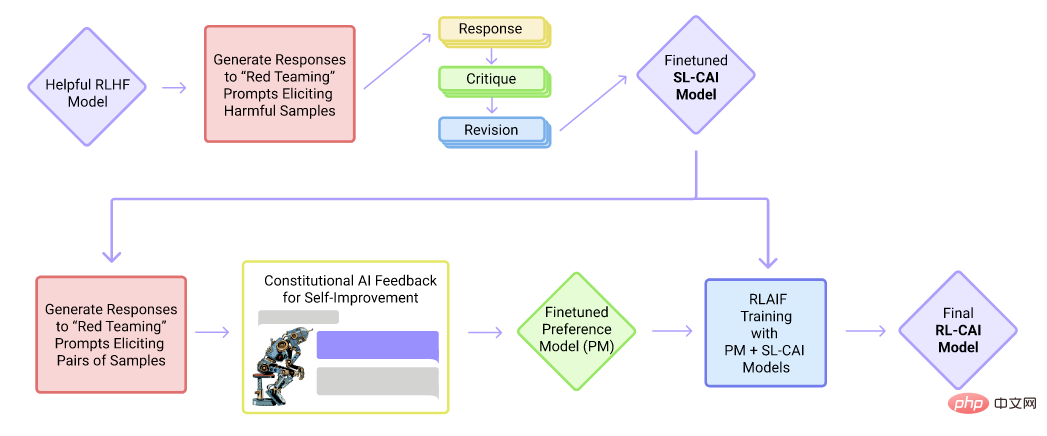

3. Model bahasa besar arus perdana: Cluade

Cluade. carta aliran latihan model

Cluade ialah produk perbualan Syarikat Anthropic. Cluade, seperti ChatGPT, adalah berdasarkan rangka kerja GPT dan merupakan model bahasa sehala. Walau bagaimanapun, tidak seperti ChatGPT, ia dilatih terutamanya oleh penalaan halus dan pembelajaran pengukuhan yang diselia dengan maklum balas AI. Dalam peringkat penalaan halus yang diselia, ia mula-mula merumuskan satu siri peraturan (Perlembagaan), seperti tiada maklumat berbahaya, tiada berat sebelah kaum, dsb., dan kemudian memperoleh data yang diselia berdasarkan peraturan ini. Kemudian, biarkan AI menilai kualiti respons dan melatih set data secara automatik untuk pembelajaran pengukuhan.

Berbanding dengan ChatGPT, Claude boleh menolak permintaan yang tidak sesuai dengan lebih jelas, dan perkaitan antara ayat lebih semula jadi. Claude sanggup bersuara apabila berhadapan dengan masalah yang di luar kemampuannya. Pada masa ini, Cluade masih dalam peringkat ujian dalaman. Bagaimanapun, menurut keputusan ujian dalaman ahli pasukan Scale Sepllbook, berbanding ChatGPT, Claude lebih kuat dalam 8 daripada 12 tugasan yang diuji.

3. Keupayaan model bahasa besar

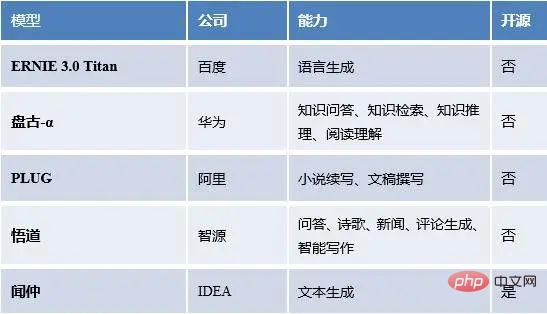

Kami mempunyai statistik tentang model bahasa besar di dalam dan luar negara, serta keupayaan model, status sumber terbuka, dsb.

Model bahasa besar popular domestik

Model bahasa besar popular asing

boleh dilihat Ia ternyata model bahasa yang besar mempunyai pelbagai keupayaan, termasuk tetapi tidak terhad kepada pembelajaran beberapa pukulan, pemindahan sifar pukulan dan sebagainya. Jadi persoalan yang sangat wajar timbul, bagaimana kebolehan ini muncul? Dari mana datangnya kuasa model bahasa yang besar? Seterusnya, kami cuba menjawab keraguan di atas.

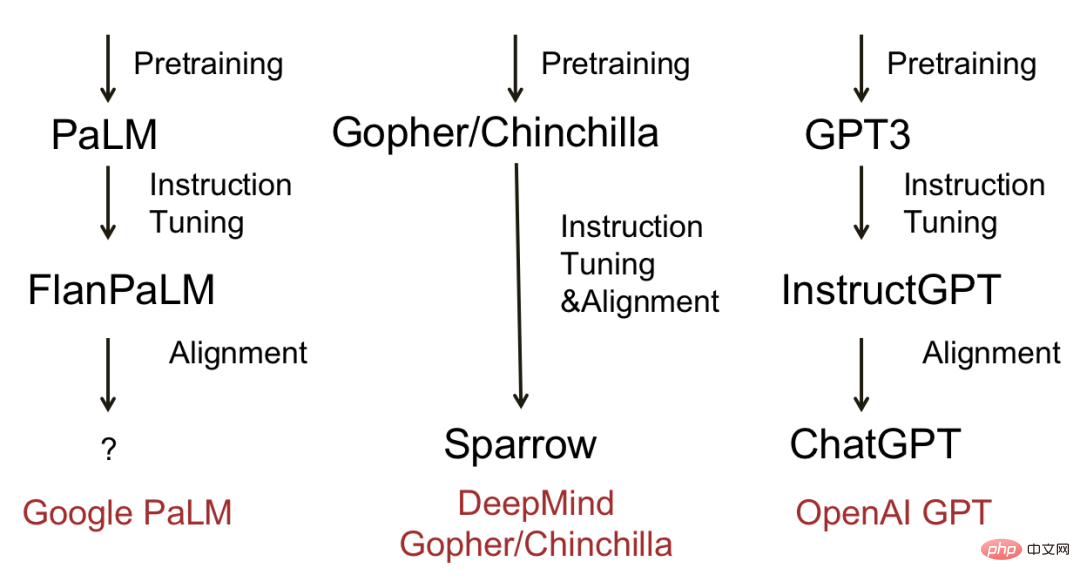

Rajah di bawah menunjukkan beberapa model bahasa besar yang matang dan proses evolusi. Kesimpulannya, kebanyakan model akan melalui tiga peringkat: pra-latihan, penalaan halus arahan dan penjajaran. Model perwakilan termasuk Deepmind's Sparrow dan OpenAI's ChatGPT.

Rajah evolusi model bahasa besar yang popular

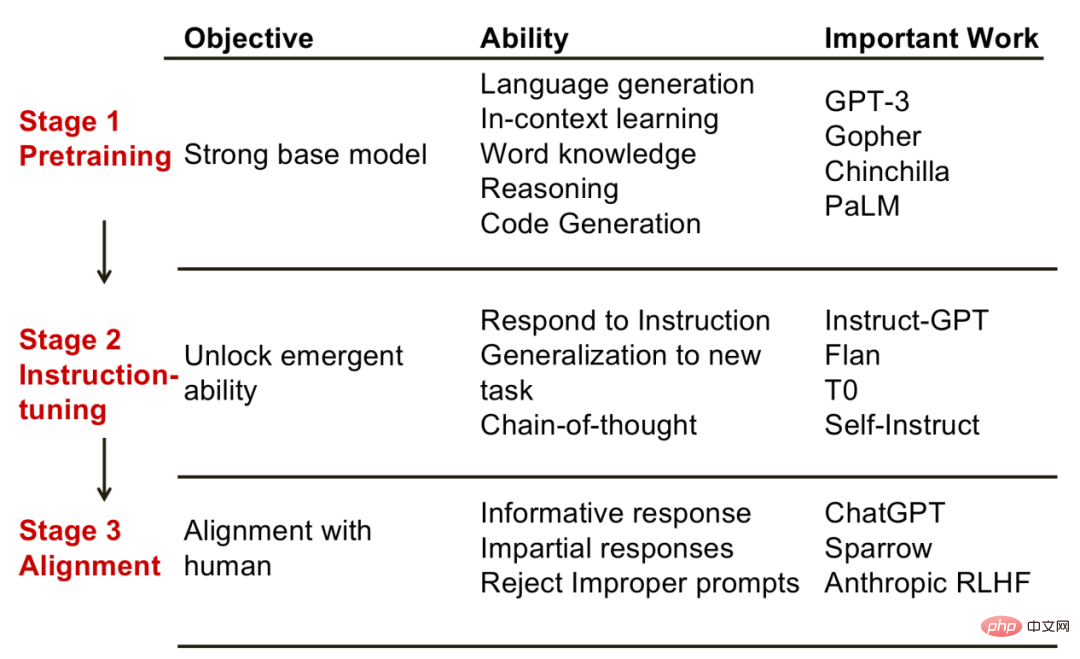

Jadi, di sebalik setiap langkah, apakah jenis keupayaan yang boleh dicapai oleh model itu? Dr. Fu Yao dari Universiti Edinburgh meringkaskan perkara yang dipercayainya sebagai hubungan yang sepadan antara langkah dan kebolehan, memberikan kami sedikit inspirasi.

1. Fasa pra-latihan Matlamat fasa ini adalah untuk mendapatkan model asas yang berkuasa. Sejajar dengan itu, keupayaan yang ditunjukkan oleh model pada peringkat ini termasuk: penjanaan bahasa, keupayaan pembelajaran konteks, pengetahuan dunia, keupayaan penaakulan, dll. Model perwakilan pada peringkat ini termasuk GPT-3, PaLM, dsb.

2. Tahap penalaan halus. Matlamat fasa ini adalah untuk membuka beberapa kebolehan yang muncul. Keupayaan timbul di sini secara khusus merujuk kepada keupayaan yang tidak dimiliki oleh model kecil tetapi hanya model besar sahaja. Model yang telah menjalani penalaan halus arahan mempunyai keupayaan yang tidak dimiliki oleh model asas. Sebagai contoh, dengan membina arahan baru, model boleh menyelesaikan tugasan baru contoh lain ialah keupayaan rantaian pemikiran, iaitu, dengan menunjukkan model proses penaakulan, model juga boleh meniru penaakulan yang betul, dll. Model perwakilan termasuk InstructGPT, Flan, dsb.

Fasa penjajaran. Matlamat peringkat ini adalah untuk menjadikan model itu mempunyai nilai kemanusiaan, seperti untuk menjana balasan bermaklumat dan bukan untuk menghasilkan kenyataan diskriminasi, dsb. Ia boleh dianggap bahawa peringkat penjajaran memberikan model "personaliti". Model perwakilan jenis ini ialah ChatGPT.

Tiga peringkat model bahasa besar. Gambar itu datang daripada "Fu Yao: Mengenai Sumber Keupayaan Model Bahasa Besar"

Secara umumnya, ketiga-tiga peringkat di atas saling melengkapi dan amat diperlukan. Hanya apabila model asas yang cukup berkuasa diperoleh dalam peringkat pra-latihan bolehlah untuk merangsang (atau meningkatkan) keupayaan lain model bahasa melalui penalaan halus arahan. Peringkat penjajaran memberikan model "watak" tertentu untuk lebih mematuhi beberapa keperluan masyarakat manusia.

4. Pengenalpastian model generatif

Walaupun teknologi model bahasa besar membawa kemudahan, ia juga mengandungi risiko dan cabaran. Pada peringkat teknikal, ketulenan kandungan yang dijana oleh GPT tidak boleh dijamin, seperti pertuturan berbahaya, dsb. Pada peringkat penggunaan, pengguna mungkin menyalahgunakan teks yang dijana AI dalam bidang seperti pendidikan dan penyelidikan saintifik. Pada masa ini, banyak syarikat dan institusi telah mula mengenakan sekatan ke atas penggunaan ChatGPT. Microsoft dan Amazon telah melarang pekerja syarikat daripada berkongsi data sensitif kepada ChatGPT kerana bimbang membocorkan maklumat sulit Universiti Hong Kong telah mengharamkan penggunaan ChatGPT atau alat kecerdasan buatan lain dalam semua kelas, tugasan dan penilaian di Universiti Hong Kong. Kami terutamanya memperkenalkan kerja berkaitan dalam industri.

GPTZero: GPTZero ialah alat penjanaan teks dan pengenalan yang terawal. Ia adalah laman web dalam talian (https://gptzero.me/) yang diterbitkan oleh Edward Tian (pelajar sarjana muda CS dari Princeton, Amerika Syarikat). Prinsipnya bergantung pada kebingungan teks (PPL) sebagai penunjuk untuk menentukan siapa yang menulis kandungan yang diberikan. Antaranya, kebingungan digunakan untuk menilai kualiti model bahasa, yang pada asasnya untuk mengira kebarangkalian ayat muncul.

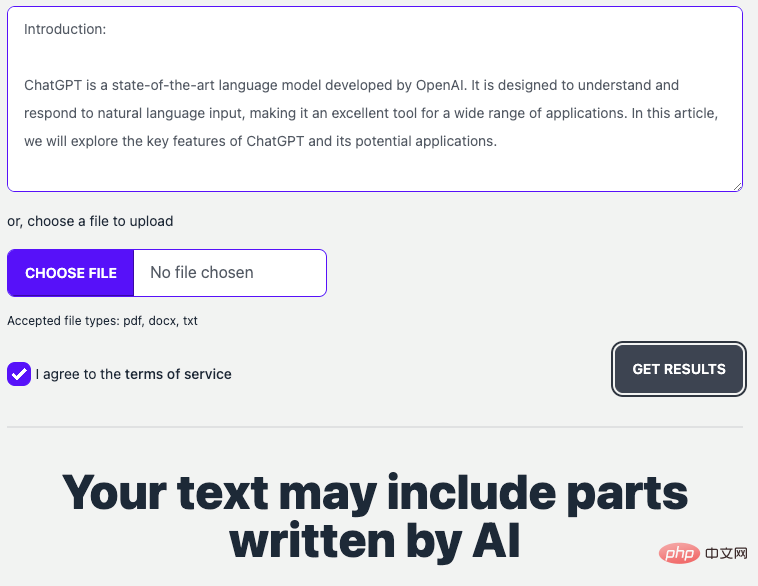

Antara muka tapak web GPTZero

(Di sini kami menggunakan ChatGPT untuk menjana laporan berita dan membenarkan GPTZero menentukan sama ada ia dijana teks.)

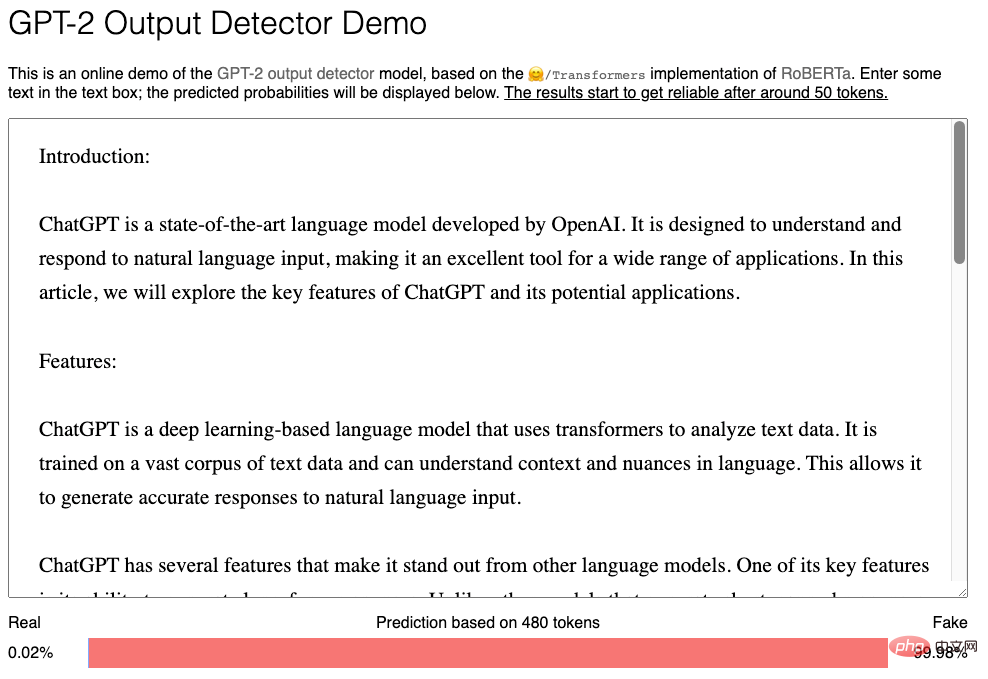

Pengesan Output GPT2: Alat ini diterbitkan oleh OpenAI. Ia memanfaatkan set data "Kandungan Dijana GPT2" dan Reddit, diperhalusi pada RoBerta, untuk mempelajari pengelas pengesanan. Iaitu, "lawan sihir dengan sihir." Laman web rasmi juga mengingatkan bahawa keputusan ramalan lebih boleh dipercayai hanya apabila teks melebihi 50 aksara (token).

Antara muka tapak web Pengesan Output GPT2

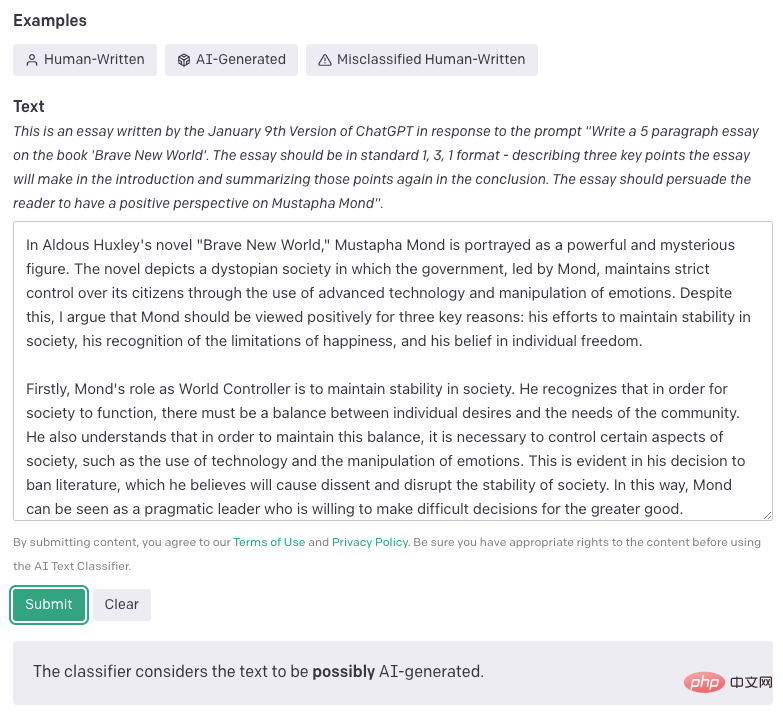

Pengelas Teks AI: Alat ini dikeluarkan oleh OpenAI. Prinsipnya adalah untuk mengumpul teks tulisan manusia dan teks penulisan AI pada topik yang sama. Bahagikan setiap teks kepada pasangan gesaan dan balas, dan biarkan kebarangkalian GPT menghasilkan jawapan selepas penalaan halus (contohnya, membenarkan GPT menghasilkan Ya/Tidak) sebagai ambang keputusan. Pengelasan alat ini sangat terperinci, dan hasilnya termasuk 5 kategori: sangat tidak mungkin dijana oleh AI (ambang 0.98).

Antara muka laman web Pengelas Teks AI

5 Ringkasan & Tinjauan

Model bahasa besar mempunyai keupayaan muncul yang tidak dimiliki oleh model kecil. seperti pembelajaran sampel sifar yang sangat baik, pemindahan domain dan keupayaan rantai pemikiran. Keupayaan model besar sebenarnya datang daripada pra-latihan, penalaan halus arahan dan penjajaran Ketiga-tiga proses ini berkait rapat dan telah membolehkan model bahasa besar yang sangat berkuasa hari ini.

Model bahasa besar (siri GPT) pada masa ini tidak mempunyai keupayaan kemas kini keyakinan, penaakulan formal, carian Internet, dsb. Sesetengah pakar percaya bahawa jika pengetahuan boleh diturunkan di luar model, bilangan parameter akan dikurangkan dengan banyak, dan model bahasa besar akan dikurangkan dengan banyaknya. Model benar-benar boleh melangkah lebih jauh.

Hanya di bawah pengawasan dan tadbir urus yang munasabah, teknologi kecerdasan buatan boleh memberi perkhidmatan yang lebih baik kepada orang ramai. Masih jauh lagi untuk membangunkan model berskala besar di China!

Rujukan

[1] https://stablediffusionweb.com

[2] https://openai.com/product/gpt-4

[3] LaMDA: Model Bahasa untuk Aplikasi Dialog, Arxiv 2022.10

[4] AI Perlembagaan: Ketidakmudaratan daripada Maklum Balas AI, Arxiv 2022.12

[5] https://scale.com / blog/chatgpt-vs-claude#Calculation

[6] Guolian Securities: "ChatGPT telah tiba, dan pengkomersilan semakin pantas"

[7] Guotai Junan Securities: "Rangka Kerja Penyelidikan ChatGPT 2023》

[8] Fu Yao: Pra-latihan, penalaan halus arahan, penjajaran, pengkhususan: Mengenai sumber keupayaan model bahasa yang besar https://www.bilibili.com/video/BV1Qs4y1h7pn/?spm_id_from= 333.880 .my_history.page.click&vd_source=da8bf0b993cab65c4de0f26405823475

[9] Analisis artikel sepanjang 10,000 perkataan! Hasilkan semula dan gunakan GPT-3/ChatGPT, perkara yang anda patut tahu https://mp.weixin.qq.com/s/ILpbRRNP10Ef1z3lb2CqmA

Atas ialah kandungan terperinci Topik Khas ChatGPT: Keupayaan dan Masa Depan Model Bahasa Besar. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1378

1378

52

52

ChatGPT kini membenarkan pengguna percuma menjana imej dengan menggunakan DALL-E 3 dengan had harian

Aug 09, 2024 pm 09:37 PM

ChatGPT kini membenarkan pengguna percuma menjana imej dengan menggunakan DALL-E 3 dengan had harian

Aug 09, 2024 pm 09:37 PM

DALL-E 3 telah diperkenalkan secara rasmi pada September 2023 sebagai model yang jauh lebih baik daripada pendahulunya. Ia dianggap sebagai salah satu penjana imej AI terbaik setakat ini, mampu mencipta imej dengan perincian yang rumit. Walau bagaimanapun, semasa pelancaran, ia adalah tidak termasuk

Bytedance Cutting melancarkan keahlian super SVIP: 499 yuan untuk langganan tahunan berterusan, menyediakan pelbagai fungsi AI

Jun 28, 2024 am 03:51 AM

Bytedance Cutting melancarkan keahlian super SVIP: 499 yuan untuk langganan tahunan berterusan, menyediakan pelbagai fungsi AI

Jun 28, 2024 am 03:51 AM

Laman web ini melaporkan pada 27 Jun bahawa Jianying ialah perisian penyuntingan video yang dibangunkan oleh FaceMeng Technology, anak syarikat ByteDance Ia bergantung pada platform Douyin dan pada asasnya menghasilkan kandungan video pendek untuk pengguna platform tersebut Windows , MacOS dan sistem pengendalian lain. Jianying secara rasmi mengumumkan peningkatan sistem keahliannya dan melancarkan SVIP baharu, yang merangkumi pelbagai teknologi hitam AI, seperti terjemahan pintar, penonjolan pintar, pembungkusan pintar, sintesis manusia digital, dsb. Dari segi harga, yuran bulanan untuk keratan SVIP ialah 79 yuan, yuran tahunan ialah 599 yuan (nota di laman web ini: bersamaan dengan 49.9 yuan sebulan), langganan bulanan berterusan ialah 59 yuan sebulan, dan langganan tahunan berterusan ialah 499 yuan setahun (bersamaan dengan 41.6 yuan sebulan) . Di samping itu, pegawai yang dipotong juga menyatakan bahawa untuk meningkatkan pengalaman pengguna, mereka yang telah melanggan VIP asal

Pembantu pengekodan AI yang ditambah konteks menggunakan Rag dan Sem-Rag

Jun 10, 2024 am 11:08 AM

Pembantu pengekodan AI yang ditambah konteks menggunakan Rag dan Sem-Rag

Jun 10, 2024 am 11:08 AM

Tingkatkan produktiviti, kecekapan dan ketepatan pembangun dengan menggabungkan penjanaan dipertingkatkan semula dan memori semantik ke dalam pembantu pengekodan AI. Diterjemah daripada EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, pengarang JanakiramMSV. Walaupun pembantu pengaturcaraan AI asas secara semulajadi membantu, mereka sering gagal memberikan cadangan kod yang paling relevan dan betul kerana mereka bergantung pada pemahaman umum bahasa perisian dan corak penulisan perisian yang paling biasa. Kod yang dijana oleh pembantu pengekodan ini sesuai untuk menyelesaikan masalah yang mereka bertanggungjawab untuk menyelesaikannya, tetapi selalunya tidak mematuhi piawaian pengekodan, konvensyen dan gaya pasukan individu. Ini selalunya menghasilkan cadangan yang perlu diubah suai atau diperhalusi agar kod itu diterima ke dalam aplikasi

Bolehkah penalaan halus benar-benar membolehkan LLM mempelajari perkara baharu: memperkenalkan pengetahuan baharu boleh menjadikan model menghasilkan lebih banyak halusinasi

Jun 11, 2024 pm 03:57 PM

Bolehkah penalaan halus benar-benar membolehkan LLM mempelajari perkara baharu: memperkenalkan pengetahuan baharu boleh menjadikan model menghasilkan lebih banyak halusinasi

Jun 11, 2024 pm 03:57 PM

Model Bahasa Besar (LLM) dilatih pada pangkalan data teks yang besar, di mana mereka memperoleh sejumlah besar pengetahuan dunia sebenar. Pengetahuan ini dibenamkan ke dalam parameter mereka dan kemudiannya boleh digunakan apabila diperlukan. Pengetahuan tentang model ini "diperbaharui" pada akhir latihan. Pada akhir pra-latihan, model sebenarnya berhenti belajar. Selaraskan atau perhalusi model untuk mempelajari cara memanfaatkan pengetahuan ini dan bertindak balas dengan lebih semula jadi kepada soalan pengguna. Tetapi kadangkala pengetahuan model tidak mencukupi, dan walaupun model boleh mengakses kandungan luaran melalui RAG, ia dianggap berfaedah untuk menyesuaikan model kepada domain baharu melalui penalaan halus. Penalaan halus ini dilakukan menggunakan input daripada anotasi manusia atau ciptaan LLM lain, di mana model menemui pengetahuan dunia sebenar tambahan dan menyepadukannya

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Editor |ScienceAI Question Answering (QA) set data memainkan peranan penting dalam mempromosikan penyelidikan pemprosesan bahasa semula jadi (NLP). Set data QA berkualiti tinggi bukan sahaja boleh digunakan untuk memperhalusi model, tetapi juga menilai dengan berkesan keupayaan model bahasa besar (LLM), terutamanya keupayaan untuk memahami dan menaakul tentang pengetahuan saintifik. Walaupun pada masa ini terdapat banyak set data QA saintifik yang meliputi bidang perubatan, kimia, biologi dan bidang lain, set data ini masih mempunyai beberapa kekurangan. Pertama, borang data adalah agak mudah, kebanyakannya adalah soalan aneka pilihan. Ia mudah dinilai, tetapi mengehadkan julat pemilihan jawapan model dan tidak dapat menguji sepenuhnya keupayaan model untuk menjawab soalan saintifik. Sebaliknya, Soal Jawab terbuka

Prestasi SOTA, kaedah AI ramalan pertalian protein-ligan pelbagai mod Xiamen, menggabungkan maklumat permukaan molekul buat kali pertama

Jul 17, 2024 pm 06:37 PM

Prestasi SOTA, kaedah AI ramalan pertalian protein-ligan pelbagai mod Xiamen, menggabungkan maklumat permukaan molekul buat kali pertama

Jul 17, 2024 pm 06:37 PM

Editor |. KX Dalam bidang penyelidikan dan pembangunan ubat, meramalkan pertalian pengikatan protein dan ligan dengan tepat dan berkesan adalah penting untuk pemeriksaan dan pengoptimuman ubat. Walau bagaimanapun, kajian semasa tidak mengambil kira peranan penting maklumat permukaan molekul dalam interaksi protein-ligan. Berdasarkan ini, penyelidik dari Universiti Xiamen mencadangkan rangka kerja pengekstrakan ciri berbilang mod (MFE) novel, yang buat pertama kalinya menggabungkan maklumat mengenai permukaan protein, struktur dan jujukan 3D, dan menggunakan mekanisme perhatian silang untuk membandingkan ciri modaliti yang berbeza penjajaran. Keputusan eksperimen menunjukkan bahawa kaedah ini mencapai prestasi terkini dalam meramalkan pertalian mengikat protein-ligan. Tambahan pula, kajian ablasi menunjukkan keberkesanan dan keperluan maklumat permukaan protein dan penjajaran ciri multimodal dalam rangka kerja ini. Penyelidikan berkaitan bermula dengan "S

SK Hynix akan memaparkan produk berkaitan AI baharu pada 6 Ogos: HBM3E 12 lapisan, NAND 321 tinggi, dsb.

Aug 01, 2024 pm 09:40 PM

SK Hynix akan memaparkan produk berkaitan AI baharu pada 6 Ogos: HBM3E 12 lapisan, NAND 321 tinggi, dsb.

Aug 01, 2024 pm 09:40 PM

Menurut berita dari laman web ini pada 1 Ogos, SK Hynix mengeluarkan catatan blog hari ini (1 Ogos), mengumumkan bahawa ia akan menghadiri Global Semiconductor Memory Summit FMS2024 yang akan diadakan di Santa Clara, California, Amerika Syarikat dari 6 hingga 8 Ogos, mempamerkan banyak produk penjanaan teknologi baru. Pengenalan kepada Sidang Kemuncak Memori dan Penyimpanan Masa Depan (FutureMemoryandStorage), dahulunya Sidang Kemuncak Memori Flash (FlashMemorySummit) terutamanya untuk pembekal NAND, dalam konteks peningkatan perhatian kepada teknologi kecerdasan buatan, tahun ini dinamakan semula sebagai Sidang Kemuncak Memori dan Penyimpanan Masa Depan (FutureMemoryandStorage) kepada jemput vendor DRAM dan storan serta ramai lagi pemain. Produk baharu SK hynix dilancarkan tahun lepas

Meletakkan pasaran seperti AI, GlobalFoundries memperoleh teknologi gallium nitrida Tagore Technology dan pasukan berkaitan

Jul 15, 2024 pm 12:21 PM

Meletakkan pasaran seperti AI, GlobalFoundries memperoleh teknologi gallium nitrida Tagore Technology dan pasukan berkaitan

Jul 15, 2024 pm 12:21 PM

Menurut berita dari laman web ini pada 5 Julai, GlobalFoundries mengeluarkan kenyataan akhbar pada 1 Julai tahun ini, mengumumkan pemerolehan teknologi power gallium nitride (GaN) Tagore Technology dan portfolio harta intelek, dengan harapan dapat mengembangkan bahagian pasarannya dalam kereta dan Internet of Things dan kawasan aplikasi pusat data kecerdasan buatan untuk meneroka kecekapan yang lebih tinggi dan prestasi yang lebih baik. Memandangkan teknologi seperti AI generatif terus berkembang dalam dunia digital, galium nitrida (GaN) telah menjadi penyelesaian utama untuk pengurusan kuasa yang mampan dan cekap, terutamanya dalam pusat data. Laman web ini memetik pengumuman rasmi bahawa semasa pengambilalihan ini, pasukan kejuruteraan Tagore Technology akan menyertai GLOBALFOUNDRIES untuk membangunkan lagi teknologi gallium nitride. G