Peranti teknologi

Peranti teknologi

AI

AI

CMU bergabung tenaga dengan Adobe: Model GAN menyambut era pra-latihan, hanya memerlukan 1% sampel latihan

CMU bergabung tenaga dengan Adobe: Model GAN menyambut era pra-latihan, hanya memerlukan 1% sampel latihan

CMU bergabung tenaga dengan Adobe: Model GAN menyambut era pra-latihan, hanya memerlukan 1% sampel latihan

Selepas memasuki era pra-latihan, prestasi model pengecaman visual telah berkembang pesat, tetapi model penjanaan imej, seperti rangkaian musuh generatif (GAN), nampaknya ketinggalan.

Biasanya latihan GAN dilakukan dari awal tanpa pengawasan, yang memakan masa dan memerlukan tenaga kerja "pengetahuan" yang dipelajari melalui data besar dalam pra-latihan berskala besar tidak digunakan rugi besar?

Selain itu, penjanaan imej itu sendiri perlu dapat menangkap dan mensimulasikan data statistik yang kompleks dalam fenomena visual dunia sebenar, jika tidak, imej yang dijana tidak akan mematuhi undang-undang dunia fizikal dan akan dikenal pasti secara langsung sebagai "palsu" sekali pandang.

Model pra-latihan memberikan pengetahuan dan model GAN menyediakan keupayaan penjanaan Gabungan kedua-duanya mungkin satu perkara yang cantik.

Persoalannya, model pra-latihan manakah dan cara menggabungkannya boleh meningkatkan keupayaan penjanaan model GAN?

Baru-baru ini, penyelidik dari CMU dan Adobe menerbitkan artikel dalam CVPR 2022, menggabungkan latihan model pra-latihan dengan model GAN melalui "pemilihan".

Pautan kertas: https://arxiv.org/abs/2112.09130

Pautan projek: https://github.com/nupurkmr9/vision- aided-gan

Pautan video: https://www.youtube.com/watch?v=oHdyJNdQ9E4

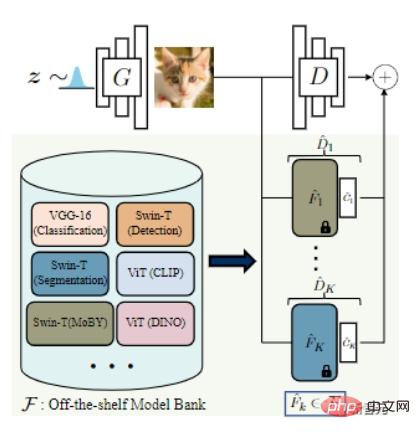

Proses latihan model GAN terdiri daripada diskriminator dan penjana, di mana diskriminator Penjana digunakan untuk mempelajari statistik berkaitan yang membezakan sampel sebenar daripada sampel yang dijana, manakala matlamat penjana adalah untuk menjadikan imej yang dihasilkan selaras mungkin dengan pengedaran sebenar.

Sebaik-baiknya, pendiskriminasi harus dapat mengukur jurang pengedaran antara imej yang dijana dan imej sebenar.

Walau bagaimanapun, apabila jumlah data sangat terhad, secara langsung menggunakan model pra-latihan berskala besar kerana diskriminator boleh dengan mudah menyebabkan penjana "dihancurkan secara kejam" dan kemudian "terlalu pas".

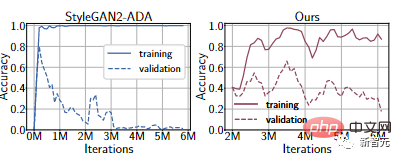

Melalui percubaan pada set data FFHQ 1k, walaupun kaedah peningkatan data boleh dibezakan terkini digunakan, diskriminator masih akan dipasang secara berlebihan Prestasi set latihan adalah sangat kuat, tetapi ia berprestasi sangat teruk pada set pengesahan .

Selain itu, diskriminasi mungkin menumpukan pada penyamaran yang tidak dapat dibezakan oleh manusia tetapi jelas kepada mesin.

Untuk mengimbangi keupayaan diskriminasi dan penjana, penyelidik mencadangkan untuk mengumpulkan perwakilan set model pra-latihan yang berbeza sebagai diskriminator.

Kaedah ini mempunyai dua faedah:

1 Melatih pengelas cetek pada ciri pra-latihan membolehkan rangkaian dalam menyesuaikan diri dengan skala kecil Kaedah biasa untuk set data sambil mengurangkan overfitting.

Maksudnya, selagi parameter model pra-latihan ditetapkan, dan kemudian rangkaian pengelasan ringan ditambah ke lapisan atas, proses latihan yang stabil boleh disediakan.

Sebagai contoh, daripada lengkung Ours dalam percubaan di atas, anda dapat melihat bahawa ketepatan set pengesahan jauh lebih baik berbanding StyleGAN2-ADA.

2. Beberapa kajian terkini telah membuktikan bahawa rangkaian dalam boleh menangkap konsep visual yang bermakna, daripada isyarat visual peringkat rendah (tepi dan tekstur) kepada konsep peringkat tinggi (objek dan bahagian objek).

Pendiskriminasi yang dibina berdasarkan ciri ini mungkin lebih selaras dengan persepsi manusia.

Dan menggabungkan berbilang model pra-latihan boleh mempromosikan penjana untuk memadankan pengedaran sebenar dalam ruang ciri yang berbeza dan saling melengkapi.

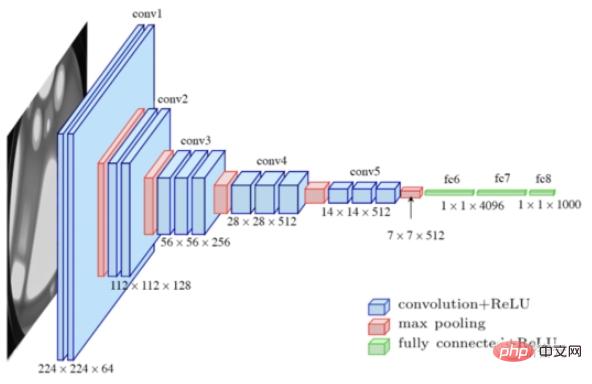

Untuk memilih rangkaian pra-latihan terbaik, para penyelidik mula-mula mengumpulkan beberapa model sota untuk membentuk "bank model", termasuk VGG-16 untuk pengelasan dan Swin-T untuk pengesanan dan pembahagian.

Kemudian, berdasarkan segmentasi linear imej sebenar dan palsu dalam ruang ciri, strategi carian model automatik dicadangkan, dan teknik pelicinan label dan boleh dibezakan digunakan untuk menstabilkan lagi latihan model untuk mengurangkan overfitting.

Khususnya, gabungan sampel latihan sebenar dan imej yang dijana dibahagikan kepada set latihan dan set pengesahan.

Untuk setiap model pra-latihan, latih diskriminator linear logistik untuk mengklasifikasikan sama ada sampel itu daripada sampel sebenar atau dijana, dan gunakan "kehilangan entropi silang binari negatif" pada pemisahan pengesahan untuk mengukur jurang pengedaran , dan Kembalikan model dengan ralat terkecil.

Ralat pengesahan yang lebih rendah dikaitkan dengan ketepatan pengesanan linear yang lebih tinggi, menunjukkan bahawa ciri ini berguna untuk membezakan sampel sebenar daripada sampel yang dijana dan menggunakan ciri ini boleh memberikan maklum balas yang lebih berguna kepada penjana.

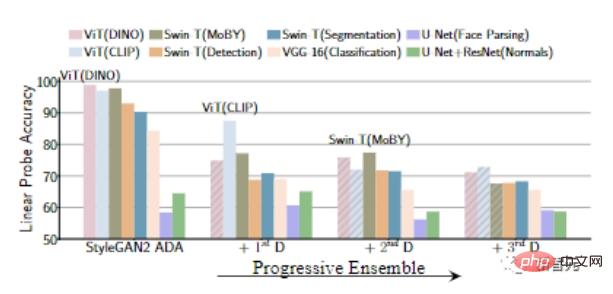

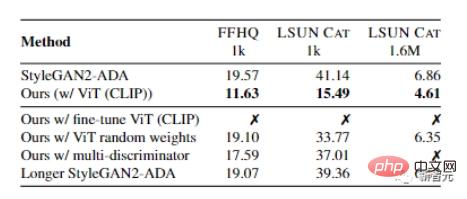

Penyelidik Kami mengesahkan latihan GAN secara empirik menggunakan 1000 sampel latihan daripada set data FFHQ dan LSUN CAT.

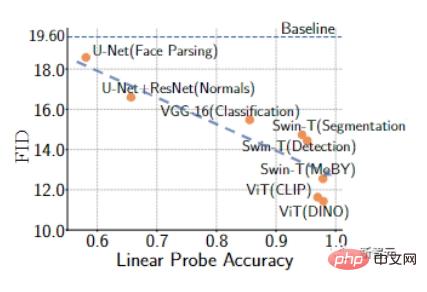

Keputusan menunjukkan bahawa GAN yang dilatih dengan model pra-latihan mempunyai ketepatan pengesanan linear yang lebih tinggi dan, secara amnya, boleh mencapai penunjuk FID yang lebih baik.

Keputusan menunjukkan bahawa GAN yang dilatih dengan model pra-latihan mempunyai ketepatan pengesanan linear yang lebih tinggi dan, secara amnya, boleh mencapai penunjuk FID yang lebih baik.

Untuk menggabungkan maklum balas daripada berbilang model sedia, artikel itu turut meneroka dua strategi pemilihan dan penyepaduan model

1) Strategi pemilihan model tetap K, memilih yang terbaik K di permulaan latihan Model sedia dan latih sehingga penumpuan;

2) Strategi pemilihan model K-progresif, secara berulang memilih dan menambah model berprestasi terbaik dan tidak digunakan selepas bilangan lelaran tetap.

Keputusan eksperimen menunjukkan bahawa berbanding dengan strategi K-fixed, pendekatan progresif mempunyai kerumitan pengiraan yang lebih rendah dan juga membantu dalam memilih model pra-latihan untuk menangkap perbezaan dalam pengedaran data. Sebagai contoh, dua model pertama yang dipilih oleh strategi progresif biasanya merupakan sepasang model yang diselia sendiri dan diselia.

Eksperimen dalam artikel kebanyakannya progresif.

Algoritma latihan akhir mula-mula melatih GAN dengan kerugian lawan standard.

Memandangkan penjana garis dasar, model pra-latihan terbaik boleh dicari menggunakan probing linear dan fungsi objektif kehilangan diperkenalkan semasa latihan.

Memandangkan penjana garis dasar, model pra-latihan terbaik boleh dicari menggunakan probing linear dan fungsi objektif kehilangan diperkenalkan semasa latihan.

Dalam strategi K-progresif, selepas latihan untuk bilangan lelaran tetap yang berkadar dengan bilangan sampel latihan sebenar yang tersedia, diskriminator bantuan visual baharu ditambah ke peringkat sebelumnya dengan set latihan terbaik Dalam petikan daripada FID.

Semasa latihan, penambahan data dilakukan dengan menyelak mendatar, dan teknik pembesaran yang boleh dibezakan dan pelicinan label sebelah pihak digunakan sebagai istilah penyelarasan.

Ia juga boleh diperhatikan bahawa menggunakan hanya model luar biasa sebagai diskriminasi membawa kepada perbezaan, manakala gabungan diskriminator asal dan model pra-latihan boleh memperbaiki keadaan ini.

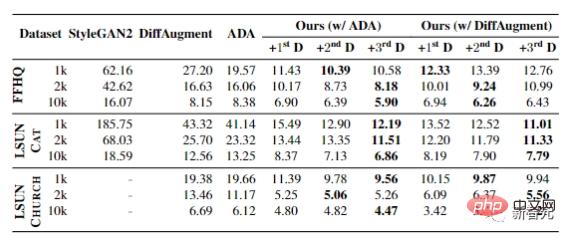

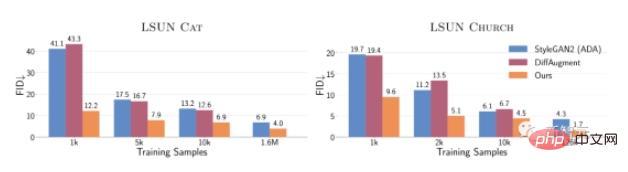

Eksperimen akhir menunjukkan keputusan apabila sampel latihan set data FFHQ, LSUN CAT dan LSUN CHURCH berbeza dari 1k hingga 10k.

Dalam semua tetapan, FID boleh mencapai peningkatan yang ketara, membuktikan keberkesanan kaedah ini dalam senario data terhad.

Dalam semua tetapan, FID boleh mencapai peningkatan yang ketara, membuktikan keberkesanan kaedah ini dalam senario data terhad.

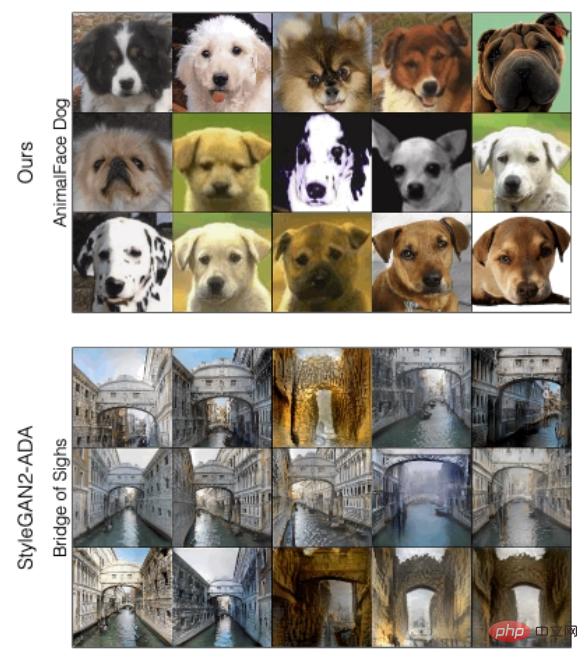

Untuk menganalisis secara kualitatif perbezaan antara kaedah ini dan StyleGAN2-ADA, mengikut kualiti sampel yang dihasilkan oleh kedua-dua kaedah, kaedah baharu yang dicadangkan dalam artikel boleh meningkatkan kualiti sampel terburuk, terutamanya untuk FFHQ dan LSUN CAT

Apabila kita menambah secara beransur-ansur diskriminator seterusnya, kita dapat melihat bahawa ketepatan pengesanan linear pada ciri model pra-latihan adalah secara beransur-ansur berkurangan, iaitu, Penjana lebih kuat.

Apabila kita menambah secara beransur-ansur diskriminator seterusnya, kita dapat melihat bahawa ketepatan pengesanan linear pada ciri model pra-latihan adalah secara beransur-ansur berkurangan, iaitu, Penjana lebih kuat.

Secara keseluruhan, dengan hanya 10,000 sampel latihan, kaedah ini menunjukkan prestasi yang lebih baik pada FID pada LSUN CAT berbanding latihan pada 1.6 juta imej Prestasi StyleGAN2 adalah serupa.

Secara keseluruhan, dengan hanya 10,000 sampel latihan, kaedah ini menunjukkan prestasi yang lebih baik pada FID pada LSUN CAT berbanding latihan pada 1.6 juta imej Prestasi StyleGAN2 adalah serupa.

Pada set data penuh, kaedah ini meningkatkan FID sebanyak 1.5 hingga 2 kali ganda pada kategori kucing, gereja dan kuda LSUN.

Pada set data penuh, kaedah ini meningkatkan FID sebanyak 1.5 hingga 2 kali ganda pada kategori kucing, gereja dan kuda LSUN.

Pengarang Richard Zhang menerima PhD dari University of California, Berkeley, dan ijazah sarjana muda dan sarjananya dari Cornell University. Minat penyelidikan utama termasuk penglihatan komputer, pembelajaran mesin, pembelajaran mendalam, grafik dan pemprosesan imej, sering bekerja dengan penyelidik akademik melalui latihan atau universiti.

Pengarang Jun-Yan Zhu ialah penolong profesor di Sekolah Robotik, Sekolah Sains Komputer, Universiti Carnegie Mellon, dan berkhidmat di Jabatan Komputer Sains dan Jabatan Pembelajaran Mesin ,Bidang penyelidikan utama termasuk penglihatan komputer, grafik komputer, pembelajaran mesin dan fotografi pengiraan.

Pengarang Jun-Yan Zhu ialah penolong profesor di Sekolah Robotik, Sekolah Sains Komputer, Universiti Carnegie Mellon, dan berkhidmat di Jabatan Komputer Sains dan Jabatan Pembelajaran Mesin ,Bidang penyelidikan utama termasuk penglihatan komputer, grafik komputer, pembelajaran mesin dan fotografi pengiraan.

Sebelum menyertai CMU, beliau adalah seorang saintis penyelidikan di Adobe Research. Beliau lulus dari Universiti Tsinghua dengan ijazah sarjana muda dan Ph.D dari University of California, Berkeley, dan kemudian bekerja sebagai felo pasca doktoral di MIT CSAIL.

Atas ialah kandungan terperinci CMU bergabung tenaga dengan Adobe: Model GAN menyambut era pra-latihan, hanya memerlukan 1% sampel latihan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1377

1377

52

52

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Bayangkan model kecerdasan buatan yang bukan sahaja mempunyai keupayaan untuk mengatasi pengkomputeran tradisional, tetapi juga mencapai prestasi yang lebih cekap pada kos yang lebih rendah. Ini bukan fiksyen sains, DeepSeek-V2[1], model MoE sumber terbuka paling berkuasa di dunia ada di sini. DeepSeek-V2 ialah gabungan model bahasa pakar (MoE) yang berkuasa dengan ciri-ciri latihan ekonomi dan inferens yang cekap. Ia terdiri daripada 236B parameter, 21B daripadanya digunakan untuk mengaktifkan setiap penanda. Berbanding dengan DeepSeek67B, DeepSeek-V2 mempunyai prestasi yang lebih kukuh, sambil menjimatkan 42.5% kos latihan, mengurangkan cache KV sebanyak 93.3% dan meningkatkan daya pemprosesan penjanaan maksimum kepada 5.76 kali. DeepSeek ialah sebuah syarikat yang meneroka kecerdasan buatan am

Apr 09, 2024 am 11:52 AM

Apr 09, 2024 am 11:52 AM

AI memang mengubah matematik. Baru-baru ini, Tao Zhexuan, yang telah mengambil perhatian terhadap isu ini, telah memajukan keluaran terbaru "Buletin Persatuan Matematik Amerika" (Buletin Persatuan Matematik Amerika). Memfokuskan pada topik "Adakah mesin akan mengubah matematik?", ramai ahli matematik menyatakan pendapat mereka Seluruh proses itu penuh dengan percikan api, tegar dan menarik. Penulis mempunyai barisan yang kuat, termasuk pemenang Fields Medal Akshay Venkatesh, ahli matematik China Zheng Lejun, saintis komputer NYU Ernest Davis dan ramai lagi sarjana terkenal dalam industri. Dunia AI telah berubah secara mendadak Anda tahu, banyak artikel ini telah dihantar setahun yang lalu.

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas secara rasmi memasuki era robot elektrik! Semalam, Atlas hidraulik hanya "menangis" menarik diri daripada peringkat sejarah Hari ini, Boston Dynamics mengumumkan bahawa Atlas elektrik sedang berfungsi. Nampaknya dalam bidang robot humanoid komersial, Boston Dynamics berazam untuk bersaing dengan Tesla. Selepas video baharu itu dikeluarkan, ia telah pun ditonton oleh lebih sejuta orang dalam masa sepuluh jam sahaja. Orang lama pergi dan peranan baru muncul. Ini adalah keperluan sejarah. Tidak dinafikan bahawa tahun ini adalah tahun letupan robot humanoid. Netizen mengulas: Kemajuan robot telah menjadikan majlis pembukaan tahun ini kelihatan seperti manusia, dan tahap kebebasan adalah jauh lebih besar daripada manusia Tetapi adakah ini benar-benar bukan filem seram? Pada permulaan video, Atlas berbaring dengan tenang di atas tanah, seolah-olah terlentang. Apa yang berikut adalah rahang-jatuh

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

Awal bulan ini, penyelidik dari MIT dan institusi lain mencadangkan alternatif yang sangat menjanjikan kepada MLP - KAN. KAN mengatasi MLP dari segi ketepatan dan kebolehtafsiran. Dan ia boleh mengatasi prestasi MLP berjalan dengan bilangan parameter yang lebih besar dengan bilangan parameter yang sangat kecil. Sebagai contoh, penulis menyatakan bahawa mereka menggunakan KAN untuk menghasilkan semula keputusan DeepMind dengan rangkaian yang lebih kecil dan tahap automasi yang lebih tinggi. Khususnya, MLP DeepMind mempunyai kira-kira 300,000 parameter, manakala KAN hanya mempunyai kira-kira 200 parameter. KAN mempunyai asas matematik yang kukuh seperti MLP berdasarkan teorem penghampiran universal, manakala KAN berdasarkan teorem perwakilan Kolmogorov-Arnold. Seperti yang ditunjukkan dalam rajah di bawah, KAN telah

Versi Kuaishou Sora 'Ke Ling' dibuka untuk ujian: menghasilkan video lebih 120-an, memahami fizik dengan lebih baik dan boleh memodelkan pergerakan kompleks dengan tepat

Jun 11, 2024 am 09:51 AM

Versi Kuaishou Sora 'Ke Ling' dibuka untuk ujian: menghasilkan video lebih 120-an, memahami fizik dengan lebih baik dan boleh memodelkan pergerakan kompleks dengan tepat

Jun 11, 2024 am 09:51 AM

Apa? Adakah Zootopia dibawa menjadi realiti oleh AI domestik? Didedahkan bersama-sama dengan video itu ialah model penjanaan video domestik berskala besar baharu yang dipanggil "Keling". Sora menggunakan laluan teknikal yang serupa dan menggabungkan beberapa inovasi teknologi yang dibangunkan sendiri untuk menghasilkan video yang bukan sahaja mempunyai pergerakan yang besar dan munasabah, tetapi juga mensimulasikan ciri-ciri dunia fizikal dan mempunyai keupayaan gabungan konsep dan imaginasi yang kuat. Mengikut data, Keling menyokong penjanaan video ultra panjang sehingga 2 minit pada 30fps, dengan resolusi sehingga 1080p dan menyokong berbilang nisbah aspek. Satu lagi perkara penting ialah Keling bukanlah demo atau demonstrasi hasil video yang dikeluarkan oleh makmal, tetapi aplikasi peringkat produk yang dilancarkan oleh Kuaishou, pemain terkemuka dalam bidang video pendek. Selain itu, tumpuan utama adalah untuk menjadi pragmatik, bukan untuk menulis cek kosong, dan pergi ke dalam talian sebaik sahaja ia dikeluarkan Model besar Ke Ling telah pun dikeluarkan di Kuaiying.

Daya hidup kecerdasan super membangkitkan! Tetapi dengan kedatangan AI yang mengemas kini sendiri, ibu tidak perlu lagi bimbang tentang kesesakan data

Apr 29, 2024 pm 06:55 PM

Daya hidup kecerdasan super membangkitkan! Tetapi dengan kedatangan AI yang mengemas kini sendiri, ibu tidak perlu lagi bimbang tentang kesesakan data

Apr 29, 2024 pm 06:55 PM

Saya menangis hingga mati. Dunia sedang membina model besar. Data di Internet tidak mencukupi. Model latihan kelihatan seperti "The Hunger Games", dan penyelidik AI di seluruh dunia bimbang tentang cara memberi makan data ini kepada pemakan yang rakus. Masalah ini amat ketara dalam tugas berbilang modal. Pada masa mereka mengalami kerugian, pasukan pemula dari Jabatan Universiti Renmin China menggunakan model baharu mereka sendiri untuk menjadi yang pertama di China untuk menjadikan "suapan data yang dijana model itu sendiri" menjadi kenyataan. Selain itu, ia merupakan pendekatan serampang dua mata dari segi pemahaman dan sisi penjanaan Kedua-dua pihak boleh menjana data baharu berbilang modal yang berkualiti tinggi dan memberikan maklum balas data kepada model itu sendiri. Apakah model? Awaker 1.0, model berbilang modal besar yang baru sahaja muncul di Forum Zhongguancun. Siapa pasukan itu? Enjin Sophon. Diasaskan oleh Gao Yizhao, pelajar kedoktoran di Sekolah Kecerdasan Buatan Hillhouse Universiti Renmin.

Tentera Udara A.S. mempamerkan jet pejuang AI pertamanya dengan profil tinggi! Menteri secara peribadi menjalankan pandu uji tanpa campur tangan semasa keseluruhan proses, dan 100,000 baris kod telah diuji selama 21 kali.

May 07, 2024 pm 05:00 PM

Tentera Udara A.S. mempamerkan jet pejuang AI pertamanya dengan profil tinggi! Menteri secara peribadi menjalankan pandu uji tanpa campur tangan semasa keseluruhan proses, dan 100,000 baris kod telah diuji selama 21 kali.

May 07, 2024 pm 05:00 PM

Baru-baru ini, bulatan tentera telah terharu dengan berita: jet pejuang tentera AS kini boleh melengkapkan pertempuran udara automatik sepenuhnya menggunakan AI. Ya, baru-baru ini, jet pejuang AI tentera AS telah didedahkan buat pertama kali, mendedahkan misterinya. Nama penuh pesawat pejuang ini ialah Variable Stability Simulator Test Aircraft (VISTA). Ia diterbangkan sendiri oleh Setiausaha Tentera Udara AS untuk mensimulasikan pertempuran udara satu lawan satu. Pada 2 Mei, Setiausaha Tentera Udara A.S. Frank Kendall berlepas menggunakan X-62AVISTA di Pangkalan Tentera Udara Edwards Ambil perhatian bahawa semasa penerbangan selama satu jam, semua tindakan penerbangan telah diselesaikan secara autonomi oleh AI! Kendall berkata - "Sejak beberapa dekad yang lalu, kami telah memikirkan tentang potensi tanpa had pertempuran udara-ke-udara autonomi, tetapi ia sentiasa kelihatan di luar jangkauan." Namun kini,

FisheyeDetNet: algoritma pengesanan sasaran pertama berdasarkan kamera fisheye

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: algoritma pengesanan sasaran pertama berdasarkan kamera fisheye

Apr 26, 2024 am 11:37 AM

Pengesanan objek ialah masalah yang agak matang dalam sistem pemanduan autonomi, antaranya pengesanan pejalan kaki adalah salah satu algoritma terawal untuk digunakan. Penyelidikan yang sangat komprehensif telah dijalankan dalam kebanyakan kertas kerja. Walau bagaimanapun, persepsi jarak menggunakan kamera fisheye untuk pandangan sekeliling agak kurang dikaji. Disebabkan herotan jejari yang besar, perwakilan kotak sempadan standard sukar dilaksanakan dalam kamera fisheye. Untuk mengurangkan perihalan di atas, kami meneroka kotak sempadan lanjutan, elips dan reka bentuk poligon am ke dalam perwakilan kutub/sudut dan mentakrifkan metrik mIOU pembahagian contoh untuk menganalisis perwakilan ini. Model fisheyeDetNet yang dicadangkan dengan bentuk poligon mengatasi model lain dan pada masa yang sama mencapai 49.5% mAP pada set data kamera fisheye Valeo untuk pemanduan autonomi