Peranti teknologi

Peranti teknologi

AI

AI

Selesaikan sepenuhnya ChatGPT amnesia! Menembusi had input Transformer: diukur untuk menyokong 2 juta token yang sah

Selesaikan sepenuhnya ChatGPT amnesia! Menembusi had input Transformer: diukur untuk menyokong 2 juta token yang sah

Selesaikan sepenuhnya ChatGPT amnesia! Menembusi had input Transformer: diukur untuk menyokong 2 juta token yang sah

ChatGPT, atau model kelas Transformer, mempunyai kecacatan yang membawa maut, iaitu ia terlalu mudah untuk dilupakan Apabila token jujukan input melebihi ambang tetingkap konteks, kandungan output seterusnya tidak akan sepadan dengan logik sebelumnya.

ChatGPT hanya boleh menyokong input 4000 token (kira-kira 3000 perkataan walaupun GPT-4 yang baru dikeluarkan hanya menyokong tetingkap token maksimum 32000. Jika panjang jujukan input terus ditingkatkan, kerumitan pengiraan). juga akan meningkat secara kuadratik.

Baru-baru ini, penyelidik dari DeepPavlov, AIRI, dan London Institute of Mathematical Sciences mengeluarkan laporan teknikal menggunakan Recurrent Memory Transformer (RMT) untuk meningkatkan panjang konteks berkesan BERT kepada "2 juta token yang belum pernah berlaku sebelum ini." ketepatan perolehan ingatan yang tinggi.

Pautan kertas: https://www.php.cn/link/459ad054a6417248a1166b30f6393301

Kaedah ini boleh menyimpan dan memproses maklumat tempatan dan global, serta menggunakan gelung untuk membenarkan maklumat disimpan dalam setiap sebahagian daripada aliran masukan antara segmen.

Bahagian eksperimen menunjukkan keberkesanan pendekatan ini, yang mempunyai potensi luar biasa untuk meningkatkan pemprosesan pergantungan jangka panjang dalam pemahaman bahasa semula jadi dan tugas penjanaan, membolehkan pemprosesan konteks berskala besar untuk aplikasi intensif memori.

Walau bagaimanapun, tiada makan tengah hari percuma di dunia Walaupun RMT tidak meningkatkan penggunaan memori dan boleh dilanjutkan kepada panjang jujukan yang hampir tidak terhad, masih terdapat masalah pereputan ingatan dalam RNN dan masa inferens yang lebih lama diperlukan. .

Tetapi sesetengah netizen telah mencadangkan penyelesaian, RMT digunakan untuk ingatan jangka panjang, konteks besar digunakan untuk ingatan jangka pendek, dan kemudian latihan model dilakukan pada waktu malam. /semasa penyelenggaraan.

Recurrent Memory Transformer

Pada tahun 2022, pasukan mencadangkan model Recurrent Memory Transformer (RMT), dengan menambahkan token memori khas pada urutan input atau output, dan kemudian melatih model untuk mengawal Operasi memori dan pemprosesan perwakilan jujukan boleh melaksanakan mekanisme ingatan baharu tanpa mengubah model Transformer asal.

Pautan kertas: https://arxiv.org/abs/2207.06881

Persidangan penerbitan: NeurIPS 2022

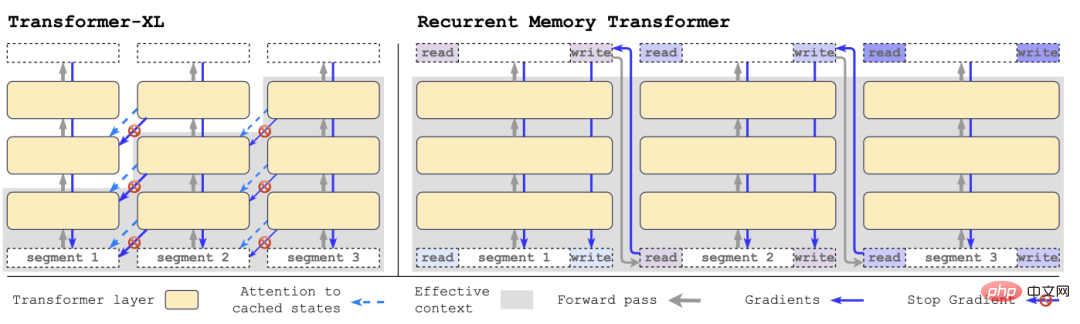

Dengan Transformer-XL Sebagai perbandingan, RMT memerlukan kurang memori dan boleh mengendalikan urutan tugasan yang lebih panjang.

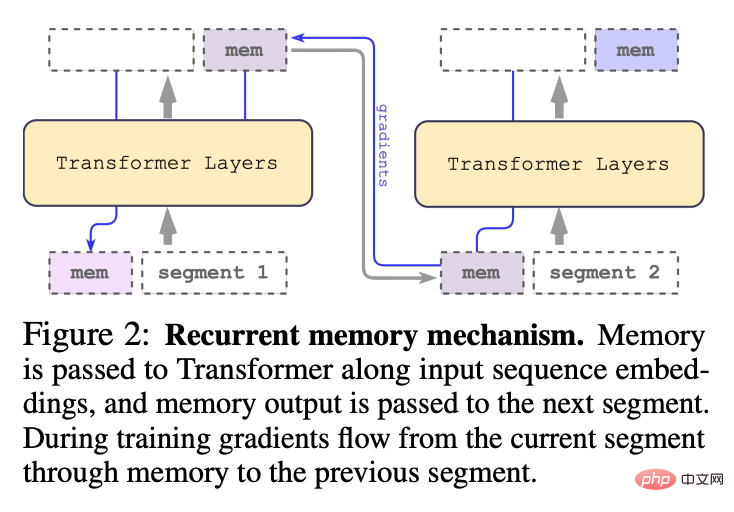

Secara khusus, RMT terdiri daripada m vektor boleh dilatih bernilai sebenar Urutan input yang terlalu panjang dibahagikan kepada beberapa segmen, dan vektor memori dipratetap kepada yang pertama pembenaman segmen dan diproses bersama-sama dengan token segmen.

Berbeza daripada model RMT asal yang dicadangkan pada tahun 2022, untuk model pengekod tulen seperti BERT, memori hanya ditambah sekali pada permulaan model penyahkodan; Ingatan terbahagi kepada dua bahagian: membaca dan menulis.

Dalam setiap langkah dan segmen masa, gelung seperti berikut, dengan N ialah bilangan lapisan Transformer, t ialah langkah masa, dan H ialah segmen

Selepas memproses segmen jujukan input mengikut tertib, untuk mencapai sambungan rekursif, penyelidik menghantar output token memori segmen semasa kepada input segmen seterusnya:

Memori dan gelung dalam RMT hanya berdasarkan token memori global, yang boleh mengekalkan model Transformer tulang belakang tidak berubah, menjadikan keupayaan peningkatan memori RMT serasi dengan mana-mana model Transformer.

Kecekapan pengiraan

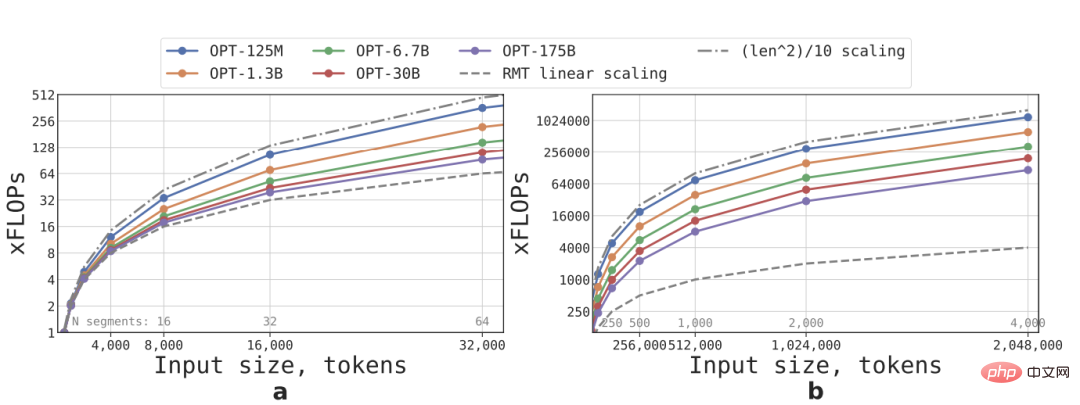

Mengikut formula, FLOP yang diperlukan untuk model RMT dan Transformer dengan saiz dan panjang jujukan yang berbeza boleh dianggarkan

Dari segi saiz perbendaharaan kata, bilangan lapisan, saiz tersembunyi, perantaraan Mengenai konfigurasi parameter saiz tersembunyi dan bilangan kepala perhatian, penyelidik mengikuti konfigurasi model OPT dan mengira bilangan FLOP selepas hantaran hadapan, dengan mengambil kira kesan kitaran RMT.

Peluasan linear dicapai dengan membahagikan jujukan input kepada beberapa segmen dan mengira keseluruhan matriks perhatian hanya dalam sempadan segmen tersebut panjang Tetap, kelajuan inferens RMT meningkat secara linear untuk sebarang saiz model.

Disebabkan jumlah pengiraan lapisan FFN yang banyak, model Transformer yang lebih besar cenderung menunjukkan kadar pertumbuhan kuadratik yang lebih perlahan berbanding dengan panjang jujukan Walau bagaimanapun, pada jujukan yang sangat panjang dengan panjang lebih daripada 32,000, FLOP kembali kepada kuadratik. keadaan pertumbuhan.

Untuk jujukan dengan lebih daripada satu segmen (lebih besar daripada 512 dalam kajian ini), RMT mempunyai FLOP yang lebih rendah daripada model asiklik, dan boleh meningkatkan kecekapan FLOP sehingga ×295 kali pada model yang lebih kecil model seperti OPT-175B, ia boleh ditingkatkan sebanyak ×29 kali.

Tugas Ingatan

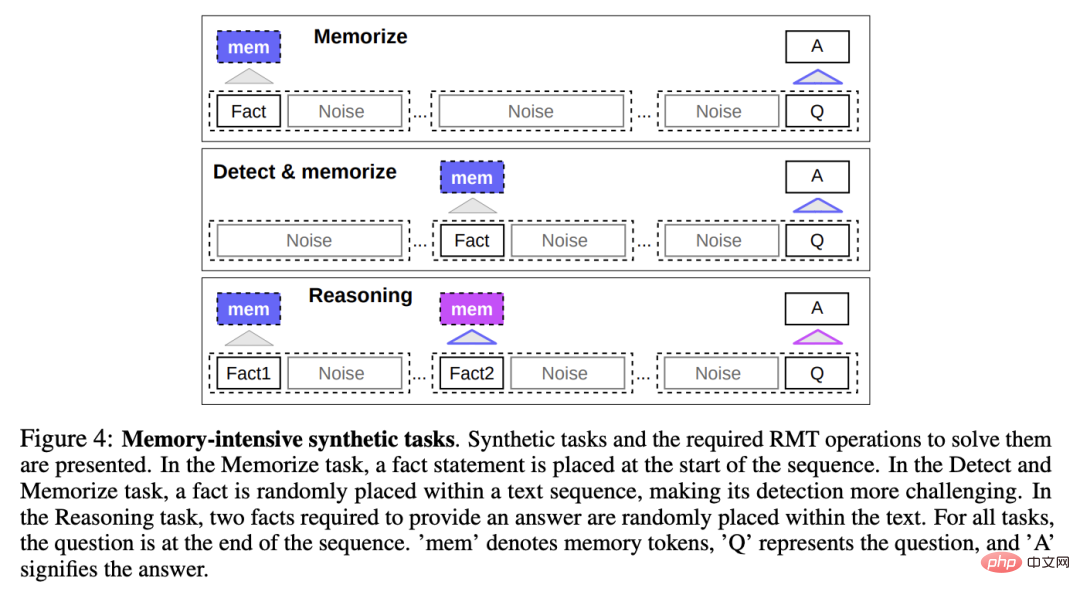

Untuk menguji kebolehan ingatan, penyelidik membina set data sintetik yang memerlukan model untuk menghafal fakta mudah dan penaakulan asas.

Input tugasan terdiri daripada satu atau beberapa fakta dan soalan yang hanya boleh dijawab dengan semua fakta ini.

Untuk meningkatkan kesukaran tugasan, teks bahasa semula jadi yang tidak berkaitan dengan soalan atau jawapan juga ditambah pada tugasan ini boleh dianggap sebagai bunyi bising, jadi tugas model sebenarnya adalah untuk asingkan fakta daripada teks yang tidak berkaitan dan gunakan teks fakta untuk menjawab soalan.

Memori Fakta

Uji penulisan RMT dan simpan maklumat dalam ingatan untuk jangka masa yang lama Kuasa masa: Dalam kes yang paling mudah, fakta berada pada permulaan input, soalan berada di penghujung input, dan secara beransur-ansur meningkatkan jumlah teks yang tidak berkaitan antara soalan dan jawapan sehingga model tidak dapat menerima semua input sekaligus .

Pengesanan fakta dan ingatan

Pengesanan fakta meningkatkan kesukaran tugasan dengan mengalihkan fakta ke kedudukan rawak dalam input, memerlukan The model mula-mula mengasingkan fakta daripada teks yang tidak berkaitan, menulisnya ke dalam ingatan, dan kemudian menjawab soalan di penghujung.

Penaakulan berdasarkan fakta yang dihafal

Satu lagi operasi ingatan yang penting ialah menggunakan fakta yang dihafal dan konteks semasa untuk menaakul.

Untuk menilai ciri ini, penyelidik memperkenalkan tugas yang lebih kompleks di mana dua fakta dijana dan diletakkan secara rawak dalam urutan input, soalan yang ditanya pada akhir urutan mesti dipilih untuk menjawab soalan dengan fakta yang betul.

Hasil eksperimen

Para penyelidik menggunakan model bersarung Bert yang telah terlatih dalam HuggingFace Transformers sebagai tulang belakang RMT dalam semua eksperimen, dan semua model adalah berdasarkan memori Dipertingkatkan dengan saiz 10.

Latih dan nilai pada 4-8 GPU NVIDIA 1080Ti untuk urutan yang lebih panjang, tukar kepada satu NVIDIA A100 40GB untuk penilaian dipercepatkan.

Pembelajaran Kurikulum

Penyelidik mendapati bahawa menggunakan penjadualan latihan boleh meningkatkan ketepatan dan kestabilan penyelesaian dengan ketara.

Mula-mula biarkan RMT melatih versi tugasan yang lebih pendek Selepas latihan bertumpu, tambah panjang tugasan dengan menambah segmen dan teruskan proses pembelajaran kursus sehingga panjang input yang ideal dicapai.

Mulakan percubaan dengan urutan yang sesuai dengan satu segmen Saiz segmen sebenar ialah 499 kerana 3 token khas BERT dan 10 ruang letak memori dikekalkan daripada input model, memberikan jumlah saiz 512.

Dapat diperhatikan bahawa selepas latihan mengenai tugasan yang lebih pendek, RMT lebih mudah untuk menyelesaikan tugasan yang lebih panjang kerana ia menumpu kepada penyelesaian yang sempurna menggunakan langkah latihan yang lebih sedikit.

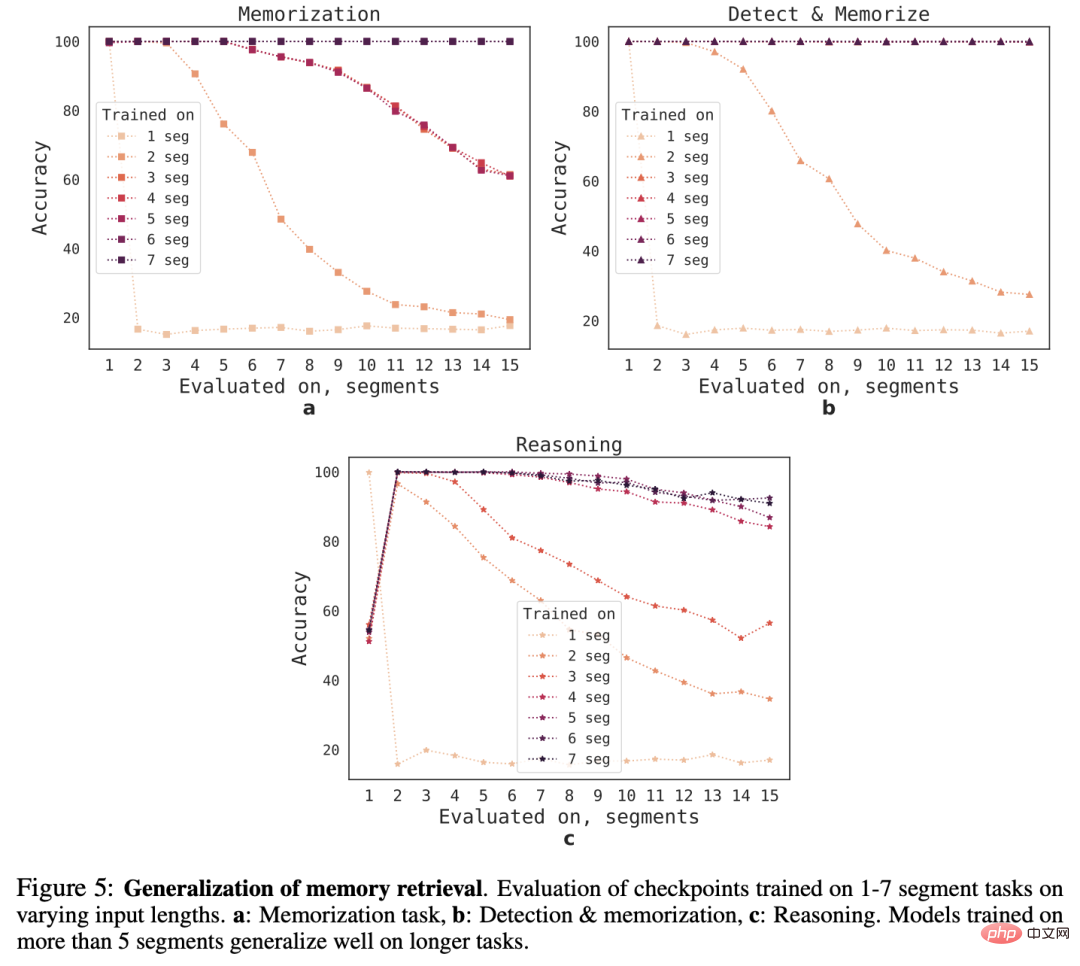

Keupayaan Ekstrapolasi

Untuk memerhatikan keupayaan generalisasi RMT kepada panjang jujukan yang berbeza, para penyelidik menilai model yang dilatih pada bilangan segmen yang berbeza, untuk menyelesaikan tugasan yang lebih besar. panjang.

Dapat diperhatikan bahawa model sering berprestasi baik pada tugasan yang lebih pendek, tetapi selepas melatih model pada urutan yang lebih panjang, ia menjadi sukar untuk mengendalikan tugasan inferens segmen tunggal.

Penjelasan yang mungkin adalah kerana saiz tugasan melebihi satu segmen, model berhenti menjangka masalah dalam segmen pertama, mengakibatkan penurunan kualiti.

Menariknya, apabila bilangan segmen latihan meningkat, keupayaan generalisasi RMT kepada urutan yang lebih panjang juga muncul Selepas latihan pada 5 atau lebih segmen, RMT boleh melakukan latihan pada urutan dua kali lebih panjang tugasan.

Untuk menguji had generalisasi, penyelidik meningkatkan saiz tugas pengesahan kepada 4096 segmen (iaitu 2,043,904 token).

RMT mengekalkan dengan baik pada jujukan yang begitu panjang, yang mana tugas "pengesan dan ingatan" adalah yang paling mudah dan tugas inferens adalah yang paling kompleks.

Rujukan: https://www.php.cn/link/459ad054a6417248a1166b30f6393301

Atas ialah kandungan terperinci Selesaikan sepenuhnya ChatGPT amnesia! Menembusi had input Transformer: diukur untuk menyokong 2 juta token yang sah. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1377

1377

52

52

ChatGPT kini membenarkan pengguna percuma menjana imej dengan menggunakan DALL-E 3 dengan had harian

Aug 09, 2024 pm 09:37 PM

ChatGPT kini membenarkan pengguna percuma menjana imej dengan menggunakan DALL-E 3 dengan had harian

Aug 09, 2024 pm 09:37 PM

DALL-E 3 telah diperkenalkan secara rasmi pada September 2023 sebagai model yang jauh lebih baik daripada pendahulunya. Ia dianggap sebagai salah satu penjana imej AI terbaik setakat ini, mampu mencipta imej dengan perincian yang rumit. Walau bagaimanapun, semasa pelancaran, ia adalah tidak termasuk

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Bayangkan model kecerdasan buatan yang bukan sahaja mempunyai keupayaan untuk mengatasi pengkomputeran tradisional, tetapi juga mencapai prestasi yang lebih cekap pada kos yang lebih rendah. Ini bukan fiksyen sains, DeepSeek-V2[1], model MoE sumber terbuka paling berkuasa di dunia ada di sini. DeepSeek-V2 ialah gabungan model bahasa pakar (MoE) yang berkuasa dengan ciri-ciri latihan ekonomi dan inferens yang cekap. Ia terdiri daripada 236B parameter, 21B daripadanya digunakan untuk mengaktifkan setiap penanda. Berbanding dengan DeepSeek67B, DeepSeek-V2 mempunyai prestasi yang lebih kukuh, sambil menjimatkan 42.5% kos latihan, mengurangkan cache KV sebanyak 93.3% dan meningkatkan daya pemprosesan penjanaan maksimum kepada 5.76 kali. DeepSeek ialah sebuah syarikat yang meneroka kecerdasan buatan am

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas secara rasmi memasuki era robot elektrik! Semalam, Atlas hidraulik hanya "menangis" menarik diri daripada peringkat sejarah Hari ini, Boston Dynamics mengumumkan bahawa Atlas elektrik sedang berfungsi. Nampaknya dalam bidang robot humanoid komersial, Boston Dynamics berazam untuk bersaing dengan Tesla. Selepas video baharu itu dikeluarkan, ia telah pun ditonton oleh lebih sejuta orang dalam masa sepuluh jam sahaja. Orang lama pergi dan peranan baru muncul. Ini adalah keperluan sejarah. Tidak dinafikan bahawa tahun ini adalah tahun letupan robot humanoid. Netizen mengulas: Kemajuan robot telah menjadikan majlis pembukaan tahun ini kelihatan seperti manusia, dan tahap kebebasan adalah jauh lebih besar daripada manusia Tetapi adakah ini benar-benar bukan filem seram? Pada permulaan video, Atlas berbaring dengan tenang di atas tanah, seolah-olah terlentang. Apa yang berikut adalah rahang-jatuh

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

Awal bulan ini, penyelidik dari MIT dan institusi lain mencadangkan alternatif yang sangat menjanjikan kepada MLP - KAN. KAN mengatasi MLP dari segi ketepatan dan kebolehtafsiran. Dan ia boleh mengatasi prestasi MLP berjalan dengan bilangan parameter yang lebih besar dengan bilangan parameter yang sangat kecil. Sebagai contoh, penulis menyatakan bahawa mereka menggunakan KAN untuk menghasilkan semula keputusan DeepMind dengan rangkaian yang lebih kecil dan tahap automasi yang lebih tinggi. Khususnya, MLP DeepMind mempunyai kira-kira 300,000 parameter, manakala KAN hanya mempunyai kira-kira 200 parameter. KAN mempunyai asas matematik yang kukuh seperti MLP berdasarkan teorem penghampiran universal, manakala KAN berdasarkan teorem perwakilan Kolmogorov-Arnold. Seperti yang ditunjukkan dalam rajah di bawah, KAN telah

Robot Tesla bekerja di kilang, Musk: Tahap kebebasan tangan akan mencapai 22 tahun ini!

May 06, 2024 pm 04:13 PM

Robot Tesla bekerja di kilang, Musk: Tahap kebebasan tangan akan mencapai 22 tahun ini!

May 06, 2024 pm 04:13 PM

Video terbaru robot Tesla Optimus dikeluarkan, dan ia sudah boleh berfungsi di kilang. Pada kelajuan biasa, ia mengisih bateri (bateri 4680 Tesla) seperti ini: Pegawai itu juga mengeluarkan rupanya pada kelajuan 20x - pada "stesen kerja" kecil, memilih dan memilih dan memilih: Kali ini ia dikeluarkan Salah satu sorotan video itu ialah Optimus menyelesaikan kerja ini di kilang, sepenuhnya secara autonomi, tanpa campur tangan manusia sepanjang proses. Dan dari perspektif Optimus, ia juga boleh mengambil dan meletakkan bateri yang bengkok, memfokuskan pada pembetulan ralat automatik: Berkenaan tangan Optimus, saintis NVIDIA Jim Fan memberikan penilaian yang tinggi: Tangan Optimus adalah robot lima jari di dunia paling cerdik. Tangannya bukan sahaja boleh disentuh

FisheyeDetNet: algoritma pengesanan sasaran pertama berdasarkan kamera fisheye

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: algoritma pengesanan sasaran pertama berdasarkan kamera fisheye

Apr 26, 2024 am 11:37 AM

Pengesanan objek ialah masalah yang agak matang dalam sistem pemanduan autonomi, antaranya pengesanan pejalan kaki adalah salah satu algoritma terawal untuk digunakan. Penyelidikan yang sangat komprehensif telah dijalankan dalam kebanyakan kertas kerja. Walau bagaimanapun, persepsi jarak menggunakan kamera fisheye untuk pandangan sekeliling agak kurang dikaji. Disebabkan herotan jejari yang besar, perwakilan kotak sempadan standard sukar dilaksanakan dalam kamera fisheye. Untuk mengurangkan perihalan di atas, kami meneroka kotak sempadan lanjutan, elips dan reka bentuk poligon am ke dalam perwakilan kutub/sudut dan mentakrifkan metrik mIOU pembahagian contoh untuk menganalisis perwakilan ini. Model fisheyeDetNet yang dicadangkan dengan bentuk poligon mengatasi model lain dan pada masa yang sama mencapai 49.5% mAP pada set data kamera fisheye Valeo untuk pemanduan autonomi

Satu kad menjalankan Llama 70B lebih pantas daripada dua kad, Microsoft hanya meletakkan FP6 ke dalam A100 |

Apr 29, 2024 pm 04:55 PM

Satu kad menjalankan Llama 70B lebih pantas daripada dua kad, Microsoft hanya meletakkan FP6 ke dalam A100 |

Apr 29, 2024 pm 04:55 PM

FP8 dan ketepatan pengiraan titik terapung yang lebih rendah bukan lagi "paten" H100! Lao Huang mahu semua orang menggunakan INT8/INT4, dan pasukan Microsoft DeepSpeed memaksa diri mereka menjalankan FP6 pada A100 tanpa sokongan rasmi daripada Nvidia. Keputusan ujian menunjukkan bahawa kaedah baharu TC-FPx FP6 kuantisasi pada A100 adalah hampir atau kadangkala lebih pantas daripada INT4, dan mempunyai ketepatan yang lebih tinggi daripada yang terakhir. Selain itu, terdapat juga sokongan model besar hujung ke hujung, yang telah bersumberkan terbuka dan disepadukan ke dalam rangka kerja inferens pembelajaran mendalam seperti DeepSpeed. Keputusan ini juga mempunyai kesan serta-merta pada mempercepatkan model besar - di bawah rangka kerja ini, menggunakan satu kad untuk menjalankan Llama, daya pemprosesan adalah 2.65 kali lebih tinggi daripada dua kad. satu

Yang terbaru dari Universiti Oxford! Mickey: Padanan imej 2D dalam SOTA 3D! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

Yang terbaru dari Universiti Oxford! Mickey: Padanan imej 2D dalam SOTA 3D! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

Pautan projek ditulis di hadapan: https://nianticlabs.github.io/mickey/ Memandangkan dua gambar, pose kamera di antara mereka boleh dianggarkan dengan mewujudkan kesesuaian antara gambar. Biasanya, surat-menyurat ini adalah 2D hingga 2D, dan anggaran pose kami adalah skala-tak tentu. Sesetengah aplikasi, seperti realiti tambahan segera pada bila-bila masa, di mana-mana sahaja, memerlukan anggaran pose metrik skala, jadi mereka bergantung pada penganggar kedalaman luaran untuk memulihkan skala. Makalah ini mencadangkan MicKey, proses pemadanan titik utama yang mampu meramalkan korespondensi metrik dalam ruang kamera 3D. Dengan mempelajari padanan koordinat 3D merentas imej, kami dapat membuat kesimpulan relatif metrik