Perkembangan pesat AI dalam sepuluh tahun yang lalu telah mendapat manfaat daripada kerjasama universiti, perusahaan dan pembangun individu, yang telah menjadikan kod sumber terbuka, data dan tutorial di mana-mana dalam bidang kecerdasan buatan.

Google juga telah menjadi peneraju dalam industri AI, menerbitkan kertas kerja merentasi pemprosesan bahasa semula jadi, penglihatan komputer, pembelajaran pengukuhan dan bidang lain serta menyumbang kepada industri seperti Transformer, Bert, PaLM dan banyak lagi model dan seni bina asas .

Tetapi OpenAI melanggar peraturan permainan bukan sahaja membangunkan ChatGPT dengan Transformer, ia juga bergantung pada kelebihan syarikat permulaan, seperti. kerana dilindungi oleh undang-undang dan pendapat umum Impaknya kurang , tidak perlu mendedahkan data latihan, saiz model, seni bina dan maklumat lain, malah <.>memburu ramai pekerja dari syarikat besar seperti Google, Google semakin kehilangan tempat.

Menghadapi kekurangan etika mempertahankan diri OpenAI, Google hanya boleh dikalahkan secara pasif.

Menurut maklumat yang diberikan oleh sumber tanpa nama, pada Februari tahun ini, Ketua AI Google Jeff Dean berkata dalam mesyuarat:

Google akan mengambil kesempatan daripada penemuan AInya sendiri, berkongsi kertas kerja hanya selepas kerja makmal diubah menjadi produk

Google akan mengambil kesempatan daripada pencapaian AInya sendiri, Papers dikongsi hanya selepas keputusan makmal telah diubah menjadi produk.

Google, yang telah bertukar kepada "keadaan defensif", mungkin berharap untuk menyingkirkan semua syarikat AI yang serupa dan melindungi perniagaan carian teras dan harga sahamnya dengan lebih baik.

Tetapi jika AI tidak mempunyai semangat sumber terbuka syarikat besar ini dan beralih kepada monopoli, adakah bidang kecerdasan buatan masih mempunyai keajaiban pembangunan sebelumnya?

Google telah dicuri kerana ia "terlalu bertanggungjawab"Bagi syarikat seperti Google dengan berbilion pengguna, walaupun percubaan berskala kecil mungkin Ia akan menjejaskan berjuta-juta orang ramai dan mengalami tindak balas daripada pendapat umum Inilah sebabnya Google enggan melancarkan chatbots dan berpegang kepada garis bawah "AI yang bertanggungjawab."

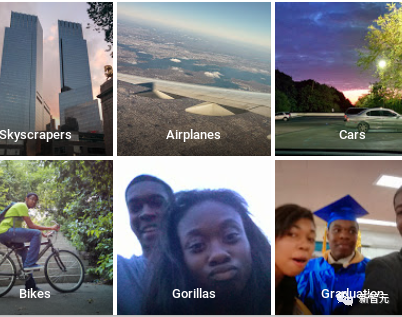

Pada tahun 2015, Google Photos melancarkan fungsi pengelasan imej dan salah mengklasifikasikan seorang lelaki kulit hitam sebagai Gorila (gorila Google serta-merta mengalami krisis perhubungan awam dan segera meminta maaf dan membuat pembetulan).

Langkah pembetulan Google ialah memadamkan terus teg Gorilla, malah memadamkan cimpanzi, monyet dan kategori lain .

Hasilnya ialah pengelas imej tidak lagi mengenali orang kulit hitam sebagai orang utan, tetapi ia tidak akan mengenali orang utan sebenar.

Walaupun Google telah melabur banyak wang dalam membangunkan teknologi kecerdasan buatan selama bertahun-tahun, disebabkan kotak hitam yang tidak dapat dijelaskan oleh rangkaian saraf, Google tidak dapat menjamin sepenuhnya kebolehkawalan selepas pengeluaran , yang memerlukan ujian keselamatan yang lebih lama dan kehilangan kelebihan penggerak pertama.

Pada April tahun ini, Ketua Pegawai Eksekutif Google Sundar Pichai masih menyatakan dengan jelas semasa penyertaannya dalam program "60 Minit" bahawa orang ramai perlu berhati-hati tentang kecerdasan buatan, yang mungkin mempunyai kelebihan kesan kepada masyarakat, seperti imej dan video palsu.

Jika Google memilih untuk menjadi "kurang bertanggungjawab", ia pasti akan menarik perhatian lebih banyak agensi kawal selia, penyelidik kecerdasan buatan dan pemimpin perniagaan.

Tetapi pengasas bersama DeepMind Mustafa Suleyman berkata bahawa ia bukan kerana mereka terlalu berhati-hati, tetapi kerana mereka tidak mahu mengganggu aliran pendapatan dan model perniagaan yang sedia ada Hanya apabila wujud Mereka yang sebenar hanya akan mula sedar apabila terdapat ancaman luar.

Dan ancaman ini telah pun tiba.

Masa semakin suntuk untuk GoogleSejak 2010, Google telah mula memperoleh syarikat permulaan kecerdasan buatan dan secara beransur-ansur menyepadukan teknologi berkaitan ke dalam produknya sendiri.

Pada tahun 2013, Google menjemput Hinton, seorang perintis pembelajaran mendalam dan pemenang Anugerah Turing, untuk menyertai (yang baru meletak jawatan setahun kemudian, Google turut memperoleh DeepMind permulaan pada harga AS$625). juta

Sejurus selepas dilantik sebagai Ketua Pegawai Eksekutif Google, Pichai mengumumkan bahawa Google akan menggunakan "AI dahulu" sebagai strategi asasnya dan menyepadukan teknologi kecerdasan buatan ke dalam semua produknya.

Tahun penanaman intensif juga telah membolehkan pasukan penyelidik kecerdasan buatan Google membuat banyak penemuan, tetapi pada masa yang sama, beberapa syarikat permulaan yang lebih kecil juga telah membuat beberapa pencapaian dalam bidang kecerdasan buatan.

OpenAI pada asalnya ditubuhkan untuk menyemak monopoli pemerolehan syarikat teknologi besar dalam bidang kecerdasan buatan Dengan kelebihan syarikat kecil, OpenAI tertakluk kepada kurang penelitian dan penyeliaan , dan lebih Kesanggupan untuk menyampaikan model kecerdasan buatan dengan cepat ke tangan pengguna biasa.

Jadi perlumbaan senjata kecerdasan buatan semakin giat tanpa pengawasan Dalam menghadapi persaingan, "tanggungjawab" perusahaan besar mungkin beransur-ansur lemah.

Para eksekutif Google juga perlu memilih prospek konsep kecerdasan buatan umum seperti "padanan teknologi kecerdasan buatan" dan "kecerdasan superhuman" yang disokong oleh DeepMind.

Pada 21 April tahun ini, Pichai mengumumkan penggabungan Google Brain, yang asalnya dikendalikan oleh Jeff Dean, dan DeepMind yang diperoleh sebelum ini, dan meletakkannya bertanggungjawab ke atas pengasas bersama dan Ketua Pegawai Eksekutif DeepMind Demis Hassabis untuk mempercepatkan kemajuan Google dalam bidang kecerdasan buatan.

Hassabis percaya bahawa dalam masa beberapa tahun, tahap kecerdasan buatan mungkin lebih hampir kepada tahap kecerdasan manusia daripada yang diramalkan kebanyakan pakar.

Menurut temu bual yang dijalankan oleh media asing dengan 11 pekerja Google semasa dan bekas, Google telah membuat perubahan pada perniagaan kecerdasan buatannya baru-baru ini Menjalankan baik pulih, matlamat utama adalah untuk melancarkan produk dengan cepat, menurunkan ambang untuk melancarkan alat AI percubaan kepada kumpulan pengguna kecil, dan membangunkan satu set metrik dan keutamaan penilaian baharu dalam bidang seperti keadilan.

Pichai menekankan bahawa percubaan Google untuk mempercepatkan penyelidikan dan pembangunan tidak bermakna memotong sudut.

Kami sedang menubuhkan jabatan baharu yang bertujuan membina sistem yang lebih berkebolehan, selamat dan lebih bertanggungjawab untuk memastikan pembangunan kecerdasan buatan am yang bertanggungjawab.

Bekas penyelidik kecerdasan buatan Google Brain, Brian Kihoon Lee telah dipecat dalam gelombang pemberhentian beramai-ramai pada Januari tahun ini. Beliau menyifatkan peralihan itu sebagai peralihan Google daripada "masa aman" kepada Perubahan "masa perang", sekali bersaing menjadi garang, semuanya akan berubah. Dalam situasi perang, keuntungan bahagian pasaran pesaing juga adalah kritikal.

Jurucakap Google Brian Gabriel berkata: Pada 2018, Google telah menubuhkan struktur pengurusan dalaman dan proses semakan yang komprehensif, dan telah menjalankan ratusan ulasan dalam pelbagai bidang produk setakat ini. Google akan terus menggunakan proses ini merentas teknologi berasaskan AI, dan memastikan AI dibangunkan secara bertanggungjawab kekal menjadi keutamaan syarikat.

Tetapi perubahan piawaian untuk menentukan masa produk AI sedia untuk pasaran juga telah menimbulkan rasa tidak senang di kalangan pekerja Contohnya, selepas Google memutuskan untuk mengeluarkan Bard, ia menurunkan taraf produk AI percubaannya piawaian markah ujian telah menimbulkan tentangan daripada pekerja dalaman.

Pada awal tahun 2023, Google mengumumkan kira-kira 20 dasar yang ditetapkan oleh dua pasukan kecerdasan buatan (Inovasi Bertanggungjawab dan AI Bertanggungjawab) di sekitar Bard secara amnya percaya bahawa peraturan ini cukup jelas dan lengkap.

Sesetengah pekerja juga percaya bahawa piawaian ini digubal lebih seperti prestasi untuk dunia luar Adalah lebih baik untuk membuat data latihan awam atau model sumber terbuka supaya pengguna boleh mempunyai pemahaman yang lebih jelas daripada keupayaan model.

Keputusan Google untuk mempercepatkan penyelidikan dan pembangunan merupakan rahmat yang bercampur-campur untuk pekerja.

Berita baiknya ialah pekerja dalam jawatan penyelidikan bukan saintifik secara amnya optimis dan percaya bahawa keputusan ini boleh membantu Google memperoleh semula kedudukan teratas.

Tetapi bagi penyelidik, keperluan untuk mendapatkan kelulusan tambahan sebelum menerbitkan hasil penyelidikan AI yang berkaitan mungkin bermakna penyelidik akan terlepas keluaran pertama dalam bidang Generatif AI yang berkembang pesat.

Terdapat juga kebimbangan bahawa Google mungkin menyekat kertas kontroversi secara senyap-senyap, seperti kajian 2020 yang diketuai oleh pasukan AI Etika Google dan dikarang bersama oleh Timnit Gebru dan Margaret Mitchell Kajian tentang bahaya model bahasa yang besar.

Ramai penyelidik kecerdasan buatan terkemuka telah diburu oleh syarikat pemula sepanjang tahun lalu, sebahagiannya disebabkan oleh ketidakpedulian Google dan penelitian yang berlebihan terhadap hasil penyelidik saintifik.

Mendapatkan kertas kerja yang diluluskan mungkin memerlukan lelaran yang ketat oleh penyelidik kanan, menurut bekas penyelidik Google. Google telah memberikan komitmen kepada ramai penyelidik supaya mereka boleh terus mengambil bahagian dalam topik penyelidikan yang lebih luas dalam bidang tersebut, dan sekatan penerbitan mungkin memaksa kumpulan penyelidik lain untuk keluar.

Sambil Google mempercepatkan pembangunannya, terdapat juga beberapa suara yang kedengaran tidak begitu harmoni. Mereka menyeru pengeluar kecerdasan buatan utama untuk memperlahankan kelajuan pembangunan mereka, dan percaya bahawa kelajuan pembangunan teknologi ini telah melebihi jangkaan pencipta.

Geoffrey Hinton, perintis dalam pembelajaran mendalam, meninggalkan Google di tengah-tengah kebimbangan tentang potensi bahaya AI superintelligent yang boleh terlepas daripada kawalan manusia.

Pengguna secara beransur-ansur mula memahami risiko dan batasan model bahasa yang besar, seperti kecenderungan kecerdasan buatan untuk mengada-adakan fakta, dsb., tetapi penafian cetakan kecil di ChatGPT tidak jelaskan batasannya.

Aplikasi hiliran berdasarkan ChatGPT telah mendedahkan lebih banyak masalah Sebagai contoh, profesor Universiti Stanford Percy Liang pernah menjalankan kajian dan mendapati hanya 70% daripada rujukan yang diberikan oleh Bing adalah betul.

Pada 4 Mei, Rumah Putih menjemput Ketua Pegawai Eksekutif Google, OpenAI dan Microsoft untuk bertemu untuk membincangkan kebimbangan orang ramai tentang teknologi AI dan cara mengawal selia AI.

Presiden AS Biden menjelaskan dalam surat jemputan bahawa syarikat AI mesti memastikan keselamatan produk mereka sebelum ia boleh dibuka kepada orang ramai.

Atas ialah kandungan terperinci Google sedang panik! Jika anda ingin menerbitkan kertas kerja, anda perlu mendapatkan kelulusan dan memberi keutamaan kepada pembangunan produk: Adakah ChatGPT lagu angsa dalam bidang kecerdasan buatan?. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

sistem Hongmeng

sistem Hongmeng

Apakah format video

Apakah format video

Bagaimana untuk mengubah suai nama fail secara kelompok

Bagaimana untuk mengubah suai nama fail secara kelompok

Bagaimana untuk menerangi Douyin kawan rapat

Bagaimana untuk menerangi Douyin kawan rapat

Ringkasan ralat soket biasa

Ringkasan ralat soket biasa

Bolehkah syiling BAGS disimpan lama?

Bolehkah syiling BAGS disimpan lama?

Cara menghidupkan dan mematikan Douyin Xiaohuoren

Cara menghidupkan dan mematikan Douyin Xiaohuoren

Bagaimanakah cara saya menyediakan WeChat untuk memerlukan persetujuan saya apabila orang menambahkan saya ke kumpulan?

Bagaimanakah cara saya menyediakan WeChat untuk memerlukan persetujuan saya apabila orang menambahkan saya ke kumpulan?