Peranti teknologi

Peranti teknologi

AI

AI

Bapa ChatGPT sedang bertengkar di Capitol Hill! OpenAI mahu bergabung tenaga dengan kerajaan untuk mendapatkan kuasa

Bapa ChatGPT sedang bertengkar di Capitol Hill! OpenAI mahu bergabung tenaga dengan kerajaan untuk mendapatkan kuasa

Bapa ChatGPT sedang bertengkar di Capitol Hill! OpenAI mahu bergabung tenaga dengan kerajaan untuk mendapatkan kuasa

Kali terakhir Zhou Zhizhi, kali ini giliran Sam Altman.

Tetapi kali ini, ahli Kongres mempunyai sikap yang sama sekali berbeza terhadapnya - peramah, sabar, membuat kerja rumah yang cukup, dan meminta nasihat dengan rendah hati.

Malam tadi, waktu Beijing, Ketua Pegawai Eksekutif OpenAI Sam Altman memberi keterangan di hadapan Senat A.S. tentang potensi bahaya teknologi AI dan menggesa penggubal undang-undang untuk melaksanakan keperluan pelesenan dan peraturan lain untuk organisasi yang mengeluarkan AI lanjutan .

Sam Altman tidak perlu menerima soalan rumit, dia duduk di tempat duduknya dan bercakap dengan mudah, dan sekali lagi memberitahu dunia Bukti: Sebagai Ketua Pegawai Eksekutif permulaan paling berprofil tinggi di dunia, dia sedang menulis peraturan dan masa depan dunia teknologi.

Menghadapi Kongres A.S., Sam Altman sekali lagi dengan pasti menjamin OpenAI tidak akan melatih GPT-5 dalam tempoh enam bulan akan datang.

Pada masa yang sama, beliau juga mengeluarkan amaran kepada dunia: AI mungkin berbahaya kepada dunia Untuk menangani risiko AI yang semakin kuat, kita perlu mengukuhkan penyeliaan dan perundangan, dan campur tangan kerajaan adalah amat penting.

Mengapa Altman begitu aktif dalam peraturan kerajaan?

Jelas sekali, selagi anda menjadi pembuat peraturan, anda boleh memenangi pertandingan pemenang-ambil-semua.

Bagi Altman, yang telah mencipta nama di Silicon Valley dengan bergantung pada sifat "lembu sosial"nya, berurusan dengan kerajaan adalah semudah memilih sesuatu daripada beg.

Ucapan pembukaan yang dijana oleh AI

Sebagai kuasa baharu yang tiba-tiba muncul dalam dunia teknologi, OpenAI telah menggerakkan dunia dengan sepantas kilat tahun ini, 8 tahun selepas penubuhannya di seluruh dunia, semua syarikat teknologi telah dipaksa untuk mengambil bahagian dalam involusi global bermula dengan ChatGPT.

Perlumbaan senjata AI global ini telah membimbangkan ramai pakar.

Namun, dalam perbicaraan ini, ahli-ahli Dewan Negara tidak mengkritik kekacauan yang disebabkan oleh teknologi OpenAI, tetapi dengan rendah hati meminta pendapat saksi mengenai peraturan berpotensi ChatGPT Sam Atlman kelihatan mesra dan hormat-menghormati.

Pada permulaan perbicaraan, Senator Richard Blumenthal menggunakan perisian pengklonan suara untuk menyalin suaranya sendiri dan membenarkan ChatGPT menulis Ayat pembukaan, penjana teks ke pertuturan yang dilatih menggunakan jam pertuturan.

Langkah ini membuktikan bahawa Kongres mempunyai sikap yang jelas terhadap "memeluk AI".

AI berbahaya, sila kawal kami

Pada pendengaran ini, penggubal undang-undang jelas sangat teruja, dan mereka sangat tegas dengan Xiao Zha dan Zhou Shouzi Soalan sedang dalam kontras yang tajam.

Daripada mengungkit kesilapan masa lalu, senator tidak sabar-sabar untuk manfaat yang boleh dibawa oleh AI.

Dan Altman terus kepada intipati dan memberitahu Senat: Teknologi AI boleh menjadi salah.

Dia berkata bahawa dia sangat bimbang tentang industri kecerdasan buatan yang menyebabkan bahaya besar kepada dunia.

"Jika teknologi AI menjadi salah, akibatnya akan menjadi bencana. Kami perlu bercakap tentang perkara ini: kami mahu bekerjasama dengan kerajaan untuk mengelakkan perkara ini daripada berlaku."

“Kami percaya campur tangan kawal selia kerajaan adalah penting untuk mengurangkan risiko model AI yang semakin berkuasa Contohnya, kerajaan A.S. boleh mempertimbangkan untuk menggabungkan keperluan pelesenan dan ujian untuk membangunkan dan mengeluarkan AI yang melebihi ambang keupayaan. Model. 》

Altman berkata bahawa dia sangat bimbang pilihan raya akan terjejas oleh kandungan yang dijana AI, jadi perlu ada penyeliaan yang mencukupi dalam hal ini.

Dalam hal ini, Senator Dick Durbin berkata adalah sesuatu yang luar biasa bagi syarikat-syarikat besar untuk datang ke Senat untuk "memohon peraturan kami."

Altman mencadangkan tiga penyelesaian:

Bagaimana untuk mengawal selia? Altman sudah memikirkan kerajaan.

Pada perbicaraan itu, beliau mencadangkan satu rancangan yang sistematik.

1. Menubuhkan agensi kerajaan baharu yang bertanggungjawab untuk melesenkan model AI yang besar dan membatalkan lesen untuk model yang tidak memenuhi piawaian.

Beliau percaya bahawa tidak ada keperluan untuk melaksanakan sistem kawal selia pelesenan ini untuk teknologi yang tidak dapat mencapai tahap model berskala besar yang canggih. Untuk menggalakkan inovasi, Kongres boleh menetapkan ambang kecekapan untuk melindungi syarikat dan penyelidik yang lebih kecil daripada beban kawal selia.

2. Cipta satu set piawaian keselamatan untuk model AI, termasuk penilaian keupayaan berbahayanya.

Sebagai contoh, model mesti lulus ujian keselamatan, seperti sama ada mereka boleh "meniru sendiri" dan "bocor di luar peraturan."

3. Memerlukan pakar bebas untuk menjalankan audit bebas prestasi model pada pelbagai penunjuk.

Apabila ditanya oleh senator sama ada dia bersedia untuk mengambil peranan itu, Altman berkata: "Saya berpuas hati dengan pekerjaan saya sekarang, tetapi dia dengan senang hati menyediakan senarai untuk dipilih oleh Kongres."

Altman berkata kerana model AI boleh "memujuk, memanipulasi, mempengaruhi tingkah laku, kepercayaan" seseorang dan juga "mencipta ejen biologi baharu", pelesenan amat diperlukan.

Adalah lebih mudah untuk melesenkan semua sistem di atas ambang kuasa pengkomputeran tertentu, tetapi Altman berkata dia lebih suka melukis garis kawal selia berdasarkan keupayaan tertentu.

Jadi adakah model OpenAI sendiri selamat?

Altman telah berulang kali mengatakan bahawa semua orang boleh yakin.

Beliau berkata model GPT-4 akan bertindak balas dengan lebih sengaja dan realistik berbanding model lain yang serupa, dan pastinya akan menolak permintaan berbahaya kerana GPT-4 telah menjalani ujian Pra-keluaran yang meluas dan pengauditan.

"Sebelum mengeluarkan sebarang sistem baharu, OpenAI menjalankan ujian yang meluas, melibatkan pakar luar untuk menjalankan semakan terperinci dan audit bebas, menambah baik tingkah laku model dan melaksanakan sistem keselamatan dan pemantauan yang kukuh. 》

“Kami menghabiskan lebih enam bulan menjalankan penilaian menyeluruh, pasukan merah luaran dan ujian keupayaan berbahaya sebelum mengeluarkan GPT-4.”

Dan yang terakhir bulan, pengguna ChatGPT dapat mematikan sejarah sembang untuk menghalang data peribadi mereka daripada digunakan untuk melatih model AI.

Namun, ada juga yang tajam mata yang menemui "titik hua" itu tidak melibatkan dua perkara yang hangat diperkatakan orang ramai -

1. Memerlukan model AI untuk mendedahkan sumber data latihan mereka.

2. Model AI dilarang menggunakan karya yang dilindungi oleh hak harta intelek untuk latihan.

Nah, maksudnya, Altman mengelak dua perkara kontroversi ini dengan sangat bijak.

Cadangan Altman untuk peraturan keselamatan AI telah dipuji oleh penggubal undang-undang, yang sekali-sekala melahirkan rasa terima kasih atas keterangannya. Senator Altman, R-LA, malah menghubungi Altman, bertanya sama ada dia berminat untuk bekerja di agensi kawal selia yang diwujudkan oleh Kongres.

Kongres berazam untuk mengawal selia kecerdasan buatan, dan terdapat tanda-tanda awal. Awal bulan ini, Altman, bersama-sama dengan Ketua Pegawai Eksekutif Google, Microsoft dan Nvidia, bertemu dengan Naib Presiden Kamala Harris di Rumah Putih untuk membincangkan pembangunan AI yang bertanggungjawab.

Seawal tahun lalu, Rumah Putih mencadangkan "Rang Undang-undang Hak Kepintaran Buatan" untuk mengemukakan pelbagai keperluan kepada industri, seperti mencegah diskriminasi.

Membandingkan AI dengan bom atom, adalah disyorkan untuk menubuhkan organisasi antarabangsa yang serupa dengan Agensi Tenaga Atom Antarabangsa

Senator mencadangkan membandingkan AI kepada bom atom.

Merujuk kepada amalan kerajaan di seluruh dunia dalam mengawal selia senjata nuklear, Altman mencadangkan idea untuk membentuk sebuah agensi yang serupa dengan Agensi Tenaga Atom Antarabangsa untuk merumuskan peraturan global untuk industri.

OpenAI tidak akan melatih GPT-5 untuk enam bulan akan datang

Dalam temu bual Pusingan 2 April dengan Lex Fridman, Sam Altman berkata dengan tegas: "Kami tidak melatih GPT-5 sekarang, kami hanya melakukan lebih banyak kerja berdasarkan GPT-4."

Pada perbicaraan ini, Altman secara langsung mengakui OpenAI tidak bercadang untuk melatih model baharu yang mungkin menjadi GPT-5 dalam tempoh enam bulan akan datang.

Dan ini bermakna hujung tahun ini, Google akan mempunyai sistem kecerdasan buatan yang paling berkuasa lagi - Project Gemini.

Dikatakan bahawa Gemini direka untuk inovasi masa depan seperti penyimpanan dan penjadualan Ia bukan sahaja berbilang modal dari awal, tetapi juga sangat cekap dalam menyepadukan alatan dan API. Ia sedang dibangunkan oleh pasukan Google Deepmind yang baru ditubuhkan.

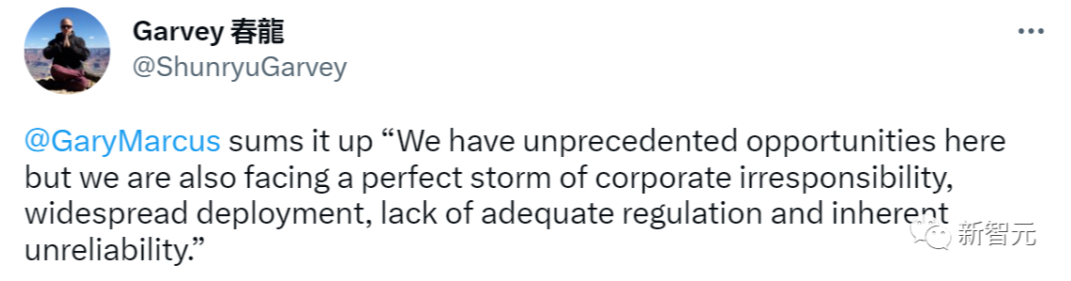

Marcus: OpenAI mendakwa ia untuk semua manusia, tetapi datanya tidak telus

Gary Marcus, seorang profesor psikologi dan neurosains di Universiti New York, turut muncul di kandang saksi.

Dia lebih keras memukul daripada ahli Kongres.

Soalannya kepada Sam Altman boleh disifatkan sebagai "mematikan".

Bukankah tujuan penubuhan OpenAI untuk memberi manfaat kepada semua manusia Mengapa ia kini membentuk pakatan dengan Microsoft?

OpenAI tidak Terbuka, dan data latihan GPT-4 tidak telus Apakah maksudnya?

Marcus menyimpulkan: Kami mempunyai peluang yang belum pernah berlaku sebelum ini, tetapi kami juga menghadapi ketidakbertanggungjawaban korporat yang meluas dan Penggunaan yang meluas, kekurangan peraturan yang betul dan risiko yang teruk tidak boleh dipercayai

Pada pandangan Marcus, kedua-dua Open dan Microsoft melakukan sesuatu yang sangat salah.

Microsoft's Bing AI Sydney menunjukkan satu siri tingkah laku yang mengejutkan.

"Sydney mempunyai masalah besar. Jika saya, saya akan menariknya keluar dari pasaran dengan segera, tetapi Microsoft tidak melakukannya." Marcus berkata bahawa insiden ini adalah satu panggilan untuknya-malah organisasi bukan untung seperti OpenAI boleh dibeli oleh syarikat besar dan kemudian melakukan apa sahaja yang dikehendakinya.

Tetapi sekarang, pandangan dan kehidupan orang ramai dibentuk dan diubah secara halus oleh AI Bagaimana jika seseorang sengaja menggunakan teknologi AI untuk tujuan yang tidak baik?

Marcus sangat risau tentang perkara ini.

Altman berkata komuniti AI Tiada monopoli

Berkenaan beberapa isu perundangan dan kawal selia yang biasa, dapat dilihat bahawa Altman telah pun mempunyai rancangan dalam fikiran dan telah membuat pengaturan yang jelas untuk para senator.

Senator itu berkata salah satu "kebimbangan terbesarnya" tentang kecerdasan buatan ialah "monopoli korporat besar-besaran ini."

Beliau menyebut kerjasama OpenAI dengan gergasi teknologi Microsoft sebagai contoh.

Altman berkata bahawa dia percaya bahawa bilangan syarikat yang boleh mengeluarkan model besar adalah agak kecil, yang mungkin memudahkan untuk mengawal selia.

Sebagai contoh, hanya beberapa syarikat yang boleh mengeluarkan AI generatif berskala besar, tetapi persaingan sentiasa wujud.

Mewujudkan liabiliti undang-undang untuk model besar

Kebangkitan media sosial telah didorong oleh Seksyen 230 yang diluluskan oleh Kongres A.S. pada tahun 1996, yang melindungi laman web Pembebasan daripada liabiliti untuk siaran pengguna.

Altman percaya: Pada masa ini tiada cara untuk model besar dilindungi oleh Seksyen 230. Undang-undang baharu harus digubal untuk melindungi model besar daripada liabiliti undang-undang untuk kandungan yang mereka keluarkan.

Bijak mengelak soalan yang paling mematikan

Ultraman pada mulanya mengelak cadangan senator bahawa "AI boleh menyebabkan akibat yang paling serius."

Tetapi selepas Marcus memberi peringatan mesra bahawa Altman tidak menjawab soalan itu, senator itu mengulangi soalannya.

Altman akhirnya tidak menjawab soalan ini secara langsung.

Beliau berkata OpenAI telah cuba untuk menjadi sangat jelas tentang risiko kecerdasan buatan, yang boleh datang dalam "banyak dengan cara yang berbeza." Menyebabkan "kemudaratan yang ketara kepada dunia".

Dia menjelaskan lagi. Menangani masalah ini adalah sebab OpenAI diasaskan. "Jika ada masalah dengan teknologi ini, ia boleh menjadi sangat salah."

Malah, dalam temu bual dengan "StrictlyVC" awal tahun ini, Altman berkata bahawa kepupusan manusia adalah yang paling banyak. Keadaan yang teruk.

Akhirnya Marcus pun nampak berlembut terhadap Ultraman.

Menjelang akhir perbicaraan, Marcus, yang duduk di sebelah Altman, berkata, "Keikhlasan yang dia bercakap tentang ketakutan sangat jelas sehingga ia tidak terpancar melalui skrin televisyen. "

Pemimpin teknologi canggih

Berbanding dengan Xiao Zha, persembahan Altman dalam pendengaran ini sangat canggih. Saya fikir dia seorang pemimpin sosial. selesa berurusan dengan ahli politik. Lagipun, Altman adalah seseorang yang mempertimbangkan untuk bertanding untuk gabenor California tahun lalu.

Dan berbanding Xiao Zha, yang telah "tersekat banyak masalah" kerana privasi data dan mata wang sebelum pergi ke pendengaran, OpenAI di belakang Altman bukan sahaja menerima hampir tiada orang awam kritikan, tetapi ia juga semasa AI Pengasas paling penting situasi dalam bidang "semua perkara berlaku".

Berdepan dengan Altman, yang menunjukkan niat baik sejak awal lagi dan menggesa peraturan AI, penggubal undang-undang ini, yang hampir semuanya "amatur teknikal", secara semula jadi akan kelihatan lembut di hadapan ini "pihak berkuasa" Banyak kebaikan.

Jadi dalam situasi yang sama, tekanan ke atas Altman tidak berada pada urutan magnitud yang sama seperti pada Xiao Zha.

Model Perniagaan Model Besar

Sesetengah ahli Senat telah membangkitkan kebimbangan bahawa jika produk AI terutamanya pengiklanan, seperti platform sosial Internet, Model perniagaan akan membenarkan reka bentuk produk manipulatif dan algoritma ketagihan disalahgunakan.

Altman berkata dia "sangat suka" model langganan.

Tetapi OpenAI mempertimbangkan kemungkinan menyiarkan iklan dalam versi percuma ChatGPT untuk menjana wang daripada pengguna percumanya.

Atas ialah kandungan terperinci Bapa ChatGPT sedang bertengkar di Capitol Hill! OpenAI mahu bergabung tenaga dengan kerajaan untuk mendapatkan kuasa. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1385

1385

52

52

Baris arahan shutdown centos

Apr 14, 2025 pm 09:12 PM

Baris arahan shutdown centos

Apr 14, 2025 pm 09:12 PM

Perintah shutdown CentOS adalah penutupan, dan sintaks adalah tutup [pilihan] [maklumat]. Pilihan termasuk: -h menghentikan sistem dengan segera; -P mematikan kuasa selepas penutupan; -r mulakan semula; -T Waktu Menunggu. Masa boleh ditentukan sebagai segera (sekarang), minit (minit), atau masa tertentu (HH: mm). Maklumat tambahan boleh dipaparkan dalam mesej sistem.

Apakah kaedah sandaran untuk gitlab di centos

Apr 14, 2025 pm 05:33 PM

Apakah kaedah sandaran untuk gitlab di centos

Apr 14, 2025 pm 05:33 PM

Dasar sandaran dan pemulihan Gitlab di bawah sistem CentOS untuk memastikan keselamatan data dan pemulihan, Gitlab pada CentOS menyediakan pelbagai kaedah sandaran. Artikel ini akan memperkenalkan beberapa kaedah sandaran biasa, parameter konfigurasi dan proses pemulihan secara terperinci untuk membantu anda menubuhkan strategi sandaran dan pemulihan GitLab lengkap. 1. Backup Manual Gunakan Gitlab-Rakegitlab: Backup: Buat Perintah untuk Melaksanakan Backup Manual. Perintah ini menyokong maklumat utama seperti repositori Gitlab, pangkalan data, pengguna, kumpulan pengguna, kunci, dan kebenaran. Fail sandaran lalai disimpan dalam direktori/var/opt/gitlab/sandaran. Anda boleh mengubah suai /etc /gitlab

Cara Memeriksa Konfigurasi HDFS CentOS

Apr 14, 2025 pm 07:21 PM

Cara Memeriksa Konfigurasi HDFS CentOS

Apr 14, 2025 pm 07:21 PM

Panduan Lengkap untuk Memeriksa Konfigurasi HDFS Dalam Sistem CentOS Artikel ini akan membimbing anda bagaimana untuk memeriksa konfigurasi dan menjalankan status HDFS secara berkesan pada sistem CentOS. Langkah -langkah berikut akan membantu anda memahami sepenuhnya persediaan dan operasi HDFS. Sahkan Pembolehubah Alam Sekitar Hadoop: Pertama, pastikan pembolehubah persekitaran Hadoop ditetapkan dengan betul. Di terminal, laksanakan arahan berikut untuk mengesahkan bahawa Hadoop dipasang dan dikonfigurasi dengan betul: Hadoopversion Semak fail konfigurasi HDFS: Fail konfigurasi teras HDFS terletak di/etc/hadoop/conf/direktori, di mana core-site.xml dan hdfs-site.xml adalah kritikal. gunakan

Bagaimana sokongan GPU untuk Pytorch di CentOS

Apr 14, 2025 pm 06:48 PM

Bagaimana sokongan GPU untuk Pytorch di CentOS

Apr 14, 2025 pm 06:48 PM

Membolehkan pecutan GPU pytorch pada sistem CentOS memerlukan pemasangan cuda, cudnn dan GPU versi pytorch. Langkah-langkah berikut akan membimbing anda melalui proses: Pemasangan CUDA dan CUDNN Tentukan keserasian versi CUDA: Gunakan perintah NVIDIA-SMI untuk melihat versi CUDA yang disokong oleh kad grafik NVIDIA anda. Sebagai contoh, kad grafik MX450 anda boleh menyokong CUDA11.1 atau lebih tinggi. Muat turun dan pasang Cudatoolkit: Lawati laman web rasmi Nvidiacudatoolkit dan muat turun dan pasang versi yang sepadan mengikut versi CUDA tertinggi yang disokong oleh kad grafik anda. Pasang Perpustakaan Cudnn:

Penjelasan terperinci mengenai Prinsip Docker

Apr 14, 2025 pm 11:57 PM

Penjelasan terperinci mengenai Prinsip Docker

Apr 14, 2025 pm 11:57 PM

Docker menggunakan ciri -ciri kernel Linux untuk menyediakan persekitaran berjalan yang cekap dan terpencil. Prinsip kerjanya adalah seperti berikut: 1. Cermin digunakan sebagai templat baca sahaja, yang mengandungi semua yang anda perlukan untuk menjalankan aplikasi; 2. Sistem Fail Kesatuan (Unionfs) menyusun pelbagai sistem fail, hanya menyimpan perbezaan, menjimatkan ruang dan mempercepatkan; 3. Daemon menguruskan cermin dan bekas, dan pelanggan menggunakannya untuk interaksi; 4. Ruang nama dan cgroups melaksanakan pengasingan kontena dan batasan sumber; 5. Pelbagai mod rangkaian menyokong interkoneksi kontena. Hanya dengan memahami konsep -konsep teras ini, anda boleh menggunakan Docker dengan lebih baik.

CentOS memasang MySQL

Apr 14, 2025 pm 08:09 PM

CentOS memasang MySQL

Apr 14, 2025 pm 08:09 PM

Memasang MySQL pada CentOS melibatkan langkah -langkah berikut: Menambah sumber MySQL YUM yang sesuai. Jalankan YUM Pasang Perintah MySQL-Server untuk memasang pelayan MySQL. Gunakan perintah mysql_secure_installation untuk membuat tetapan keselamatan, seperti menetapkan kata laluan pengguna root. Sesuaikan fail konfigurasi MySQL seperti yang diperlukan. Tune parameter MySQL dan mengoptimumkan pangkalan data untuk prestasi.

Cara Melihat Log Gitlab Di Bawah Centos

Apr 14, 2025 pm 06:18 PM

Cara Melihat Log Gitlab Di Bawah Centos

Apr 14, 2025 pm 06:18 PM

Panduan Lengkap untuk Melihat Log Gitlab Di bawah Sistem CentOS Artikel ini akan membimbing anda bagaimana untuk melihat pelbagai log Gitlab dalam sistem CentOS, termasuk log utama, log pengecualian, dan log lain yang berkaitan. Sila ambil perhatian bahawa laluan fail log mungkin berbeza -beza bergantung pada versi GitLab dan kaedah pemasangan. Jika laluan berikut tidak wujud, sila semak fail Direktori Pemasangan dan Konfigurasi GitLab. 1. Lihat log Gitlab utama Gunakan arahan berikut untuk melihat fail log utama aplikasi GitLabRails: Perintah: Sudocat/var/Log/Gitlab/Gitlab-Rails/Production.log Perintah ini akan memaparkan produk

Cara Memilih Pangkalan Data Gitlab di CentOs

Apr 14, 2025 pm 05:39 PM

Cara Memilih Pangkalan Data Gitlab di CentOs

Apr 14, 2025 pm 05:39 PM

Apabila memasang dan mengkonfigurasi GitLab pada sistem CentOS, pilihan pangkalan data adalah penting. GitLab serasi dengan pelbagai pangkalan data, tetapi PostgreSQL dan MySQL (atau MariaDB) paling biasa digunakan. Artikel ini menganalisis faktor pemilihan pangkalan data dan menyediakan langkah pemasangan dan konfigurasi terperinci. Panduan Pemilihan Pangkalan Data Ketika memilih pangkalan data, anda perlu mempertimbangkan faktor -faktor berikut: PostgreSQL: Pangkalan data lalai Gitlab adalah kuat, mempunyai skalabilitas yang tinggi, menyokong pertanyaan kompleks dan pemprosesan transaksi, dan sesuai untuk senario aplikasi besar. MySQL/MariaDB: Pangkalan data relasi yang popular digunakan secara meluas dalam aplikasi web, dengan prestasi yang stabil dan boleh dipercayai. MongoDB: Pangkalan Data NoSQL, mengkhususkan diri dalam