Peranti teknologi

Peranti teknologi

industri IT

industri IT

Alibaba Cloud melancarkan pelan transformasi komprehensif dan melancarkan model bahasa besar 'Tongyi Qianwen'

Alibaba Cloud melancarkan pelan transformasi komprehensif dan melancarkan model bahasa besar 'Tongyi Qianwen'

Alibaba Cloud melancarkan pelan transformasi komprehensif dan melancarkan model bahasa besar 'Tongyi Qianwen'

Menurut berita pada 23 Mei, Alibaba Cloud, anak syarikat Alibaba Group, merancang untuk menjalankan pusingan pengoptimuman organisasi dan kakitangan untuk meningkatkan lagi strategi perniagaan, organisasi dan operasinya. Berita itu datang lima hari sebelum Zhang Yong, pengerusi lembaga pengarah Kumpulan Alibaba dan Ketua Pegawai Eksekutif Alibaba Cloud Intelligence, mengumumkan bahawa Alibaba Cloud akan sepenuhnya beralih daripada Alibaba Group dan menyelesaikan penyenaraiannya dalam tempoh 12 bulan akan datang.

Berbilang sumber mengatakan bahawa pelan pengoptimuman ini bermula pada pertengahan Mei, dan Alibaba Group baru sahaja mengumumkan prestasi tahun lepas bulan lepas. Walaupun berita tentang pemberhentian 7% Alibaba Cloud telah menarik banyak perhatian, Alibaba Cloud telah menjawab bahawa ini adalah pengoptimuman rutin bagi jawatan dan kakitangan organisasi. Menurut orang dalam syarikat, piawaian pampasan pemberhentian syarikat ialah "N+1+1", dan cuti tahunan yang belum diambil serta cuti berteman boleh ditukar kepada wang tunai.

Organisasi dan pengoptimuman kakitangan dijalankan setiap tahun, dan Alibaba Cloud, sebagai segmen perniagaan penting Kumpulan Alibaba, tidak terkecuali. Pengoptimuman ini dilihat sebagai langkah untuk mengukuhkan lagi strategi perniagaan dan meningkatkan kecekapan organisasi. Sejak Zhang Yong mengambil alih Alibaba Cloud pada Disember tahun lepas, beliau telah mengambil beberapa langkah penting, salah satunya ialah pengurangan harga terbesar dalam produk Alibaba Cloud dalam sejarah. Pengurangan harga ini bertujuan untuk mengurangkan kos perkhidmatan awan dan mengembangkan bahagian pasaran.

Menurut data IDC, Alibaba Cloud sentiasa berada di kedudukan utama dalam pasaran awan awam domestik, tetapi pada separuh kedua 2022, bahagian pasarannya jatuh sebanyak 4.8% berbanding tempoh yang sama tahun lepas. Pada masa yang sama, kadar pertumbuhan keseluruhan pasaran awan awam adalah sangat perlahan, dan kadar pertumbuhan hasil telah menurun hampir 24 mata peratusan tahun ke tahun. Ini mungkin sebab latar belakang untuk pengoptimuman Alibaba Cloud.

Selepas mengimbangi kesan transaksi merentas segmen, hasil perniagaan awan Alibaba Group pada suku pertama tahun ini jatuh sebanyak 2% tahun ke tahun, dengan hasil sebanyak 18.582 bilion yuan. Sebagai tindak balas kepada situasi ini, Alibaba Cloud melancarkan model bahasa besar terbaru "Tongyi Qianwen" pada bulan April, dan merancang untuk mengubah secara menyeluruh semua produk untuk menyesuaikan diri dengan perkembangan era kecerdasan buatan.

Ringkasnya, rancangan pengoptimuman organisasi dan kakitangan Alibaba Cloud bertujuan untuk mengoptimumkan lagi strategi perniagaan, meningkatkan kecekapan organisasi dan menyesuaikan diri dengan perubahan dalam pasaran awan awam semasa. Alibaba Cloud akan terus berusaha untuk mengekalkan kedudukan utamanya dalam bidang pengkomputeran awan untuk menyediakan pengguna dengan perkhidmatan awan yang lebih baik.

Atas ialah kandungan terperinci Alibaba Cloud melancarkan pelan transformasi komprehensif dan melancarkan model bahasa besar 'Tongyi Qianwen'. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1391

1391

52

52

Alibaba Cloud mengumumkan bahawa Persidangan Yunqi 2024 akan diadakan di Hangzhou dari 19 hingga 21 September Permohonan percuma untuk tiket percuma

Aug 07, 2024 pm 07:12 PM

Alibaba Cloud mengumumkan bahawa Persidangan Yunqi 2024 akan diadakan di Hangzhou dari 19 hingga 21 September Permohonan percuma untuk tiket percuma

Aug 07, 2024 pm 07:12 PM

Menurut berita dari laman web ini pada 5 Ogos, Alibaba Cloud mengumumkan bahawa Persidangan Yunqi 2024 akan diadakan di Bandar Yunqi, Hangzhou dari 19 hingga 21 September akan ada forum utama selama tiga hari, 400 sub-forum dan topik selari. serta hampir empat Sepuluh ribu meter persegi kawasan pameran. Persidangan Yunqi adalah percuma dan terbuka kepada orang ramai Mulai sekarang, orang ramai boleh memohon tiket percuma melalui laman web rasmi Persidangan Yunqi Tiket semua lulus sebanyak 5,000 yuan. https://yunqi.aliyun.com/2024 /ticket-list Menurut laporan, Persidangan Yunqi bermula pada 2009 dan pada asalnya dinamakan Forum Pembangunan Laman Web China Pertama pada 2011, ia berkembang menjadi Persidangan Pembangun Awan Alibaba pada 2015 , ia secara rasmi dinamakan semula sebagai "Persidangan Yunqi" dan terus berjaya bergerak

Alibaba Cloud mengumumkan bahawa ia akan membuka sumber model 14 bilion parameter Tongyi Qianwen Qwen-14B dan model dialognya, yang akan percuma untuk kegunaan komersial.

Sep 26, 2023 pm 08:05 PM

Alibaba Cloud mengumumkan bahawa ia akan membuka sumber model 14 bilion parameter Tongyi Qianwen Qwen-14B dan model dialognya, yang akan percuma untuk kegunaan komersial.

Sep 26, 2023 pm 08:05 PM

Alibaba Cloud hari ini mengumumkan projek sumber terbuka yang dipanggil Qwen-14B, yang merangkumi model parametrik dan model perbualan. Projek sumber terbuka ini membolehkan penggunaan komersial percuma Tapak ini menyatakan: Alibaba Cloud sebelum ini telah membuka sumber model Qwen-7B bernilai 7 bilion Jumlah muat turun dalam tempoh lebih sebulan telah melebihi 1 juta kali Cloud, Qwen -14B mengatasi model dengan saiz yang sama dalam berbilang penilaian berwibawa, dan beberapa penunjuk malah hampir dengan Llama2-70B. Menurut laporan, Qwen-14B ialah model sumber terbuka berprestasi tinggi yang menyokong pelbagai bahasa. Data latihan keseluruhannya melebihi 3 trilion Token, mempunyai keupayaan penaakulan, kognisi, perancangan dan ingatan yang lebih kukuh, serta menyokong tetingkap konteks maksimum sebanyak 8k

Fahami Tokenisasi dalam satu artikel!

Apr 12, 2024 pm 02:31 PM

Fahami Tokenisasi dalam satu artikel!

Apr 12, 2024 pm 02:31 PM

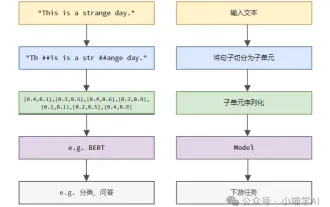

Model bahasa menaakul tentang teks, yang biasanya dalam bentuk rentetan, tetapi input kepada model hanya boleh menjadi nombor, jadi teks perlu ditukar kepada bentuk berangka. Tokenisasi ialah tugas asas pemprosesan bahasa semula jadi Mengikut keperluan khusus, urutan teks berterusan (seperti ayat, perenggan, dll.) boleh dibahagikan kepada urutan aksara (seperti perkataan, frasa, aksara, tanda baca, dsb. berbilang. unit), di mana unit Dipanggil token atau perkataan. Mengikut proses khusus yang ditunjukkan dalam rajah di bawah, ayat teks mula-mula dibahagikan kepada unit, kemudian elemen tunggal didigitalkan (dipetakan ke dalam vektor), kemudian vektor ini dimasukkan ke dalam model untuk pengekodan, dan akhirnya output ke tugas hiliran untuk seterusnya memperoleh keputusan akhir. Pembahagian teks boleh dibahagikan kepada Toke mengikut butiran pembahagian teks.

Tiga rahsia untuk menggunakan model besar dalam awan

Apr 24, 2024 pm 03:00 PM

Tiga rahsia untuk menggunakan model besar dalam awan

Apr 24, 2024 pm 03:00 PM

Kompilasi|Dihasilkan oleh Xingxuan|51CTO Technology Stack (WeChat ID: blog51cto) Dalam dua tahun lalu, saya lebih terlibat dalam projek AI generatif menggunakan model bahasa besar (LLM) berbanding sistem tradisional. Saya mula merindui pengkomputeran awan tanpa pelayan. Aplikasi mereka terdiri daripada meningkatkan AI perbualan kepada menyediakan penyelesaian analitik yang kompleks untuk pelbagai industri, dan banyak lagi keupayaan lain. Banyak perusahaan menggunakan model ini pada platform awan kerana penyedia awan awam sudah menyediakan ekosistem siap sedia dan ia merupakan laluan yang paling tidak mempunyai rintangan. Walau bagaimanapun, ia tidak murah. Awan juga menawarkan faedah lain seperti kebolehskalaan, kecekapan dan keupayaan pengkomputeran lanjutan (GPU tersedia atas permintaan). Terdapat beberapa aspek yang kurang diketahui untuk menggunakan LLM pada platform awan awam

Penalaan halus parameter yang cekap bagi model bahasa berskala besar--siri penalaan halus BitFit/Awalan/Prompt

Oct 07, 2023 pm 12:13 PM

Penalaan halus parameter yang cekap bagi model bahasa berskala besar--siri penalaan halus BitFit/Awalan/Prompt

Oct 07, 2023 pm 12:13 PM

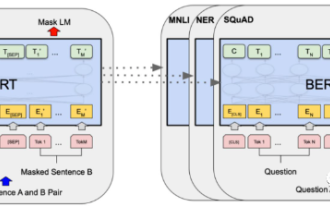

Pada tahun 2018, Google mengeluarkan BERT Sebaik sahaja ia dikeluarkan, ia mengalahkan keputusan terkini (Sota) bagi 11 tugasan NLP dalam satu masa, menjadi satu kejayaan baharu dalam dunia NLP dalam rajah di bawah. Di sebelah kiri ialah pratetap model BERT Proses latihan, di sebelah kanan ialah proses penalaan halus untuk tugasan tertentu. Antaranya, peringkat penalaan halus adalah untuk penalaan halus apabila ia kemudiannya digunakan dalam beberapa tugas hiliran, seperti klasifikasi teks, penandaan sebahagian daripada pertuturan, sistem soal jawab, dsb. BERT boleh diperhalusi pada pelbagai tugas tanpa melaraskan struktur. Melalui reka bentuk tugas "model bahasa pra-latihan + penalaan halus tugas hiliran", ia membawa kesan model yang berkuasa. Sejak itu, "model bahasa pra-latihan + penalaan tugas hiliran" telah menjadi latihan arus perdana dalam bidang NLP.

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Editor |ScienceAI Question Answering (QA) set data memainkan peranan penting dalam mempromosikan penyelidikan pemprosesan bahasa semula jadi (NLP). Set data QA berkualiti tinggi bukan sahaja boleh digunakan untuk memperhalusi model, tetapi juga menilai dengan berkesan keupayaan model bahasa besar (LLM), terutamanya keupayaan untuk memahami dan menaakul tentang pengetahuan saintifik. Walaupun pada masa ini terdapat banyak set data QA saintifik yang meliputi bidang perubatan, kimia, biologi dan bidang lain, set data ini masih mempunyai beberapa kekurangan. Pertama, borang data adalah agak mudah, kebanyakannya adalah soalan aneka pilihan. Ia mudah dinilai, tetapi mengehadkan julat pemilihan jawapan model dan tidak dapat menguji sepenuhnya keupayaan model untuk menjawab soalan saintifik. Sebaliknya, Soal Jawab terbuka

RoSA: Kaedah baharu untuk penalaan halus parameter model besar yang cekap

Jan 18, 2024 pm 05:27 PM

RoSA: Kaedah baharu untuk penalaan halus parameter model besar yang cekap

Jan 18, 2024 pm 05:27 PM

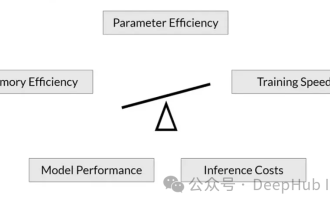

Apabila model bahasa berskala ke skala yang belum pernah berlaku sebelum ini, penalaan halus menyeluruh untuk tugas hiliran menjadi sangat mahal. Bagi menyelesaikan masalah ini, penyelidik mula memberi perhatian dan mengamalkan kaedah PEFT. Idea utama kaedah PEFT adalah untuk mengehadkan skop penalaan halus kepada set kecil parameter untuk mengurangkan kos pengiraan sambil masih mencapai prestasi terkini dalam tugas pemahaman bahasa semula jadi. Dengan cara ini, penyelidik boleh menjimatkan sumber pengkomputeran sambil mengekalkan prestasi tinggi, membawa tempat tumpuan penyelidikan baharu ke bidang pemprosesan bahasa semula jadi. RoSA ialah teknik PEFT baharu yang, melalui eksperimen pada satu set penanda aras, didapati mengatasi prestasi penyesuaian peringkat rendah (LoRA) sebelumnya dan kaedah penalaan halus tulen yang jarang menggunakan belanjawan parameter yang sama. Artikel ini akan pergi secara mendalam

Penjelasan terperinci tentang konfigurasi imej Maven Alibaba Cloud

Feb 21, 2024 pm 10:12 PM

Penjelasan terperinci tentang konfigurasi imej Maven Alibaba Cloud

Feb 21, 2024 pm 10:12 PM

Penjelasan terperinci tentang konfigurasi imej Maven Alibaba Cloud Maven ialah alat pengurusan projek Java Dengan mengkonfigurasi Maven, anda boleh memuat turun perpustakaan bergantung dan membina projek dengan mudah. Imej Alibaba Cloud boleh mempercepatkan kelajuan muat turun Maven dan meningkatkan kecekapan pembinaan projek. Artikel ini akan memperkenalkan secara terperinci cara mengkonfigurasi pencerminan Awan Alibaba dan memberikan contoh kod khusus. Apakah Imej Awan Alibaba? Alibaba Cloud Mirror ialah perkhidmatan cermin Maven yang disediakan oleh Alibaba Cloud Dengan menggunakan Alibaba Cloud Mirror, anda boleh mempercepatkan muat turun perpustakaan pergantungan Maven. Cermin Awan Alibaba