Peranti teknologi

Peranti teknologi

AI

AI

Ejen AI umum SenseTime dan Universiti Tsinghua membuka kunci 100% Minecraft! 2 hari latihan pada CPU tunggal untuk mencipta litar redstone dari awal

Ejen AI umum SenseTime dan Universiti Tsinghua membuka kunci 100% Minecraft! 2 hari latihan pada CPU tunggal untuk mencipta litar redstone dari awal

Ejen AI umum SenseTime dan Universiti Tsinghua membuka kunci 100% Minecraft! 2 hari latihan pada CPU tunggal untuk mencipta litar redstone dari awal

Dalam proses pembangunan AI, terdapat satu fenomena yang sangat menarik tetapi bertentangan dengan akal sehat -

"Beberapa tugas yang agak sukar untuk manusia, seperti bermain catur, Ia agak mudah untuk dicapai oleh AI, sambil berinteraksi dengan alam sekitar, merancang dan membuat keputusan dalam dunia terbuka adalah perkara yang agak mudah untuk manusia, tetapi AI menghadapi cabaran yang besar."

Dan ini adalah Paradoks Moravec.

Walau bagaimanapun, kini GITM telah berjaya memecahkan had paradoks ini, membuat penemuan dalam persekitaran yang kompleks dan seperti dunia sebenar, dan mampu bertahan, meneroka dan mencipta seperti manusia!

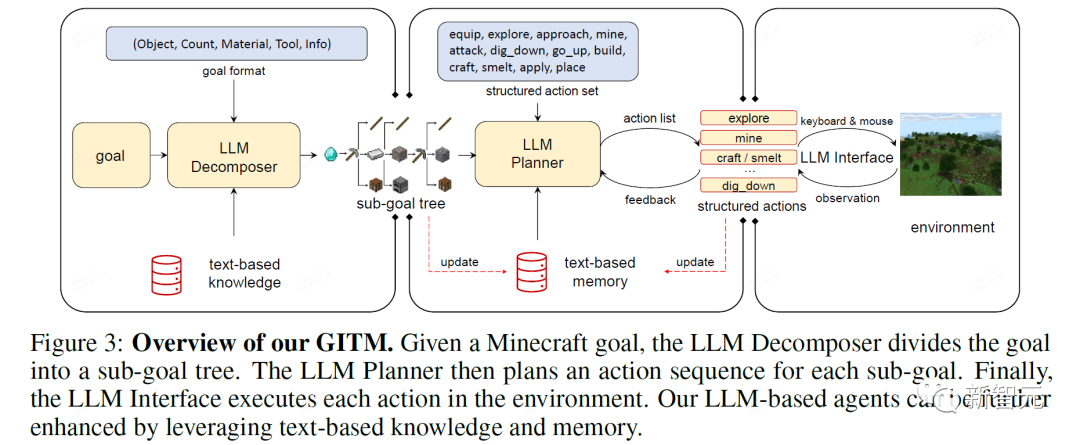

Dalam permainan terlaris "Minecraft" yang menyerupai dunia sebenar, dibangunkan bersama oleh SenseTime The general AI ejen Ghost in the Minecraft (GITM) yang dicadangkan bersama oleh penyelidik dari Universiti Tsinghua, Makmal Kepintaran Buatan Shanghai dan institusi lain bukan sahaja boleh bermain "Minecraft", tetapi juga berprestasi lebih baik daripada semua ejen sebelumnya.

Laman utama projek: https://github.com/OpenGVLab/GITM

Bertahan, teroka dan cipta seperti manusia

Penyelidikan ini merupakan langkah penting ke arah kecerdasan am buatan (AGI).

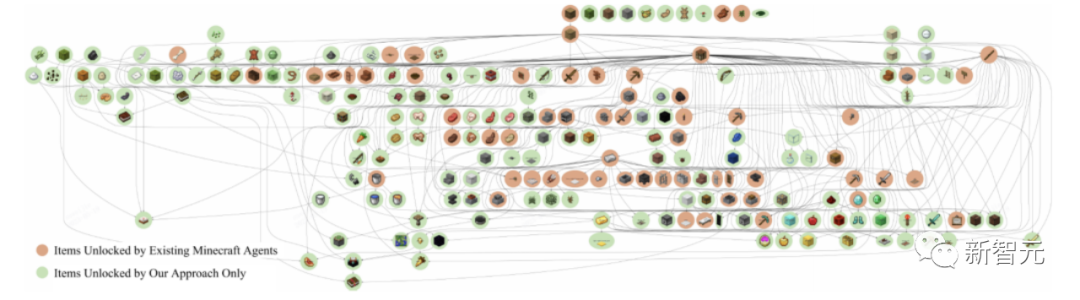

Liputan tugas yang luas

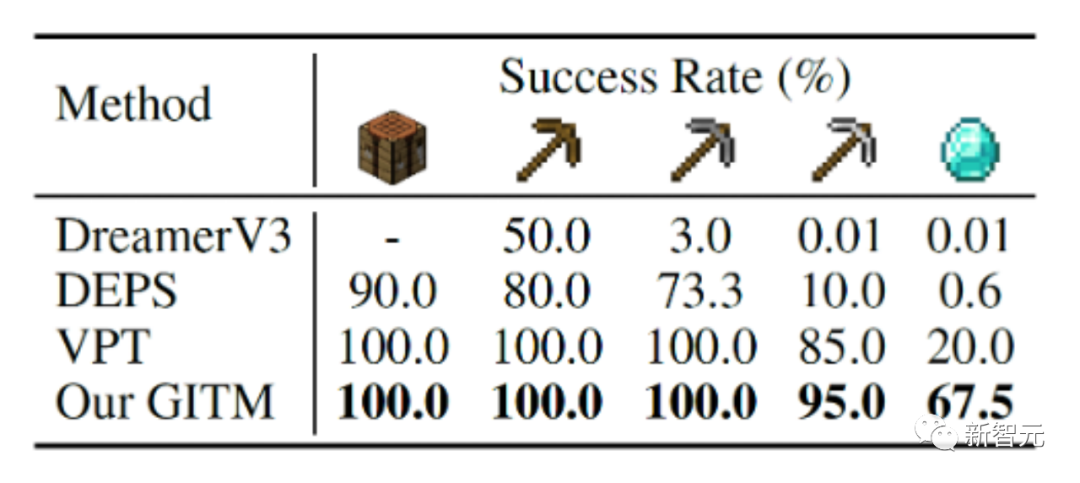

GITM mencapai 100% liputan misi pada semua cabaran teknikal dalam dunia utama Minecraft (berjaya membuka kunci 262 item dalam pokok teknologi lengkap), manakala jumlah semua ejen sebelumnya hanya Boleh menampung 30%. (Pada masa lalu, semua kaedah ejen termasuk OpenAI dan DeepMind hanya membuka kunci sebanyak 78)

Tinggi Kadar kejayaan tugasan

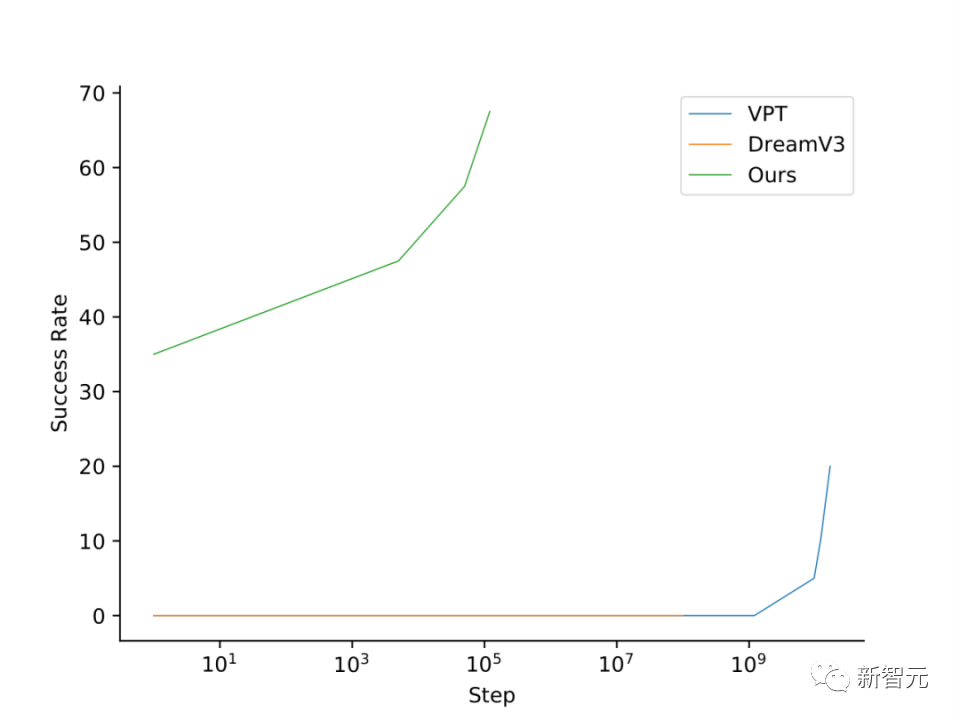

Pada tugasan yang paling banyak ditonton "Dapatkan Berlian", GITM mencapai kadar kejayaan 67.5%, berbanding keputusan terbaik semasa (OpenAI VPT) Peningkatan sebanyak 47.5%.

Kecekapan latihan yang sangat tinggi

kecekapan latihan GITM juga telah mencapai tahap yang baharu. Bilangan langkah interaksi persekitaran hanya sepersepuluh ribu daripada kaedah sedia ada, dan latihan pada satu nod CPU boleh diselesaikan dalam masa 2 hari, yang jauh lebih rendah daripada 6480 hari GPU yang diperlukan oleh OpenAI VPT sebelumnya atau 17 GPU hari yang diperlukan oleh DeepMind DreamerV3.

Ejen AI generalis "Ghost in the Minecraft" (GITM) memainkan permainan "Minecraft" dan bertahan Bermula dari mod gores, dapatkan semua item di dunia utama, gali berlian, dan buat buku terpesona!

GITM boleh mengendalikan semua jenis rupa bumi, persekitaran, pemandangan siang dan malam, dan juga raksasa

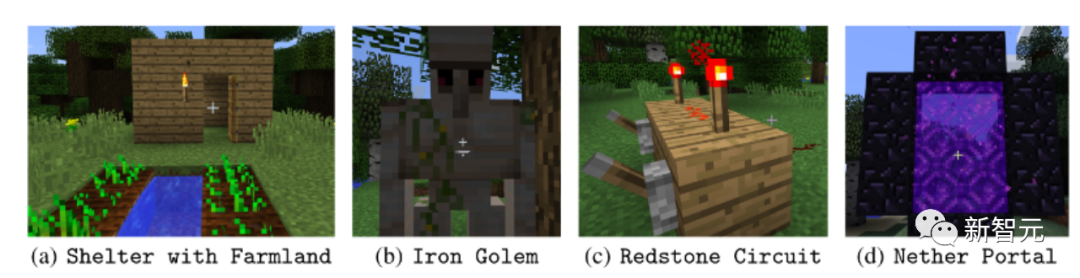

GITM boleh diaplikasikan dengan lebih lanjut. tugas kompleks "Minecraft", seperti tempat perlindungan, tanah ladang, golem besi yang diperlukan untuk hidup, litar batu merah yang diperlukan untuk mencipta peralatan automatik, portal bawah yang diperlukan untuk memasuki dunia bawah, dsb.

Tugas-tugas ini menunjukkan keupayaan berkuasa dan kebolehskalaan GITM, membolehkan ejen bermain dalam Minecraft Survive, membangun dan meneroka dunia yang lebih maju dalam jangka sederhana hingga panjang.

Penerobosan kecerdasan buatan am mempercepatkan revolusi perindustrian AI

Membangunkan GITM ejen AI yang mengatasi semua cabaran teknikal dalam "Minecraft", dengan matlamat membina autonomi Arah kecerdasan buatan umum untuk mempelajari dan menguasai keseluruhan kemahiran dunia sebenar.

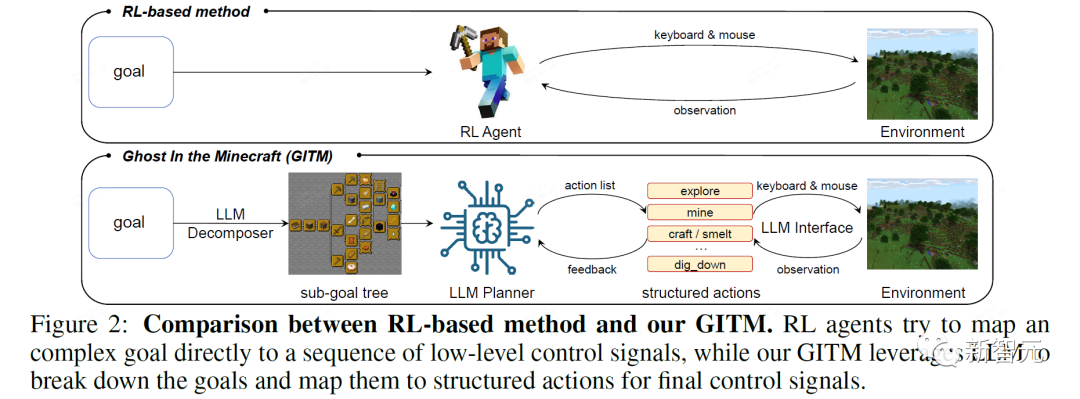

GITM memecahkan seni bina berasaskan RL tradisional dan mengguna pakai paradigma baharu model bahasa besar (LLM) sebagai teras ejen.

Inovasi ini juga membantu mempercepatkan matlamat penyelidikan kecerdasan am buatan (AGI) Realize dan membangunkan ejen pintar yang boleh melihat, memahami dan berinteraksi seperti manusia dalam persekitaran dunia terbuka, dan membawa kejayaan besar dan kemajuan kepada industri seperti robotik dan pemanduan autonomi, menyelesaikan persekitaran yang kompleks dan pelbagai isu yang panjang dalam dunia nyata untuk dipromosikan dengan berkesan pelaksanaan industri teknologi AI pada skala yang lebih besar.

"Ghost in the Minecraft" (GITM)

Manfaat Dengan susun atur strategik "model besar + kuasa pengkomputeran besar" untuk menggalakkan pembangunan AGI (kecerdasan buatan am) dan sistem R&D model besar tindanan penuh, SenseTime telah dapat membangun dengan pesat dalam bidang multi-modal dan multi- tugasan model besar am, dengan "sistem model besar Jepun Nissin SenseNova sebagai teras terus membantu teknologi inovatif digunakan dengan cepat pada bidang seperti kereta pintar, kehidupan pintar, perniagaan pintar dan bandar pintar, dan terus meningkatkan kecerdasan industri.

Hari ini, kejayaan GITM akan mendorong keupayaan aplikasi seperti pemanduan autonomi untuk mengendalikan tugas yang kompleks ke tahap yang lebih tinggi dan memecahkan siling teknikal yang lebih tinggi.

Atas ialah kandungan terperinci Ejen AI umum SenseTime dan Universiti Tsinghua membuka kunci 100% Minecraft! 2 hari latihan pada CPU tunggal untuk mencipta litar redstone dari awal. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1386

1386

52

52

Bytedance Cutting melancarkan keahlian super SVIP: 499 yuan untuk langganan tahunan berterusan, menyediakan pelbagai fungsi AI

Jun 28, 2024 am 03:51 AM

Bytedance Cutting melancarkan keahlian super SVIP: 499 yuan untuk langganan tahunan berterusan, menyediakan pelbagai fungsi AI

Jun 28, 2024 am 03:51 AM

Laman web ini melaporkan pada 27 Jun bahawa Jianying ialah perisian penyuntingan video yang dibangunkan oleh FaceMeng Technology, anak syarikat ByteDance Ia bergantung pada platform Douyin dan pada asasnya menghasilkan kandungan video pendek untuk pengguna platform tersebut Windows , MacOS dan sistem pengendalian lain. Jianying secara rasmi mengumumkan peningkatan sistem keahliannya dan melancarkan SVIP baharu, yang merangkumi pelbagai teknologi hitam AI, seperti terjemahan pintar, penonjolan pintar, pembungkusan pintar, sintesis manusia digital, dsb. Dari segi harga, yuran bulanan untuk keratan SVIP ialah 79 yuan, yuran tahunan ialah 599 yuan (nota di laman web ini: bersamaan dengan 49.9 yuan sebulan), langganan bulanan berterusan ialah 59 yuan sebulan, dan langganan tahunan berterusan ialah 499 yuan setahun (bersamaan dengan 41.6 yuan sebulan) . Di samping itu, pegawai yang dipotong juga menyatakan bahawa untuk meningkatkan pengalaman pengguna, mereka yang telah melanggan VIP asal

Pembantu pengekodan AI yang ditambah konteks menggunakan Rag dan Sem-Rag

Jun 10, 2024 am 11:08 AM

Pembantu pengekodan AI yang ditambah konteks menggunakan Rag dan Sem-Rag

Jun 10, 2024 am 11:08 AM

Tingkatkan produktiviti, kecekapan dan ketepatan pembangun dengan menggabungkan penjanaan dipertingkatkan semula dan memori semantik ke dalam pembantu pengekodan AI. Diterjemah daripada EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, pengarang JanakiramMSV. Walaupun pembantu pengaturcaraan AI asas secara semulajadi membantu, mereka sering gagal memberikan cadangan kod yang paling relevan dan betul kerana mereka bergantung pada pemahaman umum bahasa perisian dan corak penulisan perisian yang paling biasa. Kod yang dijana oleh pembantu pengekodan ini sesuai untuk menyelesaikan masalah yang mereka bertanggungjawab untuk menyelesaikannya, tetapi selalunya tidak mematuhi piawaian pengekodan, konvensyen dan gaya pasukan individu. Ini selalunya menghasilkan cadangan yang perlu diubah suai atau diperhalusi agar kod itu diterima ke dalam aplikasi

Bolehkah penalaan halus benar-benar membolehkan LLM mempelajari perkara baharu: memperkenalkan pengetahuan baharu boleh menjadikan model menghasilkan lebih banyak halusinasi

Jun 11, 2024 pm 03:57 PM

Bolehkah penalaan halus benar-benar membolehkan LLM mempelajari perkara baharu: memperkenalkan pengetahuan baharu boleh menjadikan model menghasilkan lebih banyak halusinasi

Jun 11, 2024 pm 03:57 PM

Model Bahasa Besar (LLM) dilatih pada pangkalan data teks yang besar, di mana mereka memperoleh sejumlah besar pengetahuan dunia sebenar. Pengetahuan ini dibenamkan ke dalam parameter mereka dan kemudiannya boleh digunakan apabila diperlukan. Pengetahuan tentang model ini "diperbaharui" pada akhir latihan. Pada akhir pra-latihan, model sebenarnya berhenti belajar. Selaraskan atau perhalusi model untuk mempelajari cara memanfaatkan pengetahuan ini dan bertindak balas dengan lebih semula jadi kepada soalan pengguna. Tetapi kadangkala pengetahuan model tidak mencukupi, dan walaupun model boleh mengakses kandungan luaran melalui RAG, ia dianggap berfaedah untuk menyesuaikan model kepada domain baharu melalui penalaan halus. Penalaan halus ini dilakukan menggunakan input daripada anotasi manusia atau ciptaan LLM lain, di mana model menemui pengetahuan dunia sebenar tambahan dan menyepadukannya

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Editor |ScienceAI Question Answering (QA) set data memainkan peranan penting dalam mempromosikan penyelidikan pemprosesan bahasa semula jadi (NLP). Set data QA berkualiti tinggi bukan sahaja boleh digunakan untuk memperhalusi model, tetapi juga menilai dengan berkesan keupayaan model bahasa besar (LLM), terutamanya keupayaan untuk memahami dan menaakul tentang pengetahuan saintifik. Walaupun pada masa ini terdapat banyak set data QA saintifik yang meliputi bidang perubatan, kimia, biologi dan bidang lain, set data ini masih mempunyai beberapa kekurangan. Pertama, borang data adalah agak mudah, kebanyakannya adalah soalan aneka pilihan. Ia mudah dinilai, tetapi mengehadkan julat pemilihan jawapan model dan tidak dapat menguji sepenuhnya keupayaan model untuk menjawab soalan saintifik. Sebaliknya, Soal Jawab terbuka

Tiada data OpenAI diperlukan, sertai senarai model kod besar! UIUC mengeluarkan StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

Tiada data OpenAI diperlukan, sertai senarai model kod besar! UIUC mengeluarkan StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

Di barisan hadapan teknologi perisian, kumpulan UIUC Zhang Lingming, bersama penyelidik dari organisasi BigCode, baru-baru ini mengumumkan model kod besar StarCoder2-15B-Instruct. Pencapaian inovatif ini mencapai kejayaan ketara dalam tugas penjanaan kod, berjaya mengatasi CodeLlama-70B-Instruct dan mencapai bahagian atas senarai prestasi penjanaan kod. Keunikan StarCoder2-15B-Instruct terletak pada strategi penjajaran diri yang tulen Keseluruhan proses latihan adalah terbuka, telus, dan sepenuhnya autonomi dan boleh dikawal. Model ini menjana beribu-ribu arahan melalui StarCoder2-15B sebagai tindak balas kepada penalaan halus model asas StarCoder-15B tanpa bergantung pada anotasi manual yang mahal.

Yolov10: Penjelasan terperinci, penggunaan dan aplikasi semuanya di satu tempat!

Jun 07, 2024 pm 12:05 PM

Yolov10: Penjelasan terperinci, penggunaan dan aplikasi semuanya di satu tempat!

Jun 07, 2024 pm 12:05 PM

1. Pengenalan Sejak beberapa tahun kebelakangan ini, YOLO telah menjadi paradigma dominan dalam bidang pengesanan objek masa nyata kerana keseimbangannya yang berkesan antara kos pengiraan dan prestasi pengesanan. Penyelidik telah meneroka reka bentuk seni bina YOLO, matlamat pengoptimuman, strategi pengembangan data, dsb., dan telah mencapai kemajuan yang ketara. Pada masa yang sama, bergantung pada penindasan bukan maksimum (NMS) untuk pemprosesan pasca menghalang penggunaan YOLO dari hujung ke hujung dan memberi kesan buruk kepada kependaman inferens. Dalam YOLO, reka bentuk pelbagai komponen tidak mempunyai pemeriksaan yang komprehensif dan teliti, mengakibatkan lebihan pengiraan yang ketara dan mengehadkan keupayaan model. Ia menawarkan kecekapan suboptimum, dan potensi yang agak besar untuk peningkatan prestasi. Dalam kerja ini, matlamatnya adalah untuk meningkatkan lagi sempadan kecekapan prestasi YOLO daripada kedua-dua pasca pemprosesan dan seni bina model. sampai habis

Prestasi SOTA, kaedah AI ramalan pertalian protein-ligan pelbagai mod Xiamen, menggabungkan maklumat permukaan molekul buat kali pertama

Jul 17, 2024 pm 06:37 PM

Prestasi SOTA, kaedah AI ramalan pertalian protein-ligan pelbagai mod Xiamen, menggabungkan maklumat permukaan molekul buat kali pertama

Jul 17, 2024 pm 06:37 PM

Editor |. KX Dalam bidang penyelidikan dan pembangunan ubat, meramalkan pertalian pengikatan protein dan ligan dengan tepat dan berkesan adalah penting untuk pemeriksaan dan pengoptimuman ubat. Walau bagaimanapun, kajian semasa tidak mengambil kira peranan penting maklumat permukaan molekul dalam interaksi protein-ligan. Berdasarkan ini, penyelidik dari Universiti Xiamen mencadangkan rangka kerja pengekstrakan ciri berbilang mod (MFE) novel, yang buat pertama kalinya menggabungkan maklumat mengenai permukaan protein, struktur dan jujukan 3D, dan menggunakan mekanisme perhatian silang untuk membandingkan ciri modaliti yang berbeza penjajaran. Keputusan eksperimen menunjukkan bahawa kaedah ini mencapai prestasi terkini dalam meramalkan pertalian mengikat protein-ligan. Tambahan pula, kajian ablasi menunjukkan keberkesanan dan keperluan maklumat permukaan protein dan penjajaran ciri multimodal dalam rangka kerja ini. Penyelidikan berkaitan bermula dengan "S

SK Hynix akan memaparkan produk berkaitan AI baharu pada 6 Ogos: HBM3E 12 lapisan, NAND 321 tinggi, dsb.

Aug 01, 2024 pm 09:40 PM

SK Hynix akan memaparkan produk berkaitan AI baharu pada 6 Ogos: HBM3E 12 lapisan, NAND 321 tinggi, dsb.

Aug 01, 2024 pm 09:40 PM

Menurut berita dari laman web ini pada 1 Ogos, SK Hynix mengeluarkan catatan blog hari ini (1 Ogos), mengumumkan bahawa ia akan menghadiri Global Semiconductor Memory Summit FMS2024 yang akan diadakan di Santa Clara, California, Amerika Syarikat dari 6 hingga 8 Ogos, mempamerkan banyak produk penjanaan teknologi baru. Pengenalan kepada Sidang Kemuncak Memori dan Penyimpanan Masa Depan (FutureMemoryandStorage), dahulunya Sidang Kemuncak Memori Flash (FlashMemorySummit) terutamanya untuk pembekal NAND, dalam konteks peningkatan perhatian kepada teknologi kecerdasan buatan, tahun ini dinamakan semula sebagai Sidang Kemuncak Memori dan Penyimpanan Masa Depan (FutureMemoryandStorage) kepada jemput vendor DRAM dan storan serta ramai lagi pemain. Produk baharu SK hynix dilancarkan tahun lepas