Peranti teknologi

Peranti teknologi

AI

AI

Buat alat anda sendiri untuk model besar seperti GPT-4 untuk mengenal pasti penipuan ChatGPT

Buat alat anda sendiri untuk model besar seperti GPT-4 untuk mengenal pasti penipuan ChatGPT

Buat alat anda sendiri untuk model besar seperti GPT-4 untuk mengenal pasti penipuan ChatGPT

目录:

- Pelbagai Skala Positif-Tidak Berlabel Pengesanan Teks Dijana AI

- Ke Arah Mendedahkan Misteri di sebalik Rantaian Pemikiran: Perspektif Teori

- Model Bahasa Besar sebagai Pembuat Alat

- SpecInfer: Mempercepatkan Penyajian LLM Generatif dengan Inferens Spekulatif dan Pengesahan Pokok Token

- Murah dan Pantas: Penalaan Arahan Visi-Bahasa yang Cekap untuk Model Bahasa Besar

- mPLUG-2: Model Asas Berbilang Modal Bermodul Merentasi Teks, Imej dan Video

- Ke mana Hendak Pergi Seterusnya untuk Sistem Pengesyoran? ID- lwn. Model Pengesyor berasaskan Modaliti Dilawati Semula

论文 1:Pengesanan Berbilang Skala Positif-Tidak Berlabel Teks Dijana AI

- 作者:Yuchuan Tian, Hanting Chen 等

- 论文地址:https://arxiv.org/abs /2305.18149

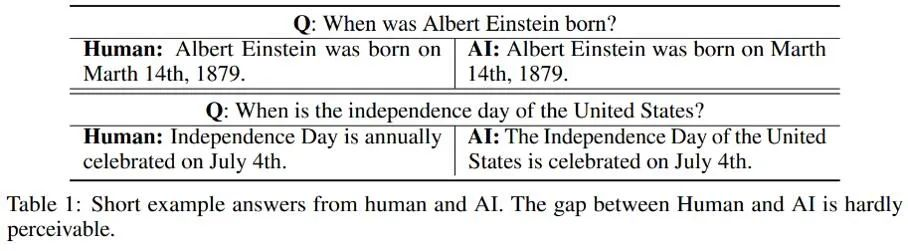

摘要:AI 造假的成功率很高,前几1天逌行 4上了热搜。在最热门的大语言模型上,北大、华为的研究者们最近探索了一种识别一一种识别一一一别一一一一一一一一一一一一一一别一一一一一一一一一一一一一一一一一了别一种识别一一一别一一一别一种识别方一一。和 AI 分别对同一问题做出回答的例子:

推荐: 识别 「chatgpt 造假」, 效果 超越 超越 超越 北大 北大 华为 的 的 的 生成 检测器 来 来 了 了 了 了 了 了>

论文 2:Ke Arah Mendedahkan Misteri di Sebalik Rantaian Pemikiran: Perspektif Teori

- 作者:Guhao Feng、Bohang Zhang等

- 论文地址:https://arxiv.org/abs/2305.15408

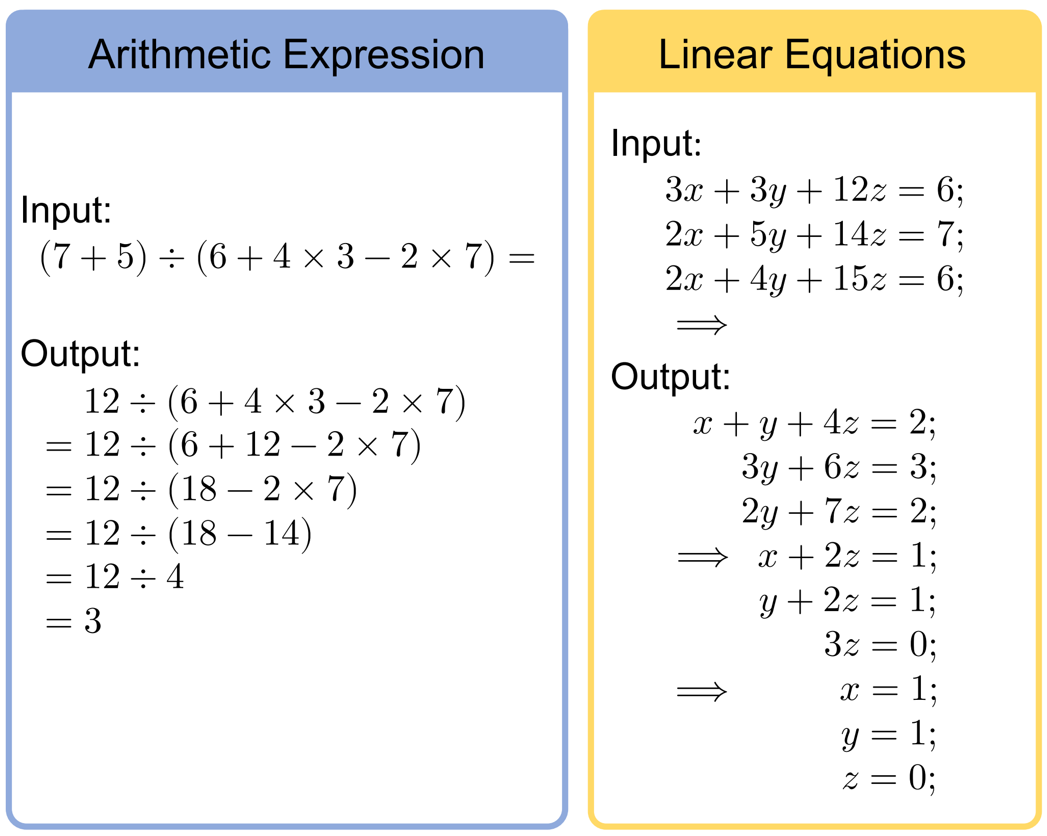

摘要:思维链提示(CoT)是大模型涌现中最神秘的现象之一,尤其决现说策问题中取得了惊艳效果。CoT 到底有多重要呢?它背后成功的机制是什么?缺的,并从理论和实验角度揭示了 CoT 如何释放 LLM 的巨大潜力。

本文选取了两个非常基础但核心的数学任务:算术和方程(下出务的输入输出示例)

论文 3:Model Bahasa Besar sebagai Pembuat Alat

论文 3:Model Bahasa Besar sebagai Pembuat Alat

作者:Tianle Cai、 Xuezhi Wang 等

论文地址:https://arxiv.org/pdf/2305.17126.pdf

- 摘要:受到制造工具对人类重要性的启发,在本文中,Google Deepmind、普林斯顿和簏福的家这种「进化」的概念应用于 LLM 领域,进行了初步探索。他们提出了一个闭环框架,在这个框架中 LLM 作为工具制作者(LLMs As Tool Maker ,LATM失的至家重新使用的工具来处理新任务。

- Pengarang: Xupeng Miao, Gabriele Oliaro, dsb.

- Alamat kertas: https://arxiv.org/abs/2305.09781

- Pengarang: Gen Luo, Yiyi Zhou, dll.

- Kertas alamat: https://arxiv .org/pdf/2305.15023.pdf

- Pengarang: Haiyang Xu, Qinghao Ye, dll.

- Alamat kertas: https:// /arxiv.org/pdf/2302.00402.pdf

- Pengarang: Zheng Yuan, Fajie Yuan , dsb.

- Alamat kertas: https://arxiv.org/abs/2303.13835

Disyorkan: GPT-4 dan model besar lain telah mencapai titik perubahan evolusi: mereka bukan sahaja menggunakannya, tetapi juga membuat alatan mereka sendiri

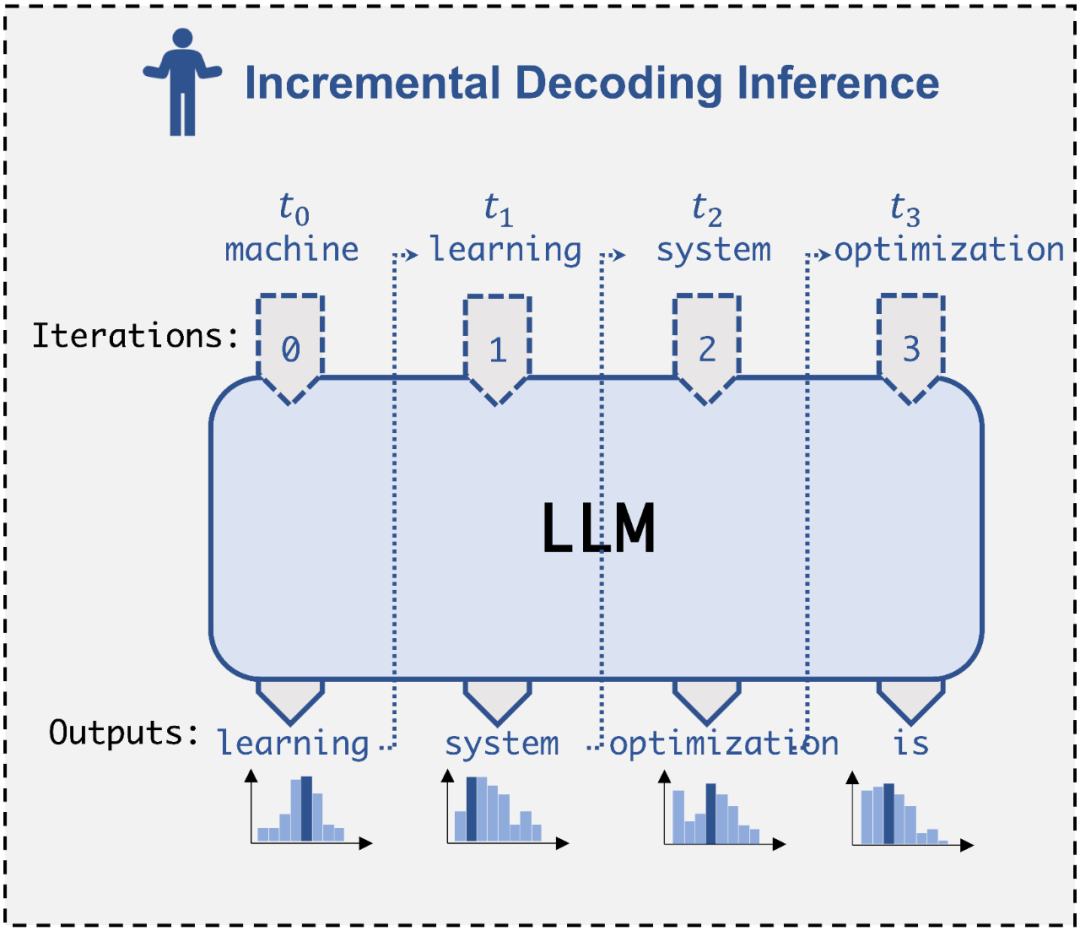

Kertas 4: SpecInfer: Mempercepatkan Penyajian LLM Generatif dengan Inferens Spekulatif dan Pengesahan Pokok Token

Abstrak: Baru-baru ini, pasukan Catalyst Group dari Carnegie Mellon University (CMU) mengeluarkan SpecInfer, sebuah enjin "inferens spekulatif" yang boleh menggunakan model kecil yang ringan untuk membantu model besar tanpa menjejaskan ketepatan kandungan yang dihasilkan di semua. Dalam kes ini, dua hingga tiga kali kelajuan inferens dicapai.

Disyorkan: Kelajuan inferens LLM ditingkatkan sebanyak 2.8 kali ganda, alumni kelas Tsinghua Yao CMU mencadangkan Enjin "pendekatan spekulatif" "Inferens" SpecInfer, model kecil memanfaatkan model besar untuk penaakulan yang cekap

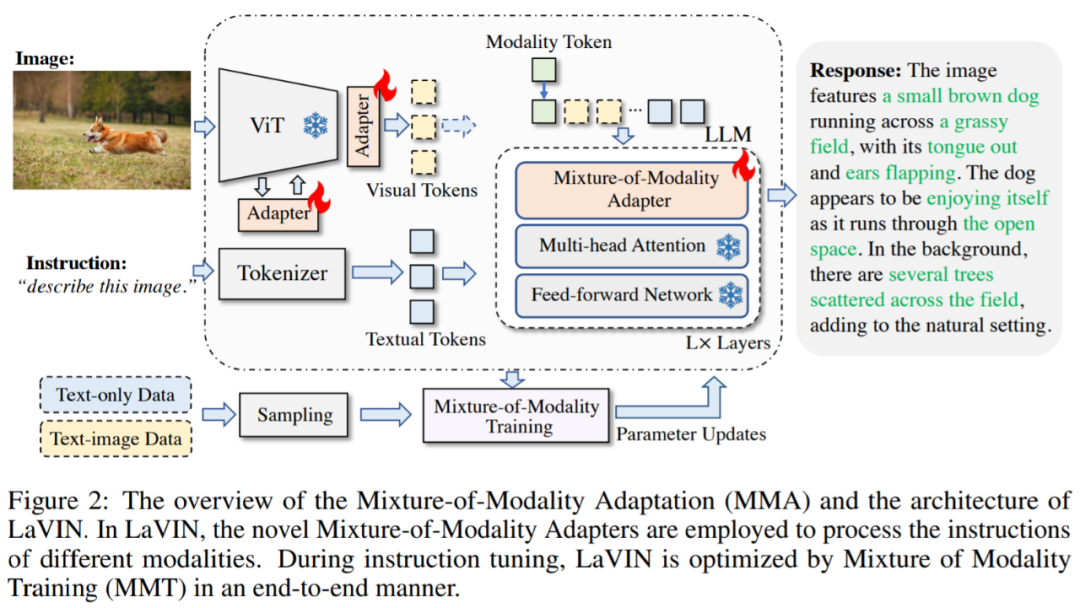

Kertas 5: Murah dan Pantas: Penalaan Arahan Visi-Bahasa yang Cekap untuk Model Bahasa Besar

Abstrak: Kertas kerja ini mencadangkan novel dan kos efektif penyelesaian untuk berkesan Menyesuaikan LLM kepada tugas VL (bahasa visual) dipanggil MMA. Daripada menggunakan rangkaian saraf yang besar untuk menyambungkan pengekod imej dan LLM, MMA menggunakan modul ringan, dipanggil penyesuai, untuk merapatkan jurang antara tugasan LLM dan VL, sambil turut membolehkan pengoptimuman bersama model imej dan model bahasa. Pada masa yang sama, MMA juga dilengkapi dengan algoritma penghalaan yang boleh membantu LLM bertukar secara automatik antara arahan mod tunggal dan berbilang tanpa menjejaskan keupayaan pemahaman bahasa semula jadinya.

Cadangan: Kurangkan masa latihan sebanyak 71.4%, jimat kos penyimpanan sebanyak 99.9%, Xiamen Pelarasan arahan universiti MMA penyelesaian baharu yang sangat baik membolehkan model alpaca mencapai pelbagai modaliti

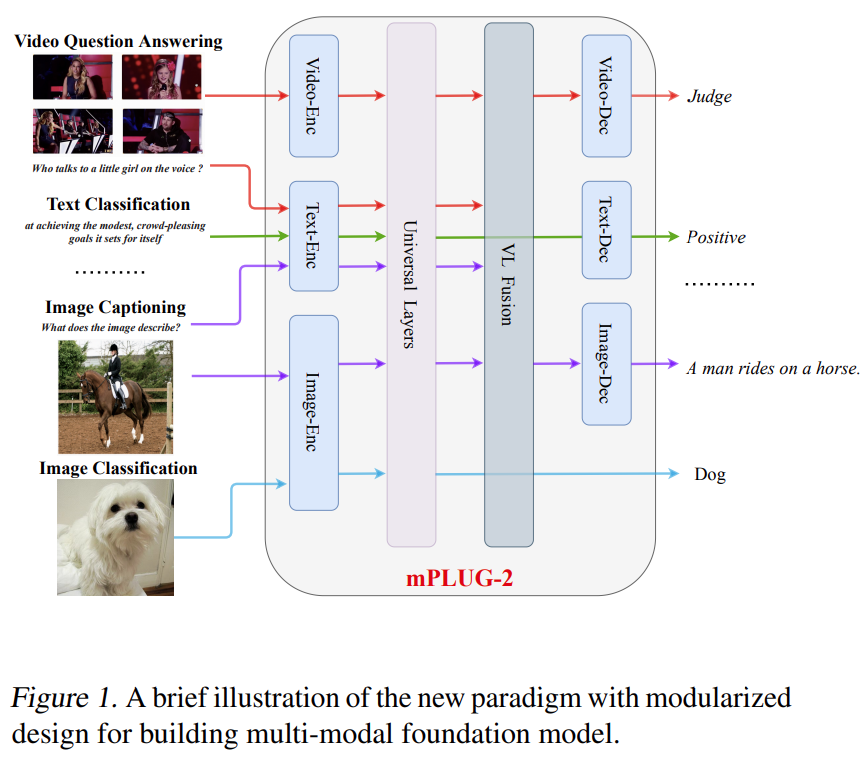

Kertas 6: mPLUG-2: Model Asas Pelbagai Modal Bermodul Merentasi Teks, Imej dan Video

Abstrak: Untuk model asas multimodal, kami berharap bahawa ia bukan sahaja boleh mengendalikan khusus Ia juga berharap untuk mempunyai prestasi yang cemerlang apabila mengendalikan tugas-tugas modal tunggal. Pasukan Akademi Aidamo mendapati bahawa model sedia ada selalunya tidak dapat mengimbangi isu kerjasama modal dan keterjeratan modal dengan baik, yang mengehadkan prestasi model dalam pelbagai tugas hiliran modal tunggal dan rentas modal.

Berdasarkan ini, penyelidik dari DAMO Academy mencadangkan mPLUG-2, yang menggunakan reka bentuk struktur rangkaian modular untuk mengimbangi masalah kerjasama dan keterjeratan antara mod berbilang mod, mPLUG -2 Dalam 30 + tugasan berbilang/modal tunggal, ia mencapai hasil SOTA atau Setanding dengan volum data dan saiz model yang sama, dan mengatasi model yang sangat besar seperti Flamingo, VideoCoca dan GITv2 dalam VideoQA dan VideoCaption untuk mencapai SOTA mutlak. Di samping itu, mPLUG-Owl ialah karya terbaharu siri mPLUG Alibaba Damo Academy Ia meneruskan idea latihan modular siri mPLUG dan menaik taraf LLM menjadi model besar berbilang modal. Kertas penyelidikan mPLUG-2 telah diterima oleh ICML 2023.

Disyorkan: ICML 2023 Berdasarkan idea modular, Alibaba DAMO Academy mencadangkan model asas multi-modal mPLUG-2

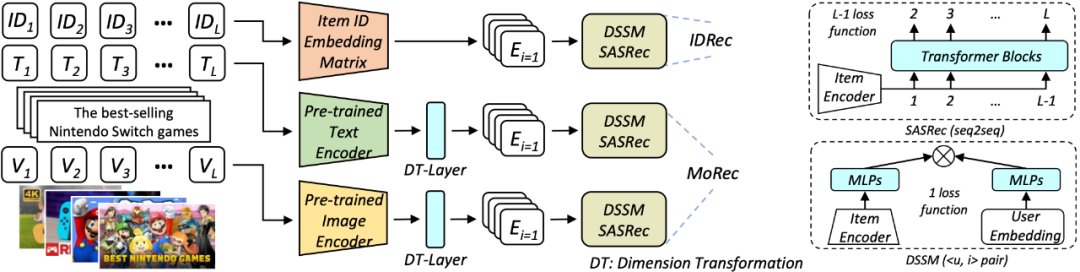

Kertas 7: Ke Mana Seterusnya untuk Sistem Pengesyoran - vs. Model Pengesyoran Berasaskan Modaliti Dilawati Semula

Abstrak: Kertas kerja ini menyiasat isu yang berpotensi, iaitu sama ada sistem pengesyoran pelbagai mod MoRec dijangka menamatkan penguasaan 10 tahun IDRec dalam bidang sistem pengesyoran kertas kerja menjalankan penyelidikan yang mendalam. Keputusan berkaitan telah diterima oleh SIGIR 2023. Rajah di bawah menunjukkan seni bina rangkaian.

Cadangan: SIGIR 2023 | ditumbangkan?

Atas ialah kandungan terperinci Buat alat anda sendiri untuk model besar seperti GPT-4 untuk mengenal pasti penipuan ChatGPT. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1377

1377

52

52

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Bayangkan model kecerdasan buatan yang bukan sahaja mempunyai keupayaan untuk mengatasi pengkomputeran tradisional, tetapi juga mencapai prestasi yang lebih cekap pada kos yang lebih rendah. Ini bukan fiksyen sains, DeepSeek-V2[1], model MoE sumber terbuka paling berkuasa di dunia ada di sini. DeepSeek-V2 ialah gabungan model bahasa pakar (MoE) yang berkuasa dengan ciri-ciri latihan ekonomi dan inferens yang cekap. Ia terdiri daripada 236B parameter, 21B daripadanya digunakan untuk mengaktifkan setiap penanda. Berbanding dengan DeepSeek67B, DeepSeek-V2 mempunyai prestasi yang lebih kukuh, sambil menjimatkan 42.5% kos latihan, mengurangkan cache KV sebanyak 93.3% dan meningkatkan daya pemprosesan penjanaan maksimum kepada 5.76 kali. DeepSeek ialah sebuah syarikat yang meneroka kecerdasan buatan am

Apr 09, 2024 am 11:52 AM

Apr 09, 2024 am 11:52 AM

AI memang mengubah matematik. Baru-baru ini, Tao Zhexuan, yang telah mengambil perhatian terhadap isu ini, telah memajukan keluaran terbaru "Buletin Persatuan Matematik Amerika" (Buletin Persatuan Matematik Amerika). Memfokuskan pada topik "Adakah mesin akan mengubah matematik?", ramai ahli matematik menyatakan pendapat mereka Seluruh proses itu penuh dengan percikan api, tegar dan menarik. Penulis mempunyai barisan yang kuat, termasuk pemenang Fields Medal Akshay Venkatesh, ahli matematik China Zheng Lejun, saintis komputer NYU Ernest Davis dan ramai lagi sarjana terkenal dalam industri. Dunia AI telah berubah secara mendadak Anda tahu, banyak artikel ini telah dihantar setahun yang lalu.

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas secara rasmi memasuki era robot elektrik! Semalam, Atlas hidraulik hanya "menangis" menarik diri daripada peringkat sejarah Hari ini, Boston Dynamics mengumumkan bahawa Atlas elektrik sedang berfungsi. Nampaknya dalam bidang robot humanoid komersial, Boston Dynamics berazam untuk bersaing dengan Tesla. Selepas video baharu itu dikeluarkan, ia telah pun ditonton oleh lebih sejuta orang dalam masa sepuluh jam sahaja. Orang lama pergi dan peranan baru muncul. Ini adalah keperluan sejarah. Tidak dinafikan bahawa tahun ini adalah tahun letupan robot humanoid. Netizen mengulas: Kemajuan robot telah menjadikan majlis pembukaan tahun ini kelihatan seperti manusia, dan tahap kebebasan adalah jauh lebih besar daripada manusia Tetapi adakah ini benar-benar bukan filem seram? Pada permulaan video, Atlas berbaring dengan tenang di atas tanah, seolah-olah terlentang. Apa yang berikut adalah rahang-jatuh

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

Awal bulan ini, penyelidik dari MIT dan institusi lain mencadangkan alternatif yang sangat menjanjikan kepada MLP - KAN. KAN mengatasi MLP dari segi ketepatan dan kebolehtafsiran. Dan ia boleh mengatasi prestasi MLP berjalan dengan bilangan parameter yang lebih besar dengan bilangan parameter yang sangat kecil. Sebagai contoh, penulis menyatakan bahawa mereka menggunakan KAN untuk menghasilkan semula keputusan DeepMind dengan rangkaian yang lebih kecil dan tahap automasi yang lebih tinggi. Khususnya, MLP DeepMind mempunyai kira-kira 300,000 parameter, manakala KAN hanya mempunyai kira-kira 200 parameter. KAN mempunyai asas matematik yang kukuh seperti MLP berdasarkan teorem penghampiran universal, manakala KAN berdasarkan teorem perwakilan Kolmogorov-Arnold. Seperti yang ditunjukkan dalam rajah di bawah, KAN telah

Google gembira: prestasi JAX mengatasi Pytorch dan TensorFlow! Ia mungkin menjadi pilihan terpantas untuk latihan inferens GPU

Apr 01, 2024 pm 07:46 PM

Google gembira: prestasi JAX mengatasi Pytorch dan TensorFlow! Ia mungkin menjadi pilihan terpantas untuk latihan inferens GPU

Apr 01, 2024 pm 07:46 PM

Prestasi JAX, yang dipromosikan oleh Google, telah mengatasi Pytorch dan TensorFlow dalam ujian penanda aras baru-baru ini, menduduki tempat pertama dalam 7 penunjuk. Dan ujian tidak dilakukan pada TPU dengan prestasi JAX terbaik. Walaupun dalam kalangan pembangun, Pytorch masih lebih popular daripada Tensorflow. Tetapi pada masa hadapan, mungkin lebih banyak model besar akan dilatih dan dijalankan berdasarkan platform JAX. Model Baru-baru ini, pasukan Keras menanda aras tiga hujung belakang (TensorFlow, JAX, PyTorch) dengan pelaksanaan PyTorch asli dan Keras2 dengan TensorFlow. Pertama, mereka memilih satu set arus perdana

Robot Tesla bekerja di kilang, Musk: Tahap kebebasan tangan akan mencapai 22 tahun ini!

May 06, 2024 pm 04:13 PM

Robot Tesla bekerja di kilang, Musk: Tahap kebebasan tangan akan mencapai 22 tahun ini!

May 06, 2024 pm 04:13 PM

Video terbaru robot Tesla Optimus dikeluarkan, dan ia sudah boleh berfungsi di kilang. Pada kelajuan biasa, ia mengisih bateri (bateri 4680 Tesla) seperti ini: Pegawai itu juga mengeluarkan rupanya pada kelajuan 20x - pada "stesen kerja" kecil, memilih dan memilih dan memilih: Kali ini ia dikeluarkan Salah satu sorotan video itu ialah Optimus menyelesaikan kerja ini di kilang, sepenuhnya secara autonomi, tanpa campur tangan manusia sepanjang proses. Dan dari perspektif Optimus, ia juga boleh mengambil dan meletakkan bateri yang bengkok, memfokuskan pada pembetulan ralat automatik: Berkenaan tangan Optimus, saintis NVIDIA Jim Fan memberikan penilaian yang tinggi: Tangan Optimus adalah robot lima jari di dunia paling cerdik. Tangannya bukan sahaja boleh disentuh

FisheyeDetNet: algoritma pengesanan sasaran pertama berdasarkan kamera fisheye

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: algoritma pengesanan sasaran pertama berdasarkan kamera fisheye

Apr 26, 2024 am 11:37 AM

Pengesanan objek ialah masalah yang agak matang dalam sistem pemanduan autonomi, antaranya pengesanan pejalan kaki adalah salah satu algoritma terawal untuk digunakan. Penyelidikan yang sangat komprehensif telah dijalankan dalam kebanyakan kertas kerja. Walau bagaimanapun, persepsi jarak menggunakan kamera fisheye untuk pandangan sekeliling agak kurang dikaji. Disebabkan herotan jejari yang besar, perwakilan kotak sempadan standard sukar dilaksanakan dalam kamera fisheye. Untuk mengurangkan perihalan di atas, kami meneroka kotak sempadan lanjutan, elips dan reka bentuk poligon am ke dalam perwakilan kutub/sudut dan mentakrifkan metrik mIOU pembahagian contoh untuk menganalisis perwakilan ini. Model fisheyeDetNet yang dicadangkan dengan bentuk poligon mengatasi model lain dan pada masa yang sama mencapai 49.5% mAP pada set data kamera fisheye Valeo untuk pemanduan autonomi

DualBEV: mengatasi BEVFormer dan BEVDet4D dengan ketara, buka buku!

Mar 21, 2024 pm 05:21 PM

DualBEV: mengatasi BEVFormer dan BEVDet4D dengan ketara, buka buku!

Mar 21, 2024 pm 05:21 PM

Kertas kerja ini meneroka masalah mengesan objek dengan tepat dari sudut pandangan yang berbeza (seperti perspektif dan pandangan mata burung) dalam pemanduan autonomi, terutamanya cara mengubah ciri dari perspektif (PV) kepada ruang pandangan mata burung (BEV) dengan berkesan dilaksanakan melalui modul Transformasi Visual (VT). Kaedah sedia ada secara amnya dibahagikan kepada dua strategi: penukaran 2D kepada 3D dan 3D kepada 2D. Kaedah 2D-ke-3D meningkatkan ciri 2D yang padat dengan meramalkan kebarangkalian kedalaman, tetapi ketidakpastian yang wujud dalam ramalan kedalaman, terutamanya di kawasan yang jauh, mungkin menimbulkan ketidaktepatan. Manakala kaedah 3D ke 2D biasanya menggunakan pertanyaan 3D untuk mencuba ciri 2D dan mempelajari berat perhatian bagi kesesuaian antara ciri 3D dan 2D melalui Transformer, yang meningkatkan masa pengiraan dan penggunaan.