Peranti teknologi

Peranti teknologi

AI

AI

'Meletakkan' model parameter 33 bilion yang besar ke dalam GPU gred pengguna tunggal, mempercepatkan 15% tanpa mengorbankan prestasi

'Meletakkan' model parameter 33 bilion yang besar ke dalam GPU gred pengguna tunggal, mempercepatkan 15% tanpa mengorbankan prestasi

'Meletakkan' model parameter 33 bilion yang besar ke dalam GPU gred pengguna tunggal, mempercepatkan 15% tanpa mengorbankan prestasi

Prestasi model bahasa besar yang telah dilatih (LLM) pada tugasan tertentu terus bertambah baik Selepas itu, jika arahan segera sesuai, ia boleh digeneralisasikan dengan lebih baik kepada lebih banyak tugasan kepada peningkatan dalam data latihan dan parameter Walau bagaimanapun, trend terkini menunjukkan bahawa penyelidik lebih memfokuskan pada model yang lebih kecil, tetapi model ini dilatih pada lebih banyak data dan oleh itu lebih mudah untuk digunakan.

Sebagai contoh, LLaMA dengan saiz parameter 7B dilatih pada token 1T Walaupun prestasi purata lebih rendah sedikit daripada GPT-3, saiz parameter ialah 1/25 daripada yang terakhir . Bukan itu sahaja, tetapi teknologi pemampatan semasa boleh memampatkan lagi model ini, dengan ketara mengurangkan keperluan memori sambil mengekalkan prestasi. Dengan penambahbaikan sedemikian, model yang berprestasi baik boleh digunakan pada peranti pengguna akhir seperti komputer riba.

Walau bagaimanapun, ini menghadapi satu lagi cabaran, iaitu cara memampatkan model ini kepada saiz yang cukup kecil agar sesuai dengan peranti ini, sambil mengambil kira kualiti penjanaan. Penyelidikan menunjukkan bahawa walaupun model dimampatkan menjana jawapan dengan ketepatan yang boleh diterima, teknik pengkuantitian 3-4-bit sedia ada masih merendahkan ketepatan. Memandangkan penjanaan LLM dilakukan secara berurutan dan bergantung pada token yang dijana sebelum ini, ralat relatif kecil terkumpul dan membawa kepada rasuah keluaran yang teruk. Untuk memastikan kualiti yang boleh dipercayai, adalah penting untuk mereka bentuk kaedah pengkuantitian lebar bit rendah yang tidak merendahkan prestasi ramalan berbanding model 16-bit.

Walau bagaimanapun, mengkuantifikasi setiap parameter kepada 3-4 bit selalunya mengakibatkan kehilangan ketepatan yang sederhana atau tinggi, terutamanya 1-10B yang sangat sesuai untuk penggunaan tepi Model yang lebih kecil dalam julat parameter.

Untuk menyelesaikan masalah ketepatan, penyelidik dari University of Washington, ETH Zurich dan institusi lain mencadangkan format mampatan baharu dan teknologi pengkuantitian SpQR (Sparse-Quantized Representation, sparse - quantified representasi), mencapai pemampatan hampir-lossless LLM merentas skala model buat kali pertama sambil mencapai tahap mampatan yang serupa dengan kaedah sebelumnya.

SpQR berfungsi dengan mengenal pasti dan mengasingkan pemberat anomali yang menyebabkan ralat pengkuantitian yang sangat besar, menyimpannya dengan ketepatan yang lebih tinggi sambil memampatkan semua pemberat lain Ke kedudukan 3-4, kurang daripada 1% ketepatan relatif kebingungan kerugian dicapai dalam LLaMA dan Falcon LLM. Ini membolehkan LLM parameter 33B dijalankan pada satu GPU pengguna 24GB tanpa sebarang penurunan prestasi sambil 15% lebih pantas.

Algoritma SpQR adalah cekap dan boleh mengekod pemberat ke dalam format lain dan menyahkodnya dengan cekap semasa masa jalan. Secara khusus, penyelidikan ini menyediakan SpQR dengan algoritma inferens GPU yang cekap yang membolehkan inferens lebih pantas daripada model garis dasar 16-bit sambil mencapai lebih 4x keuntungan mampatan memori.

- Alamat kertas: https://arxiv.org/pdf/2306.03078.pdf

- Alamat projek: https://github.com/Vahe1994/SpQR

Kaedah

Penyelidikan ini mencadangkan format baharu pengkuantitian jarang hibrid - Perwakilan Kuantiti Jarang (SpQR), yang boleh memampatkan LLM pra-latihan dengan tepat kepada 3-4 bit setiap parameter sambil kekal hampir tanpa kerugian.

Secara khusus, kajian membahagikan keseluruhan proses kepada dua langkah. Langkah pertama ialah pengesanan outlier: kajian mula-mula mengasingkan pemberat terpencil dan menunjukkan bahawa pengkuantitian mereka membawa kepada ralat yang tinggi: pemberat terpencil kekal dengan ketepatan tinggi, manakala pemberat lain disimpan dengan ketepatan rendah (mis. dalam format 3-bit). Kajian kemudiannya melaksanakan varian pengkuantitian berkumpulan dengan saiz kumpulan yang sangat kecil dan menunjukkan bahawa skala pengkuantitian itu sendiri boleh dikuantisasi menjadi perwakilan 3-bit.

SpQR sangat mengurangkan jejak memori LLM tanpa mengorbankan ketepatan, sambil menghasilkan LLM 20%-30% lebih pantas berbanding inferens 16-bit.

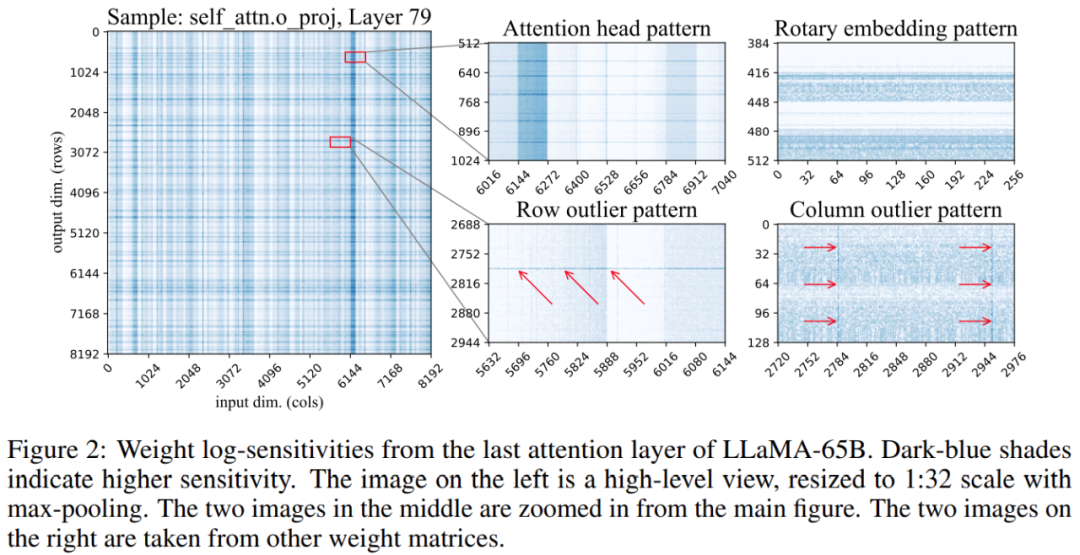

Tambahan pula, kajian mendapati kedudukan pemberat sensitif dalam matriks berat tidak rawak tetapi mempunyai struktur tertentu. Untuk menyerlahkan strukturnya semasa kuantifikasi, kajian mengira sensitiviti setiap berat dan memvisualisasikan sensitiviti berat ini untuk model LLaMA-65B. Rajah 2 di bawah menggambarkan unjuran keluaran lapisan perhatian diri terakhir LLaMA-65B.

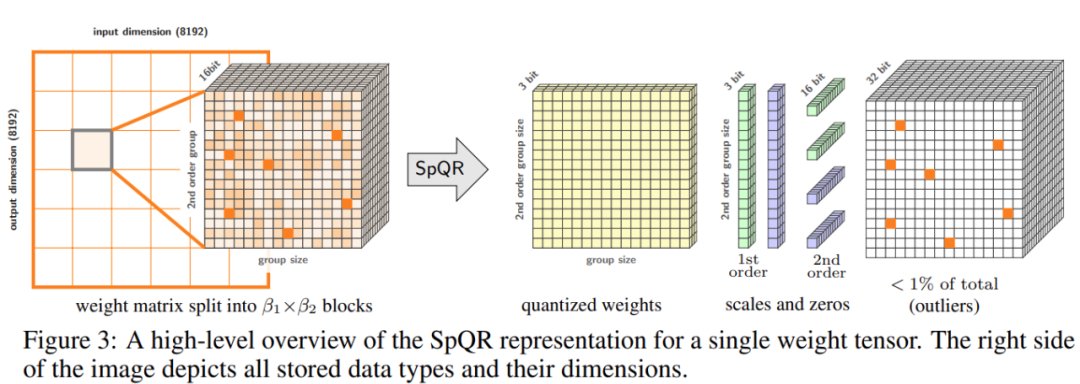

Kajian ini membuat dua perubahan pada proses kuantifikasi: satu untuk menangkap kumpulan berat sensitif yang kecil Digunakan untuk menangkap outlier individu . Rajah 3 di bawah menunjukkan seni bina keseluruhan SpQR:

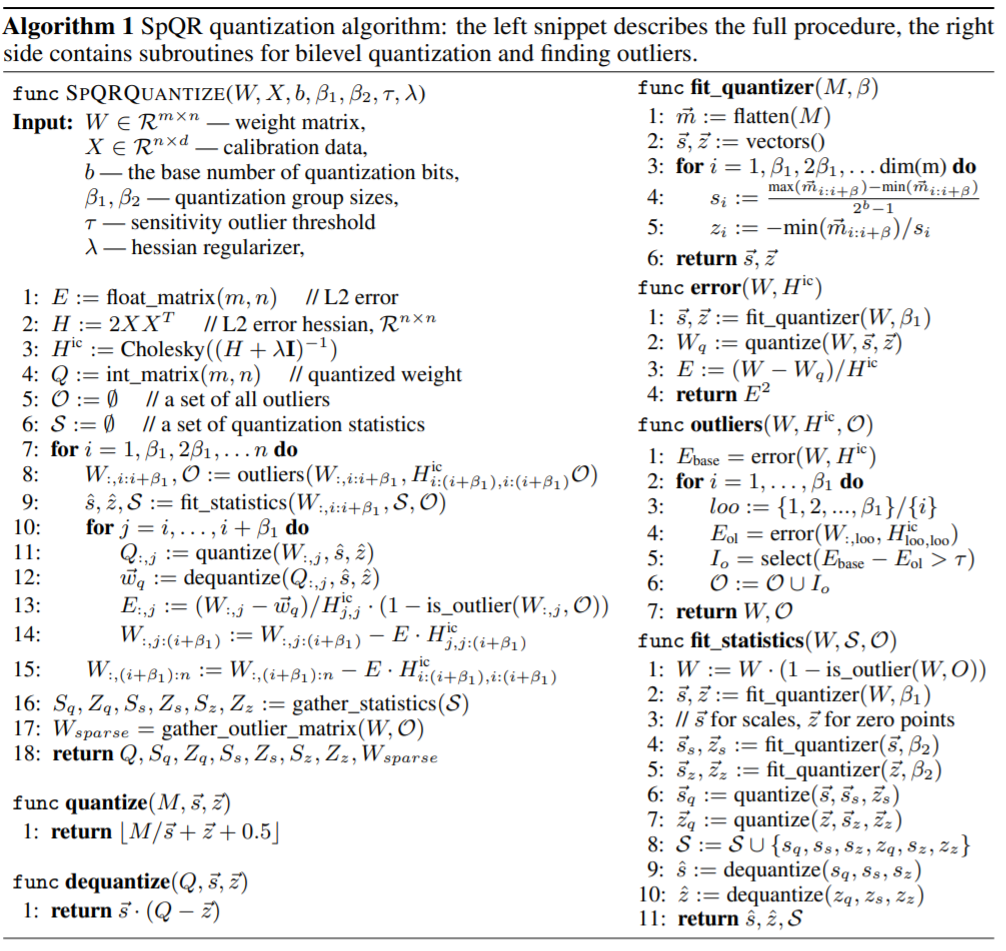

Jadual berikut menunjukkan algoritma pengkuantitian SpQR, dan serpihan kod di sebelah kiri menerangkan keseluruhan proses, coretan kod di sebelah kanan mengandungi subrutin untuk kuantifikasi sekunder dan mencari outlier:

Kajian ini akan SpQR dibandingkan dengan dua skim pengkuantitian lain: GPTQ, RTN (pembundaran-ke-terdekat), dan dua metrik digunakan untuk menilai prestasi model pengkuantitian. Yang pertama ialah pengukuran kebingungan, menggunakan set data termasuk WikiText2, Penn Treebank dan C4 yang kedua ialah ketepatan sampel sifar pada lima tugas: WinoGrande, PiQA, HellaSwag, ARC-easy, ARC-challenge;

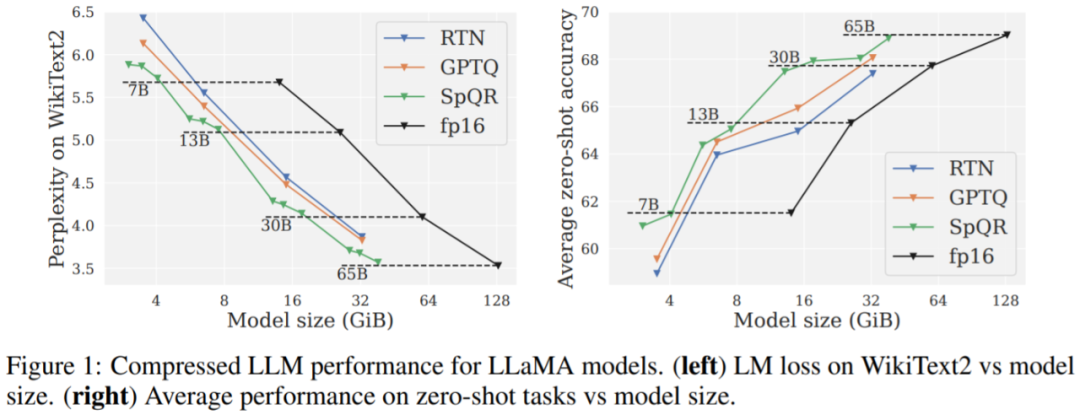

Hasil utama. Keputusan Rajah 1 menunjukkan bahawa pada saiz model yang serupa, SpQR menunjukkan prestasi yang lebih baik daripada GPTQ (dan RTN yang sepadan), terutamanya pada model yang lebih kecil. Penambahbaikan ini disebabkan oleh SpQR mencapai lebih banyak pemampatan di samping mengurangkan degradasi kerugian.

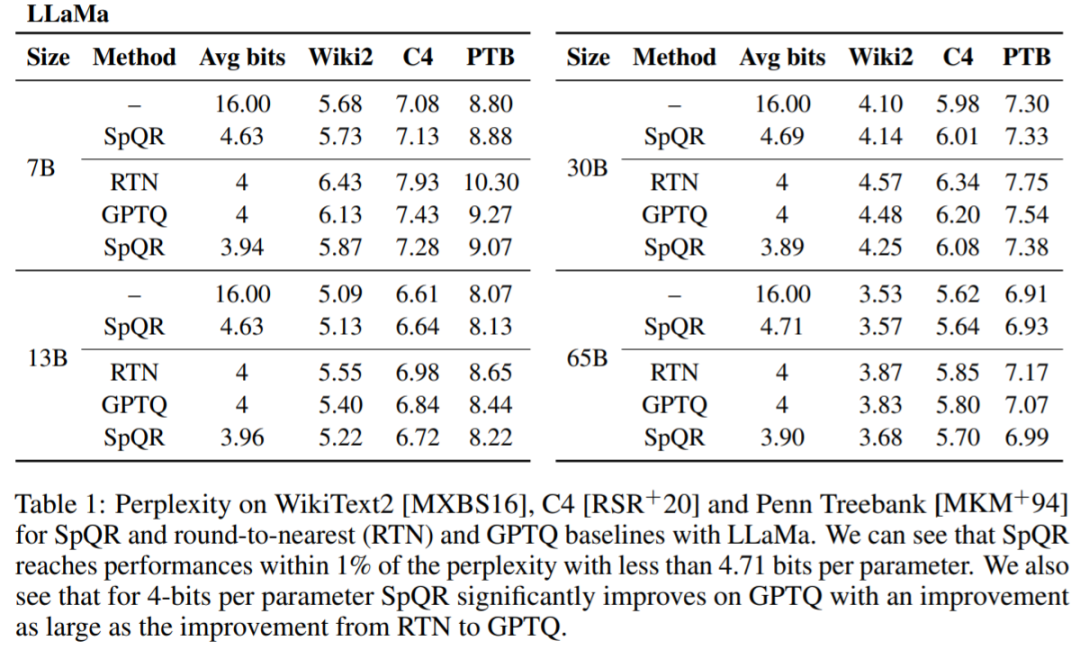

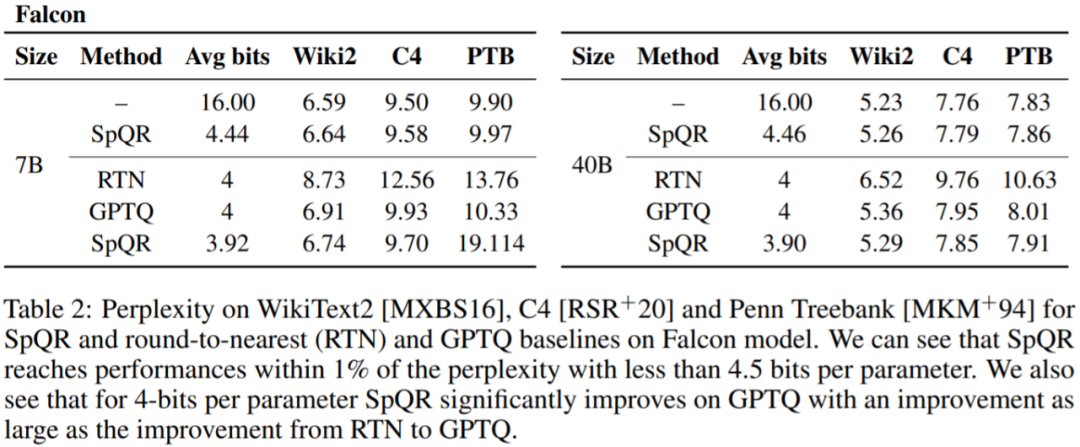

Jadual 1, Jadual 2 Keputusan menunjukkan bahawa untuk pengkuantitian 4-bit, ralat SpQR berbanding garis dasar 16-bit dibahagi dua berbanding kepada GPTQ.

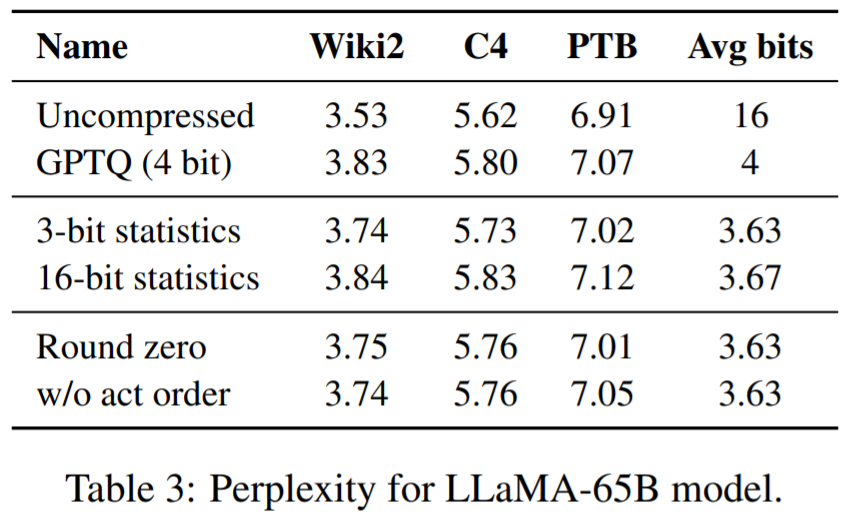

Jadual 3 melaporkan model LLaMA-65B Kekeliruan terhasil pada set data yang berbeza.

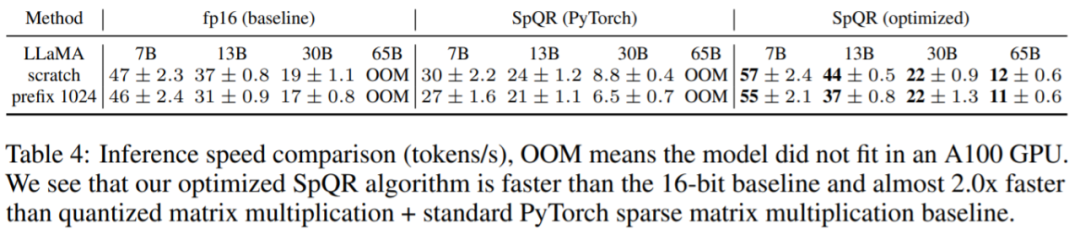

Akhir sekali, kajian menilai kelajuan inferens SpQR. Kajian ini membandingkan algoritma pendaraban matriks jarang yang direka khas dengan algoritma yang dilaksanakan dalam PyTorch (cuSPARSE), dan hasilnya ditunjukkan dalam Jadual 4. Seperti yang anda lihat, walaupun pendaraban matriks jarang standard dalam PyTorch tidak lebih pantas daripada inferens 16-bit, algoritma pendaraban matriks jarang yang direka khas dalam artikel ini boleh meningkatkan kelajuan sebanyak kira-kira 20-30%.

Atas ialah kandungan terperinci 'Meletakkan' model parameter 33 bilion yang besar ke dalam GPU gred pengguna tunggal, mempercepatkan 15% tanpa mengorbankan prestasi. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1374

1374

52

52

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Bayangkan model kecerdasan buatan yang bukan sahaja mempunyai keupayaan untuk mengatasi pengkomputeran tradisional, tetapi juga mencapai prestasi yang lebih cekap pada kos yang lebih rendah. Ini bukan fiksyen sains, DeepSeek-V2[1], model MoE sumber terbuka paling berkuasa di dunia ada di sini. DeepSeek-V2 ialah gabungan model bahasa pakar (MoE) yang berkuasa dengan ciri-ciri latihan ekonomi dan inferens yang cekap. Ia terdiri daripada 236B parameter, 21B daripadanya digunakan untuk mengaktifkan setiap penanda. Berbanding dengan DeepSeek67B, DeepSeek-V2 mempunyai prestasi yang lebih kukuh, sambil menjimatkan 42.5% kos latihan, mengurangkan cache KV sebanyak 93.3% dan meningkatkan daya pemprosesan penjanaan maksimum kepada 5.76 kali. DeepSeek ialah sebuah syarikat yang meneroka kecerdasan buatan am

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

Awal bulan ini, penyelidik dari MIT dan institusi lain mencadangkan alternatif yang sangat menjanjikan kepada MLP - KAN. KAN mengatasi MLP dari segi ketepatan dan kebolehtafsiran. Dan ia boleh mengatasi prestasi MLP berjalan dengan bilangan parameter yang lebih besar dengan bilangan parameter yang sangat kecil. Sebagai contoh, penulis menyatakan bahawa mereka menggunakan KAN untuk menghasilkan semula keputusan DeepMind dengan rangkaian yang lebih kecil dan tahap automasi yang lebih tinggi. Khususnya, MLP DeepMind mempunyai kira-kira 300,000 parameter, manakala KAN hanya mempunyai kira-kira 200 parameter. KAN mempunyai asas matematik yang kukuh seperti MLP berdasarkan teorem penghampiran universal, manakala KAN berdasarkan teorem perwakilan Kolmogorov-Arnold. Seperti yang ditunjukkan dalam rajah di bawah, KAN telah

Robot Tesla bekerja di kilang, Musk: Tahap kebebasan tangan akan mencapai 22 tahun ini!

May 06, 2024 pm 04:13 PM

Robot Tesla bekerja di kilang, Musk: Tahap kebebasan tangan akan mencapai 22 tahun ini!

May 06, 2024 pm 04:13 PM

Video terbaru robot Tesla Optimus dikeluarkan, dan ia sudah boleh berfungsi di kilang. Pada kelajuan biasa, ia mengisih bateri (bateri 4680 Tesla) seperti ini: Pegawai itu juga mengeluarkan rupanya pada kelajuan 20x - pada "stesen kerja" kecil, memilih dan memilih dan memilih: Kali ini ia dikeluarkan Salah satu sorotan video itu ialah Optimus menyelesaikan kerja ini di kilang, sepenuhnya secara autonomi, tanpa campur tangan manusia sepanjang proses. Dan dari perspektif Optimus, ia juga boleh mengambil dan meletakkan bateri yang bengkok, memfokuskan pada pembetulan ralat automatik: Berkenaan tangan Optimus, saintis NVIDIA Jim Fan memberikan penilaian yang tinggi: Tangan Optimus adalah robot lima jari di dunia paling cerdik. Tangannya bukan sahaja boleh disentuh

Tiada data OpenAI diperlukan, sertai senarai model kod besar! UIUC mengeluarkan StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

Tiada data OpenAI diperlukan, sertai senarai model kod besar! UIUC mengeluarkan StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

Di barisan hadapan teknologi perisian, kumpulan UIUC Zhang Lingming, bersama penyelidik dari organisasi BigCode, baru-baru ini mengumumkan model kod besar StarCoder2-15B-Instruct. Pencapaian inovatif ini mencapai kejayaan ketara dalam tugas penjanaan kod, berjaya mengatasi CodeLlama-70B-Instruct dan mencapai bahagian atas senarai prestasi penjanaan kod. Keunikan StarCoder2-15B-Instruct terletak pada strategi penjajaran diri yang tulen Keseluruhan proses latihan adalah terbuka, telus, dan sepenuhnya autonomi dan boleh dikawal. Model ini menjana beribu-ribu arahan melalui StarCoder2-15B sebagai tindak balas kepada penalaan halus model asas StarCoder-15B tanpa bergantung pada anotasi manual yang mahal.

Melebihi DPO secara menyeluruh: Pasukan Chen Danqi mencadangkan pengoptimuman pilihan mudah SimPO, dan turut memperhalusi model sumber terbuka 8B terkuat

Jun 01, 2024 pm 04:41 PM

Melebihi DPO secara menyeluruh: Pasukan Chen Danqi mencadangkan pengoptimuman pilihan mudah SimPO, dan turut memperhalusi model sumber terbuka 8B terkuat

Jun 01, 2024 pm 04:41 PM

Untuk menyelaraskan model bahasa besar (LLM) dengan nilai dan niat manusia, adalah penting untuk mempelajari maklum balas manusia untuk memastikan bahawa ia berguna, jujur dan tidak berbahaya. Dari segi penjajaran LLM, kaedah yang berkesan ialah pembelajaran pengukuhan berdasarkan maklum balas manusia (RLHF). Walaupun keputusan kaedah RLHF adalah cemerlang, terdapat beberapa cabaran pengoptimuman yang terlibat. Ini melibatkan latihan model ganjaran dan kemudian mengoptimumkan model dasar untuk memaksimumkan ganjaran tersebut. Baru-baru ini, beberapa penyelidik telah meneroka algoritma luar talian yang lebih mudah, salah satunya ialah pengoptimuman keutamaan langsung (DPO). DPO mempelajari model dasar secara langsung berdasarkan data keutamaan dengan meparameterkan fungsi ganjaran dalam RLHF, sekali gus menghapuskan keperluan untuk model ganjaran yang jelas. Kaedah ini mudah dan stabil

Yolov10: Penjelasan terperinci, penggunaan dan aplikasi semuanya di satu tempat!

Jun 07, 2024 pm 12:05 PM

Yolov10: Penjelasan terperinci, penggunaan dan aplikasi semuanya di satu tempat!

Jun 07, 2024 pm 12:05 PM

1. Pengenalan Sejak beberapa tahun kebelakangan ini, YOLO telah menjadi paradigma dominan dalam bidang pengesanan objek masa nyata kerana keseimbangannya yang berkesan antara kos pengiraan dan prestasi pengesanan. Penyelidik telah meneroka reka bentuk seni bina YOLO, matlamat pengoptimuman, strategi pengembangan data, dsb., dan telah mencapai kemajuan yang ketara. Pada masa yang sama, bergantung pada penindasan bukan maksimum (NMS) untuk pemprosesan pasca menghalang penggunaan YOLO dari hujung ke hujung dan memberi kesan buruk kepada kependaman inferens. Dalam YOLO, reka bentuk pelbagai komponen tidak mempunyai pemeriksaan yang komprehensif dan teliti, mengakibatkan lebihan pengiraan yang ketara dan mengehadkan keupayaan model. Ia menawarkan kecekapan suboptimum, dan potensi yang agak besar untuk peningkatan prestasi. Dalam kerja ini, matlamatnya adalah untuk meningkatkan lagi sempadan kecekapan prestasi YOLO daripada kedua-dua pasca pemprosesan dan seni bina model. sampai habis

Perbandingan prestasi rangka kerja Java yang berbeza

Jun 05, 2024 pm 07:14 PM

Perbandingan prestasi rangka kerja Java yang berbeza

Jun 05, 2024 pm 07:14 PM

Perbandingan prestasi rangka kerja Java yang berbeza: Pemprosesan permintaan REST API: Vert.x adalah yang terbaik, dengan kadar permintaan 2 kali SpringBoot dan 3 kali Dropwizard. Pertanyaan pangkalan data: HibernateORM SpringBoot adalah lebih baik daripada Vert.x dan ORM Dropwizard. Operasi caching: Pelanggan Hazelcast Vert.x lebih unggul daripada mekanisme caching SpringBoot dan Dropwizard. Rangka kerja yang sesuai: Pilih mengikut keperluan aplikasi Vert.x sesuai untuk perkhidmatan web berprestasi tinggi, SpringBoot sesuai untuk aplikasi intensif data, dan Dropwizard sesuai untuk seni bina perkhidmatan mikro.

Li Feifei mendedahkan hala tuju keusahawanan 'kecerdasan ruang': visualisasi bertukar menjadi wawasan, melihat menjadi pemahaman, dan pemahaman membawa kepada tindakan

Jun 01, 2024 pm 02:55 PM

Li Feifei mendedahkan hala tuju keusahawanan 'kecerdasan ruang': visualisasi bertukar menjadi wawasan, melihat menjadi pemahaman, dan pemahaman membawa kepada tindakan

Jun 01, 2024 pm 02:55 PM

Stanford Li Feifei memperkenalkan konsep baharu "kecerdasan ruang" buat kali pertama selepas memulakan perniagaannya sendiri. Ini bukan sahaja hala tuju keusahawanannya, tetapi juga "Bintang Utara" yang membimbingnya "bahagian teka-teki utama untuk menyelesaikan masalah kecerdasan buatan." Visualisasi membawa kepada pandangan; melihat membawa kepada pemahaman; Berdasarkan ceramah TED selama 15 minit Li Feifei, ia didedahkan sepenuhnya, bermula dari asal-usul evolusi kehidupan beratus-ratus juta tahun yang lalu, kepada bagaimana manusia tidak berpuas hati dengan apa yang telah diberikan oleh alam semula jadi kepada mereka dan membangunkan kecerdasan buatan, kepada bagaimana untuk membina. kecerdasan ruang dalam langkah seterusnya. Sembilan tahun yang lalu, Li Feifei memperkenalkan ImageNet yang baru dilahirkan kepada dunia di peringkat yang sama - salah satu titik permulaan untuk pusingan ledakan pembelajaran mendalam ini. Dia sendiri juga menggalakkan netizen: Jika anda menonton kedua-dua video, anda akan dapat memahami visi komputer selama 10 tahun yang lalu.