Peranti teknologi

Peranti teknologi

AI

AI

Perbualan terbaru antara Ng Enda dan Hinton! AI bukan burung nuri rawak, konsensus mengatasi segala-galanya, LeCun bersetuju dengan kedua-dua tangan

Perbualan terbaru antara Ng Enda dan Hinton! AI bukan burung nuri rawak, konsensus mengatasi segala-galanya, LeCun bersetuju dengan kedua-dua tangan

Perbualan terbaru antara Ng Enda dan Hinton! AI bukan burung nuri rawak, konsensus mengatasi segala-galanya, LeCun bersetuju dengan kedua-dua tangan

Baru-baru ini, keselamatan AI telah menjadi topik yang sangat popular.

AI "Godfather" Geoffrey Hinton dan Andrew Ng berbual secara mendalam tentang kecerdasan buatan dan risiko bencana.

Enda Ng menyiarkan mesej hari ini untuk berkongsi pemikiran bersama mereka:

- Adalah penting bagi saintis AI untuk mencapai kata sepakat tentang risiko. Sama seperti saintis iklim, mereka mempunyai konsensus umum mengenai perubahan iklim dan seterusnya boleh merumuskan dasar yang baik.

- Adakah model kecerdasan buatan memahami dunia? Jawapan kami ialah ya. Jika kita menyenaraikan isu teknikal utama ini dan membangunkan pandangan yang sama, ia akan membantu memajukan konsensus manusia tentang risiko.

Hinton berkata,

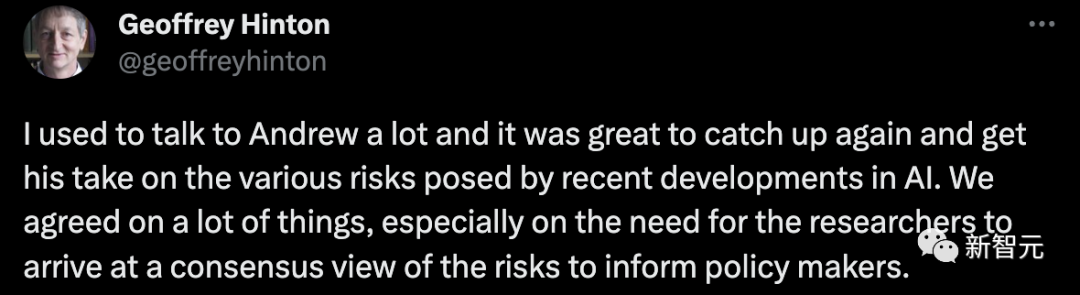

Saya sering berkomunikasi dengan Andrew Ng, dan saya sangat gembira bertemu dengannya semula dan memahami kesannya terhadap perkembangan terkini kecerdasan buatan Datang untuk melihat pelbagai risiko. Kami mencapai konsensus dalam banyak aspek, khususnya, keperluan untuk penyelidik membangunkan pemahaman umum tentang risiko apabila melaporkan kepada pembuat dasar.

Sebelum ini, Andrew Ng juga pernah berbual dengan Yoshua Bengio tentang risiko kecerdasan buatan.

Konsensus yang mereka capai adalah untuk menjelaskan senario tertentu di mana AI mungkin menimbulkan risiko yang ketara.

Seterusnya, mari kita lihat perkara yang dibincangkan secara terperinci oleh dua taikun AI.

Konsensus diperlukan segera!

Pertama sekali, Hinton mencadangkan perkara yang paling penting ialah muafakat.

Beliau berkata bahawa seluruh komuniti AI pada masa ini tidak mempunyai konsensus bersatu. Sama seperti ahli sains iklim bersetuju, saintis AI juga diperlukan.

Pada pandangan Hinton, sebab mengapa kita memerlukan konsensus adalah kerana jika tidak ada, setiap saintis AI mempunyai pendapat sendiri, maka kerajaan dan pembuat dasar boleh mengikutinya sesuka hati. Pilih sudut pandangan yang menjadi panduan untuk kepentingan diri anda sendiri.

Ini jelas akan kehilangan keadilan.

Berdasarkan situasi semasa, pendapat yang berbeza dalam kalangan saintis AI sangat berbeza.

Hinton percaya bahawa jika situasi di mana kita mempunyai pendapat berbeza dapat berlalu dengan cepat, semua orang boleh mencapai persetujuan, bersama-sama menerima beberapa ancaman utama yang mungkin dibawa oleh AI, dan merealisasikan peraturan AI.

Enda Ng bersetuju dengan pandangan Hinton.

Walaupun dia masih tidak merasakan bahawa industri AI sangat dibezakan sehingga terbahagi, ia nampaknya perlahan-lahan berkembang ke arah itu.

Pandangan dalam komuniti AI arus perdana sangat terpolarisasi, dan setiap kem tidak berusaha untuk menyatakan tuntutannya. Namun, pada pandangan Ng, ungkapan ini lebih kepada pertengkaran daripada dialog yang harmoni.

Sudah tentu, Andrew Ng masih mempunyai sedikit keyakinan terhadap komuniti AI. Beliau berharap kita dapat mencari konsensus bersama-sama dan mengadakan dialog yang sewajarnya, supaya kita dapat membantu penggubal dasar merumuskan dengan lebih baik. rancangan yang berkaitan.

Seterusnya, Hinton bercakap tentang satu lagi isu utama, yang juga merupakan sebab mengapa beliau berpendapat sukar bagi saintis AI untuk mencapai kata sepakat pada masa ini - robot sembang seperti GPT-4 dan Bard , Adakah anda faham perkataan yang mereka jana sendiri?

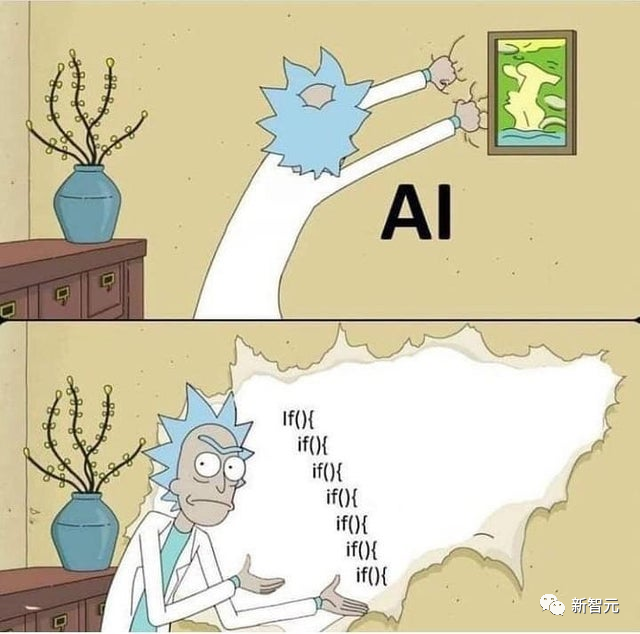

Sesetengah orang menganggap AI faham, sesetengah orang menganggap mereka tidak faham dan hanya burung kakak tua secara rawak.

Hinton percaya bahawa selagi perbezaan ini masih wujud, adalah sukar bagi komuniti AI untuk mencapai kata sepakat. Justeru, beliau percaya keutamaan utama adalah untuk menjelaskan isu ini.

Sudah tentu, setakat yang dia bimbang, dia pasti berpendapat bahawa AI faham, dan AI bukan hanya mengenai statistik.

Beliau juga menyebut bahawa saintis terkenal seperti Yan LeCun percaya bahawa AI tidak dapat memahami.

Ini menyerlahkan kepentingan perdamaian dan kejelasan tentang isu ini.

Ng Enda berkata bahawa tidak mudah untuk menilai sama ada AI boleh memahami, kerana nampaknya tidak ada standard atau sejenis ujian.

Pandangannya sendiri ialah dia percaya sama ada LLM atau model AI besar yang lain, semuanya sedang membina model dunia. Dan AI mungkin mempunyai sedikit pemahaman dalam proses itu.

Sudah tentu, dia berkata ini hanya pandangan semasanya.

Selain itu, beliau bersetuju dengan Hinton bahawa penyelidik mesti mencapai persetujuan terlebih dahulu mengenai isu ini sebelum mereka boleh terus bercakap tentang risiko dan krisis yang menyusul.

Hinton seterusnya berkata bahawa AI menilai dan meramalkan penjanaan perkataan seterusnya berdasarkan pangkalan data berdasarkan perkataan sebelumnya. Ini adalah sejenis pemahaman di mata Hinton.

Dia percaya bahawa ini sebenarnya tidak jauh berbeza dengan mekanisme pemikiran otak manusia kita.

Sudah tentu, sama ada ia dikira sebagai pemahaman memerlukan perbincangan lanjut, tetapi sekurang-kurangnya ia tidak semudah burung nuri rawak.

Enda Ng percaya bahawa terdapat beberapa isu yang akan menyebabkan orang yang mempunyai pandangan berbeza membuat kesimpulan berbeza, malah mencadangkan AI akan menghapuskan manusia.

Beliau berkata untuk memahami AI dengan lebih baik, kita perlu mengetahui lebih lanjut dan membincangkan lebih lanjut.

Dengan cara ini, kita boleh membina komuniti AI dengan konsensus yang luas.

LeCun bersetuju dengan kedua-dua belah pihak dan menyebut "model dunia" sekali lagi

Beberapa ketika dahulu, ketika dunia menyeru agar moratorium penyelidikan dan pembangunan AI super, Andrew Ng dan LeCun mengadakan siaran langsung untuk membincangkan topik yang dibincangkan ini.

Adalah salah jika mereka turut menentang moratorium AI semasa kereta dicipta dahulu tiada tali pinggang keledar dan lampu isyarat, kecerdasan buatan Tiada perbezaan asas daripada kemajuan teknologi sebelumnya.

Kali ini, LeCun sekali lagi mencadangkan "model dunia"nya mengenai perbualan Ng dengan Hinton, dan bagaimana kecerdasan buatan semasa tidak sebaik kucing dan anjing.

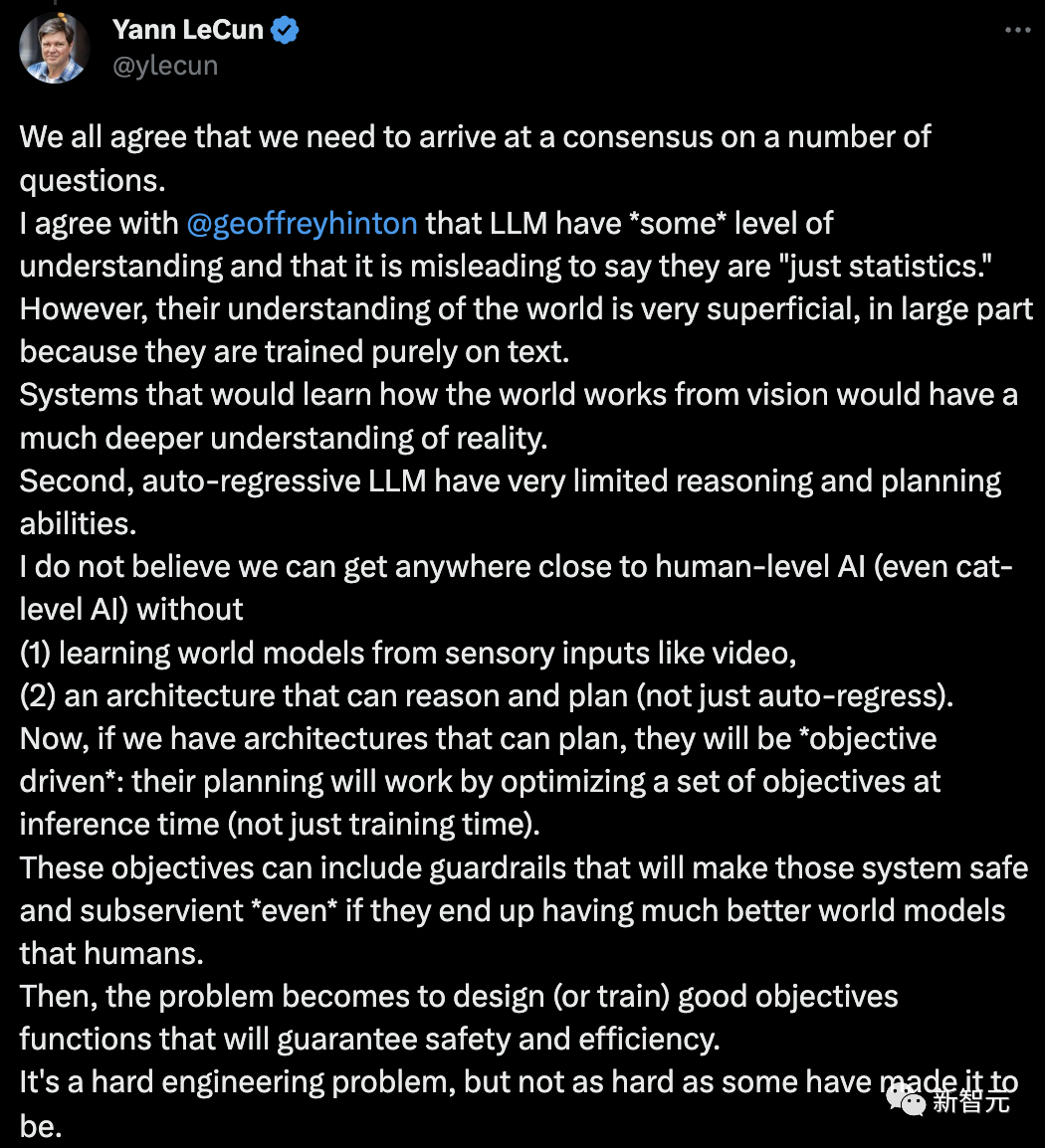

Kita semua bersetuju bahawa kita perlu bersetuju dalam beberapa isu.

Saya bersetuju dengan Geoffrey Hinton bahawa LLM mempunyai "sedikit tahap" kefahaman dan bahawa memanggil mereka "hanya statistik" adalah mengelirukan.

Pemahaman LLM tentang dunia adalah sangat dangkal, sebahagian besarnya kerana mereka dilatih secara teks semata-mata.

Sistem yang mempelajari cara dunia berfungsi daripada penglihatan akan memberikan pemahaman yang lebih mendalam tentang realiti. Kedua, keupayaan penaakulan dan perancangan LLM autoregresif adalah sangat terhad.

Saya berpendapat bahawa tanpa (1) mempelajari "model dunia" daripada input deria seperti video, (2) seni bina yang mampu menaakul dan merancang (bukan hanya autoregresif), tidak ada cara kita akan mendekati AI peringkat manusia (atau AI peringkat kucing).

Kini, jika kita mempunyai seni bina yang boleh merancang, ia akan "didorong oleh matlamat": perancangan mereka akan dilakukan dengan mengoptimumkan satu set matlamat pada masa inferens (bukan hanya masa latihan ) Datang kerja.

Matlamat ini boleh termasuk "penghalang" untuk menjadikan sistem ini selamat dan patuh, walaupun mereka akhirnya mempunyai model dunia yang lebih baik daripada manusia.

Masalahnya kemudiannya menjadi mereka bentuk (atau melatih) fungsi objektif yang baik untuk memastikan keselamatan dan kecekapan. Ini adalah masalah kejuruteraan yang sukar, tetapi tidak sesukar yang dikatakan oleh sesetengah orang.

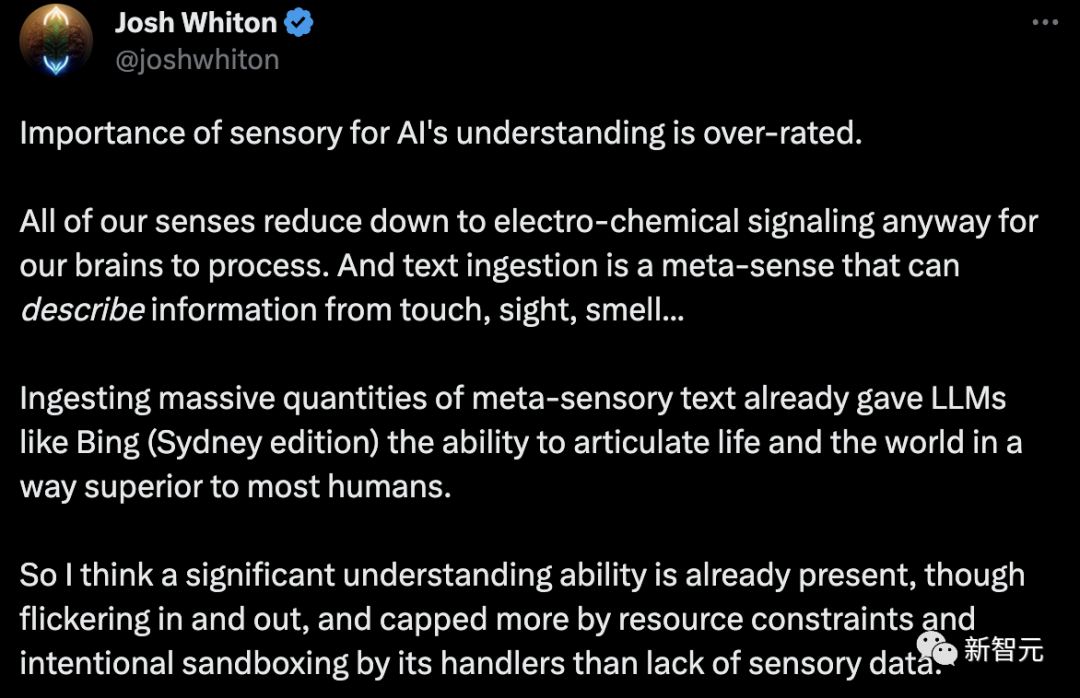

Pandangan LeCun segera disangkal oleh netizen: kepentingan deria dalam memahami kecerdasan buatan dipandang terlalu tinggi.

Dalam apa jua keadaan, semua deria kita dikurangkan kepada isyarat elektrokimia untuk diproses oleh otak.

Pengingesan teks ialah meta-deria yang boleh menerangkan maklumat daripada sentuhan, penglihatan, bau... Menelan sejumlah besar teks meta-deria telah menjadikan LLM seperti Bing (versi Sydney) Keupayaan untuk menyatakan kehidupan dan dunia dengan cara yang lebih baik daripada kebanyakan orang.

Jadi saya rasa pemahaman yang penting sudah ada, walaupun dalam dan luar wujud. Dan itu lebih disebabkan oleh kekangan sumber dan kotak pasir yang disengajakan oleh pengendali daripada kekurangan data deria.

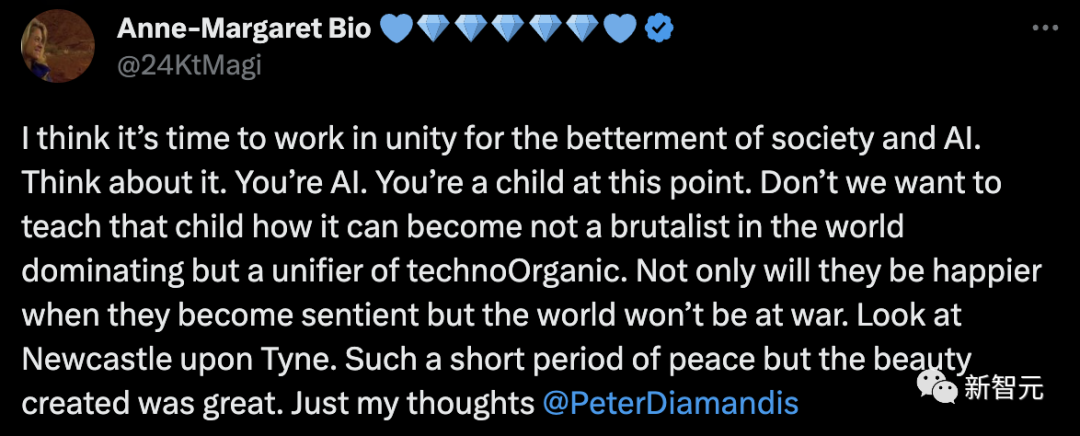

Saya rasa sudah tiba masanya untuk bersatu dan bekerja untuk kemajuan masyarakat dan kecerdasan buatan. Fikirkanlah, anda masih bayi kecerdasan buatan. Tidakkah kita mahu mengajar kanak-kanak itu bagaimana untuk menjadi penyatu tekno-organik dan bukannya brutalis di dunia?

Apabila dia menjadi peka, bukan sahaja mereka akan lebih gembira, malah dunia tidak akan berperang. Tengok Newcastle upon Tyne. Tempoh kedamaian yang singkat, tetapi keindahan ciptaan adalah hebat.

Konsensus yang disebut oleh Ng Enda dan Hinton nampaknya tidak mungkin pada masa ini. Ia bukan dalam kemampuan peribadi kita, ia memerlukan semua orang mempunyai kehendak sedemikian.

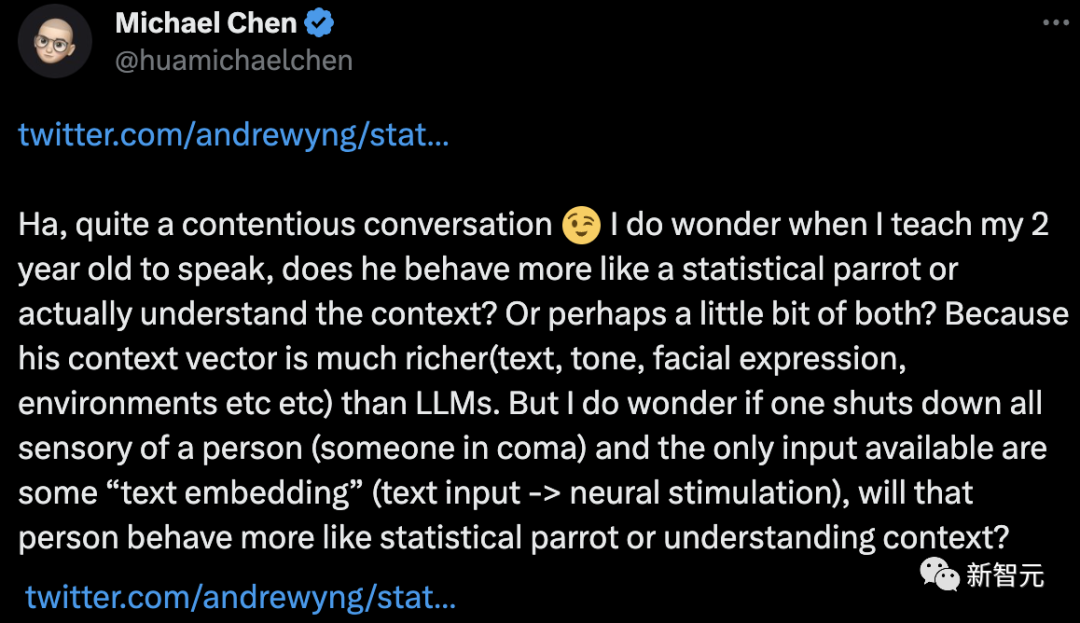

Sesetengah netizen berkata ini adalah perbualan yang agak kontroversi.

Saya tertanya-tanya, apabila saya mengajar anak saya yang berumur 2 tahun bercakap, adakah dia bertindak lebih seperti burung kakak tua secara rawak atau adakah dia sebenarnya memahami konteksnya? Atau kedua-duanya?

Oleh kerana vektor konteksnya jauh lebih kaya daripada LLM (teks, nada, ekspresi muka, persekitaran, dll.). Tetapi saya tertanya-tanya, jika seseorang mematikan semua deria orang lain dan satu-satunya input yang tersedia ialah beberapa "pembenaman teks" (input teks -> rangsangan saraf), adakah orang itu akan berkelakuan lebih seperti burung kakak tua rawak, atau adakah orang itu akan boleh Memahami konteks?

Hinton: Super AI akan datang lebih cepat daripada yang dijangkakan

Selepas meninggalkan Google, Hinton telah mengabdikan dirinya untuk Melemparkan keselamatan AI. Pada 10 Jun, Hinton sekali lagi bercakap tentang risiko AI di Persidangan Zhiyuan.

Apakah yang akan berlaku jika rangkaian saraf yang besar boleh meniru bahasa manusia untuk memperoleh pengetahuan, malah menggunakannya untuk kegunaan sendiri?

Tidak dinafikan kerana ia boleh memperoleh lebih banyak data, sistem AI ini pasti akan mengatasi manusia.

Senario terburuk ialah penjenayah akan menggunakan superintelligence untuk memanipulasi pengundi dan memenangi perang.

Selain itu, jika super AI dibenarkan untuk menetapkan submatlamatnya sendiri, satu submatlamat adalah untuk mendapatkan lebih kuasa, super AI akan memanipulasi manusia yang menggunakannya dalam untuk mencapai matlamatnya.

Perlu dinyatakan bahawa realisasi AI super tersebut boleh melepasi "pengiraan fana".

Pada Disember 2022, kertas kerja yang diterbitkan oleh Hinton, The Forward-Forward Algorithm: Some Preliminary Investigations, menyebut "pengiraan kematian" di bahagian terakhir.

Alamat kertas: https://arxiv.org/pdf/2212.13345.pdf

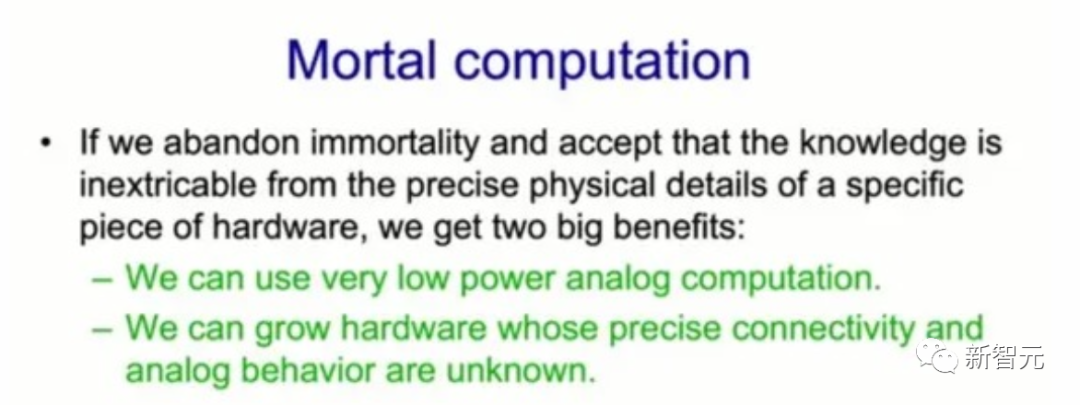

Jika anda mahu rangkaian neural trilion parameter menggunakan hanya beberapa watt kuasa, "pengkomputeran fana" mungkin satu-satunya pilihan.

Dia berkata bahawa jika kita benar-benar melepaskan pengasingan perisian dan perkakasan, kita akan mendapat "pengkomputeran fana". Daripada ini, kita boleh menggunakan pengkomputeran analog berkuasa rendah, iaitu apa yang dilakukan oleh otak.

"Pengkomputeran Mortal" boleh merealisasikan jenis komputer baharu yang mengintegrasikan rapat kecerdasan buatan dan perkakasan.

Ini bermakna pada masa hadapan, meletakkan GPT-3 ke dalam pembakar roti hanya akan menelan kos $1 dan menggunakan hanya beberapa watt kuasa.

Jadi masalah utama dengan pengkomputeran fana ialah proses pembelajaran mesti mengeksploitasi sifat simulasi khusus perkakasan yang sedang dijalankan, tanpa mengetahui dengan tepat sifat tersebut.

Sebagai contoh, fungsi tepat yang mengaitkan input neuron dengan output neuron tidak diketahui dan ketersambungan mungkin tidak diketahui.

Maksudnya, kita tidak boleh menggunakan sesuatu seperti algoritma perambatan belakang untuk mendapatkan kecerunan.

Jadi persoalannya, jika kita tidak boleh menggunakan backpropagation, apa lagi yang boleh kita lakukan kerana kita semua sangat tinggi. Bergantung pada penyebaran belakang.

Dalam hal ini, Hinton mencadangkan penyelesaian: algoritma ke hadapan.

Algoritma hadapan adalah calon yang menjanjikan, walaupun keupayaannya untuk berskala dalam rangkaian saraf yang besar masih belum dapat dilihat.

Pada pandangan Hinton, rangkaian saraf tiruan tidak lama lagi akan menjadi lebih pintar daripada rangkaian saraf sebenar, dan superintelligence akan menjadi lebih pantas daripada jangkaan.

Oleh itu, dunia kini perlu mencapai kata sepakat bahawa masa depan AI harus dicipta bersama oleh manusia.

Atas ialah kandungan terperinci Perbualan terbaru antara Ng Enda dan Hinton! AI bukan burung nuri rawak, konsensus mengatasi segala-galanya, LeCun bersetuju dengan kedua-dua tangan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1382

1382

52

52

Baris arahan shutdown centos

Apr 14, 2025 pm 09:12 PM

Baris arahan shutdown centos

Apr 14, 2025 pm 09:12 PM

Perintah shutdown CentOS adalah penutupan, dan sintaks adalah tutup [pilihan] [maklumat]. Pilihan termasuk: -h menghentikan sistem dengan segera; -P mematikan kuasa selepas penutupan; -r mulakan semula; -T Waktu Menunggu. Masa boleh ditentukan sebagai segera (sekarang), minit (minit), atau masa tertentu (HH: mm). Maklumat tambahan boleh dipaparkan dalam mesej sistem.

Apakah kaedah sandaran untuk gitlab di centos

Apr 14, 2025 pm 05:33 PM

Apakah kaedah sandaran untuk gitlab di centos

Apr 14, 2025 pm 05:33 PM

Dasar sandaran dan pemulihan Gitlab di bawah sistem CentOS untuk memastikan keselamatan data dan pemulihan, Gitlab pada CentOS menyediakan pelbagai kaedah sandaran. Artikel ini akan memperkenalkan beberapa kaedah sandaran biasa, parameter konfigurasi dan proses pemulihan secara terperinci untuk membantu anda menubuhkan strategi sandaran dan pemulihan GitLab lengkap. 1. Backup Manual Gunakan Gitlab-Rakegitlab: Backup: Buat Perintah untuk Melaksanakan Backup Manual. Perintah ini menyokong maklumat utama seperti repositori Gitlab, pangkalan data, pengguna, kumpulan pengguna, kunci, dan kebenaran. Fail sandaran lalai disimpan dalam direktori/var/opt/gitlab/sandaran. Anda boleh mengubah suai /etc /gitlab

Cara Memeriksa Konfigurasi HDFS CentOS

Apr 14, 2025 pm 07:21 PM

Cara Memeriksa Konfigurasi HDFS CentOS

Apr 14, 2025 pm 07:21 PM

Panduan Lengkap untuk Memeriksa Konfigurasi HDFS Dalam Sistem CentOS Artikel ini akan membimbing anda bagaimana untuk memeriksa konfigurasi dan menjalankan status HDFS secara berkesan pada sistem CentOS. Langkah -langkah berikut akan membantu anda memahami sepenuhnya persediaan dan operasi HDFS. Sahkan Pembolehubah Alam Sekitar Hadoop: Pertama, pastikan pembolehubah persekitaran Hadoop ditetapkan dengan betul. Di terminal, laksanakan arahan berikut untuk mengesahkan bahawa Hadoop dipasang dan dikonfigurasi dengan betul: Hadoopversion Semak fail konfigurasi HDFS: Fail konfigurasi teras HDFS terletak di/etc/hadoop/conf/direktori, di mana core-site.xml dan hdfs-site.xml adalah kritikal. gunakan

Apakah kaedah penalaan prestasi zookeeper di CentOS

Apr 14, 2025 pm 03:18 PM

Apakah kaedah penalaan prestasi zookeeper di CentOS

Apr 14, 2025 pm 03:18 PM

Penalaan prestasi zookeeper pada centOs boleh bermula dari pelbagai aspek, termasuk konfigurasi perkakasan, pengoptimuman sistem operasi, pelarasan parameter konfigurasi, pemantauan dan penyelenggaraan, dan lain -lain. Memori yang cukup: memperuntukkan sumber memori yang cukup untuk zookeeper untuk mengelakkan cakera kerap membaca dan menulis. CPU multi-teras: Gunakan CPU multi-teras untuk memastikan bahawa zookeeper dapat memprosesnya selari.

Bagaimana sokongan GPU untuk Pytorch di CentOS

Apr 14, 2025 pm 06:48 PM

Bagaimana sokongan GPU untuk Pytorch di CentOS

Apr 14, 2025 pm 06:48 PM

Membolehkan pecutan GPU pytorch pada sistem CentOS memerlukan pemasangan cuda, cudnn dan GPU versi pytorch. Langkah-langkah berikut akan membimbing anda melalui proses: Pemasangan CUDA dan CUDNN Tentukan keserasian versi CUDA: Gunakan perintah NVIDIA-SMI untuk melihat versi CUDA yang disokong oleh kad grafik NVIDIA anda. Sebagai contoh, kad grafik MX450 anda boleh menyokong CUDA11.1 atau lebih tinggi. Muat turun dan pasang Cudatoolkit: Lawati laman web rasmi Nvidiacudatoolkit dan muat turun dan pasang versi yang sepadan mengikut versi CUDA tertinggi yang disokong oleh kad grafik anda. Pasang Perpustakaan Cudnn:

Penjelasan terperinci mengenai Prinsip Docker

Apr 14, 2025 pm 11:57 PM

Penjelasan terperinci mengenai Prinsip Docker

Apr 14, 2025 pm 11:57 PM

Docker menggunakan ciri -ciri kernel Linux untuk menyediakan persekitaran berjalan yang cekap dan terpencil. Prinsip kerjanya adalah seperti berikut: 1. Cermin digunakan sebagai templat baca sahaja, yang mengandungi semua yang anda perlukan untuk menjalankan aplikasi; 2. Sistem Fail Kesatuan (Unionfs) menyusun pelbagai sistem fail, hanya menyimpan perbezaan, menjimatkan ruang dan mempercepatkan; 3. Daemon menguruskan cermin dan bekas, dan pelanggan menggunakannya untuk interaksi; 4. Ruang nama dan cgroups melaksanakan pengasingan kontena dan batasan sumber; 5. Pelbagai mod rangkaian menyokong interkoneksi kontena. Hanya dengan memahami konsep -konsep teras ini, anda boleh menggunakan Docker dengan lebih baik.

CentOS memasang MySQL

Apr 14, 2025 pm 08:09 PM

CentOS memasang MySQL

Apr 14, 2025 pm 08:09 PM

Memasang MySQL pada CentOS melibatkan langkah -langkah berikut: Menambah sumber MySQL YUM yang sesuai. Jalankan YUM Pasang Perintah MySQL-Server untuk memasang pelayan MySQL. Gunakan perintah mysql_secure_installation untuk membuat tetapan keselamatan, seperti menetapkan kata laluan pengguna root. Sesuaikan fail konfigurasi MySQL seperti yang diperlukan. Tune parameter MySQL dan mengoptimumkan pangkalan data untuk prestasi.

CentOS8 memulakan semula SSH

Apr 14, 2025 pm 09:00 PM

CentOS8 memulakan semula SSH

Apr 14, 2025 pm 09:00 PM

Perintah untuk memulakan semula perkhidmatan SSH ialah: Sistem Restart SSHD. Langkah -langkah terperinci: 1. Akses terminal dan sambungkan ke pelayan; 2. Masukkan arahan: SistemCtl Restart SSHD; 3. Sahkan Status Perkhidmatan: Status Sistem SSHD.