Peranti teknologi

Peranti teknologi

AI

AI

Berdasarkan teknologi penentukuran teori maklumat, CML menjadikan pembelajaran mesin berbilang modal lebih dipercayai

Berdasarkan teknologi penentukuran teori maklumat, CML menjadikan pembelajaran mesin berbilang modal lebih dipercayai

Berdasarkan teknologi penentukuran teori maklumat, CML menjadikan pembelajaran mesin berbilang modal lebih dipercayai

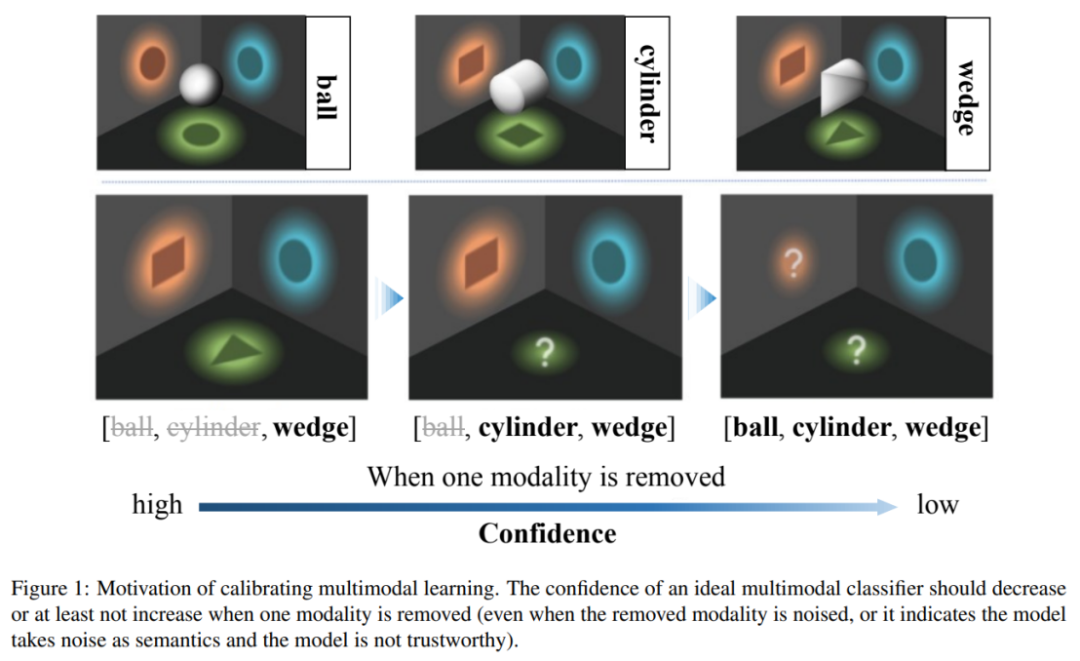

Pembelajaran mesin pelbagai mod telah mencapai kemajuan yang mengagumkan dalam pelbagai senario. Walau bagaimanapun, kebolehpercayaan model pembelajaran multimodal tidak mempunyai penyelidikan yang mendalam. "Maklumat ialah penghapusan ketidakpastian." Niat asal pembelajaran mesin pelbagai mod adalah konsisten dengan ini - modaliti tambahan boleh membuat ramalan lebih tepat dan boleh dipercayai. Walau bagaimanapun, kertas kerja "Calibrating Multimodal Learning" baru-baru ini diterbitkan dalam ICML2023 mendapati bahawa kaedah pembelajaran multimodal semasa melanggar andaian kebolehpercayaan ini, dan membuat analisis dan pembetulan terperinci.

Gambar

Gambar

- Paper Arxiv: https://arxiv.org/abs/2306.01265

- b.com/Q ingyangZhang/CML

Kaedah klasifikasi pelbagai mod semasa mempunyai keyakinan yang tidak boleh dipercayai, iaitu, apabila beberapa mod dialih keluar, model mungkin menghasilkan keyakinan yang lebih tinggi, yang melanggar teori maklumat "maklumat dihapuskan". prinsip asas. Untuk menangani masalah ini, artikel ini mencadangkan kaedah Pembelajaran Multimodal Kalibrasi. Kaedah ini boleh digunakan dalam paradigma pembelajaran pelbagai mod yang berbeza untuk meningkatkan rasional dan kredibiliti model pembelajaran pelbagai mod.

Kaedah klasifikasi pelbagai mod semasa mempunyai keyakinan yang tidak boleh dipercayai, iaitu, apabila beberapa mod dialih keluar, model mungkin menghasilkan keyakinan yang lebih tinggi, yang melanggar teori maklumat "maklumat dihapuskan". prinsip asas. Untuk menangani masalah ini, artikel ini mencadangkan kaedah Pembelajaran Multimodal Kalibrasi. Kaedah ini boleh digunakan dalam paradigma pembelajaran pelbagai mod yang berbeza untuk meningkatkan rasional dan kredibiliti model pembelajaran pelbagai mod.

Pictures

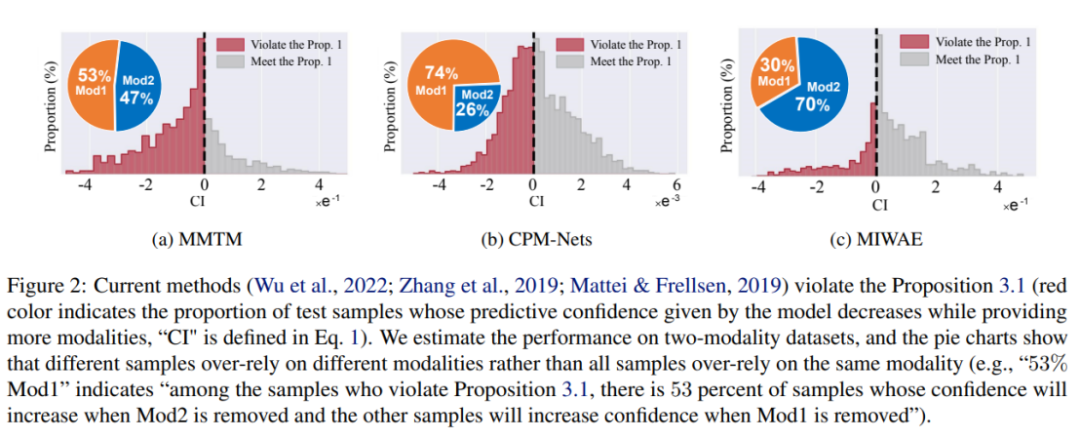

Kerja ini menunjukkan bahawa kaedah pembelajaran pelbagai mod semasa mempunyai masalah keyakinan ramalan yang tidak boleh dipercayai, dan model pembelajaran mesin pelbagai mod sedia ada cenderung bergantung pada modaliti separa untuk menganggarkan keyakinan. Khususnya, kajian mendapati bahawa keyakinan anggaran model semasa meningkat apabila mod tertentu rosak. Untuk menyelesaikan masalah yang tidak munasabah ini, penulis mencadangkan prinsip pembelajaran pelbagai mod intuitif: apabila modaliti dialih keluar, keyakinan ramalan model tidak seharusnya meningkat. Walau bagaimanapun, model semasa cenderung untuk mempercayai dan dipengaruhi oleh subset modaliti, dan bukannya mempertimbangkan semua modaliti secara adil. Ini seterusnya menjejaskan kekukuhan model, iaitu model mudah terjejas apabila mod tertentu rosak.

Kerja ini menunjukkan bahawa kaedah pembelajaran pelbagai mod semasa mempunyai masalah keyakinan ramalan yang tidak boleh dipercayai, dan model pembelajaran mesin pelbagai mod sedia ada cenderung bergantung pada modaliti separa untuk menganggarkan keyakinan. Khususnya, kajian mendapati bahawa keyakinan anggaran model semasa meningkat apabila mod tertentu rosak. Untuk menyelesaikan masalah yang tidak munasabah ini, penulis mencadangkan prinsip pembelajaran pelbagai mod intuitif: apabila modaliti dialih keluar, keyakinan ramalan model tidak seharusnya meningkat. Walau bagaimanapun, model semasa cenderung untuk mempercayai dan dipengaruhi oleh subset modaliti, dan bukannya mempertimbangkan semua modaliti secara adil. Ini seterusnya menjejaskan kekukuhan model, iaitu model mudah terjejas apabila mod tertentu rosak.

Untuk menyelesaikan masalah di atas, beberapa kaedah pada masa ini menggunakan kaedah penentukuran ketidakpastian sedia ada, seperti Penskalaan Suhu atau kaedah pembelajaran Bayesian. Kaedah ini boleh membina anggaran keyakinan yang lebih tepat daripada kaedah latihan/inferens tradisional. Walau bagaimanapun, kaedah ini hanya sepadan dengan anggaran keyakinan hasil gabungan akhir dengan ketepatan, dan tidak mempertimbangkan secara eksplisit perhubungan antara jumlah maklumat modal dan keyakinan Oleh itu, ia tidak dapat meningkatkan kredibiliti model pembelajaran pelbagai mod.

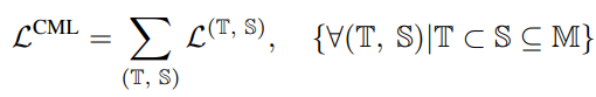

Pengarang mencadangkan teknik regularisasi baharu yang dipanggil "Calibrating Multimodal Learning (CML)". Teknik ini menguatkuasakan perhubungan padanan antara keyakinan ramalan model dan kandungan maklumat dengan menambahkan istilah penalti untuk mencapai konsistensi antara keyakinan ramalan dan kandungan maklumat. Teknik ini adalah berdasarkan intuisi semula jadi bahawa keyakinan ramalan harus berkurangan (sekurang-kurangnya tidak meningkat) apabila modaliti dialih keluar, yang sememangnya boleh meningkatkan penentukuran keyakinan. Secara khusus, istilah penyelarasan mudah dicadangkan untuk memaksa model mempelajari hubungan pesanan intuitif dengan menambahkan penalti kepada sampel tersebut yang keyakinan ramalannya meningkat apabila modaliti dialih keluar:

Pengarang mencadangkan teknik regularisasi baharu yang dipanggil "Calibrating Multimodal Learning (CML)". Teknik ini menguatkuasakan perhubungan padanan antara keyakinan ramalan model dan kandungan maklumat dengan menambahkan istilah penalti untuk mencapai konsistensi antara keyakinan ramalan dan kandungan maklumat. Teknik ini adalah berdasarkan intuisi semula jadi bahawa keyakinan ramalan harus berkurangan (sekurang-kurangnya tidak meningkat) apabila modaliti dialih keluar, yang sememangnya boleh meningkatkan penentukuran keyakinan. Secara khusus, istilah penyelarasan mudah dicadangkan untuk memaksa model mempelajari hubungan pesanan intuitif dengan menambahkan penalti kepada sampel tersebut yang keyakinan ramalannya meningkat apabila modaliti dialih keluar:

Kekangan di atas ialah a kerugian tetap, yang muncul sebagai penalti apabila maklumat modal dialih keluar dan keyakinan meningkat.

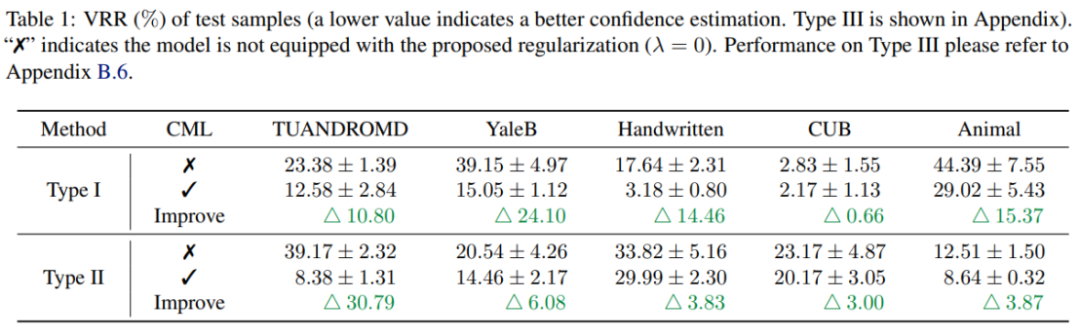

Hasil eksperimen menunjukkan bahawa penyelarasan CML boleh meningkatkan dengan ketara kebolehpercayaan keyakinan ramalan kaedah pembelajaran pelbagai mod sedia ada. Selain itu, CML boleh meningkatkan ketepatan klasifikasi dan meningkatkan keteguhan model.

Hasil eksperimen menunjukkan bahawa penyelarasan CML boleh meningkatkan dengan ketara kebolehpercayaan keyakinan ramalan kaedah pembelajaran pelbagai mod sedia ada. Selain itu, CML boleh meningkatkan ketepatan klasifikasi dan meningkatkan keteguhan model.

Pembelajaran mesin pelbagai mod telah mencapai kemajuan yang ketara dalam pelbagai senario, tetapi kebolehpercayaan model pembelajaran mesin pelbagai mod masih menjadi masalah yang perlu diselesaikan. Melalui kajian empirikal yang meluas, kertas kerja ini mendapati kaedah pengelasan multimodal semasa mempunyai masalah keyakinan ramalan yang tidak boleh dipercayai dan melanggar prinsip teori maklumat. Untuk menangani isu ini, penyelidik mencadangkan teknik penyusunan CML, yang boleh digunakan secara fleksibel pada model sedia ada dan meningkatkan prestasi dari segi penentukuran keyakinan, ketepatan klasifikasi dan keteguhan model. Adalah dipercayai bahawa teknologi baharu ini akan memainkan peranan penting dalam pembelajaran pelbagai mod pada masa hadapan dan meningkatkan kebolehpercayaan dan kepraktisan pembelajaran mesin.

Atas ialah kandungan terperinci Berdasarkan teknologi penentukuran teori maklumat, CML menjadikan pembelajaran mesin berbilang modal lebih dipercayai. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1378

1378

52

52

Artikel ini akan membawa anda memahami SHAP: penjelasan model untuk pembelajaran mesin

Jun 01, 2024 am 10:58 AM

Artikel ini akan membawa anda memahami SHAP: penjelasan model untuk pembelajaran mesin

Jun 01, 2024 am 10:58 AM

Dalam bidang pembelajaran mesin dan sains data, kebolehtafsiran model sentiasa menjadi tumpuan penyelidik dan pengamal. Dengan aplikasi meluas model yang kompleks seperti kaedah pembelajaran mendalam dan ensemble, memahami proses membuat keputusan model menjadi sangat penting. AI|XAI yang boleh dijelaskan membantu membina kepercayaan dan keyakinan dalam model pembelajaran mesin dengan meningkatkan ketelusan model. Meningkatkan ketelusan model boleh dicapai melalui kaedah seperti penggunaan meluas pelbagai model yang kompleks, serta proses membuat keputusan yang digunakan untuk menerangkan model. Kaedah ini termasuk analisis kepentingan ciri, anggaran selang ramalan model, algoritma kebolehtafsiran tempatan, dsb. Analisis kepentingan ciri boleh menerangkan proses membuat keputusan model dengan menilai tahap pengaruh model ke atas ciri input. Anggaran selang ramalan model

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

Awal bulan ini, penyelidik dari MIT dan institusi lain mencadangkan alternatif yang sangat menjanjikan kepada MLP - KAN. KAN mengatasi MLP dari segi ketepatan dan kebolehtafsiran. Dan ia boleh mengatasi prestasi MLP berjalan dengan bilangan parameter yang lebih besar dengan bilangan parameter yang sangat kecil. Sebagai contoh, penulis menyatakan bahawa mereka menggunakan KAN untuk menghasilkan semula keputusan DeepMind dengan rangkaian yang lebih kecil dan tahap automasi yang lebih tinggi. Khususnya, MLP DeepMind mempunyai kira-kira 300,000 parameter, manakala KAN hanya mempunyai kira-kira 200 parameter. KAN mempunyai asas matematik yang kukuh seperti MLP berdasarkan teorem penghampiran universal, manakala KAN berdasarkan teorem perwakilan Kolmogorov-Arnold. Seperti yang ditunjukkan dalam rajah di bawah, KAN telah

Melaksanakan Algoritma Pembelajaran Mesin dalam C++: Cabaran dan Penyelesaian Biasa

Jun 03, 2024 pm 01:25 PM

Melaksanakan Algoritma Pembelajaran Mesin dalam C++: Cabaran dan Penyelesaian Biasa

Jun 03, 2024 pm 01:25 PM

Cabaran biasa yang dihadapi oleh algoritma pembelajaran mesin dalam C++ termasuk pengurusan memori, multi-threading, pengoptimuman prestasi dan kebolehselenggaraan. Penyelesaian termasuk menggunakan penunjuk pintar, perpustakaan benang moden, arahan SIMD dan perpustakaan pihak ketiga, serta mengikuti garis panduan gaya pengekodan dan menggunakan alat automasi. Kes praktikal menunjukkan cara menggunakan perpustakaan Eigen untuk melaksanakan algoritma regresi linear, mengurus memori dengan berkesan dan menggunakan operasi matriks berprestasi tinggi.

Melebihi DPO secara menyeluruh: Pasukan Chen Danqi mencadangkan pengoptimuman pilihan mudah SimPO, dan turut memperhalusi model sumber terbuka 8B terkuat

Jun 01, 2024 pm 04:41 PM

Melebihi DPO secara menyeluruh: Pasukan Chen Danqi mencadangkan pengoptimuman pilihan mudah SimPO, dan turut memperhalusi model sumber terbuka 8B terkuat

Jun 01, 2024 pm 04:41 PM

Untuk menyelaraskan model bahasa besar (LLM) dengan nilai dan niat manusia, adalah penting untuk mempelajari maklum balas manusia untuk memastikan bahawa ia berguna, jujur dan tidak berbahaya. Dari segi penjajaran LLM, kaedah yang berkesan ialah pembelajaran pengukuhan berdasarkan maklum balas manusia (RLHF). Walaupun keputusan kaedah RLHF adalah cemerlang, terdapat beberapa cabaran pengoptimuman yang terlibat. Ini melibatkan latihan model ganjaran dan kemudian mengoptimumkan model dasar untuk memaksimumkan ganjaran tersebut. Baru-baru ini, beberapa penyelidik telah meneroka algoritma luar talian yang lebih mudah, salah satunya ialah pengoptimuman keutamaan langsung (DPO). DPO mempelajari model dasar secara langsung berdasarkan data keutamaan dengan meparameterkan fungsi ganjaran dalam RLHF, sekali gus menghapuskan keperluan untuk model ganjaran yang jelas. Kaedah ini mudah dan stabil

AI yang boleh dijelaskan: Menerangkan model AI/ML yang kompleks

Jun 03, 2024 pm 10:08 PM

AI yang boleh dijelaskan: Menerangkan model AI/ML yang kompleks

Jun 03, 2024 pm 10:08 PM

Penterjemah |. Disemak oleh Li Rui |. Chonglou Model kecerdasan buatan (AI) dan pembelajaran mesin (ML) semakin kompleks hari ini, dan output yang dihasilkan oleh model ini adalah kotak hitam – tidak dapat dijelaskan kepada pihak berkepentingan. AI Boleh Dijelaskan (XAI) bertujuan untuk menyelesaikan masalah ini dengan membolehkan pihak berkepentingan memahami cara model ini berfungsi, memastikan mereka memahami cara model ini sebenarnya membuat keputusan, dan memastikan ketelusan dalam sistem AI, Amanah dan akauntabiliti untuk menyelesaikan masalah ini. Artikel ini meneroka pelbagai teknik kecerdasan buatan (XAI) yang boleh dijelaskan untuk menggambarkan prinsip asasnya. Beberapa sebab mengapa AI boleh dijelaskan adalah penting Kepercayaan dan ketelusan: Untuk sistem AI diterima secara meluas dan dipercayai, pengguna perlu memahami cara keputusan dibuat

Tiada data OpenAI diperlukan, sertai senarai model kod besar! UIUC mengeluarkan StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

Tiada data OpenAI diperlukan, sertai senarai model kod besar! UIUC mengeluarkan StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

Di barisan hadapan teknologi perisian, kumpulan UIUC Zhang Lingming, bersama penyelidik dari organisasi BigCode, baru-baru ini mengumumkan model kod besar StarCoder2-15B-Instruct. Pencapaian inovatif ini mencapai kejayaan ketara dalam tugas penjanaan kod, berjaya mengatasi CodeLlama-70B-Instruct dan mencapai bahagian atas senarai prestasi penjanaan kod. Keunikan StarCoder2-15B-Instruct terletak pada strategi penjajaran diri yang tulen Keseluruhan proses latihan adalah terbuka, telus, dan sepenuhnya autonomi dan boleh dikawal. Model ini menjana beribu-ribu arahan melalui StarCoder2-15B sebagai tindak balas kepada penalaan halus model asas StarCoder-15B tanpa bergantung pada anotasi manual yang mahal.

Lima sekolah pembelajaran mesin yang anda tidak tahu

Jun 05, 2024 pm 08:51 PM

Lima sekolah pembelajaran mesin yang anda tidak tahu

Jun 05, 2024 pm 08:51 PM

Pembelajaran mesin ialah cabang penting kecerdasan buatan yang memberikan komputer keupayaan untuk belajar daripada data dan meningkatkan keupayaan mereka tanpa diprogramkan secara eksplisit. Pembelajaran mesin mempunyai pelbagai aplikasi dalam pelbagai bidang, daripada pengecaman imej dan pemprosesan bahasa semula jadi kepada sistem pengesyoran dan pengesanan penipuan, dan ia mengubah cara hidup kita. Terdapat banyak kaedah dan teori yang berbeza dalam bidang pembelajaran mesin, antaranya lima kaedah yang paling berpengaruh dipanggil "Lima Sekolah Pembelajaran Mesin". Lima sekolah utama ialah sekolah simbolik, sekolah sambungan, sekolah evolusi, sekolah Bayesian dan sekolah analogi. 1. Simbolisme, juga dikenali sebagai simbolisme, menekankan penggunaan simbol untuk penaakulan logik dan ekspresi pengetahuan. Aliran pemikiran ini percaya bahawa pembelajaran adalah proses penolakan terbalik, melalui sedia ada

Adakah Flash Attention stabil? Meta dan Harvard mendapati bahawa sisihan berat model mereka berubah-ubah mengikut urutan magnitud

May 30, 2024 pm 01:24 PM

Adakah Flash Attention stabil? Meta dan Harvard mendapati bahawa sisihan berat model mereka berubah-ubah mengikut urutan magnitud

May 30, 2024 pm 01:24 PM

MetaFAIR bekerjasama dengan Harvard untuk menyediakan rangka kerja penyelidikan baharu untuk mengoptimumkan bias data yang dijana apabila pembelajaran mesin berskala besar dilakukan. Adalah diketahui bahawa latihan model bahasa besar sering mengambil masa berbulan-bulan dan menggunakan ratusan atau bahkan ribuan GPU. Mengambil model LLaMA270B sebagai contoh, latihannya memerlukan sejumlah 1,720,320 jam GPU. Melatih model besar memberikan cabaran sistemik yang unik disebabkan oleh skala dan kerumitan beban kerja ini. Baru-baru ini, banyak institusi telah melaporkan ketidakstabilan dalam proses latihan apabila melatih model AI generatif SOTA Mereka biasanya muncul dalam bentuk lonjakan kerugian Contohnya, model PaLM Google mengalami sehingga 20 lonjakan kerugian semasa proses latihan. Bias berangka adalah punca ketidaktepatan latihan ini,