Dalam dunia ajaib AIGC, kita boleh menukar dan menggabungkan imej yang kita inginkan dengan "seret" pada imej. Sebagai contoh, membuat singa memalingkan kepalanya dan membuka mulutnya:

Penyelidikan untuk mencapai kesan ini datang daripada kertas "Drag Your GAN" yang diketuai oleh seorang pengarang Cina, yang dikeluarkan bulan lepas dan telah diterima oleh persidangan SIGGRAPH 2023.

Lebih daripada sebulan telah berlalu, dan pasukan penyelidik baru-baru ini mengeluarkan kod rasmi. Dalam masa tiga hari sahaja, bilangan Bintang telah melebihi 23k, yang menunjukkan popularitinya. . DragGAN sebelumnya melaksanakan pengeditan imej interaktif berasaskan titik dan mencapai kesan pengeditan ketepatan tahap piksel. Walau bagaimanapun, terdapat juga kekurangan DragGAN adalah berdasarkan rangkaian permusuhan generatif (GAN), dan serba boleh dihadkan oleh kapasiti model GAN yang telah dilatih.

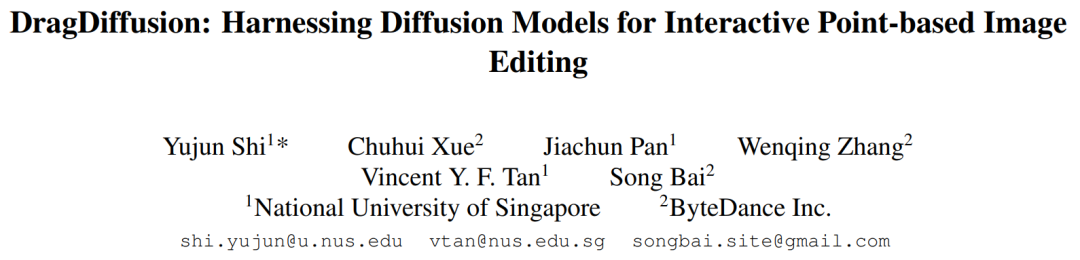

Dalam penyelidikan baharu, beberapa penyelidik dari Universiti Nasional Singapura dan ByteDance memperluaskan rangka kerja penyuntingan jenis ini kepada model resapan dan mencadangkan DragDiffusion. Mereka memanfaatkan model penyebaran pra-latihan berskala besar untuk meningkatkan kebolehgunaan pengeditan interaktif berasaskan titik dalam senario dunia sebenar.

Dalam penyelidikan baharu, beberapa penyelidik dari Universiti Nasional Singapura dan ByteDance memperluaskan rangka kerja penyuntingan jenis ini kepada model resapan dan mencadangkan DragDiffusion. Mereka memanfaatkan model penyebaran pra-latihan berskala besar untuk meningkatkan kebolehgunaan pengeditan interaktif berasaskan titik dalam senario dunia sebenar.

Walaupun kebanyakan kaedah pengeditan imej berasaskan resapan semasa sesuai untuk pembenaman teks, DragDiffusion mengoptimumkan perwakilan pendam resapan untuk mencapai kawalan spatial yang tepat.

Gambar

Alamat kertas: https://arxiv.org/pdf/2306.14435.pdf

projek-alamat: https://arxiv.org/pdf /dragdiffusion.html

Seterusnya, Kami ingin membuat. puncak gunung lebih tinggi, tiada masalah, seret sahaja titik kunci merah:

gambar

Kami juga mahu avatar arca itu memusingkan kepalanya, seret sahaja:

. Biarkan bunga di pantai mekar sedikit lebih luas:

. Biarkan bunga di pantai mekar sedikit lebih luas:

Pengenalan kepada kaedah

DRAGDIFFUSION,tentalah sasaran khusus yang dicadangkan dalam artikel interaktif ini penyuntingan imej.

DRAGDIFFUSION,tentalah sasaran khusus yang dicadangkan dalam artikel interaktif ini penyuntingan imej.

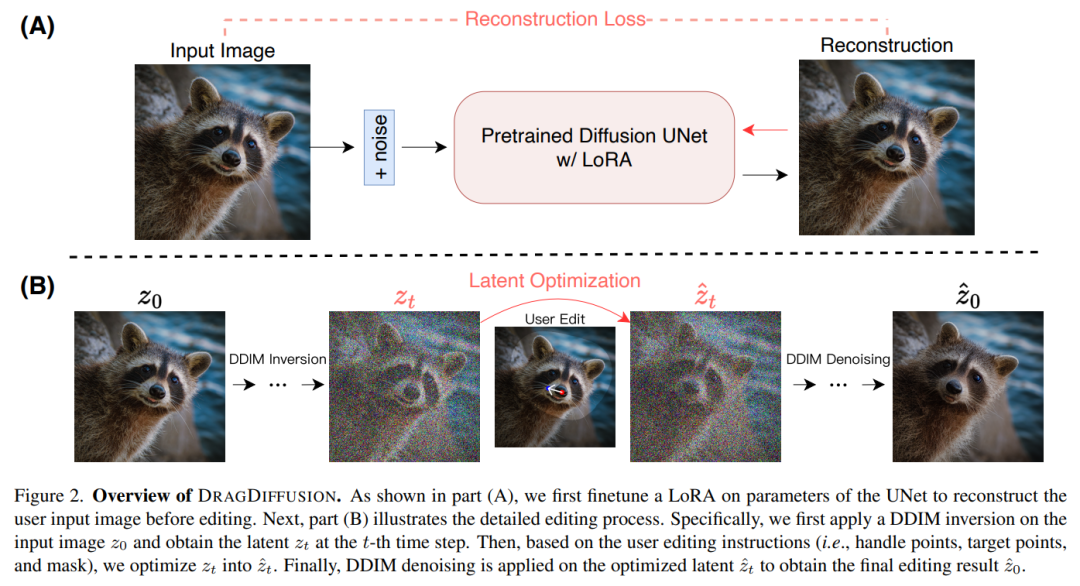

Untuk mencapai matlamat ini, penyelidikan terlebih dahulu memperhalusi LoRA berdasarkan model resapan untuk membina semula imej input pengguna. Ini boleh memastikan bahawa gaya imej input dan output adalah konsisten.

Seterusnya, penyelidik menggunakan penyongsangan DDIM (iaitu kaedah untuk meneroka transformasi songsang dan operasi ruang terpendam model resapan) pada imej input untuk mendapatkan pembolehubah pendam resapan pada langkah tertentu.

Semasa proses penyuntingan, penyelidik berulang kali menggunakan penyeliaan gerakan dan pengesanan titik untuk mengoptimumkan pembolehubah pendam resapan yang diperoleh sebelum ini pada langkah t, dengan itu "seret" kandungan titik pemprosesan ke lokasi sasaran. Proses penyuntingan juga menggunakan istilah penyelarasan untuk memastikan kawasan imej yang tidak bertopeng kekal tidak berubah.

Akhir sekali, gunakan DDIM untuk menafikan pembolehubah pendam yang dioptimumkan pada langkah t untuk mendapatkan hasil yang diedit. Gambaran keseluruhan adalah seperti berikut:

Gambar

Gambar

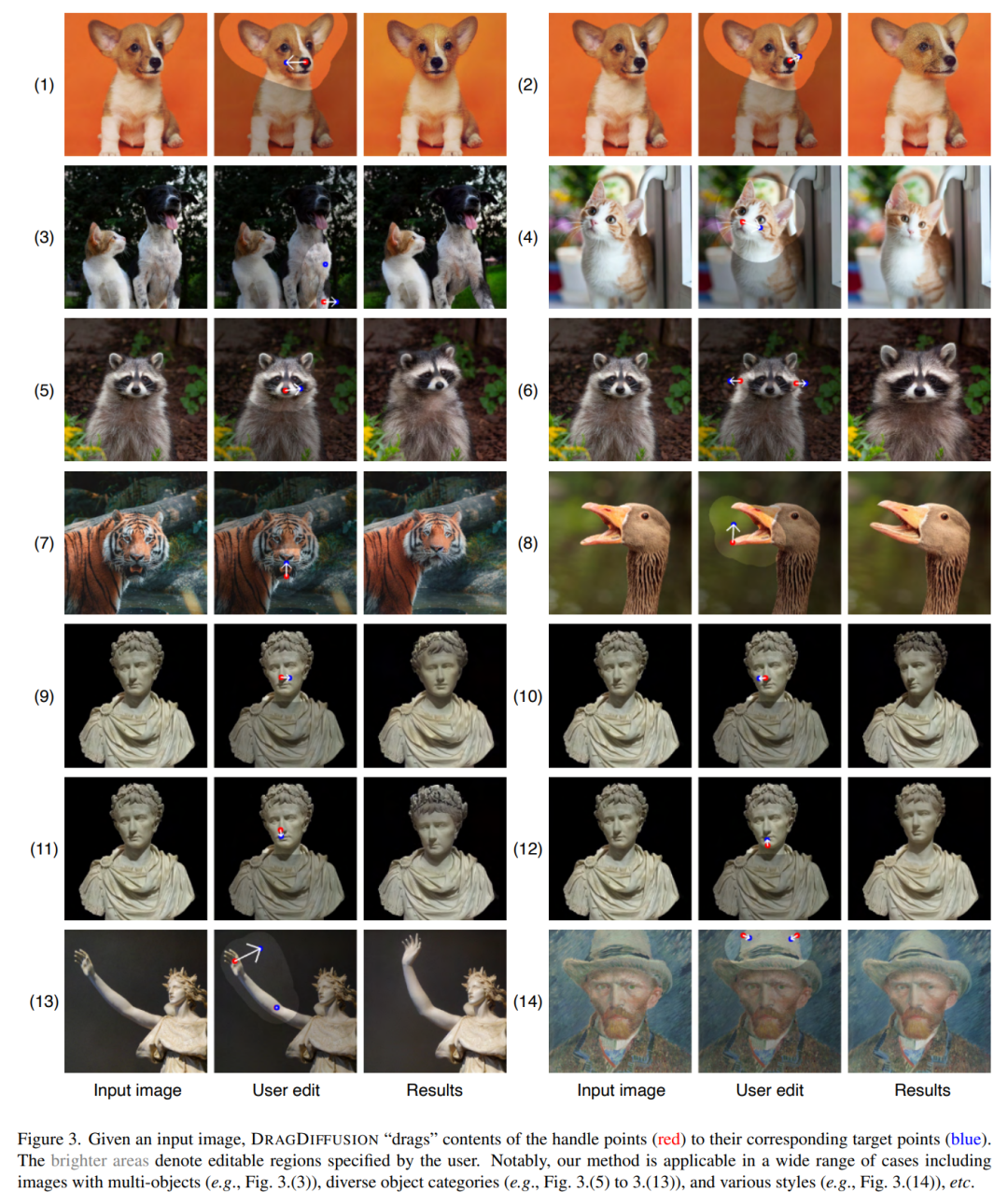

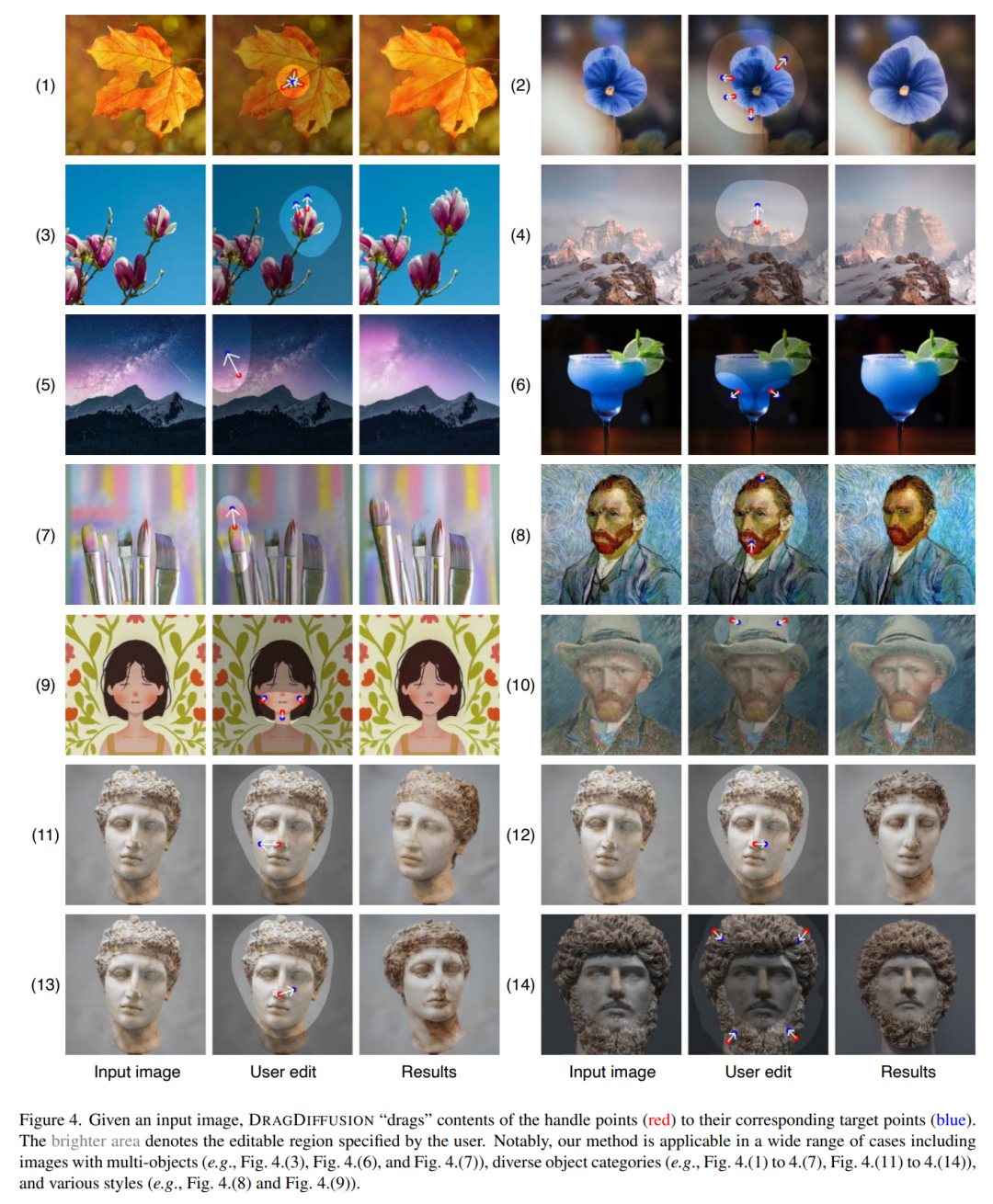

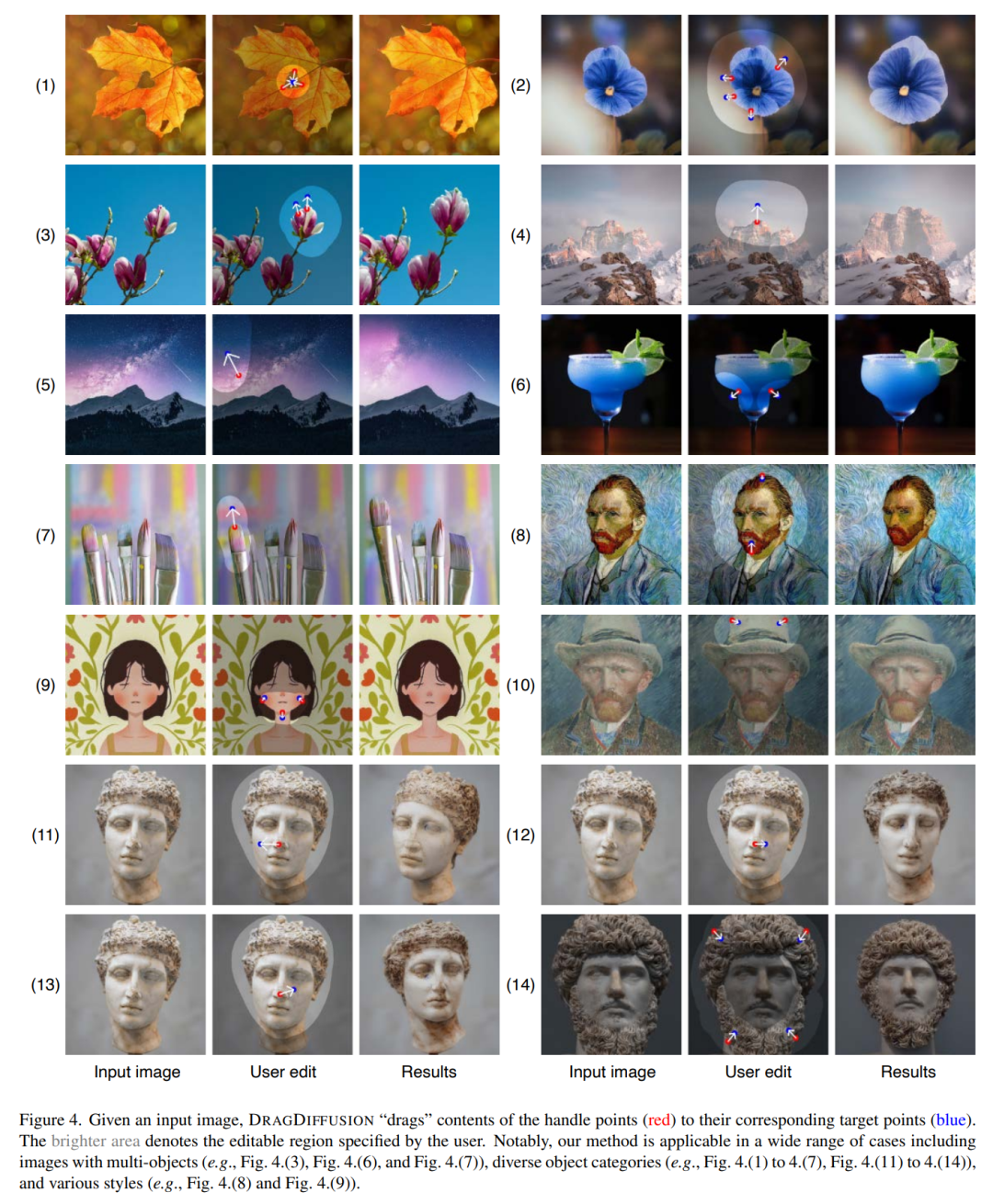

Memandangkan imej input, DRAGDIFFUSION "menyeret" kandungan titik warna utama (merah) ke titik biru yang sepadan (merah) . Contohnya, dalam gambar (1), pusingkan kepala anak anjing, dalam gambar (7), tutup mulut harimau, dsb.

Gambar

Gambar

Berikut adalah lebih banyak contoh demo. Seperti yang ditunjukkan dalam Rajah (4), jadikan puncak gunung lebih tinggi, Rajah (7) jadikan hujung pen lebih besar, dsb.

Gambar

Gambar

Atas ialah kandungan terperinci DragGAN telah menjadi sumber terbuka untuk 23k bintang dalam masa tiga hari, ini datang lagi DragDiffusion. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Cara mengubah suai teks dalam gambar

Cara mengubah suai teks dalam gambar

Apa yang perlu dilakukan jika imej terbenam tidak dipaparkan sepenuhnya

Apa yang perlu dilakukan jika imej terbenam tidak dipaparkan sepenuhnya

Cara membuat gambar ppt muncul satu persatu

Cara membuat gambar ppt muncul satu persatu

Cara membuat gambar bulat dalam ppt

Cara membuat gambar bulat dalam ppt

Apakah maksud sisi c dan sisi b?

Apakah maksud sisi c dan sisi b?

Pangkalan data tiga paradigma

Pangkalan data tiga paradigma

Bagaimana untuk menyelesaikan kod ralat deletefile 5

Bagaimana untuk menyelesaikan kod ralat deletefile 5

Bagaimana untuk membayar balik Douyin yang dicas semula Doucoin

Bagaimana untuk membayar balik Douyin yang dicas semula Doucoin