Peranti teknologi

Peranti teknologi

AI

AI

Saluran baharu untuk AI? Model Zeroscope berkualiti tinggi pertama 'Vinson Video' mencetuskan perang sumber terbuka: ia boleh dijalankan dengan sekurang-kurangnya memori video 8G

Saluran baharu untuk AI? Model Zeroscope berkualiti tinggi pertama 'Vinson Video' mencetuskan perang sumber terbuka: ia boleh dijalankan dengan sekurang-kurangnya memori video 8G

Saluran baharu untuk AI? Model Zeroscope berkualiti tinggi pertama 'Vinson Video' mencetuskan perang sumber terbuka: ia boleh dijalankan dengan sekurang-kurangnya memori video 8G

Selepas model Stable Diffusion model graf Vincent adalah sumber terbuka, "seni AI" telah didemokrasikan sepenuhnya. Hanya kad grafik gred pengguna boleh digunakan untuk mencipta imej yang sangat cantik.

Dalam bidang penukaran teks ke video, kini satu-satunya model Gen-2 komersial berkualiti tinggi yang dilancarkan oleh Runway tidak lama dahulu, dan tiada model yang boleh bersaing dalam industri sumber terbuka.

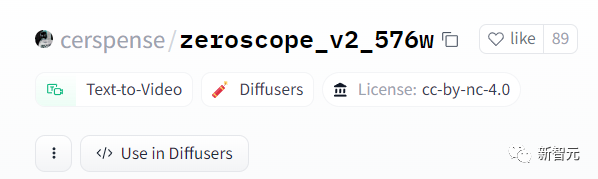

Baru-baru ini, seorang pengarang di Huggingface mengeluarkan model sintesis teks-ke-video Zeroscope_v2, yang dibangunkan berdasarkan model ModelScope-text-to-video-sintesis dengan 1.7 bilion parameter.

Gambar

Gambar

Pautan model: https://huggingface.co/cerspense/zeroscope_v2_576w

Berbanding dengan versi asal dan Zeroscope tidak mempunyai kelancaran dan kelancaran video yang dihasilkan oleh penanda air. Diperbaik untuk menyesuaikan diri kepada nisbah bidang 16:9.

Pembangun cerspense berkata bahawa matlamatnya adalah untuk bersaing dengan Gen-2 sebagai sumber terbuka, iaitu sambil meningkatkan kualiti model, ia juga boleh digunakan secara bebas oleh orang ramai.

zeroscope_v2 termasuk dua versi. GB memori video untuk dijalankan.

Gunakan Zeroscope_v2 XL untuk menjana video definisi tinggi dengan resolusi 1024x576 dan menduduki kira-kira 15.3GB memori video.

Zeroscope juga boleh digunakan dengan alat penjanaan muzik MusicGen untuk mencipta video pendek yang asli semata-mata.

Latihan model Zeroscope menggunakan 9923 klip video (klip) dan 29769 bingkai beranotasi, setiap klip termasuk 24 bingkai. Bunyi offset termasuk anjakan rawak objek dalam bingkai video, sedikit perubahan dalam pemasaan bingkai atau herotan kecil.

Memperkenalkan bunyi semasa latihan boleh meningkatkan pemahaman model tentang pengedaran data, membolehkannya menjana video yang lebih pelbagai dan realistik serta menerangkan perubahan dalam penerangan teks dengan lebih berkesan.

Cara menggunakanGunakan stable diffusion webui

Muat turun fail berat dalam direktori zs2_XL pada Huggingface, dan kemudian letakkannya dalam direktori s.delffusion-web-tableui

Apabila menjana video, nilai intensiti pengurangan hingar yang disyorkan ialah 0.66 hingga 0.85

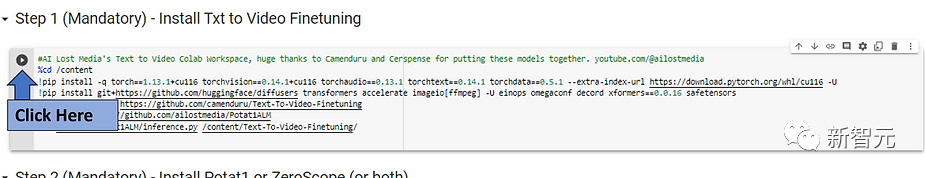

menggunakan pautan colab

note: https://colab.research.google.com/ Drive/1TSZMatsu1-1LNBEOQZ3_9ZQ5P2C0XTTQ? USP = Sharing

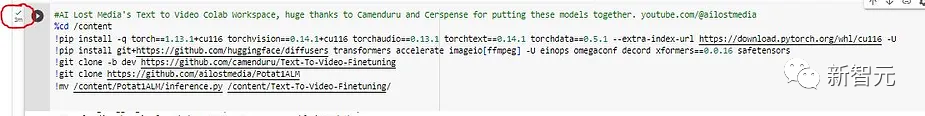

first Klik butang Run di bawah Langkah 1 dan tunggu pemasangan, yang akan mengambil masa kira-kira 3 minit; di sebelah butang , teruskan ke langkah seterusnya. . 448).

Gambar

Gambar

memerlukan pertukaran masa pelaksanaan yang lebih lama apabila melaksanakan model resolusi lebih tinggi seperti Potat 1 atau ZeroScope XL.

Tunggu lagi tanda semak muncul untuk meneruskan ke langkah seterusnya.

Tunggu lagi tanda semak muncul untuk meneruskan ke langkah seterusnya.

Pilih model model yang dipasang pada Langkah 2 dan ingin menggunakannya Untuk model resolusi lebih tinggi, parameter konfigurasi berikut disyorkan, yang tidak memerlukan masa penjanaan terlalu lama.

Pictures

Pictures

Seterusnya, anda boleh memasukkan perkataan gesaan video sasaran untuk menukar kesan, dan anda juga boleh memasukkan gesaan negatif (gesaan negatif), dan kemudian klik butang jalankan.

Setelah menunggu seketika, video yang dihasilkan akan diletakkan dalam direktori output.

gambar

Pertandingan Sumber Terbuka "Vincent Video"

Pada masa ini, bidang Video Vincent masih di peringkat awal, malah alat terbaik hanya boleh menjana video dalam beberapa saat, dan selalunya mempunyai kecacatan visual yang besar.

Tetapi sebenarnya, model Vincentian pada mulanya menghadapi masalah yang sama, tetapi ia mencapai fotorealisme hanya beberapa bulan kemudian.

Walau bagaimanapun, tidak seperti model graf Vincentian, medan video memerlukan lebih banyak sumber semasa latihan dan penjanaan daripada imej.

Walaupun Google telah membangunkan model Phenaki dan Imagen Video yang boleh menghasilkan klip video beresolusi tinggi, lebih panjang dan koheren secara logik, kedua-dua model ini tidak tersedia kepada orang ramai model Make-a-Video Meta juga tidak dikeluarkan .

Alat yang tersedia pada masa ini masih hanya model komersial Runway Gen-2 Pengeluaran Zeroscope juga menandakan kemunculan model sumber terbuka berkualiti tinggi pertama dalam medan video Vincent.

Atas ialah kandungan terperinci Saluran baharu untuk AI? Model Zeroscope berkualiti tinggi pertama 'Vinson Video' mencetuskan perang sumber terbuka: ia boleh dijalankan dengan sekurang-kurangnya memori video 8G. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

Apakah jenis nilai pulangan fungsi bahasa C? Ringkasan jenis nilai pulangan fungsi bahasa C?

Apr 03, 2025 pm 11:18 PM

Apakah jenis nilai pulangan fungsi bahasa C? Ringkasan jenis nilai pulangan fungsi bahasa C?

Apr 03, 2025 pm 11:18 PM

Jenis nilai pulangan fungsi bahasa C termasuk int, float, double, char, void dan jenis penunjuk. Int digunakan untuk mengembalikan bilangan bulat, terapung dan dua kali digunakan untuk mengembalikan terapung, dan char mengembalikan aksara. Kekosongan bermaksud bahawa fungsi tidak mengembalikan sebarang nilai. Jenis penunjuk mengembalikan alamat memori, berhati -hati untuk mengelakkan kebocoran ingatan. Struktur atau konsortium boleh mengembalikan pelbagai data yang berkaitan.

Cara Mengira C-SubScript 3 Subscript 5 C-SubScript 3 Subscript 5 Algoritma Tutorial

Apr 03, 2025 pm 10:33 PM

Cara Mengira C-SubScript 3 Subscript 5 C-SubScript 3 Subscript 5 Algoritma Tutorial

Apr 03, 2025 pm 10:33 PM

Pengiraan C35 pada dasarnya adalah matematik gabungan, yang mewakili bilangan kombinasi yang dipilih dari 3 dari 5 elemen. Formula pengiraan ialah C53 = 5! / (3! * 2!), Yang boleh dikira secara langsung oleh gelung untuk meningkatkan kecekapan dan mengelakkan limpahan. Di samping itu, memahami sifat kombinasi dan menguasai kaedah pengiraan yang cekap adalah penting untuk menyelesaikan banyak masalah dalam bidang statistik kebarangkalian, kriptografi, reka bentuk algoritma, dll.

Fungsi Penggunaan Fungsi Jarak Jarak Jarak Penggunaan C Tutorial Penggunaan

Apr 03, 2025 pm 10:27 PM

Fungsi Penggunaan Fungsi Jarak Jarak Jarak Penggunaan C Tutorial Penggunaan

Apr 03, 2025 pm 10:27 PM

STD :: Unik menghilangkan elemen pendua bersebelahan di dalam bekas dan menggerakkannya ke akhir, mengembalikan iterator yang menunjuk ke elemen pendua pertama. STD :: Jarak mengira jarak antara dua iterators, iaitu bilangan elemen yang mereka maksudkan. Kedua -dua fungsi ini berguna untuk mengoptimumkan kod dan meningkatkan kecekapan, tetapi terdapat juga beberapa perangkap yang perlu diberi perhatian, seperti: STD :: Unik hanya berkaitan dengan unsur -unsur pendua yang bersebelahan. STD :: Jarak kurang cekap apabila berurusan dengan Iterator Akses Bukan Rawak. Dengan menguasai ciri -ciri dan amalan terbaik ini, anda boleh menggunakan sepenuhnya kuasa kedua -dua fungsi ini.

Apakah perbezaan dan hubungan antara C dan C#?

Apr 03, 2025 pm 10:36 PM

Apakah perbezaan dan hubungan antara C dan C#?

Apr 03, 2025 pm 10:36 PM

Walaupun C dan C# mempunyai persamaan, mereka sama sekali berbeza: C adalah pengurusan memori yang berorientasikan proses, dan bahasa yang bergantung kepada platform yang digunakan untuk pengaturcaraan sistem; C# adalah bahasa berorientasikan objek, sampah, dan bahasa bebas platform yang digunakan untuk desktop, aplikasi web dan pembangunan permainan.

Apakah format definisi fungsi dalam bahasa C?

Apr 03, 2025 pm 11:51 PM

Apakah format definisi fungsi dalam bahasa C?

Apr 03, 2025 pm 11:51 PM

Unsur -unsur utama definisi fungsi C termasuk: jenis pulangan (menentukan nilai yang dikembalikan oleh fungsi), nama fungsi (mengikuti spesifikasi penamaan dan menentukan skop), senarai parameter (menentukan jenis parameter, kuantiti dan pesanan yang diterima oleh fungsi) dan badan fungsi (melaksanakan logik fungsi). Adalah penting untuk menjelaskan makna dan hubungan halus unsur -unsur ini, dan boleh membantu pemaju mengelakkan "lubang" dan menulis kod yang lebih cekap dan elegan.

Apakah penunjuk fungsi bahasa C dan fungsi penunjuk? Apa perbezaannya?

Apr 03, 2025 pm 11:54 PM

Apakah penunjuk fungsi bahasa C dan fungsi penunjuk? Apa perbezaannya?

Apr 03, 2025 pm 11:54 PM

Penunjuk fungsi adalah penunjuk kepada fungsi, dan fungsi penunjuk adalah fungsi yang mengembalikan penunjuk. Penunjuk fungsi menunjukkan fungsi, digunakan untuk memilih dan melaksanakan fungsi yang berbeza; fungsi penunjuk mengembalikan penunjuk kepada pembolehubah, tatasusunan atau fungsi lain; Apabila menggunakan penunjuk fungsi, perhatikan pemadanan parameter dan memeriksa nilai null penunjuk; Apabila menggunakan fungsi penunjuk, perhatikan pengurusan ingatan dan memori yang diperuntukkan secara dinamik; Memahami perbezaan dan ciri -ciri kedua -dua untuk mengelakkan kekeliruan dan kesilapan.

CS-Week 3

Apr 04, 2025 am 06:06 AM

CS-Week 3

Apr 04, 2025 am 06:06 AM

Algorithms are the set of instructions to solve problems, and their execution speed and memory usage vary. In programming, many algorithms are based on data search and sorting. Artikel ini akan memperkenalkan beberapa algoritma pengambilan data dan penyortiran. Carian linear mengandaikan bahawa terdapat array [20,500,10,5,100,1,50] dan perlu mencari nombor 50. Algoritma carian linear memeriksa setiap elemen dalam array satu demi satu sehingga nilai sasaran dijumpai atau array lengkap dilalui. Carta aliran algoritma adalah seperti berikut: kod pseudo untuk carian linear adalah seperti berikut: periksa setiap elemen: jika nilai sasaran dijumpai: pulih semula benar-benar pelaksanaan bahasa palsu c: #termasuk #termasukintmain (tidak sah) {i

Cara menggunakan penunjuk fungsi bahasa C untuk mencari nilai maksimum pelbagai dimensi

Apr 03, 2025 pm 11:45 PM

Cara menggunakan penunjuk fungsi bahasa C untuk mencari nilai maksimum pelbagai dimensi

Apr 03, 2025 pm 11:45 PM

Aplikasi fleksibel penunjuk fungsi: Gunakan fungsi perbandingan untuk mencari nilai maksimum array. Pertama, tentukan jenis fungsi perbandingan CompareFunc, dan kemudian tulis fungsi perbandingan perbandingan (a, b). Fungsi FindMax menerima array, saiz array, dan parameter fungsi perbandingan, dan menggunakan fungsi perbandingan untuk gelung untuk membandingkan elemen array untuk mencari nilai maksimum. Kaedah ini mempunyai kebolehgunaan semula kod yang kuat, mencerminkan idea pengaturcaraan pesanan yang lebih tinggi, dan kondusif untuk menyelesaikan masalah yang lebih kompleks.