Peranti teknologi

Peranti teknologi

AI

AI

Kertas hangat baharu Microsoft: Transformer berkembang kepada 1 bilion token

Kertas hangat baharu Microsoft: Transformer berkembang kepada 1 bilion token

Kertas hangat baharu Microsoft: Transformer berkembang kepada 1 bilion token

Apabila semua orang terus menaik taraf dan mengulang model besar mereka sendiri, keupayaan LLM (Model Bahasa Besar) untuk memproses tetingkap konteks juga telah menjadi penunjuk penilaian yang penting.

Sebagai contoh, model besar selebriti GPT-4 menyokong 32k token, yang bersamaan dengan 50 halaman teks, yang diasaskan oleh bekas ahli OpenAI, telah meningkatkan keupayaan pemprosesan token Claude kepada 100k, kira-kira 75,000 perkataan; yang secara kasarnya bersamaan dengan ringkasan satu klik "Harry Potter" Bahagian Pertama.

Dalam penyelidikan terkini Microsoft, mereka terus mengembangkan Transformer kepada 1 bilion token kali ini. Ini membuka kemungkinan baharu untuk memodelkan jujukan yang sangat panjang, seperti menganggap keseluruhan korpus atau malah keseluruhan Internet sebagai satu jujukan.

Sebagai perbandingan, purata orang boleh membaca 100,000 token dalam masa kira-kira 5 jam, dan mungkin mengambil masa yang lebih lama untuk mencerna, menghafal dan menganalisis maklumat ini. Claude boleh melakukan ini dalam masa kurang daripada satu minit. Jika ditukar kepada penyelidikan ini oleh Microsoft, ia akan menjadi angka yang mengejutkan.

Gambar

Gambar

- Alamat kertas: https://arxiv.org/pdf/2307.02486.pdf

- Alamat projek: https://github.com/unisoft

Secara khusus, penyelidikan mencadangkan LONGNET, varian Transformer yang boleh memanjangkan panjang jujukan kepada lebih 1 bilion token tanpa mengorbankan prestasi pada jujukan yang lebih pendek. Artikel itu juga mencadangkan perhatian yang meluas, yang boleh mengembangkan julat persepsi model secara eksponen.

longnet mempunyai kelebihan berikut:

1) Ia mempunyai kerumitan komputasi linear; digunakan tanpa Seam menggantikan perhatian standard dan boleh disepadukan dengan lancar dengan kaedah pengoptimuman berasaskan Transformer sedia ada.

Hasil eksperimen menunjukkan bahawa LONGNET mempamerkan prestasi yang kukuh dalam kedua-dua pemodelan jujukan panjang dan tugasan bahasa umum.

Dari segi motivasi penyelidikan, kertas kerja menyatakan bahawa dalam beberapa tahun kebelakangan ini, meluaskan rangkaian saraf telah menjadi trend, dan banyak rangkaian dengan prestasi yang baik telah dikaji. Antaranya, panjang jujukan, sebagai sebahagian daripada rangkaian saraf, sepatutnya tidak terhingga. Tetapi realitinya selalunya sebaliknya, jadi melanggar had panjang jujukan akan membawa kelebihan yang ketara:

Pertama, ia menyediakan model dengan memori berkapasiti besar dan medan penerimaan, membolehkannya berkomunikasi secara berkesan dengan manusia dan dunia.

Kedua, konteks yang lebih panjang mengandungi hubungan sebab akibat yang lebih kompleks dan laluan penaakulan yang boleh dieksploitasi oleh model dalam data latihan. Sebaliknya, kebergantungan yang lebih pendek akan memperkenalkan korelasi yang lebih palsu, yang tidak kondusif untuk generalisasi model.

- Ketiga, panjang jujukan yang lebih panjang boleh membantu model meneroka konteks yang lebih panjang, dan konteks yang sangat panjang juga boleh membantu model mengurangkan masalah lupa yang dahsyat.

- Walau bagaimanapun, cabaran utama dalam memanjangkan panjang jujukan ialah mencari keseimbangan yang tepat antara kerumitan pengiraan dan kuasa ekspresif model.

- Sebagai contoh, model gaya RNN digunakan terutamanya untuk meningkatkan panjang jujukan. Walau bagaimanapun, sifat urutannya mengehadkan keselarian semasa latihan, yang penting dalam pemodelan jujukan panjang.

Baru-baru ini, model ruang negeri telah menjadi sangat menarik untuk pemodelan jujukan, yang boleh dijalankan sebagai CNN semasa latihan dan ditukar kepada RNN yang cekap pada masa ujian. Walau bagaimanapun, model jenis ini tidak berfungsi sebaik Transformer pada panjang biasa.

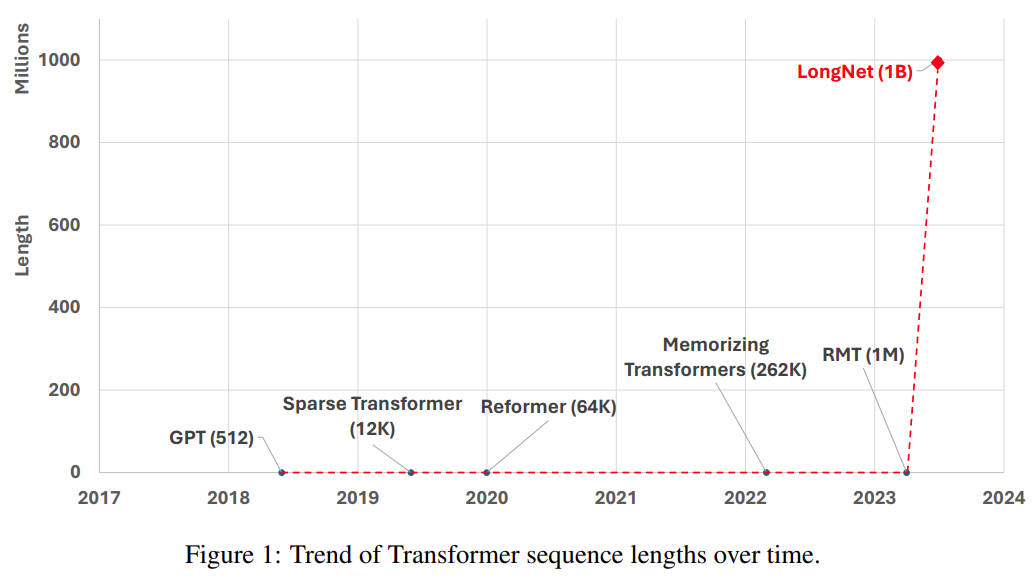

Satu lagi cara untuk memanjangkan panjang jujukan ialah mengurangkan kerumitan Transformer, iaitu, kerumitan kuadratik perhatian diri. Pada peringkat ini, beberapa varian berasaskan Transformer yang cekap telah dicadangkan, termasuk perhatian peringkat rendah, kaedah berasaskan kernel, kaedah pensampelan turun, dan kaedah berasaskan pengambilan semula. Walau bagaimanapun, pendekatan ini masih belum menskalakan Transformer kepada skala 1 bilion token (lihat Rajah 1).

Gambar

Jadual berikut menunjukkan perbandingan kerumitan pengiraan kaedah pengiraan yang berbeza. N ialah panjang jujukan, dan d ialah dimensi tersembunyi.

gambar

gambar

Kaedah

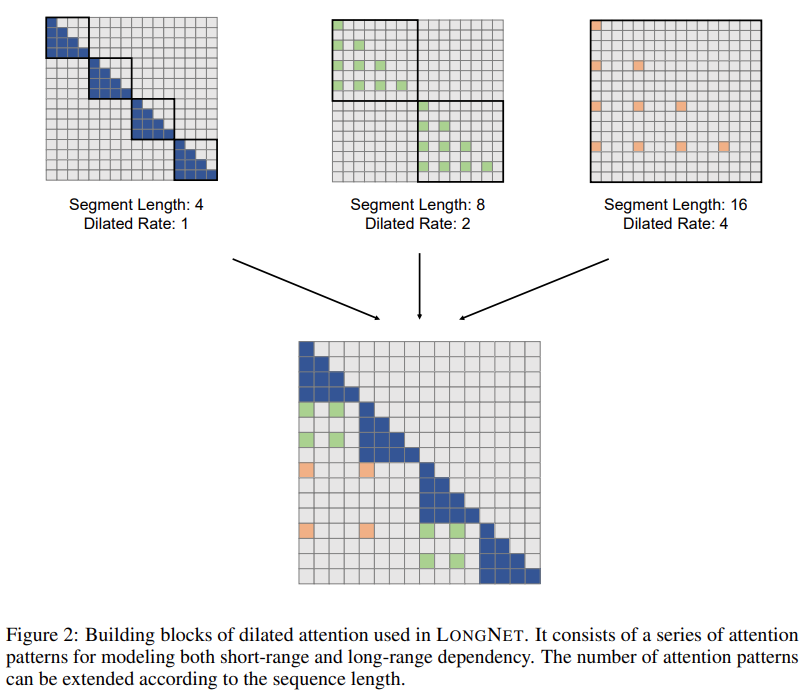

Penyelesaian penyelidikan LONGNET berjaya memanjangkan panjang jujukan kepada 1 bilion token. Secara khusus, penyelidikan ini mencadangkan komponen baru yang dipanggil perhatian diluaskan dan menggantikan mekanisme perhatian Transformer Vanila dengan perhatian diluaskan. Prinsip reka bentuk umum ialah peruntukan perhatian berkurangan secara eksponen apabila jarak antara token bertambah. Kajian menunjukkan bahawa pendekatan reka bentuk ini memperoleh kerumitan pengiraan linear dan pergantungan logaritma antara token. Ini menyelesaikan konflik antara sumber perhatian terhad dan akses kepada setiap token. . Mengambil kesempatan daripada kerumitan linear, LONGNET boleh dilatih secara selari merentas nod, menggunakan algoritma teragih untuk memecahkan kekangan pengkomputeran dan ingatan.

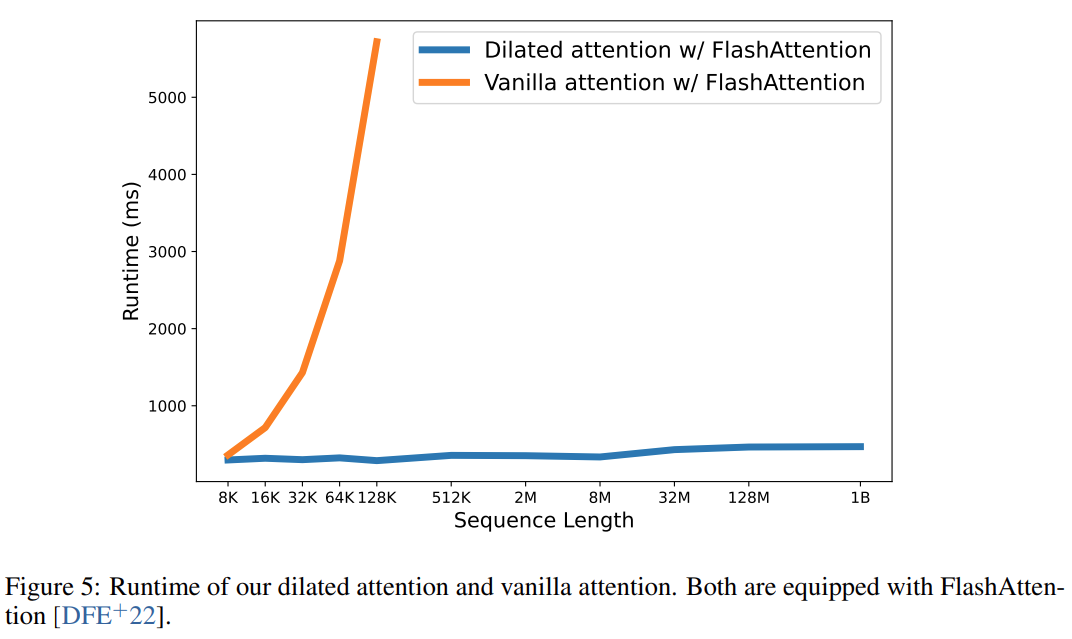

Akhirnya, penyelidikan ini secara berkesan mengembangkan panjang jujukan kepada token 1B, dan masa jalannya hampir tetap, seperti yang ditunjukkan dalam rajah di bawah. Sebaliknya, masa jalan Transformer vanila mengalami kerumitan kuadratik.

Akhirnya, penyelidikan ini secara berkesan mengembangkan panjang jujukan kepada token 1B, dan masa jalannya hampir tetap, seperti yang ditunjukkan dalam rajah di bawah. Sebaliknya, masa jalan Transformer vanila mengalami kerumitan kuadratik.

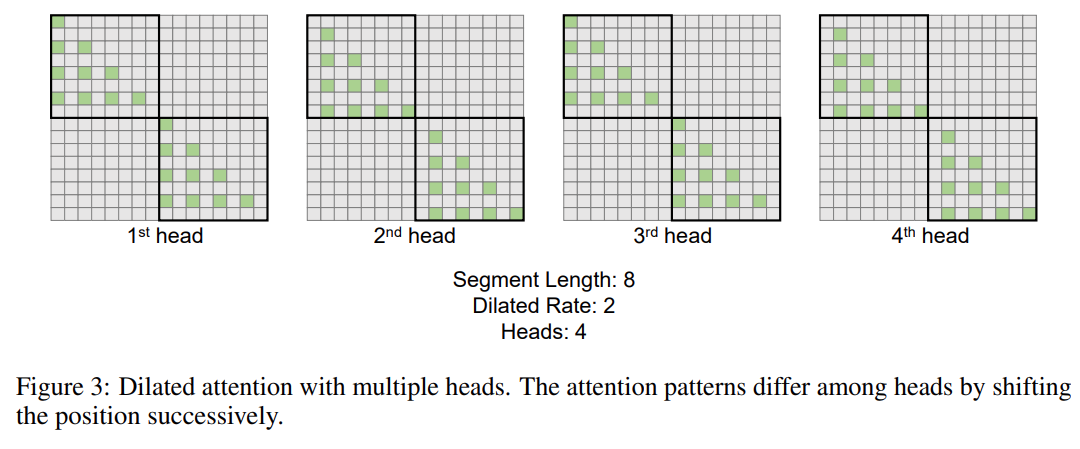

Penyelidikan ini memperkenalkan lagi mekanisme perhatian diluaskan berbilang kepala. Seperti yang ditunjukkan dalam Rajah 3 di bawah, kajian ini melakukan pengiraan yang berbeza merentas kepala yang berbeza dengan mengecilkan bahagian berlainan pasangan nilai kunci pertanyaan.

Pictures

Pictures

Divibusi Latihan -walaupun kerumitan pengiraan perhatian diluaskan telah dikurangkan dengan ketara kepada

, disebabkan oleh pengkomputeran dan batasan memori, ia akan mengukur panjang urutan ke berjuta-juta tidak boleh dilaksanakan. Terdapat beberapa algoritma latihan teragih untuk latihan model berskala besar, seperti selari model [SPP+19], selari jujukan [LXLY21, KCL+22] dan selari saluran paip [HCB+19]. . , terutamanya apabila dimensi jujukan adalah sangat besar.

, disebabkan oleh pengkomputeran dan batasan memori, ia akan mengukur panjang urutan ke berjuta-juta tidak boleh dilaksanakan. Terdapat beberapa algoritma latihan teragih untuk latihan model berskala besar, seperti selari model [SPP+19], selari jujukan [LXLY21, KCL+22] dan selari saluran paip [HCB+19]. . , terutamanya apabila dimensi jujukan adalah sangat besar.

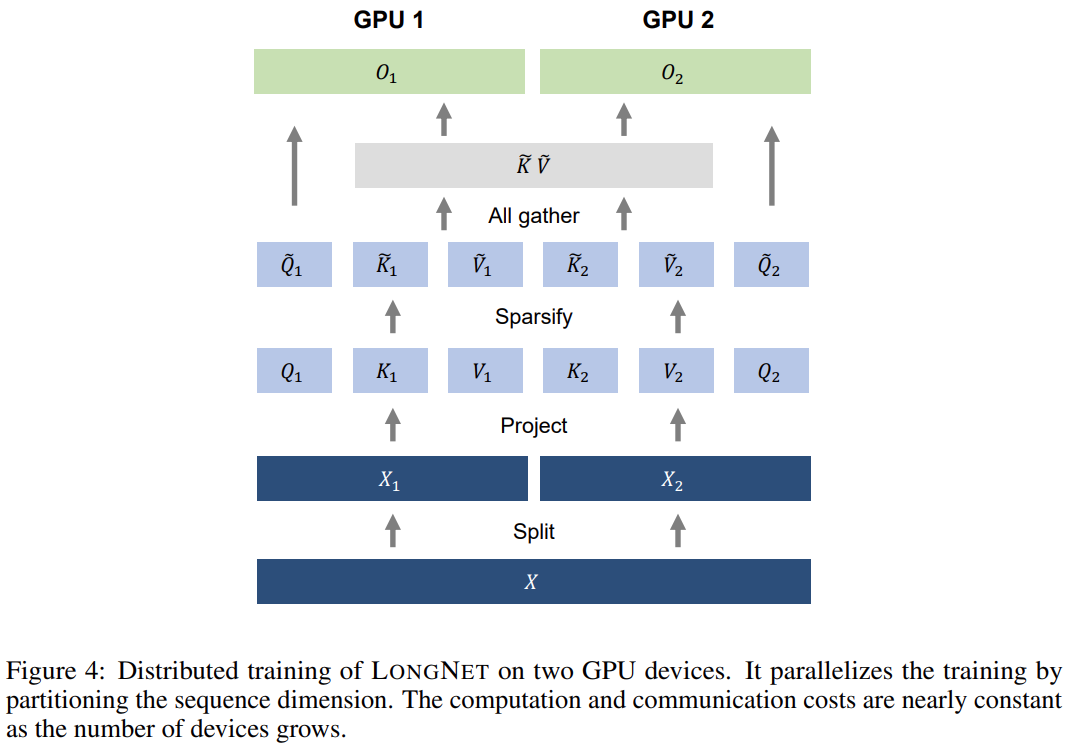

Penyelidikan ini menggunakan kerumitan pengiraan linear LONGNET untuk latihan teragih bagi dimensi jujukan. Rajah 4 di bawah menunjukkan algoritma yang diedarkan pada dua GPU, yang boleh ditingkatkan lagi kepada sebarang bilangan peranti. Kajian ini membandingkan LONGNET dengan Transformer vanila dan Transformer jarang. Perbezaan antara seni bina adalah lapisan perhatian, manakala lapisan lain kekal tidak berubah. Para penyelidik mengembangkan panjang jujukan model ini daripada 2K kepada 32K, sambil mengurangkan saiz kelompok untuk memastikan bilangan token dalam setiap kelompok kekal tidak berubah. Jadual 2 meringkaskan keputusan model ini pada set data Tindanan. Penyelidikan menggunakan kerumitan sebagai metrik penilaian. Model telah diuji menggunakan panjang jujukan yang berbeza, antara 2k hingga 32k. Apabila panjang input melebihi panjang maksimum yang disokong oleh model, penyelidikan melaksanakan perhatian sebab akibat blok (BCA) [SDP+22], kaedah ekstrapolasi terkini untuk inferens model bahasa.

Selain itu, kajian itu mengalih keluar pengekodan kedudukan mutlak. Pertama, keputusan menunjukkan bahawa peningkatan panjang urutan semasa latihan umumnya menghasilkan model bahasa yang lebih baik. Kedua, kaedah ekstrapolasi panjang jujukan dalam inferens tidak terpakai apabila panjangnya jauh lebih besar daripada sokongan model. Akhir sekali, LONGNET secara konsisten mengatasi model garis dasar, menunjukkan keberkesanannya dalam pemodelan bahasa.

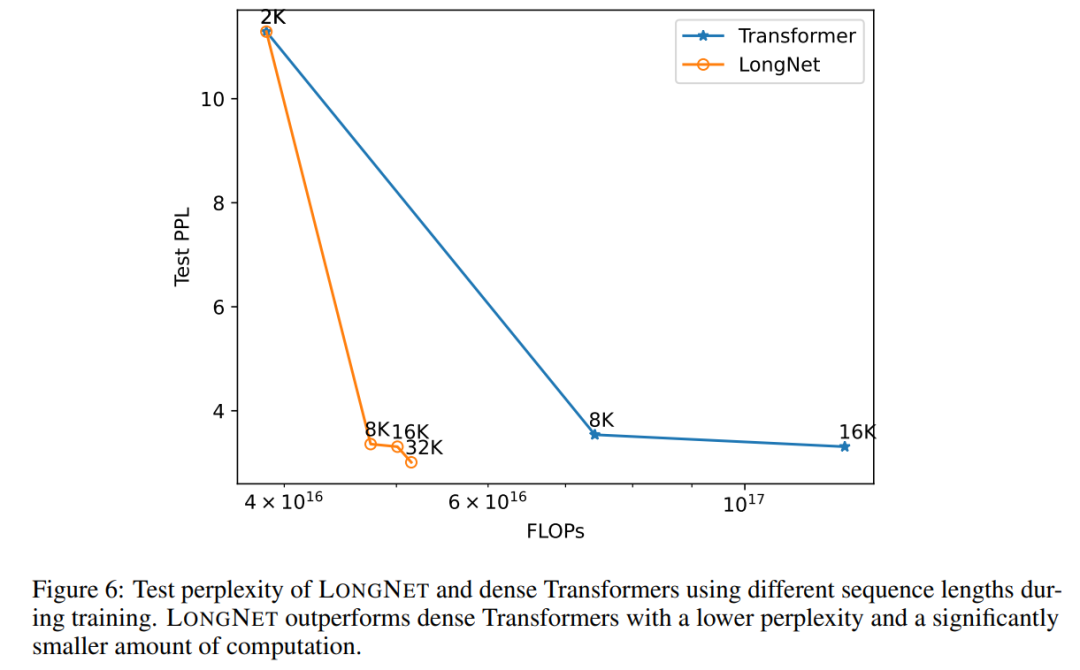

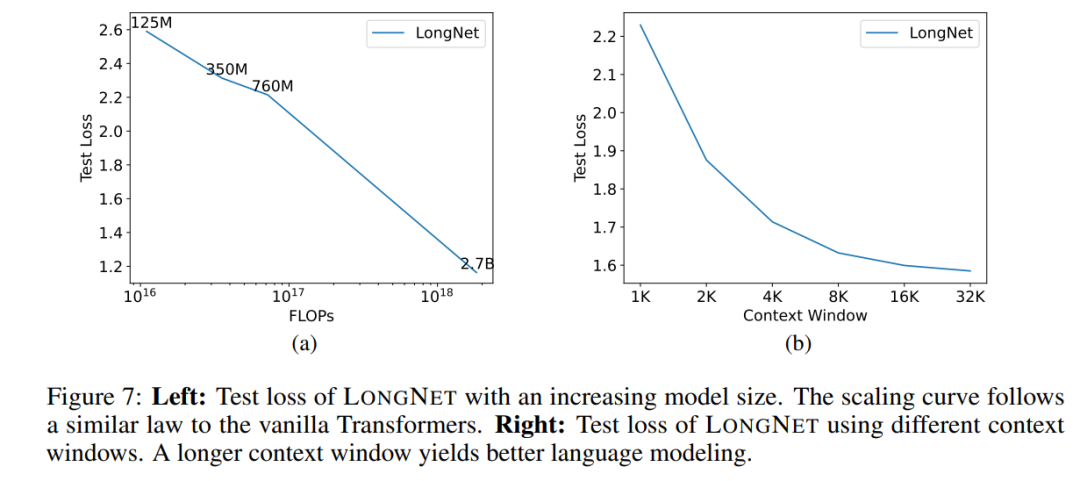

Lengkung pengembangan panjang jujukan

Rajah 6 memplotkan lengkung pengembangan panjang jujukan pengubah vanila dan LONGNET. Kajian ini menganggarkan usaha pengiraan dengan mengira jumlah flop pendaraban matriks. Keputusan menunjukkan bahawa kedua-dua pengubah vanila dan LONGNET mencapai panjang konteks yang lebih besar daripada latihan. Walau bagaimanapun, LONGNET boleh memanjangkan panjang konteks dengan lebih cekap, mencapai kehilangan ujian yang lebih rendah dengan kurang pengiraan. Ini menunjukkan kelebihan input latihan yang lebih lama berbanding ekstrapolasi. Eksperimen menunjukkan bahawa LONGNET ialah cara yang lebih cekap untuk memanjangkan panjang konteks dalam model bahasa. Ini kerana LONGNET boleh mempelajari kebergantungan yang lebih panjang dengan lebih cekap. . Untuk mengesahkan sama ada LONGNET masih mengikut peraturan penskalaan yang sama, kajian itu melatih satu siri model dengan saiz model yang berbeza (daripada 125 juta hingga 2.7 bilion parameter). 2.7 bilion model telah dilatih dengan token 300B, manakala model selebihnya menggunakan kira-kira 400B token. Rajah 7 (a) memplotkan lengkung penskalaan LONGNET berkenaan dengan pengiraan. Kajian itu mengira kerumitan pada set ujian yang sama. Ini membuktikan bahawa LONGNET masih boleh mengikut undang-undang kuasa. Ini juga bermakna Transformer padat bukanlah prasyarat untuk melanjutkan model bahasa. Selain itu, kebolehskalaan dan kecekapan diperoleh dengan LONGNET. Prompt konteks panjang Kajian ini mengekalkan awalan (awalan) sebagai gesaan dan menguji kebingungan imbuhannya (akhiran). Selain itu, semasa proses penyelidikan, gesaan telah dikembangkan secara beransur-ansur daripada 2K kepada 32K. Untuk membuat perbandingan yang saksama, panjang akhiran dikekalkan tetap manakala panjang awalan ditambah kepada panjang maksimum model. Rajah 7(b) melaporkan keputusan pada set ujian. Ia menunjukkan bahawa kehilangan ujian LONGNET secara beransur-ansur berkurangan apabila tetingkap konteks meningkat. Ini membuktikan keunggulan LONGNET dalam menggunakan sepenuhnya konteks panjang untuk menambah baik model bahasa.

Atas ialah kandungan terperinci Kertas hangat baharu Microsoft: Transformer berkembang kepada 1 bilion token. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1377

1377

52

52

![Cara Menunjukkan Kelajuan Internet pada Bar Tugas [Langkah Mudah]](https://img.php.cn/upload/article/000/465/014/169088173253603.png?x-oss-process=image/resize,m_fill,h_207,w_330) Cara Menunjukkan Kelajuan Internet pada Bar Tugas [Langkah Mudah]

Aug 01, 2023 pm 05:22 PM

Cara Menunjukkan Kelajuan Internet pada Bar Tugas [Langkah Mudah]

Aug 01, 2023 pm 05:22 PM

Kelajuan Internet ialah parameter penting dalam menentukan hasil pengalaman dalam talian anda. Sama ada memuat turun atau memuat naik fail atau hanya melayari web, kita semua memerlukan sambungan internet yang baik. Inilah sebabnya mengapa pengguna mencari cara untuk memaparkan kelajuan internet pada bar tugas. Memaparkan kelajuan rangkaian dalam bar tugas membolehkan pengguna memantau perkara dengan cepat, tidak kira tugas yang sedang dijalankan. Bar tugas sentiasa kelihatan melainkan anda berada dalam mod skrin penuh. Tetapi Windows tidak menawarkan pilihan asli untuk memaparkan kelajuan internet dalam bar tugas. Itulah sebabnya anda memerlukan alat pihak ketiga. Teruskan membaca untuk mengetahui semua tentang pilihan terbaik! Bagaimana untuk menjalankan ujian kelajuan dari baris arahan Windows? Tekan + untuk membuka Run, taip power shell dan tekan ++. Tingkap

Betulkan: Isu sambungan rangkaian yang menghalang akses kepada Internet dalam Mod Selamat Windows 11

Sep 23, 2023 pm 01:13 PM

Betulkan: Isu sambungan rangkaian yang menghalang akses kepada Internet dalam Mod Selamat Windows 11

Sep 23, 2023 pm 01:13 PM

Tidak mempunyai sambungan internet pada komputer Windows 11 anda dalam Safe Mode with Networking boleh mengecewakan, terutamanya apabila mendiagnosis dan menyelesaikan masalah sistem. Dalam panduan ini, kami akan membincangkan potensi punca masalah dan menyenaraikan penyelesaian yang berkesan untuk memastikan anda boleh mengakses internet dalam Mod Selamat. Mengapa tiada internet dalam mod selamat dengan rangkaian? Penyesuai rangkaian tidak serasi atau tidak dimuatkan dengan betul. Firewall pihak ketiga, perisian keselamatan atau perisian antivirus mungkin mengganggu sambungan rangkaian dalam mod selamat. Perkhidmatan rangkaian tidak berjalan. Jangkitan Hasad Apakah yang perlu saya lakukan jika Internet tidak boleh digunakan dalam Safe Mode pada Windows 11? Sebelum melakukan langkah penyelesaian masalah lanjutan, anda harus mempertimbangkan untuk melakukan semakan berikut: Pastikan untuk menggunakan

Kertas Stable Diffusion 3 akhirnya telah dikeluarkan, dan butiran seni bina didedahkan Adakah ia akan membantu untuk menghasilkan semula Sora?

Mar 06, 2024 pm 05:34 PM

Kertas Stable Diffusion 3 akhirnya telah dikeluarkan, dan butiran seni bina didedahkan Adakah ia akan membantu untuk menghasilkan semula Sora?

Mar 06, 2024 pm 05:34 PM

Kertas StableDiffusion3 akhirnya di sini! Model ini dikeluarkan dua minggu lalu dan menggunakan seni bina DiT (DiffusionTransformer) yang sama seperti Sora. Ia menimbulkan kekecohan apabila ia dikeluarkan. Berbanding dengan versi sebelumnya, kualiti imej yang dijana oleh StableDiffusion3 telah dipertingkatkan dengan ketara Ia kini menyokong gesaan berbilang tema, dan kesan penulisan teks juga telah dipertingkatkan, dan aksara bercelaru tidak lagi muncul. StabilityAI menegaskan bahawa StableDiffusion3 ialah satu siri model dengan saiz parameter antara 800M hingga 8B. Julat parameter ini bermakna model boleh dijalankan terus pada banyak peranti mudah alih, dengan ketara mengurangkan penggunaan AI

Anugerah kertas ICCV'23 'Fighting of Gods'! Meta Divide Everything dan ControlNet telah dipilih secara bersama, dan terdapat satu lagi artikel yang mengejutkan para hakim

Oct 04, 2023 pm 08:37 PM

Anugerah kertas ICCV'23 'Fighting of Gods'! Meta Divide Everything dan ControlNet telah dipilih secara bersama, dan terdapat satu lagi artikel yang mengejutkan para hakim

Oct 04, 2023 pm 08:37 PM

ICCV2023, persidangan penglihatan komputer teratas yang diadakan di Paris, Perancis, baru sahaja tamat! Anugerah kertas terbaik tahun ini hanyalah "pergaduhan antara tuhan". Sebagai contoh, dua kertas kerja yang memenangi Anugerah Kertas Terbaik termasuk ControlNet, sebuah karya yang menumbangkan bidang AI graf Vincentian. Sejak menjadi sumber terbuka, ControlNet telah menerima 24k bintang di GitHub. Sama ada untuk model resapan atau keseluruhan bidang penglihatan komputer, anugerah kertas ini sememangnya wajar diberi penghormatan untuk anugerah kertas terbaik telah dianugerahkan kepada satu lagi kertas kerja yang sama terkenal, Meta "Separate Everything" ”Model SAM. Sejak pelancarannya, "Segment Everything" telah menjadi "penanda aras" untuk pelbagai model AI segmentasi imej, termasuk yang datang dari belakang.

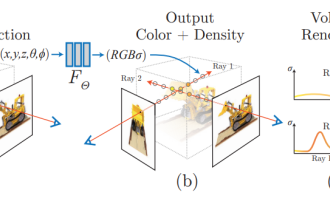

NeRF dan pemanduan autonomi masa lalu dan sekarang, ringkasan hampir 10 kertas kerja!

Nov 14, 2023 pm 03:09 PM

NeRF dan pemanduan autonomi masa lalu dan sekarang, ringkasan hampir 10 kertas kerja!

Nov 14, 2023 pm 03:09 PM

Sejak Medan Sinaran Neural dicadangkan pada tahun 2020, bilangan kertas kerja yang berkaitan telah meningkat secara eksponen. Ia bukan sahaja menjadi hala tuju cabang penting pembinaan semula tiga dimensi, tetapi juga secara beransur-ansur menjadi aktif di sempadan penyelidikan sebagai alat penting untuk pemanduan autonomi. . NeRF telah muncul secara tiba-tiba dalam tempoh dua tahun yang lalu, terutamanya kerana ia melangkau pengekstrakan dan pemadanan titik ciri, geometri dan triangulasi epipolar, PnP serta Pelarasan Bundle dan langkah lain dalam saluran paip pembinaan semula CV tradisional, malah melangkau pembinaan semula jaringan, pemetaan dan pengesanan cahaya , terus daripada 2D Imej input digunakan untuk mempelajari medan sinaran, dan kemudian imej yang dihasilkan yang menghampiri foto sebenar adalah output daripada medan sinaran. Dengan kata lain, biarkan model tiga dimensi tersirat berdasarkan rangkaian saraf sesuai dengan perspektif yang ditentukan

Ilustrasi kertas juga boleh dijana secara automatik, menggunakan model resapan, dan juga diterima oleh ICLR.

Jun 27, 2023 pm 05:46 PM

Ilustrasi kertas juga boleh dijana secara automatik, menggunakan model resapan, dan juga diterima oleh ICLR.

Jun 27, 2023 pm 05:46 PM

Generatif AI telah menarik perhatian komuniti kecerdasan buatan Kedua-dua individu dan perusahaan telah mula berminat untuk mencipta aplikasi penukaran modal yang berkaitan, seperti gambar Vincent, video Vincent, muzik Vincent, dll. Baru-baru ini, beberapa penyelidik dari institusi penyelidikan saintifik seperti ServiceNow Research dan LIVIA telah cuba menjana carta dalam kertas kerja berdasarkan penerangan teks. Untuk tujuan ini, mereka mencadangkan kaedah baru FigGen, dan kertas berkaitan juga dimasukkan dalam ICLR2023 sebagai TinyPaper. Alamat kertas bergambar: https://arxiv.org/pdf/2306.00800.pdf Sesetengah orang mungkin bertanya, apakah yang sukar untuk menjana carta dalam kertas itu? Bagaimanakah ini membantu penyelidikan saintifik?

Tangkapan skrin sembang mendedahkan peraturan tersembunyi semakan AI! AAAAI 3000 yuan kuat terima?

Apr 12, 2023 am 08:34 AM

Tangkapan skrin sembang mendedahkan peraturan tersembunyi semakan AI! AAAAI 3000 yuan kuat terima?

Apr 12, 2023 am 08:34 AM

Ketika tarikh akhir penyerahan kertas AAI 2023 semakin hampir, tangkapan skrin sembang tanpa nama dalam kumpulan penyerahan AI tiba-tiba muncul di Zhihu. Salah seorang daripada mereka mendakwa bahawa dia boleh menyediakan perkhidmatan "3,000 yuan terima kuat". Sejurus berita itu keluar, ia segera membangkitkan kemarahan orang ramai di kalangan netizen. Namun, jangan tergesa-gesa lagi. Bos Zhihu "Fine Tuning" berkata bahawa ini kemungkinan besar hanya "keseronokan lisan". Menurut "Fine Tuning", salam dan jenayah geng adalah masalah yang tidak dapat dielakkan dalam apa jua bidang. Dengan kebangkitan openreview, pelbagai kelemahan cmt telah menjadi lebih jelas Pada masa hadapan, ruang yang ditinggalkan untuk bulatan kecil untuk beroperasi akan menjadi lebih kecil, tetapi akan sentiasa ada ruang. Kerana ini adalah masalah peribadi, bukan masalah dengan sistem dan mekanisme penyerahan. Memperkenalkan open r

Kedudukan CVPR 2023 dikeluarkan, kadar penerimaan ialah 25.78%! 2,360 kertas telah diterima, dan bilangan penyerahan meningkat kepada 9,155

Apr 13, 2023 am 09:37 AM

Kedudukan CVPR 2023 dikeluarkan, kadar penerimaan ialah 25.78%! 2,360 kertas telah diterima, dan bilangan penyerahan meningkat kepada 9,155

Apr 13, 2023 am 09:37 AM

Sebentar tadi, CVPR 2023 mengeluarkan kenyataan yang mengatakan: Tahun ini, kami menerima rekod 9,155 kertas (peningkatan 12% daripada CVPR 2022), dan menerima 2,360 kertas, dengan kadar penerimaan 25.78%. Mengikut statistik, bilangan penyerahan kepada CVPR hanya meningkat daripada 1,724 kepada 2,145 dalam tempoh 7 tahun dari 2010 hingga 2016. Selepas 2017, ia melonjak dengan pesat dan memasuki tempoh pertumbuhan pesat Pada 2019, ia melebihi 5,000 buat kali pertama, dan menjelang 2022, jumlah penyerahan telah mencapai 8,161. Seperti yang anda lihat, sebanyak 9,155 kertas telah diserahkan pada tahun ini, sememangnya mencatat rekod. Selepas wabak itu dilonggarkan, sidang kemuncak CVPR tahun ini akan diadakan di Kanada. Tahun ini ia akan menjadi persidangan trek tunggal dan pemilihan Lisan tradisional akan dibatalkan. penyelidikan google