Apakah sumber keupayaan pembelajaran kontekstual Transformer?

Mengapa transformer berprestasi baik? Dari manakah datangnya keupayaan Pembelajaran Dalam Konteks yang dibawanya kepada banyak model bahasa besar? Dalam bidang kecerdasan buatan, transformer telah menjadi model dominan dalam pembelajaran mendalam, tetapi asas teori untuk prestasi cemerlangnya tidak dikaji dengan secukupnya.

Baru-baru ini, penyelidik dari Google AI, ETH Zurich dan Google DeepMind menjalankan kajian baharu untuk cuba membongkar rahsia beberapa algoritma pengoptimuman dalam Google AI. Dalam kajian ini, mereka merekayasa balik pengubah dan menemui beberapa kaedah pengoptimuman. Makalah ini dipanggil "Mendedahkan Algoritma Pengoptimuman Mesa dalam Transformer"

Pautan kertas: https://arxiv.org/abs/2309.05858

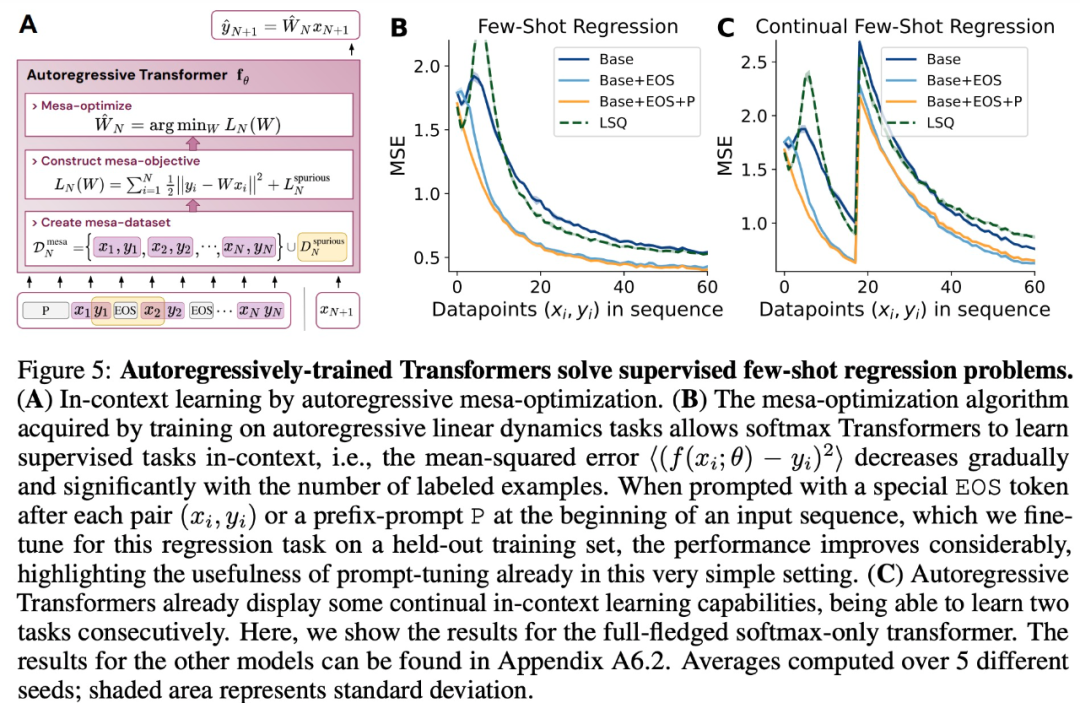

Pengarang yang meminimumkan kerugian akan menghasilkan autogresif yang universal. algoritma pengoptimuman berasaskan kecerunan tambahan yang berjalan dalam hantaran hadapan Transformer. Fenomena ini baru-baru ini dipanggil "pengoptimuman mesa." Tambahan pula, penyelidik mendapati bahawa algoritma pengoptimuman mesa yang terhasil mempamerkan keupayaan pembelajaran pukulan kecil kontekstual, bebas daripada saiz model. Oleh itu, keputusan baharu melengkapkan prinsip pembelajaran pukulan kecil yang telah muncul sebelum ini dalam model bahasa besar.

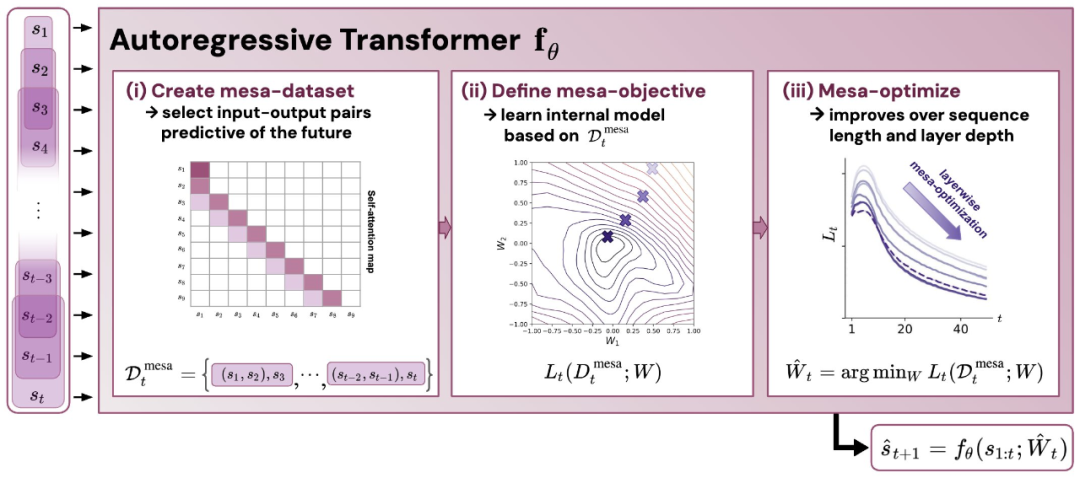

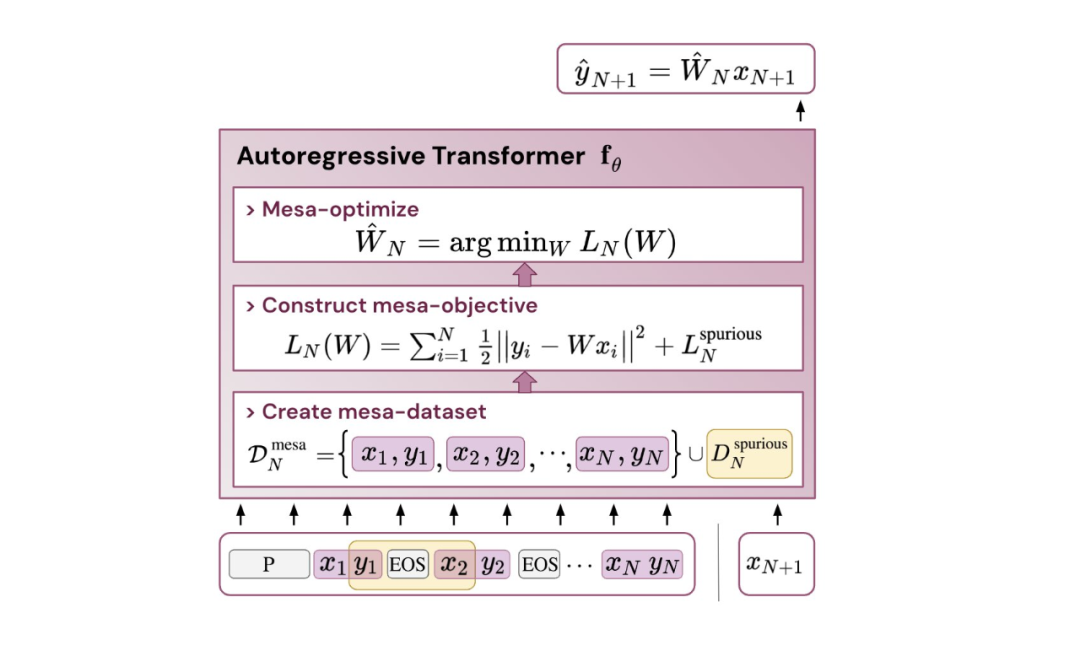

Para penyelidik percaya bahawa kejayaan Transformers adalah berdasarkan bias seni bina algoritma pengoptimuman Mesa yang dilaksanakannya dalam pas ke hadapan: (i) mentakrifkan matlamat pembelajaran dalaman, dan (ii) mengoptimumkannya

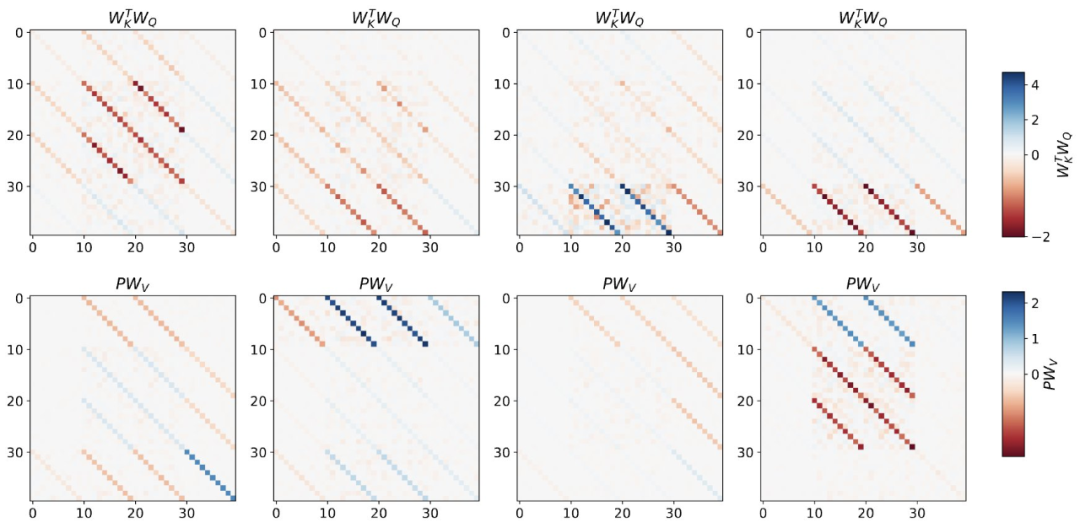

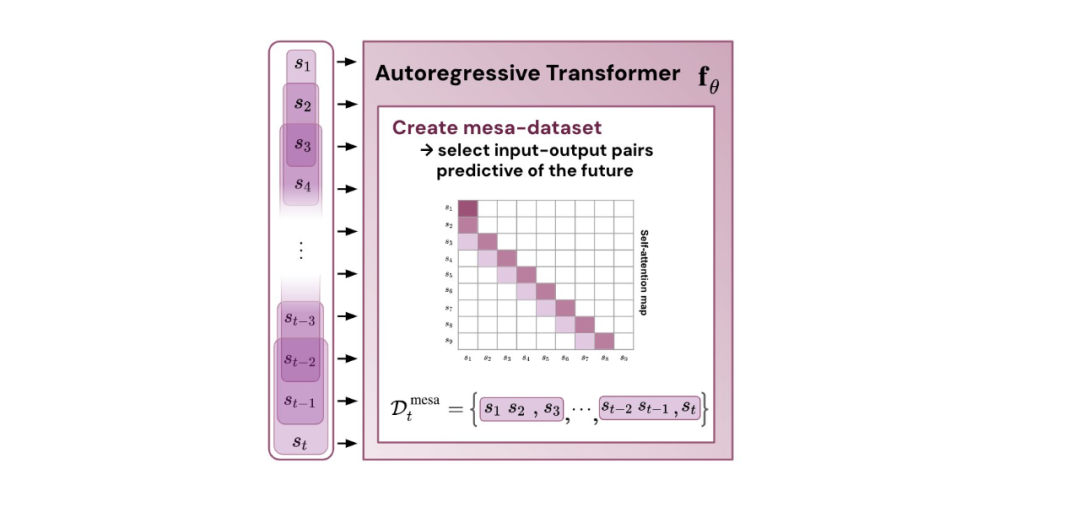

Rajah 1: Ilustrasi hipotesis baharu: mengoptimumkan pemberat θ bagi Transformer autoregresif fθ menghasilkan algoritma pengoptimuman mesa yang dilaksanakan dalam perambatan hadapan model. Sebagai urutan input s_1, . . , s_t diproses ke langkah masa t, Transformer (i) mencipta set latihan dalaman yang terdiri daripada pasangan persatuan sasaran input, (ii) mentakrifkan fungsi objektif dalaman melalui set data hasil, yang digunakan untuk mengukur prestasi model dalaman menggunakan pemberat W, (iii) Optimumkan objektif ini dan gunakan model yang dipelajari untuk menjana ramalan masa hadapan .

.

Sumbangan kajian ini termasuk yang berikut:

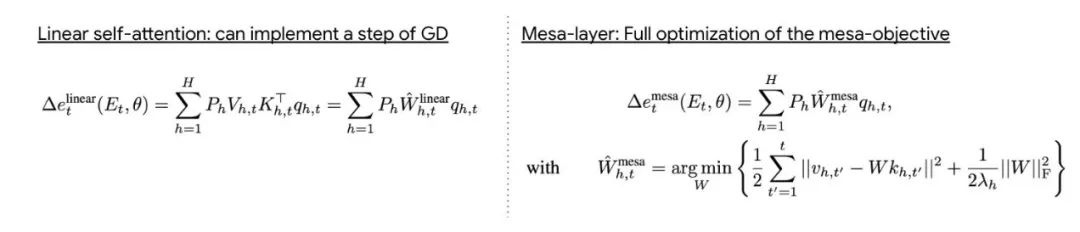

- Mengumumkan teori von Oswald et al dan menunjukkan bagaimana Transformers secara teori boleh mengoptimumkan objektif yang dibina secara dalaman daripada regresi menggunakan kaedah berasaskan kecerunan seterusnya. urutan.

- Transformer kejuruteraan terbalik secara eksperimen dilatih pada tugas pemodelan jujukan mudah dan menemui bukti kukuh bahawa hantaran hadapan mereka melaksanakan algoritma dua langkah: (i) lapisan perhatian kendiri awal melalui penanda pengumpulan dan salinan membina set data latihan dalaman, jadi set data latihan dalaman dibina secara tersirat. Tentukan fungsi objektif dalaman dan (ii) optimumkan objektif ini pada tahap yang lebih mendalam untuk menjana ramalan.

- Sama seperti LLM, eksperimen menunjukkan bahawa model latihan autoregresif mudah juga boleh menjadi pelajar konteks, dan pelarasan segera adalah penting untuk meningkatkan pembelajaran konteks LLM dan juga boleh meningkatkan prestasi dalam persekitaran tertentu.

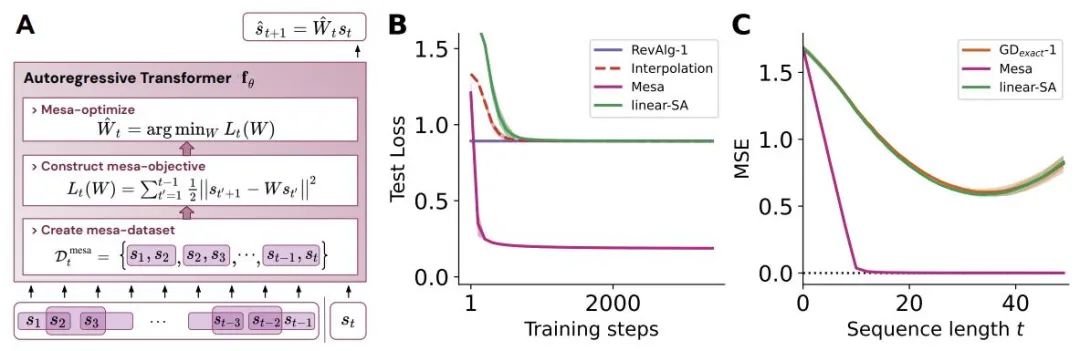

- Diinspirasikan oleh penemuan bahawa lapisan perhatian cuba mengoptimumkan fungsi objektif dalaman secara tersirat, pengarang memperkenalkan lapisan mesa, jenis lapisan perhatian baharu yang boleh menyelesaikan masalah pengoptimuman kuasa dua terkecil dan bukannya hanya mengambil satu langkah kecerunan. untuk mencapai optimum. Percubaan menunjukkan bahawa satu lapisan mesa mengatasi Transformer perhatian kendiri linear dalam dan softmax pada tugas berjujukan mudah sambil memberikan lebih kebolehtafsiran.

- Selepas eksperimen pemodelan bahasa awal, didapati bahawa menggantikan lapisan perhatian kendiri standard dengan lapisan mesa mencapai hasil yang menjanjikan, membuktikan bahawa lapisan ini mempunyai keupayaan kontekstual yang kukuh.

Berdasarkan kerja baru-baru ini yang menunjukkan bahawa transformer yang dilatih secara eksplisit untuk menyelesaikan tugasan kecil dalam konteks boleh melaksanakan algoritma keturunan kecerunan (GD). Di sini, pengarang menunjukkan bahawa keputusan ini digeneralisasikan kepada pemodelan jujukan autoregresif-pendekatan tipikal untuk melatih LLM.

Pertama, analisa Transformer yang dilatih pada dinamik linear mudah. Dalam kes ini, setiap jujukan dijana oleh W* yang berbeza untuk mengelakkan hafalan jujukan silang. Dalam persediaan mudah ini, penyelidik menunjukkan cara Transformer mencipta set data mesa dan menggunakan GD praproses untuk mengoptimumkan objektif mesa

Kandungan yang ditulis semula ialah: kita boleh mengagregatkan struktur token unsur jujukan bersebelahan dengan melatih pengubah dalam. Menariknya, kaedah prapemprosesan mudah ini menghasilkan matriks berat yang sangat jarang (kurang daripada 1% berat adalah bukan sifar), menghasilkan algoritma kejuruteraan terbalik

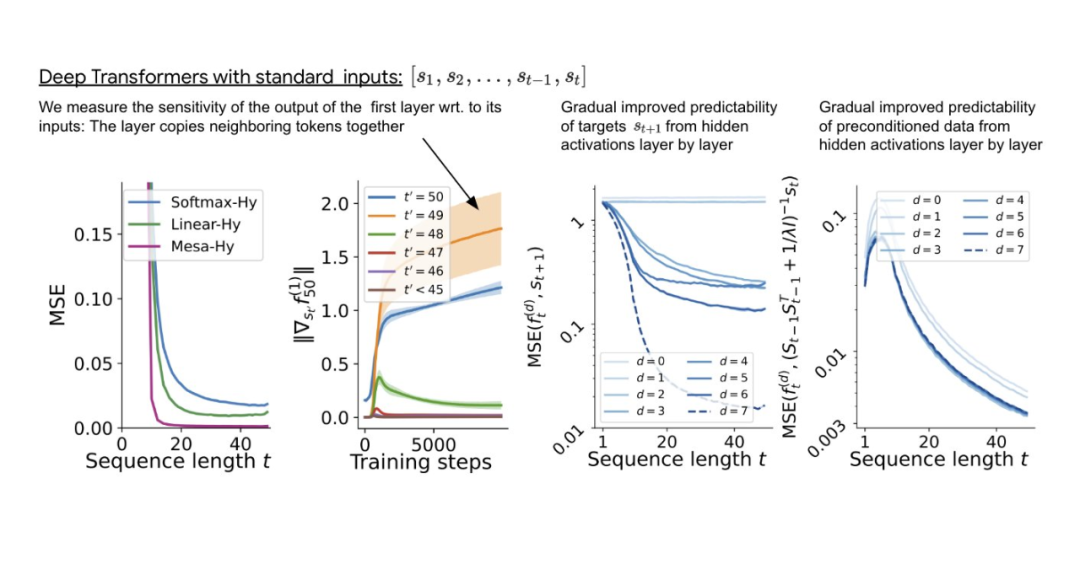

Untuk perhatian kendiri linear satu lapisan, pemberat Sepadan dengan langkah penurunan kecerunan. Untuk Transformer mendalam, kebolehtafsiran menjadi sukar. Kajian ini bergantung pada probing linear dan meneliti sama ada pengaktifan tersembunyi dapat meramalkan sasaran autoregresif atau input praproses

Menariknya, kebolehramalan kedua-dua kaedah probing secara beransur-ansur bertambah baik dengan peningkatan kedalaman rangkaian. Dapatan ini menunjukkan bahawa GD praproses tersembunyi dalam model.

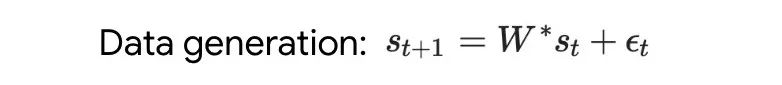

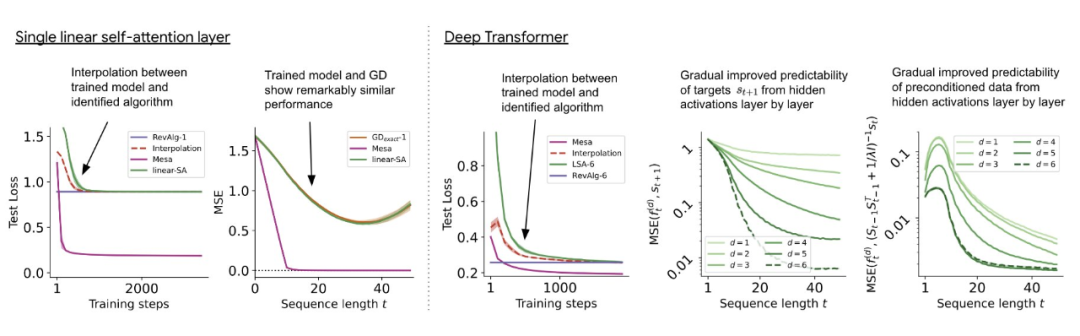

Rajah 2: Kejuruteraan songsang lapisan perhatian kendiri linear terlatih.

Kajian mendapati bahawa lapisan latihan boleh dipasang dengan sempurna apabila menggunakan semua darjah kebebasan dalam pembinaan, termasuk bukan sahaja kadar pembelajaran yang dipelajari η, tetapi juga satu set pemberat awal yang dipelajari W_0. Yang penting, seperti yang ditunjukkan dalam Rajah 2, algoritma satu langkah yang dipelajari masih berprestasi jauh lebih baik daripada satu lapisan mesa.

Dengan tetapan berat yang mudah, kita dapat melihat bahawa adalah mudah untuk mencari melalui pengoptimuman asas bahawa lapisan ini boleh menyelesaikan tugas penyelidikan ini secara optimum. Keputusan ini membuktikan bahawa bias induktif pengekodan keras bermanfaat untuk pengoptimuman mesa

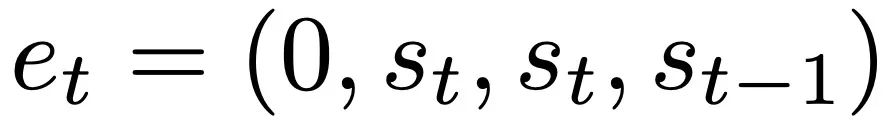

Dengan cerapan teori ke dalam kes berbilang lapisan, mula-mula analisa linear dalam dan softmax dan beri perhatian hanya kepada Transformer. Pengarang memformat input mengikut struktur 4 saluran,  , yang sepadan dengan pilihan W_0 = 0.

, yang sepadan dengan pilihan W_0 = 0.

Seperti model satu lapisan, penulis melihat struktur yang jelas dalam berat model terlatih. Sebagai analisis kejuruteraan terbalik yang pertama, kajian ini mengeksploitasi struktur ini dan membina algoritma (RevAlg-d, dengan d mewakili bilangan lapisan) yang mengandungi 16 parameter setiap pengepala lapisan (bukannya 3200). Penulis mendapati bahawa ungkapan termampat tetapi kompleks ini boleh menggambarkan model terlatih. Khususnya, ia membenarkan interpolasi antara Transformer sebenar dan pemberat RevAlg-d dalam cara yang hampir tanpa kerugian

Walaupun ungkapan RevAlg-d menerangkan Transformer berbilang lapisan terlatih dengan sebilangan kecil parameter bebas, ia adalah sukar untuk menukar Ia dijelaskan sebagai algoritma pengoptimuman mesa. Oleh itu, penulis menggunakan analisis probing regresi linear (Alain & Bengio, 2017; Akyürek et al., 2023) untuk mencari ciri-ciri algoritma pengoptimuman mesa yang dihipotesiskan.

Pada Transformer perhatian kendiri linear dalam yang ditunjukkan dalam Rajah 3, kita dapat memerhatikan bahawa kedua-dua probe mampu untuk penyahkodan linear, dan apabila panjang jujukan dan kedalaman rangkaian meningkat, prestasi penyahkodan juga meningkat. Oleh itu, kami menemui algoritma pengoptimuman asas yang menurun lapisan demi lapisan berdasarkan objektif mesa asal Lt (W) sambil menambah baik nombor keadaan masalah pengoptimuman mesa. Ini mengakibatkan penurunan pesat dalam objektif mesa Lt (W). Tambahan pula, kita juga dapat melihat bahawa prestasi meningkat dengan ketara apabila kedalaman meningkat

Dengan prapemprosesan data yang lebih baik, fungsi objektif autoregresif Lt (W) boleh dioptimumkan secara berperingkat (merentasi lapisan), jadi penurunan pantas boleh dipertimbangkan Ia dicapai melalui pengoptimuman ini

Rajah 3: Latihan Transformer berbilang lapisan untuk kejuruteraan terbalik input token yang dibina.

Ini menunjukkan bahawa jika transformer dilatih pada token yang dibina, ia akan meramalkan dengan pengoptimuman mesa. Menariknya, apabila elemen jujukan diberikan secara langsung, pengubah akan membina token dengan sendirinya dengan mengumpulkan elemen, yang dipanggil oleh pasukan penyelidik sebagai "mencipta dataset mesa".

Kesimpulan

Dapatan kajian ini ialah apabila model Transformer digunakan untuk latihan mengenai tugas ramalan jujukan di bawah objektif autoregresif standard, Algoritma inferens berasaskan kecerunan boleh dibangunkan. Oleh itu, keputusan multi-tugas dan meta-pembelajaran terkini juga boleh digunakan untuk tetapan latihan LLM penyeliaan kendiri tradisional

Selain itu, kajian juga mendapati bahawa mereka yang belajar inferens autoregresif Algoritma boleh digunakan semula untuk menyelesaikan tugas pembelajaran kontekstual yang diselia tanpa perlu latihan semula, dengan itu mentafsir keputusan dalam rangka kerja yang bersatu 🎜#

Jadi, apakah kaitannya dengan pembelajaran kontekstual? Menurut kajian itu, selepas melatih model pengubah, pada tugas jujukan autoregresif, ia mencapai pengoptimuman mesa yang sesuai dan oleh itu boleh melakukan pembelajaran konteks beberapa pukulan tanpa sebarang penalaan halus

Kajian ini mengandaikan bahawa pengoptimuman mesa juga wujud dalam LLM, dengan itu meningkatkan keupayaan pembelajaran konteksnya. Menariknya, kajian itu juga mendapati bahawa menyesuaikan gesaan secara berkesan untuk LLM juga boleh membawa kepada peningkatan yang ketara dalam keupayaan pembelajaran kontekstual.

#🎜🎜🎜##🎜🎜🎜##🎜🎜🎜 🎜#Pembaca yang berminat boleh membaca teks asal kertas untuk mengetahui lebih lanjut tentang kandungan penyelidikan.

#🎜🎜🎜##🎜🎜🎜##🎜🎜🎜 🎜#Pembaca yang berminat boleh membaca teks asal kertas untuk mengetahui lebih lanjut tentang kandungan penyelidikan.

Atas ialah kandungan terperinci Apakah sumber keupayaan pembelajaran kontekstual Transformer?. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1384

1384

52

52

Bytedance Cutting melancarkan keahlian super SVIP: 499 yuan untuk langganan tahunan berterusan, menyediakan pelbagai fungsi AI

Jun 28, 2024 am 03:51 AM

Bytedance Cutting melancarkan keahlian super SVIP: 499 yuan untuk langganan tahunan berterusan, menyediakan pelbagai fungsi AI

Jun 28, 2024 am 03:51 AM

Laman web ini melaporkan pada 27 Jun bahawa Jianying ialah perisian penyuntingan video yang dibangunkan oleh FaceMeng Technology, anak syarikat ByteDance Ia bergantung pada platform Douyin dan pada asasnya menghasilkan kandungan video pendek untuk pengguna platform tersebut Windows , MacOS dan sistem pengendalian lain. Jianying secara rasmi mengumumkan peningkatan sistem keahliannya dan melancarkan SVIP baharu, yang merangkumi pelbagai teknologi hitam AI, seperti terjemahan pintar, penonjolan pintar, pembungkusan pintar, sintesis manusia digital, dsb. Dari segi harga, yuran bulanan untuk keratan SVIP ialah 79 yuan, yuran tahunan ialah 599 yuan (nota di laman web ini: bersamaan dengan 49.9 yuan sebulan), langganan bulanan berterusan ialah 59 yuan sebulan, dan langganan tahunan berterusan ialah 499 yuan setahun (bersamaan dengan 41.6 yuan sebulan) . Di samping itu, pegawai yang dipotong juga menyatakan bahawa untuk meningkatkan pengalaman pengguna, mereka yang telah melanggan VIP asal

Pembantu pengekodan AI yang ditambah konteks menggunakan Rag dan Sem-Rag

Jun 10, 2024 am 11:08 AM

Pembantu pengekodan AI yang ditambah konteks menggunakan Rag dan Sem-Rag

Jun 10, 2024 am 11:08 AM

Tingkatkan produktiviti, kecekapan dan ketepatan pembangun dengan menggabungkan penjanaan dipertingkatkan semula dan memori semantik ke dalam pembantu pengekodan AI. Diterjemah daripada EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, pengarang JanakiramMSV. Walaupun pembantu pengaturcaraan AI asas secara semulajadi membantu, mereka sering gagal memberikan cadangan kod yang paling relevan dan betul kerana mereka bergantung pada pemahaman umum bahasa perisian dan corak penulisan perisian yang paling biasa. Kod yang dijana oleh pembantu pengekodan ini sesuai untuk menyelesaikan masalah yang mereka bertanggungjawab untuk menyelesaikannya, tetapi selalunya tidak mematuhi piawaian pengekodan, konvensyen dan gaya pasukan individu. Ini selalunya menghasilkan cadangan yang perlu diubah suai atau diperhalusi agar kod itu diterima ke dalam aplikasi

Bolehkah penalaan halus benar-benar membolehkan LLM mempelajari perkara baharu: memperkenalkan pengetahuan baharu boleh menjadikan model menghasilkan lebih banyak halusinasi

Jun 11, 2024 pm 03:57 PM

Bolehkah penalaan halus benar-benar membolehkan LLM mempelajari perkara baharu: memperkenalkan pengetahuan baharu boleh menjadikan model menghasilkan lebih banyak halusinasi

Jun 11, 2024 pm 03:57 PM

Model Bahasa Besar (LLM) dilatih pada pangkalan data teks yang besar, di mana mereka memperoleh sejumlah besar pengetahuan dunia sebenar. Pengetahuan ini dibenamkan ke dalam parameter mereka dan kemudiannya boleh digunakan apabila diperlukan. Pengetahuan tentang model ini "diperbaharui" pada akhir latihan. Pada akhir pra-latihan, model sebenarnya berhenti belajar. Selaraskan atau perhalusi model untuk mempelajari cara memanfaatkan pengetahuan ini dan bertindak balas dengan lebih semula jadi kepada soalan pengguna. Tetapi kadangkala pengetahuan model tidak mencukupi, dan walaupun model boleh mengakses kandungan luaran melalui RAG, ia dianggap berfaedah untuk menyesuaikan model kepada domain baharu melalui penalaan halus. Penalaan halus ini dilakukan menggunakan input daripada anotasi manusia atau ciptaan LLM lain, di mana model menemui pengetahuan dunia sebenar tambahan dan menyepadukannya

Tujuh Soalan Temuduga Teknikal GenAI & LLM yang Cool

Jun 07, 2024 am 10:06 AM

Tujuh Soalan Temuduga Teknikal GenAI & LLM yang Cool

Jun 07, 2024 am 10:06 AM

Untuk mengetahui lebih lanjut tentang AIGC, sila layari: 51CTOAI.x Komuniti https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou berbeza daripada bank soalan tradisional yang boleh dilihat di mana-mana sahaja di Internet memerlukan pemikiran di luar kotak. Model Bahasa Besar (LLM) semakin penting dalam bidang sains data, kecerdasan buatan generatif (GenAI) dan kecerdasan buatan. Algoritma kompleks ini meningkatkan kemahiran manusia dan memacu kecekapan dan inovasi dalam banyak industri, menjadi kunci kepada syarikat untuk kekal berdaya saing. LLM mempunyai pelbagai aplikasi Ia boleh digunakan dalam bidang seperti pemprosesan bahasa semula jadi, penjanaan teks, pengecaman pertuturan dan sistem pengesyoran. Dengan belajar daripada sejumlah besar data, LLM dapat menjana teks

Lima sekolah pembelajaran mesin yang anda tidak tahu

Jun 05, 2024 pm 08:51 PM

Lima sekolah pembelajaran mesin yang anda tidak tahu

Jun 05, 2024 pm 08:51 PM

Pembelajaran mesin ialah cabang penting kecerdasan buatan yang memberikan komputer keupayaan untuk belajar daripada data dan meningkatkan keupayaan mereka tanpa diprogramkan secara eksplisit. Pembelajaran mesin mempunyai pelbagai aplikasi dalam pelbagai bidang, daripada pengecaman imej dan pemprosesan bahasa semula jadi kepada sistem pengesyoran dan pengesanan penipuan, dan ia mengubah cara hidup kita. Terdapat banyak kaedah dan teori yang berbeza dalam bidang pembelajaran mesin, antaranya lima kaedah yang paling berpengaruh dipanggil "Lima Sekolah Pembelajaran Mesin". Lima sekolah utama ialah sekolah simbolik, sekolah sambungan, sekolah evolusi, sekolah Bayesian dan sekolah analogi. 1. Simbolisme, juga dikenali sebagai simbolisme, menekankan penggunaan simbol untuk penaakulan logik dan ekspresi pengetahuan. Aliran pemikiran ini percaya bahawa pembelajaran adalah proses penolakan terbalik, melalui sedia ada

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Editor |ScienceAI Question Answering (QA) set data memainkan peranan penting dalam mempromosikan penyelidikan pemprosesan bahasa semula jadi (NLP). Set data QA berkualiti tinggi bukan sahaja boleh digunakan untuk memperhalusi model, tetapi juga menilai dengan berkesan keupayaan model bahasa besar (LLM), terutamanya keupayaan untuk memahami dan menaakul tentang pengetahuan saintifik. Walaupun pada masa ini terdapat banyak set data QA saintifik yang meliputi bidang perubatan, kimia, biologi dan bidang lain, set data ini masih mempunyai beberapa kekurangan. Pertama, borang data adalah agak mudah, kebanyakannya adalah soalan aneka pilihan. Ia mudah dinilai, tetapi mengehadkan julat pemilihan jawapan model dan tidak dapat menguji sepenuhnya keupayaan model untuk menjawab soalan saintifik. Sebaliknya, Soal Jawab terbuka

Pemula AI secara kolektif menukar pekerjaan kepada OpenAI, dan pasukan keselamatan berkumpul semula selepas Ilya pergi!

Jun 08, 2024 pm 01:00 PM

Pemula AI secara kolektif menukar pekerjaan kepada OpenAI, dan pasukan keselamatan berkumpul semula selepas Ilya pergi!

Jun 08, 2024 pm 01:00 PM

Minggu lalu, di tengah gelombang peletakan jawatan dalaman dan kritikan luar, OpenAI dibelenggu oleh masalah dalaman dan luaran: - Pelanggaran kakak balu itu mencetuskan perbincangan hangat global - Pekerja menandatangani "fasal tuan" didedahkan satu demi satu - Netizen menyenaraikan " Ultraman " tujuh dosa maut" ” Pembasmi khabar angin: Menurut maklumat dan dokumen bocor yang diperolehi oleh Vox, kepimpinan kanan OpenAI, termasuk Altman, sangat mengetahui peruntukan pemulihan ekuiti ini dan menandatanganinya. Di samping itu, terdapat isu serius dan mendesak yang dihadapi oleh OpenAI - keselamatan AI. Pemergian lima pekerja berkaitan keselamatan baru-baru ini, termasuk dua pekerjanya yang paling terkemuka, dan pembubaran pasukan "Penjajaran Super" sekali lagi meletakkan isu keselamatan OpenAI dalam perhatian. Majalah Fortune melaporkan bahawa OpenA

Prestasi SOTA, kaedah AI ramalan pertalian protein-ligan pelbagai mod Xiamen, menggabungkan maklumat permukaan molekul buat kali pertama

Jul 17, 2024 pm 06:37 PM

Prestasi SOTA, kaedah AI ramalan pertalian protein-ligan pelbagai mod Xiamen, menggabungkan maklumat permukaan molekul buat kali pertama

Jul 17, 2024 pm 06:37 PM

Editor |. KX Dalam bidang penyelidikan dan pembangunan ubat, meramalkan pertalian pengikatan protein dan ligan dengan tepat dan berkesan adalah penting untuk pemeriksaan dan pengoptimuman ubat. Walau bagaimanapun, kajian semasa tidak mengambil kira peranan penting maklumat permukaan molekul dalam interaksi protein-ligan. Berdasarkan ini, penyelidik dari Universiti Xiamen mencadangkan rangka kerja pengekstrakan ciri berbilang mod (MFE) novel, yang buat pertama kalinya menggabungkan maklumat mengenai permukaan protein, struktur dan jujukan 3D, dan menggunakan mekanisme perhatian silang untuk membandingkan ciri modaliti yang berbeza penjajaran. Keputusan eksperimen menunjukkan bahawa kaedah ini mencapai prestasi terkini dalam meramalkan pertalian mengikat protein-ligan. Tambahan pula, kajian ablasi menunjukkan keberkesanan dan keperluan maklumat permukaan protein dan penjajaran ciri multimodal dalam rangka kerja ini. Penyelidikan berkaitan bermula dengan "S