Dengan asas teori, kami boleh menjalankan pengoptimuman yang mendalam.

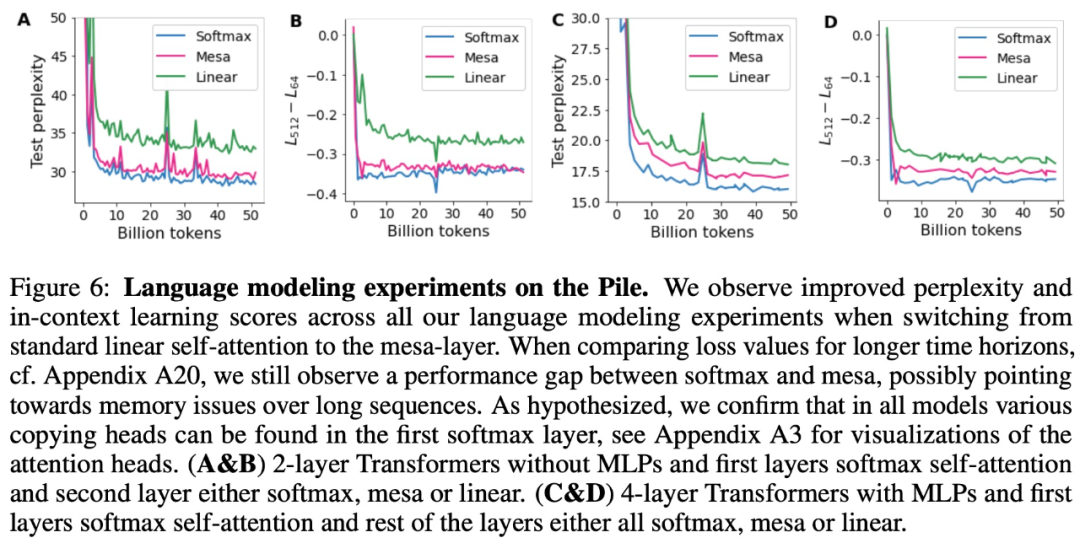

- Selepas eksperimen pemodelan bahasa awal, didapati bahawa menggantikan lapisan perhatian kendiri standard dengan lapisan mesa mencapai hasil yang menjanjikan, membuktikan bahawa lapisan ini mempunyai keupayaan pembelajaran kontekstual yang kuat.

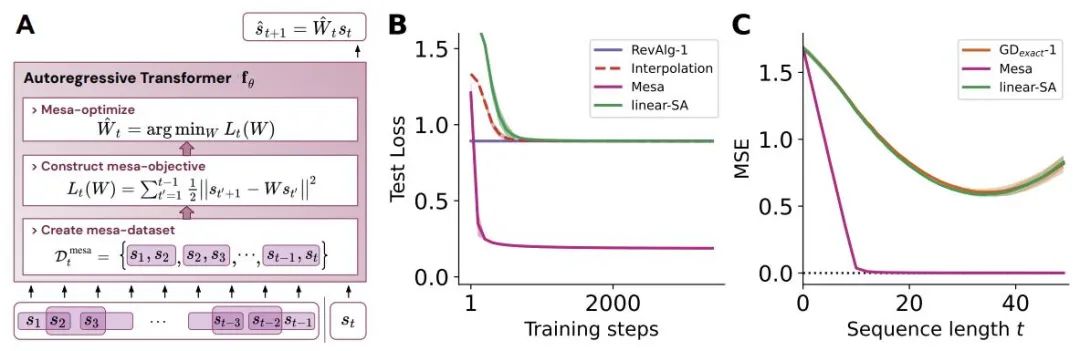

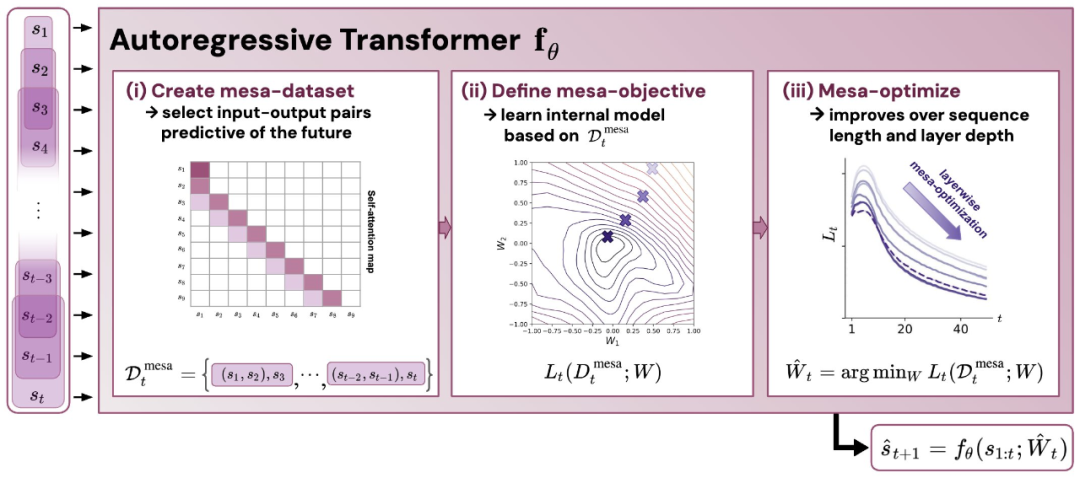

- Berdasarkan kerja baru-baru ini yang menunjukkan bahawa transformer yang dilatih secara eksplisit untuk menyelesaikan tugasan kecil dalam konteks boleh melaksanakan algoritma keturunan kecerunan (GD). Di sini, pengarang menunjukkan bahawa keputusan ini digeneralisasikan kepada pemodelan jujukan autoregresif-pendekatan tipikal untuk melatih LLM.

-

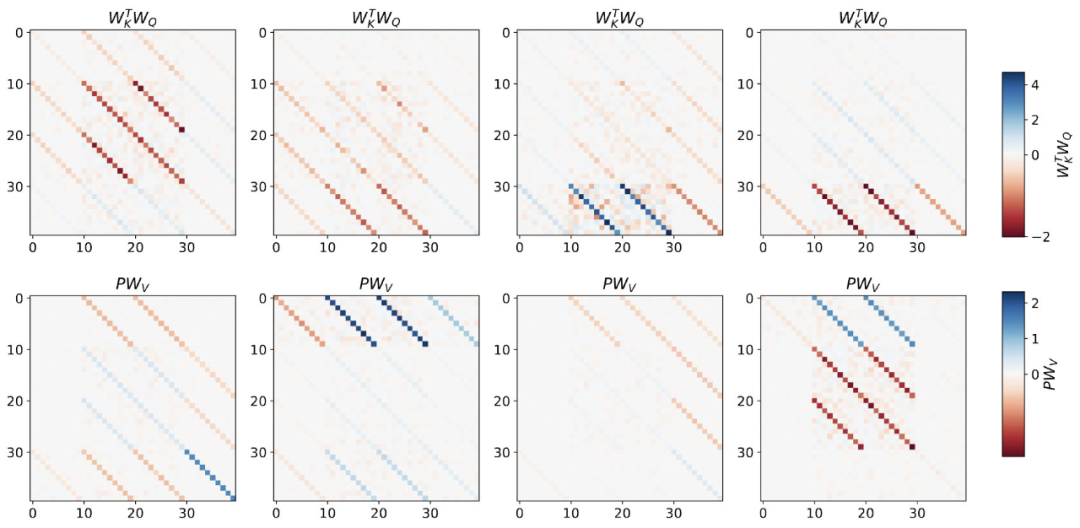

Kajian ini melatih pengubah dalam pada struktur token yang mengagregat unsur jujukan bersebelahan. Menariknya, prapemprosesan mudah ini menghasilkan matriks berat yang sangat jarang (kurang daripada 1% daripada pemberat adalah bukan sifar), menghasilkan algoritma kejuruteraan terbalik.

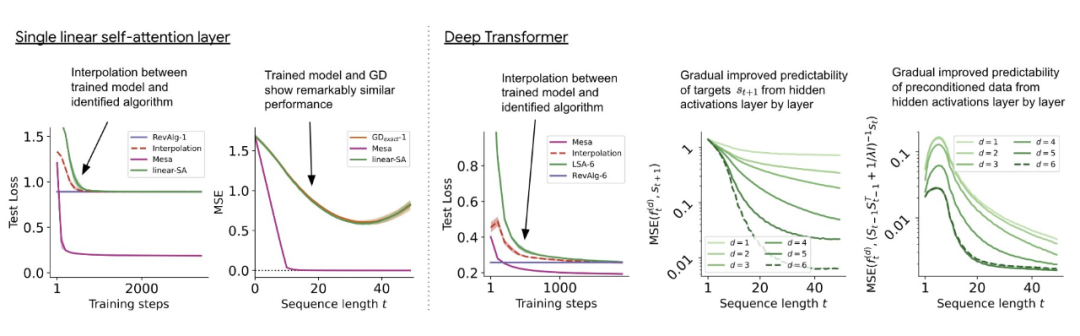

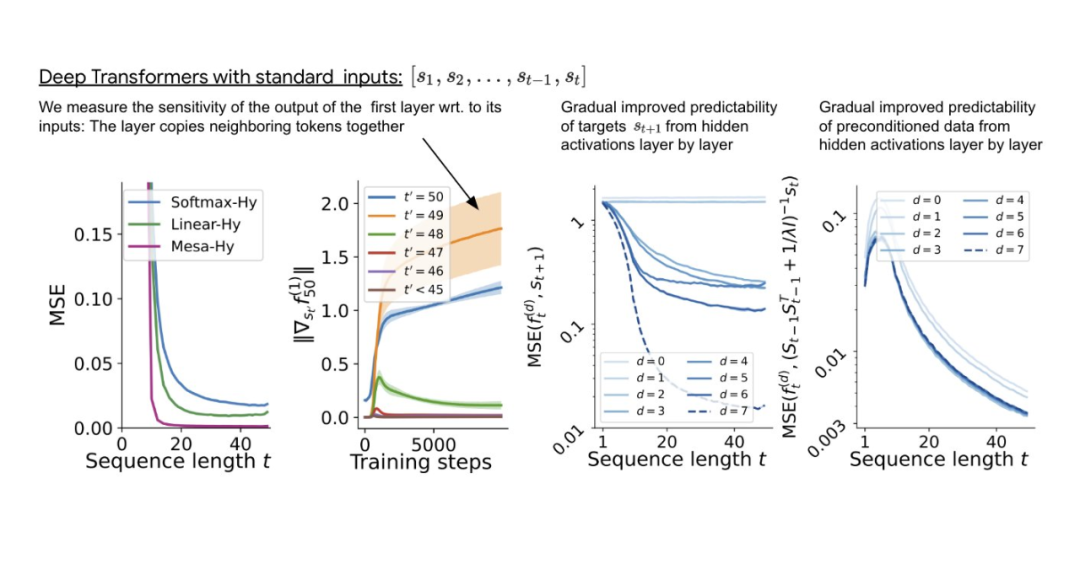

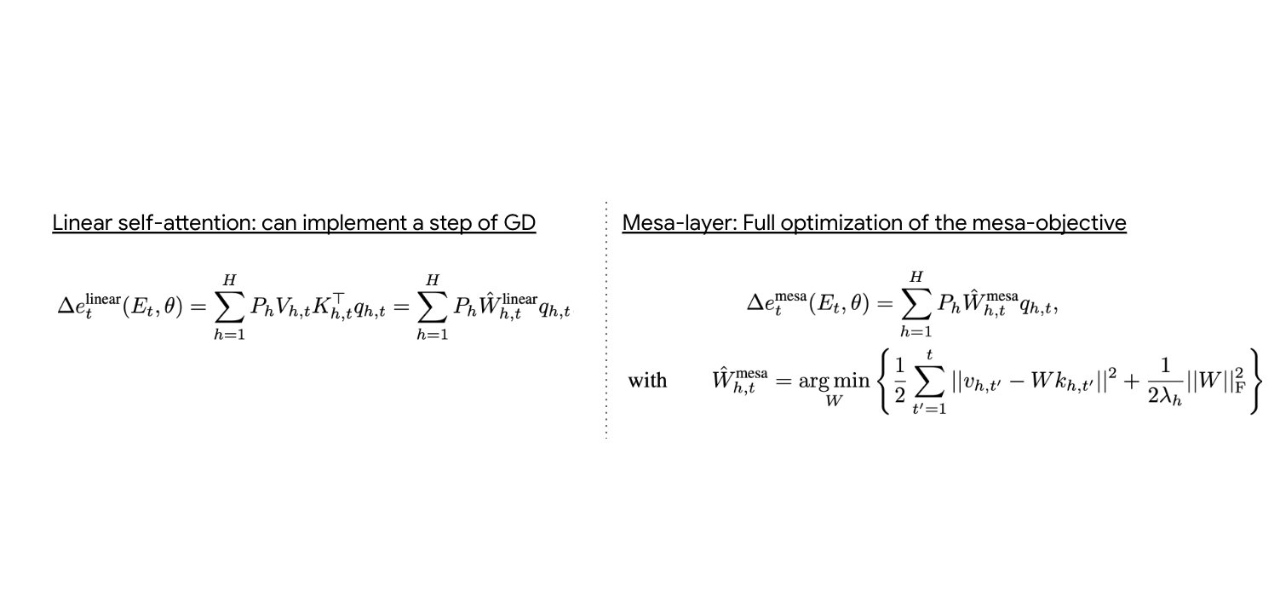

Untuk perhatian kendiri linear satu lapisan, berat sepadan dengan satu langkah GD. Untuk transformer dalam, kebolehtafsiran menjadi sukar. Kajian ini bergantung pada probing linear dan mengkaji sama ada pengaktifan tersembunyi meramalkan sasaran autoregresif atau input praproses. Menariknya, kebolehramalan kedua-dua kaedah pengesanan secara beransur-ansur bertambah baik apabila kedalaman rangkaian meningkat. Dapatan ini menunjukkan bahawa GD praproses tersembunyi dalam model. Rajah 2: Kejuruteraan songsang lapisan perhatian diri linear terlatih.

Kajian mendapati bahawa lapisan latihan boleh dipasang dengan sempurna apabila semua darjah kebebasan digunakan dalam pembinaan, termasuk bukan sahaja kadar pembelajaran yang dipelajari η, tetapi juga satu set pemberat awal yang dipelajari W_0. Yang penting, seperti yang ditunjukkan dalam Rajah 2, algoritma satu langkah yang dipelajari masih berprestasi jauh lebih baik daripada satu lapisan mesa.

Kita dapat perhatikan bahawa di bawah tetapan berat yang mudah, adalah mudah untuk mencari melalui pengoptimuman asas bahawa lapisan ini boleh menyelesaikan tugas yang dikaji di sini secara optimum. Keputusan ini menunjukkan kelebihan bias induktif berkod keras yang memihak kepada pengoptimuman mesa.

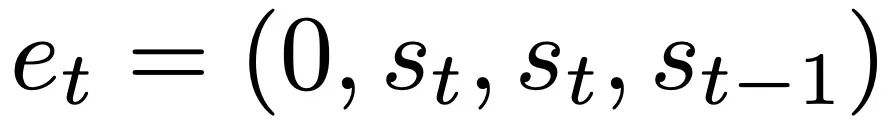

Dengan pandangan teori ke dalam sarung berbilang lapisan, mula-mula analisa linear dalam dan softmax hanya memberi perhatian kepada Transformer. Pengarang memformat input mengikut struktur 4 saluran,

Walaupun ungkapan RevAlg-d menerangkan Transformer berbilang lapisan terlatih dengan sebilangan kecil parameter percuma, adalah sukar untuk mentafsirkannya sebagai algoritma pengoptimuman mesa. Oleh itu, penulis menggunakan analisis probing regresi linear (Alain & Bengio, 2017; Akyürek et al., 2023) untuk mencari ciri-ciri algoritma pengoptimuman mesa yang dihipotesiskan.

Pada Transformer perhatian kendiri linear dalam yang ditunjukkan dalam Rajah 3, kita dapat melihat bahawa kedua-dua probe boleh dinyahkod secara linear, dan prestasi penyahkodan meningkat dengan peningkatan panjang jujukan dan kedalaman rangkaian. Oleh itu, pengoptimuman asas menemui algoritma hibrid yang menuruni lapisan demi lapisan pada Lt (W) objektif mesa asal sambil menambah baik nombor keadaan masalah pengoptimuman mesa. Ini mengakibatkan penurunan pesat dalam mesa-objektif Lt (W). Ia juga boleh dilihat bahawa prestasi meningkat dengan ketara dengan peningkatan kedalaman.

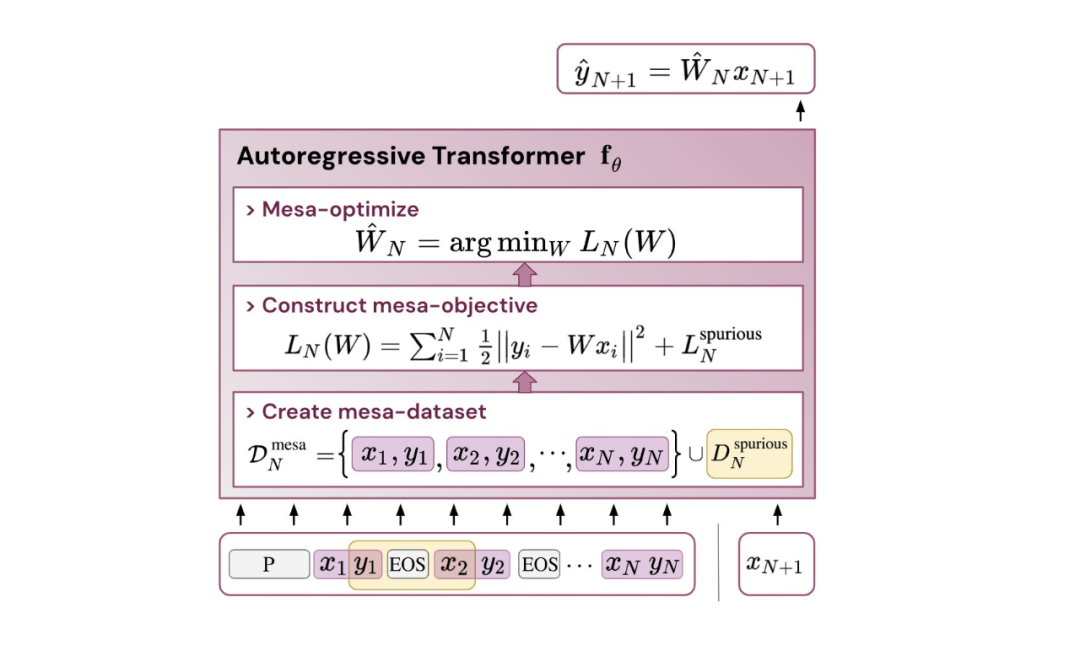

Oleh itu, kemerosotan pesat autoregresif mesa-objektif Lt (W) dicapai melalui pengoptimuman mesa secara berperingkat (rentas lapisan) pada data praproses yang lebih baik.建 Rajah 3: Latihan pengubah berbilang lapisan untuk input binaan kejuruteraan songsang.Ini menunjukkan bahawa jika transformer dilatih pada token yang dibina, ia akan meramalkan dengan pengoptimuman mesa. Menariknya, apabila unsur jujukan diberikan secara langsung, pengubah akan membina token dengan sendirinya dengan mengumpulkan elemen, yang dipanggil oleh pasukan penyelidik "membuat dataset mesa". Kesimpulan

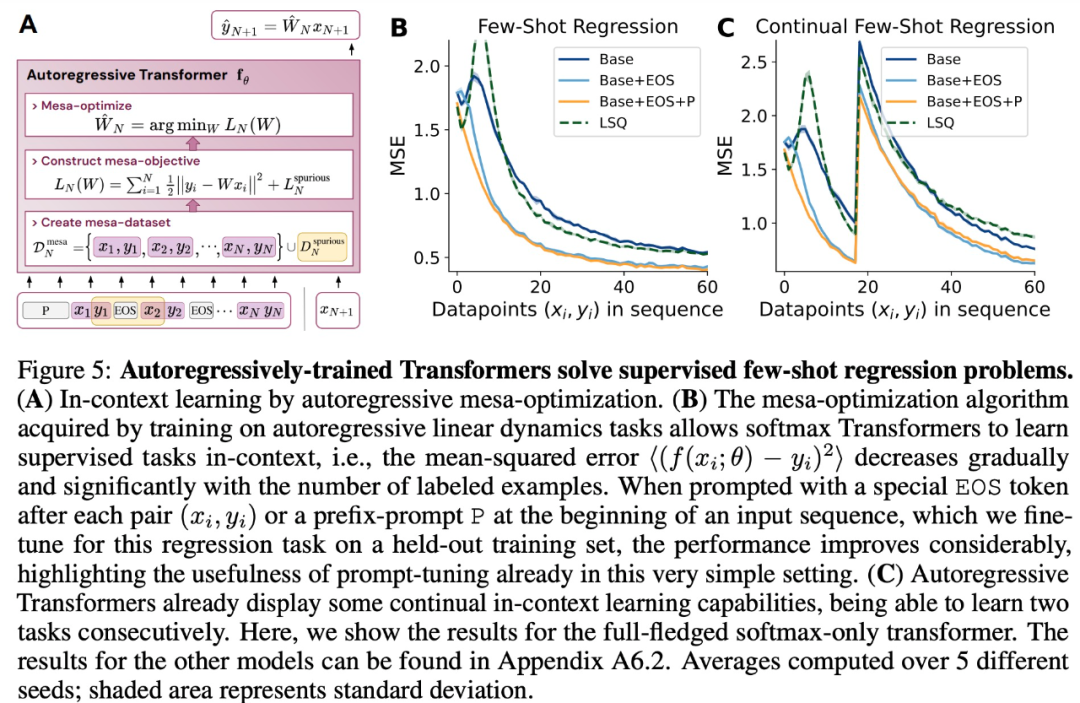

Kajian ini menunjukkan bahawa model Transformer mampu membangunkan algoritma inferens berasaskan kecerunan apabila dilatih mengenai tugas ramalan jujukan di bawah objektif autoregresif standard. Oleh itu, hasil terkini yang diperoleh dalam tetapan meta-pembelajaran berbilang tugas juga boleh dipindahkan ke tetapan latihan LLM penyeliaan kendiri tradisional. Selain itu, kajian mendapati bahawa algoritma inferens autoregresif yang dipelajari boleh digunakan semula untuk menyelesaikan tugas pembelajaran kontekstual yang diselia tanpa memerlukan latihan semula, menerangkan hasil dalam satu rangka kerja bersatu.

Jadi, apakah kaitan ini dengan pembelajaran dalam konteks? Kajian ini percaya bahawa selepas melatih pengubah pada tugas jujukan autoregresif, ia mencapai pengoptimuman mesa yang sesuai dan oleh itu boleh melakukan pembelajaran konteks beberapa pukulan tanpa sebarang penalaan halus.

Kajian ini mengandaikan bahawa pengoptimuman mesa juga wujud untuk LLM, dengan itu meningkatkan keupayaan pembelajaran konteksnya. Menariknya, kajian itu juga mendapati bahawa menyesuaikan gesaan secara berkesan untuk LLM juga boleh membawa kepada peningkatan yang ketara dalam keupayaan pembelajaran kontekstual.

Pembaca yang berminat boleh membaca teks asal kertas kerja untuk mengetahui lebih lanjut tentang kandungan penyelidikan. Kandungan rujukan: https://www.reddit.com/r/MachineLearning/comments/16jc2su/r_uncovering/mesathms_optimization https://twitter.com/ oswaldjoh/status/1701873029100241241

Atas ialah kandungan terperinci Dengan asas teori, kami boleh menjalankan pengoptimuman yang mendalam.. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1377

1377

52

52

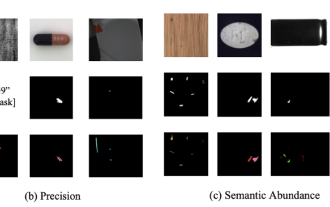

Menerobos sempadan pengesanan kecacatan tradisional, 'Spektrum Kecacatan' mencapai ketepatan ultra tinggi dan pengesanan kecacatan industri semantik yang kaya buat kali pertama.

Jul 26, 2024 pm 05:38 PM

Menerobos sempadan pengesanan kecacatan tradisional, 'Spektrum Kecacatan' mencapai ketepatan ultra tinggi dan pengesanan kecacatan industri semantik yang kaya buat kali pertama.

Jul 26, 2024 pm 05:38 PM

Dalam pembuatan moden, pengesanan kecacatan yang tepat bukan sahaja kunci untuk memastikan kualiti produk, tetapi juga teras untuk meningkatkan kecekapan pengeluaran. Walau bagaimanapun, set data pengesanan kecacatan sedia ada selalunya tidak mempunyai ketepatan dan kekayaan semantik yang diperlukan untuk aplikasi praktikal, menyebabkan model tidak dapat mengenal pasti kategori atau lokasi kecacatan tertentu. Untuk menyelesaikan masalah ini, pasukan penyelidik terkemuka yang terdiri daripada Universiti Sains dan Teknologi Hong Kong Guangzhou dan Teknologi Simou telah membangunkan set data "DefectSpectrum" secara inovatif, yang menyediakan anotasi berskala besar yang kaya dengan semantik bagi kecacatan industri. Seperti yang ditunjukkan dalam Jadual 1, berbanding set data industri lain, set data "DefectSpectrum" menyediakan anotasi kecacatan yang paling banyak (5438 sampel kecacatan) dan klasifikasi kecacatan yang paling terperinci (125 kategori kecacatan

Model dialog NVIDIA ChatQA telah berkembang kepada versi 2.0, dengan panjang konteks disebut pada 128K

Jul 26, 2024 am 08:40 AM

Model dialog NVIDIA ChatQA telah berkembang kepada versi 2.0, dengan panjang konteks disebut pada 128K

Jul 26, 2024 am 08:40 AM

Komuniti LLM terbuka ialah era apabila seratus bunga mekar dan bersaing Anda boleh melihat Llama-3-70B-Instruct, QWen2-72B-Instruct, Nemotron-4-340B-Instruct, Mixtral-8x22BInstruct-v0.1 dan banyak lagi. model yang cemerlang. Walau bagaimanapun, berbanding dengan model besar proprietari yang diwakili oleh GPT-4-Turbo, model terbuka masih mempunyai jurang yang ketara dalam banyak bidang. Selain model umum, beberapa model terbuka yang mengkhusus dalam bidang utama telah dibangunkan, seperti DeepSeek-Coder-V2 untuk pengaturcaraan dan matematik, dan InternVL untuk tugasan bahasa visual.

Google AI memenangi pingat perak IMO Mathematical Olympiad, model penaakulan matematik AlphaProof telah dilancarkan dan pembelajaran pengukuhan kembali

Jul 26, 2024 pm 02:40 PM

Google AI memenangi pingat perak IMO Mathematical Olympiad, model penaakulan matematik AlphaProof telah dilancarkan dan pembelajaran pengukuhan kembali

Jul 26, 2024 pm 02:40 PM

Bagi AI, Olimpik Matematik tidak lagi menjadi masalah. Pada hari Khamis, kecerdasan buatan Google DeepMind menyelesaikan satu kejayaan: menggunakan AI untuk menyelesaikan soalan sebenar IMO Olimpik Matematik Antarabangsa tahun ini, dan ia hanya selangkah lagi untuk memenangi pingat emas. Pertandingan IMO yang baru berakhir minggu lalu mempunyai enam soalan melibatkan algebra, kombinatorik, geometri dan teori nombor. Sistem AI hibrid yang dicadangkan oleh Google mendapat empat soalan dengan betul dan memperoleh 28 mata, mencapai tahap pingat perak. Awal bulan ini, profesor UCLA, Terence Tao baru sahaja mempromosikan Olimpik Matematik AI (Anugerah Kemajuan AIMO) dengan hadiah berjuta-juta dolar Tanpa diduga, tahap penyelesaian masalah AI telah meningkat ke tahap ini sebelum Julai. Lakukan soalan secara serentak pada IMO Perkara yang paling sukar untuk dilakukan dengan betul ialah IMO, yang mempunyai sejarah terpanjang, skala terbesar dan paling negatif

Pandangan alam semula jadi: Ujian kecerdasan buatan dalam perubatan berada dalam keadaan huru-hara Apa yang perlu dilakukan?

Aug 22, 2024 pm 04:37 PM

Pandangan alam semula jadi: Ujian kecerdasan buatan dalam perubatan berada dalam keadaan huru-hara Apa yang perlu dilakukan?

Aug 22, 2024 pm 04:37 PM

Editor |. ScienceAI Berdasarkan data klinikal yang terhad, beratus-ratus algoritma perubatan telah diluluskan. Para saintis sedang membahaskan siapa yang harus menguji alat dan cara terbaik untuk melakukannya. Devin Singh menyaksikan seorang pesakit kanak-kanak di bilik kecemasan mengalami serangan jantung semasa menunggu rawatan untuk masa yang lama, yang mendorongnya untuk meneroka aplikasi AI untuk memendekkan masa menunggu. Menggunakan data triage daripada bilik kecemasan SickKids, Singh dan rakan sekerja membina satu siri model AI untuk menyediakan potensi diagnosis dan mengesyorkan ujian. Satu kajian menunjukkan bahawa model ini boleh mempercepatkan lawatan doktor sebanyak 22.3%, mempercepatkan pemprosesan keputusan hampir 3 jam bagi setiap pesakit yang memerlukan ujian perubatan. Walau bagaimanapun, kejayaan algoritma kecerdasan buatan dalam penyelidikan hanya mengesahkan perkara ini

Latihan dengan berjuta-juta data kristal untuk menyelesaikan masalah fasa kristalografi, kaedah pembelajaran mendalam PhAI diterbitkan dalam Sains

Aug 08, 2024 pm 09:22 PM

Latihan dengan berjuta-juta data kristal untuk menyelesaikan masalah fasa kristalografi, kaedah pembelajaran mendalam PhAI diterbitkan dalam Sains

Aug 08, 2024 pm 09:22 PM

Editor |KX Sehingga hari ini, perincian dan ketepatan struktur yang ditentukan oleh kristalografi, daripada logam ringkas kepada protein membran yang besar, tidak dapat ditandingi oleh mana-mana kaedah lain. Walau bagaimanapun, cabaran terbesar, yang dipanggil masalah fasa, kekal mendapatkan maklumat fasa daripada amplitud yang ditentukan secara eksperimen. Penyelidik di Universiti Copenhagen di Denmark telah membangunkan kaedah pembelajaran mendalam yang dipanggil PhAI untuk menyelesaikan masalah fasa kristal Rangkaian saraf pembelajaran mendalam yang dilatih menggunakan berjuta-juta struktur kristal tiruan dan data pembelauan sintetik yang sepadan boleh menghasilkan peta ketumpatan elektron yang tepat. Kajian menunjukkan bahawa kaedah penyelesaian struktur ab initio berasaskan pembelajaran mendalam ini boleh menyelesaikan masalah fasa pada resolusi hanya 2 Angstrom, yang bersamaan dengan hanya 10% hingga 20% daripada data yang tersedia pada resolusi atom, manakala Pengiraan ab initio tradisional

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Editor |ScienceAI Question Answering (QA) set data memainkan peranan penting dalam mempromosikan penyelidikan pemprosesan bahasa semula jadi (NLP). Set data QA berkualiti tinggi bukan sahaja boleh digunakan untuk memperhalusi model, tetapi juga menilai dengan berkesan keupayaan model bahasa besar (LLM), terutamanya keupayaan untuk memahami dan menaakul tentang pengetahuan saintifik. Walaupun pada masa ini terdapat banyak set data QA saintifik yang meliputi bidang perubatan, kimia, biologi dan bidang lain, set data ini masih mempunyai beberapa kekurangan. Pertama, borang data adalah agak mudah, kebanyakannya adalah soalan aneka pilihan. Ia mudah dinilai, tetapi mengehadkan julat pemilihan jawapan model dan tidak dapat menguji sepenuhnya keupayaan model untuk menjawab soalan saintifik. Sebaliknya, Soal Jawab terbuka

Mengenal pasti molekul terbaik secara automatik dan mengurangkan kos sintesis MIT membangunkan rangka kerja algoritma pembuatan keputusan reka bentuk molekul

Jun 22, 2024 am 06:43 AM

Mengenal pasti molekul terbaik secara automatik dan mengurangkan kos sintesis MIT membangunkan rangka kerja algoritma pembuatan keputusan reka bentuk molekul

Jun 22, 2024 am 06:43 AM

Editor |. Penggunaan Ziluo AI dalam memperkemas penemuan dadah semakin meletup. Skrin berbilion molekul calon untuk mereka yang mungkin mempunyai sifat yang diperlukan untuk membangunkan ubat baharu. Terdapat begitu banyak pembolehubah untuk dipertimbangkan, daripada harga material kepada risiko kesilapan, sehingga menimbang kos mensintesis molekul calon terbaik bukanlah tugas yang mudah, walaupun saintis menggunakan AI. Di sini, penyelidik MIT membangunkan SPARROW, rangka kerja algoritma membuat keputusan kuantitatif, untuk mengenal pasti calon molekul terbaik secara automatik, dengan itu meminimumkan kos sintesis sambil memaksimumkan kemungkinan calon mempunyai sifat yang diingini. Algoritma juga menentukan bahan dan langkah eksperimen yang diperlukan untuk mensintesis molekul ini. SPARROW mengambil kira kos mensintesis sekumpulan molekul sekaligus, memandangkan berbilang molekul calon selalunya tersedia

Prestasi SOTA, kaedah AI ramalan pertalian protein-ligan pelbagai mod Xiamen, menggabungkan maklumat permukaan molekul buat kali pertama

Jul 17, 2024 pm 06:37 PM

Prestasi SOTA, kaedah AI ramalan pertalian protein-ligan pelbagai mod Xiamen, menggabungkan maklumat permukaan molekul buat kali pertama

Jul 17, 2024 pm 06:37 PM

Editor |. KX Dalam bidang penyelidikan dan pembangunan ubat, meramalkan pertalian pengikatan protein dan ligan dengan tepat dan berkesan adalah penting untuk pemeriksaan dan pengoptimuman ubat. Walau bagaimanapun, kajian semasa tidak mengambil kira peranan penting maklumat permukaan molekul dalam interaksi protein-ligan. Berdasarkan ini, penyelidik dari Universiti Xiamen mencadangkan rangka kerja pengekstrakan ciri berbilang mod (MFE) novel, yang buat pertama kalinya menggabungkan maklumat mengenai permukaan protein, struktur dan jujukan 3D, dan menggunakan mekanisme perhatian silang untuk membandingkan ciri modaliti yang berbeza penjajaran. Keputusan eksperimen menunjukkan bahawa kaedah ini mencapai prestasi terkini dalam meramalkan pertalian mengikat protein-ligan. Tambahan pula, kajian ablasi menunjukkan keberkesanan dan keperluan maklumat permukaan protein dan penjajaran ciri multimodal dalam rangka kerja ini. Penyelidikan berkaitan bermula dengan "S