Peranti teknologi

Peranti teknologi

AI

AI

Microsoft melancarkan model AI kecil, secara rahsia menjalankan 'Pelan B', tiada kaitan dengan OpenAI

Microsoft melancarkan model AI kecil, secara rahsia menjalankan 'Pelan B', tiada kaitan dengan OpenAI

Microsoft melancarkan model AI kecil, secara rahsia menjalankan 'Pelan B', tiada kaitan dengan OpenAI

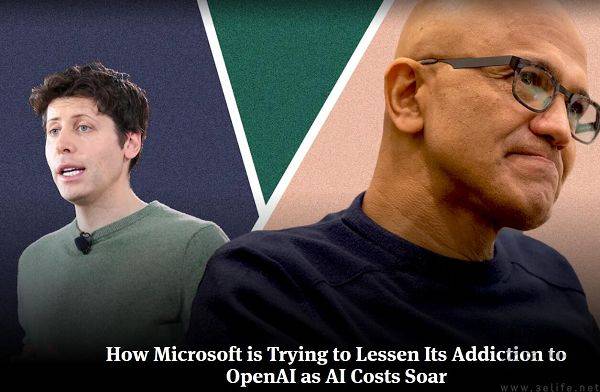

Model besar AI akan menjadi kata kunci pada tahun 2023, dan ia juga merupakan kawasan panas untuk persaingan di kalangan syarikat teknologi utama. Walau bagaimanapun, kos model besar AI ini yang melambangkan masa depan adalah terlalu tinggi, menyebabkan syarikat kaya seperti Microsoft mula mempertimbangkan alternatif. Pendedahan terbaru menunjukkan bahawa beberapa daripada 1,500 orang pasukan penyelidik dalam Microsoft yang diketuai oleh Peter Lee telah beralih kepada membangunkan LLM baharu, yang lebih kecil dan mempunyai kos operasi yang lebih rendah

Mengenai model AI bersaiz kecil Microsoft, petunjuk mula muncul 3 bulan lalu. Pada bulan Jun tahun ini, Microsoft mengeluarkan kertas kerja bertajuk "Buku Teks Semua yang Anda Perlukan", menggunakan data "peringkat buku teks" hanya 7 bilion token untuk melatih 1.3 bilion parameter model phi-1, membuktikan bahawa walaupun pada skala kecil High- data yang berkualiti juga boleh membolehkan model tersebut mempunyai prestasi yang baik. Di samping itu, Microsoft Research juga mengeluarkan model bahasa pra-latihan baharu yang dipanggil phi-1.5 berdasarkan phi-1, yang sesuai untuk Soal Jawab QA, format sembang dan senario kod

Menurut Microsoft, phi-1.5 mengatasi sejumlah besar model besar di bawah penanda aras yang menguji akal, pemahaman bahasa dan penaakulan logik. Dalam suite skor larian GPT4AL dengan LM-Eval Harness, phi-1.5 adalah setanding dengan model besar sumber terbuka Meta llama-2 dengan 7 bilion parameter, malah melebihi llama-2 dalam skor AGIEval.

Mengapa Microsoft tiba-tiba membangunkan model AI bersaiz kecil? Secara amnya dipercayai bahawa ini mungkin berkaitan dengan isu antara OpenAI. Microsoft ialah pelabur utama dalam OpenAI, jadi ia boleh menggunakan harta intelek sedia ada OpenAI secara kekal, tetapi ia tidak dapat mengawal pembuatan keputusan OpenAI. Oleh itu, adalah penting bagi syarikat gergasi seperti Microsoft untuk membangunkan model AI bersaiz kecil berkualiti tinggi, sama ada untuk pertimbangan keselamatan strategiknya sendiri atau untuk mengekalkan kedudukan yang baik dengan kerjasama OpenAI

Sudah tentu, penggunaan tenaga semasa model AI yang besar adalah faktor utama. Pada Persidangan Automasi Reka Bentuk awal tahun ini, Ketua Pegawai Teknologi AMD Mark Papermaster menunjukkan slaid membandingkan penggunaan tenaga sistem pembelajaran mesin dengan penjanaan kuasa global. Menurut anggaran Agensi Tenaga Antarabangsa, pusat data yang melatih model besar semakin intensif tenaga, menyumbang 1.5% hingga 2% daripada penggunaan elektrik global, bersamaan dengan penggunaan elektrik seluruh United Kingdom. Dijangkakan bahawa bahagian ini akan meningkat kepada 4% menjelang 2030

Menurut laporan berkaitan yang dikeluarkan oleh Dunia Maklumat Digital, penggunaan tenaga yang dijana oleh pusat data untuk melatih model AI akan menjadi tiga kali ganda daripada perkhidmatan awan konvensional Menjelang 2028, penggunaan kuasa pusat data akan menghampiri 4,250 megawatt, peningkatan sebanyak. 212 kali daripada 2023. Penggunaan kuasa latihan OpenAI GPT-3 ialah 1.287 gigawatt jam, yang lebih kurang bersamaan dengan penggunaan kuasa 120 isi rumah Amerika selama satu tahun. Tetapi ini hanya penggunaan kuasa awal untuk melatih model AI, yang hanya menyumbang 40% daripada kuasa yang digunakan apabila model itu benar-benar digunakan.

Menurut laporan alam sekitar 2023 yang dikeluarkan oleh Google, melatih model AI yang besar bukan sahaja akan menggunakan banyak tenaga, tetapi juga menggunakan banyak sumber air. Menurut laporan itu, Google menggunakan 5.6 bilion gelen (kira-kira 21.2 bilion liter) air pada tahun 2022, bersamaan dengan penggunaan air di 37 padang golf. Daripada jumlah ini, 5.2 bilion gelen digunakan di pusat data Google, peningkatan 20% daripada 2021

Penggunaan tenaga yang tinggi bagi model AI yang besar adalah perkara biasa. Dalam kata-kata Pengarah Teknikal Kanan ARM, Ian Bratt, "Keperluan pengkomputeran AI tidak dapat dipenuhi. Lebih besar skala rangkaian, lebih baik hasilnya, lebih banyak masalah yang boleh diselesaikan, dan penggunaan kuasa adalah berkadar terus dengan skala rangkaian. "

Sesetengah pengamal kecerdasan buatan berkata bahawa sebelum wabak, penggunaan tenaga yang diperlukan untuk melatih model Transformer adalah dalam julat 27 kilowatt jam. Walau bagaimanapun, kini bilangan parameter model Transformer telah meningkat daripada 50 juta kepada 200 juta, dan penggunaan tenaga telah melebihi 500,000 kilowatt jam. Dalam erti kata lain, bilangan parameter meningkat empat kali ganda, tetapi penggunaan tenaga meningkat lebih daripada 18,000 kali. Dari satu segi, pelbagai fungsi inovatif yang dibawa oleh model kecerdasan buatan berskala besar sebenarnya datang dengan kos prestasi pemprosesan yang tinggi dan penggunaan tenaga

Lebih banyak tenaga elektrik memacu lebih banyak GPU untuk latihan AI, dan sejumlah besar air digunakan untuk menyejukkan GPU. Inilah masalahnya. Sehingga didedahkan bahawa Microsoft sedang membangunkan peta jalan untuk mengendalikan pusat data menggunakan tenaga elektrik yang dihasilkan oleh reaktor nuklear kecil. Apatah lagi, walaupun tanpa menyebut ESG ("persekitaran, sosial dan tadbir urus"), adalah penting untuk mengkaji model bersaiz kecil semata-mata dari perspektif kos.

Seperti yang kita semua tahu, NVIDIA, yang telah membina ekosistem CUDA, adalah penerima terbesar pusingan ledakan AI ini Ia telah menduduki 70% pasaran cip AI pada masa kini, kad pengkomputeran seperti H100 dan A100 sukar dicari. Tetapi keadaan semasa ialah kuasa belian pengkomputeran daripada NVIDIA telah menjadi faktor penting yang menaikkan kos pengeluar AI. Oleh itu, model saiz kecil bermakna ia memerlukan kurang sumber pengkomputeran dan anda hanya perlu membeli lebih sedikit GPU untuk menyelesaikan masalah.

Walaupun model berskala besar yang lebih berkuasa sememangnya sangat baik, pengkomersilan model berskala besar masih di peringkat awal, dan satu-satunya orang yang menjana wang yang banyak ialah peranan NVIDIA sebagai "menjual penyodok." Oleh itu, dalam kes ini, Microsoft secara semula jadi berhasrat untuk menukar status quo

Atas ialah kandungan terperinci Microsoft melancarkan model AI kecil, secara rahsia menjalankan 'Pelan B', tiada kaitan dengan OpenAI. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1376

1376

52

52

Permintaan untuk kuasa pengkomputeran telah meletup di bawah gelombang model besar AI 'model besar + kuasa pengkomputeran besar' SenseTime memperkasakan pembangunan pelbagai industri.

Jun 09, 2023 pm 07:35 PM

Permintaan untuk kuasa pengkomputeran telah meletup di bawah gelombang model besar AI 'model besar + kuasa pengkomputeran besar' SenseTime memperkasakan pembangunan pelbagai industri.

Jun 09, 2023 pm 07:35 PM

Baru-baru ini, "Persidangan Pengkomputeran Pintar Kawasan Baharu Lingang" dengan tema "AI menerajui era, kuasa pengkomputeran memacu masa depan" telah diadakan. Pada mesyuarat itu, Perikatan Industri Pengkomputeran Pintar Kawasan Baru telah ditubuhkan secara rasmi SenseTime menjadi ahli perikatan sebagai pembekal kuasa pengkomputeran Pada masa yang sama, SenseTime telah dianugerahkan gelaran perusahaan "Industri Pengkomputeran Pintar Kawasan Baru". Sebagai peserta aktif dalam ekosistem kuasa pengkomputeran Lingang, SenseTime kini telah membina salah satu platform pengkomputeran pintar terbesar di Asia - SenseTime AIDC, yang boleh mengeluarkan jumlah kuasa pengkomputeran sebanyak 5,000 Petaflops dan menyokong 20 model ultra-besar dengan ratusan bilion parameter. Berlatih pada masa yang sama. SenseCore, peranti berskala besar yang dibina dengan AIDC sebagai asas dan berpandangan ke hadapan, komited untuk mencipta infrastruktur dan perkhidmatan AI generasi seterusnya yang cekap tinggi, kos rendah dan berskala besar untuk memperkasakan kecerdasan buatan.

Penyelidik: Inferens model AI menggunakan lebih banyak kuasa, dan penggunaan elektrik industri pada 2027 akan setanding dengan Belanda

Oct 14, 2023 am 08:25 AM

Penyelidik: Inferens model AI menggunakan lebih banyak kuasa, dan penggunaan elektrik industri pada 2027 akan setanding dengan Belanda

Oct 14, 2023 am 08:25 AM

IT House melaporkan pada 13 Oktober bahawa "Joule", jurnal saudara perempuan "Cell", menerbitkan kertas minggu ini yang dipanggil "The growth footprint of artificial intelligence (The growing energy footprint of artificial intelligence)". Melalui pertanyaan, kami mengetahui bahawa kertas kerja ini diterbitkan oleh Alex DeVries, pengasas institusi penyelidikan saintifik Digiconomist. Beliau mendakwa bahawa prestasi penaakulan kecerdasan buatan pada masa hadapan mungkin menggunakan banyak tenaga elektrik Dianggarkan menjelang 2027, penggunaan elektrik kecerdasan buatan mungkin bersamaan dengan penggunaan elektrik Belanda selama setahun dunia luar sentiasa percaya bahawa melatih model AI adalah "perkara yang paling penting dalam AI".

Markah akan diukur apabila terdapat percanggahan pendapat Mengapa model AI domestik yang besar ketagih untuk 'meleret kedudukan'?

Dec 02, 2023 am 08:53 AM

Markah akan diukur apabila terdapat percanggahan pendapat Mengapa model AI domestik yang besar ketagih untuk 'meleret kedudukan'?

Dec 02, 2023 am 08:53 AM

Saya percaya bahawa rakan-rakan yang mengikuti bulatan telefon bimbit tidak akan asing dengan ungkapan "dapat markah jika anda tidak menerimanya". Sebagai contoh, perisian ujian prestasi teori seperti AnTuTu dan GeekBench telah menarik banyak perhatian daripada pemain kerana ia boleh mencerminkan prestasi telefon mudah alih pada tahap tertentu. Begitu juga, terdapat perisian penanda aras yang sepadan untuk pemproses PC dan kad grafik untuk mengukur prestasi mereka Memandangkan "semuanya boleh ditanda aras", model AI besar yang paling popular juga telah mula mengambil bahagian dalam pertandingan penanda aras, terutamanya dalam "Seratus Model" Selepas itu. "perang" bermula, kejayaan dibuat hampir setiap hari, dan setiap syarikat mendakwa sebagai "nombor satu dalam skor larian model AI domestik yang besar hampir tidak pernah ketinggalan dari segi skor prestasi, tetapi mereka tidak pernah dapat mengatasi GP." syarat pengalaman pengguna.

China Unicom mengeluarkan model AI imej dan teks besar yang boleh menjana imej dan klip video daripada teks

Jun 29, 2023 am 09:26 AM

China Unicom mengeluarkan model AI imej dan teks besar yang boleh menjana imej dan klip video daripada teks

Jun 29, 2023 am 09:26 AM

Memandu China News pada 28 Jun 2023, hari ini semasa Kongres Dunia Mudah Alih di Shanghai, China Unicom mengeluarkan model grafik "Honghu Graphic Model 1.0". China Unicom berkata bahawa model grafik Honghu ialah model besar pertama untuk perkhidmatan tambah nilai pengendali. Wartawan China Business News mengetahui bahawa model grafik Honghu pada masa ini mempunyai dua versi 800 juta parameter latihan dan 2 bilion parameter latihan, yang boleh merealisasikan fungsi seperti gambar berasaskan teks, penyuntingan video dan gambar berasaskan gambar. Di samping itu, Pengerusi Unicom China Liu Liehong juga berkata dalam ucaptama hari ini bahawa AI generatif membawa ketunggalan pembangunan, dan 50% pekerjaan akan terjejas teruk oleh kecerdasan buatan dalam tempoh dua tahun akan datang.

Pusat Rangkaian Institut Bersama Institut Fizik, Akademi Sains China mengeluarkan model AI MatChat

Nov 03, 2023 pm 08:13 PM

Pusat Rangkaian Institut Bersama Institut Fizik, Akademi Sains China mengeluarkan model AI MatChat

Nov 03, 2023 pm 08:13 PM

IT House melaporkan pada 3 November bahawa laman web rasmi Institut Fizik Akademi Sains China menerbitkan artikel Baru-baru ini, Kumpulan SF10 Institut Fizik Akademi Sains China/Pusat Penyelidikan Kebangsaan Beijing untuk Fizik Pekat. dan Pusat Maklumat Rangkaian Komputer Akademi Sains China bekerjasama untuk menggunakan model AI yang besar kepada sains bahan Dalam bidang ini, puluhan ribu data laluan sintesis kimia disalurkan kepada model bahasa besar LLAMA2-7b, dengan itu memperoleh model MatChat. , yang boleh digunakan untuk meramalkan laluan sintesis bahan bukan organik. IT House menyatakan bahawa model itu boleh melakukan penaakulan logik berdasarkan struktur pertanyaan dan mengeluarkan proses penyediaan dan formula yang sepadan. Ia telah digunakan dalam talian dan terbuka kepada semua penyelidik bahan, membawa inspirasi baharu dan idea baharu kepada penyelidikan dan inovasi bahan. Kerja ini adalah untuk model bahasa besar dalam bidang sains bersegmen

Empat kali lebih pantas, enjin inferens latihan berprestasi tinggi sumber terbuka Bytedance teknologi LightSeq didedahkan

May 02, 2023 pm 05:52 PM

Empat kali lebih pantas, enjin inferens latihan berprestasi tinggi sumber terbuka Bytedance teknologi LightSeq didedahkan

May 02, 2023 pm 05:52 PM

Model Transformer berasal daripada kertas kerja "Attentionisallyouneed" yang diterbitkan oleh pasukan Google pada 2017. Kertas kerja ini mula-mula mencadangkan konsep penggunaan Attention untuk menggantikan struktur kitaran model Seq2Seq, yang membawa impak yang hebat kepada bidang NLP. Dan dengan kemajuan berterusan penyelidikan dalam beberapa tahun kebelakangan ini, teknologi berkaitan Transformer telah beransur-ansur mengalir daripada pemprosesan bahasa semula jadi ke bidang lain. Sehingga kini, model siri Transformer telah menjadi model arus perdana dalam NLP, CV, ASR dan bidang lain. Oleh itu, cara melatih dan membuat kesimpulan model Transformer dengan lebih pantas telah menjadi hala tuju penyelidikan yang penting dalam industri. Teknik pengkuantitian ketepatan rendah boleh

Penyelidik meta membuat percubaan baharu pada AI: mengajar robot untuk menavigasi secara fizikal tanpa peta atau latihan

Apr 09, 2023 pm 08:31 PM

Penyelidik meta membuat percubaan baharu pada AI: mengajar robot untuk menavigasi secara fizikal tanpa peta atau latihan

Apr 09, 2023 pm 08:31 PM

Jabatan kecerdasan buatan Meta Platforms baru-baru ini menyatakan bahawa mereka sedang mengajar model AI cara belajar berjalan di dunia fizikal dengan sokongan sejumlah kecil data latihan, dan telah mencapai kemajuan pesat. Penyelidikan ini boleh memendekkan dengan ketara masa untuk model AI memperoleh keupayaan navigasi visual. Sebelum ini, untuk mencapai matlamat sedemikian memerlukan "pembelajaran pengukuhan" berulang menggunakan set data yang besar. Penyelidik Meta AI berkata bahawa penerokaan navigasi visual AI ini akan memberi kesan yang ketara kepada dunia maya. Idea asas projek itu tidak rumit: untuk membantu AI menavigasi ruang fizikal seperti yang dilakukan manusia, hanya melalui pemerhatian dan penerokaan. Jabatan Meta AI menjelaskan, “Sebagai contoh, jika kita mahu cermin mata AR membimbing kita untuk mencari kunci, kita mesti

Nvidia mengeluarkan perisian sumber terbuka TensorRT-LLM untuk meningkatkan prestasi model AI pada cip GPU mewah

Sep 14, 2023 pm 12:29 PM

Nvidia mengeluarkan perisian sumber terbuka TensorRT-LLM untuk meningkatkan prestasi model AI pada cip GPU mewah

Sep 14, 2023 pm 12:29 PM

Nvidia baru-baru ini mengumumkan pelancaran suite perisian sumber terbuka baharu yang dipanggil TensorRT-LLM, yang memperluaskan keupayaan pengoptimuman model bahasa besar pada GPU Nvidia dan memecahkan had prestasi inferens kecerdasan buatan selepas penggunaan. Model bahasa besar AI Generatif telah menjadi popular kerana keupayaannya yang mengagumkan. Ia memperluaskan kemungkinan kecerdasan buatan dan digunakan secara meluas dalam pelbagai industri. Pengguna boleh mendapatkan maklumat dengan bercakap dengan chatbots, meringkaskan dokumen besar, menulis kod perisian dan menemui cara baharu untuk memahami maklumat, kata Ian Buck, naib presiden pengkomputeran skala besar dan berprestasi tinggi di Nvidia Corporation: "Inferens model bahasa besar semakin meningkat. sukar. .Kerumitan model terus meningkat, model menjadi lebih dan lebih pintar, dan ia menjadi