Peranti teknologi

Peranti teknologi

industri IT

industri IT

Meta merancang untuk memberhentikan ahli jabatan Metaverse Reality Labs, berita keluar

Meta merancang untuk memberhentikan ahli jabatan Metaverse Reality Labs, berita keluar

Meta merancang untuk memberhentikan ahli jabatan Metaverse Reality Labs, berita keluar

Menurut laporan daripada Reuters, Meta bercadang untuk memberhentikan pasukan pembangunan cip (FAST) Reality Labs, sebuah jabatan berkaitan metaverse

Menurut dua orang yang biasa dengan perkara itu, Meta. pekerja telah mengumumkan di forum dalaman Tempat Kerja Menerima notis pemberhentian. Dikatakan bahawa Meta akan menyiarkan pemberitahuan syarikat mengenai status terakhir mereka pada awal pagi Rabu waktu tempatan. Jurucakap Meta enggan mengulas.

Menurut maklumat awam, jabatan FAST Meta mempunyai kira-kira 600 pekerja. Jabatan ini telah berusaha membangunkan cip tersuai untuk menyediakan peranti Meta dengan ciri unik dan meningkatkan prestasi untuk membezakannya daripada peranti VR/AR lain

Namun, walaupun Meta telah berusaha, mereka tidak dapat menghasilkan cip yang boleh bersaing dengan produk luar, jadi peranti mereka masih menggunakan cip Qualcomm

Meta menggunakan cip Qualcomm Snapdragon XR2 Gen 2 dalam Quest 3 yang dikeluarkan minggu lepas, dilengkapi dengan memori 8GB. Meta berkata prestasi grafik Quest 3 adalah dua kali ganda berbanding Quest 2, malah lebih baik daripada Quest Pro yang dilengkapi dengan cip XR2+ generasi sebelumnya), manakala versi 512GB berharga AS$649.99 (kira-kira RMB 4,751) #🎜🎜. #

menurut orang yang biasa dengan perkara itu, syarikat ini sedang membangunkan cermin mata realiti tambahan yang lebih mencabar, lebih kecil dan kelihatan lebih seperti cermin mata biasa, serta jam tangan pintar yang berkaitan

menurut orang yang biasa dengan perkara itu, syarikat ini sedang membangunkan cermin mata realiti tambahan yang lebih mencabar, lebih kecil dan kelihatan lebih seperti cermin mata biasa, serta jam tangan pintar yang berkaitan Atas ialah kandungan terperinci Meta merancang untuk memberhentikan ahli jabatan Metaverse Reality Labs, berita keluar. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

Adakah cip 1nm dibuat di China atau Amerika Syarikat?

Nov 06, 2023 pm 01:30 PM

Adakah cip 1nm dibuat di China atau Amerika Syarikat?

Nov 06, 2023 pm 01:30 PM

Tidak pasti siapa yang membuat cip 1nm. Dari perspektif penyelidikan dan pembangunan, cip 1nm dibangunkan bersama oleh Taiwan, China dan Amerika Syarikat. Dari perspektif pengeluaran besar-besaran, teknologi ini masih belum direalisasikan sepenuhnya. Orang utama yang bertanggungjawab dalam penyelidikan ini ialah Dr. Zhu Jiadi dari MIT, yang merupakan seorang saintis Cina. Dr Zhu Jiadi berkata bahawa penyelidikan itu masih di peringkat awal dan masih jauh dari pengeluaran besar-besaran.

Pertama di China: Changxin Memory melancarkan cip memori DRAM LPDDR5

Nov 28, 2023 pm 09:29 PM

Pertama di China: Changxin Memory melancarkan cip memori DRAM LPDDR5

Nov 28, 2023 pm 09:29 PM

Berita dari laman web ini pada 28 November. Menurut laman web rasmi Changxin Memory, Changxin Memory telah melancarkan cip memori LPDDR5DRAM terbaharu Ia adalah jenama domestik pertama yang melancarkan produk LPDDR5 yang dibangunkan secara bebas. Ia telah mencapai kejayaan sifar dalam domestik pasaran dan juga menjadikan susun atur produk Changxin Storage dalam pasaran terminal mudah alih lebih pelbagai. Laman web ini mendapati bahawa produk siri Changxin Memory LPDDR5 termasuk zarah 12Gb LPDDR5, cip 12GBLPDDR5 pakej POP dan cip 6GBLPDDR5 pakej DSC. Cip 12GBLPDDR5 telah disahkan pada model pengeluar telefon bimbit domestik arus perdana seperti Xiaomi dan Transsion. LPDDR5 ialah produk yang dilancarkan oleh Changxin Storage untuk pasaran peranti mudah alih pertengahan hingga tinggi.

Alat dengar Meta Quest 3S VR mampu milik baharu muncul di FCC, mencadangkan pelancaran yang akan berlaku

Sep 04, 2024 am 06:51 AM

Alat dengar Meta Quest 3S VR mampu milik baharu muncul di FCC, mencadangkan pelancaran yang akan berlaku

Sep 04, 2024 am 06:51 AM

Acara Meta Connect 2024 ditetapkan pada 25 hingga 26 September, dan dalam acara ini, syarikat itu dijangka memperkenalkan set kepala realiti maya mampu milik baharu. Dikhabarkan sebagai Meta Quest 3S, set kepala VR nampaknya telah muncul pada penyenaraian FCC. cadangan ini

Dilaporkan bahawa pelanggan pembungkusan lanjutan TSMC mengejar pesanan dengan ketara, dan kapasiti pengeluaran bulanan dirancang meningkat sebanyak 120% tahun depan

Nov 13, 2023 pm 12:29 PM

Dilaporkan bahawa pelanggan pembungkusan lanjutan TSMC mengejar pesanan dengan ketara, dan kapasiti pengeluaran bulanan dirancang meningkat sebanyak 120% tahun depan

Nov 13, 2023 pm 12:29 PM

Berita dari laman web ini pada 13 November, menurut Taiwan Economic Daily, permintaan pembungkusan lanjutan CoWoS TSMC akan meletup Selain NVIDIA, yang telah mengesahkan pesanan yang diperluaskan pada bulan Oktober, pelanggan kelas berat seperti Apple, AMD, Broadcom, dan Marvell telah. juga baru-baru ini mengejar pesanan dengan ketara. Menurut laporan, TSMC sedang berusaha keras untuk mempercepatkan pengembangan kapasiti pengeluaran pembungkusan termaju CoWoS untuk memenuhi keperluan lima pelanggan utama yang disebutkan di atas. Kapasiti pengeluaran bulanan tahun depan dijangka meningkat kira-kira 20% daripada sasaran asal, mencecah 35,000 keping Penganalisis berkata bahawa lima pelanggan utama TSMC telah membuat tempahan yang besar, menunjukkan bahawa aplikasi kecerdasan buatan telah menjadi popular secara meluas, dan pengeluar utama berminat. cip kecerdasan buatan Permintaan telah meningkat dengan ketara. Pertanyaan di laman web ini mendapati bahawa teknologi pembungkusan termaju CoWoS kebanyakannya dibahagikan kepada tiga jenis - CoWos-S.

Model sumber terbuka pertama yang melepasi tahap GPT4o! Llama 3.1 bocor: 405 bilion parameter, pautan muat turun dan kad model tersedia

Jul 23, 2024 pm 08:51 PM

Model sumber terbuka pertama yang melepasi tahap GPT4o! Llama 3.1 bocor: 405 bilion parameter, pautan muat turun dan kad model tersedia

Jul 23, 2024 pm 08:51 PM

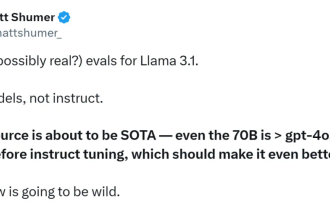

Sediakan GPU anda! Llama3.1 akhirnya muncul, tetapi sumbernya bukan Meta rasmi. Hari ini, berita bocor versi baharu model besar Llama menjadi tular di Reddit Selain model asas, ia juga termasuk hasil penanda aras 8B, 70B dan parameter maksimum 405B. Rajah di bawah menunjukkan hasil perbandingan setiap versi Llama3.1 dengan OpenAIGPT-4o dan Llama38B/70B. Ia boleh dilihat bahawa walaupun versi 70B melebihi GPT-4o pada pelbagai penanda aras. Sumber imej: https://x.com/mattshumer_/status/1815444612414087294 Jelas sekali, versi 3.1 daripada 8B dan 70

Enam cara cepat untuk mengalami Llama 3 yang baru dikeluarkan!

Apr 19, 2024 pm 12:16 PM

Enam cara cepat untuk mengalami Llama 3 yang baru dikeluarkan!

Apr 19, 2024 pm 12:16 PM

Malam tadi Meta mengeluarkan model Llama38B dan 70B Model penalaan arahan Llama3 diperhalusi dan dioptimumkan untuk kes penggunaan perbualan/sembang dan mengatasi banyak model sembang sumber terbuka sedia ada dalam penanda aras biasa. Contohnya, Gemma7B dan Mistral7B. Model Llama+3 menambah baik data dan skala serta mencapai ketinggian baharu. Ia telah dilatih pada lebih daripada 15T token data pada dua kluster 24K GPU tersuai yang dikeluarkan baru-baru ini oleh Meta. Set data latihan ini adalah 7 kali lebih besar daripada Llama2 dan mengandungi 4 kali lebih banyak kod. Ini membawa keupayaan model Llama ke tahap tertinggi semasa, yang menyokong panjang teks lebih daripada 8K, dua kali ganda daripada Llama2. bawah

Model terkuat Llama 3.1 405B dikeluarkan secara rasmi, Zuckerberg: Sumber terbuka menerajui era baharu

Jul 24, 2024 pm 08:23 PM

Model terkuat Llama 3.1 405B dikeluarkan secara rasmi, Zuckerberg: Sumber terbuka menerajui era baharu

Jul 24, 2024 pm 08:23 PM

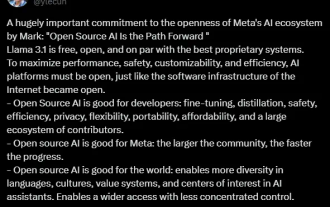

Sebentar tadi, Llama 3.1 yang ditunggu-tunggu telah dikeluarkan secara rasmi! Meta secara rasmi mengeluarkan suara bahawa "sumber terbuka membawa era baru." Dalam blog rasmi, Meta berkata: "Sehingga hari ini, model bahasa besar sumber terbuka kebanyakannya ketinggalan di belakang model tertutup dari segi kefungsian dan prestasi. Kini, kami menyambut era baharu yang diterajui oleh sumber terbuka. Kami mengeluarkan MetaLlama3.1405B secara terbuka. , yang kami percaya Ia adalah model asas sumber terbuka yang terbesar dan paling berkuasa di dunia Sehingga kini, jumlah muat turun semua versi Llama telah melebihi 300 juta kali, dan kami baru sahaja memulakan pengasas dan Ketua Pegawai Eksekutif Meta Zuckerberg artikel panjang "OpenSourceAIIsthePathForward",

Llama3 datang secara tiba-tiba! Komuniti sumber terbuka sedang mendidih lagi: era akses percuma kepada model peringkat GPT4 telah tiba

Apr 19, 2024 pm 12:43 PM

Llama3 datang secara tiba-tiba! Komuniti sumber terbuka sedang mendidih lagi: era akses percuma kepada model peringkat GPT4 telah tiba

Apr 19, 2024 pm 12:43 PM

Llama3 ada di sini! Sebentar tadi, laman web rasmi Meta telah dikemas kini dan rasminya mengumumkan versi parameter Llama 38 bilion dan 70 bilion. Dan ia adalah SOTA sumber terbuka selepas pelancarannya: Data rasmi Meta menunjukkan bahawa versi Llama38B dan 70B mengatasi semua lawan dalam skala parameter masing-masing. Model 8B mengatasi prestasi Gemma7B dan Mistral7BInstruct pada banyak penanda aras seperti MMLU, GPQA dan HumanEval. Model 70B telah mengatasi ayam goreng sumber tertutup yang popular Claude3Sonnet, dan telah berulang-alik dengan GeminiPro1.5 Google. Sebaik sahaja pautan Huggingface keluar, komuniti sumber terbuka kembali teruja. Pelajar buta yang bermata tajam itu turut menemui serta-merta