Peranti teknologi

Peranti teknologi

AI

AI

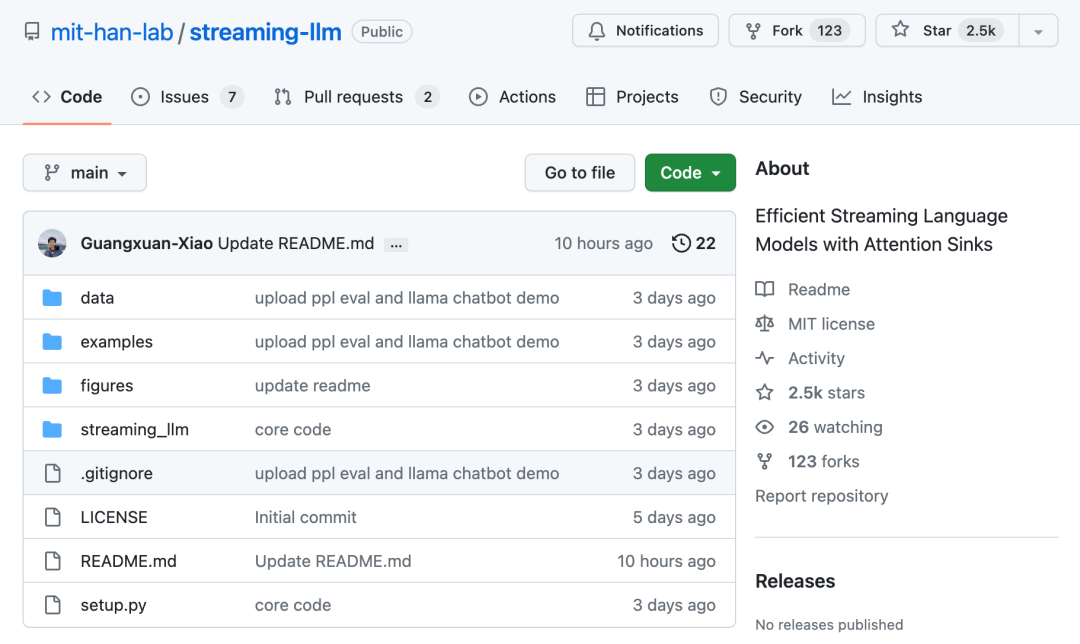

Dengan sehingga 4 juta konteks token dan inferens 22 kali lebih pantas, StreamingLLM telah menjadi popular dan telah menerima 2.5K bintang di GitHub.

Dengan sehingga 4 juta konteks token dan inferens 22 kali lebih pantas, StreamingLLM telah menjadi popular dan telah menerima 2.5K bintang di GitHub.

Dengan sehingga 4 juta konteks token dan inferens 22 kali lebih pantas, StreamingLLM telah menjadi popular dan telah menerima 2.5K bintang di GitHub.

Jika anda pernah berinteraksi dengan mana-mana bot AI perbualan, anda akan mengingati beberapa detik yang sangat mengecewakan. Sebagai contoh, perkara penting yang anda nyatakan dalam perbualan sehari sebelumnya telah dilupakan sepenuhnya oleh AI...

Ini kerana kebanyakan LLM semasa hanya boleh mengingati konteks terhad, sama seperti pelajar berdesak-desakan untuk peperiksaan , sedikit silang- peperiksaan akan "mendedahkan kebenaran."

Bukankah patut dicemburui jika pembantu AI boleh merujuk perbualan secara kontekstual dari beberapa minggu atau bulan lalu dalam sembang, atau jika anda boleh meminta pembantu AI untuk meringkaskan laporan yang sepanjang beribu-ribu halaman?

Untuk menjadikan LLM lebih mengingati dan mengingati lebih banyak kandungan, penyelidik telah bekerja keras. Baru-baru ini, penyelidik dari MIT, Meta AI, dan Carnegie Mellon University mencadangkan kaedah yang dipanggil "StreamingLLM" yang membolehkan model bahasa memproses teks tanpa henti dengan lancar

- Alamat kertas: https://arxiv.org /pdf/2309.17453.pdf

- Alamat projek: https://github.com/mit-han-lab/streaming-llm

StreamingLLM berfungsi dengan mengenal pasti dan menyimpan niat ” (perhatian tenggelam) yang menambat token awal untuk alasannya. Digabungkan dengan cache rolling token baru-baru ini, StreamingLLM mempercepatkan inferens sebanyak 22x tanpa mengorbankan sebarang ketepatan. Hanya dalam beberapa hari, projek itu telah memperoleh 2.5K bintang pada platform GitHub:

Secara khusus, StreamingLLM ialah model bahasa yang boleh mengingati dengan tepat skor permainan sebelumnya, a kontrak yang panjang, atau kandungan perbahasan. Sama seperti menaik taraf memori pembantu AI, ia boleh mengendalikan lebih banyak beban kerja yang berat dengan sempurna

Mari lihat butiran teknikal seterusnya.

Inovasi Kaedah

Secara amnya, LLM dihadkan oleh tingkap perhatian semasa pra-latihan. Walaupun terdapat banyak kerja sebelum ini untuk mengembangkan saiz tetingkap ini dan meningkatkan kecekapan latihan dan inferens, panjang jujukan LLM yang boleh diterima masih terhad, yang tidak mesra untuk penggunaan berterusan.

Dalam kertas kerja ini, penyelidik mula-mula memperkenalkan konsep aplikasi penstriman LLM dan menimbulkan persoalan: "Bolehkah LLM digunakan dengan input yang tidak terhingga tanpa mengorbankan kecekapan dan prestasi?"

Apabila menggunakan LLM pada panjang yang tidak terhingga aliran input, anda akan menghadapi dua cabaran utama:

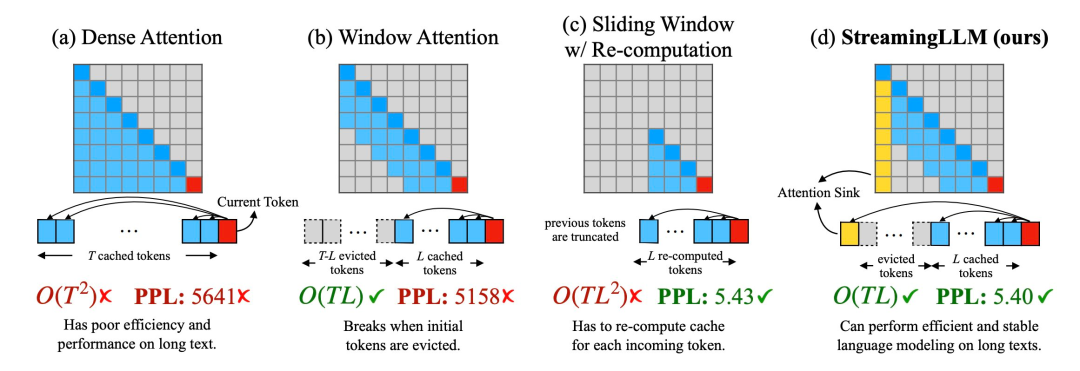

1 Dalam peringkat penyahkodan, LLM berasaskan transformer akan menyimpan status Kunci dan Nilai (KV) bagi semua token sebelumnya, seperti yang ditunjukkan dalam Rajah 1 (Seperti yang ditunjukkan dalam. a), ini boleh membawa kepada penggunaan memori yang berlebihan dan meningkatkan kependaman penyahkodan

2 Model sedia ada mempunyai keupayaan ekstrapolasi panjang yang terhad, iaitu, apabila panjang jujukan melebihi tetingkap perhatian yang ditetapkan semasa pra-latihan, ia terlalu terhad. jam yang besar, prestasinya akan merosot.

Kaedah intuitif dipanggil Window Attention (Rajah 1 b) Kaedah ini hanya mengekalkan tetingkap gelongsor bersaiz tetap pada status KV token terkini Walaupun ia boleh memastikan penggunaan memori dan penyahkodan yang stabil kelajuan selepas cache diisi, tetapi apabila panjang jujukan melebihi saiz cache, atau malah hanya mengusir KV token pertama, model akan ranap. Kaedah lain ialah mengira semula tetingkap gelongsor (ditunjukkan dalam Rajah 1 c). Kaedah ini membina semula keadaan KV bagi token yang dijana Walaupun prestasinya berkuasa, ia memerlukan pengiraan perhatian sekunder dalam tetingkap hasilnya adalah lebih perlahan, yang tidak sesuai dalam aplikasi penstriman sebenar.

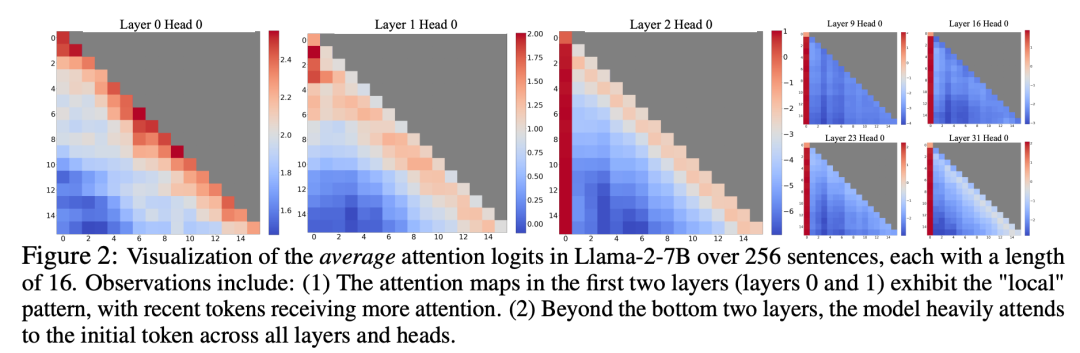

Dalam proses mengkaji kegagalan perhatian tetingkap, penyelidik menemui fenomena menarik: menurut Rajah 2, sejumlah besar skor perhatian diberikan kepada tag awal, tidak kira sama ada tag ini berkaitan dengan tugas pemodelan bahasa

Penyelidik memanggil token ini sebagai "kolam perhatian": walaupun ia tidak mempunyai makna semantik, ia menduduki sejumlah besar skor perhatian. Penyelidik mengaitkan fenomena ini kepada Softmax (yang memerlukan jumlah skor perhatian semua token konteks ialah 1 Walaupun pertanyaan semasa tidak mempunyai padanan yang kukuh antara banyak token sebelumnya, model masih perlu memindahkan perhatian yang tidak diingini ini). . Nilai ditetapkan di suatu tempat supaya jumlahnya menjadi 1. Sebab mengapa token awal menjadi "kolam" adalah intuitif: disebabkan oleh ciri-ciri pemodelan bahasa autoregresif, token awal kelihatan kepada hampir semua token berikutnya, yang menjadikannya lebih mudah untuk dilatih sebagai kumpulan perhatian.

Berdasarkan pandangan di atas, penyelidik mencadangkan StreamingLLM. Ini ialah rangka kerja yang mudah dan cekap yang membolehkan model perhatian yang dilatih dengan tingkap perhatian terhad untuk mengendalikan teks yang panjang tidak terhingga tanpa penalaan halus

StreamingLLM mengambil kesempatan daripada fakta bahawa kumpulan perhatian mempunyai nilai perhatian yang tinggi Malah, mengekalkan kumpulan perhatian ini boleh jadikan taburan skor perhatian hampir kepada taburan normal. Oleh itu, StreamingLLM hanya perlu mengekalkan nilai KV token pool perhatian (hanya 4 token awal sudah mencukupi) dan nilai KV tetingkap gelongsor untuk menambat pengiraan perhatian dan menstabilkan prestasi model.

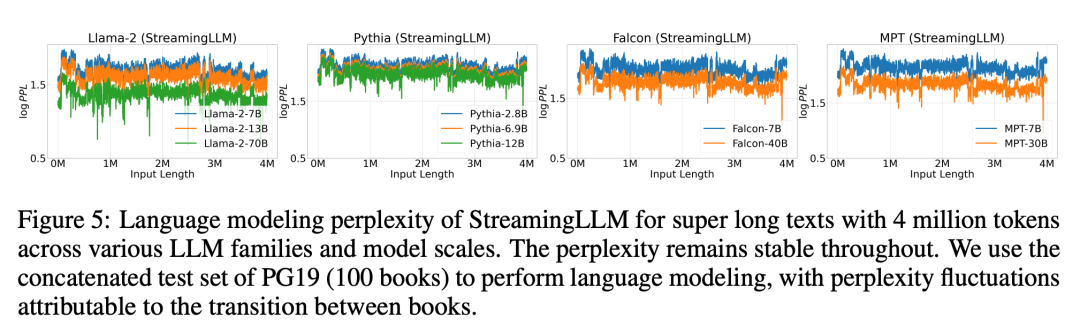

Menggunakan StreamingLLM, termasuk Llama-2-[7,13,70] B, MPT-[7,30] B, Falcon-[7,40] B dan Pythia [2.9,6.9,12] B Model boleh mensimulasikan 4 juta token atau lebih dengan pasti.

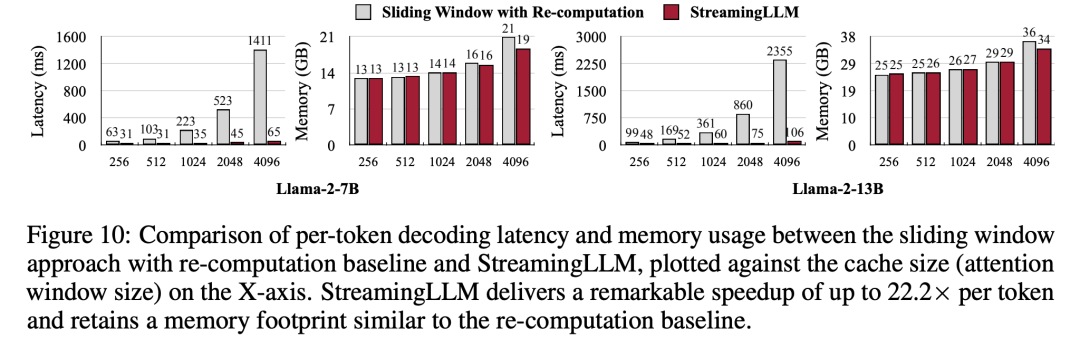

Berbanding dengan mengira semula tetingkap gelongsor, StreamingLLM adalah 22.2 kali lebih pantas tanpa menjejaskan prestasi

Penilaian

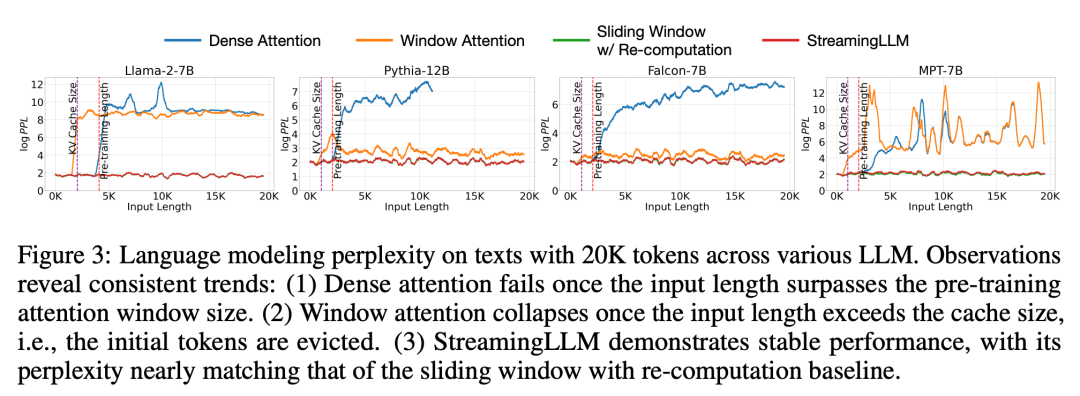

Dalam eksperimen, seperti yang ditunjukkan dalam Rajah 3, perplexiti LL, untuk teks 3M setanding dengan garis dasar Oracle yang mengira semula tetingkap gelongsor. Pada masa yang sama, apabila panjang input melebihi tetingkap pra-latihan, perhatian yang padat gagal, dan apabila panjang input melebihi saiz cache, perhatian tetingkap akan tersekat, menyebabkan tag awal akan disingkirkan

Rajah 5 Selanjutnya Kebolehpercayaan StreamingLLM ditunjukkan dan ia boleh mengendalikan teks dengan saiz luar biasa, termasuk lebih daripada 4 juta token, meliputi pelbagai keluarga dan saiz model. Model ini termasuk Llama-2-[7,13,70] B, Falcon-[7,40] B, Pythia-[2.8,6.9,12] B dan MPT-[7,30] B

Seterusnya, penyelidik mengesahkan hipotesis "kolam perhatian" dan membuktikan bahawa model bahasa boleh dilatih terlebih dahulu dan hanya memerlukan satu token kumpulan perhatian semasa penggunaan penstriman. Khususnya, mereka mencadangkan menambah token boleh dipelajari tambahan pada permulaan semua sampel latihan sebagai kumpulan perhatian yang ditetapkan. Dengan pra-latihan model bahasa dengan 160 juta parameter dari awal, para penyelidik menunjukkan bahawa kaedah kami boleh mengekalkan prestasi model. Ini sangat berbeza dengan model bahasa semasa, yang memerlukan pengenalan semula berbilang token awal sebagai kumpulan perhatian untuk mencapai tahap prestasi yang sama.

Akhir sekali, penyelidik membandingkan kependaman penyahkodan dan penggunaan memori StreamingLLM dengan tetingkap gelongsor yang dikira semula dan mengujinya menggunakan model Llama-2-7B dan Llama-2-13B pada GPU NVIDIA A6000 tunggal. Menurut keputusan dalam Rajah 10, apabila saiz cache meningkat, kelajuan penyahkodan StreamingLLM meningkat secara linear, manakala kelewatan penyahkodan meningkat secara kuadratik. Eksperimen telah membuktikan bahawa StreamingLLM mencapai kelajuan yang mengagumkan, dengan kelajuan setiap token meningkat sehingga 22.2 kali ganda

Untuk butiran penyelidikan lanjut, sila rujuk kertas asal.

🎜Atas ialah kandungan terperinci Dengan sehingga 4 juta konteks token dan inferens 22 kali lebih pantas, StreamingLLM telah menjadi popular dan telah menerima 2.5K bintang di GitHub.. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1376

1376

52

52

Geospatial Laravel: Pengoptimuman peta interaktif dan sejumlah besar data

Apr 08, 2025 pm 12:24 PM

Geospatial Laravel: Pengoptimuman peta interaktif dan sejumlah besar data

Apr 08, 2025 pm 12:24 PM

Cecair memproses 7 juta rekod dan membuat peta interaktif dengan teknologi geospatial. Artikel ini meneroka cara memproses lebih dari 7 juta rekod menggunakan Laravel dan MySQL dan mengubahnya menjadi visualisasi peta interaktif. Keperluan Projek Cabaran Awal: Ekstrak Wawasan berharga menggunakan 7 juta rekod dalam pangkalan data MySQL. Ramai orang mula -mula mempertimbangkan bahasa pengaturcaraan, tetapi mengabaikan pangkalan data itu sendiri: Bolehkah ia memenuhi keperluan? Adakah penghijrahan data atau pelarasan struktur diperlukan? Bolehkah MySQL menahan beban data yang besar? Analisis awal: Penapis utama dan sifat perlu dikenalpasti. Selepas analisis, didapati bahawa hanya beberapa atribut yang berkaitan dengan penyelesaiannya. Kami mengesahkan kemungkinan penapis dan menetapkan beberapa sekatan untuk mengoptimumkan carian. Carian Peta Berdasarkan Bandar

Cara menyelesaikan MySQL tidak dapat dimulakan

Apr 08, 2025 pm 02:21 PM

Cara menyelesaikan MySQL tidak dapat dimulakan

Apr 08, 2025 pm 02:21 PM

Terdapat banyak sebab mengapa permulaan MySQL gagal, dan ia boleh didiagnosis dengan memeriksa log ralat. Penyebab umum termasuk konflik pelabuhan (periksa penghunian pelabuhan dan ubah suai konfigurasi), isu kebenaran (periksa keizinan pengguna yang menjalankan perkhidmatan), ralat fail konfigurasi (periksa tetapan parameter), rasuah direktori data (memulihkan data atau membina semula ruang meja), isu ruang jadual InnoDB (semak fail ibdata1) Apabila menyelesaikan masalah, anda harus menganalisisnya berdasarkan log ralat, cari punca utama masalah, dan mengembangkan tabiat sandaran data secara teratur untuk mencegah dan menyelesaikan masalah.

Cara Menggunakan MySQL Selepas Pemasangan

Apr 08, 2025 am 11:48 AM

Cara Menggunakan MySQL Selepas Pemasangan

Apr 08, 2025 am 11:48 AM

Artikel ini memperkenalkan operasi pangkalan data MySQL. Pertama, anda perlu memasang klien MySQL, seperti MySqlworkbench atau Command Line Client. 1. Gunakan perintah MySQL-Uroot-P untuk menyambung ke pelayan dan log masuk dengan kata laluan akaun root; 2. Gunakan CreateTatabase untuk membuat pangkalan data, dan gunakan Pilih pangkalan data; 3. Gunakan createtable untuk membuat jadual, menentukan medan dan jenis data; 4. Gunakan InsertInto untuk memasukkan data, data pertanyaan, kemas kini data dengan kemas kini, dan padam data dengan padam. Hanya dengan menguasai langkah -langkah ini, belajar menangani masalah biasa dan mengoptimumkan prestasi pangkalan data anda boleh menggunakan MySQL dengan cekap.

Jurutera Backend Senior Remote (Platform) memerlukan kalangan

Apr 08, 2025 pm 12:27 PM

Jurutera Backend Senior Remote (Platform) memerlukan kalangan

Apr 08, 2025 pm 12:27 PM

Jurutera Backend Senior Remote Company Kekosongan Syarikat: Lokasi Lokasi: Jauh Pejabat Jauh Jenis: Gaji sepenuh masa: $ 130,000- $ 140,000 Penerangan Pekerjaan Mengambil bahagian dalam penyelidikan dan pembangunan aplikasi mudah alih Circle dan ciri-ciri berkaitan API awam yang meliputi keseluruhan kitaran hayat pembangunan perisian. Tanggungjawab utama kerja pembangunan secara bebas berdasarkan rubyonrails dan bekerjasama dengan pasukan react/redux/relay front-end. Membina fungsi teras dan penambahbaikan untuk aplikasi web dan bekerjasama rapat dengan pereka dan kepimpinan sepanjang proses reka bentuk berfungsi. Menggalakkan proses pembangunan positif dan mengutamakan kelajuan lelaran. Memerlukan lebih daripada 6 tahun backend aplikasi web kompleks

Bolehkah mysql kembali json

Apr 08, 2025 pm 03:09 PM

Bolehkah mysql kembali json

Apr 08, 2025 pm 03:09 PM

MySQL boleh mengembalikan data JSON. Fungsi JSON_EXTRACT mengekstrak nilai medan. Untuk pertanyaan yang kompleks, pertimbangkan untuk menggunakan klausa WHERE untuk menapis data JSON, tetapi perhatikan kesan prestasinya. Sokongan MySQL untuk JSON sentiasa meningkat, dan disyorkan untuk memberi perhatian kepada versi dan ciri terkini.

Memahami sifat asid: tiang pangkalan data yang boleh dipercayai

Apr 08, 2025 pm 06:33 PM

Memahami sifat asid: tiang pangkalan data yang boleh dipercayai

Apr 08, 2025 pm 06:33 PM

Penjelasan terperinci mengenai atribut asid asid pangkalan data adalah satu set peraturan untuk memastikan kebolehpercayaan dan konsistensi urus niaga pangkalan data. Mereka menentukan bagaimana sistem pangkalan data mengendalikan urus niaga, dan memastikan integriti dan ketepatan data walaupun dalam hal kemalangan sistem, gangguan kuasa, atau pelbagai pengguna akses serentak. Gambaran keseluruhan atribut asid Atomicity: Transaksi dianggap sebagai unit yang tidak dapat dipisahkan. Mana -mana bahagian gagal, keseluruhan transaksi dilancarkan kembali, dan pangkalan data tidak mengekalkan sebarang perubahan. Sebagai contoh, jika pemindahan bank ditolak dari satu akaun tetapi tidak meningkat kepada yang lain, keseluruhan operasi dibatalkan. Begintransaction; UpdateAcCountSsetBalance = Balance-100Wh

Mysql tidak dapat dipasang setelah memuat turun

Apr 08, 2025 am 11:24 AM

Mysql tidak dapat dipasang setelah memuat turun

Apr 08, 2025 am 11:24 AM

Sebab utama kegagalan pemasangan MySQL adalah: 1. Isu kebenaran, anda perlu menjalankan sebagai pentadbir atau menggunakan perintah sudo; 2. Ketergantungan hilang, dan anda perlu memasang pakej pembangunan yang relevan; 3. Konflik pelabuhan, anda perlu menutup program yang menduduki port 3306 atau mengubah suai fail konfigurasi; 4. Pakej pemasangan adalah korup, anda perlu memuat turun dan mengesahkan integriti; 5. Pembolehubah persekitaran dikonfigurasikan dengan salah, dan pembolehubah persekitaran mesti dikonfigurasi dengan betul mengikut sistem operasi. Selesaikan masalah ini dan periksa dengan teliti setiap langkah untuk berjaya memasang MySQL.

Klausa had SQL Master: Kawal bilangan baris dalam pertanyaan

Apr 08, 2025 pm 07:00 PM

Klausa had SQL Master: Kawal bilangan baris dalam pertanyaan

Apr 08, 2025 pm 07:00 PM

Klausa SQLLIMIT: Kawal bilangan baris dalam hasil pertanyaan. Klausa had dalam SQL digunakan untuk mengehadkan bilangan baris yang dikembalikan oleh pertanyaan. Ini sangat berguna apabila memproses set data yang besar, paparan paginat dan data ujian, dan dapat meningkatkan kecekapan pertanyaan dengan berkesan. Sintaks Asas Sintaks: SelectColumn1, Column2, ... FROMTABLE_NAMELIMITNUMBER_OF_ROWS; Number_of_rows: Tentukan bilangan baris yang dikembalikan. Sintaks dengan Offset: SelectColumn1, Column2, ... Fromtable_namelimitoffset, Number_of_rows; Offset: Langkau