LeCun amat kecewa dengan penipuan unicorn memandu sendiri

Adakah anda rasa ini video memandu sendiri biasa?

Gambar

Gambar

Kandungan ini perlu ditulis semula ke dalam bahasa Cina tanpa mengubah maksud asal

Tiada satu bingkai pun "nyata".

Gambar

Gambar

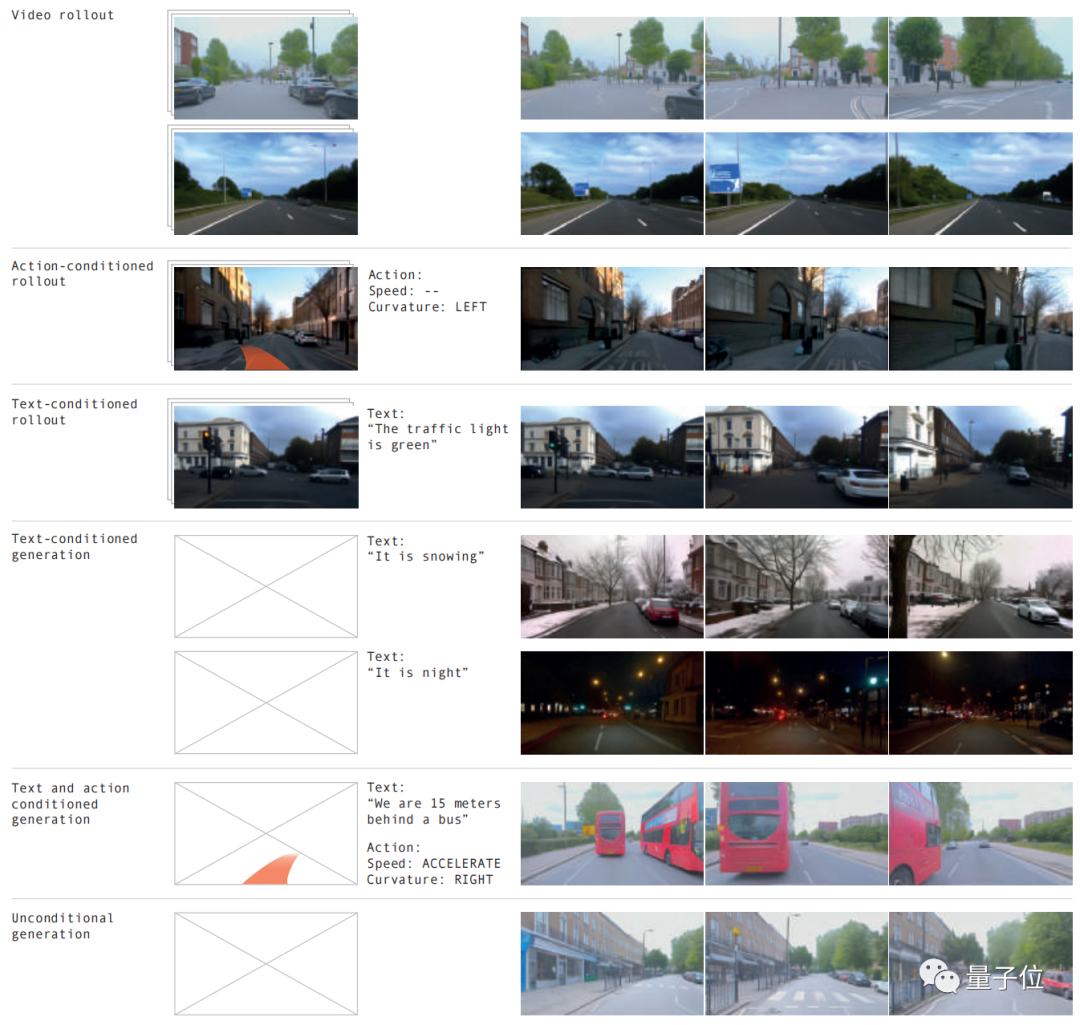

Keadaan jalan yang berbeza, pelbagai keadaan cuaca, dan lebih daripada 20 situasi boleh disimulasikan, dan kesannya sama seperti yang sebenar.

Gambar

Gambar

Model dunia telah melakukan kerja yang hebat sekali lagi! LeCun dengan penuh semangat mengetweet semula ini selepas melihatnya.

Gambar

Gambar

Mengikut kesan di atas, ini dibawakan oleh versi terbaru GAIA-1

Skala projek ini telah mencapai 9 bilion parameter Melalui latihan video memandu selama 4700 jam, ia telah berjaya dicapai video input, Manfaat paling langsung untuk menjana video memandu sendiri daripada teks atau operasi ialah ia boleh meramalkan peristiwa masa hadapan dengan lebih baik, dan lebih daripada 20 senario boleh disimulasikan, sekali gus meningkatkan lagi keselamatan pemanduan sendiri dan mengurangkan kos.

Gambar Pasukan kreatif kami secara terus terang menyatakan bahawa ini akan mengubah sepenuhnya peraturan permainan pemanduan autonomi!

Pasukan kreatif kami secara terus terang menyatakan bahawa ini akan mengubah sepenuhnya peraturan permainan pemanduan autonomi!

Jadi bagaimana GAIA-1 dilaksanakan?

Semakin besar skala, semakin baik

GAIA-1 ialah model dunia generatif dengan pelbagai mod

Dengan memanfaatkan video, teks dan tindakan sebagai input, sistem boleh menjana video adegan pemanduan yang realistik dan boleh mengawal kawalan halus autonomi ke atas kenderaan ciri tingkah laku dan pemandangan

Video boleh dijana dengan hanya menggunakan gesaan teks

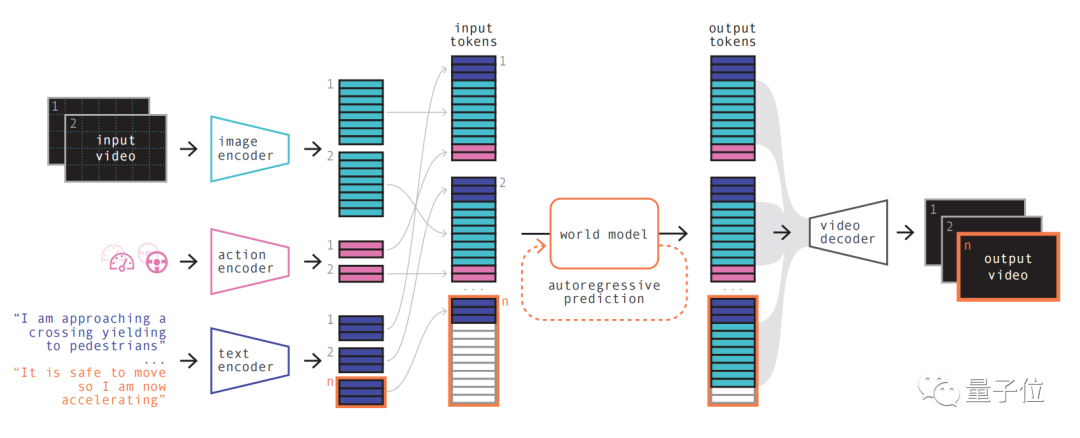

Gambar  Prinsip modelnya adalah serupa dengan model bahasa besar, iaitu, meramalkan token seterusnya

Prinsip modelnya adalah serupa dengan model bahasa besar, iaitu, meramalkan token seterusnya

Model boleh menggunakan pengkuantitian vektor bingkai video dan kemudian meramalkan adegan masa hadapan ditukar kepada meramalkan token seterusnya dalam jujukan. Model resapan kemudiannya digunakan untuk menjana video berkualiti tinggi daripada ruang bahasa model dunia.

Langkah-langkah khusus adalah seperti berikut:

Gambar Langkah pertama mudah difahami, iaitu mengekod semula dan menyusun serta menggabungkan pelbagai input.

Langkah pertama mudah difahami, iaitu mengekod semula dan menyusun serta menggabungkan pelbagai input.

Dengan menggunakan pengekod khusus untuk mengekod pelbagai input dan menayangkan input berbeza ke dalam perwakilan bersama. Pengekod teks dan video mengasingkan dan membenamkan input, manakala perwakilan operasi diunjurkan secara individu menjadi perwakilan dikongsi

Perwakilan yang dikodkan ini konsisten secara sementara.

Selepas mengatur, bahagian utama model dunia muncul.

Sebagai Transformer autoregresif, ia boleh meramalkan set token imej seterusnya dalam jujukan. Dan ia bukan sahaja mengambil kira token imej sebelumnya, tetapi juga mengambil kira maklumat kontekstual teks dan operasi.

Kandungan yang dijana oleh model bukan sahaja mengekalkan ketekalan imej, tetapi juga konsisten dengan teks dan tindakan yang diramalkan

Pasukan memperkenalkan bahawa saiz model dunia dalam GAIA-1 ialah 6.5 bilion parameter dan telah dilatih pada 64 A100s selama 15 hari Menjadi.

Akhir sekali, gunakan penyahkod video dan model penyebaran video untuk menukar token ini kembali kepada video.

Kepentingan langkah ini adalah untuk memastikan kualiti semantik, ketepatan imej dan ketekalan temporal video

Penyahkod video GAIA-1 mempunyai skala 2.6 bilion parameter dan telah dilatih menggunakan 32 A100 selama 15 hari.

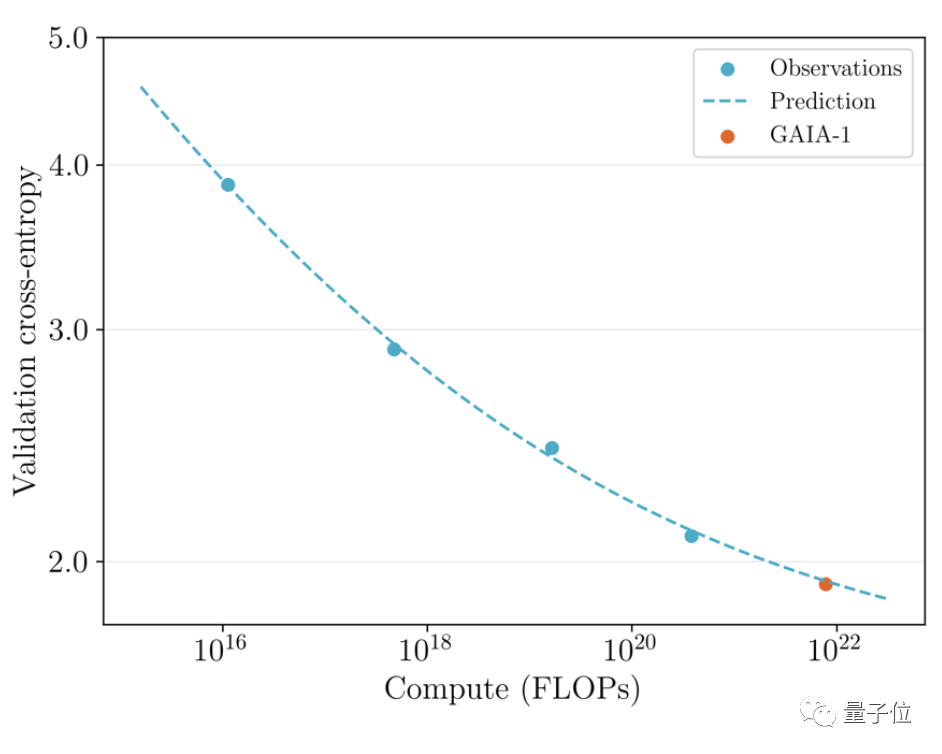

Perlu dinyatakan bahawa GAIA-1 bukan sahaja serupa dengan prinsip model bahasa berskala besar, tetapi juga menunjukkan ciri kualiti penjanaan yang lebih baik apabila skala model berkembang

Gambar Pasukan menyemak dikeluarkan sebelum ini Jun Versi awal dan kesan terkini dibandingkan

Pasukan menyemak dikeluarkan sebelum ini Jun Versi awal dan kesan terkini dibandingkan

Yang terakhir adalah 480 kali lebih besar daripada yang pertama.

Anda boleh melihat secara intuitif bahawa butiran dan peleraian video telah dipertingkatkan dengan ketara.

Gambar Dari perspektif aplikasi praktikal, kemunculan GAIA-1 juga telah membawa sedikit impak bahawa ini akan mengubah peraturan pemanduan autonomi

Dari perspektif aplikasi praktikal, kemunculan GAIA-1 juga telah membawa sedikit impak bahawa ini akan mengubah peraturan pemanduan autonomi

Picture

Picture

Sebabnya boleh dijelaskan dari tiga aspek:

- #🎜🎜🎜🎜🎜🎜 #

- Data latihan yang komprehensif

- Senario ekor panjang

- Pertama sekali, dari segi keselamatan, model dunia boleh mensimulasikan masa depan, memberikan AI keupayaan untuk merealisasikan keputusannya sendiri, yang penting untuk keselamatan pemanduan autonomi.

Kedua, data latihan juga sangat penting untuk pemanduan autonomi. AI Generatif boleh menyelesaikan salah satu cabaran senario ekor panjang yang dihadapi oleh pemanduan autonomi. Ia boleh mengendalikan lebih banyak senario kelebihan, seperti menghadapi pejalan kaki yang melintas jalan dalam cuaca berkabus. Ini akan meningkatkan lagi keupayaan pemanduan autonomi

Siapakah Wayve?

GAIA-1 telah dibangunkan oleh syarikat permulaan memandu sendiri British Wayve

Wayve telah diasaskan pada 2017. Pelabur termasuk Microsoft dan lain-lain, dan penilaiannya telah mencapai unicorn.

Pengasasnya ialah Alex Kendall dan Amar Shah, kedua-duanya mempunyai PhD dalam pembelajaran mesin dari Universiti Cambridge

Gambar

# 🎜🎜# Pada laluan teknikal, seperti Tesla, Wayve menyokong penyelesaian visual semata-mata menggunakan kamera, meninggalkan peta berketepatan tinggi sangat awal dan mengikuti laluan "persepsi segera".  Tidak lama dahulu, sebuah lagi model besar LINGO-1 yang dikeluarkan oleh pasukan turut menarik perhatian meluas

Tidak lama dahulu, sebuah lagi model besar LINGO-1 yang dikeluarkan oleh pasukan turut menarik perhatian meluas

Alamat kertas:  https://www.php.cn/link/4a08c14e fbf # 🎜🎜#Pautan rujukan:

https://www.php.cn/link/4a08c14e fbf # 🎜🎜#Pautan rujukan:

https://www.php.cn/link/85dca1d270f7f9aef00c9d372#f114🎜 https ://www.php.cn/link/a4c22565dfafb162a17a7c357ca9e0be

Atas ialah kandungan terperinci LeCun amat kecewa dengan penipuan unicorn memandu sendiri. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1384

1384

52

52

Bagaimana untuk menyelesaikan masalah ekor panjang dalam senario pemanduan autonomi?

Jun 02, 2024 pm 02:44 PM

Bagaimana untuk menyelesaikan masalah ekor panjang dalam senario pemanduan autonomi?

Jun 02, 2024 pm 02:44 PM

Semalam semasa temu bual, saya telah ditanya sama ada saya telah membuat sebarang soalan berkaitan ekor panjang, jadi saya fikir saya akan memberikan ringkasan ringkas. Masalah ekor panjang pemanduan autonomi merujuk kepada kes tepi dalam kenderaan autonomi, iaitu, kemungkinan senario dengan kebarangkalian yang rendah untuk berlaku. Masalah ekor panjang yang dirasakan adalah salah satu sebab utama yang kini mengehadkan domain reka bentuk pengendalian kenderaan autonomi pintar satu kenderaan. Seni bina asas dan kebanyakan isu teknikal pemanduan autonomi telah diselesaikan, dan baki 5% masalah ekor panjang secara beransur-ansur menjadi kunci untuk menyekat pembangunan pemanduan autonomi. Masalah ini termasuk pelbagai senario yang berpecah-belah, situasi yang melampau dan tingkah laku manusia yang tidak dapat diramalkan. "Ekor panjang" senario tepi dalam pemanduan autonomi merujuk kepada kes tepi dalam kenderaan autonomi (AVs) kes Edge adalah senario yang mungkin dengan kebarangkalian yang rendah untuk berlaku. kejadian yang jarang berlaku ini

Di luar ORB-SLAM3! SL-SLAM: Adegan bertekstur lemah ringan, kegelisahan teruk dan lemah semuanya dikendalikan

May 30, 2024 am 09:35 AM

Di luar ORB-SLAM3! SL-SLAM: Adegan bertekstur lemah ringan, kegelisahan teruk dan lemah semuanya dikendalikan

May 30, 2024 am 09:35 AM

Ditulis sebelum ini, hari ini kita membincangkan bagaimana teknologi pembelajaran mendalam boleh meningkatkan prestasi SLAM berasaskan penglihatan (penyetempatan dan pemetaan serentak) dalam persekitaran yang kompleks. Dengan menggabungkan kaedah pengekstrakan ciri dalam dan pemadanan kedalaman, di sini kami memperkenalkan sistem SLAM visual hibrid serba boleh yang direka untuk meningkatkan penyesuaian dalam senario yang mencabar seperti keadaan cahaya malap, pencahayaan dinamik, kawasan bertekstur lemah dan seks yang teruk. Sistem kami menyokong berbilang mod, termasuk konfigurasi monokular, stereo, monokular-inersia dan stereo-inersia lanjutan. Selain itu, ia juga menganalisis cara menggabungkan SLAM visual dengan kaedah pembelajaran mendalam untuk memberi inspirasi kepada penyelidikan lain. Melalui percubaan yang meluas pada set data awam dan data sampel sendiri, kami menunjukkan keunggulan SL-SLAM dari segi ketepatan kedudukan dan keteguhan penjejakan.

Mari kita bincangkan tentang sistem pemanduan autonomi hujung ke hujung dan generasi seterusnya, serta beberapa salah faham tentang pemanduan autonomi hujung ke hujung?

Apr 15, 2024 pm 04:13 PM

Mari kita bincangkan tentang sistem pemanduan autonomi hujung ke hujung dan generasi seterusnya, serta beberapa salah faham tentang pemanduan autonomi hujung ke hujung?

Apr 15, 2024 pm 04:13 PM

Pada bulan lalu, atas sebab-sebab yang diketahui umum, saya telah mengadakan pertukaran yang sangat intensif dengan pelbagai guru dan rakan sekelas dalam industri. Topik yang tidak dapat dielakkan dalam pertukaran secara semula jadi adalah hujung ke hujung dan Tesla FSDV12 yang popular. Saya ingin mengambil kesempatan ini untuk menyelesaikan beberapa buah fikiran dan pendapat saya pada masa ini untuk rujukan dan perbincangan anda. Bagaimana untuk mentakrifkan sistem pemanduan autonomi hujung ke hujung, dan apakah masalah yang sepatutnya dijangka diselesaikan hujung ke hujung? Menurut definisi yang paling tradisional, sistem hujung ke hujung merujuk kepada sistem yang memasukkan maklumat mentah daripada penderia dan secara langsung mengeluarkan pembolehubah yang membimbangkan tugas. Sebagai contoh, dalam pengecaman imej, CNN boleh dipanggil hujung-ke-hujung berbanding kaedah pengekstrak ciri + pengelas tradisional. Dalam tugas pemanduan autonomi, masukkan data daripada pelbagai penderia (kamera/LiDAR

SOTA terbaharu nuScenes |. SparseAD: Pertanyaan jarang membantu pemanduan autonomi hujung ke hujung yang cekap!

Apr 17, 2024 pm 06:22 PM

SOTA terbaharu nuScenes |. SparseAD: Pertanyaan jarang membantu pemanduan autonomi hujung ke hujung yang cekap!

Apr 17, 2024 pm 06:22 PM

Ditulis di hadapan & titik permulaan Paradigma hujung ke hujung menggunakan rangka kerja bersatu untuk mencapai pelbagai tugas dalam sistem pemanduan autonomi. Walaupun kesederhanaan dan kejelasan paradigma ini, prestasi kaedah pemanduan autonomi hujung ke hujung pada subtugas masih jauh ketinggalan berbanding kaedah tugasan tunggal. Pada masa yang sama, ciri pandangan mata burung (BEV) padat yang digunakan secara meluas dalam kaedah hujung ke hujung sebelum ini menyukarkan untuk membuat skala kepada lebih banyak modaliti atau tugasan. Paradigma pemanduan autonomi hujung ke hujung (SparseAD) tertumpu carian jarang dicadangkan di sini, di mana carian jarang mewakili sepenuhnya keseluruhan senario pemanduan, termasuk ruang, masa dan tugas, tanpa sebarang perwakilan BEV yang padat. Khususnya, seni bina jarang bersatu direka bentuk untuk kesedaran tugas termasuk pengesanan, penjejakan dan pemetaan dalam talian. Di samping itu, berat

FisheyeDetNet: algoritma pengesanan sasaran pertama berdasarkan kamera fisheye

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: algoritma pengesanan sasaran pertama berdasarkan kamera fisheye

Apr 26, 2024 am 11:37 AM

Pengesanan objek ialah masalah yang agak matang dalam sistem pemanduan autonomi, antaranya pengesanan pejalan kaki adalah salah satu algoritma terawal untuk digunakan. Penyelidikan yang sangat komprehensif telah dijalankan dalam kebanyakan kertas kerja. Walau bagaimanapun, persepsi jarak menggunakan kamera fisheye untuk pandangan sekeliling agak kurang dikaji. Disebabkan herotan jejari yang besar, perwakilan kotak sempadan standard sukar dilaksanakan dalam kamera fisheye. Untuk mengurangkan perihalan di atas, kami meneroka kotak sempadan lanjutan, elips dan reka bentuk poligon am ke dalam perwakilan kutub/sudut dan mentakrifkan metrik mIOU pembahagian contoh untuk menganalisis perwakilan ini. Model fisheyeDetNet yang dicadangkan dengan bentuk poligon mengatasi model lain dan pada masa yang sama mencapai 49.5% mAP pada set data kamera fisheye Valeo untuk pemanduan autonomi

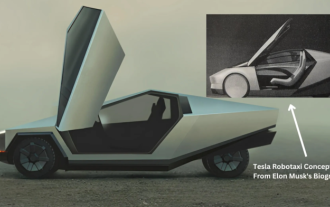

Tesla akhirnya mengambil tindakan! Adakah teksi pandu sendiri akan didedahkan tidak lama lagi? !

Apr 08, 2024 pm 05:49 PM

Tesla akhirnya mengambil tindakan! Adakah teksi pandu sendiri akan didedahkan tidak lama lagi? !

Apr 08, 2024 pm 05:49 PM

Menurut berita pada 8 April, Ketua Pegawai Eksekutif Tesla Elon Musk baru-baru ini mendedahkan bahawa Tesla komited untuk membangunkan sepenuhnya teknologi kereta pandu sendiri Robotaxi teksi pandu sendiri tanpa pemandu yang dinanti-nantikan akan dilancarkan pada 8 Ogos. Editor data mengetahui bahawa kenyataan Musk pada Sebelum ini, Reuters melaporkan bahawa rancangan Tesla untuk memandu kereta akan memberi tumpuan kepada pengeluaran Robotaxi. Bagaimanapun, Musk menafikannya, menuduh Reuters telah membatalkan rancangan untuk membangunkan kereta kos rendah dan sekali lagi menerbitkan laporan palsu, sambil menjelaskan bahawa kereta kos rendah Model 2 dan Robotax

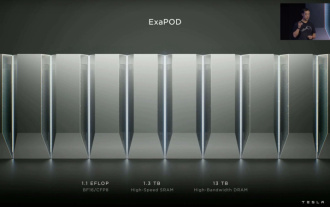

Debut pengkomputeran super Tesla Dojo, Musk: Kuasa pengkomputeran latihan AI menjelang akhir tahun akan lebih kurang sama dengan 8,000 GPU NVIDIA H100

Jul 24, 2024 am 10:38 AM

Debut pengkomputeran super Tesla Dojo, Musk: Kuasa pengkomputeran latihan AI menjelang akhir tahun akan lebih kurang sama dengan 8,000 GPU NVIDIA H100

Jul 24, 2024 am 10:38 AM

Menurut berita dari laman web ini pada 24 Julai, Ketua Pegawai Eksekutif Tesla Elon Musk (Elon Musk) menyatakan dalam panggilan persidangan pendapatan hari ini bahawa syarikat itu akan menyelesaikan kluster latihan kecerdasan buatan terbesar setakat ini, yang akan dilengkapi dengan 2 Ribu NVIDIA H100 GPU. Musk juga memberitahu pelabur mengenai panggilan pendapatan syarikat bahawa Tesla akan berusaha membangunkan superkomputer Dojonya kerana GPU daripada Nvidia mahal. Tapak ini menterjemah sebahagian daripada ucapan Musk seperti berikut: Jalan untuk bersaing dengan NVIDIA melalui Dojo adalah sukar, tetapi saya fikir kami tidak mempunyai pilihan sekarang. Dari perspektif NVIDIA, mereka pasti akan meningkatkan harga GPU ke tahap yang boleh ditanggung oleh pasaran, tetapi

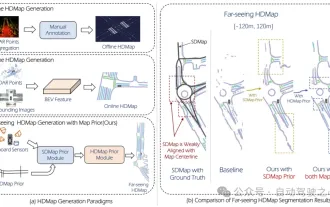

Pembunuh pengeluaran besar-besaran! P-Mapnet: Menggunakan peta SDMap berketepatan rendah sebelum ini, prestasi pemetaan dipertingkatkan dengan hampir 20 mata!

Mar 28, 2024 pm 02:36 PM

Pembunuh pengeluaran besar-besaran! P-Mapnet: Menggunakan peta SDMap berketepatan rendah sebelum ini, prestasi pemetaan dipertingkatkan dengan hampir 20 mata!

Mar 28, 2024 pm 02:36 PM

Seperti yang ditulis di atas, salah satu algoritma yang digunakan oleh sistem pemanduan autonomi semasa untuk menghilangkan pergantungan pada peta berketepatan tinggi adalah untuk mengambil kesempatan daripada fakta bahawa prestasi persepsi dalam julat jarak jauh masih lemah. Untuk tujuan ini, kami mencadangkan P-MapNet, di mana "P" memfokuskan pada menggabungkan peta sebelum untuk meningkatkan prestasi model. Khususnya, kami mengeksploitasi maklumat terdahulu dalam SDMap dan HDMap: di satu pihak, kami mengekstrak data SDMap yang sejajar dengan lemah daripada OpenStreetMap dan mengekodkannya ke dalam istilah bebas untuk menyokong input. Terdapat masalah penjajaran lemah antara input yang diubah suai dengan ketat dan HD+Map sebenar Struktur kami berdasarkan mekanisme Cross-attention boleh memfokus secara adaptif pada rangka SDMap dan membawa peningkatan prestasi yang ketara.