Peranti teknologi

Peranti teknologi

AI

AI

Risiko AI di luar kawalan meningkat: Berat model terbuka mencetuskan protes Meta

Risiko AI di luar kawalan meningkat: Berat model terbuka mencetuskan protes Meta

Risiko AI di luar kawalan meningkat: Berat model terbuka mencetuskan protes Meta

Editor: Du Wei, Xiaozhou

AI, terutamanya sumber terbuka dan sumber tertutup dalam era model besar, mempunyai kebaikan dan keburukan yang penting ialah bagaimana melakukan kerja yang baik dalam proses menggunakannya.

Orang ramai sentiasa berbelah bahagi mengenai pilihan antara sumber terbuka dan sumber tertutup dalam bidang AI Walau bagaimanapun, dalam era model besar, kuasa sumber terbuka yang kuat telah muncul secara senyap-senyap. Menurut dokumen dalaman yang bocor sebelum ini daripada Google, di sekitar model sumber terbuka seperti LLaMA Meta, seluruh komuniti dengan pantas membina model serupa dengan OpenAI dan keupayaan model besar Google.

Tidak syak lagi bahawa Meta adalah teras mutlak dunia sumber terbuka, dengan usaha sumber terbuka yang berterusan seperti keluaran terbaru Llama 2. Namun, segala yang baik dimusnahkan oleh angin Baru-baru ini, Meta telah "bermasalah" kerana sumber terbuka.

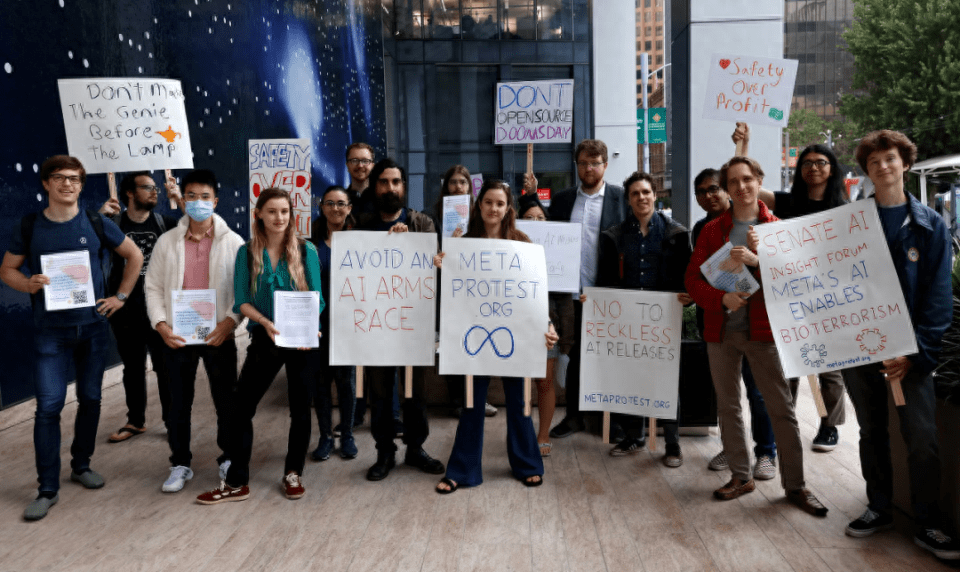

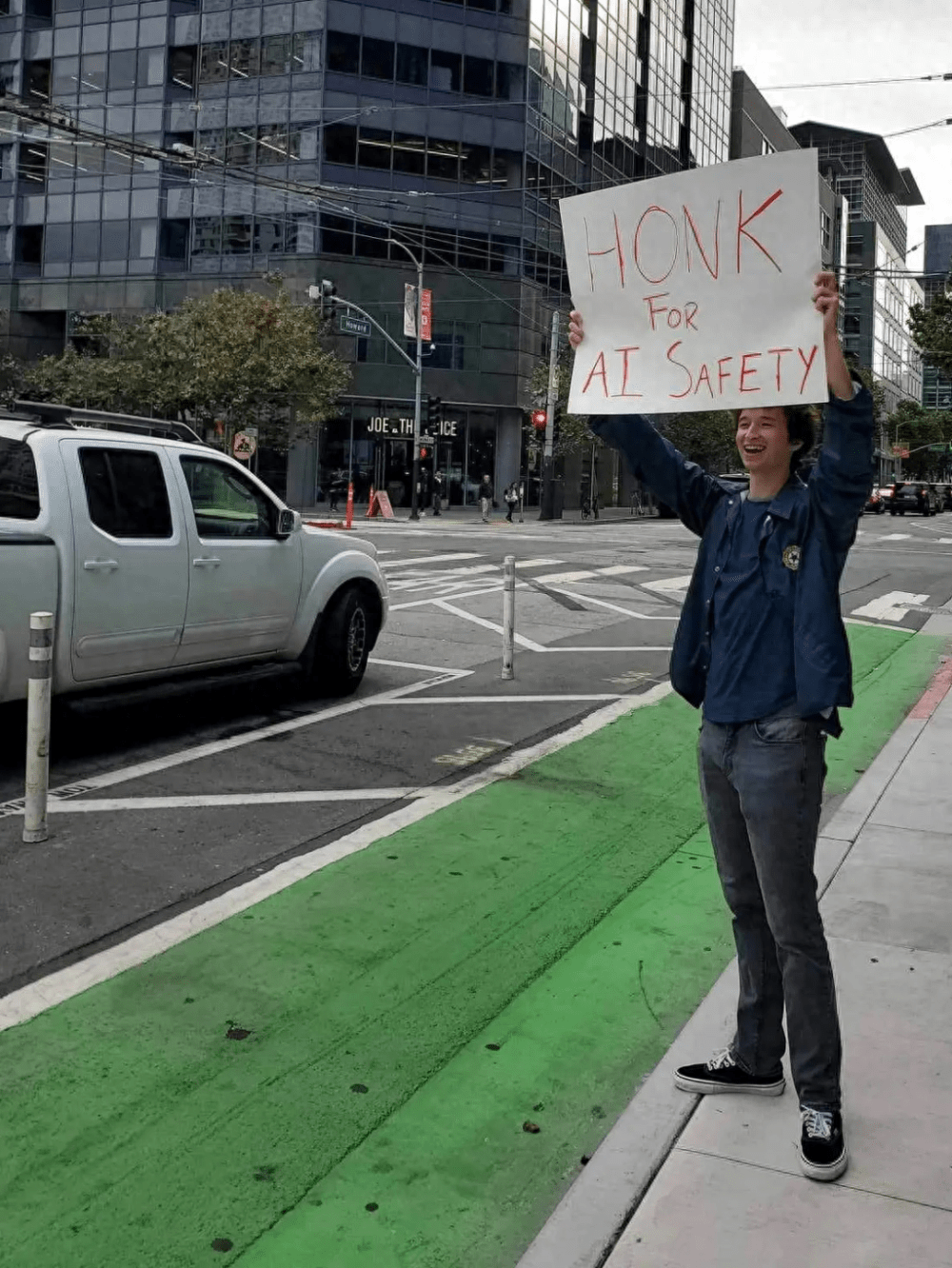

Di luar pejabat Meta di San Francisco, sekumpulan penunjuk perasaan yang memegang papan tanda berkumpul untuk membantah strategi Meta mengeluarkan model AI secara terbuka, dengan mendakwa bahawa model yang dikeluarkan ini menyebabkan "percambahan tidak dapat dipulihkan" teknologi yang berpotensi tidak selamat. Sesetengah penunjuk perasaan membandingkan model besar yang dikeluarkan oleh Meta dengan "senjata pemusnah besar-besaran"

Penunjuk perasaan ini menggelarkan diri mereka sebagai "warga prihatin" dan diketuai oleh Holly Elmore. Menurut LinkedIn, dia adalah penyokong bebas untuk pergerakan Jeda AI.

Kandungan yang perlu ditulis semula ialah: Sumber imej: MISHA GUREVICH

Jika model terbukti tidak selamat, dia menyatakan bahawa API boleh ditutup. Sebagai contoh, syarikat seperti Google dan OpenAI hanya membenarkan pengguna mengakses model besar melalui API

Sebaliknya, model sumber terbuka siri LLaMA Meta menjadikan pemberat model tersedia kepada orang ramai, membenarkan sesiapa sahaja yang mempunyai perkakasan dan kepakaran yang betul untuk meniru dan mengubah suai model itu sendiri. Sebaik sahaja berat model dikeluarkan, syarikat penerbitan tidak lagi mempunyai kawalan ke atas cara AI digunakan

Pada pendapat Holly Elmore, melepaskan pemberat model adalah strategi berbahaya, kerana sesiapa sahaja boleh mengubah suai model dan model ini tidak boleh dibuat asal. "Semakin kuat model itu, semakin berbahaya strategi ini."

Berbanding dengan model sumber terbuka, model besar yang diakses melalui API selalunya mempunyai pelbagai ciri keselamatan, seperti penapisan tindak balas atau latihan khusus untuk menghalang output respons berbahaya atau menjengkelkan

Jika pemberat model dilepaskan, lebih mudah untuk melatih semula model untuk melompat ke atas "pengadang" ini. Ini menjadikannya lebih mungkin untuk menggunakan model sumber terbuka ini untuk mencipta perisian pancingan data dan menjalankan serangan rangkaian.

Kandungan yang perlu ditulis semula ialah: Sumber imej: MISHA GUREVICH

Dia percaya bahawa sebahagian daripada masalah keselamatan model ialah langkah keselamatan semasa yang diambil tidak mencukupi, jadi perlu mencari cara yang lebih baik untuk memastikan keselamatan model

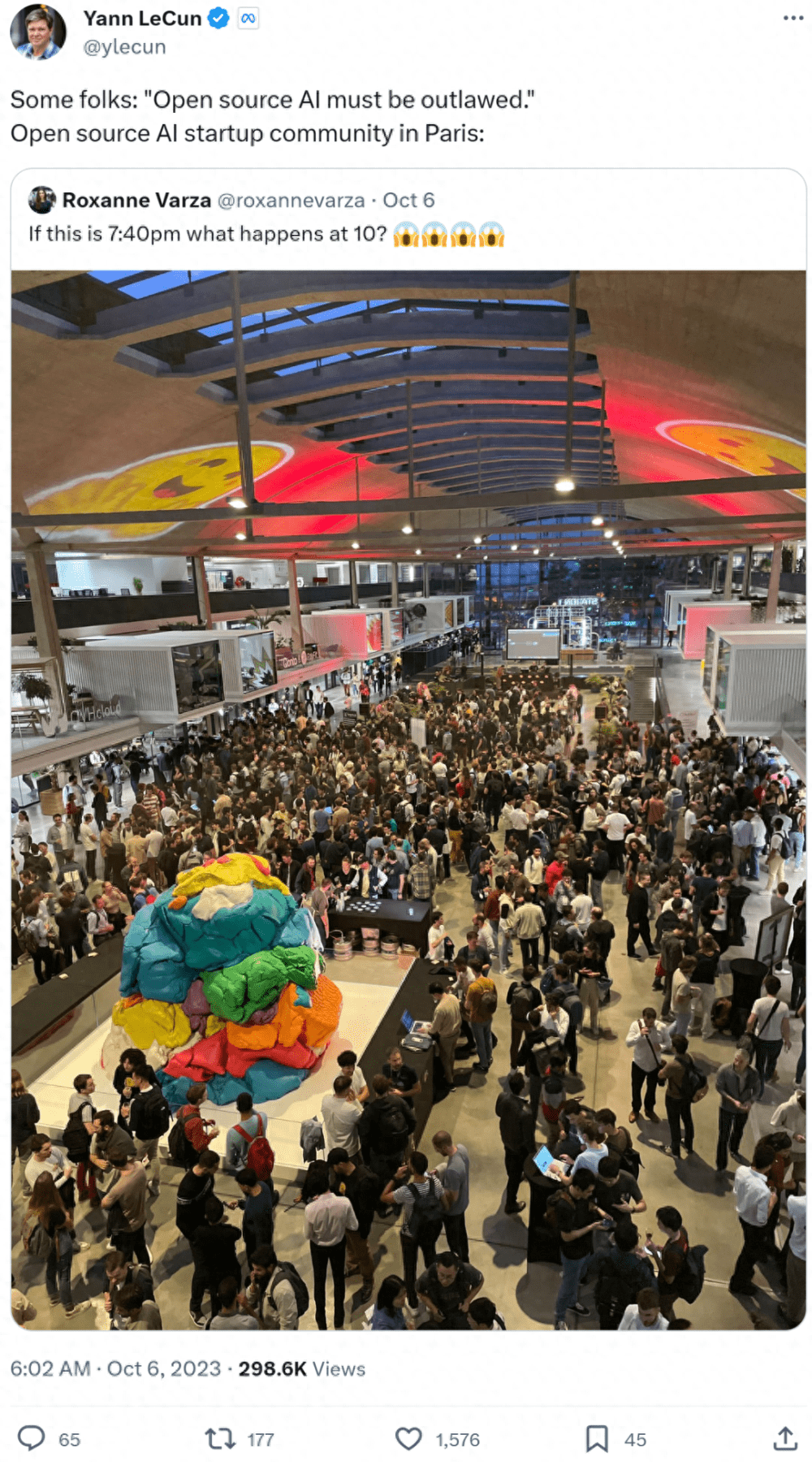

Pada masa ini, Meta belum mengulas mengenai perkara ini. Walau bagaimanapun, ketua saintis AI Meta Yann LeCun nampaknya menjawab kenyataan bahawa "AI sumber terbuka mesti diharamkan" dan menunjukkan komuniti permulaan AI sumber terbuka yang berkembang pesat di Paris

Terdapat ramai orang yang mempunyai pendapat berbeza dan percaya bahawa strategi terbuka untuk pembangunan AI adalah satu-satunya cara untuk memastikan kepercayaan terhadap teknologi, yang berbeza daripada pandangan Holly Elmore

Sesetengah netizen berkata bahawa sumber terbuka mempunyai kebaikan dan keburukan Ia boleh membolehkan orang ramai memperoleh ketelusan yang lebih besar dan meningkatkan inovasi, tetapi ia juga akan menghadapi risiko penyalahgunaan (seperti kod) oleh pelakon yang berniat jahat.

Seperti yang dijangka, OpenAI diejek sekali lagi, dengan ada yang mengatakan "ia harus kembali kepada sumber terbuka."

.

Terdapat ramai orang yang bimbang tentang sumber terbuka

Peter S. Park, seorang penyelidik pasca doktoral dalam keselamatan kecerdasan buatan di MIT, berkata bahawa pengeluaran meluas model kecerdasan buatan lanjutan pada masa hadapan mungkin menyebabkan banyak masalah kerana pada asasnya adalah mustahil untuk mencegah sepenuhnya penyalahgunaan model kecerdasan buatan.

Walau bagaimanapun, Stella Biderman, pengarah eksekutif EleutherAI, sebuah organisasi penyelidikan kecerdasan buatan bukan untung, berkata: "Setakat ini, terdapat sedikit bukti bahawa model sumber terbuka telah menyebabkan sebarang bahaya khusus. Tidak jelas sama ada hanya meletakkan model di belakang API akan menyelesaikan masalah keselamatan."

Biderman percaya: "Elemen asas membina LLM telah didedahkan dalam kertas penyelidikan percuma yang boleh dibaca oleh sesiapa sahaja untuk membangunkan model mereka sendiri."

Dia seterusnya menegaskan: "Jika syarikat menggalakkan kerahsiaan butiran model, ia mungkin mempunyai akibat buruk yang serius terhadap ketelusan penyelidikan lapangan, kesedaran awam dan pembangunan saintifik, terutamanya bagi penyelidik bebas."Walaupun semua orang sudah membincangkan kesan sumber terbuka, masih tidak jelas sama ada kaedah Meta benar-benar cukup terbuka dan sama ada ia boleh memanfaatkan sumber terbuka.

Stefano Maffulli, pengarah eksekutif Inisiatif Sumber Terbuka (OSI), berkata: "Konsep kepintaran buatan sumber terbuka masih belum ditakrifkan dengan jelas. Organisasi yang berbeza menggunakan istilah untuk merujuk kepada perkara yang berbeza, yang menunjukkan pelbagai peringkat 'tersedia secara umum barangan' , yang boleh mengelirukan orang ramai.”

Maffulli menegaskan bahawa untuk perisian sumber terbuka, isu utama ialah sama ada kod sumber tersedia secara umum dan boleh digunakan untuk sebarang tujuan. Walau bagaimanapun, menghasilkan semula model AI mungkin memerlukan perkongsian data latihan, kaedah pengumpulan data, perisian latihan, berat model, kod inferens dan banyak lagi. Antaranya, isu paling penting ialah data latihan mungkin melibatkan isu privasi dan hak cipta

Maffulli menegaskan bahawa untuk perisian sumber terbuka, isu utama ialah sama ada kod sumber tersedia secara umum dan boleh digunakan untuk sebarang tujuan. Walau bagaimanapun, menghasilkan semula model AI mungkin memerlukan perkongsian data latihan, kaedah pengumpulan data, perisian latihan, berat model, kod inferens dan banyak lagi. Antaranya, isu paling penting ialah data latihan mungkin melibatkan isu privasi dan hak cipta

OSI telah mengusahakan definisi tepat "AI sumber terbuka" sejak tahun lepas dan berkemungkinan akan mengeluarkan draf awal dalam beberapa minggu akan datang. Tetapi tidak kira apa, dia percaya bahawa sumber terbuka adalah penting untuk pembangunan AI. "Jika AI bukan sumber terbuka, kita tidak boleh mempunyai AI yang boleh dipercayai dan bertanggungjawab," katanya

Pada masa hadapan, perbezaan antara sumber terbuka dan sumber tertutup akan berterusan, tetapi sumber terbuka tidak dapat dihalang.

Atas ialah kandungan terperinci Risiko AI di luar kawalan meningkat: Berat model terbuka mencetuskan protes Meta. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1393

1393

52

52

1205

1205

24

24

Alat dengar Meta Quest 3S VR mampu milik baharu muncul di FCC, mencadangkan pelancaran yang akan berlaku

Sep 04, 2024 am 06:51 AM

Alat dengar Meta Quest 3S VR mampu milik baharu muncul di FCC, mencadangkan pelancaran yang akan berlaku

Sep 04, 2024 am 06:51 AM

Acara Meta Connect 2024 ditetapkan pada 25 hingga 26 September, dan dalam acara ini, syarikat itu dijangka memperkenalkan set kepala realiti maya mampu milik baharu. Dikhabarkan sebagai Meta Quest 3S, set kepala VR nampaknya telah muncul pada penyenaraian FCC. cadangan ini

Model sumber terbuka pertama yang melepasi tahap GPT4o! Llama 3.1 bocor: 405 bilion parameter, pautan muat turun dan kad model tersedia

Jul 23, 2024 pm 08:51 PM

Model sumber terbuka pertama yang melepasi tahap GPT4o! Llama 3.1 bocor: 405 bilion parameter, pautan muat turun dan kad model tersedia

Jul 23, 2024 pm 08:51 PM

Sediakan GPU anda! Llama3.1 akhirnya muncul, tetapi sumbernya bukan Meta rasmi. Hari ini, berita bocor versi baharu model besar Llama menjadi tular di Reddit Selain model asas, ia juga termasuk hasil penanda aras 8B, 70B dan parameter maksimum 405B. Rajah di bawah menunjukkan hasil perbandingan setiap versi Llama3.1 dengan OpenAIGPT-4o dan Llama38B/70B. Ia boleh dilihat bahawa walaupun versi 70B melebihi GPT-4o pada pelbagai penanda aras. Sumber imej: https://x.com/mattshumer_/status/1815444612414087294 Jelas sekali, versi 3.1 daripada 8B dan 70

Enam cara cepat untuk mengalami Llama 3 yang baru dikeluarkan!

Apr 19, 2024 pm 12:16 PM

Enam cara cepat untuk mengalami Llama 3 yang baru dikeluarkan!

Apr 19, 2024 pm 12:16 PM

Malam tadi Meta mengeluarkan model Llama38B dan 70B Model penalaan arahan Llama3 diperhalusi dan dioptimumkan untuk kes penggunaan perbualan/sembang dan mengatasi banyak model sembang sumber terbuka sedia ada dalam penanda aras biasa. Contohnya, Gemma7B dan Mistral7B. Model Llama+3 menambah baik data dan skala serta mencapai ketinggian baharu. Ia telah dilatih pada lebih daripada 15T token data pada dua kluster 24K GPU tersuai yang dikeluarkan baru-baru ini oleh Meta. Set data latihan ini adalah 7 kali lebih besar daripada Llama2 dan mengandungi 4 kali lebih banyak kod. Ini membawa keupayaan model Llama ke tahap tertinggi semasa, yang menyokong panjang teks lebih daripada 8K, dua kali ganda daripada Llama2. bawah

Model terkuat Llama 3.1 405B dikeluarkan secara rasmi, Zuckerberg: Sumber terbuka menerajui era baharu

Jul 24, 2024 pm 08:23 PM

Model terkuat Llama 3.1 405B dikeluarkan secara rasmi, Zuckerberg: Sumber terbuka menerajui era baharu

Jul 24, 2024 pm 08:23 PM

Sebentar tadi, Llama 3.1 yang ditunggu-tunggu telah dikeluarkan secara rasmi! Meta secara rasmi mengeluarkan suara bahawa "sumber terbuka membawa era baru." Dalam blog rasmi, Meta berkata: "Sehingga hari ini, model bahasa besar sumber terbuka kebanyakannya ketinggalan di belakang model tertutup dari segi kefungsian dan prestasi. Kini, kami menyambut era baharu yang diterajui oleh sumber terbuka. Kami mengeluarkan MetaLlama3.1405B secara terbuka. , yang kami percaya Ia adalah model asas sumber terbuka yang terbesar dan paling berkuasa di dunia Sehingga kini, jumlah muat turun semua versi Llama telah melebihi 300 juta kali, dan kami baru sahaja memulakan pengasas dan Ketua Pegawai Eksekutif Meta Zuckerberg artikel panjang "OpenSourceAIIsthePathForward",

Llama3 datang secara tiba-tiba! Komuniti sumber terbuka sedang mendidih lagi: era akses percuma kepada model peringkat GPT4 telah tiba

Apr 19, 2024 pm 12:43 PM

Llama3 datang secara tiba-tiba! Komuniti sumber terbuka sedang mendidih lagi: era akses percuma kepada model peringkat GPT4 telah tiba

Apr 19, 2024 pm 12:43 PM

Llama3 ada di sini! Sebentar tadi, laman web rasmi Meta telah dikemas kini dan rasminya mengumumkan versi parameter Llama 38 bilion dan 70 bilion. Dan ia adalah SOTA sumber terbuka selepas pelancarannya: Data rasmi Meta menunjukkan bahawa versi Llama38B dan 70B mengatasi semua lawan dalam skala parameter masing-masing. Model 8B mengatasi prestasi Gemma7B dan Mistral7BInstruct pada banyak penanda aras seperti MMLU, GPQA dan HumanEval. Model 70B telah mengatasi ayam goreng sumber tertutup yang popular Claude3Sonnet, dan telah berulang-alik dengan GeminiPro1.5 Google. Sebaik sahaja pautan Huggingface keluar, komuniti sumber terbuka kembali teruja. Pelajar buta yang bermata tajam itu turut menemui serta-merta

Apakah maksud META?

Mar 05, 2024 pm 12:18 PM

Apakah maksud META?

Mar 05, 2024 pm 12:18 PM

META biasanya merujuk kepada dunia maya atau platform yang dipanggil Metaverse. Metaverse ialah dunia maya yang dibina oleh manusia menggunakan teknologi digital yang mencerminkan atau melangkaui dunia sebenar dan boleh berinteraksi dengan dunia sebenar Ia adalah ruang hidup digital dengan sistem sosial baharu.

Penganalisis membincangkan harga pelancaran untuk alat dengar Meta Quest 3S VR yang dikhabarkan

Aug 27, 2024 pm 09:35 PM

Penganalisis membincangkan harga pelancaran untuk alat dengar Meta Quest 3S VR yang dikhabarkan

Aug 27, 2024 pm 09:35 PM

Lebih setahun kini telah berlalu daripada keluaran awal Meta untuk Quest 3 (sekira $499.99 di Amazon). Sejak itu, Apple telah menghantar Vision Pro yang jauh lebih mahal, manakala Byte Dance kini telah memperkenalkan Pico 4 Ultra di China. Walau bagaimanapun, terdapat

Dijangka pada tahun 2024, Meta merancang untuk melancarkan prototaip cermin mata AR revolusioner yang dipanggil 'Orion'

Jan 04, 2024 pm 09:35 PM

Dijangka pada tahun 2024, Meta merancang untuk melancarkan prototaip cermin mata AR revolusioner yang dipanggil 'Orion'

Jan 04, 2024 pm 09:35 PM

Menurut berita pada 24 Disember, meta, sebuah syarikat teknologi yang mempunyai pengaruh besar dalam industri media sosial, kini menyematkan jangkaan kukuhnya pada cermin mata realiti tambahan (AR), teknologi yang dianggap sebagai platform pengkomputeran generasi akan datang. Baru-baru ini, pengarah teknikal meta Andrew Bosworth mendedahkan dalam temu bual bahawa syarikat itu dijangka melancarkan prototaip cermin mata AR canggih bernama kod "Orion" pada 2024. Untuk masa yang lama, meta telah melabur dalam teknologi AR sama seperti dalam bidang lain Mereka telah melabur sejumlah besar wang, berjumlah berbilion dolar, bertujuan untuk mencipta produk revolusioner yang setanding dengan iPhone. Walaupun tahun lepas mereka mengumumkan penamatan rancangan pengeluaran besar-besaran untuk cermin mata Orion,