Analisis mendalam model BERT

1. Apa yang model BERT boleh lakukan

Model BERT ialah model pemprosesan bahasa semula jadi berdasarkan model Transformer, yang digunakan untuk mengendalikan tugas seperti klasifikasi teks, sistem menjawab soalan, pengecaman entiti yang dinamakan, dan pengiraan persamaan semantik. Disebabkan prestasinya yang cemerlang dalam pelbagai tugas pemprosesan bahasa semula jadi, model BERT telah menjadi salah satu model bahasa pra-latihan yang paling maju dan telah mendapat perhatian dan aplikasi yang meluas.

Nama penuh model BERT ialah Perwakilan Pengekod Dwi Arah daripada Transformers, iaitu perwakilan penukar pengekod dwiarah. Berbanding dengan model pemprosesan bahasa semula jadi tradisional, model BERT mempunyai kelebihan ketara berikut: Pertama, model BERT secara serentak boleh mempertimbangkan maklumat konteks konteks sekeliling untuk lebih memahami semantik dan konteks. Kedua, model BERT menggunakan seni bina Transformer untuk membolehkan model memproses jujukan input secara selari, mempercepatkan latihan dan inferens. Di samping itu, model BERT boleh mencapai hasil yang lebih baik pada pelbagai tugas melalui pra-latihan dan penalaan halus, dan mempunyai pembelajaran pemindahan yang lebih baik

Model BERT ialah pengekod dua arah yang boleh mensintesis bahagian hadapan dan belakang teks Maklumat kontekstual untuk memahami maksud teks dengan lebih tepat.

Model BERT dilatih terlebih dahulu pada data teks tidak berlabel untuk mempelajari perwakilan teks yang lebih kaya dan meningkatkan prestasi tugasan hiliran.

Penalaan halus: Model BERT boleh diperhalusi untuk disesuaikan dengan tugasan tertentu, yang membolehkan ia digunakan dalam pelbagai tugas pemprosesan bahasa semula jadi dan berfungsi dengan baik.

Model BERT dipertingkatkan berdasarkan model Transformer, terutamanya dalam aspek berikut:

1 Model Bahasa Bertopeng (MLM): Model BERT menggunakan kaedah MLM dalam peringkat pra-latihan, iaitu, untuk memasukkan Teks bertopeng secara rawak, dan model kemudian diminta untuk meramalkan apakah perkataan bertopeng itu. Pendekatan ini memaksa model untuk mempelajari maklumat kontekstual dan boleh mengurangkan masalah sparsity data dengan berkesan.

2. Ramalan Ayat Seterusnya (NSP): Model BERT juga menggunakan kaedah NSP, yang membolehkan model menentukan sama ada dua ayat bersebelahan semasa peringkat pra-latihan. Pendekatan ini boleh membantu model mempelajari hubungan antara teks dan dengan itu lebih memahami maksud teks.

3. Pengekod Transformer: Model BERT menggunakan Pengekod Transformer sebagai model asas Melalui susunan berbilang lapisan Pengekod Transformer, struktur rangkaian saraf dalam dibina untuk mendapatkan keupayaan perwakilan ciri yang lebih kaya.

4.Penalaan halus: Model BERT juga menggunakan Penalaan Halus untuk menyesuaikan diri dengan tugasan tertentu Dengan memperhalusi model berdasarkan model pra-latihan, ia boleh menyesuaikan diri dengan tugas yang berbeza dengan lebih baik. Kaedah ini telah menunjukkan hasil yang baik dalam pelbagai tugas pemprosesan bahasa semula jadi.

2. Berapa lama masa yang diambil untuk melatih model BERT Secara umumnya, pra-latihan model BERT mengambil masa beberapa hari hingga minggu, bergantung kepada pengaruh faktor berikut:

1 Saiz set: Model BERT memerlukan sejumlah besar data teks tidak berlabel untuk pra-latihan Lebih besar set data, lebih lama masa latihan.

2 Skala model: Lebih besar model BERT, lebih banyak sumber pengkomputeran dan masa latihan yang diperlukan.

3 Sumber pengkomputeran: Latihan model BERT memerlukan penggunaan sumber pengkomputeran berskala besar, seperti kelompok GPU, dll. Kuantiti dan kualiti sumber pengkomputeran akan mempengaruhi masa latihan.

4 Strategi latihan: Latihan model BERT juga memerlukan penggunaan beberapa strategi latihan yang cekap, seperti pengumpulan kecerunan, pelarasan kadar pembelajaran dinamik, dll. Strategi ini juga akan mempengaruhi masa latihan.

3. Struktur parameter model BERT

Struktur parameter model BERT boleh dibahagikan kepada bahagian berikut:

1) Lapisan pembenaman perkataan (Lapisan Penyematan): vektor perkataan , biasanya menggunakan algoritma seperti WordPiece atau BPE untuk pembahagian dan pengekodan perkataan.

2) Lapisan Pengekod Transformer: Model BERT menggunakan Pengekod Transformer berbilang lapisan untuk pengekstrakan ciri dan pembelajaran perwakilan Setiap Pengekod mengandungi berbilang sub-lapisan Perhatian Kendiri dan Suapan Hadapan.

3) Lapisan Penggabungan: Gabungkan output berbilang lapisan Pengekod Transformer untuk menjana vektor panjang tetap sebagai perwakilan keseluruhan ayat.

4) Lapisan output: Direka mengikut tugas tertentu, ia boleh menjadi pengelas tunggal, anotasi jujukan, regressor, dsb.

Model BERT mempunyai bilangan parameter yang sangat besar Ia biasanya dilatih melalui pra-latihan dan kemudian diperhalusi pada tugasan tertentu melalui Penalaan Halus.

4. Kemahiran penalaan model BERT

Kemahiran penalaan model BERT boleh dibahagikan kepada aspek berikut:

1) Pelarasan kadar pembelajaran: Latihan model BERT, memerlukan pelarasan kadar pembelajaran secara amnya Gunakan kaedah pemanasan dan pereputan untuk melaraskan supaya model boleh menumpu dengan lebih baik.

2) Pengumpulan kecerunan: Oleh kerana bilangan parameter model BERT adalah sangat besar, jumlah pengiraan untuk mengemas kini semua parameter pada satu masa adalah sangat besar, jadi kaedah pengumpulan kecerunan boleh digunakan untuk pengoptimuman, iaitu, kecerunan yang dikira berbilang kali terkumpul, dan kemudian dikemas kini sekali Kemas kini model.

3) Pemampatan model: Model BERT berskala besar dan memerlukan sejumlah besar sumber pengkomputeran untuk latihan dan inferens Oleh itu, pemampatan model boleh digunakan untuk mengurangkan saiz model dan jumlah pengiraan. Teknik pemampatan model yang biasa digunakan termasuk pemangkasan model, kuantisasi dan penyulingan.

4) Peningkatan data: Untuk meningkatkan keupayaan generalisasi model, kaedah peningkatan data boleh digunakan, seperti penyamaran rawak, pengulangan data, pertukaran perkataan, dll., untuk mengembangkan set data latihan.

5) Pengoptimuman perkakasan: Latihan dan inferens model BERT memerlukan sejumlah besar sumber pengkomputeran, jadi perkakasan berprestasi tinggi seperti GPU atau TPU boleh digunakan untuk mempercepatkan proses latihan dan inferens, dengan itu meningkatkan latihan kecekapan dan kelajuan inferens model.

6) Strategi penalaan halus: Untuk tugasan yang berbeza, strategi penalaan halus yang berbeza boleh digunakan untuk mengoptimumkan prestasi model, seperti tahap penalaan halus, pelarasan kadar pembelajaran, pengumpulan kecerunan, dsb.

Secara amnya, model BERT adalah model bahasa yang telah dilatih berdasarkan model Transformer Melalui penyusunan Pengekod Transformer berbilang lapisan dan penambahbaikan seperti MLM dan NSP, ia telah mencapai hasil yang luar biasa dalam pemprosesan bahasa semula jadi. Prestasi. Pada masa yang sama, model BERT juga menyediakan idea dan kaedah baharu untuk penyelidikan tugas pemprosesan bahasa semula jadi yang lain.

Atas ialah kandungan terperinci Analisis mendalam model BERT. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1670

1670

14

14

1428

1428

52

52

1329

1329

25

25

1274

1274

29

29

1256

1256

24

24

Bagaimana Membina Ejen AI Multimodal Menggunakan Rangka Kerja AGNO?

Apr 23, 2025 am 11:30 AM

Bagaimana Membina Ejen AI Multimodal Menggunakan Rangka Kerja AGNO?

Apr 23, 2025 am 11:30 AM

Semasa bekerja pada AIS AI, pemaju sering mendapati diri mereka menavigasi perdagangan antara kelajuan, fleksibiliti, dan kecekapan sumber. Saya telah meneroka rangka kerja AI yang agentik dan menjumpai Agno (sebelum ini adalah Phi-

Bagaimana untuk menambah lajur dalam SQL? - Analytics Vidhya

Apr 17, 2025 am 11:43 AM

Bagaimana untuk menambah lajur dalam SQL? - Analytics Vidhya

Apr 17, 2025 am 11:43 AM

Pernyataan Jadual Alter SQL: Menambah lajur secara dinamik ke pangkalan data anda Dalam pengurusan data, kebolehsuaian SQL adalah penting. Perlu menyesuaikan struktur pangkalan data anda dengan cepat? Pernyataan Jadual ALTER adalah penyelesaian anda. Butiran panduan ini menambah colu

Terbuka beralih fokus dengan GPT-4.1, mengutamakan pengekodan dan kecekapan kos

Apr 16, 2025 am 11:37 AM

Terbuka beralih fokus dengan GPT-4.1, mengutamakan pengekodan dan kecekapan kos

Apr 16, 2025 am 11:37 AM

Pelepasan ini termasuk tiga model yang berbeza, GPT-4.1, GPT-4.1 Mini dan GPT-4.1 Nano, menandakan langkah ke arah pengoptimuman khusus tugas dalam landskap model bahasa yang besar. Model-model ini tidak segera menggantikan antara muka yang dihadapi pengguna seperti

Beyond the Llama Drama: 4 Benchmarks Baru Untuk Model Bahasa Besar

Apr 14, 2025 am 11:09 AM

Beyond the Llama Drama: 4 Benchmarks Baru Untuk Model Bahasa Besar

Apr 14, 2025 am 11:09 AM

Penanda Aras Bermasalah: Kajian Kes Llama Pada awal April 2025, Meta melancarkan model Llama 4 suite, dengan metrik prestasi yang mengagumkan yang meletakkan mereka dengan baik terhadap pesaing seperti GPT-4O dan Claude 3.5 sonnet. Pusat ke LAUNC

Kursus Pendek Baru mengenai Model Embedding oleh Andrew Ng

Apr 15, 2025 am 11:32 AM

Kursus Pendek Baru mengenai Model Embedding oleh Andrew Ng

Apr 15, 2025 am 11:32 AM

Buka kunci kekuatan model embedding: menyelam jauh ke kursus baru Andrew Ng Bayangkan masa depan di mana mesin memahami dan menjawab soalan anda dengan ketepatan yang sempurna. Ini bukan fiksyen sains; Terima kasih kepada kemajuan dalam AI, ia menjadi R

Bagaimana permainan ADHD, alat kesihatan & chatbots AI mengubah kesihatan global

Apr 14, 2025 am 11:27 AM

Bagaimana permainan ADHD, alat kesihatan & chatbots AI mengubah kesihatan global

Apr 14, 2025 am 11:27 AM

Bolehkah permainan video meringankan kebimbangan, membina fokus, atau menyokong kanak -kanak dengan ADHD? Memandangkan cabaran penjagaan kesihatan melonjak di seluruh dunia - terutamanya di kalangan belia - inovator beralih kepada alat yang tidak mungkin: permainan video. Sekarang salah satu hiburan terbesar di dunia Indus

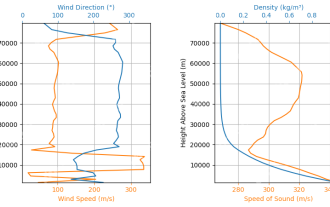

Simulasi dan analisis pelancaran roket menggunakan Rocketpy - Analytics Vidhya

Apr 19, 2025 am 11:12 AM

Simulasi dan analisis pelancaran roket menggunakan Rocketpy - Analytics Vidhya

Apr 19, 2025 am 11:12 AM

Simulasi Rocket dilancarkan dengan Rocketpy: Panduan Komprehensif Artikel ini membimbing anda melalui mensimulasikan pelancaran roket kuasa tinggi menggunakan Rocketpy, perpustakaan Python yang kuat. Kami akan merangkumi segala -galanya daripada menentukan komponen roket untuk menganalisis simula

Google melancarkan strategi ejen yang paling komprehensif di Cloud Seterusnya 2025

Apr 15, 2025 am 11:14 AM

Google melancarkan strategi ejen yang paling komprehensif di Cloud Seterusnya 2025

Apr 15, 2025 am 11:14 AM

Gemini sebagai asas strategi AI Google Gemini adalah asas kepada strategi ejen AI Google, memanfaatkan keupayaan multimodalnya untuk memproses dan menjana respons di seluruh teks, imej, audio, video dan kod. Dibangunkan oleh DeepM