Perbezaan antara normalisasi kelompok dan normalisasi lapisan

Penormalan sering digunakan untuk menyelesaikan masalah kecerunan yang meletup atau hilang dalam rangkaian saraf. Ia berfungsi dengan memetakan nilai ciri ke dalam julat [0,1] supaya semua nilai berada dalam skala atau pengedaran yang sama. Ringkasnya, normalisasi menormalkan input kepada rangkaian saraf dan meningkatkan kelajuan latihan.

Dua jenis normalisasi

Terdapat terutamanya dua jenis teknik normalisasi, iaitu:

- Penormalan Kelompok

- Penormalan Lapisan

Penormalan Kelompok (Penormalan Kelompok)

keluaran tersembunyi untuk mendapatkan lapisan kami biasanya menggunakan fungsi pengaktifan tak linear untuk memproses input. Dan untuk setiap neuron dalam lapisan tertentu, kita boleh praaktifkannya supaya ia mempunyai min sifar dan sisihan piawai unit. Ini boleh dicapai dengan melakukan penolakan min dan pembahagian sisihan piawai pada kumpulan mini ciri input.

Walau bagaimanapun, memaksa semua pra-pengaktifan kepada sifar dan sisihan piawai unit untuk semua kelompok mungkin terlalu ketat, jadi memperkenalkan taburan turun naik tertentu boleh membantu rangkaian belajar dengan lebih baik.

Untuk menyelesaikan masalah ini, penormalan kelompok memperkenalkan dua parameter: gamma faktor skala (γ) dan beta mengimbangi (β), yang kedua-duanya adalah parameter yang boleh dipelajari.

Dalam penormalan batch, kita perlu memberi perhatian kepada penggunaan statistik kelompok. Apabila saiz kelompok kecil, min sampel dan sisihan piawai tidak mencukupi untuk mewakili taburan sebenar, yang mengakibatkan rangkaian gagal mempelajari sesuatu yang bermakna. Oleh itu, kita perlu memastikan bahawa saiz kelompok cukup besar untuk mendapatkan statistik yang lebih tepat, seterusnya meningkatkan prestasi dan pembelajaran model.

Layer Normalization (Layer Normalization)

Layer Normalization ialah kaedah yang dicadangkan oleh penyelidik Jimmy Lei Ba, Jamie Ryan Kiros, dan Geoffrey E. Hinton. Idea teras kaedah ini adalah untuk mempunyai pengedaran yang sama untuk semua ciri input yang diberikan ke atas semua neuron dalam lapisan tertentu. Berbeza daripada normalisasi kelompok, normalisasi lapisan melakukan operasi normalisasi pada dimensi ciri setiap sampel. Ia menormalkan output lapisan ini dengan mengira min dan varians setiap neuron pada ciri input. Kaedah ini boleh membantu model menyesuaikan diri dengan kumpulan kecil data dan meningkatkan keupayaan generalisasi model. Kelebihan normalisasi lapisan ialah ia tidak bergantung pada kelompok untuk menormalkan semua ciri, tetapi menormalkan setiap input kepada lapisan tertentu, menghapuskan pergantungan pada kelompok. Ini menjadikan normalisasi lapisan sangat sesuai untuk model jujukan seperti Transformer dan Rangkaian Neural Berulang (RNN) yang popular.

Perbezaan utama antara penormalan kelompok dan penormalan lapisan

1 Penormalan kelompok menormalkan setiap ciri secara bebas dalam kelompok mini. Normalisasi lapisan menormalkan setiap input dalam kelompok secara bebas merentas semua ciri.

2 Memandangkan penormalan batch bergantung pada saiz batch, ia tidak berkesan untuk kumpulan kecil. Normalisasi lapisan adalah saiz kelompok bebas, jadi ia boleh digunakan pada saiz kelompok saiz yang lebih kecil juga.

3 Penormalan kelompok memerlukan pemprosesan yang berbeza semasa latihan dan inferens. Memandangkan penormalan lapisan dilakukan sepanjang input panjang lapisan tertentu, set operasi yang sama boleh digunakan pada masa latihan dan inferens.

Atas ialah kandungan terperinci Perbezaan antara normalisasi kelompok dan normalisasi lapisan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

Terokai konsep, perbezaan, kebaikan dan keburukan RNN, LSTM dan GRU

Jan 22, 2024 pm 07:51 PM

Terokai konsep, perbezaan, kebaikan dan keburukan RNN, LSTM dan GRU

Jan 22, 2024 pm 07:51 PM

Dalam data siri masa, terdapat kebergantungan antara pemerhatian, jadi ia tidak bebas antara satu sama lain. Walau bagaimanapun, rangkaian saraf tradisional menganggap setiap pemerhatian sebagai bebas, yang mengehadkan keupayaan model untuk memodelkan data siri masa. Untuk menyelesaikan masalah ini, Rangkaian Neural Berulang (RNN) telah diperkenalkan, yang memperkenalkan konsep ingatan untuk menangkap ciri dinamik data siri masa dengan mewujudkan kebergantungan antara titik data dalam rangkaian. Melalui sambungan berulang, RNN boleh menghantar maklumat sebelumnya ke dalam pemerhatian semasa untuk meramalkan nilai masa hadapan dengan lebih baik. Ini menjadikan RNN alat yang berkuasa untuk tugasan yang melibatkan data siri masa. Tetapi bagaimanakah RNN mencapai ingatan seperti ini? RNN merealisasikan ingatan melalui gelung maklum balas dalam rangkaian saraf Ini adalah perbezaan antara RNN dan rangkaian saraf tradisional.

Kajian kes menggunakan model LSTM dwiarah untuk pengelasan teks

Jan 24, 2024 am 10:36 AM

Kajian kes menggunakan model LSTM dwiarah untuk pengelasan teks

Jan 24, 2024 am 10:36 AM

Model LSTM dwiarah ialah rangkaian saraf yang digunakan untuk pengelasan teks. Berikut ialah contoh mudah yang menunjukkan cara menggunakan LSTM dwiarah untuk tugasan pengelasan teks. Pertama, kita perlu mengimport perpustakaan dan modul yang diperlukan: importosimportnumpyasnpfromkeras.preprocessing.textimportTokenizerfromkeras.preprocessing.sequenceimportpad_sequencesfromkeras.modelsimportSequentialfromkeras.layersimportDense,Em

Mengira operan titik terapung (FLOPS) untuk rangkaian saraf

Jan 22, 2024 pm 07:21 PM

Mengira operan titik terapung (FLOPS) untuk rangkaian saraf

Jan 22, 2024 pm 07:21 PM

FLOPS ialah salah satu piawaian untuk penilaian prestasi komputer, digunakan untuk mengukur bilangan operasi titik terapung sesaat. Dalam rangkaian saraf, FLOPS sering digunakan untuk menilai kerumitan pengiraan model dan penggunaan sumber pengkomputeran. Ia adalah penunjuk penting yang digunakan untuk mengukur kuasa pengkomputeran dan kecekapan komputer. Rangkaian saraf ialah model kompleks yang terdiri daripada berbilang lapisan neuron yang digunakan untuk tugas seperti klasifikasi data, regresi dan pengelompokan. Latihan dan inferens rangkaian saraf memerlukan sejumlah besar pendaraban matriks, konvolusi dan operasi pengiraan lain, jadi kerumitan pengiraan adalah sangat tinggi. FLOPS (FloatingPointOperationsperSecond) boleh digunakan untuk mengukur kerumitan pengiraan rangkaian saraf untuk menilai kecekapan penggunaan sumber pengiraan model. FLOP

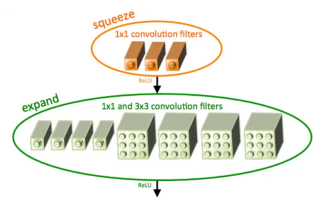

Pengenalan kepada SqueezeNet dan ciri-cirinya

Jan 22, 2024 pm 07:15 PM

Pengenalan kepada SqueezeNet dan ciri-cirinya

Jan 22, 2024 pm 07:15 PM

SqueezeNet ialah algoritma kecil dan tepat yang memberikan keseimbangan yang baik antara ketepatan tinggi dan kerumitan rendah, menjadikannya sesuai untuk sistem mudah alih dan terbenam dengan sumber terhad. Pada 2016, penyelidik dari DeepScale, University of California, Berkeley, dan Stanford University mencadangkan SqueezeNet, rangkaian neural convolutional (CNN) yang padat dan cekap. Dalam beberapa tahun kebelakangan ini, penyelidik telah membuat beberapa penambahbaikan pada SqueezeNet, termasuk SqueezeNetv1.1 dan SqueezeNetv2.0. Penambahbaikan dalam kedua-dua versi bukan sahaja meningkatkan ketepatan tetapi juga mengurangkan kos pengiraan. Ketepatan SqueezeNetv1.1 pada dataset ImageNet

Definisi dan analisis struktur rangkaian neural kabur

Jan 22, 2024 pm 09:09 PM

Definisi dan analisis struktur rangkaian neural kabur

Jan 22, 2024 pm 09:09 PM

Rangkaian saraf kabur ialah model hibrid yang menggabungkan logik kabur dan rangkaian saraf untuk menyelesaikan masalah kabur atau tidak pasti yang sukar dikendalikan dengan rangkaian saraf tradisional. Reka bentuknya diilhamkan oleh kekaburan dan ketidakpastian dalam kognisi manusia, jadi ia digunakan secara meluas dalam sistem kawalan, pengecaman corak, perlombongan data dan bidang lain. Seni bina asas rangkaian neural kabur terdiri daripada subsistem kabur dan subsistem saraf. Subsistem kabur menggunakan logik kabur untuk memproses data input dan menukarnya kepada set kabur untuk menyatakan kekaburan dan ketidakpastian data input. Subsistem saraf menggunakan rangkaian saraf untuk memproses set kabur untuk tugasan seperti pengelasan, regresi atau pengelompokan. Interaksi antara subsistem kabur dan subsistem saraf menjadikan rangkaian neural kabur mempunyai keupayaan pemprosesan yang lebih berkuasa dan boleh

Penghapusan imej menggunakan rangkaian saraf konvolusi

Jan 23, 2024 pm 11:48 PM

Penghapusan imej menggunakan rangkaian saraf konvolusi

Jan 23, 2024 pm 11:48 PM

Rangkaian neural konvolusi berfungsi dengan baik dalam tugasan menghilangkan imej. Ia menggunakan penapis yang dipelajari untuk menapis bunyi dan dengan itu memulihkan imej asal. Artikel ini memperkenalkan secara terperinci kaedah denoising imej berdasarkan rangkaian neural convolutional. 1. Gambaran Keseluruhan Rangkaian Neural Konvolusi Rangkaian saraf konvolusi ialah algoritma pembelajaran mendalam yang menggunakan gabungan berbilang lapisan konvolusi, lapisan gabungan dan lapisan bersambung sepenuhnya untuk mempelajari dan mengelaskan ciri imej. Dalam lapisan konvolusi, ciri tempatan imej diekstrak melalui operasi konvolusi, dengan itu menangkap korelasi spatial dalam imej. Lapisan pengumpulan mengurangkan jumlah pengiraan dengan mengurangkan dimensi ciri dan mengekalkan ciri utama. Lapisan bersambung sepenuhnya bertanggungjawab untuk memetakan ciri dan label yang dipelajari untuk melaksanakan pengelasan imej atau tugas lain. Reka bentuk struktur rangkaian ini menjadikan rangkaian neural konvolusi berguna dalam pemprosesan dan pengecaman imej.

Bandingkan persamaan, perbezaan dan hubungan antara lilitan diluaskan dan lilitan atrus

Jan 22, 2024 pm 10:27 PM

Bandingkan persamaan, perbezaan dan hubungan antara lilitan diluaskan dan lilitan atrus

Jan 22, 2024 pm 10:27 PM

Konvolusi diluaskan dan lilitan diluaskan adalah operasi yang biasa digunakan dalam rangkaian neural konvolusi Artikel ini akan memperkenalkan perbezaan dan hubungannya secara terperinci. 1. Konvolusi diluaskan Konvolusi diluaskan, juga dikenali sebagai lilitan diluaskan atau lilitan diluaskan, ialah operasi dalam rangkaian neural konvolusi. Ia adalah lanjutan berdasarkan operasi lilitan tradisional dan meningkatkan medan penerimaan kernel lilitan dengan memasukkan lubang dalam kernel lilitan. Dengan cara ini, rangkaian boleh menangkap lebih banyak ciri yang lebih luas. Konvolusi dilatasi digunakan secara meluas dalam bidang pemprosesan imej dan boleh meningkatkan prestasi rangkaian tanpa menambah bilangan parameter dan jumlah pengiraan. Dengan meluaskan medan penerimaan kernel lilitan, lilitan diluaskan boleh memproses maklumat global dalam imej dengan lebih baik, sekali gus meningkatkan kesan pengekstrakan ciri. Idea utama lilitan diluaskan adalah untuk memperkenalkan beberapa

rangkaian neural convolutional sebab

Jan 24, 2024 pm 12:42 PM

rangkaian neural convolutional sebab

Jan 24, 2024 pm 12:42 PM

Rangkaian neural convolutional kausal ialah rangkaian neural convolutional khas yang direka untuk masalah kausalitas dalam data siri masa. Berbanding dengan rangkaian neural convolutional konvensional, rangkaian neural convolutional kausal mempunyai kelebihan unik dalam mengekalkan hubungan kausal siri masa dan digunakan secara meluas dalam ramalan dan analisis data siri masa. Idea teras rangkaian neural convolutional kausal adalah untuk memperkenalkan kausalitas dalam operasi konvolusi. Rangkaian saraf konvolusional tradisional boleh melihat data secara serentak sebelum dan selepas titik masa semasa, tetapi dalam ramalan siri masa, ini mungkin membawa kepada masalah kebocoran maklumat. Kerana keputusan ramalan pada titik masa semasa akan dipengaruhi oleh data pada titik masa akan datang. Rangkaian saraf konvolusi penyebab menyelesaikan masalah ini Ia hanya dapat melihat titik masa semasa dan data sebelumnya, tetapi tidak dapat melihat data masa depan.