Graf pengetahuan: rakan kongsi yang ideal untuk model besar

Model bahasa berskala besar (LLM) mempunyai keupayaan untuk menghasilkan teks yang lancar dan koheren, membawa prospek baharu ke bidang seperti dialog kecerdasan buatan dan penulisan kreatif. Walau bagaimanapun, LLM juga mempunyai beberapa had utama. Pertama, pengetahuan mereka terhad kepada corak yang diiktiraf daripada data latihan, kurang pemahaman sebenar tentang dunia. Kedua, kemahiran menaakul adalah terhad dan tidak boleh membuat inferens logik atau menggabungkan fakta daripada pelbagai sumber data. Apabila berhadapan dengan soalan yang lebih kompleks dan terbuka, jawapan LLM mungkin menjadi tidak masuk akal atau bercanggah, dikenali sebagai "ilusi." Oleh itu, walaupun LLM sangat berguna dalam beberapa aspek, ia masih mempunyai had tertentu apabila berhadapan dengan masalah kompleks dan situasi dunia sebenar.

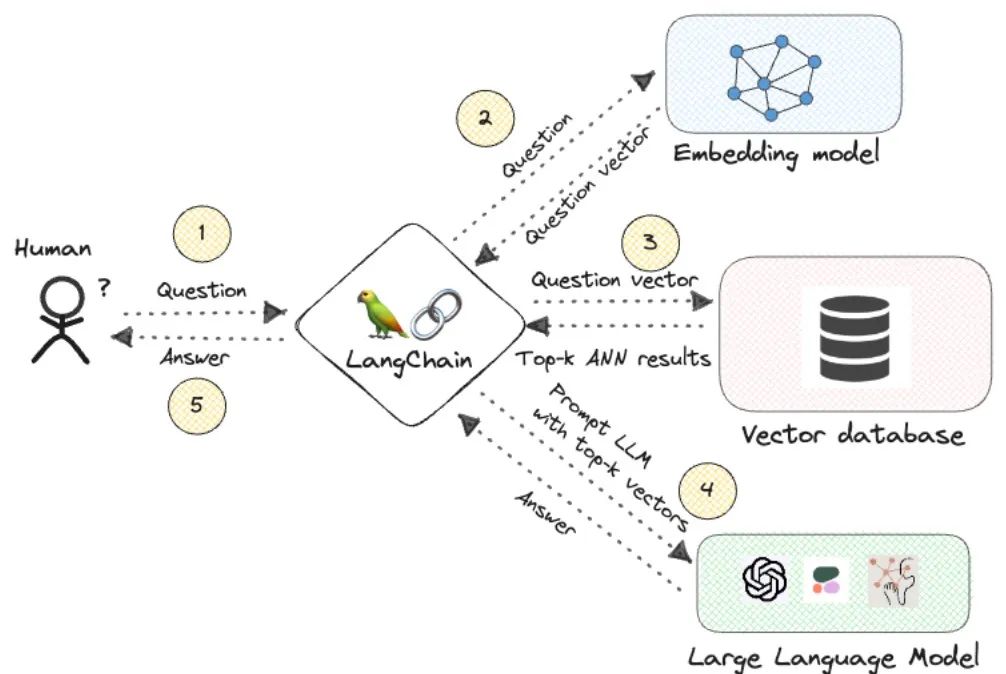

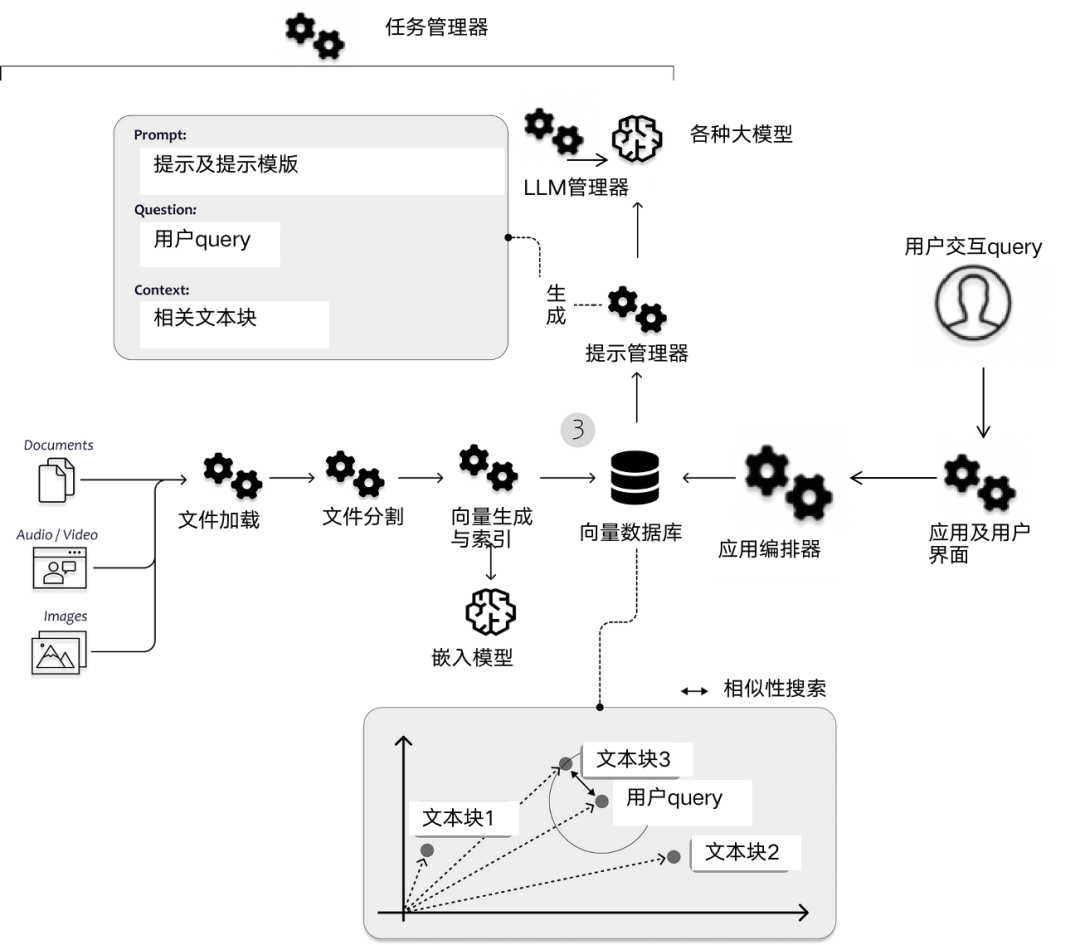

Untuk merapatkan jurang ini, sistem Retrieval Augmented Generation (RAG) telah muncul dalam beberapa tahun kebelakangan ini, idea terasnya adalah untuk menyediakan konteks kepada LLM dengan mendapatkan semula pengetahuan yang berkaitan daripada sumber luar untuk membuat respons yang lebih termaklum. Sistem semasa kebanyakannya menggunakan persamaan semantik bagi pembenaman vektor untuk mendapatkan petikan, namun, pendekatan ini mempunyai kelemahannya sendiri, seperti kekurangan korelasi yang benar, ketidakupayaan untuk mengagregatkan fakta dan kekurangan rantai inferens. Bidang aplikasi graf pengetahuan boleh menyelesaikan masalah ini. Graf pengetahuan ialah perwakilan berstruktur bagi entiti dan perhubungan dunia sebenar. Dengan mengekodkan kesalinghubungan antara fakta kontekstual, graf pengetahuan mengatasi kelemahan carian vektor tulen, dan carian graf membolehkan penaakulan pelbagai peringkat yang kompleks merentas pelbagai sumber maklumat.

Gabungan pembenaman vektor dan graf pengetahuan boleh meningkatkan keupayaan penaakulan LLM dan meningkatkan ketepatan dan kebolehtafsirannya. Perkongsian ini menggabungkan dengan sempurna semantik permukaan dengan pengetahuan dan logik berstruktur, membolehkan LLM menggunakan pembelajaran statistik dan perwakilan simbolik secara serentak.

Gambar

Gambar

1. Had carian vektor

Kebanyakan sistem RAG mencari konteks LLM melalui carian vektor bagi petikan dalam koleksi dokumen. Terdapat beberapa langkah utama dalam proses ini.

- Pengekodan Teks: Sistem menggunakan model benam seperti BERT untuk mengekod teks daripada perenggan dalam korpus ke dalam perwakilan vektor. Setiap artikel dimampatkan menjadi vektor padat untuk menangkap semantik.

- Indeks: Vektor saluran ini diindeks dalam ruang vektor berdimensi tinggi untuk membolehkan carian jiran terdekat yang pantas. Kaedah popular termasuk Faiss dan Pinecone, antara lain.

- Pengekodan pertanyaan: Pernyataan pertanyaan pengguna juga dikodkan ke dalam perwakilan vektor menggunakan model benam yang sama.

- Pendapatan semula persamaan: Carian jiran terdekat dijalankan merentas perenggan yang diindeks, mencari perenggan yang paling hampir dengan vektor pertanyaan berdasarkan metrik jarak (seperti jarak kosinus).

- Kembalikan hasil perenggan: Kembalikan vektor perenggan yang paling serupa, ekstrak teks asal untuk menyediakan konteks untuk LLM.

Saluran paip ini mempunyai beberapa had utama:

- vektor saluran mungkin tidak menangkap sepenuhnya maksud semantik pertanyaan, benam tidak boleh mewakili sambungan inferens tertentu dan konteks penting akhirnya diabaikan.

- Memadatkan seluruh perenggan menjadi satu vektor akan kehilangan nuansa dan butiran penting penting yang dibenamkan dalam ayat akan menjadi kabur.

- Pemadanan dilakukan secara bebas untuk setiap perenggan, tiada analisis bersama merentas perenggan yang berbeza, dan terdapat kekurangan fakta yang menghubungkan dan tiba pada jawapan yang perlu diagregatkan.

- Proses pemeringkatan dan pemadanan adalah legap, tiada ketelusan untuk menjelaskan mengapa petikan tertentu dianggap lebih relevan.

- Hanya persamaan semantik dikodkan dan tiada perwakilan perhubungan, struktur, peraturan dan kandungan lain antara sambungan yang berbeza.

- Tumpuan tunggal pada persamaan vektor semantik membawa kepada kekurangan pemahaman sebenar dalam pencarian semula.

Apabila pertanyaan menjadi lebih kompleks, batasan ini menjadi semakin ketara dalam ketidakupayaan untuk membuat alasan tentang kandungan yang diambil.

2. Sepadukan graf pengetahuan

Graf pengetahuan adalah berdasarkan entiti dan perhubungan, menghantar maklumat melalui rangkaian yang saling berkaitan dan meningkatkan keupayaan mendapatkan semula melalui penaakulan yang kompleks.

- Fakta Eksplisit Fakta ditangkap terus sebagai nod dan tepi dan bukannya dimampatkan menjadi vektor legap, yang mengekalkan butiran kritikal.

- Butiran konteks, entiti mengandungi atribut kaya, seperti perihalan, alias dan metadata yang menyediakan konteks utama.

- Struktur rangkaian menyatakan sambungan sebenar, peraturan tangkapan, hierarki, garis masa, dll. antara entiti pemodelan hubungan.

- Penaakulan pelbagai peringkat adalah berdasarkan traversal perhubungan dan menghubungkan fakta daripada sumber yang berbeza untuk mendapatkan jawapan yang memerlukan penaakulan merentasi pelbagai langkah.

- Taakulan bersama memaut ke objek dunia sebenar yang sama melalui resolusi entiti, membolehkan analisis kolektif.

- Korelasi yang boleh ditafsir, topologi graf menyediakan ketelusan yang boleh menjelaskan mengapa fakta berasaskan tertentu relevan berdasarkan sambungan.

- Pemperibadian, menangkap atribut pengguna, konteks dan interaksi sejarah untuk menyesuaikan hasil.

Graf pengetahuan bukan sekadar padanan mudah, tetapi proses merentasi graf untuk mengumpul fakta kontekstual yang berkaitan dengan pertanyaan. Kaedah penarafan yang boleh ditafsir mengeksploitasi topologi graf untuk meningkatkan keupayaan mendapatkan semula dengan mengekodkan fakta berstruktur, perhubungan dan konteks, dengan itu membolehkan penaakulan berbilang langkah yang tepat. Pendekatan ini memberikan korelasi dan kuasa penjelasan yang lebih besar berbanding dengan carian vektor tulen.

3. Gunakan kekangan mudah untuk menambah baik pembenaman graf pengetahuanMembenamkan graf pengetahuan dalam ruang vektor berterusan ialah tempat tumpuan penyelidikan semasa. Graf pengetahuan menggunakan benam vektor untuk mewakili entiti dan perhubungan untuk menyokong operasi matematik. Selain itu, kekangan tambahan boleh mengoptimumkan lagi perwakilan.

- Kekangan bukan negatif, mengehadkan pembenaman entiti kepada nilai positif antara 0 dan 1 menghasilkan jarang, memodelkan sifat positifnya secara eksplisit dan meningkatkan kebolehtafsiran.

- Kekangan implikasi secara langsung mengekod peraturan logik seperti simetri, penyongsangan, gubahan, dsb. ke dalam kekangan tertanam secara perhubungan untuk menguatkuasakan corak ini.

- Pemodelan keyakinan, kekangan lembut dengan pembolehubah kendur boleh mengekodkan keyakinan peraturan logik berdasarkan bukti.

- Pengaturan, yang mengenakan bias induktif yang berguna dan hanya menambah langkah unjuran tanpa menjadikan pengoptimuman lebih kompleks.

- Kebolehtafsiran, kekangan berstruktur memberikan ketelusan kepada corak yang dipelajari oleh model, yang menerangkan proses inferens.

- Ketepatan, kekangan meningkatkan generalisasi dengan mengurangkan ruang hipotesis kepada perwakilan yang memenuhi keperluan.

Kekangan mudah dan universal ditambah pada pembenaman graf pengetahuan, menghasilkan perwakilan yang lebih optimum, lebih mudah untuk ditafsir dan serasi secara logik. Pembenaman memperoleh bias induktif yang meniru struktur dan peraturan dunia sebenar tanpa memperkenalkan banyak kerumitan tambahan untuk penaakulan yang lebih tepat dan boleh ditafsir.

4. Mengintegrasikan pelbagai rangka kerja penaakulanGraf pengetahuan memerlukan penaakulan untuk memperoleh fakta baharu, menjawab soalan dan membuat ramalan Teknologi yang berbeza mempunyai kelebihan yang saling melengkapi:

pengetahuan logik dan peraturan logik. penaakulan lengkap melalui pembuktian teorem, dan pemprosesan ketidakpastian terhad. Pembenaman graf ialah struktur graf pengetahuan terbenam yang digunakan untuk operasi ruang vektor, yang boleh mengendalikan ketidakpastian tetapi tidak mempunyai ekspresif. Rangkaian saraf yang digabungkan dengan carian vektor adalah adaptif, tetapi inferensnya adalah legap. Peraturan boleh dibuat secara automatik melalui analisis statistik struktur dan data graf, tetapi kualitinya tidak pasti. Talian paip hibrid mengekodkan kekangan eksplisit melalui peraturan logik, benam menyediakan operasi ruang vektor, dan rangkaian saraf mendapat faedah gabungan melalui latihan bersama. Gunakan kaedah logik berasaskan kes, kabur atau probabilistik untuk meningkatkan ketelusan, menyatakan ketidakpastian dan keyakinan terhadap peraturan. Kembangkan pengetahuan dengan menjelmakan fakta yang disimpulkan dan peraturan yang dipelajari ke dalam graf, menyediakan gelung maklum balas.

Kuncinya ialah mengenal pasti jenis inferens yang diperlukan dan memetakannya kepada teknik yang sesuai, menggabungkan bentuk logik, perwakilan vektor dan saluran paip komponen neuron yang boleh digubah untuk memberikan keteguhan dan kebolehtafsiran.

4.1 Mengekalkan aliran maklumat LLM

Mendapatkan kembali fakta dalam graf pengetahuan untuk LLM memperkenalkan kesesakan maklumat yang perlu dikekalkan oleh reka bentuk untuk mengekalkan perkaitan. Memecahkan kandungan kepada bahagian kecil meningkatkan pengasingan tetapi kehilangan konteks sekeliling, yang menghalang penaakulan antara bahagian. Menjana ringkasan blok menyediakan konteks yang lebih ringkas, dengan butiran utama yang dipekatkan untuk menyerlahkan makna. Lampirkan ringkasan, tajuk, teg, dsb. sebagai metadata untuk mengekalkan konteks tentang kandungan sumber. Menulis semula pertanyaan asal ke dalam versi yang lebih terperinci boleh menyasarkan pengambilan semula kepada keperluan LLM dengan lebih baik. Fungsi traversal graf pengetahuan mengekalkan hubungan antara fakta dan mengekalkan konteks. Mengisih secara kronologi atau mengikut kaitan boleh mengoptimumkan struktur maklumat LLM, dan menukar pengetahuan tersirat kepada fakta eksplisit yang dinyatakan untuk LLM boleh memudahkan penaakulan.

Matlamatnya adalah untuk mengoptimumkan perkaitan, konteks, struktur dan ekspresi eksplisit pengetahuan yang diperolehi untuk memaksimumkan keupayaan penaakulan. Keseimbangan perlu dicapai antara butiran dan perpaduan. Hubungan graf pengetahuan membantu membina konteks untuk fakta terpencil.

4.2 Membuka kunci keupayaan penaakulan

Gabungan graf pengetahuan dan teknologi terbenam mempunyai kelebihan untuk mengatasi kelemahan masing-masing.

Graf pengetahuan menyediakan ungkapan berstruktur entiti dan perhubungan. Tingkatkan keupayaan penaakulan yang kompleks melalui fungsi traversal dan kendalikan penaakulan berbilang peringkat mengekod maklumat untuk operasi berasaskan persamaan dalam ruang vektor, menyokong carian anggaran yang berkesan pada skala tertentu dan memaparkan corak yang berpotensi. Pengekodan bersama menjana pembenaman untuk entiti dan perhubungan dalam graf pengetahuan. Rangkaian saraf graf beroperasi pada struktur graf dan elemen terbenam melalui hantaran mesej yang boleh dibezakan.

Graf pengetahuan mula-mula mengumpulkan pengetahuan berstruktur, dan kemudian membenamkan carian dan perolehan tertumpu pada kandungan yang berkaitan dengan perhubungan graf pengetahuan eksplisit memberikan kebolehtafsiran untuk proses penaakulan. Pengetahuan yang disimpulkan boleh diperluaskan kepada graf, dan GNN menyediakan pembelajaran perwakilan berterusan.

Perkongsian ini boleh dikenali melalui corak! Skala daya dan rangkaian saraf meningkatkan perwakilan pengetahuan berstruktur. Ini adalah kunci kepada keperluan pembelajaran statistik dan logik simbolik untuk memajukan AI linguistik. .

Hasilkan vektor pembenaman untuk atribut nod utama tertentu (seperti tajuk, penerangan, dll.).Indeks Vektor - Membina indeks persamaan vektor bagi benam nod.

- Carian Jiran Terdekat - Untuk pertanyaan carian, cari nod dengan benam yang paling serupa.

- Pelarasan Kolaboratif - Sambungan berasaskan nod, menggunakan algoritma seperti PageRank untuk menyebarkan dan melaraskan skor persamaan.

- Berat tepiーLaraskan berat berdasarkan jenis tepi, kekuatan, keyakinan, dsb.

- Penormalan Skor ーーMenormalkan skor yang dilaraskan untuk mengekalkan kedudukan relatif.

- Keputusan disusun semulaーーKeputusan awal disusun semula berdasarkan skor kerjasama yang dilaraskan.

- Konteks penggunaーーditala selanjutnya berdasarkan profil pengguna, sejarah dan pilihan.

- Gambar 5. Menjana Enjin RAG - Roda Gila Data

- Membina data yang sentiasa bertambah baik Retrieval Augmentation Generation (RAG) mungkin memerlukan sistem data flywheel. Graf pengetahuan membuka kunci keupayaan penaakulan baharu untuk model bahasa dengan menyediakan pengetahuan dunia berstruktur. Walau bagaimanapun, membina peta berkualiti tinggi masih mencabar. Di sinilah roda tenaga data masuk, dengan menganalisis interaksi sistem untuk meningkatkan graf pengetahuan secara berterusan.

Log semua pertanyaan sistem, respons, skor, tindakan pengguna dan banyak lagi untuk memberikan keterlihatan tentang cara graf pengetahuan digunakan, gunakan pengagregatan data untuk memaparkan respons buruk, kelompok dan analisis respons ini untuk mengenal pasti corak yang menunjukkan jurang pengetahuan. Semak respons sistem yang bermasalah secara manual dan jejak isu kembali kepada fakta yang hilang atau salah dalam peta. Kemudian, ubah suai carta secara terus untuk menambah data fakta yang tiada, menambah baik struktur, meningkatkan kejelasan dan banyak lagi. Langkah-langkah di atas diselesaikan dalam gelung berterusan, dan setiap lelaran meningkatkan lagi graf pengetahuan.

Log semua pertanyaan sistem, respons, skor, tindakan pengguna dan banyak lagi untuk memberikan keterlihatan tentang cara graf pengetahuan digunakan, gunakan pengagregatan data untuk memaparkan respons buruk, kelompok dan analisis respons ini untuk mengenal pasti corak yang menunjukkan jurang pengetahuan. Semak respons sistem yang bermasalah secara manual dan jejak isu kembali kepada fakta yang hilang atau salah dalam peta. Kemudian, ubah suai carta secara terus untuk menambah data fakta yang tiada, menambah baik struktur, meningkatkan kejelasan dan banyak lagi. Langkah-langkah di atas diselesaikan dalam gelung berterusan, dan setiap lelaran meningkatkan lagi graf pengetahuan.

Menstrim sumber data masa nyata seperti berita dan media sosial menyediakan aliran maklumat baharu yang berterusan untuk memastikan graf pengetahuan terkini. Menggunakan penjanaan pertanyaan untuk mengenal pasti dan mengisi jurang pengetahuan kritikal adalah di luar skop apa yang disediakan oleh penstriman. Cari lubang dalam graf, tanya soalan, dapatkan semula fakta yang hilang dan tambahkannya. Untuk setiap kitaran, graf pengetahuan dipertingkatkan secara beransur-ansur dengan menganalisis corak penggunaan dan membetulkan masalah data Graf yang dipertingkatkan meningkatkan prestasi sistem.

Proses roda tenaga ini membolehkan graf pengetahuan dan model bahasa berkembang bersama berdasarkan maklum balas daripada penggunaan dunia sebenar. Peta diubah suai secara aktif agar sesuai dengan keperluan model.

Ringkasnya, roda tenaga data menyediakan perancah untuk peningkatan berterusan dan automatik bagi graf pengetahuan dengan menganalisis interaksi sistem. Ini menguasakan ketepatan, perkaitan dan kebolehsuaian model bahasa yang bergantung kepada graf.

6. Ringkasan

Kecerdasan buatan perlu menggabungkan pengetahuan luaran dan penaakulan, di mana graf pengetahuan masuk. Graf pengetahuan menyediakan perwakilan berstruktur bagi entiti dan perhubungan dunia sebenar, pengekodan fakta tentang dunia dan perkaitan antara mereka. Ini membolehkan penaakulan logik yang kompleks merentasi pelbagai langkah dengan merentasi fakta yang saling berkaitan itu

Walau bagaimanapun, graf pengetahuan mempunyai hadnya sendiri seperti keterbatasan dan kekurangan pengendalian ketidakpastian, yang merupakan tempat pembenaman graf membantu lokasi. Dengan mengekodkan elemen graf pengetahuan dalam ruang vektor, pembenaman membenarkan pembelajaran statistik daripada korpora besar kepada perwakilan corak terpendam, dan juga membolehkan operasi berasaskan persamaan yang cekap.

Tiada graf pengetahuan atau pembenaman vektor dengan sendirinya tidak mencukupi untuk membentuk kecerdasan bahasa seperti manusia, tetapi bersama-sama ia menyediakan gabungan perwakilan pengetahuan berstruktur yang berkesan, penaakulan logik dan pembelajaran statistik, dan graf pengetahuan merangkumi model rangkaian saraf Beyond keupayaan untuk mengenali logik dan perhubungan simbolik, teknik seperti rangkaian saraf graf menyatukan lagi pendekatan ini melalui struktur graf pemindahan maklumat dan benam. Hubungan simbiotik ini membolehkan sistem menggunakan kedua-dua pembelajaran statistik dan logik simbolik, menggabungkan kelebihan rangkaian saraf dan perwakilan pengetahuan berstruktur.

Masih terdapat cabaran dalam membina graf pengetahuan berkualiti tinggi, ujian penanda aras, pemprosesan hingar, dsb. Walau bagaimanapun, teknologi hibrid yang merangkumi rangkaian simbolik dan saraf kekal menjanjikan. Apabila graf pengetahuan dan model bahasa terus berkembang, penyepaduan mereka akan membuka bidang baharu AI yang boleh dijelaskan.

Atas ialah kandungan terperinci Graf pengetahuan: rakan kongsi yang ideal untuk model besar. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1374

1374

52

52

Bytedance Cutting melancarkan keahlian super SVIP: 499 yuan untuk langganan tahunan berterusan, menyediakan pelbagai fungsi AI

Jun 28, 2024 am 03:51 AM

Bytedance Cutting melancarkan keahlian super SVIP: 499 yuan untuk langganan tahunan berterusan, menyediakan pelbagai fungsi AI

Jun 28, 2024 am 03:51 AM

Laman web ini melaporkan pada 27 Jun bahawa Jianying ialah perisian penyuntingan video yang dibangunkan oleh FaceMeng Technology, anak syarikat ByteDance Ia bergantung pada platform Douyin dan pada asasnya menghasilkan kandungan video pendek untuk pengguna platform tersebut Windows , MacOS dan sistem pengendalian lain. Jianying secara rasmi mengumumkan peningkatan sistem keahliannya dan melancarkan SVIP baharu, yang merangkumi pelbagai teknologi hitam AI, seperti terjemahan pintar, penonjolan pintar, pembungkusan pintar, sintesis manusia digital, dsb. Dari segi harga, yuran bulanan untuk keratan SVIP ialah 79 yuan, yuran tahunan ialah 599 yuan (nota di laman web ini: bersamaan dengan 49.9 yuan sebulan), langganan bulanan berterusan ialah 59 yuan sebulan, dan langganan tahunan berterusan ialah 499 yuan setahun (bersamaan dengan 41.6 yuan sebulan) . Di samping itu, pegawai yang dipotong juga menyatakan bahawa untuk meningkatkan pengalaman pengguna, mereka yang telah melanggan VIP asal

Pembantu pengekodan AI yang ditambah konteks menggunakan Rag dan Sem-Rag

Jun 10, 2024 am 11:08 AM

Pembantu pengekodan AI yang ditambah konteks menggunakan Rag dan Sem-Rag

Jun 10, 2024 am 11:08 AM

Tingkatkan produktiviti, kecekapan dan ketepatan pembangun dengan menggabungkan penjanaan dipertingkatkan semula dan memori semantik ke dalam pembantu pengekodan AI. Diterjemah daripada EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, pengarang JanakiramMSV. Walaupun pembantu pengaturcaraan AI asas secara semulajadi membantu, mereka sering gagal memberikan cadangan kod yang paling relevan dan betul kerana mereka bergantung pada pemahaman umum bahasa perisian dan corak penulisan perisian yang paling biasa. Kod yang dijana oleh pembantu pengekodan ini sesuai untuk menyelesaikan masalah yang mereka bertanggungjawab untuk menyelesaikannya, tetapi selalunya tidak mematuhi piawaian pengekodan, konvensyen dan gaya pasukan individu. Ini selalunya menghasilkan cadangan yang perlu diubah suai atau diperhalusi agar kod itu diterima ke dalam aplikasi

Tujuh Soalan Temuduga Teknikal GenAI & LLM yang Cool

Jun 07, 2024 am 10:06 AM

Tujuh Soalan Temuduga Teknikal GenAI & LLM yang Cool

Jun 07, 2024 am 10:06 AM

Untuk mengetahui lebih lanjut tentang AIGC, sila layari: 51CTOAI.x Komuniti https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou berbeza daripada bank soalan tradisional yang boleh dilihat di mana-mana sahaja di Internet memerlukan pemikiran di luar kotak. Model Bahasa Besar (LLM) semakin penting dalam bidang sains data, kecerdasan buatan generatif (GenAI) dan kecerdasan buatan. Algoritma kompleks ini meningkatkan kemahiran manusia dan memacu kecekapan dan inovasi dalam banyak industri, menjadi kunci kepada syarikat untuk kekal berdaya saing. LLM mempunyai pelbagai aplikasi Ia boleh digunakan dalam bidang seperti pemprosesan bahasa semula jadi, penjanaan teks, pengecaman pertuturan dan sistem pengesyoran. Dengan belajar daripada sejumlah besar data, LLM dapat menjana teks

Bolehkah penalaan halus benar-benar membolehkan LLM mempelajari perkara baharu: memperkenalkan pengetahuan baharu boleh menjadikan model menghasilkan lebih banyak halusinasi

Jun 11, 2024 pm 03:57 PM

Bolehkah penalaan halus benar-benar membolehkan LLM mempelajari perkara baharu: memperkenalkan pengetahuan baharu boleh menjadikan model menghasilkan lebih banyak halusinasi

Jun 11, 2024 pm 03:57 PM

Model Bahasa Besar (LLM) dilatih pada pangkalan data teks yang besar, di mana mereka memperoleh sejumlah besar pengetahuan dunia sebenar. Pengetahuan ini dibenamkan ke dalam parameter mereka dan kemudiannya boleh digunakan apabila diperlukan. Pengetahuan tentang model ini "diperbaharui" pada akhir latihan. Pada akhir pra-latihan, model sebenarnya berhenti belajar. Selaraskan atau perhalusi model untuk mempelajari cara memanfaatkan pengetahuan ini dan bertindak balas dengan lebih semula jadi kepada soalan pengguna. Tetapi kadangkala pengetahuan model tidak mencukupi, dan walaupun model boleh mengakses kandungan luaran melalui RAG, ia dianggap berfaedah untuk menyesuaikan model kepada domain baharu melalui penalaan halus. Penalaan halus ini dilakukan menggunakan input daripada anotasi manusia atau ciptaan LLM lain, di mana model menemui pengetahuan dunia sebenar tambahan dan menyepadukannya

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Editor |ScienceAI Question Answering (QA) set data memainkan peranan penting dalam mempromosikan penyelidikan pemprosesan bahasa semula jadi (NLP). Set data QA berkualiti tinggi bukan sahaja boleh digunakan untuk memperhalusi model, tetapi juga menilai dengan berkesan keupayaan model bahasa besar (LLM), terutamanya keupayaan untuk memahami dan menaakul tentang pengetahuan saintifik. Walaupun pada masa ini terdapat banyak set data QA saintifik yang meliputi bidang perubatan, kimia, biologi dan bidang lain, set data ini masih mempunyai beberapa kekurangan. Pertama, borang data adalah agak mudah, kebanyakannya adalah soalan aneka pilihan. Ia mudah dinilai, tetapi mengehadkan julat pemilihan jawapan model dan tidak dapat menguji sepenuhnya keupayaan model untuk menjawab soalan saintifik. Sebaliknya, Soal Jawab terbuka

Lima sekolah pembelajaran mesin yang anda tidak tahu

Jun 05, 2024 pm 08:51 PM

Lima sekolah pembelajaran mesin yang anda tidak tahu

Jun 05, 2024 pm 08:51 PM

Pembelajaran mesin ialah cabang penting kecerdasan buatan yang memberikan komputer keupayaan untuk belajar daripada data dan meningkatkan keupayaan mereka tanpa diprogramkan secara eksplisit. Pembelajaran mesin mempunyai pelbagai aplikasi dalam pelbagai bidang, daripada pengecaman imej dan pemprosesan bahasa semula jadi kepada sistem pengesyoran dan pengesanan penipuan, dan ia mengubah cara hidup kita. Terdapat banyak kaedah dan teori yang berbeza dalam bidang pembelajaran mesin, antaranya lima kaedah yang paling berpengaruh dipanggil "Lima Sekolah Pembelajaran Mesin". Lima sekolah utama ialah sekolah simbolik, sekolah sambungan, sekolah evolusi, sekolah Bayesian dan sekolah analogi. 1. Simbolisme, juga dikenali sebagai simbolisme, menekankan penggunaan simbol untuk penaakulan logik dan ekspresi pengetahuan. Aliran pemikiran ini percaya bahawa pembelajaran adalah proses penolakan terbalik, melalui sedia ada

Prestasi SOTA, kaedah AI ramalan pertalian protein-ligan pelbagai mod Xiamen, menggabungkan maklumat permukaan molekul buat kali pertama

Jul 17, 2024 pm 06:37 PM

Prestasi SOTA, kaedah AI ramalan pertalian protein-ligan pelbagai mod Xiamen, menggabungkan maklumat permukaan molekul buat kali pertama

Jul 17, 2024 pm 06:37 PM

Editor |. KX Dalam bidang penyelidikan dan pembangunan ubat, meramalkan pertalian pengikatan protein dan ligan dengan tepat dan berkesan adalah penting untuk pemeriksaan dan pengoptimuman ubat. Walau bagaimanapun, kajian semasa tidak mengambil kira peranan penting maklumat permukaan molekul dalam interaksi protein-ligan. Berdasarkan ini, penyelidik dari Universiti Xiamen mencadangkan rangka kerja pengekstrakan ciri berbilang mod (MFE) novel, yang buat pertama kalinya menggabungkan maklumat mengenai permukaan protein, struktur dan jujukan 3D, dan menggunakan mekanisme perhatian silang untuk membandingkan ciri modaliti yang berbeza penjajaran. Keputusan eksperimen menunjukkan bahawa kaedah ini mencapai prestasi terkini dalam meramalkan pertalian mengikat protein-ligan. Tambahan pula, kajian ablasi menunjukkan keberkesanan dan keperluan maklumat permukaan protein dan penjajaran ciri multimodal dalam rangka kerja ini. Penyelidikan berkaitan bermula dengan "S

Meletakkan pasaran seperti AI, GlobalFoundries memperoleh teknologi gallium nitrida Tagore Technology dan pasukan berkaitan

Jul 15, 2024 pm 12:21 PM

Meletakkan pasaran seperti AI, GlobalFoundries memperoleh teknologi gallium nitrida Tagore Technology dan pasukan berkaitan

Jul 15, 2024 pm 12:21 PM

Menurut berita dari laman web ini pada 5 Julai, GlobalFoundries mengeluarkan kenyataan akhbar pada 1 Julai tahun ini, mengumumkan pemerolehan teknologi power gallium nitride (GaN) Tagore Technology dan portfolio harta intelek, dengan harapan dapat mengembangkan bahagian pasarannya dalam kereta dan Internet of Things dan kawasan aplikasi pusat data kecerdasan buatan untuk meneroka kecekapan yang lebih tinggi dan prestasi yang lebih baik. Memandangkan teknologi seperti AI generatif terus berkembang dalam dunia digital, galium nitrida (GaN) telah menjadi penyelesaian utama untuk pengurusan kuasa yang mampan dan cekap, terutamanya dalam pusat data. Laman web ini memetik pengumuman rasmi bahawa semasa pengambilalihan ini, pasukan kejuruteraan Tagore Technology akan menyertai GLOBALFOUNDRIES untuk membangunkan lagi teknologi gallium nitride. G