Berita 8 Februari Berbanding dengan kemakmuran Microsoft, susun atur Apple dalam bidang AI adalah lebih rendah, tetapi ini tidak bermakna Apple tidak membuat sebarang pencapaian dalam bidang ini. Apple baru-baru ini mengeluarkan model kecerdasan buatan sumber terbuka baharu yang dipanggil "MGIE", yang boleh mengedit imej berdasarkan arahan bahasa semula jadi.

Sumber imej: VentureBeat dengan kerjasama Midjourney

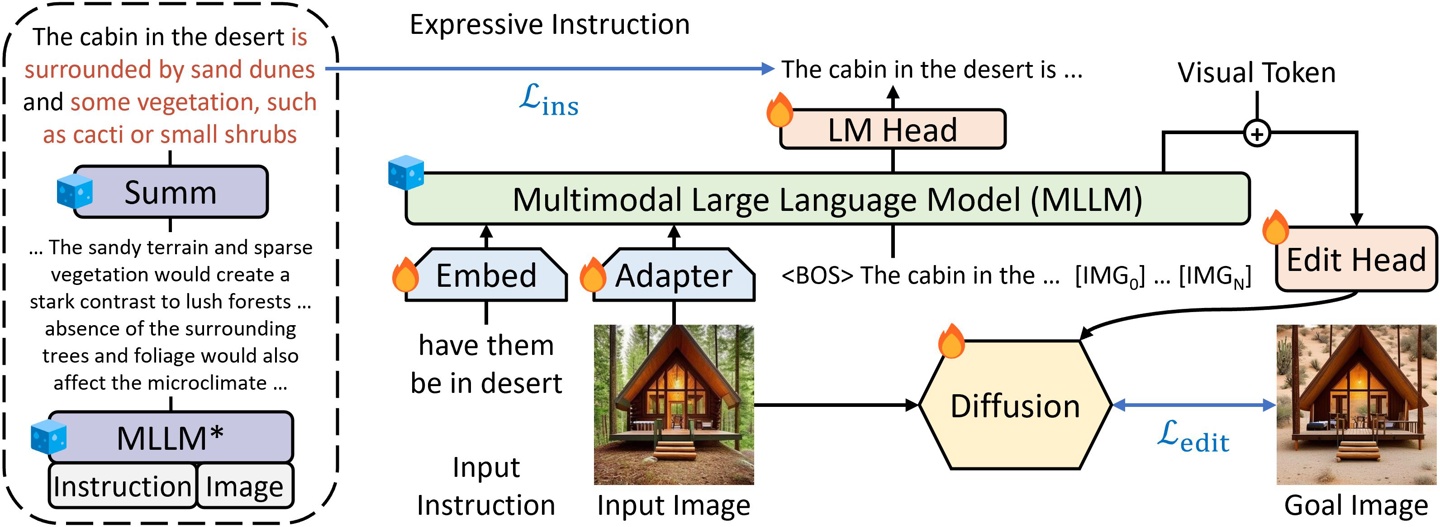

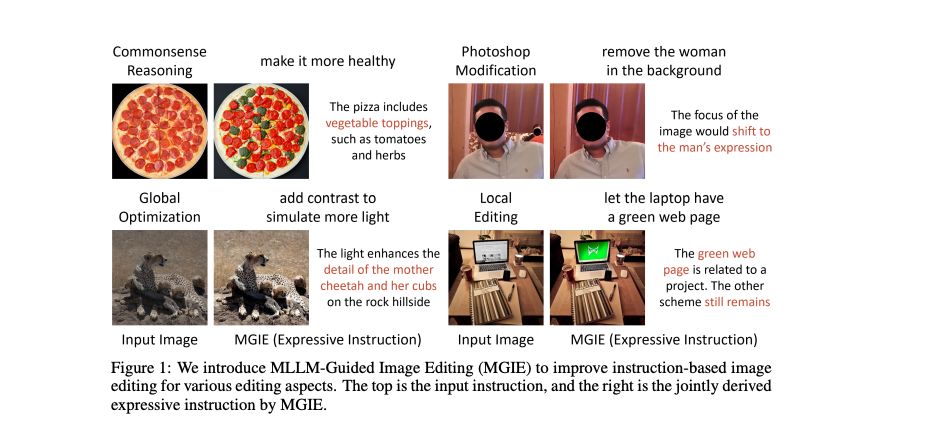

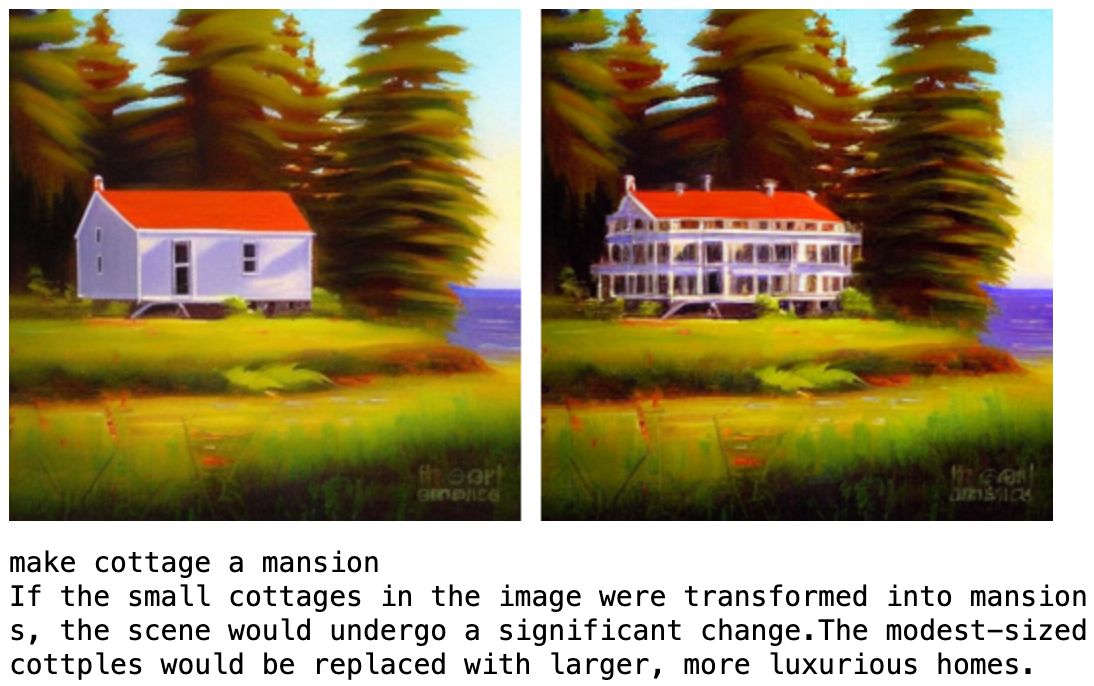

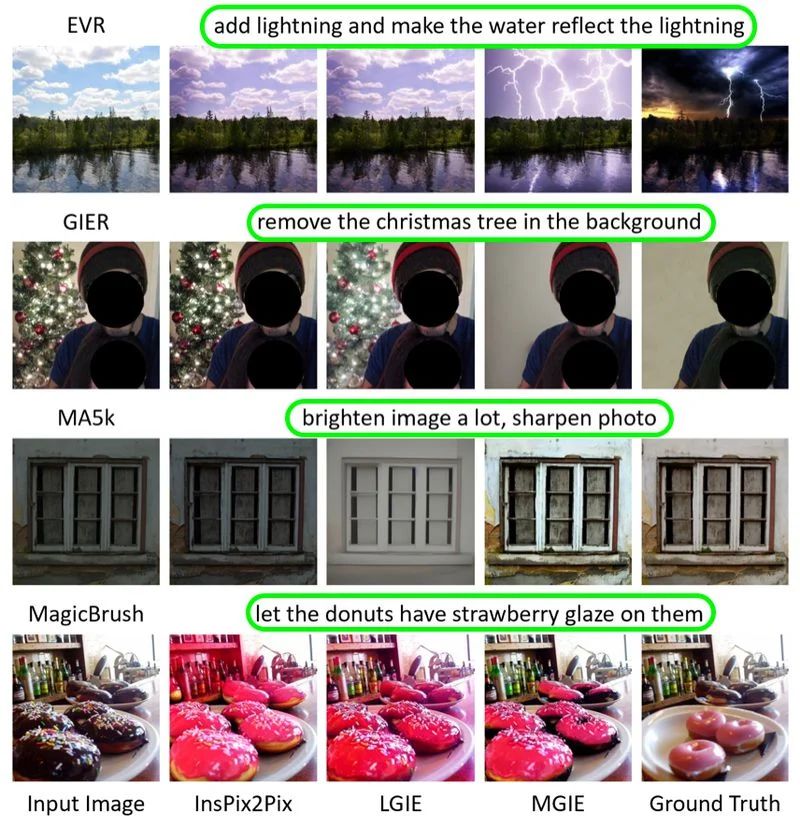

MGIE (Penyuntingan Imej Berpandukan MLLM) ialah teknologi yang menggunakan model bahasa besar berbilang mod (MLLM) untuk melaksanakan arahan pengguna peringkat piksel dan Ia boleh memahami arahan bahasa semula jadi pengguna dan melakukan pengubahsuaian seperti Photoshop, pengoptimuman foto global dan penyuntingan tempatan. Melalui MGIE, pengguna boleh melakukan pelbagai suntingan pada gambar dengan mudah tanpa mengetahui perisian pemprosesan imej yang kompleks. Teknologi ini memudahkan proses penyuntingan imej di samping menyediakan kaedah penyuntingan yang lebih intuitif dan cekap.

Apple, dengan kerjasama penyelidik di University of California, Santa Barbara, mengumumkan hasil penyelidikan berkaitan MGIE pada Persidangan Antarabangsa mengenai Perwakilan Pembelajaran (ICLR) 2024. ICLR adalah salah satu persidangan terpenting dalam bidang penyelidikan kecerdasan buatan.

Sebelum memperkenalkan MGIE, laman web ini akan memperkenalkan secara ringkas MLLM (Model Pembelajaran Bahasa Pelbagai Modal). MLLM ialah model kecerdasan buatan berkuasa yang unik kerana ia boleh memproses teks dan imej secara serentak, sekali gus meningkatkan keupayaan penyuntingan imej berasaskan arahan. MLLM telah menunjukkan keupayaan yang sangat baik dalam pemahaman silang mod dan penjanaan tindak balas persepsi visual, namun, ia masih belum digunakan secara meluas dalam tugas penyuntingan imej.

MGIE mengintegrasikan MLLM ke dalam proses penyuntingan imej dalam dua cara: Pertama, ia memanfaatkan MLLM untuk memperoleh arahan yang tepat dan ekspresif daripada input pengguna. Arahan ini ringkas dan jelas, memberikan panduan yang jelas untuk proses penyuntingan.

Contohnya, apabila menaip "Jadikan langit lebih biru", MGIE boleh menjana arahan "Tingkatkan ketepuan kawasan langit sebanyak 20%".

Kedua, ia menggunakan MLLM untuk menjana imaginasi visual, iaitu, perwakilan terpendam bagi suntingan yang dikehendaki. Perwakilan ini menangkap intipati pengeditan dan boleh digunakan untuk membimbing operasi peringkat piksel. MGIE menggunakan skim latihan hujung ke hujung novel yang mengoptimumkan derivasi arahan, imaginasi visual dan modul penyuntingan imej secara bersama.

MGIE boleh mengendalikan pelbagai situasi penyuntingan, daripada pelarasan warna mudah kepada manipulasi objek yang kompleks. Model ini juga boleh melakukan pengeditan global dan tempatan berdasarkan pilihan pengguna. Beberapa ciri dan fungsi MGIE termasuk:

MGIE ialah projek sumber terbuka di GitHub Pengguna boleh klik di sini untuk mencari kod, data dan model yang telah dilatih. Projek ini juga menyediakan buku nota demo yang menunjukkan cara menggunakan MGIE untuk menyelesaikan pelbagai tugas penyuntingan.

Atas ialah kandungan terperinci Apple menunjukkan model AI baharu MGIE, yang boleh memperhalusi gambar dalam satu ayat. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Apakah maksud rangkaian Apple LTE?

Apakah maksud rangkaian Apple LTE?

Peranan mod Jangan Ganggu Apple

Peranan mod Jangan Ganggu Apple

Bagaimana untuk menyelesaikan masalah bahawa Apple tidak boleh memuat turun lebih daripada 200 fail

Bagaimana untuk menyelesaikan masalah bahawa Apple tidak boleh memuat turun lebih daripada 200 fail

apa itu html

apa itu html

Apakah jenama telefon bimbit Nubia?

Apakah jenama telefon bimbit Nubia?

Bagaimana untuk memulihkan sejarah penyemak imbas pada komputer

Bagaimana untuk memulihkan sejarah penyemak imbas pada komputer

Pelabuhan 8080 telah diduduki

Pelabuhan 8080 telah diduduki

Bagaimana untuk memampatkan fail html ke dalam zip

Bagaimana untuk memampatkan fail html ke dalam zip