Peranti teknologi

Peranti teknologi

industri IT

industri IT

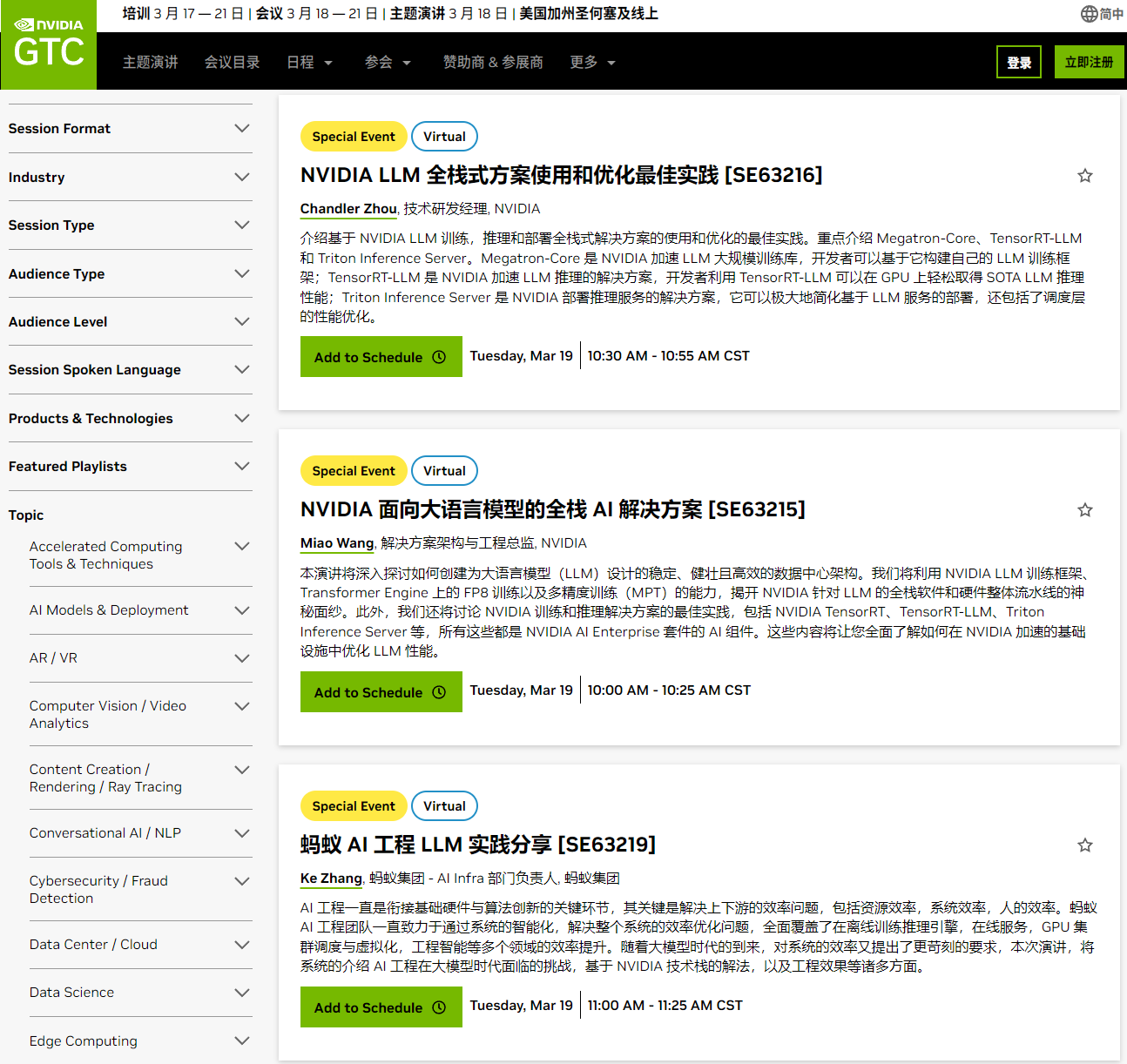

NVIDIA GTC 2024 Conference China AI Day Sesi khas Cina telah diadakan pada 19 Mac, dengan perbincangan mendalam tentang LLM

NVIDIA GTC 2024 Conference China AI Day Sesi khas Cina telah diadakan pada 19 Mac, dengan perbincangan mendalam tentang LLM

NVIDIA GTC 2024 Conference China AI Day Sesi khas Cina telah diadakan pada 19 Mac, dengan perbincangan mendalam tentang LLM

NVIDIA merancang untuk menganjurkan persidangan GTC 2024 di Pusat Konvensyen San Jose dari 18 hingga 21 Mac tahun depan. Pada masa itu, Ketua Pegawai Eksekutif Nvidia Jensen Huang akan mengumumkan penemuan terbaru syarikat dalam pengkomputeran dipercepatkan, AI generatif dan robotik.

NVIDIA secara rasmi mengumumkan hari ini bahawa sesi dalam talian Cina Hari AI China GTC 2024 akan diadakan pada jam 10:00 pagi pada 19 Mac.

Menurut laporan, sesi khas Cina akan tertumpu kepada "LLM" dan terbahagi terutamanya kepada empat tema utama, termasuk infrastruktur AI, rantaian alat awan, analisis inferens dan prestasi serta perbincangan aplikasi. Persidangan itu akan menyelidiki pengoptimuman prestasi dan aplikasi praktikal LLM. Pakar teknikal dari NVIDIA dan Ant Group secara khusus akan berkongsi kandungan tematik mengenai infrastruktur AI LLM.

Mengikut jadual yang dikeluarkan oleh NVIDIA, mereka akan mengadakan perbincangan khas mengenai "amalan terbaik penggunaan penyelesaian tindanan penuh NVIDIA LLM dan pengoptimuman" dan "penyelesaian AI tindanan penuh NVIDIA untuk model bahasa besar". Selain itu, Kumpulan Ant juga akan berkongsi pengalaman praktikalnya dalam LLM kejuruteraan AI. Bagi pengguna laman web ini, jika mereka berminat dengan topik-topik ini, mereka boleh membuat temujanji untuk menyertai melalui laman web rasmi.

Atas ialah kandungan terperinci NVIDIA GTC 2024 Conference China AI Day Sesi khas Cina telah diadakan pada 19 Mac, dengan perbincangan mendalam tentang LLM. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1359

1359

52

52

Bytedance Cutting melancarkan keahlian super SVIP: 499 yuan untuk langganan tahunan berterusan, menyediakan pelbagai fungsi AI

Jun 28, 2024 am 03:51 AM

Bytedance Cutting melancarkan keahlian super SVIP: 499 yuan untuk langganan tahunan berterusan, menyediakan pelbagai fungsi AI

Jun 28, 2024 am 03:51 AM

Laman web ini melaporkan pada 27 Jun bahawa Jianying ialah perisian penyuntingan video yang dibangunkan oleh FaceMeng Technology, anak syarikat ByteDance Ia bergantung pada platform Douyin dan pada asasnya menghasilkan kandungan video pendek untuk pengguna platform tersebut Windows , MacOS dan sistem pengendalian lain. Jianying secara rasmi mengumumkan peningkatan sistem keahliannya dan melancarkan SVIP baharu, yang merangkumi pelbagai teknologi hitam AI, seperti terjemahan pintar, penonjolan pintar, pembungkusan pintar, sintesis manusia digital, dsb. Dari segi harga, yuran bulanan untuk keratan SVIP ialah 79 yuan, yuran tahunan ialah 599 yuan (nota di laman web ini: bersamaan dengan 49.9 yuan sebulan), langganan bulanan berterusan ialah 59 yuan sebulan, dan langganan tahunan berterusan ialah 499 yuan setahun (bersamaan dengan 41.6 yuan sebulan) . Di samping itu, pegawai yang dipotong juga menyatakan bahawa untuk meningkatkan pengalaman pengguna, mereka yang telah melanggan VIP asal

Pembantu pengekodan AI yang ditambah konteks menggunakan Rag dan Sem-Rag

Jun 10, 2024 am 11:08 AM

Pembantu pengekodan AI yang ditambah konteks menggunakan Rag dan Sem-Rag

Jun 10, 2024 am 11:08 AM

Tingkatkan produktiviti, kecekapan dan ketepatan pembangun dengan menggabungkan penjanaan dipertingkatkan semula dan memori semantik ke dalam pembantu pengekodan AI. Diterjemah daripada EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, pengarang JanakiramMSV. Walaupun pembantu pengaturcaraan AI asas secara semulajadi membantu, mereka sering gagal memberikan cadangan kod yang paling relevan dan betul kerana mereka bergantung pada pemahaman umum bahasa perisian dan corak penulisan perisian yang paling biasa. Kod yang dijana oleh pembantu pengekodan ini sesuai untuk menyelesaikan masalah yang mereka bertanggungjawab untuk menyelesaikannya, tetapi selalunya tidak mematuhi piawaian pengekodan, konvensyen dan gaya pasukan individu. Ini selalunya menghasilkan cadangan yang perlu diubah suai atau diperhalusi agar kod itu diterima ke dalam aplikasi

Bolehkah penalaan halus benar-benar membolehkan LLM mempelajari perkara baharu: memperkenalkan pengetahuan baharu boleh menjadikan model menghasilkan lebih banyak halusinasi

Jun 11, 2024 pm 03:57 PM

Bolehkah penalaan halus benar-benar membolehkan LLM mempelajari perkara baharu: memperkenalkan pengetahuan baharu boleh menjadikan model menghasilkan lebih banyak halusinasi

Jun 11, 2024 pm 03:57 PM

Model Bahasa Besar (LLM) dilatih pada pangkalan data teks yang besar, di mana mereka memperoleh sejumlah besar pengetahuan dunia sebenar. Pengetahuan ini dibenamkan ke dalam parameter mereka dan kemudiannya boleh digunakan apabila diperlukan. Pengetahuan tentang model ini "diperbaharui" pada akhir latihan. Pada akhir pra-latihan, model sebenarnya berhenti belajar. Selaraskan atau perhalusi model untuk mempelajari cara memanfaatkan pengetahuan ini dan bertindak balas dengan lebih semula jadi kepada soalan pengguna. Tetapi kadangkala pengetahuan model tidak mencukupi, dan walaupun model boleh mengakses kandungan luaran melalui RAG, ia dianggap berfaedah untuk menyesuaikan model kepada domain baharu melalui penalaan halus. Penalaan halus ini dilakukan menggunakan input daripada anotasi manusia atau ciptaan LLM lain, di mana model menemui pengetahuan dunia sebenar tambahan dan menyepadukannya

Model dialog NVIDIA ChatQA telah berkembang kepada versi 2.0, dengan panjang konteks disebut pada 128K

Jul 26, 2024 am 08:40 AM

Model dialog NVIDIA ChatQA telah berkembang kepada versi 2.0, dengan panjang konteks disebut pada 128K

Jul 26, 2024 am 08:40 AM

Komuniti LLM terbuka ialah era apabila seratus bunga mekar dan bersaing Anda boleh melihat Llama-3-70B-Instruct, QWen2-72B-Instruct, Nemotron-4-340B-Instruct, Mixtral-8x22BInstruct-v0.1 dan banyak lagi. model yang cemerlang. Walau bagaimanapun, berbanding dengan model besar proprietari yang diwakili oleh GPT-4-Turbo, model terbuka masih mempunyai jurang yang ketara dalam banyak bidang. Selain model umum, beberapa model terbuka yang mengkhusus dalam bidang utama telah dibangunkan, seperti DeepSeek-Coder-V2 untuk pengaturcaraan dan matematik, dan InternVL untuk tugasan bahasa visual.

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Editor |ScienceAI Question Answering (QA) set data memainkan peranan penting dalam mempromosikan penyelidikan pemprosesan bahasa semula jadi (NLP). Set data QA berkualiti tinggi bukan sahaja boleh digunakan untuk memperhalusi model, tetapi juga menilai dengan berkesan keupayaan model bahasa besar (LLM), terutamanya keupayaan untuk memahami dan menaakul tentang pengetahuan saintifik. Walaupun pada masa ini terdapat banyak set data QA saintifik yang meliputi bidang perubatan, kimia, biologi dan bidang lain, set data ini masih mempunyai beberapa kekurangan. Pertama, borang data adalah agak mudah, kebanyakannya adalah soalan aneka pilihan. Ia mudah dinilai, tetapi mengehadkan julat pemilihan jawapan model dan tidak dapat menguji sepenuhnya keupayaan model untuk menjawab soalan saintifik. Sebaliknya, Soal Jawab terbuka

Prestasi SOTA, kaedah AI ramalan pertalian protein-ligan pelbagai mod Xiamen, menggabungkan maklumat permukaan molekul buat kali pertama

Jul 17, 2024 pm 06:37 PM

Prestasi SOTA, kaedah AI ramalan pertalian protein-ligan pelbagai mod Xiamen, menggabungkan maklumat permukaan molekul buat kali pertama

Jul 17, 2024 pm 06:37 PM

Editor |. KX Dalam bidang penyelidikan dan pembangunan ubat, meramalkan pertalian pengikatan protein dan ligan dengan tepat dan berkesan adalah penting untuk pemeriksaan dan pengoptimuman ubat. Walau bagaimanapun, kajian semasa tidak mengambil kira peranan penting maklumat permukaan molekul dalam interaksi protein-ligan. Berdasarkan ini, penyelidik dari Universiti Xiamen mencadangkan rangka kerja pengekstrakan ciri berbilang mod (MFE) novel, yang buat pertama kalinya menggabungkan maklumat mengenai permukaan protein, struktur dan jujukan 3D, dan menggunakan mekanisme perhatian silang untuk membandingkan ciri modaliti yang berbeza penjajaran. Keputusan eksperimen menunjukkan bahawa kaedah ini mencapai prestasi terkini dalam meramalkan pertalian mengikat protein-ligan. Tambahan pula, kajian ablasi menunjukkan keberkesanan dan keperluan maklumat permukaan protein dan penjajaran ciri multimodal dalam rangka kerja ini. Penyelidikan berkaitan bermula dengan "S

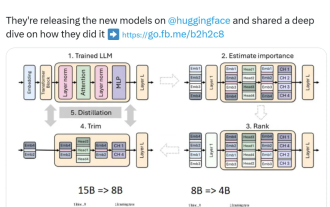

Nvidia bermain dengan pemangkasan dan penyulingan: mengurangkan separuh parameter Llama 3.1 8B untuk mencapai prestasi yang lebih baik dengan saiz yang sama

Aug 16, 2024 pm 04:42 PM

Nvidia bermain dengan pemangkasan dan penyulingan: mengurangkan separuh parameter Llama 3.1 8B untuk mencapai prestasi yang lebih baik dengan saiz yang sama

Aug 16, 2024 pm 04:42 PM

Kebangkitan model kecil. Bulan lepas, Meta mengeluarkan siri model Llama3.1, yang merangkumi model terbesar Meta setakat ini, model 405B, dan dua model yang lebih kecil dengan 70 bilion dan 8 bilion parameter masing-masing. Llama3.1 dianggap sebagai permulaan era baharu sumber terbuka. Walau bagaimanapun, walaupun model generasi baharu berkuasa dalam prestasi, ia masih memerlukan sejumlah besar sumber pengkomputeran apabila digunakan. Oleh itu, trend lain telah muncul dalam industri, iaitu membangunkan model bahasa kecil (SLM) yang berprestasi cukup baik dalam banyak tugas bahasa dan juga sangat murah untuk digunakan. Baru-baru ini, penyelidikan NVIDIA telah menunjukkan bahawa pemangkasan berat berstruktur digabungkan dengan penyulingan pengetahuan secara beransur-ansur boleh memperoleh model bahasa yang lebih kecil daripada model yang pada mulanya lebih besar. Pemenang Anugerah Turing, Ketua Meta A

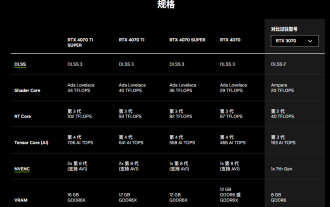

Nvidia mengeluarkan versi memori GDDR6 kad grafik GeForce RTX 4070, tersedia mulai September

Aug 21, 2024 am 07:31 AM

Nvidia mengeluarkan versi memori GDDR6 kad grafik GeForce RTX 4070, tersedia mulai September

Aug 21, 2024 am 07:31 AM

Menurut berita dari laman web ini pada 20 Ogos, beberapa sumber melaporkan pada bulan Julai bahawa kad grafik Nvidia RTX4070 dan ke atas akan berada dalam bekalan yang ketat pada bulan Ogos kerana kekurangan memori video GDDR6X. Selepas itu, spekulasi tersebar di Internet tentang melancarkan versi memori GDDR6 kad grafik RTX4070. Seperti yang dilaporkan oleh laman web ini sebelum ini, Nvidia hari ini mengeluarkan pemacu GameReady untuk "Black Myth: Wukong" dan "Star Wars: Outlaws" Pada masa yang sama, siaran akhbar itu juga menyebut keluaran versi memori video GDDR6 GeForce RTX4070. Nvidia menyatakan bahawa spesifikasi RTX4070 baharu selain daripada memori video akan kekal tidak berubah (sudah tentu, ia juga akan terus mengekalkan harga 4,799 yuan), memberikan prestasi yang serupa dengan versi asal dalam permainan dan aplikasi, dan produk berkaitan akan dilancarkan daripada