Peranti teknologi

Peranti teknologi

AI

AI

Latih anjing robot anda dalam masa nyata dengan Vision Pro! Projek sumber terbuka pelajar PhD MIT menjadi popular

Latih anjing robot anda dalam masa nyata dengan Vision Pro! Projek sumber terbuka pelajar PhD MIT menjadi popular

Latih anjing robot anda dalam masa nyata dengan Vision Pro! Projek sumber terbuka pelajar PhD MIT menjadi popular

Vision Pro mempunyai satu lagi permainan baharu yang hangat, kali ini ia dikaitkan dengan kecerdasan yang terkandung~

Sama seperti ini, lelaki MIT menggunakan fungsi penjejakan tangan Vision Pro untuk berjaya mencapai kawalan masa nyata anjing robot itu.

Bukan sahaja tindakan seperti membuka pintu boleh diperolehi dengan tepat:

, hampir tiada kelewatan.

Sebaik Demo keluar, bukan sahaja netizen memuji Goose Girl, malah pelbagai penyelidik perisikan yang dijelmakan turut teruja.

Sebagai contoh, bakal pelajar kedoktoran di Universiti Tsinghua ini:

Sesetengah orang dengan berani meramalkan: Beginilah cara kita akan berinteraksi dengan generasi mesin akan datang.

Cara melaksanakan projek, pengarang Park Younghyo(Younghyo Park) telah sumber terbuka di GitHub. Apl yang berkaitan boleh dimuat turun terus daripada App Store Vision Pro.

Gunakan Vision Pro untuk melatih anjing robot

Mari lihat aplikasi yang dibangunkan oleh pengarang secara terperinci - Pengukus Penjejakan.

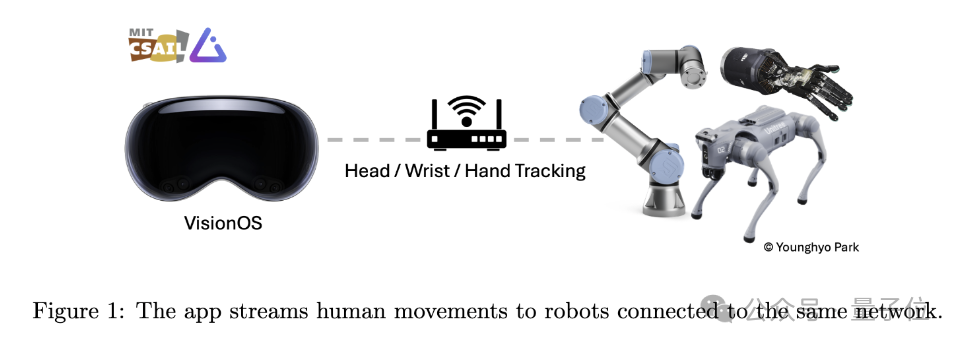

Seperti namanya, aplikasi ini direka bentuk untuk menggunakan Vision Pro untuk mengesan pergerakan manusia dan menghantar data pergerakan ini ke peranti robot lain di bawah WiFi yang sama dalam masa nyata.

Bahagian penjejakan gerakan bergantung terutamanya pada perpustakaan ARKit Apple.

Penjejakan kepala memanggil queryDeviceAnchor. Pengguna boleh menetapkan semula bingkai kepala kepada kedudukan semasa dengan menekan dan menahan Digital Crown.

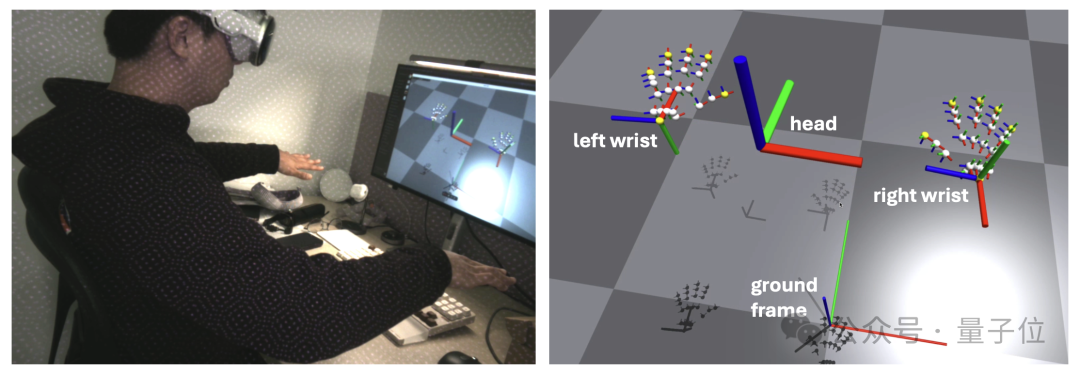

Penjejakan pergelangan tangan dan jari dilaksanakan melalui HandTrackingProvider. Ia mampu mengesan kedudukan dan orientasi pergelangan tangan kiri dan kanan berbanding rangka tanah, serta postur 25 sendi jari pada setiap tangan berbanding rangka pergelangan tangan.

Dari segi komunikasi rangkaian, Aplikasi ini menggunakan gRPC sebagai protokol komunikasi rangkaian untuk menstrim data. Ini membolehkan data melanggan lebih banyak peranti, termasuk peranti Linux, Mac dan Windows.

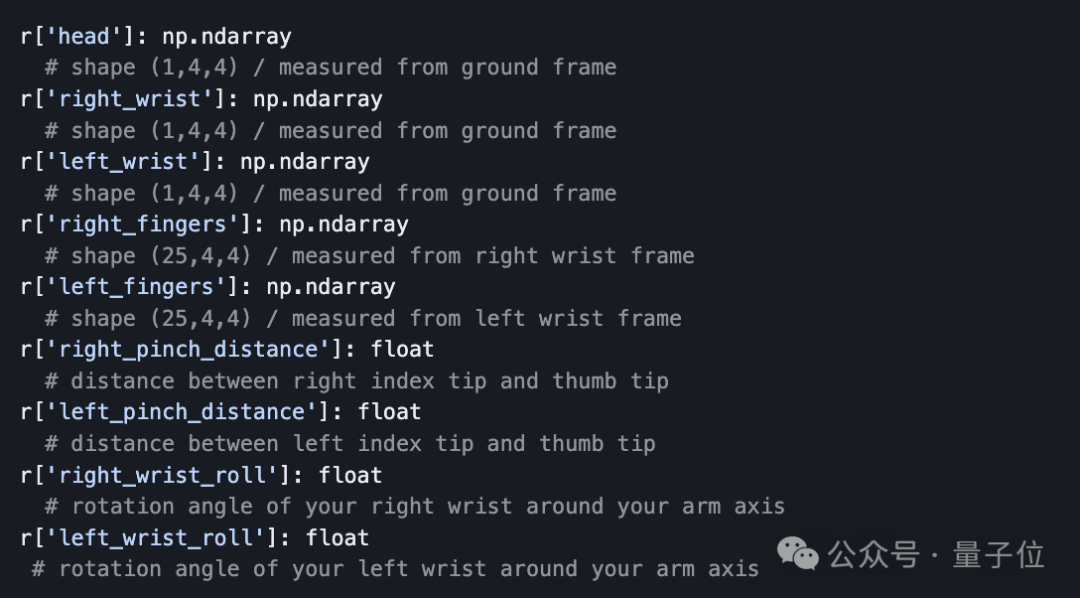

Selain itu, bagi memudahkan penghantaran data, penulis juga telah menyediakan Python API yang membolehkan pembangun melanggan dan menerima data penjejakan yang distrim daripada Vision Pro secara pemrograman.

Data yang dikembalikan oleh API adalah dalam bentuk kamus, termasuk maklumat postur SE (3) kepala, pergelangan tangan dan jari, iaitu kedudukan dan orientasi tiga dimensi. Pembangun boleh memproses data ini secara langsung dalam Python untuk analisis dan kawalan lanjut robot.

Seperti yang ditunjukkan oleh ramai profesional, tidak kira sama ada pergerakan anjing robot itu masih dikawal oleh manusia, sebenarnya, berbanding "kawalan" itu sendiri, digabungkan dengan algoritma pembelajaran tiruan, manusia lebih berkebolehan dalam proses ini seperti jurulatih robot.

Vision Pro menyediakan kaedah interaksi yang intuitif dan mudah dengan menjejaki pergerakan pengguna, membolehkan bukan profesional menyediakan data latihan yang tepat untuk robot.

Pengarang sendiri juga menulis dalam kertas:

Dalam masa terdekat, orang mungkin memakai peranti seperti Vision Pro seperti cermin mata harian.

Ini adalah sumber data yang menjanjikan dari mana robot boleh mempelajari cara manusia berinteraksi dengan dunia sebenar.

Akhir sekali, peringatan, jika anda ingin mencuba projek sumber terbuka ini, selain Vision Pro, anda juga perlu menyediakan:

- Akaun Pembangun Apple

- Aksesori Pembangun Vision Pro (Tali Pembangun, berharga $299)

- Komputer Mac dengan Xcode dipasang

Nampaknya Apple masih perlu mengaut keuntungan (doge) terlebih dahulu.

Pautan projek:https://github.com/Improbable-AI/VisionProTeleop?tab=readme-ov-file

Atas ialah kandungan terperinci Latih anjing robot anda dalam masa nyata dengan Vision Pro! Projek sumber terbuka pelajar PhD MIT menjadi popular. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1378

1378

52

52

Sumber terbuka! Di luar ZoeDepth! DepthFM: Anggaran kedalaman monokular yang cepat dan tepat!

Apr 03, 2024 pm 12:04 PM

Sumber terbuka! Di luar ZoeDepth! DepthFM: Anggaran kedalaman monokular yang cepat dan tepat!

Apr 03, 2024 pm 12:04 PM

0. Apakah fungsi artikel ini? Kami mencadangkan DepthFM: model anggaran kedalaman monokular generatif yang serba boleh dan pantas. Sebagai tambahan kepada tugas anggaran kedalaman tradisional, DepthFM juga menunjukkan keupayaan terkini dalam tugas hiliran seperti mengecat kedalaman. DepthFM cekap dan boleh mensintesis peta kedalaman dalam beberapa langkah inferens. Mari kita baca karya ini bersama-sama ~ 1. Tajuk maklumat kertas: DepthFM: FastMonocularDepthEstimationwithFlowMatching Pengarang: MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Tinggalkan seni bina pengekod-penyahkod dan gunakan model resapan untuk pengesanan tepi, yang lebih berkesan Universiti Teknologi Pertahanan Nasional mencadangkan DiffusionEdge

Feb 07, 2024 pm 10:12 PM

Tinggalkan seni bina pengekod-penyahkod dan gunakan model resapan untuk pengesanan tepi, yang lebih berkesan Universiti Teknologi Pertahanan Nasional mencadangkan DiffusionEdge

Feb 07, 2024 pm 10:12 PM

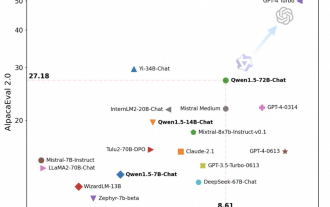

Rangkaian pengesanan tepi dalam semasa biasanya menggunakan seni bina penyahkod pengekod, yang mengandungi modul pensampelan atas dan bawah untuk mengekstrak ciri berbilang peringkat dengan lebih baik. Walau bagaimanapun, struktur ini mengehadkan rangkaian untuk mengeluarkan hasil pengesanan tepi yang tepat dan terperinci. Sebagai tindak balas kepada masalah ini, kertas kerja mengenai AAAI2024 menyediakan penyelesaian baharu. Tajuk tesis: DiffusionEdge:DiffusionProbabilisticModelforCrispEdgeDetection Penulis: Ye Yunfan (Universiti Teknologi Pertahanan Nasional), Xu Kai (Universiti Teknologi Pertahanan Kebangsaan), Huang Yuxing (Universiti Teknologi Pertahanan Nasional), Yi Renjiao (Universiti Teknologi Pertahanan Nasional), Cai Zhiping (Universiti Teknologi Pertahanan Negara) Pautan kertas: https ://ar

Tongyi Qianwen adalah sumber terbuka sekali lagi, Qwen1.5 membawakan enam model volum, dan prestasinya melebihi GPT3.5

Feb 07, 2024 pm 10:15 PM

Tongyi Qianwen adalah sumber terbuka sekali lagi, Qwen1.5 membawakan enam model volum, dan prestasinya melebihi GPT3.5

Feb 07, 2024 pm 10:15 PM

Pada masanya untuk Festival Musim Bunga, versi 1.5 Model Tongyi Qianwen (Qwen) berada dalam talian. Pagi ini, berita versi baharu itu menarik perhatian komuniti AI. Versi baharu model besar termasuk enam saiz model: 0.5B, 1.8B, 4B, 7B, 14B dan 72B. Antaranya, prestasi versi terkuat mengatasi GPT3.5 dan Mistral-Medium. Versi ini termasuk model Base dan model Sembang, dan menyediakan sokongan berbilang bahasa. Pasukan Tongyi Qianwen Alibaba menyatakan bahawa teknologi yang berkaitan juga telah dilancarkan di laman web rasmi Tongyi Qianwen dan Apl Tongyi Qianwen. Selain itu, keluaran Qwen 1.5 hari ini juga mempunyai sorotan berikut: menyokong panjang konteks 32K membuka pusat pemeriksaan model Base+Chat;

Model besar juga boleh dihiris, dan Microsoft SliceGPT sangat meningkatkan kecekapan pengiraan LLAMA-2

Jan 31, 2024 am 11:39 AM

Model besar juga boleh dihiris, dan Microsoft SliceGPT sangat meningkatkan kecekapan pengiraan LLAMA-2

Jan 31, 2024 am 11:39 AM

Model bahasa besar (LLM) biasanya mempunyai berbilion parameter dan dilatih menggunakan trilion token. Walau bagaimanapun, model sedemikian sangat mahal untuk dilatih dan digunakan. Untuk mengurangkan keperluan pengiraan, pelbagai teknik pemampatan model sering digunakan. Teknik pemampatan model ini secara amnya boleh dibahagikan kepada empat kategori: penyulingan, penguraian tensor (termasuk pemfaktoran peringkat rendah), pemangkasan dan kuantisasi. Kaedah pemangkasan telah wujud sejak sekian lama, tetapi banyak yang memerlukan penalaan halus pemulihan (RFT) selepas pemangkasan untuk mengekalkan prestasi, menjadikan keseluruhan proses mahal dan sukar untuk skala. Penyelidik dari ETH Zurich dan Microsoft telah mencadangkan penyelesaian kepada masalah ini yang dipanggil SliceGPT. Idea teras kaedah ini adalah untuk mengurangkan pembenaman rangkaian dengan memadamkan baris dan lajur dalam matriks berat.

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas secara rasmi memasuki era robot elektrik! Semalam, Atlas hidraulik hanya "menangis" menarik diri daripada peringkat sejarah Hari ini, Boston Dynamics mengumumkan bahawa Atlas elektrik sedang berfungsi. Nampaknya dalam bidang robot humanoid komersial, Boston Dynamics berazam untuk bersaing dengan Tesla. Selepas video baharu itu dikeluarkan, ia telah pun ditonton oleh lebih sejuta orang dalam masa sepuluh jam sahaja. Orang lama pergi dan peranan baru muncul. Ini adalah keperluan sejarah. Tidak dinafikan bahawa tahun ini adalah tahun letupan robot humanoid. Netizen mengulas: Kemajuan robot telah menjadikan majlis pembukaan tahun ini kelihatan seperti manusia, dan tahap kebebasan adalah jauh lebih besar daripada manusia Tetapi adakah ini benar-benar bukan filem seram? Pada permulaan video, Atlas berbaring dengan tenang di atas tanah, seolah-olah terlentang. Apa yang berikut adalah rahang-jatuh

Pengubah Titik Dikemas kini: lebih cekap, lebih pantas dan lebih berkuasa!

Jan 17, 2024 am 08:27 AM

Pengubah Titik Dikemas kini: lebih cekap, lebih pantas dan lebih berkuasa!

Jan 17, 2024 am 08:27 AM

Tajuk asal: PointTransformerV3: Pautan Kertas Lebih Ringkas, Pantas, Lebih Kuat: https://arxiv.org/pdf/2312.10035.pdf Pautan kod: https://github.com/Pointcept/PointTransformerV3 Unit pengarang: HKUSHAILabMPIPKUMIT Idea kertas: Artikel ini ialah tidak bertujuan untuk diterbitkan dalam Mencari inovasi dalam mekanisme perhatian. Sebaliknya, ia memberi tumpuan kepada memanfaatkan kuasa skala untuk mengatasi pertukaran sedia ada antara ketepatan dan kecekapan dalam konteks pemprosesan awan titik. Dapatkan inspirasi daripada kemajuan terkini dalam pembelajaran perwakilan berskala besar 3D,

Versi Kuaishou Sora 'Ke Ling' dibuka untuk ujian: menghasilkan video lebih 120-an, memahami fizik dengan lebih baik dan boleh memodelkan pergerakan kompleks dengan tepat

Jun 11, 2024 am 09:51 AM

Versi Kuaishou Sora 'Ke Ling' dibuka untuk ujian: menghasilkan video lebih 120-an, memahami fizik dengan lebih baik dan boleh memodelkan pergerakan kompleks dengan tepat

Jun 11, 2024 am 09:51 AM

Apa? Adakah Zootopia dibawa menjadi realiti oleh AI domestik? Didedahkan bersama-sama dengan video itu ialah model penjanaan video domestik berskala besar baharu yang dipanggil "Keling". Sora menggunakan laluan teknikal yang serupa dan menggabungkan beberapa inovasi teknologi yang dibangunkan sendiri untuk menghasilkan video yang bukan sahaja mempunyai pergerakan yang besar dan munasabah, tetapi juga mensimulasikan ciri-ciri dunia fizikal dan mempunyai keupayaan gabungan konsep dan imaginasi yang kuat. Mengikut data, Keling menyokong penjanaan video ultra panjang sehingga 2 minit pada 30fps, dengan resolusi sehingga 1080p dan menyokong berbilang nisbah aspek. Satu lagi perkara penting ialah Keling bukanlah demo atau demonstrasi hasil video yang dikeluarkan oleh makmal, tetapi aplikasi peringkat produk yang dilancarkan oleh Kuaishou, pemain terkemuka dalam bidang video pendek. Selain itu, tumpuan utama adalah untuk menjadi pragmatik, bukan untuk menulis cek kosong, dan pergi ke dalam talian sebaik sahaja ia dikeluarkan Model besar Ke Ling telah pun dikeluarkan di Kuaiying.

Daya hidup kecerdasan super membangkitkan! Tetapi dengan kedatangan AI yang mengemas kini sendiri, ibu tidak perlu lagi bimbang tentang kesesakan data

Apr 29, 2024 pm 06:55 PM

Daya hidup kecerdasan super membangkitkan! Tetapi dengan kedatangan AI yang mengemas kini sendiri, ibu tidak perlu lagi bimbang tentang kesesakan data

Apr 29, 2024 pm 06:55 PM

Saya menangis hingga mati. Dunia sedang membina model besar. Data di Internet tidak mencukupi. Model latihan kelihatan seperti "The Hunger Games", dan penyelidik AI di seluruh dunia bimbang tentang cara memberi makan data ini kepada pemakan yang rakus. Masalah ini amat ketara dalam tugas berbilang modal. Pada masa mereka mengalami kerugian, pasukan pemula dari Jabatan Universiti Renmin China menggunakan model baharu mereka sendiri untuk menjadi yang pertama di China untuk menjadikan "suapan data yang dijana model itu sendiri" menjadi kenyataan. Selain itu, ia merupakan pendekatan serampang dua mata dari segi pemahaman dan sisi penjanaan Kedua-dua pihak boleh menjana data baharu berbilang modal yang berkualiti tinggi dan memberikan maklum balas data kepada model itu sendiri. Apakah model? Awaker 1.0, model berbilang modal besar yang baru sahaja muncul di Forum Zhongguancun. Siapa pasukan itu? Enjin Sophon. Diasaskan oleh Gao Yizhao, pelajar kedoktoran di Sekolah Kecerdasan Buatan Hillhouse Universiti Renmin.