Peranti teknologi

Peranti teknologi

AI

AI

Penjelasan terperinci tentang Latte: video Vincent sumber terbuka pertama di dunia DiT dilancarkan pada penghujung tahun lepas

Penjelasan terperinci tentang Latte: video Vincent sumber terbuka pertama di dunia DiT dilancarkan pada penghujung tahun lepas

Penjelasan terperinci tentang Latte: video Vincent sumber terbuka pertama di dunia DiT dilancarkan pada penghujung tahun lepas

Dengan kejayaan pelancaran Sora, model video DiT telah menarik perhatian dan perbincangan yang meluas. Mereka bentuk rangkaian neural yang stabil dan berskala sangat besar sentiasa menjadi tumpuan penyelidikan dalam bidang penjanaan penglihatan. Kejayaan model DiT membawa kemungkinan baharu untuk menskalakan penjanaan imej.

Walau bagaimanapun, disebabkan sifat data video yang sangat berstruktur dan kompleks, memperluaskan DiT ke domain penjanaan video adalah tugas yang mencabar. Pasukan yang terdiri daripada pasukan penyelidik dari Makmal Kepintaran Buatan Shanghai dan institusi lain menjawab soalan ini melalui eksperimen berskala besar.

Pada November tahun lalu, pasukan itu telah mengeluarkan model yang dibangunkan sendiri dipanggil Latte, yang teknologinya serupa dengan Sora. Latte ialah DiT video Wensheng sumber terbuka pertama di dunia dan telah mendapat perhatian meluas. Banyak rangka kerja sumber terbuka seperti Pelan Open-Sora (PKU) dan Open-Sora (ColossalAI) menggunakan dan merujuk kepada reka bentuk model Latte.

- Pautan sumber terbuka: https://github.com/Vchitect/Latte

- Laman utama projek: https://maxin-cn.projek/lattehub.

- Pautan kertas: https://arxiv.org/pdf/2401.03048v1.pdf

Mula-mula, mari kita lihat kesan penjanaan video Latte.

Pengenalan kaedah

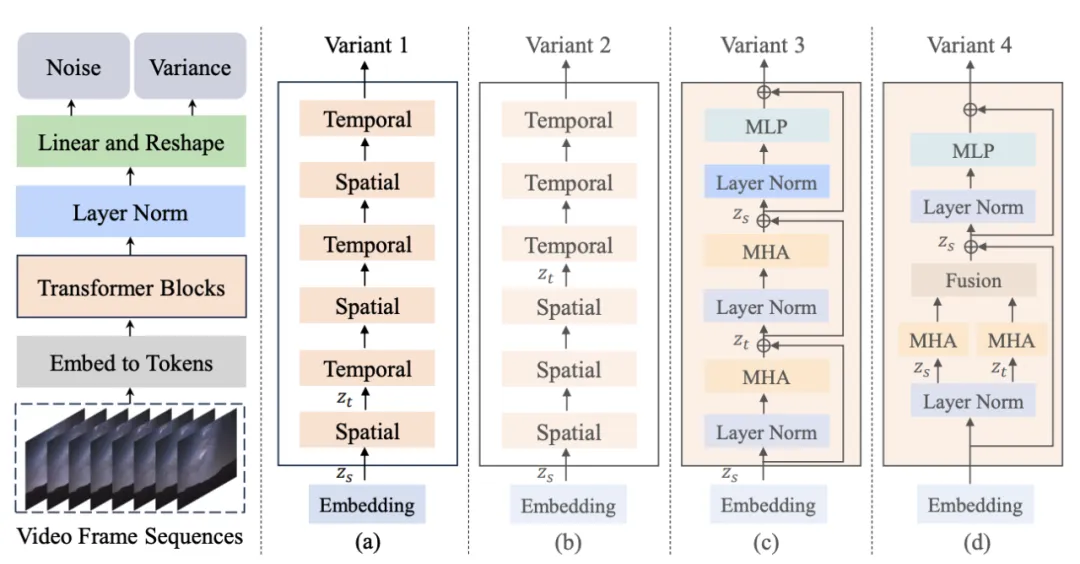

Secara amnya, Latte mengandungi dua modul utama: VAE terlatih dan DiT video. Dalam VAE yang telah dilatih, pengekod bertanggungjawab untuk memampatkan video daripada ruang piksel kepada bingkai ruang terpendam demi bingkai, manakala video DiT bertanggungjawab untuk mengekstrak token dan melaksanakan pemodelan spatiotemporal untuk memproses perwakilan terpendam Akhirnya, peta penyahkod VAE ciri ini kembali ke ruang Pixel untuk menjana video. Bagi mendapatkan kualiti video yang terbaik, penyelidik memfokuskan kepada dua aspek penting dalam reka bentuk Latte, iaitu reka bentuk struktur keseluruhan model DiT video dan butiran amalan terbaik latihan model. . modul direka bentuk dari perspektif mekanisme perhatian spatiotemporal, dan dua varian (Varian) dikaji dalam setiap modul:

1 Modul mekanisme perhatian tunggal, dalam setiap modul Mengandungi perhatian masa atau ruang sahaja.

Pemodelan jujukan ruang-masa (Varian 2): Modul masa diletakkan sepenuhnya selepas modul ruang.

2. Modul mekanisme perhatian berbilang, setiap modul mengandungi kedua-dua mekanisme perhatian temporal dan spatial (varian rujukan terbuka-sora).

- Mekanisme perhatian spatiotemporal bersiri (Varian 3): Pemodelan bersiri mekanisme perhatian spatiotemporal.

- Mekanisme perhatian spatiotemporal selari (Varian 4): Pemodelan selari dan gabungan ciri mekanisme perhatian spatiotemporal.

Eksperimen menunjukkan (Rajah 2) bahawa dengan menetapkan jumlah parameter yang sama untuk empat varian model, varian 4 mempunyai perbezaan yang ketara dalam FLOPS berbanding tiga varian lain, jadi ia juga mempunyai FVD tertinggi Prestasi keseluruhan tiga varian lain adalah serupa. Varian 1 mencapai prestasi terbaik.

Rajah 2. Struktur model FVD- (2) Penerokaan reka bentuk optimum model Latte dan butiran latihan (Amalan terbaik)

- kepada struktur keseluruhan model , penulis juga meneroka Faktor yang mempengaruhi kesan penjanaan dalam model lain dan latihan disertakan.

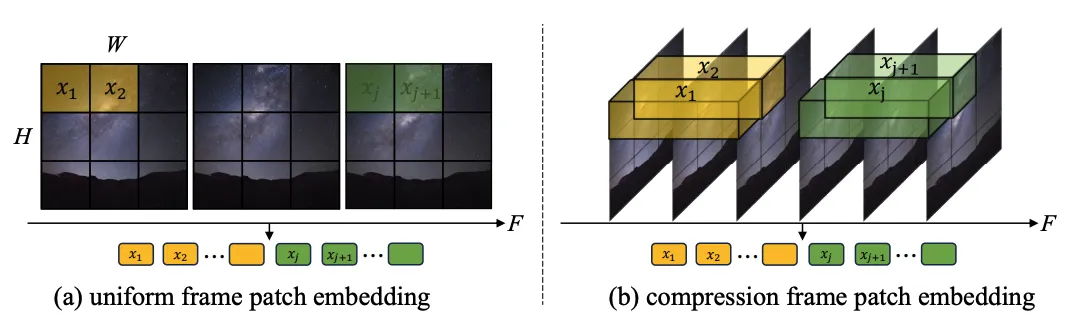

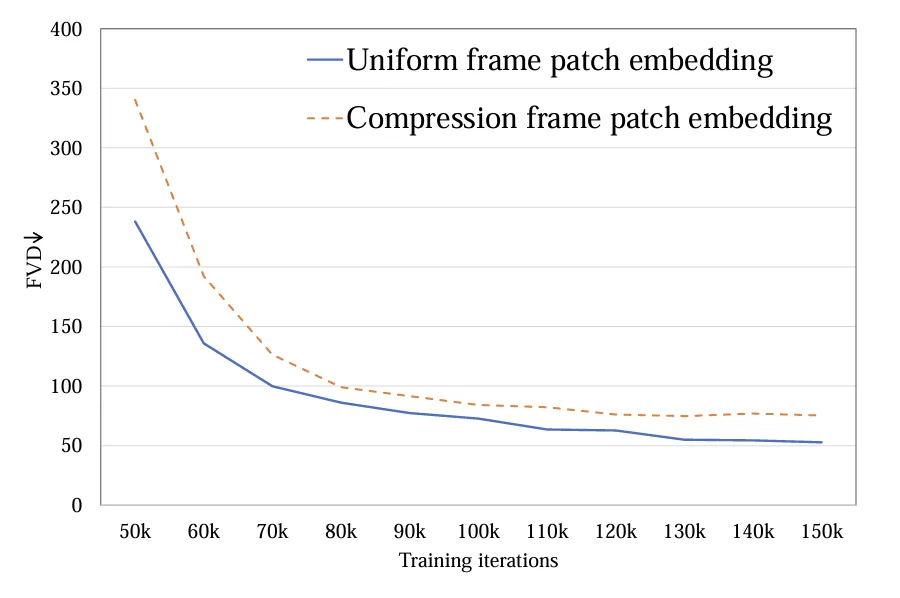

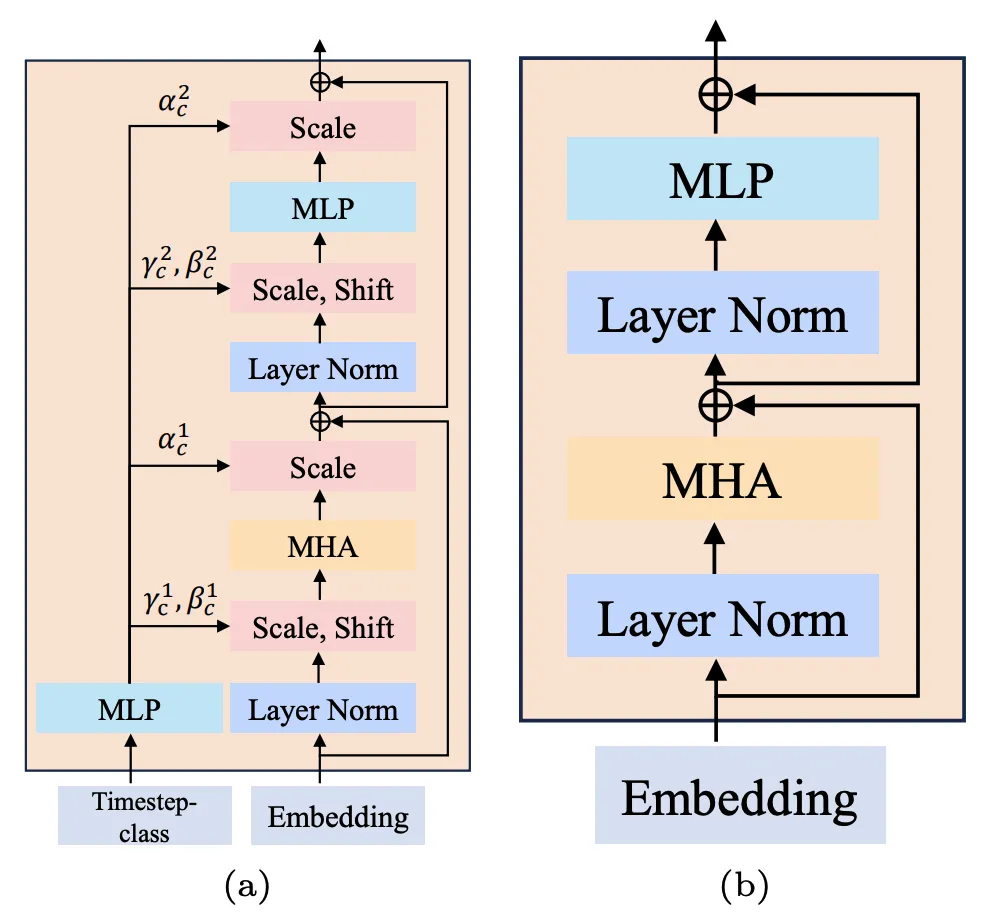

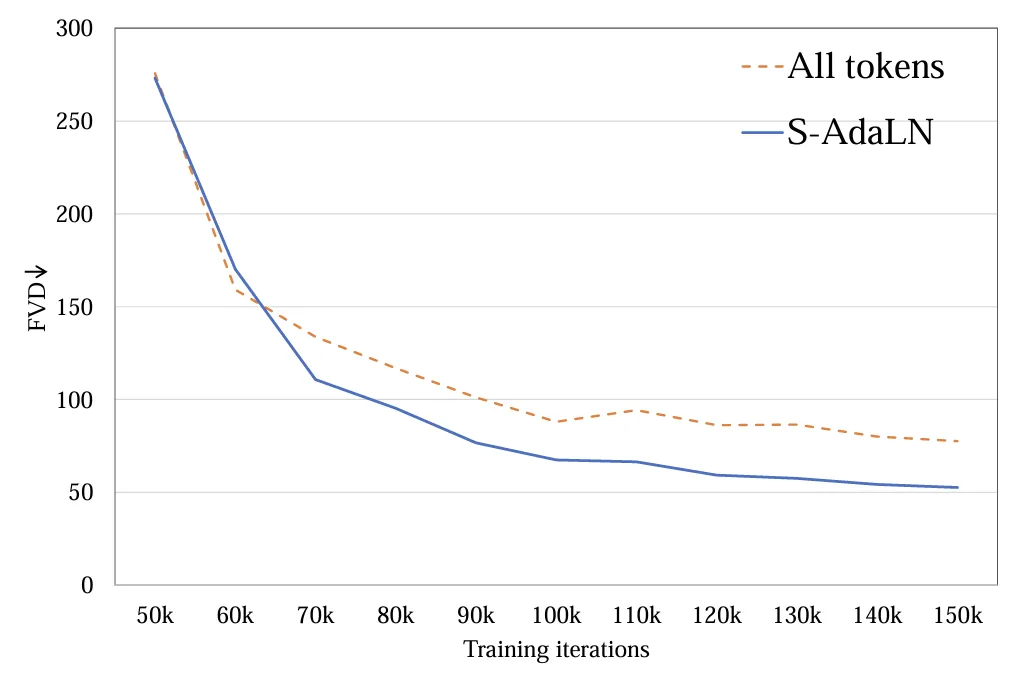

1.Pengestrakan token: Dua kaedah, token bingkai tunggal (a) dan token spatio-temporal (b), telah diterokai yang pertama hanya memampatkan token pada tahap spatial, manakala yang terakhir memampatkan maklumat spatio-temporal di. pada masa yang sama. Eksperimen menunjukkan bahawa token bingkai tunggal adalah lebih baik daripada token spatio-temporal (Rajah 4). Berbanding dengan Sora, pengarang membuat spekulasi bahawa token spatio-temporal yang dicadangkan oleh Sora telah dimampatkan terlebih dahulu dalam dimensi masa melalui video VAE, dan serupa dengan reka bentuk Latte dalam ruang terpendam, hanya pemprosesan token bingkai tunggal dilakukan. . Suntikan bersyarat mod : Dua kaedah, (a) S-AdaLN dan (b) semua token, telah diterokai (Rajah 5). S-AdaLN menukar maklumat keadaan kepada pembolehubah dalam normalisasi dan menyuntiknya ke dalam model melalui MLP. Borang Semua token menukar semua syarat menjadi token bersatu sebagai input kepada model. Eksperimen telah membuktikan bahawa kaedah S-AdaLN lebih berkesan dalam mendapatkan hasil yang berkualiti tinggi daripada semua token

(Rajah 6). Sebabnya ialah S-AdaLN membolehkan maklumat disuntik terus ke dalam setiap modul. Walau bagaimanapun, semua token perlu menghantar maklumat bersyarat dari input ke lapisan akhir demi lapisan, dan terdapat kehilangan dalam proses aliran maklumat.

Rajah 5. (a) S-AdaLN dan (b) semua token.

Rajah 6. Kaedah suntikan bersyarat FVD

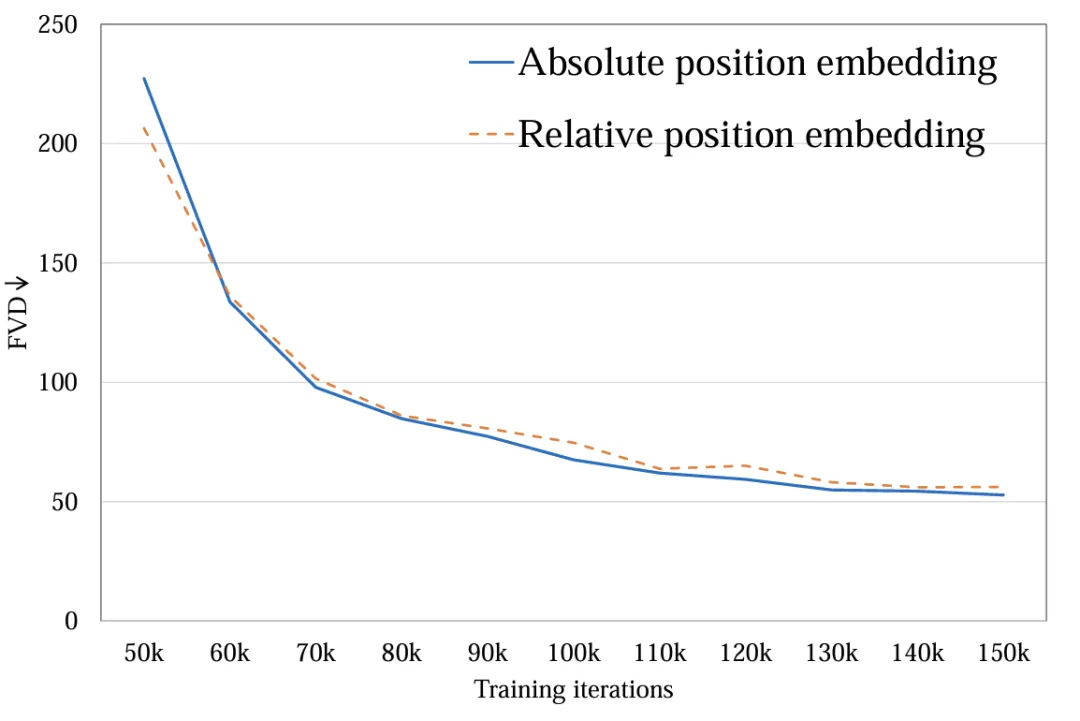

3 Pengekodan kedudukan spatial dan temporal: Terokai pengekodan kedudukan mutlak dan pengekodan kedudukan relatif. Pengekodan kedudukan yang berbeza mempunyai sedikit kesan pada kualiti video akhir

(Rajah 7). Oleh kerana tempoh penjanaan yang singkat, perbezaan dalam pengekodan kedudukan tidak mencukupi untuk menjejaskan kualiti video Untuk penjanaan video yang panjang, faktor ini perlu dipertimbangkan semula. . Eksperimen menunjukkan bahawa model yang dimulakan menggunakan ImageNet mempunyai kelajuan penumpuan yang lebih pantas, namun, apabila latihan berlangsung, model yang dimulakan secara rawak mencapai hasil yang lebih baik (Rajah 8). Sebab yang mungkin ialah terdapat perbezaan pengedaran yang agak besar antara ImageNet dan set latihan FaceForensics, jadi ia gagal mempromosikan hasil akhir model. Untuk tugasan video Vincent, kesimpulan ini perlu dipertimbangkan semula. Dalam pengedaran set data am, pengedaran spatial kandungan imej dan video adalah serupa, dan penggunaan model T2I yang telah terlatih boleh mempromosikan T2V dengan banyak.

Figure 8. Parameter Inisialisasi FVD

5. token imej hanya bertanggungjawab untuk pengoptimuman parameter spatial. Latihan bersama telah meningkatkan keputusan akhir dengan ketara

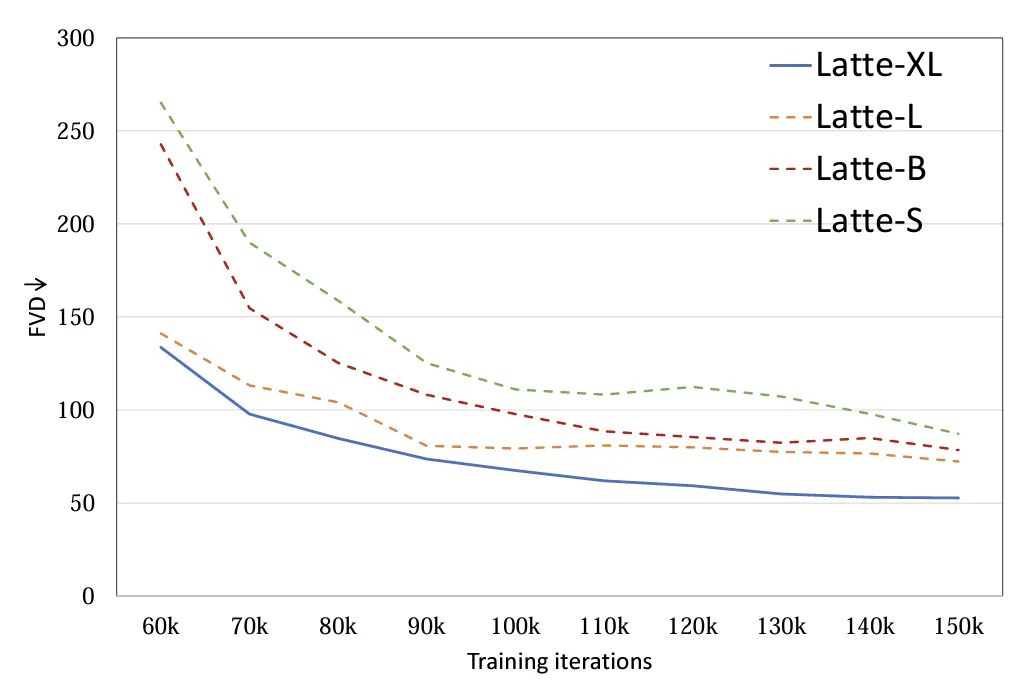

(Jadual 2 dan Jadual 3). Kedua-dua gambar FID dan video FVD telah dikurangkan melalui latihan bersama Keputusan ini konsisten dengan rangka kerja berasaskan UNet [2][3] adalah konsisten.6. Saiz Model: 4 saiz model yang berbeza telah diterokai, S, B, L dan XL (Jadual 1). Memperluas skala video DiT akan membantu meningkatkan kualiti sampel yang dijana dengan ketara

(Rajah 9). Kesimpulan ini juga membuktikan ketepatan penggunaan struktur Transformer dalam model penyebaran video untuk penskalaan seterusnya.

Jadual 1. Skala model latte pelbagai saiz

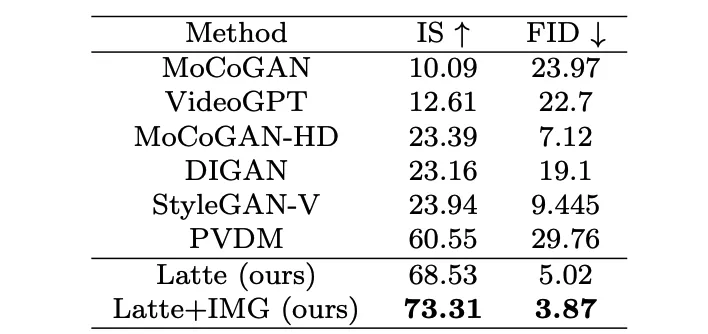

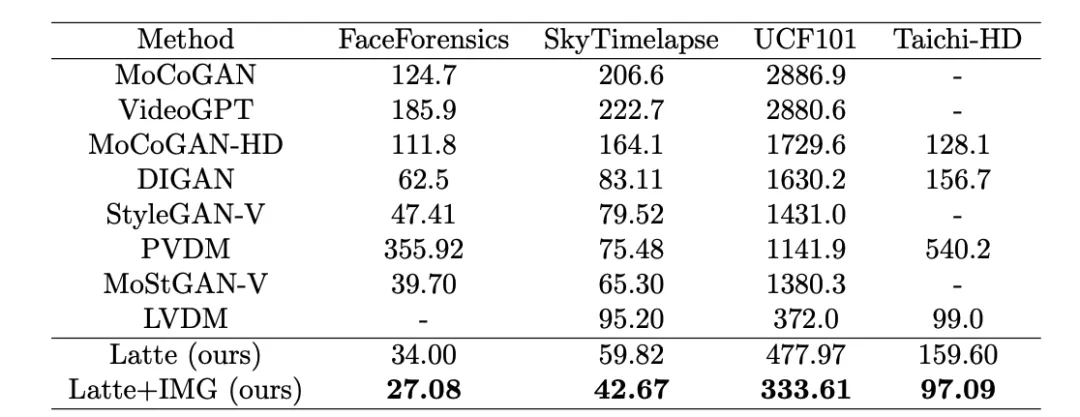

. Keputusan kualitatif dan kuantitatif (Jadual 2 dan Jadual 3) menunjukkan Latte mencapai prestasi terbaik, yang membuktikan reka bentuk keseluruhan model adalah cemerlang.

Untuk bukti lanjut Untuk prestasi umum Latte, penulis melanjutkan Latte kepada tugasan video Vincent, menggunakan model PixArt-alpha [4] yang telah dilatih sebagai permulaan parameter spatial Menurut prinsip reka bentuk optimum, selepas tempoh latihan, Latte pada mulanya telah mencapai keupayaan video Vincent. Pelan susulan adalah untuk mengesahkan had atas keupayaan penjanaan Latte dengan meningkatkan. Latte, sebagai sumber terbuka video Vincent DiT yang pertama di dunia, telah mencapai hasil yang memberangsangkan, bagaimanapun, disebabkan perbezaan besar dalam sumber pengkomputeran, terdapat masalah dalam kejelasan, kelancaran dan tempoh penjanaan. Masih terdapat jurang yang besar berbanding dengan Sora. Pasukan ini mengalu-alukan dan secara aktif mencari kerjasama dalam semua jenis, berharap dapat menggunakan kuasa sumber terbuka untuk mencipta model penjanaan video universal berskala besar yang dibangunkan sendiri dengan prestasi cemerlang.

Jadual 2. Penilaian kualiti gambar UCF101

Jadual 3. Latte dan SoTA kualiti video. Sambungan

Jadual 3. Latte dan SoTA kualiti video. Sambungan  Perbincangan dan Ringkasan

Perbincangan dan Ringkasan

Atas ialah kandungan terperinci Penjelasan terperinci tentang Latte: video Vincent sumber terbuka pertama di dunia DiT dilancarkan pada penghujung tahun lepas. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1376

1376

52

52

Sumber terbuka! Di luar ZoeDepth! DepthFM: Anggaran kedalaman monokular yang cepat dan tepat!

Apr 03, 2024 pm 12:04 PM

Sumber terbuka! Di luar ZoeDepth! DepthFM: Anggaran kedalaman monokular yang cepat dan tepat!

Apr 03, 2024 pm 12:04 PM

0. Apakah fungsi artikel ini? Kami mencadangkan DepthFM: model anggaran kedalaman monokular generatif yang serba boleh dan pantas. Sebagai tambahan kepada tugas anggaran kedalaman tradisional, DepthFM juga menunjukkan keupayaan terkini dalam tugas hiliran seperti mengecat kedalaman. DepthFM cekap dan boleh mensintesis peta kedalaman dalam beberapa langkah inferens. Mari kita baca karya ini bersama-sama ~ 1. Tajuk maklumat kertas: DepthFM: FastMonocularDepthEstimationwithFlowMatching Pengarang: MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Bayangkan model kecerdasan buatan yang bukan sahaja mempunyai keupayaan untuk mengatasi pengkomputeran tradisional, tetapi juga mencapai prestasi yang lebih cekap pada kos yang lebih rendah. Ini bukan fiksyen sains, DeepSeek-V2[1], model MoE sumber terbuka paling berkuasa di dunia ada di sini. DeepSeek-V2 ialah gabungan model bahasa pakar (MoE) yang berkuasa dengan ciri-ciri latihan ekonomi dan inferens yang cekap. Ia terdiri daripada 236B parameter, 21B daripadanya digunakan untuk mengaktifkan setiap penanda. Berbanding dengan DeepSeek67B, DeepSeek-V2 mempunyai prestasi yang lebih kukuh, sambil menjimatkan 42.5% kos latihan, mengurangkan cache KV sebanyak 93.3% dan meningkatkan daya pemprosesan penjanaan maksimum kepada 5.76 kali. DeepSeek ialah sebuah syarikat yang meneroka kecerdasan buatan am

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas secara rasmi memasuki era robot elektrik! Semalam, Atlas hidraulik hanya "menangis" menarik diri daripada peringkat sejarah Hari ini, Boston Dynamics mengumumkan bahawa Atlas elektrik sedang berfungsi. Nampaknya dalam bidang robot humanoid komersial, Boston Dynamics berazam untuk bersaing dengan Tesla. Selepas video baharu itu dikeluarkan, ia telah pun ditonton oleh lebih sejuta orang dalam masa sepuluh jam sahaja. Orang lama pergi dan peranan baru muncul. Ini adalah keperluan sejarah. Tidak dinafikan bahawa tahun ini adalah tahun letupan robot humanoid. Netizen mengulas: Kemajuan robot telah menjadikan majlis pembukaan tahun ini kelihatan seperti manusia, dan tahap kebebasan adalah jauh lebih besar daripada manusia Tetapi adakah ini benar-benar bukan filem seram? Pada permulaan video, Atlas berbaring dengan tenang di atas tanah, seolah-olah terlentang. Apa yang berikut adalah rahang-jatuh

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

Awal bulan ini, penyelidik dari MIT dan institusi lain mencadangkan alternatif yang sangat menjanjikan kepada MLP - KAN. KAN mengatasi MLP dari segi ketepatan dan kebolehtafsiran. Dan ia boleh mengatasi prestasi MLP berjalan dengan bilangan parameter yang lebih besar dengan bilangan parameter yang sangat kecil. Sebagai contoh, penulis menyatakan bahawa mereka menggunakan KAN untuk menghasilkan semula keputusan DeepMind dengan rangkaian yang lebih kecil dan tahap automasi yang lebih tinggi. Khususnya, MLP DeepMind mempunyai kira-kira 300,000 parameter, manakala KAN hanya mempunyai kira-kira 200 parameter. KAN mempunyai asas matematik yang kukuh seperti MLP berdasarkan teorem penghampiran universal, manakala KAN berdasarkan teorem perwakilan Kolmogorov-Arnold. Seperti yang ditunjukkan dalam rajah di bawah, KAN telah

Apr 09, 2024 am 11:52 AM

Apr 09, 2024 am 11:52 AM

AI memang mengubah matematik. Baru-baru ini, Tao Zhexuan, yang telah mengambil perhatian terhadap isu ini, telah memajukan keluaran terbaru "Buletin Persatuan Matematik Amerika" (Buletin Persatuan Matematik Amerika). Memfokuskan pada topik "Adakah mesin akan mengubah matematik?", ramai ahli matematik menyatakan pendapat mereka Seluruh proses itu penuh dengan percikan api, tegar dan menarik. Penulis mempunyai barisan yang kuat, termasuk pemenang Fields Medal Akshay Venkatesh, ahli matematik China Zheng Lejun, saintis komputer NYU Ernest Davis dan ramai lagi sarjana terkenal dalam industri. Dunia AI telah berubah secara mendadak Anda tahu, banyak artikel ini telah dihantar setahun yang lalu.

Versi Kuaishou Sora 'Ke Ling' dibuka untuk ujian: menghasilkan video lebih 120-an, memahami fizik dengan lebih baik dan boleh memodelkan pergerakan kompleks dengan tepat

Jun 11, 2024 am 09:51 AM

Versi Kuaishou Sora 'Ke Ling' dibuka untuk ujian: menghasilkan video lebih 120-an, memahami fizik dengan lebih baik dan boleh memodelkan pergerakan kompleks dengan tepat

Jun 11, 2024 am 09:51 AM

Apa? Adakah Zootopia dibawa menjadi realiti oleh AI domestik? Didedahkan bersama-sama dengan video itu ialah model penjanaan video domestik berskala besar baharu yang dipanggil "Keling". Sora menggunakan laluan teknikal yang serupa dan menggabungkan beberapa inovasi teknologi yang dibangunkan sendiri untuk menghasilkan video yang bukan sahaja mempunyai pergerakan yang besar dan munasabah, tetapi juga mensimulasikan ciri-ciri dunia fizikal dan mempunyai keupayaan gabungan konsep dan imaginasi yang kuat. Mengikut data, Keling menyokong penjanaan video ultra panjang sehingga 2 minit pada 30fps, dengan resolusi sehingga 1080p dan menyokong berbilang nisbah aspek. Satu lagi perkara penting ialah Keling bukanlah demo atau demonstrasi hasil video yang dikeluarkan oleh makmal, tetapi aplikasi peringkat produk yang dilancarkan oleh Kuaishou, pemain terkemuka dalam bidang video pendek. Selain itu, tumpuan utama adalah untuk menjadi pragmatik, bukan untuk menulis cek kosong, dan pergi ke dalam talian sebaik sahaja ia dikeluarkan Model besar Ke Ling telah pun dikeluarkan di Kuaiying.

Daya hidup kecerdasan super membangkitkan! Tetapi dengan kedatangan AI yang mengemas kini sendiri, ibu tidak perlu lagi bimbang tentang kesesakan data

Apr 29, 2024 pm 06:55 PM

Daya hidup kecerdasan super membangkitkan! Tetapi dengan kedatangan AI yang mengemas kini sendiri, ibu tidak perlu lagi bimbang tentang kesesakan data

Apr 29, 2024 pm 06:55 PM

Saya menangis hingga mati. Dunia sedang membina model besar. Data di Internet tidak mencukupi. Model latihan kelihatan seperti "The Hunger Games", dan penyelidik AI di seluruh dunia bimbang tentang cara memberi makan data ini kepada pemakan yang rakus. Masalah ini amat ketara dalam tugas berbilang modal. Pada masa mereka mengalami kerugian, pasukan pemula dari Jabatan Universiti Renmin China menggunakan model baharu mereka sendiri untuk menjadi yang pertama di China untuk menjadikan "suapan data yang dijana model itu sendiri" menjadi kenyataan. Selain itu, ia merupakan pendekatan serampang dua mata dari segi pemahaman dan sisi penjanaan Kedua-dua pihak boleh menjana data baharu berbilang modal yang berkualiti tinggi dan memberikan maklum balas data kepada model itu sendiri. Apakah model? Awaker 1.0, model berbilang modal besar yang baru sahaja muncul di Forum Zhongguancun. Siapa pasukan itu? Enjin Sophon. Diasaskan oleh Gao Yizhao, pelajar kedoktoran di Sekolah Kecerdasan Buatan Hillhouse Universiti Renmin.

Tentera Udara A.S. mempamerkan jet pejuang AI pertamanya dengan profil tinggi! Menteri secara peribadi menjalankan pandu uji tanpa campur tangan semasa keseluruhan proses, dan 100,000 baris kod telah diuji selama 21 kali.

May 07, 2024 pm 05:00 PM

Tentera Udara A.S. mempamerkan jet pejuang AI pertamanya dengan profil tinggi! Menteri secara peribadi menjalankan pandu uji tanpa campur tangan semasa keseluruhan proses, dan 100,000 baris kod telah diuji selama 21 kali.

May 07, 2024 pm 05:00 PM

Baru-baru ini, bulatan tentera telah terharu dengan berita: jet pejuang tentera AS kini boleh melengkapkan pertempuran udara automatik sepenuhnya menggunakan AI. Ya, baru-baru ini, jet pejuang AI tentera AS telah didedahkan buat pertama kali, mendedahkan misterinya. Nama penuh pesawat pejuang ini ialah Variable Stability Simulator Test Aircraft (VISTA). Ia diterbangkan sendiri oleh Setiausaha Tentera Udara AS untuk mensimulasikan pertempuran udara satu lawan satu. Pada 2 Mei, Setiausaha Tentera Udara A.S. Frank Kendall berlepas menggunakan X-62AVISTA di Pangkalan Tentera Udara Edwards Ambil perhatian bahawa semasa penerbangan selama satu jam, semua tindakan penerbangan telah diselesaikan secara autonomi oleh AI! Kendall berkata - "Sejak beberapa dekad yang lalu, kami telah memikirkan tentang potensi tanpa had pertempuran udara-ke-udara autonomi, tetapi ia sentiasa kelihatan di luar jangkauan." Namun kini,