Tiga rahsia untuk menggunakan model besar dalam awan

. . Saya mula merindui pengkomputeran awan tanpa pelayan. Aplikasi mereka terdiri daripada meningkatkan AI perbualan kepada menyediakan penyelesaian analitik yang kompleks untuk pelbagai industri, dan banyak lagi keupayaan lain. Banyak perusahaan menggunakan model ini pada platform awan kerana penyedia awan awam sudah menyediakan ekosistem siap sedia dan ia merupakan laluan yang paling tidak mempunyai rintangan. Walau bagaimanapun, ia tidak murah.

Awan juga menyediakan faedah lain seperti kebolehskalaan, kecekapan dan kuasa pengkomputeran lanjutan (GPU atas permintaan). Proses menggunakan LLM pada platform awan awam mempunyai beberapa rahsia yang kurang diketahui yang boleh memberi impak yang besar kepada kejayaan atau kegagalan. Mungkin kerana tidak ramai pakar AI yang berurusan dengan LLM, dan kerana kami belum mempunyai banyak pengalaman dalam bidang ini, terdapat banyak jurang dalam sistem pengetahuan kami.

Awan juga menyediakan faedah lain seperti kebolehskalaan, kecekapan dan kuasa pengkomputeran lanjutan (GPU atas permintaan). Proses menggunakan LLM pada platform awan awam mempunyai beberapa rahsia yang kurang diketahui yang boleh memberi impak yang besar kepada kejayaan atau kegagalan. Mungkin kerana tidak ramai pakar AI yang berurusan dengan LLM, dan kerana kami belum mempunyai banyak pengalaman dalam bidang ini, terdapat banyak jurang dalam sistem pengetahuan kami.

Alat orkestrasi yang menyokong penggunaan stateful (seperti Kubernetes) sangat membantu. Mereka boleh memanfaatkan pilihan storan berterusan untuk model bahasa yang besar dan dikonfigurasikan untuk mengekalkan dan memanipulasi keadaan mereka merentas sesi. Anda perlu melakukan ini untuk menyokong kesinambungan dan prestasi model bahasa yang besar.

Dengan pertumbuhan pesat kecerdasan buatan generatif, menggunakan model bahasa besar pada platform awan adalah satu kesimpulan yang tidak dapat dielakkan. Bagi kebanyakan perniagaan, tidak menggunakan awan adalah terlalu menyusahkan. Kebimbangan saya tentang kegilaan yang seterusnya ialah kita akan terlepas beberapa masalah yang mudah diselesaikan dan membuat kesilapan besar dan mahal yang kebanyakannya boleh dielakkan pada akhirnya.

Untuk mengetahui lebih lanjut tentang AIGC, sila layari:

51CTO AI.x Community

https://www.51cto.com/aigc/

Atas ialah kandungan terperinci Tiga rahsia untuk menggunakan model besar dalam awan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1377

1377

52

52

Fahami Tokenisasi dalam satu artikel!

Apr 12, 2024 pm 02:31 PM

Fahami Tokenisasi dalam satu artikel!

Apr 12, 2024 pm 02:31 PM

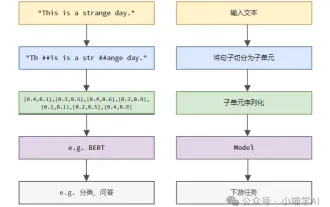

Model bahasa menaakul tentang teks, yang biasanya dalam bentuk rentetan, tetapi input kepada model hanya boleh menjadi nombor, jadi teks perlu ditukar kepada bentuk berangka. Tokenisasi ialah tugas asas pemprosesan bahasa semula jadi Mengikut keperluan khusus, urutan teks berterusan (seperti ayat, perenggan, dll.) boleh dibahagikan kepada urutan aksara (seperti perkataan, frasa, aksara, tanda baca, dsb. berbilang. unit), di mana unit Dipanggil token atau perkataan. Mengikut proses khusus yang ditunjukkan dalam rajah di bawah, ayat teks mula-mula dibahagikan kepada unit, kemudian elemen tunggal didigitalkan (dipetakan ke dalam vektor), kemudian vektor ini dimasukkan ke dalam model untuk pengekodan, dan akhirnya output ke tugas hiliran untuk seterusnya memperoleh keputusan akhir. Pembahagian teks boleh dibahagikan kepada Toke mengikut butiran pembahagian teks.

Cara menggunakan Vue untuk penyulitan data dan penghantaran selamat

Aug 02, 2023 pm 02:58 PM

Cara menggunakan Vue untuk penyulitan data dan penghantaran selamat

Aug 02, 2023 pm 02:58 PM

Cara menggunakan Vue untuk penyulitan data dan penghantaran selamat Pengenalan: Dengan perkembangan Internet, keselamatan data telah mendapat lebih banyak perhatian. Dalam pembangunan aplikasi web, penyulitan data dan penghantaran selamat adalah cara penting untuk melindungi privasi pengguna dan maklumat sensitif. Sebagai rangka kerja JavaScript yang popular, Vue menyediakan pelbagai alatan dan pemalam yang boleh membantu kami mencapai penyulitan data dan penghantaran selamat. Artikel ini akan memperkenalkan cara menggunakan Vue untuk penyulitan data dan penghantaran selamat, dan menyediakan contoh kod untuk rujukan. 1. Penyulitan data dan penyulitan data

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Untuk menyediakan tanda aras dan sistem penilaian menjawab soalan saintifik dan kompleks baharu untuk model besar, UNSW, Argonne, University of Chicago dan institusi lain bersama-sama melancarkan rangka kerja SciQAG

Jul 25, 2024 am 06:42 AM

Editor |ScienceAI Question Answering (QA) set data memainkan peranan penting dalam mempromosikan penyelidikan pemprosesan bahasa semula jadi (NLP). Set data QA berkualiti tinggi bukan sahaja boleh digunakan untuk memperhalusi model, tetapi juga menilai dengan berkesan keupayaan model bahasa besar (LLM), terutamanya keupayaan untuk memahami dan menaakul tentang pengetahuan saintifik. Walaupun pada masa ini terdapat banyak set data QA saintifik yang meliputi bidang perubatan, kimia, biologi dan bidang lain, set data ini masih mempunyai beberapa kekurangan. Pertama, borang data adalah agak mudah, kebanyakannya adalah soalan aneka pilihan. Ia mudah dinilai, tetapi mengehadkan julat pemilihan jawapan model dan tidak dapat menguji sepenuhnya keupayaan model untuk menjawab soalan saintifik. Sebaliknya, Soal Jawab terbuka

Penalaan halus parameter yang cekap bagi model bahasa berskala besar--siri penalaan halus BitFit/Awalan/Prompt

Oct 07, 2023 pm 12:13 PM

Penalaan halus parameter yang cekap bagi model bahasa berskala besar--siri penalaan halus BitFit/Awalan/Prompt

Oct 07, 2023 pm 12:13 PM

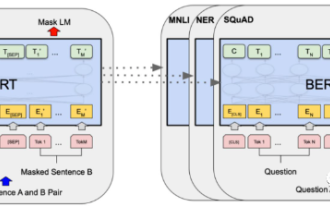

Pada tahun 2018, Google mengeluarkan BERT Sebaik sahaja ia dikeluarkan, ia mengalahkan keputusan terkini (Sota) bagi 11 tugasan NLP dalam satu masa, menjadi satu kejayaan baharu dalam dunia NLP dalam rajah di bawah. Di sebelah kiri ialah pratetap model BERT Proses latihan, di sebelah kanan ialah proses penalaan halus untuk tugasan tertentu. Antaranya, peringkat penalaan halus adalah untuk penalaan halus apabila ia kemudiannya digunakan dalam beberapa tugas hiliran, seperti klasifikasi teks, penandaan sebahagian daripada pertuturan, sistem soal jawab, dsb. BERT boleh diperhalusi pada pelbagai tugas tanpa melaraskan struktur. Melalui reka bentuk tugas "model bahasa pra-latihan + penalaan halus tugas hiliran", ia membawa kesan model yang berkuasa. Sejak itu, "model bahasa pra-latihan + penalaan tugas hiliran" telah menjadi latihan arus perdana dalam bidang NLP.

Tiga rahsia untuk menggunakan model besar dalam awan

Apr 24, 2024 pm 03:00 PM

Tiga rahsia untuk menggunakan model besar dalam awan

Apr 24, 2024 pm 03:00 PM

Kompilasi|Dihasilkan oleh Xingxuan|51CTO Technology Stack (WeChat ID: blog51cto) Dalam dua tahun lalu, saya lebih terlibat dalam projek AI generatif menggunakan model bahasa besar (LLM) berbanding sistem tradisional. Saya mula merindui pengkomputeran awan tanpa pelayan. Aplikasi mereka terdiri daripada meningkatkan AI perbualan kepada menyediakan penyelesaian analitik yang kompleks untuk pelbagai industri, dan banyak lagi keupayaan lain. Banyak perusahaan menggunakan model ini pada platform awan kerana penyedia awan awam sudah menyediakan ekosistem siap sedia dan ia merupakan laluan yang paling tidak mempunyai rintangan. Walau bagaimanapun, ia tidak murah. Awan juga menawarkan faedah lain seperti kebolehskalaan, kecekapan dan keupayaan pengkomputeran lanjutan (GPU tersedia atas permintaan). Terdapat beberapa aspek yang kurang diketahui untuk menggunakan LLM pada platform awan awam

Satu artikel untuk memahami cabaran teknikal dan strategi pengoptimuman untuk memperhalusi model bahasa besar

Mar 20, 2024 pm 11:01 PM

Satu artikel untuk memahami cabaran teknikal dan strategi pengoptimuman untuk memperhalusi model bahasa besar

Mar 20, 2024 pm 11:01 PM

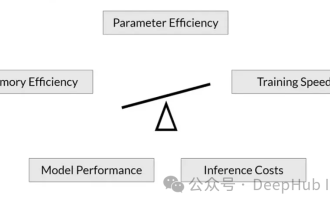

Hello semua, nama saya Luga. Hari ini kami akan terus meneroka teknologi dalam ekosistem kecerdasan buatan, terutamanya LLMFine-Tuning. Artikel ini akan terus menganalisis teknologi LLMFine-Tuning secara mendalam untuk membantu semua orang memahami mekanisme pelaksanaannya dengan lebih baik supaya ia boleh digunakan dengan lebih baik pada pembangunan pasaran dan bidang lain. LLM (LargeLanguageModels) menerajui gelombang baharu teknologi kecerdasan buatan. AI lanjutan ini mensimulasikan kebolehan kognitif dan bahasa manusia dengan menganalisis sejumlah besar data menggunakan model statistik untuk mempelajari corak kompleks antara perkataan dan frasa. Fungsi berkuasa LLM telah menimbulkan minat yang kuat daripada banyak syarikat terkemuka dan peminat teknologi, yang tergesa-gesa untuk menerima pakai yang didorong oleh kecerdasan buatan ini

RoSA: Kaedah baharu untuk penalaan halus parameter model besar yang cekap

Jan 18, 2024 pm 05:27 PM

RoSA: Kaedah baharu untuk penalaan halus parameter model besar yang cekap

Jan 18, 2024 pm 05:27 PM

Apabila model bahasa berskala ke skala yang belum pernah berlaku sebelum ini, penalaan halus menyeluruh untuk tugas hiliran menjadi sangat mahal. Bagi menyelesaikan masalah ini, penyelidik mula memberi perhatian dan mengamalkan kaedah PEFT. Idea utama kaedah PEFT adalah untuk mengehadkan skop penalaan halus kepada set kecil parameter untuk mengurangkan kos pengiraan sambil masih mencapai prestasi terkini dalam tugas pemahaman bahasa semula jadi. Dengan cara ini, penyelidik boleh menjimatkan sumber pengkomputeran sambil mengekalkan prestasi tinggi, membawa tempat tumpuan penyelidikan baharu ke bidang pemprosesan bahasa semula jadi. RoSA ialah teknik PEFT baharu yang, melalui eksperimen pada satu set penanda aras, didapati mengatasi prestasi penyesuaian peringkat rendah (LoRA) sebelumnya dan kaedah penalaan halus tulen yang jarang menggunakan belanjawan parameter yang sama. Artikel ini akan pergi secara mendalam

Melatih ViT terbesar dalam sejarah dengan mudah? Google meningkatkan model bahasa visual PaLI: menyokong 100+ bahasa

Apr 12, 2023 am 09:31 AM

Melatih ViT terbesar dalam sejarah dengan mudah? Google meningkatkan model bahasa visual PaLI: menyokong 100+ bahasa

Apr 12, 2023 am 09:31 AM

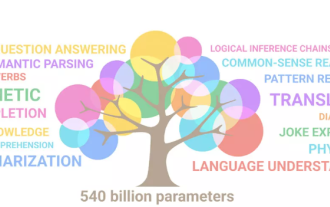

Kemajuan pemprosesan bahasa semula jadi dalam beberapa tahun kebelakangan ini sebahagian besarnya datang daripada model bahasa berskala besar Setiap model baharu yang dikeluarkan mendorong jumlah parameter dan data latihan ke tahap tertinggi baharu, dan pada masa yang sama, kedudukan penanda aras yang sedia ada akan disembelih. Sebagai contoh, pada April tahun ini, Google mengeluarkan model bahasa 540 bilion parameter PaLM (Model Bahasa Laluan), yang berjaya mengatasi manusia dalam satu siri ujian bahasa dan penaakulan, terutamanya prestasi cemerlangnya dalam senario pembelajaran sampel kecil beberapa pukulan. PaLM dianggap sebagai hala tuju pembangunan model bahasa generasi akan datang. Dengan cara yang sama, model bahasa visual sebenarnya berfungsi dengan hebat, dan prestasi boleh dipertingkatkan dengan meningkatkan saiz model. Sudah tentu, jika ia hanya model bahasa visual pelbagai tugas